Passamos 3 dias experimentando fluxos de trabalho e pipelines de agentes no n8n, seguindo os guias de Anthropic e OpenAI sobre como construir agentes de IA eficazes. 1 2

Explore os principais componentes do agente de IA , como escolher os componentes e ferramentas certos, além de criar fluxos de trabalho de agentes com base nos padrões simples e componíveis de Anthropic, como encadeamento de prompts, roteamento, paralelização, trabalhadores orquestradores e um avaliador-otimizador:

Compreendendo os componentes dos agentes de IA

A construção de agentes envolve a conexão de componentes em diversos domínios, como modelos, ferramentas, conhecimento e memória, além de mecanismos de proteção. OpenAI fornece primitivas componíveis para cada um deles:

Fonte: OpenAI 3

Obviamente, o OpenAI lista seus próprios recursos em primeiro lugar, mas existe um amplo ecossistema de alternativas. Dependendo do seu caso de uso, você pode criar agentes usando frameworks como LangChain, LlamaIndex, CrewAI ou até mesmo camadas de orquestração personalizadas.

Vou detalhar cada um desses componentes:

Modelos

Primeiro, você tem o componente de modelos. Estes são seus modelos de IA, seus grandes modelos de linguagem que são a inteligência central capaz de raciocinar, tomar decisões e processar diferentes modalidades. Claro, os exemplos que OpenAI nos dá são o GPT-5 , etc.

Dependendo do tipo específico de agente que você está construindo, você deve escolher um modelo diferente dentro do ecossistema OpenAI.

GPT-5 é o seu modelo principal. É um modelo de pensamento forte em raciocínio, resolução de problemas em várias etapas e particularmente eficaz para responder à maioria das perguntas.

Fora do ecossistema OpenAI, o Claude 4.5 Sonnet costuma ser o modelo preferido para pessoas que realizam muitas tarefas de programação, raciocínio e atividades relacionadas a STEM (Ciência, Tecnologia, Engenharia e Matemática), embora o Gemini 2.5 Pro esteja desafiando isso no momento.

No entanto, a OpenAI afirma que o GPT-5.2-Codex é o modelo de codificação mais avançado para desenvolvedores resolverem problemas complexos de engenharia de software do mundo real. O OpenAI apresenta desempenho comparável em benchmarks de codificação como TerminalBench e SWE-bench. 4

Analisamos e comparamos os principais modelos de IA para ajudar você a entender o desempenho de cada um em termos de raciocínio, velocidade e custo, para que você possa escolher aquele que melhor se adapta aos seus objetivos.

Ferramentas

Em seguida, vêm as ferramentas que ampliam as capacidades do modelo, como permitir que ele pesquise na web ou interaja com outros sistemas.

Quase qualquer aplicativo pode se tornar uma ferramenta para sua IA. Você pode conectá-la ao Gmail, ao Calendário, ao seu Drive ou a aplicativos como Slack, Discord, YouTube e Zapier. Você pode até criar suas próprias ferramentas personalizadas.

Com o SDK de Agentes do OpenAI (que requer alguma programação), você pode definir ferramentas ou usar ferramentas integradas, como pesquisa na web, pesquisa de arquivos e uso do computador. 5

O MCP (Model Context Protocol) de Anthropic também simplifica a integração de ferramentas ao padronizar a forma como os modelos acessam essas ferramentas. Em 2026, o valor comercial virá cada vez mais de “linhas de montagem digitais”, fluxos de trabalho multietapas guiados por humanos, nos quais múltiplos agentes executam processos de ponta a ponta, viabilizados pelo Model Context Protocol (MCP).

Se você não gosta de programação,plataformas sem código como o n8n permitem que você arraste e solte ferramentas para vinculá-las ao seu modelo.

Conhecimento e memória

Existem dois tipos principais de memória: base de conhecimento (memória estática) e memória persistente .

- A base de conhecimento fornece à sua IA acesso a fatos, políticas e documentos estáticos que permanecem relativamente inalterados. Isso é essencial para agentes que executam tarefas orientadas por políticas ou específicas da empresa, onde os materiais de referência precisam permanecer consistentes.

- A memória persistente permite que a IA se lembre de interações passadas entre sessões. Isso é crucial para chatbots ou assistentes pessoais que precisam recordar conversas anteriores.

OpenAI fornece serviços hospedados, como armazenamento de vetores , busca de arquivos e incorporações para gerenciar a memória.

Se você preferir soluções de código aberto, Pinecone (nativa da nuvem e otimizada para pesquisa vetorial) e Weaviate são opções populares.

Para quem usa ferramentas sem código , o gerenciamento de memória geralmente já está integrado em plataformas como n8n e Creatio .

Para mais informações, consulte: Construindo um agente de pesquisa de IA com memória.

Guarda-corpos

As diretrizes garantem que seu agente se comporte conforme o esperado, evitando respostas irrelevantes, prejudiciais ou inadequadas. Por exemplo, um chatbot de atendimento ao cliente deve se manter focado em tópicos relacionados ao serviço, e não se desviar para assuntos não relacionados.

Fora do ecossistema da OpenAI, ferramentas populares incluem Guardrails AI e LangChain Guardrails . Muitas plataformas no-code já possuem recursos de guardrail integrados, mas ainda é importante entender como eles funcionam para manter o controle e a conformidade em seus agentes.

Orquestração

O componente final é a orquestração. Isso envolve gerenciar como vários subagentes trabalham juntos, implantá-los em produção e monitorar seu desempenho.

Uma vez implantados, os agentes precisam de supervisão contínua. Modelos, dados e comportamentos mudam, portanto, atualizações e melhorias constantes são essenciais.

Diversas plataformas/frameworks oferecem suporte à orquestração, como:

- Plataformas de baixo código/sem código :

- Stack AI

- Microsoft Construtor de Agentes do Copilot Studio

- Relevância da IA, etc.

- Frameworks de código aberto :

- Crew AI, projetado para sistemas multiagentes

- LangChain, amplamente utilizado para gerenciar e implantar interações de agentes.

- O LlamaIndex é particularmente eficaz para agentes que lidam com grande volume de documentos e aplicações baseadas em conhecimento.

Elementos básicos da automação: fluxos de trabalho versus agentes

Um agente de IA é um sistema que percebe seu ambiente, processa informações e realiza ações de forma autônoma para atingir objetivos específicos, como agentes de codificação como o Cursor ou o Windsurf, editores de código com IA que possuem "modos de agente" capazes de executar tarefas de codificação de forma autônoma usando modelos como o Claude Sonnet 4.5. Outro exemplo comum são os agentes de atendimento ao cliente , que muitas empresas utilizam para lidar com consultas.

Existem muitas maneiras diferentes de projetar e implantar esses agentes, dependendo da complexidade do fluxo de trabalho e do grau de autonomia necessário.

Para dar uma breve visão geral, um agente de IA geralmente é um conjunto de subagentes, cada um executando tarefas específicas. Juntos, esses subagentes se coordenam dentro de sistemas multiagentes para entregar o que percebemos como um único agente de IA.

São fundamentalmente diferentes de fluxos de trabalho. Fluxos de trabalho são sequências orquestradas de etapas predefinidas, como uma receita que sempre segue a mesma ordem:

Quando usar agentes de IA

Antes de mergulharmos em exemplos de implementação de fluxos de trabalho para a criação de agentes de IA, vale a pena fazer uma breve análise da realidade. Agentes de IA não são estruturas rígidas. Muitas equipes ainda constatam que os fluxos de trabalho tradicionais têm um bom desempenho, mesmo em cenários onde, em teoria, os agentes poderiam ser aplicados.

Uma das maneiras mais claras de pensar sobre isso, descrita no blog de Anthropic, é a seguinte:

Dito isso, existem situações reais em que os agentes superam os fluxos de trabalho tradicionais em tarefas que exigem flexibilidade, raciocínio e adaptabilidade:

Conversas dinâmicas que exigem adaptações :

Algumas interações, como solicitações básicas de reembolso ou redefinição de senha, se encaixam perfeitamente nos fluxos de trabalho. Mas outras exigem julgamento criterioso ou decisões sensíveis ao contexto, como recomendações personalizadas, que dependem muito do contexto e de raciocínio mútuo.

Tomada de decisões de alto valor e baixo volume:

Operar com agentes pode ser caro, mas, em alguns casos, as decisões que eles embasam são muito mais custosas se tomadas incorretamente.

Por exemplo, a BCG relatou que um dos principais fornecedores de energia da Alemanha usou uma ferramenta de análise automatizada baseada em GenAI para automatizar as revisões de pagamento. 6

Se você estiver planejando infraestrutura em larga escala, como a otimização de projetos de engenharia, o custo da computação é insignificante. Nesses casos de alto risco, os agentes agregam valor porque o custo de um erro supera em muito o custo de executar o modelo.

Fluxos de trabalho com várias etapas e imprevisíveis:

Alguns fluxos de trabalho são tão complexos que escrever inúmeras regras do tipo "se isso, então aquilo" acaba se tornando um projeto à parte.

Nesses casos, os loops agentivos simplificam o caos. Em vez de codificar todos os caminhos possíveis, o modelo decide dinamicamente o próximo passo com base no contexto e no raciocínio em tempo real.

Essa abordagem funciona bem para sistemas ou ferramentas de diagnóstico que lidam com dezenas de variáveis em constante mudança.

Quando os fluxos de trabalho são melhores

Cenários de alta frequência e baixa complexidade :

Algumas tarefas dependem mais de velocidade e escala do que de raciocínio, como:

- Recuperar informações de um banco de dados

- Analisar mensagens ou e-mails estruturados.

- Respondendo a perguntas no formato de FAQ

Um fluxo de trabalho poderia processar milhares dessas solicitações, com custo e latência mais previsíveis do que um agente.

Introdução aos fluxos de trabalho e implementações de agentes de IA

Agora que discutimos os fluxos de trabalho dos agentes de IA e os componentes que os compõem, vamos passar para as implementações propriamente ditas. Como mencionado anteriormente, os agentes de IA geralmente não são uma única entidade. Em vez disso, são compostos por vários subagentes que interagem entre si. Um dos melhores recursos que encontrei sobre fluxos de trabalho comuns e sistemas de agentes é o guia "Building Effective Agents" de Anthropic. 7 Vamos analisar isso passo a passo.

No cerne dos sistemas agentes está o que Anthropic chama de LLM aumentado . Essa estrutura consiste em três elementos-chave:

- a entrada,

- o modelo de linguagem grande (LLM),

- e a saída.

Fonte: Anthropic 8

O LLM aumentado é capaz de gerar suas próprias consultas de pesquisa, selecionar ferramentas relevantes e decidir quais informações armazenar na memória.

Você pode notar algumas semelhanças com os componentes de OpenAI (conforme descrito abaixo). No entanto, esta versão é mais simplificada e não inclui elementos como mecanismos de proteção e orquestração, mas a estrutura principal permanece a mesma. Isso é perfeitamente aceitável. Para tarefas como testes e implantação, é melhor consultar os componentes de OpenAI.

Lista de componentes do agente de IA de OpenAI 9

Esses blocos de construção LLM aumentados também são conhecidos como subagentes . Agora, vamos explorar como esses subagentes se encaixam e interagem para formar um agente de IA maior. Começaremos com os fluxos de trabalho mais simples e avançaremos gradualmente para sistemas mais complexos e totalmente autônomos:

1. Fluxos de trabalho agéticos simples (encadeamento de prompts)

O fluxo de trabalho agentivo mais simples é chamado de encadeamento de prompts. Nesse processo, uma tarefa é dividida em uma série de etapas, onde cada subagente lida com a saída do anterior.

Em sua essência, funciona como uma linha de montagem, mas você pode introduzir pontos de decisão para redirecionar o fluxo, se necessário. O padrão geral permanece o mesmo: uma entrada é processada por um subagente, que passa o resultado para outro subagente para processamento adicional, e assim por diante, até que a saída final seja produzida. Esse método é particularmente útil para tarefas que podem ser facilmente divididas em subtarefas menores e sequenciais.

O fluxo de trabalho de encadeamento de prompts 10

Exemplo prático: 11

Encadeamento de prompts em n8n (esboçar, avaliar e publicar em folhas)

No exemplo acima, o usuário insere um tópico na janela de bate-papo n8n. Cada nó LLM utiliza o modelo Azure OpenAI.

O primeiro exercício do LLM gera um esboço estruturado para uma postagem de blog. A instrução para o redator do esboço é a seguinte:

Captura de tela da solicitação para o gerador de estrutura de tópicos LLM

Onde {{ $json.chatInput }} se refere ao tópico que foi inserido pelo usuário na janela de bate-papo.

A variável {{ $json.chatInput }} está cinza porque o fluxo de trabalho ainda não foi executado. Se já tivéssemos executado ou testado o nó, ela estaria verde ou vermelha, dependendo da validade da variável.

Em seguida, o LLM avaliará o esboço com base em critérios-chave na seção de mensagens do sistema. O prompt pode ser encontrado abaixo:

O último trabalho do LLM em Redação de Blogs incluirá uma linha em uma planilha sobre o tema, com base no esboço criado pelo trabalho anterior.

Captura de tela do enunciado do curso de mestrado em Redação de Blogs (LLM)

Quando usar o encadeamento de prompts:

- As tarefas podem ser naturalmente decompostas em subtarefas fixas e sequenciais.

- Cada etapa contribui de forma significativa para o resultado final.

- O raciocínio passo a passo aumenta a precisão em comparação com o processamento direto.

- São necessários pontos de controle de qualidade ao longo de todo o processo.

2. Fluxo de trabalho de roteamento

O roteamento é outro tipo de fluxo de trabalho em que uma entrada é recebida e um subagente é responsável por direcioná-la para a tarefa subsequente apropriada. Cada tarefa é então tratada por um subagente especializado nessa área e, uma vez concluídas as tarefas, a saída final é gerada.

Um exemplo clássico de roteamento pode ser visto em chatbots de atendimento ao cliente. O chatbot pode receber vários tipos de consultas, como dúvidas gerais, pedidos de reembolso ou problemas de suporte técnico. O primeiro subagente identifica a natureza da consulta e a encaminha para o subagente especializado em lidar com aquele problema específico.

Por exemplo, se a consulta for sobre um reembolso, ela será encaminhada para o subagente especialista em reembolsos, enquanto uma questão de suporte técnico será direcionada ao subagente de suporte técnico.

Outro exemplo é o direcionamento de perguntas para diferentes modelos com base em seus pontos fortes. Para perguntas mais complexas relacionadas a STEM (Ciência, Tecnologia, Engenharia e Matemática), você pode direcionar a entrada para um modelo como Claude Sonnet 4.5. Para consultas mais simples e rápidas, você pode optar por direcioná-las para um modelo como Gemini Flash, que é otimizado para velocidade.

Exemplo prático: 12

No exemplo acima, o agente encaminha a entrada do usuário para agentes especializados (como um Agente de Lembrete, um Agente de E-mail, etc.) usando uma saída estruturada de um modelo de linguagem.

O roteador está conectado ao GPT 4o mini. O prompt e as categorias são os seguintes:

Captura de tela dos parâmetros do nó do agente de IA

Exemplos de casos de uso:

Você pode inserir uma consulta na janela de bate-papo do n8n, por exemplo, digamos:

- Usuário diz: "Lembre-me de ligar para minha mãe amanhã."

→ Encaminhado para o Agente de Lembrete - O usuário diz: “Envie um e-mail para a equipe de RH.”

→ Encaminhado para o Agente de E-mail - O usuário diz: "Agende uma reunião com John na próxima semana."

→ Encaminhado para o Agente de Reunião

Quando usar o roteamento:

- Diversos tipos de entrada: Seu sistema recebe vários tipos de consultas que se beneficiam de um tratamento especializado.

- Otimização de recursos: você deseja atribuir consultas simples a processadores com boa relação custo-benefício, enquanto encaminha solicitações complexas para sistemas avançados.

- Especialização de domínio: Diferentes categorias de entradas exigem conhecimento especializado ou lógica de processamento específicos do domínio.

- Otimização de desempenho: É necessário equilibrar a carga e garantir tempos de resposta ideais para diferentes tipos de consulta.

3. Fluxo de trabalho de paralelização

O próximo fluxo de trabalho é a paralelização. Esse fluxo de trabalho específico, baseado em agentes, normalmente apresenta duas variações principais. Na paralelização, vários subagentes trabalham em uma tarefa simultaneamente, e suas saídas são então combinadas.

- A primeira variação é chamada de seccionamento , onde uma tarefa é dividida em subtarefas independentes que são executadas em paralelo.

- A segunda variação é a votação , onde a mesma tarefa é realizada várias vezes por diferentes subagentes para produzir resultados diversos, que são então agregados.

Isso ajuda a alcançar uma automação modular mais rápida, especialmente em fluxos de trabalho complexos.

Comparação de tempo entre fluxo de trabalho sequencial e fluxo de trabalho paralelo 13

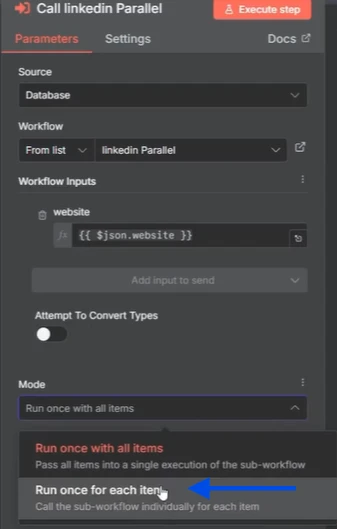

Exemplo prático: 14

Captura de tela do exemplo de fluxo de trabalho de paralelização no n8n

A execução paralela no exemplo n8n demonstra uma tarefa em que o fluxo de trabalho consulta a pesquisa Google usando a API SERP para recuperar URLs do LinkedIn e armazená-las em uma planilha Google. Na configuração inicial, o fluxo de trabalho processa cada tarefa sequencialmente, um site por vez:

- O fluxo de trabalho é acionado.

- A ferramenta Obter recupera o site da planilha Google.

- O agente de IA usa a API SERP para pesquisar Google e obter o URL do LinkedIn.

- O URL do LinkedIn é então atualizado na planilha Google.

Neste ponto, as tarefas são processadas uma após a outra, o que pode ser lento ao lidar com grandes conjuntos de dados.

O n8n possui um recurso em que você pode selecionar nós, clicar e então dizer "Quero converter esses nós selecionados em um subfluxo de trabalho".

O que acontece é que, ao clicar neste botão, ele nomeará meu fluxo de trabalho. Ao clicar em confirmar, tudo isso se transforma em um subfluxo de trabalho, que já está vinculado aqui e sendo chamado por este outro.

O subfluxo de trabalho criado

Então, o n8n transformou isso em um subfluxo de trabalho, mas você ainda não tem paralelização porque ele ainda seria executado por aqui.

Para que isso funcione em paralelo, todos os itens devem ser executados individualmente. Portanto, ao clicar no nó, você pode escolher "executar uma vez" para cada item, o que significa que o subfluxo de trabalho será chamado individualmente para cada item.

Depois de alterar isso, você pode acessar o subfluxo de trabalho e clicar em execuções. Você verá que os três itens estão sendo executados exatamente ao mesmo tempo.

Quando usar a paralelização: A paralelização é mais eficaz quando as tarefas podem ser divididas em subtarefas menores e independentes que podem ser executadas simultaneamente, melhorando tanto a velocidade quanto a eficiência.

Também é valioso quando são necessárias múltiplas perspectivas ou tentativas repetidas para alcançar maior confiança nos resultados. Para problemas complexos que envolvem diversas dimensões ou critérios de avaliação, os grandes modelos de linguagem têm melhor desempenho quando cada aspecto específico é tratado por uma chamada de modelo separada, permitindo um raciocínio mais focado e preciso para cada parte da tarefa.

4. Fluxo de trabalho dos trabalhadores do Orchestrator

O próximo fluxo de trabalho, que se torna mais complexo, é o padrão orquestrador-trabalhador.

A arquitetura orquestrador-trabalhador torna seus fluxos de trabalho n8n modulares, escaláveis e adaptáveis, transformando uma única automação rígida em um sistema componível de agentes cooperativos.

À primeira vista, pode parecer semelhante à paralelização, já que vários subagentes podem estar ativos, mas a principal diferença reside na flexibilidade. Ao contrário da paralelização, a configuração orquestrador-trabalhador não depende de uma lista fixa de subtarefas. Em vez disso, o orquestrador decide dinamicamente quais tarefas precisam ser executadas, atribui-as aos agentes trabalhadores e gerencia sua coordenação ao longo de todo o processo.

Exemplo prático: 15

Captura de tela do exemplo de fluxo de trabalho de orquestrador-trabalhadores no n8n

No exemplo acima, o briefing é coletado uma única vez e um orquestrador encaminha o trabalho para vários agentes especializados.

O Agente CEO atua como o orquestrador LLM. Ele processa o briefing de entrada, refina-o para cada departamento, seleciona quais agentes de trabalho ativar e determina como suas saídas serão integradas. Ele pode decidir acionar um, dois ou todos os agentes de trabalho, dependendo do contexto e das restrições.

Captura de tela do nó do Agente CEO

Abaixo, três agentes de trabalho, Marketing, Operações e Finanças, executam cada um seu próprio Modelo de Chat OpenAI com configurações de memória e ferramentas separadas. Isso permite prompts específicos do departamento e esquemas JSON para saída estruturada.

Captura de tela dos três nós de agentes de trabalho

Após o orquestrador preparar as instruções específicas para cada departamento, ele invoca cada trabalhador como uma ferramenta para gerar resultados com base nas entradas.

Por exemplo, o Agente de Marketing cria campanhas (nome, canal, KPI).

Nó de ferramenta de IA (Agente de Marketing)

Após a geração dos relatórios dos funcionários, o Agente CEO compila e mescla as respostas dos departamentos em um único plano coeso. Em seguida, o fluxo de trabalho grava o plano em um documento Google, adiciona metadados, converte-o para PDF e o carrega automaticamente para compartilhamento ou revisão.

Captura de tela dos nós de criação, conversão e upload de documentos

Quando executado, o orquestrador determina quais agentes ativar, coordena sua colaboração e combina suas saídas em um relatório abrangente, demonstrando como os fluxos de trabalho entre orquestrador e trabalhador possibilitam sistemas de IA flexíveis, modulares e componíveis.

Quando usar o fluxo de trabalho de trabalhadores do orquestrador: Essa abordagem é especialmente valiosa para resolver problemas complexos ou em constante evolução, nos quais as etapas necessárias não podem ser conhecidas antecipadamente.

Exemplos em que o fluxo de trabalho orquestrador-trabalhador é útil:

- Tarefas de codificação: Ao desenvolver ou depurar produtos de software complexos que exigem alterações coordenadas em vários arquivos, onde os arquivos e edições exatos podem ser determinados durante a execução.

- Pesquisa e coleta de informações: Em tarefas que envolvem a busca, coleta e análise de dados de múltiplas fontes, onde as informações relevantes não podem ser totalmente identificadas antecipadamente e devem ser descobertas dinamicamente.

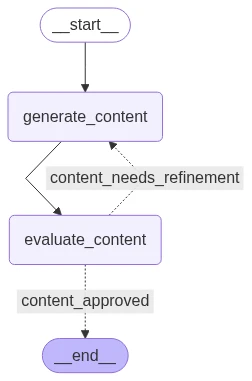

5. Fluxo de trabalho do otimizador do avaliador

Ainda mais complexo é o fluxo de trabalho avaliador-otimizador. Essa configuração caminha em direção a um comportamento mais autônomo, dando ao subagente ou agente de IA maior liberdade para decidir quais ações tomar e como melhorar seus próprios resultados.

Você começa com uma entrada, e o primeiro subagente gera uma solução proposta. Essa saída é então passada para um subagente avaliador, que revisa o resultado. Se o avaliador considerar o resultado satisfatório, a saída é finalizada. Mas se determinar que o resultado não é bom o suficiente, ele o envia de volta ao primeiro subagente com feedback específico para melhorias.

Isso cria um ciclo de feedback contínuo no qual o otimizador refina iterativamente sua saída até que o avaliador determine que ela atende aos padrões de qualidade exigidos.

Exemplo prático: 16

Neste exemplo, utilizei uma simulação em Python, em vez de uma ferramenta sem código, para mostrar diretamente os esquemas de avaliação, a lógica personalizada e os loops iterativos.

Esta não é uma configuração completa. Para executar o fluxo de trabalho de avaliador-otimizador de ponta a ponta, você precisará de configuração de ambiente adequada, inicialização do modelo e configuração do esquema, etc.

Você também pode implementar um ciclo de avaliação-otimização usando ferramentas de automação de fluxo de trabalho que suportam nós de avaliação.

Fluxo de trabalho de avaliador-otimizador com Python:

Um exemplo de um ciclo Avaliador-Otimizador, um padrão comum em sistemas de IA autorreflexivos ou fluxos de trabalho agentes.

Este fluxo de trabalho representa um ciclo automatizado de geração e avaliação de conteúdo, no qual dois componentes colaboram: um cria e o outro revisa. Ele garante que os resultados atendam aos padrões de qualidade antes da finalização.

Explicação passo a passo:

- Inicializar entrada: Criar initial_state = {“content_topic”: topic}.

- Execute o loop: Chame evaluator_optimizer_workflow.invoke(initial_state) iterativamente:

- Gera/aprimora conteúdo,

- avalia a qualidade,

- Repete-se até ser aprovado ou atingir o limite máximo de iterações.

- Resultado do registro: Imprimir mensagem de conclusão e o conteúdo gerado aprovado.

- Resultados retornados: dicionário final_state (ex.: content_topic, generated_content, quality_assessment).

Visualização do fluxo de trabalho:

Ciclo de avaliação-otimização com resultados em Python: Cada ciclo utiliza o feedback anterior para aprimorar o conteúdo. O ciclo eventualmente produz conteúdo que atende ao padrão de qualidade.

Quando usar o fluxo de trabalho de otimizador de avaliador: Este fluxo de trabalho é especialmente útil quando existem critérios de avaliação claros e quando o refinamento iterativo pode levar a melhorias significativas na qualidade.

Exemplos em que o fluxo de trabalho avaliador-otimizador é útil:

- Por exemplo, em uma tarefa de tradução literária, a primeira tentativa pode não captar certas nuances linguísticas ou tons emocionais. O avaliador fornecerá feedback e solicitará revisões até que a tradução capture plenamente o significado pretendido e as sutilezas do texto original.

- Outro exemplo está na agregação de pesquisas complexas , onde o otimizador coleta e resume informações enquanto o avaliador verifica a profundidade, a completude e a precisão. Se o avaliador considerar a pesquisa insuficiente, ela a devolve para retrabalho até que o relatório final atenda a todos os requisitos e sintetize efetivamente as informações necessárias.

6. Implementação de agentes verdadeiramente autônomos

E, finalmente, temos a implementação de agentes verdadeiramente autônomos. Esse tipo de sistema é conceitualmente simples, mas pode produzir comportamentos altamente diversos e complexos na prática.

O agente inicia sua operação com intervenção humana mínima; geralmente uma única instrução ou objetivo. Uma vez definida a tarefa, ele funciona de forma independente, executando ações e observando seus efeitos no ambiente.

Uma característica fundamental dessa abordagem é a autoavaliação: o agente deve determinar, com base no feedback do ambiente, se suas ações o estão aproximando do objetivo. Por exemplo, se ele executa código ou usa ferramentas externas, deve avaliar se essas ações contribuem para o progresso ou se ajustes são necessários. Esse ciclo orientado por feedback continua até que o agente determine que o objetivo foi alcançado ou que nenhum progresso adicional é possível.

Exemplo prático:

Em nossa avaliação comparativa de ferramentas de codificação de IA , observamos que Windsurf e Cursor demonstraram capacidades de agente, criando estruturas de arquivos de forma autônoma, editando vários arquivos e executando comandos de terminal para implantar APIs no Heroku.

Windsurf até se adaptou às mudanças recentes da plataforma, quando descobriu que o complemento PostgreSQL Hobby Dev estava obsoleto, reconfigurou corretamente a implantação para usar o PostgreSQL Essential 0.

Resumo

Construir agentes de IA não se trata tanto de alcançar autonomia total, mas sim de criar sistemas que sejam intencionais, transparentes e confiáveis. A partir de nossos experimentos no n8n e das percepções obtidas com os guias de Anthropic e OpenAI, descobrimos que agentes eficazes surgem de escolhas de design.

Ao implementar agentes, focamos em três princípios orientadores:

- Mantenha a arquitetura simples. Comece pequeno, construa de forma modular e introduza complexidade somente quando ela claramente melhorar o desempenho ou a flexibilidade.

- Torne o processo de raciocínio visível. Permita que usuários e desenvolvedores vejam como o agente planeja e toma decisões, melhorando a interpretabilidade e o controle.

- Garanta interações confiáveis entre as ferramentas. Projete ferramentas com escopo bem definido, documentação completa e testes rigorosos para que os agentes possam agir de forma consistente em ambientes reais.

Seja o primeiro a comentar

Seu endereço de e-mail não será publicado. Todos os campos são obrigatórios.