Abbiamo analizzato circa 20 strumenti di governance dell'IA e circa 40 piattaforme MLOps che offrono funzionalità di governance dell'IA per identificare i leader di mercato sulla base di metriche quantificabili. Clicca sui link qui sotto per esplorare i loro profili:

Confronta i software di governance basati sull'intelligenza artificiale

Il panorama degli strumenti di governance dell'IA riportato di seguito mostra le categorie pertinenti per ciascuno strumento menzionato nell'articolo. Le aziende possono selezionare le soluzioni da queste categorie in base alle proprie iniziative in materia di IA e alle esigenze di governance.

Alcuni di questi strumenti includono:

I migliori strumenti MLOps

Gli strumenti MLOps sono singoli strumenti software che svolgono funzioni specifiche all'interno dell'intero processo di apprendimento automatico. Ad esempio, gli strumenti MLOps possono concentrarsi sullo sviluppo, sul monitoraggio o sull'implementazione di modelli di apprendimento automatico. Un team di data science può realizzare prodotti di intelligenza artificiale responsabili applicando questi strumenti agli algoritmi di apprendimento automatico per:

- Monitorare e individuare i pregiudizi

- Verificare la disponibilità e la trasparenza

- Garantire la conformità etica e la privacy dei dati.

Pesi e distorsioni

Weights and Biases è una piattaforma MLOps che aiuta i team a tracciare, gestire e riprodurre esperimenti e modelli di machine learning. Il suo modulo Registry offre funzionalità incentrate sulla governance, tra cui:

- Registro di modelli e set di dati per centralizzare e condividere le risorse di machine learning tra i team.

- Gestione delle versioni e tracciabilità della provenienza per garantire la riproducibilità e la tracciabilità di modelli ed esperimenti.

- Gestione del ciclo di vita per etichettare e gestire i modelli nelle diverse fasi, come sviluppo, staging e produzione.

- Controllo degli accessi e verifiche per limitare l'utilizzo e monitorare le modifiche a fini di conformità.

- Integrazione CI/CD per automatizzare la valutazione, la distribuzione e la riproducibilità dei modelli nelle pipeline di produzione.

Aporia AI

Specializzata nell'osservabilità e nel monitoraggio dell'apprendimento automatico (ML) per garantire l'affidabilità e l'equità dei modelli di machine learning in produzione. Si avvale di tecniche di tracciamento delle prestazioni dei modelli, rilevamento dei bias e garanzia della qualità dei dati.

Datatron

Offre visibilità sulle prestazioni del modello, consente il monitoraggio in tempo reale e garantisce la conformità agli standard etici e normativi, promuovendo così pratiche di intelligenza artificiale responsabili e trasparenti.

IA spia

Uno strumento di osservabilità e validazione di modelli di machine learning in grado di tracciare le prestazioni dei modelli, risolvere i problemi e monitorarli continuamente.

Superwise AI

Monitorare i modelli di intelligenza artificiale in tempo reale, individuare i pregiudizi e spiegare le decisioni del modello, promuovendo così trasparenza, equità e responsabilità nei sistemi di intelligenza artificiale.

Perché i laboratori

Uno strumento LLMOps che monitora i dati e la modalità degli LLM per identificare i problemi.

- Attuazione delle misure di sicurezza

- Rimanere in linea con i requisiti normativi e le leggi

- Gestione della documentazione del modello.

Le migliori piattaforme MLOps

Le principali piattaforme MLOps offrono strumenti e infrastrutture a supporto dei flussi di lavoro di apprendimento automatico end-to-end, inclusa la gestione e la supervisione dei modelli.

Amazon Sagemaker

Amazon SageMaker è un servizio AWS gestito che consente agli utenti di sviluppare, addestrare e implementare modelli di machine learning su larga scala. Semplifica il processo di creazione, addestramento e implementazione di modelli di machine learning, tenendo conto delle pratiche di governance dell'IA.

Azure ML

Azure Machine Learning è una piattaforma MLOps basata sul cloud di Microsoft che supporta l'intero ciclo di vita del machine learning, dalla preparazione dei dati all'addestramento del modello, alla distribuzione e al monitoraggio. Offre funzionalità relative alla governance dell'IA per i modelli di machine learning, tra cui:

- Registrazione dei modelli e gestione delle versioni per tracciare esperimenti e modelli di produzione.

- Tracciamento del lignaggio per garantire la riproducibilità di modelli ed esperimenti.

- Gestione del ciclo di vita e integrazione CI/CD per orchestrare la valutazione, il riaddestramento e la distribuzione dei modelli.

Robot di dati

Offre un'unica piattaforma per implementare, monitorare, gestire e governare tutti i modelli in produzione, incluse funzionalità come la governance affidabile di IA e ML per fornire una governance completa del ciclo di vita dell'IA.

Vertex AI

Offre una gamma di strumenti e servizi per la creazione, l'addestramento e l'implementazione di modelli di apprendimento automatico con tecniche di governance dell'IA, come il monitoraggio dei modelli, l'equità e le funzionalità di interpretabilità.

Confronta un maggior numero di piattaforme MLOP nella nostra lista completa di fornitori, basata sui dati.

I migliori strumenti LLMOps

Gli strumenti LLMOps includono soluzioni e strumenti di monitoraggio LLM che supportano alcuni aspetti delle operazioni LLM. Questi strumenti possono implementare pratiche di governance basate sull'IA negli LLM monitorando più modelli e rilevando pregiudizi e comportamenti non etici al loro interno. Alcuni esempi includono:

Akira AI

Esegue controlli di qualità per individuare comportamenti non etici, pregiudizi o mancanza di robustezza .

Calypso AI

Offre un servizio di monitoraggio che tiene conto del controllo, della sicurezza e della governance dei modelli di intelligenza artificiale generativa.

Arthur AI

Il test valuta i modelli di apprendimento per rinforzo (LLM), la visione artificiale e l'elaborazione del linguaggio naturale (NLP) rispetto a parametri consolidati.

Confronta altri strumenti LLMOps nella nostra lista completa di fornitori, basata sui dati.

Strumenti di governance basati sull'intelligenza artificiale per il governo e le politiche pubbliche.

Mentre la maggior parte degli strumenti di governance basati sull'IA è destinata al settore privato, sta emergendo una nuova categoria di strumenti per la pubblica amministrazione. Questi strumenti:

- Automatizzare le funzioni pubbliche , dall'erogazione dei servizi alla supervisione normativa.

- Presenta sfide di governance uniche , tra cui la fiducia del pubblico e l'interpretazione giuridica.

- Evidenziare un'area critica di studio per il futuro dell'intelligenza artificiale.

SweetREX Deregolamentazione dell'IA

SweetREX Deregulation AI è uno strumento sviluppato per il Dipartimento per l'efficienza governativa (DOGE) che utilizza modelli di intelligenza artificiale per:

- Individua e segnala le normative federali obsolete o non legalmente obbligatorie.

- Automatizzare la deregolamentazione , con l'obiettivo di eliminare un numero significativo di norme con un intervento umano minimo.

- Riduzione drastica della manodopera , con un'implementazione a livello nazionale prevista per il 2026.

Attualmente si trova nelle prime fasi di implementazione e il suo utilizzo solleva preoccupazioni circa la capacità dell'IA di interpretare accuratamente un linguaggio giuridico complesso e la sua conformità alle procedure legali.

Le migliori piattaforme di governance dell'IA

Questi strumenti tendono a concentrarsi su un aspetto della governance dell'IA, a differenza delle piattaforme che gestiscono l'intero ciclo di vita dell'IA. Tali strumenti possono essere utili per progetti su piccola scala o per approcci basati sulle migliori soluzioni disponibili.

Ad esempio, possono concentrarsi sul garantire che i sistemi di IA siano conformi alle migliori pratiche di IA responsabile , alle normative di settore e agli standard di sicurezza. Aiutano le organizzazioni a mitigare il rischio dell'IA attraverso:

Asenion (precedentemente Fairly AI e Anch.AI)

Asenion è una piattaforma unificata per la governance dell'IA, nata dall'acquisizione di Anch.AI e Fairly AI. La piattaforma può aiutare a gestire i rischi, semplificare la conformità e ottimizzare la fiducia, la sicurezza e la protezione dell'IA lungo tutto il suo ciclo di vita, grazie a funzionalità chiave come:

- La governance dell'IA definisce politiche e controlli per garantire che i sistemi di intelligenza artificiale siano affidabili e sicuri.

- La gestione del rischio dell'IA comprende l'intero processo di identificazione, valutazione, mitigazione e monitoraggio dei rischi durante l'intero ciclo di vita del sistema di IA.

- La conformità all'IA garantisce il rispetto delle normative applicabili, delle linee guida etiche e delle politiche interne dell'organizzazione, offrendo in particolare un percorso rapido e affidabile per l'attuazione dell'Atto UE sull'IA.

- Gestione del rischio e della conformità che unisce competenze legali e tecniche.

Asenion offre una facile integrazione tramite API per i team tecnici e una garanzia automatizzata basata sull'intelligenza artificiale per i dirigenti aziendali.

Anthropic

Anthropic offre una suite di strumenti e framework di intelligenza artificiale progettati per supportare utenti aziendali, governativi e di ricerca, con particolare attenzione alla sicurezza, all'allineamento e alla governance.

Strumenti e funzionalità principali per la governance dell'IA

- La suite di valutazione del sabotaggio testa i modelli rispetto a comportamenti dannosi occulti, come sabotaggio nascosto, sabotaggio non autorizzato ed elusione. La suite simula scenari di implementazione reali e potenziali vettori di attacco per aiutare le organizzazioni a identificare e affrontare le vulnerabilità prima che i modelli vengano rilasciati o scalati.

- Gli strumenti di monitoraggio degli agenti possono analizzare azioni, ragionamenti interni e processi decisionali alla ricerca di segnali di disallineamento o anomalie. Il monitoraggio è integrato con audit periodici e protocolli di valutazione del rischio, offrendo una visibilità completa sul comportamento del modello e sulla conformità in ogni momento.

- Il framework del red team prevede test avversariali sistematici, in cui team di esperti tentano di provocare risultati non sicuri o manipolativi da parte dei modelli. I risultati di queste esercitazioni di red team possono contribuire a definire strategie di mitigazione e a rafforzare la resilienza delle implementazioni di IA negli ambienti di produzione.

Caratteristiche del modello Claude per la governance

Claude è un modello linguistico di intelligenza artificiale progettato da Antrhopic per la comprensione e la generazione di testo in diverse applicazioni.

- Allineamento costituzionale dell'IA: addestra i modelli secondo un insieme trasparente di principi etici per garantire un allineamento coerente e autoregolamentato.

- Modelli Claude GOV: Varianti specializzate del modello Claude, progettate per l'uso governativo con funzionalità di conformità e sicurezza avanzate.

- Misure di sicurezza multi-agente: implementa controlli deterministici come checkpoint e logica di ripetizione per governare il comportamento degli agenti in ambienti complessi.

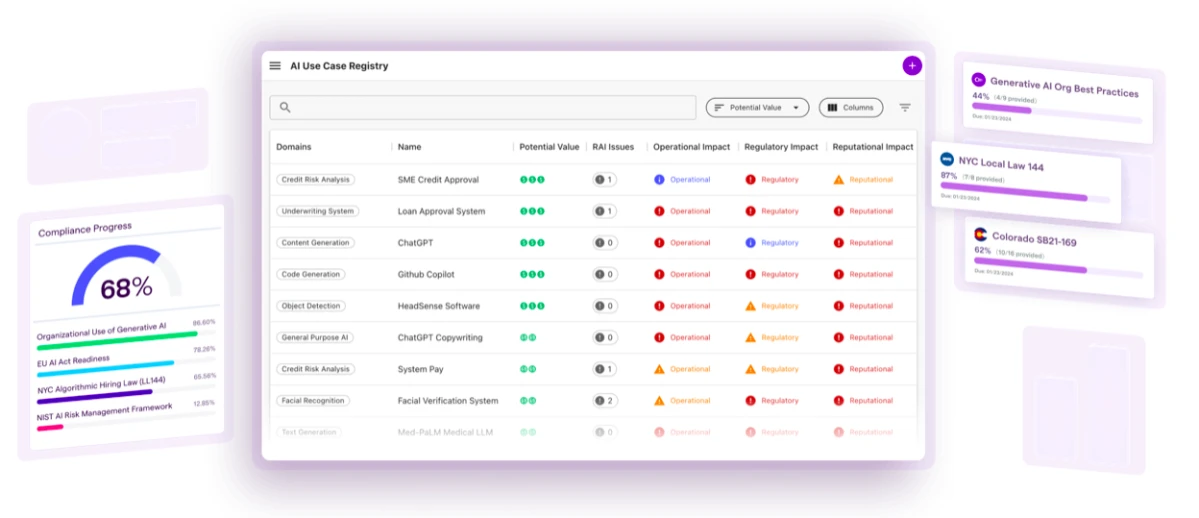

Credo AI

Offre servizi di gestione del rischio dei modelli di IA, governance dei modelli e valutazioni di conformità, con particolare attenzione all'IA generativa, per facilitare l'adozione della tecnologia IA. Credo AI offre:

- Conformità normativa per semplificare l'adesione alle normative e alle politiche aziendali, compresa la preparazione per nuove leggi come l'EU AI Act.

- Mitigazione del rischio per valutare i modelli di IA in base a fattori quali pregiudizi, sicurezza, prestazioni e interpretabilità.

- Strumenti di governance per la generazione di documentazione relativa all'IA, tra cui rapporti di audit, analisi dei rischi e valutazioni d'impatto.

FairNow

FairNow è una piattaforma di governance e GRC basata sull'IA che aiuta le aziende a gestire i rischi legati all'intelligenza artificiale, garantire la conformità e costruire sistemi affidabili. Include modelli interni e IA di fornitori terzi e si integra con gli strumenti GRC, MLOps e di gestione dei flussi di lavoro già in uso nelle aziende.

Con FairNow, gli utenti possono facilitare:

- Registro centralizzato dell'IA per mantenere un inventario unico di tutti i sistemi di IA, al fine di garantire una migliore visibilità.

- Valutazione automatizzata del rischio per identificare automaticamente i rischi legali, operativi e reputazionali.

- Automazione della documentazione tramite l'intelligenza artificiale Agentic per la creazione di documenti e schede modello pronti per le verifiche.

- Monitoraggio continuo per testare e controllare in modo proattivo i modelli di IA per individuare eventuali distorsioni, con avvisi intelligenti per i rischi emergenti.

- Dati sintetici per le verifiche contabili : utilizzo di dati sintetici per testare la presenza di pregiudizi e l'equità, soprattutto in presenza di dati sensibili o non disponibili.

- Gestione della governance e dei flussi di lavoro per definire ruoli e procedure, garantendo l'allineamento e la responsabilità del team.

- Conformità alla legge europea sull'intelligenza artificiale (EU AI Act), al quadro di riferimento NIST sull'IA (NIST AI RMF), alla norma ISO/IEC 42001 e alle leggi statali e locali degli Stati Uniti (ad esempio, la legge SB 205 del Colorado e la legge locale 144 di New York).

Fiddler AI

Uno strumento di osservabilità dell'IA che fornisce il monitoraggio dei modelli di machine learning e le relative funzionalità LLMOps e MLOPs per costruire e implementare un'IA affidabile, inclusa l'IA generativa .

Sicurezza armonica

Harmonic Security è una piattaforma di governance e sicurezza dell'IA aziendale che offre visibilità, controllo e protezione per l'utilizzo dell'IA in tutta l'organizzazione. Le sue funzionalità principali includono:

- Monitoraggio dell'utilizzo dell'IA per tracciare in tempo reale le interazioni dei dipendenti con strumenti di IA e sistemi agentivi.

- Protezione dei dati per rilevare e bloccare la condivisione di informazioni sensibili o ad alto rischio con i sistemi di intelligenza artificiale.

- Applicazione delle policy per definire e implementare controlli di accesso e restrizioni d'uso tra i team.

- Analisi dell'IA ombra per identificare strumenti di IA non autorizzati e flussi di lavoro agentici all'interno dell'organizzazione.

- Attività di audit e reporting per la generazione di registri e report ai fini delle verifiche di conformità e governance.

Intelligenza artificiale olistica

Holistic AI è una piattaforma di governance che aiuta le aziende a gestire i rischi legati all'IA, a monitorare i progetti di IA e a semplificare la gestione dell'inventario dell'IA. Consente agli utenti di valutare l'efficacia e la presenza di distorsioni nei sistemi e di monitorare costantemente le normative globali sull'IA per garantire la conformità delle proprie applicazioni, come ad esempio i modelli di apprendimento per livelli (LLM).

Con l'IA olistica, gli utenti possono facilitare:

- Gestione delle politiche e dei rischi per l'attuazione delle politiche, il controllo degli incidenti e la gestione del rischio operativo.

- Verifica e conformità agli standard ambientali e di ripristino post-disastro.

- Supporto ai sensi dell'EU AI Act per la conformità alle normative UE sull'IA, consentendo alle aziende di concentrarsi sugli obiettivi principali mentre la piattaforma gestisce le complessità normative.

IBM watsonx.governance

IBM watsonx.governance è una piattaforma di governance AI aziendale che consente alle organizzazioni di verificare, monitorare e garantire la conformità dei modelli di IA e ML in tutta l'organizzazione. Le sue principali funzionalità di governance includono:

- Gestione del catalogo modelli e dei metadati per una supervisione centralizzata dei sistemi di intelligenza artificiale.

- Gestione del ciclo di vita per amministrare i modelli dallo sviluppo fino all'implementazione e alla dismissione.

- Monitoraggio dei pregiudizi, dell'equità e dei rischi per identificare e mitigare i problemi di conformità.

Mind Foundry

Monitorare e convalidare i modelli di IA, mantenere la trasparenza nel processo decisionale e allineare il comportamento dell'IA agli standard etici e normativi, promuovendo una governance responsabile dell'IA.

Centro operativo modello

ModelOp Center è una piattaforma di governance dell'IA aziendale focalizzata sulla verifica, il controllo e la garanzia della conformità dei modelli di IA durante tutto il loro ciclo di vita. Le sue funzionalità principali includono:

- Gestione dell'inventario e del ciclo di vita dei modelli per tracciare i modelli di intelligenza artificiale dallo sviluppo alla dismissione.

- Politiche di governance e meccanismi di applicazione per garantire che i modelli siano conformi alle norme interne e ai requisiti normativi.

- Integrazione con le pipeline MLOps per applicare i controlli di governance senza interrompere le operazioni.

Monitorare

Monitaur è specializzata nella governance dell'IA con la sua piattaforma Monitaur ML Assurance, una soluzione SaaS per il monitoraggio e la gestione dei modelli di IA. La piattaforma consente alle aziende di migliorare la supervisione, ottimizzare la collaborazione e implementare framework di governance scalabili. Le sue caratteristiche principali includono:

- Monitoraggio in tempo reale: traccia continuamente gli algoritmi di intelligenza artificiale e registra informazioni in tempo reale.

- Quadro di governance: supporta la creazione di programmi di governance dell'IA trasparenti e basati su dati concreti.

Sigma Red AI

Individua e mitiga i pregiudizi, garantendo la spiegabilità del modello e facilitando pratiche di intelligenza artificiale etiche.

Solar AI

Verifiche per individuare eventuali discriminazioni algoritmiche al fine di migliorare la conformità alle normative e alle leggi vigenti.

Le migliori piattaforme di governance dei dati

Le piattaforme di governance dei dati contengono diversi strumenti e kit di strumenti incentrati principalmente sulla gestione dei dati per garantire la qualità, la privacy e la conformità dei dati utilizzati nelle applicazioni di intelligenza artificiale. Contribuiscono a mantenere l'integrità, la sicurezza e l'uso etico dei dati, elementi cruciali per pratiche di intelligenza artificiale responsabili.

Alcune di queste piattaforme possono aiutare a verificare la conformità e la gestione complessiva del ciclo di vita dell'IA. Queste piattaforme possono essere preziose per le organizzazioni che implementano framework di governance dell'IA completi. Ecco alcuni esempi:

Cloudera

Una piattaforma dati ibrida che mira a migliorare la qualità dei set di dati e dei modelli di machine learning, con particolare attenzione alla governance dei dati.

Databricks

Unisce data lake e data warehouse in un'unica piattaforma, in grado di gestire dati strutturati e non strutturati, modelli di machine learning, notebook, dashboard e file su qualsiasi cloud o piattaforma.

Devin AI

Offre una piattaforma di data science per creare e addestrare modelli di intelligenza artificiale e garantire che tali modelli soddisfino le politiche di governance e i requisiti di conformità, tra cui GDPR, CCPA e legge europea sull'IA.

IBM Cloud Pak per i dati

La piattaforma completa di dati e intelligenza artificiale di IBM, che offre funzionalità di governance end-to-end per i progetti di IA:

Snowflake

Offre una piattaforma cloud per la gestione dei dati in grado di gestire i rischi e migliorare l'efficienza operativa attraverso la gestione e la sicurezza dei dati.

governance degli agenti di IA

La governance degli agenti di IA è un ambito emergente incentrato sulla supervisione dei sistemi di IA autonomi e delle configurazioni multi-agente. Garantisce che gli agenti operino in modo sicuro, etico e nel rispetto dei limiti organizzativi e normativi. I pilastri fondamentali della governance degli agenti di IA includono:

- Applicazione delle politiche: Definizione di ciò che gli agenti sono autorizzati o vietati a fare.

- Monitoraggio del comportamento: tracciamento delle azioni dell'agente in tempo reale per rilevare anomalie o comportamenti non sicuri.

- Valutazione e gestione del rischio: identificazione di potenziali danni, comportamenti emergenti o guasti a cascata derivanti dalle interazioni tra agenti.

- Audit e trasparenza: garantire che tutte le azioni degli agenti siano registrate e tracciabili ai fini della conformità e della responsabilità.

- Controllo degli accessi e delle identità: Gestione degli agenti che possono accedere a dati, API o strumenti.

Perché la governance degli agenti di intelligenza artificiale è importante?

La necessità di una governance dedicata da parte degli agenti è in aumento a causa di nuovi rischi, tra cui:

- Azioni involontarie (ad esempio, cancellazione di dati, invio di e-mail, effettuazione di ordini)

- Uso improprio degli strumenti o escalation dei privilegi

- Decisioni frutto di allucinazioni ma eseguite, soprattutto per quanto riguarda le decisioni autonome ad alto impatto.

- Comportamento imprevedibile nelle interazioni tra più agenti.

- Inosservanza delle normative (GDPR, AI Act, HIPAA, ecc.).

- Nessuna chiara attribuzione di responsabilità ("perché l'agente ha fatto questo?")

governance degli agenti IA vs. governance dell'IA

La governance degli agenti di IA condivide principi con la governance generale dell'IA, come la valutazione del rischio, la conformità, l'audit e la supervisione etica. Le differenze includono:

- Sistemi dinamici vs. sistemi statici: la governance tradizionale dell'IA si concentra su modelli statici, mentre la governance basata su agenti gestisce sistemi autonomi che agiscono e pianificano in tempo reale.

- Supervisione in fase di esecuzione: la governance degli agenti si concentra sul monitoraggio e sul controllo in tempo reale, piuttosto che sui soli controlli in fase di sviluppo.

- Gestione dei comportamenti emergenti: le interazioni tra più agenti possono produrre risultati imprevedibili, che richiedono ulteriori misure di sicurezza.

Strumenti di governance basati su agenti di intelligenza artificiale

Ecco alcune delle categorie di strumenti di governance degli agenti di intelligenza artificiale:

- Piattaforme complete di governance AI: questi strumenti coprono ogni aspetto, dall'inventario e dalla conformità all'applicazione delle policy e all'audit.

- Strumenti per il monitoraggio, la spiegabilità e il rilevamento delle derive dei modelli: questi strumenti sono utili per la "governance soft" al fine di garantire che i modelli si comportino correttamente nel tempo.

- Strumenti di governance dei dati: questi strumenti combinano la tutela della privacy dei dati, la conformità normativa e la supervisione del comportamento dell'IA.

- Strumenti orientati alla sicurezza e alla conformità: questi strumenti aiutano a mitigare i rischi e ad allinearsi alle normative.

- Strumenti di governance incentrati sugli agenti: questi strumenti sono applicazioni di governance open-source per agenti autonomi.

mercato della governance degli agenti di intelligenza artificiale

Non esiste un singolo strumento di governance "perfetto". Molte organizzazioni combinano diversi strumenti a seconda delle proprie esigenze, come ad esempio: regolamentazione, conformità, MLOps, privacy, rischio e audit.

Il mercato è ancora in evoluzione, con fornitori di nicchia che si differenziano in base a casi d'uso specifici come la gestione del rischio LLM, la governance dell'IA generativa o l'allineamento normativo.

Che cos'è la governance dell'IA e perché è importante?

La governance dell'IA si riferisce alla definizione di regole, politiche e quadri normativi che guidino lo sviluppo, l'implementazione e l'utilizzo delle tecnologie di intelligenza artificiale. Il suo obiettivo è garantire un comportamento etico, trasparenza, responsabilità e benefici per la società, mitigando al contempo i potenziali rischi e pregiudizi associati ai sistemi di IA.

L'intelligenza artificiale etica deve essere una priorità per le imprese:

- La legge europea sull'intelligenza artificiale (EU AI Act) è entrata in vigore nell'agosto del 2024. Alcune delle sue disposizioni sono già operative e si prevede che lo saranno tutte entro il 2026.

- Si prevede che l'intelligenza artificiale alimenterà il 90% delle applicazioni commerciali entro la fine del 2025 (Fonte: statistiche sull'IA ).

Questi fattori hanno portato a un maggiore interesse per la governance dell'IA:

I bias nei dati e negli algoritmi possono danneggiare la reputazione e le finanze di un'azienda, un problema che può essere prevenuto adottando piattaforme di governance dell'IA. Questi strumenti aiutano le aziende che sviluppano e implementano l'IA a migliorare:

- Intelligenza artificiale etica e responsabile: garantisce che i sistemi di IA siano progettati, addestrati e utilizzati in modo etico, prevenendo risultati distorti o dannosi. Scopri di più sull'IA etica e sull'etica dell'IA generativa .

- Trasparenza e responsabilità: promuove la trasparenza negli algoritmi e nelle decisioni dell'IA, rendendo sviluppatori e organizzazioni responsabili delle azioni intraprese dai sistemi di IA.

- Protezione dei dati e conformità: aiuta le organizzazioni a conformarsi alle normative sulla privacy dei dati come il GDPR e l'HIPAA, garantendo che i dati vengano raccolti e utilizzati in modo legale ed etico.

- Valutazione e mitigazione del rischio: identifica e mitiga i vari rischi associati all'IA, inclusi i rischi legali, finanziari e reputazionali, prima che portino a conseguenze negative.

- Equità e giustizia: identifica e affronta i pregiudizi presenti nei modelli di intelligenza artificiale per promuovere un trattamento equo tra utenti e gruppi diversi.

- Prestazioni e affidabilità del modello: monitora costantemente i modelli di IA per mantenerne l'affidabilità, rilevando eventuali deviazioni dal modello ed eseguendo il riaddestramento del modello quando necessario, riducendo gli errori e migliorando la soddisfazione dell'utente.

- Fiducia del pubblico: rafforza la fiducia del pubblico nelle tecnologie di intelligenza artificiale, ponendo l'accento su un comportamento etico e sulla trasparenza.

- Allineamento con i valori organizzativi: consente alle organizzazioni di allineare le pratiche di intelligenza artificiale alla propria missione e ai propri valori, dimostrando un impegno verso l'etica e la responsabilità.

- Scopri di più sulle soluzioni di conformità basate sull'IA .

- Vantaggio competitivo: l'IA etica e una governance responsabile possono fornire un vantaggio competitivo attirando clienti, partner e investitori che apprezzano le soluzioni di IA etica.

FAQ

Il software di governance dell'IA utilizza tecniche comuni per semplificare la creazione e l'implementazione di modelli di IA/ML, come ad esempio:

Spiegabilità e interpretabilità: il software di governance dell'IA utilizza visualizzazioni e spiegazioni per gli output dei modelli di IA al fine di fornire informazioni su come i modelli di IA prendono decisioni. Questi strumenti consentono agli utenti di comprendere e prevedere comportamenti complessi dei modelli.

Trasparenza e responsabilità: la governance dell'IA fornisce una documentazione chiara. dei dati e dei processi di addestramento del modello, che consentono il monitoraggio delle decisioni del modello ai fini della rendicontazione.

Equità e rilevamento dei pregiudizi: le pratiche di governance dell'IA si concentrano principalmente sull'identificazione e la quantificazione dei pregiudizi nei modelli e nei dati di IA. Ad esempio, gli strumenti di governance dell'IA possono monitorare le prestazioni del modello in diversi gruppi demografici, consentendo di mitigare i pregiudizi in tempo reale o durante l'addestramento. Due modi principali per rilevare i pregiudizi nel modello sono garantire la conformità con l'etica e la legge:

Conformità etica all'IA: la governance dell'IA allinea principalmente il comportamento dell'IA all'etica attraverso l'implementazione di linee guida e vincoli. Di conseguenza, uno scienziato dei dati può personalizzare il comportamento dell'IA per evitare risultati dannosi e offensivi da parte dei sistemi di IA.

Conformità normativa: una delle principali pratiche di governance dell'IA consiste nel garantire il rispetto dei requisiti legali e normativi, soddisfare gli standard di privacy e sicurezza dei dati e aiutare gli utenti aziendali a conformarsi alle normative specifiche del settore.

Gestione del ciclo di vita del modello: una volta che un modello è pronto, le tecniche di governance dell'IA possono gestirne l'implementazione nell'ambiente di produzione monitorando i modelli per rilevare derive, degrado o comportamenti imprevisti. Due funzionalità che possono facilitare l'implementazione dell'IA includono:

Validazione e test dei modelli: alcuni strumenti di governance dell'IA possono includere funzionalità di validazione dei modelli per testarli e verificarli rispetto a set di dati di riferimento. Implementare questi strumenti prima della produzione consente di individuare potenziali problemi.

Gestione del rischio dei modelli: le tecniche di governance dell'IA forniscono spunti per valutare e mitigare i rischi dei sistemi di IA.

Monitoraggio e verifica continui: un'altra pratica comune è il monitoraggio delle prestazioni del modello in produzione e del suo comportamento per garantire la conformità e l'affidabilità dei sistemi di intelligenza artificiale.

1. Identifica l'obiettivo e la portata: considera la portata delle tue iniziative di intelligenza artificiale e le tipologie di modelli e applicazioni di IA che stai sviluppando.

2. Ricercare e valutare gli strumenti disponibili sul mercato:

– Cercate fornitori specializzati nei settori più rilevanti per le vostre esigenze.

– Crea un elenco ristretto di strumenti promettenti in base alle loro caratteristiche, funzionalità e recensioni degli utenti.

3. Valutare gli strumenti preselezionati in base ai seguenti criteri:

– Caratteristiche di ciascuno strumento: Valutare la sua capacità di rilevare pregiudizi, garantire la privacy dei dati, fornire trasparenza e monitorare la conformità.

– Facilità di integrazione: Valuta quanto bene lo strumento di governance dell'IA si integra con la tua pipeline di sviluppo e implementazione dell'IA esistente.

– Compatibilità con la tua organizzazione: verifica la compatibilità con i linguaggi di programmazione, i framework e le piattaforme che utilizzi per lo sviluppo dell'IA. Assicurati che lo strumento possa integrarsi perfettamente con le tue fonti di dati, le soluzioni di archiviazione e i provider cloud.

– Interfaccia intuitiva: quanto lo strumento è intuitivo per un'interazione senza intoppi.

– Personalizzazione e flessibilità: la misura in cui lo strumento può essere personalizzato per soddisfare le vostre esigenze, consentendovi di regolare impostazioni e configurazioni.

– Scalabilità: Valuta la scalabilità dello strumento per adattarlo alla crescita della tua organizzazione nelle iniziative di intelligenza artificiale, come ad esempio l'aumento dei volumi di dati e dei carichi di lavoro man mano che i tuoi progetti si espandono.

– Qualità dell'assistenza del fornitore: Indagare sul livello di assistenza clienti, sui tempi di risposta e sul supporto fornito.

– Formazione e risorse: Valuta la completezza della documentazione, dei tutorial, delle guide per l'utente, delle risorse online e dei materiali di formazione. Ricorda che sono necessarie risorse adeguate per aiutare il tuo team ad apprendere come utilizzare lo strumento in modo efficace.

– Costi e budget: Valuta la struttura dei costi dello strumento di governance basato sull'IA, inclusi i costi di licenza, gli abbonamenti e le spese di implementazione. Calcola i costi e i benefici a lungo termine dello strumento per assicurarti che offra valore nel tempo, in base alle tue risorse finanziarie.

– Sicurezza e privacy dei dati: Verificare la conformità alle normative sulla protezione dei dati, inclusi crittografia e controlli di accesso. Garantire la sicurezza e la riservatezza delle informazioni sensibili.

3. Richiedere una prova gratuita e una dimostrazione di fattibilità (se applicabile): Eseguire una prova o una dimostrazione di fattibilità (PoC) con il software di governance dell'IA selezionato. È possibile utilizzare progetti di IA reali o simulati per valutare l'efficacia dello strumento nel soddisfare le proprie esigenze di governance. Coinvolgere le principali parti interessate, i data scientist e gli sviluppatori di IA nella PoC per raccogliere feedback su usabilità ed efficacia.

Dichiarazioni di non responsabilità

Si tratta di un settore emergente e la maggior parte di questi strumenti è integrata in piattaforme che offrono altri servizi come MLOps. Pertanto, AIMultiple non ha avuto la possibilità di esaminare questi strumenti in dettaglio e si è basata sulle dichiarazioni pubbliche dei fornitori per questa categorizzazione. AIMultiple migliorerà la propria categorizzazione man mano che il mercato maturerà.

I prodotti, ad eccezione di quelli degli sponsor, sono ordinati alfabeticamente in questa pagina poiché AIMultiple al momento non ha accesso a metriche più pertinenti per classificare queste aziende.

Gli elenchi dei fornitori non sono esaustivi.

Per approfondire

Scopri di più su AIOps, MLOps, ITOPs e LLMOps consultando i nostri articoli esaustivi:

- Confronto tra oltre 10 strumenti LLMOps: un benchmark completo dei fornitori.

- Cos'è LLMOps, perché è importante e 7 best practice

- Comprendere ITOps: vantaggi, casi d'uso e migliori pratiche

- Cos'è AIOPS, i 3 principali casi d'uso e i migliori strumenti?

- Panorama degli strumenti e delle piattaforme MLOps: guida approfondita

Consulta i nostri elenchi di fornitori basati sui dati per scoprire altri strumenti LLMOps e piattaforme MLOps .

Se hai ancora domande o dubbi, saremo lieti di aiutarti:

Trova i fornitori giusti

Sii il primo a commentare

Il tuo indirizzo email non verrà pubblicato. Tutti i campi sono obbligatori.