As empresas geram grandes volumes de dados de voz a partir de chamadas, reuniões e interfaces de voz, mas o processamento manual desses dados é lento e difícil de escalar.

O reconhecimento de fala (também chamado de reconhecimento automático de fala ou conversão de fala em texto) converte a linguagem falada em texto, permitindo que os sistemas analisem e automatizem fluxos de trabalho baseados em voz, como transcrição de chamadas, assistentes de voz e resumos de reuniões.

Explorando como funciona o reconhecimento de fala, os algoritmos envolvidos, suas aplicações em diversos setores e exemplos da vida real.

12 casos de uso de reconhecimento de fala

O reconhecimento de voz é utilizado em diversos setores para converter a linguagem falada em texto e possibilitar interações por voz com sistemas. Os exemplos a seguir mostram casos de uso comuns do reconhecimento de voz em setores como atendimento ao cliente, vendas, automotivo, saúde e tecnologia.

Atendimento e suporte ao cliente

- Sistemas de Resposta de Voz Interativa (IVR): Os sistemas IVR encaminham automaticamente as chamadas para o departamento apropriado, reconhecendo as perguntas feitas por voz. Eles reduzem o volume de chamadas e o tempo de espera, atendendo a solicitações simples por meio de respostas pré-gravadas ou sistemas de conversão de texto em voz . O Reconhecimento Automático de Fala (ASR) permite que os sistemas IVR compreendam e respondam às perguntas dos clientes em tempo real.

- Automação do suporte ao cliente e chatbots: O reconhecimento de voz permite que chatbots e assistentes virtuais baseados em voz lidem com solicitações rotineiras de atendimento ao cliente, como responder a perguntas frequentes, orientar na resolução de problemas e auxiliar com dúvidas sobre contas.

- Análise de sentimentos e monitoramento de chamadas: A análise de sentimentos classifica as conversas como positivas, negativas ou neutras, ajudando as organizações a monitorar a qualidade do serviço e identificar as preocupações dos clientes.

- Suporte multilíngue: Os modelos de reconhecimento de fala podem ser treinados para reconhecer vários idiomas. Quando integrados a chatbots ou sistemas de URA (Unidade de Resposta Audível), eles podem detectar o idioma do usuário e alternar para o modelo apropriado, ajudando as organizações a atender clientes internacionais (veja a Figura 1).

- Autenticação de clientes com biometria de voz: A biometria de voz utiliza tecnologias de reconhecimento de fala para analisar a voz de um falante e extrair características como sotaque e velocidade para verificar sua identidade.

Figura 1: Imagem que mostra como um chatbot multilíngue reconhece palavras em outro idioma.

Vendas e marketing

- Assistentes de vendas virtuais: assistentes de vendas com inteligência artificial interagem com os clientes por meio de voz e ajudam a orientá-los em suas decisões de compra. O reconhecimento de voz permite que esses sistemas entendam as solicitações faladas e respondam com base na intenção do cliente.

- Serviços de transcrição: O reconhecimento de voz converte gravações de chamadas de vendas e reuniões em transcrições escritas, facilitando a documentação e a análise.

Automotivo

- Controles ativados por voz: Os controles ativados por voz permitem que os usuários interajam com dispositivos e aplicativos usando comandos de voz. Os motoristas podem operar recursos como controle de temperatura, chamadas telefônicas ou sistemas de navegação.

- Navegação assistida por voz: A navegação assistida por voz fornece instruções guiadas por voz em tempo real, utilizando a entrada de voz do motorista para o destino. Os motoristas podem solicitar atualizações de trânsito em tempo real ou pesquisar pontos de interesse próximos usando comandos de voz, sem a necessidade de controles físicos.

Assistência médica

- Transcrição médica: A transcrição médica, também conhecida como MT, é o processo de conversão de relatórios médicos gravados em áudio em um documento de texto escrito. As principais etapas do processo de transcrição médica são as seguintes:

- Gravação da ditadura do médico.

- Transcrever a fala em texto usando sistemas de reconhecimento de voz (alguns sistemas também incluem a diarização do falante para distinguir entre falantes).

- Editar o texto transcrito para maior precisão e corrigir erros conforme necessário.

- Formatar o documento de acordo com os requisitos legais e médicos.

- Assistentes médicos virtuais: Os assistentes médicos virtuais (AMVs) utilizam reconhecimento de voz, processamento de linguagem natural e algoritmos de aprendizado de máquina para se comunicar com pacientes por voz ou texto. O software de reconhecimento de voz permite que os AMVs respondam a comandos de voz, recuperem informações de registros eletrônicos de saúde (RES) e automatizem o processo de transcrição médica.

- Integração com Registros Eletrônicos de Saúde (EHR): Os profissionais de saúde podem usar comandos de voz para navegar no sistema EHR, acessar dados do paciente e inserir dados em campos específicos.

exemplos práticos de reconhecimento de fala

Fala do Azure

O Azure Speech é um serviço de IA baseado na nuvem da Azure (parte das ferramentas do Azure AI Foundry) que permite que aplicativos processem e gerem linguagem falada. Ele oferece recursos como:

Conversão de fala em texto (reconhecimento automático de fala) : Converte áudio falado em texto escrito com suporte para múltiplos modos de transcrição:

- Transcrição em tempo real para áudio em streaming

- Transcrição rápida para arquivos gravados

- Transcrição em lote para grandes volumes de áudio

Os desenvolvedores também podem criar modelos de fala personalizados para melhorar a precisão do reconhecimento em vocabulário específico de um domínio ou em ambientes ruidosos.

Síntese de voz (conversão de texto em fala) : Transforma texto escrito em áudio com som natural usando vozes neurais. Os desenvolvedores podem controlar características da voz, como tom, velocidade e pronúncia, usando a Linguagem de Marcação de Síntese de Fala (SSML).

O Azure Speech também oferece suporte a vozes neurais personalizadas , permitindo que as organizações criem uma voz exclusiva para seus aplicativos.

Tradução de voz : Oferece tradução de voz multilíngue em tempo real, permitindo a tradução de voz para voz ou de voz para texto em diferentes idiomas.

Modelos de fala personalizados : Os desenvolvedores podem treinar modelos personalizados com seus próprios dados para melhorar o reconhecimento de:

- Terminologia específica do setor

- Sotaques e estilos de fala

- Condições de áudio ruidosas

Avatares de voz e IA conversacional : o Azure Speech pode gerar avatares falantes sintéticos e permitir interações de voz em tempo real, oferecendo suporte a sistemas de IA conversacional e agentes de voz.

Figura 2: Um exemplo do agente de IA de voz do Azure, Voice Live. 1

Deepgram

A Deepgram fornece APIs para integrar recursos de fala, como transcrição de fala para texto, síntese de texto para fala e inteligência de voz. 2

- Transcrição de fala para texto: Converte áudio em texto tanto para streaming em tempo real quanto para áudio pré-gravado.

- Conversão de texto em fala: Gera fala com som natural a partir de texto para interfaces de voz e assistentes.

- Diarização de falantes: Identifica e separa diferentes falantes em uma gravação de áudio.

- Detecção de palavras-chave e inteligência de áudio: Detecta palavras ou frases específicas e extrai informações relevantes dos dados de áudio.

- Modelos de fala personalizados: Permitem que as organizações melhorem a precisão do reconhecimento usando dados específicos do domínio.

Os casos de uso do Deepgram incluem:

- Atendimento ao cliente: Transcrever e analisar conversas de call center para monitorar a qualidade do serviço e extrair informações relevantes.

- Mídia e radiodifusão: Geração de legendas e transcrições para podcasts, entrevistas e transmissões ao vivo.

- Áreas da saúde e jurídica : Conversão de ditados e conversas faladas em documentação escrita.

- Análise de negócios: Extração de palavras-chave, sentimentos e insights de grandes volumes de dados de áudio.

AssemblyAI

A AssemblyAI é utilizada em análises de call center , onde as chamadas de suporte ao cliente são transcritas e analisadas para monitoramento de qualidade e obtenção de insights; transcrição de reuniões , que gera transcrições e resumos de reuniões virtuais; e transcrição de mídia , possibilitando legendas, transcrições e conteúdo de áudio ou vídeo pesquisável.

Também é utilizado para moderação de conteúdo , para detectar discursos inadequados ou restritos em fluxos de áudio, e para análise de dados de voz, extraindo informações como tópicos, entidades e sentimentos de grandes volumes de conversas gravadas. 3

- Transcrição de fala em texto: Converte fluxos ou arquivos de áudio em texto com registros de data e hora, níveis de confiança e outros metadados.

- Transcrição de streaming em tempo real: Processa áudio ao vivo com baixa latência para agentes de voz e aplicações em tempo real.

- Inteligência de áudio: Extrai informações da fala, incluindo diarização do locutor, análise de sentimentos , detecção de tópicos e reconhecimento de entidades.

- Resumo e compreensão de fala: Gera resumos e saídas estruturadas a partir de transcrições para dar suporte a fluxos de trabalho subsequentes.

- Moderação de conteúdo e redação de informações pessoais: Identifica ou remove conteúdo sensível ou inadequado de áudios.

- Recursos multilíngues e de detecção de idioma: Suporta transcrição em vários idiomas e sotaques.

Google Voz para Texto na Nuvem

Google O Cloud Speech-to-Text permite que os desenvolvedores integrem a API para transcrever arquivos de áudio, processar fluxos de fala ao vivo e criar recursos habilitados por voz, como comandos ou pesquisa. 4

- Transcrição em tempo real e em lote: transcreve áudio em streaming e arquivos pré-gravados.

- Suporte multilíngue: Reconhece a fala em mais de 100 idiomas e variantes.

- Modelos avançados de IA para reconhecimento de fala: Utiliza modelos de fala de Google (por exemplo, Chirp 3) treinados em grandes conjuntos de dados de áudio para maior precisão.

- O Chirp 3 é o modelo de IA de fala mais recente da Google para reconhecimento automático de fala (ASR). É um modelo generativo multilíngue projetado para converter áudio falado em texto com maior precisão e velocidade. O modelo aprimora a qualidade da transcrição e oferece recursos como diarização de falantes (identificação de diferentes falantes), detecção automática de idioma e reconhecimento de fala multilíngue.

- Pontuação automática e recursos de identificação de locutor: Adiciona pontuação às transcrições e consegue distinguir entre locutores em gravações.

O que é reconhecimento de fala?

O reconhecimento de fala, também conhecido como reconhecimento automático de fala (ASR), conversão de fala em texto (STT) e reconhecimento de fala por computador, é uma tecnologia que permite que um computador reconheça e converta a linguagem falada em texto.

A tecnologia de reconhecimento de voz utiliza modelos de IA e aprendizado de máquina para identificar e transcrever com precisão diferentes sotaques, dialetos e padrões de fala.

Reconhecimento de fala versus reconhecimento de voz

O reconhecimento de fala é frequentemente confundido com o reconhecimento de voz , porém, referem-se a conceitos distintos. O reconhecimento de fala converte palavras faladas em texto escrito, focando na identificação das palavras e frases proferidas por um usuário, independentemente da identidade do falante.

Por outro lado, o reconhecimento de voz se preocupa em reconhecer ou verificar a voz de um falante, visando determinar a identidade de um falante desconhecido, em vez de se concentrar na compreensão do conteúdo da fala.

Quais são as características dos sistemas de reconhecimento de fala?

Os sistemas de reconhecimento de fala possuem diversos componentes que trabalham em conjunto para compreender e processar a fala humana. As principais características de um sistema eficaz de reconhecimento de fala são:

Pré-processamento de áudio

Após obter o sinal de áudio bruto de um dispositivo de entrada, é necessário pré-processá-lo para melhorar a qualidade da entrada de voz. O principal objetivo do pré-processamento de áudio é capturar os dados de fala relevantes, removendo artefatos indesejados e reduzindo o ruído.

Extração de características

Esta etapa converte o sinal de áudio pré-processado em uma representação mais informativa. Isso torna os dados de áudio brutos mais gerenciáveis para modelos de aprendizado de máquina em sistemas de reconhecimento de fala.

ponderação do modelo de linguagem

A ponderação linguística atribui maior importância a certas palavras e frases, como referências a produtos, em sinais de áudio e voz. Isso aumenta a probabilidade de essas palavras-chave serem reconhecidas posteriormente por sistemas de reconhecimento de fala.

Modelagem acústica

Permite que os sistemas de reconhecimento de fala capturem e distingam unidades fonéticas dentro de um sinal de fala. Os modelos acústicos são treinados em grandes conjuntos de dados contendo amostras de fala de um conjunto diversificado de falantes com diferentes sotaques, estilos de fala e origens.

Identificação de falantes

Permite que aplicativos de reconhecimento de fala determinem a identidade de vários falantes em uma gravação de áudio. Atribui rótulos exclusivos a cada falante na gravação, possibilitando a identificação de quem estava falando em determinado momento.

Filtragem de palavrões

O processo de remoção de palavras ou frases ofensivas, inapropriadas ou explícitas de dados de áudio.

Quais são os diferentes algoritmos de reconhecimento de fala?

O reconhecimento de fala utiliza diversos algoritmos e técnicas computacionais para converter a linguagem falada em linguagem escrita. A seguir, alguns dos métodos de reconhecimento de fala mais comumente utilizados:

Modelos Ocultos de Markov (HMMs)

O modelo oculto de Markov (HMM) é um modelo estatístico de Markov comumente usado em sistemas tradicionais de reconhecimento de fala. Os HMMs capturam a relação entre as características acústicas e modelam a dinâmica temporal dos sinais de fala.

Processamento de linguagem natural (PLN)

O Processamento de Linguagem Natural (PLN) é um subcampo da inteligência artificial que se concentra na interação entre humanos e máquinas por meio da linguagem natural. Algumas das principais funções do PLN em sistemas de reconhecimento de fala incluem:

- Estime a probabilidade de sequências de palavras no texto reconhecido.

- Converter expressões coloquiais e abreviações da língua falada em sua forma escrita padrão.

- Mapear as unidades fonéticas obtidas a partir de modelos acústicos para suas palavras correspondentes na língua alvo.

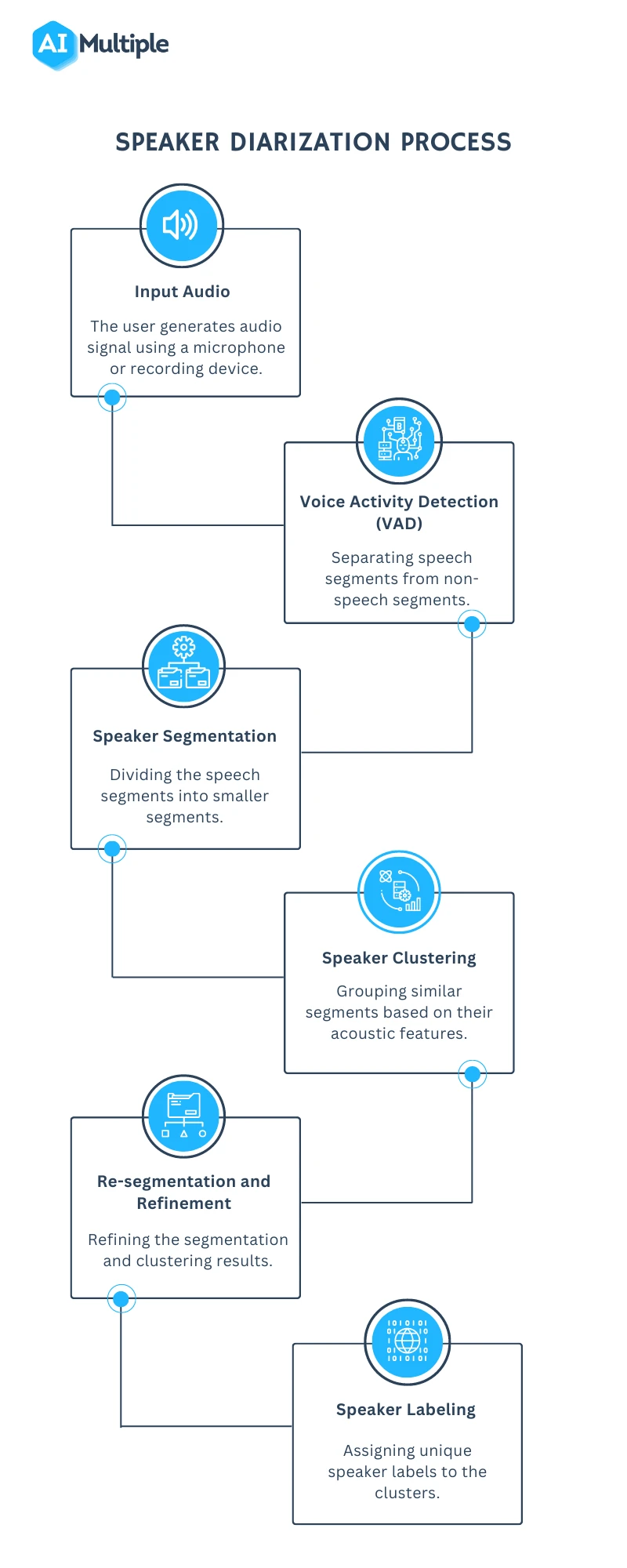

Diarização de falantes (SD)

A diarização de falantes, ou rotulagem de falantes, é o processo de identificar e atribuir segmentos de fala aos seus respectivos falantes (Figura 1). Ela permite o reconhecimento de voz específico para cada falante e a identificação de indivíduos em uma conversa.

Figura 3: Fluxograma ilustrando o processo de diarização de falantes.

Distorção Temporal Dinâmica (DTW)

Os algoritmos de reconhecimento de fala utilizam o algoritmo Dynamic Time Warping (DTW) para encontrar um alinhamento ideal entre duas sequências (Figura 4).

Figura 4: Um sistema de reconhecimento de fala que utiliza o algoritmo de alinhamento temporal dinâmico (DTW) para determinar a distância ideal entre os elementos. 5

Redes neurais profundas

As redes neurais processam e transformam os dados de entrada simulando a percepção não linear da frequência do sistema auditivo humano.

Classificação Temporal Conexionista (CTC)

Trata-se de um objetivo de treinamento introduzido por Alex Graves em 2006. O CTC é especialmente útil para tarefas de rotulagem de sequências e sistemas de reconhecimento de fala de ponta a ponta. Ele permite que a rede neural descubra a relação entre os quadros de entrada e alinhe esses quadros com os rótulos de saída.

Quais são os desafios do reconhecimento de fala?

Embora a tecnologia de reconhecimento de voz ofereça muitos benefícios, ela ainda enfrenta diversos desafios que precisam ser superados. Algumas das principais limitações do reconhecimento de voz incluem:

Desafios acústicos

Sotaques e dialetos

Os sotaques e dialetos diferem na pronúncia, no vocabulário e na gramática, o que dificulta o reconhecimento preciso da fala por aplicativos de reconhecimento de voz.

Suponha que um modelo de reconhecimento de fala tenha sido treinado principalmente com sotaques do inglês americano. Se um falante com um forte sotaque escocês usar o sistema, poderá encontrar dificuldades devido às diferenças de pronúncia. Por exemplo, a palavra "water" (água) é pronunciada de forma diferente em ambos os sotaques. Se o sistema não estiver familiarizado com essa pronúncia, poderá ter dificuldades em reconhecer a palavra "water".

Solução: Superar esses desafios é crucial para aprimorar a precisão dos aplicativos de reconhecimento de fala. Para contornar as variações de pronúncia, é essencial expandir os dados de treinamento para incluir amostras de falantes com diferentes sotaques. Essa abordagem ajuda o sistema a reconhecer e compreender uma gama mais ampla de padrões de fala.

Ruído de fundo

O ruído de fundo (por exemplo, tráfego, conversas simultâneas) dificulta a distinção entre fala e ruído de fundo em aplicações de reconhecimento de fala (ver Figura 5).

Solução: Técnicas de pré-processamento podem ser usadas para reduzir o ruído de fundo no reconhecimento de fala, o que pode ajudar a melhorar o desempenho dos modelos de reconhecimento de fala em ambientes ruidosos.

Por exemplo, você pode usar técnicas de aumento de dados para reduzir o impacto do ruído em dados de áudio. O aumento de dados ajuda a treinar modelos de reconhecimento de fala com dados ruidosos para melhorar a precisão do modelo em ambientes do mundo real.

Figura 5: Exemplos de uma frase-alvo (“O palhaço tinha uma cara engraçada”) em meio ao ruído de fundo de conversas, carros e chuva. 6

Desafios linguísticos

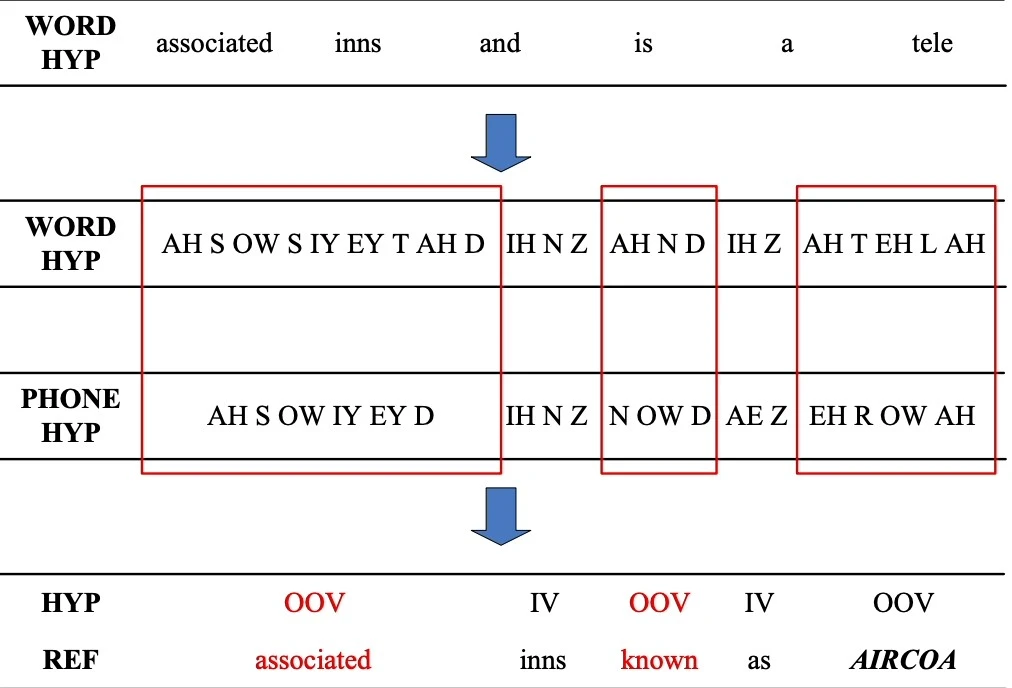

Palavras fora do vocabulário

Como o modelo de reconhecimento de fala não foi treinado em palavras fora do vocabulário (OOV, na sigla em inglês), ele pode reconhecê-las incorretamente como diferentes ou falhar na transcrição ao encontrá-las.

Figura 6: Um exemplo de detecção de uma palavra fora do vocabulário (OOV).

Solução: A Taxa de Erro de Palavras (WER, na sigla em inglês) é uma métrica comum usada para medir a precisão de um sistema de reconhecimento de fala ou tradução automática. A taxa de erro de palavras pode ser calculada como:

Figura 7: Demonstração de como calcular a taxa de erro de palavras (WER). 7

Homófonos

Homófonos são palavras que são pronunciadas da mesma forma, mas têm significados diferentes, como "to", "too" e "two".

Solução: A análise semântica permite que os programas de reconhecimento de fala selecionem o homófono apropriado com base no seu significado pretendido num determinado contexto. O tratamento de homófonos melhora a capacidade do processo de reconhecimento de fala de compreender e transcrever palavras faladas com precisão.

Desafios técnicos/de sistema

Privacidade e segurança de dados

Os sistemas de reconhecimento de voz envolvem o processamento e o armazenamento de informações sensíveis e pessoais, como informações financeiras. Uma pessoa não autorizada poderia usar as informações capturadas, levando a violações de privacidade.

Solução: É possível criptografar informações de áudio sensíveis e pessoais transmitidas entre o dispositivo do usuário e o software de reconhecimento de voz. Outra técnica para lidar com a privacidade e a segurança de dados em sistemas de reconhecimento de voz é a mascaramento de dados. Os algoritmos de mascaramento de dados mascaram e substituem dados de voz sensíveis por dados estruturalmente idênticos, mas acusticamente diferentes.

Figura 8: Um exemplo de como funciona a mascaramento de dados.

Dados de treinamento limitados

A quantidade limitada de dados de treinamento impacta diretamente o desempenho do software de reconhecimento de fala. Com dados de treinamento insuficientes, o modelo de reconhecimento de fala pode ter dificuldades para generalizar diferentes sotaques ou reconhecer palavras menos comuns.

Solução: Para melhorar a qualidade e a quantidade de dados de treinamento, você pode expandir o conjunto de dados existente usando tecnologias de aumento de dados e geração de dados sintéticos.

Seja o primeiro a comentar

Seu endereço de e-mail não será publicado. Todos os campos são obrigatórios.