Confronta oltre 20 piattaforme e librerie di intelligenza artificiale responsabile

Il mercato delle piattaforme di IA responsabile comprende due tipologie di software. Segui i link per saperne di più:

Piattaforme di intelligenza artificiale responsabile orientate alle imprese, come ad esempio:

- Credo AI e IBM Watsonx.governance per la governance dell'IA

- Amazon SageMaker e Dataiku per MLOps con funzionalità di intelligenza artificiale responsabile

- Databricks e IBM Watsonx.data intelligence per una piattaforma dati con funzionalità di IA responsabile

Librerie di intelligenza artificiale responsabili e open-source che offrono funzionalità specifiche (ad esempio, apprendimento federato):

- TensorFlow Federated (TFF) per la privacy

- Intelligenza artificiale Fairness 360 per l'equità

- Dalex per la spiegabilità (ovvero XAI )

- TextAttack per l'apprendimento automatico avversariale

Questi strumenti sono identificati come leader di mercato in base a parametri quali il numero di recensioni, le funzionalità, i punteggi GitHub e le citazioni da parte di aziende Fortune 500. Per visualizzare i casi d'uso e gli ambiti di applicazione degli strumenti (ad esempio, MLops, governance dell'IA e governance dei dati), segui i link presenti su ciascuna di esse.

Piattaforme di IA aziendali responsabili

Piattaforma | Tipo | numero di dipendenti | Valutazione |

|---|---|---|---|

Intelligenza artificiale olistica | governance dell'IA | 85 | Non ci sono abbastanza recensioni |

Credo AI | governance dell'IA | 49 | Non ci sono abbastanza recensioni |

Intelligenza artificiale equa | governance dell'IA | 13 | Non ci sono abbastanza recensioni |

Aporia | MLOP | 359 | 4.8 basato su 68 reviews |

Dataiku | MLOP | 1,378 | 4.5 basato su 198 reviews |

Amazon SageMaker | MLOP | 130,371 | 4.5 basato su 49 reviews |

Databricks | governance dei dati | 9,280 | 4.6 basato su 655 reviews |

IBM Watsonx | governance dei dati | 4,07 basato su 30 recensioni | |

Snowflake | governance dei dati | 8,441 | 4.6 basato su 770 reviews |

Intelligenza artificiale esperta | PNL responsabile | 278 | Non ci sono abbastanza recensioni |

* Questi strumenti sono ordinati alfabeticamente all'interno della loro categoria, ad eccezione degli sponsor che sono posizionati in cima.

piattaforme di governance dell'IA

Gli strumenti di governance dell'IA aiutano le unità aziendali a implementare sistemi di IA conformi agli standard di settore.

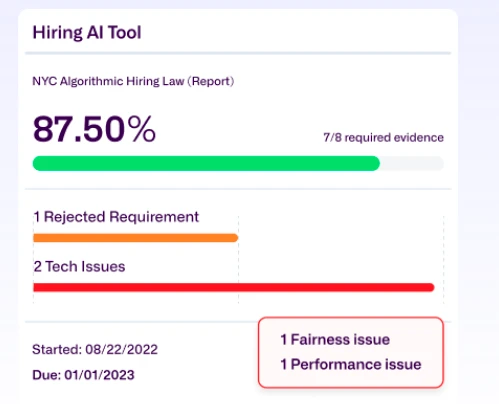

Credo AI

Credo AI, una piattaforma di governance dell'IA responsabile, può aiutare le aziende a:

- Collabora utilizzando strumenti come la raccolta di prove, il monitoraggio delle responsabilità e la semplificazione degli appalti da terze parti.

- Valutare i sistemi di intelligenza artificiale in termini di rischi operativi, normativi e reputazionali durante tutto il loro ciclo di vita.

- Creare artefatti di governance traducendo le evidenze tecniche in documenti di facile utilizzo, realizzando schede modello, rapporti di audit, rapporti sui rischi e sulla conformità e informative.

- Garantire la conformità alle normative globali come l'EU AI Act e il Canada Data and AI Act, alle politiche interne e agli standard di settore.

Intelligenza artificiale equa

Fairly AI, ora acquisita da Asenion, è uno strumento di governance dell'IA che semplifica la convalida dei modelli, i processi di audit e le valutazioni del rischio, garantendo la conformità normativa e la gestione del rischio. Il framework di IA responsabile di Fairly AI individua le lacune nelle politiche e nelle normative, contribuendo a selezionare le politiche appropriate e garantendo una copertura completa per un'efficace governance e gestione del rischio dell'IA.

Intelligenza artificiale olistica

Holistic AI offre framework di gestione del rischio, conformità e governance dell'IA per aiutare le aziende a implementare l'intelligenza artificiale in modo responsabile.

- Valutazione dei pregiudizi attraverso l'identificazione e la mitigazione dei pregiudizi nei sistemi di intelligenza artificiale, offrendo strategie attuabili, supporto continuo e report di audit completi che possono essere condivisi con le parti interessate.

- Valutazione della conformità mediante la catalogazione e la convalida dei sistemi di IA ad alto rischio rispetto ai requisiti dell'AI Act, conduzione di valutazioni del rischio con strategie di mitigazione e garanzia che la documentazione tecnica sia conforme agli standard legali.

- Gestione proattiva del rischio attraverso la ricezione di report periodici e l'esecuzione di audit interni per individuare impatti negativi, utilizzando al contempo informazioni basate sui dati per ottimizzare l'uso dell'IA e supportare le decisioni strategiche.

IBM Watsonx.governance

Watsonx.governance può migliorare la fiducia e la trasparenza dell'IA fornendo visibilità di livello aziendale, tracciamento delle risorse IA e conformità dei dati e dei flussi di lavoro IA in vari ambienti di implementazione, tra cui Cloud e AWS.

Gli utenti di Watsonx.governance possono integrarsi con altri strumenti di Watsonx Studio, come watsonx.ai e watson.data, per addestrare, convalidare, ottimizzare e implementare l'IA.

MLOps

Amazon SageMaker e Amazon Bedrock

Amazon fornisce strumenti progettati per supportare i team di conformità nella realizzazione di sistemi di IA responsabile, quali:

- Su Amazon Bedrock: un servizio completamente gestito che semplifica lo sviluppo di applicazioni di intelligenza artificiale generativa, fornendo accesso a modelli di base ad alte prestazioni senza richiedere la preparazione dei dati, la creazione di modelli o la gestione dell'infrastruttura.

- Guardrails : Implementa misure di sicurezza nell'IA generativa specificando gli argomenti da evitare e rilevando e prevenendo automaticamente query e risposte soggette a restrizioni.

- Valutazione del modello : valuta e confronta i modelli Foundation in base a metriche personalizzate come accuratezza e sicurezza per aiutare a selezionare il modello migliore per casi d'uso specifici.

- Su Amazon SageMaker: una piattaforma di machine learning che offre processi di creazione, addestramento e implementazione di modelli, risultando ideale per attività di machine learning personalizzate come analisi predittiva, sistemi di raccomandazione e rilevamento di anomalie.

- Chiarimento : rileva potenziali distorsioni e fornisce spiegazioni sulle previsioni del modello, offrendo trasparenza e approfondimenti per garantire decisioni di intelligenza artificiale eque e informate.

- Monitoraggio del modello : monitora i modelli distribuiti rilevando e segnalando automaticamente le previsioni imprecise per mantenere la qualità del modello.

- Governance dell'apprendimento automatico : migliora la governance offrendo strumenti per il controllo e il monitoraggio dei modelli di apprendimento automatico, inclusa l'acquisizione e la condivisione delle informazioni sui modelli per garantire un'implementazione responsabile dell'IA.

- Intelligenza artificiale aumentata di Amazon : facilita la revisione umana delle previsioni di apprendimento automatico, consentendo la supervisione laddove è richiesto il giudizio umano.

Scopri come Amazon Bedrock offre un'intelligenza artificiale responsabile:

Aporia

La piattaforma Aporia Responsible AI offre una governance completa per i progetti di IA attraverso:

- Garantire la diversità dei dati, valutare le metriche di equità e monitorare i sistemi per individuare eventuali pregiudizi, al fine di mantenere standard etici nell'ambito dell'IA.

- Conformarsi a normative come il GDPR e altri standard di settore

- Promuovere la responsabilità e la trasparenza attraverso l'IA spiegabile, garantendo che i processi decisionali dell'IA siano comprensibili.

Dataiku

Dataiku è una piattaforma di machine learning e data science che consente di creare, implementare e gestire progetti di dati, analisi e intelligenza artificiale. Grazie a diverse funzionalità chiave, supporta l'IA responsabile in questi progetti:

- Analisi statistica avanzata : consente un'analisi approfondita dei dati per identificare e affrontare potenziali distorsioni.

- Rapporti sull'equità del modello : forniscono metriche come la parità demografica e le probabilità equiparate per misurare e mitigare i pregiudizi.

- Intelligenza artificiale spiegabile : offre spiegazioni a livello di riga e analisi "what-if" per garantire trasparenza e responsabilità.

- Conformità alla protezione dei dati : garantisce il rispetto di normative quali il GDPR e il CCPA.

- Documentazione del modello : automatizza la creazione di una documentazione dettagliata del modello per scopi normativi e interni.

- Strumenti di governance : implementa piani di progetto standard e modelli di flusso di lavoro per allinearsi alle pratiche di IA responsabile e ai requisiti normativi.

governance dei dati

La governance dei dati si riferisce al quadro generale che allinea le pratiche relative ai dati con gli obiettivi aziendali e le strutture di responsabilità. Un'ampia applicazione della governance dei dati si trova nelle applicazioni di machine learning, ed è nota come governance dei dati per il machine learning .

Databricks

Databricks è una piattaforma unificata di dati e intelligenza artificiale che garantisce la proprietà e il controllo dei dati per i modelli di IA attraverso un monitoraggio completo, controlli sulla privacy e governance. Databricks offre un'IA responsabile attraverso il suo framework di test per l'IA responsabile, che include:

- Red teaming basato sull'intelligenza artificiale per identificare le vulnerabilità

- Indagini automatizzate e manuali per individuare pregiudizi e questioni etiche.

- Test di jailbreak per comprendere il comportamento del modello sotto attacco

- Modella la sicurezza della catena di approvvigionamento per salvaguardare i sistemi di intelligenza artificiale durante tutto il loro ciclo di vita.

IBM Watsonx.data intelligence

Watsonx.data intelligence è una piattaforma di governance e intelligence dei dati che garantisce dati di alta qualità, conformi e pronti per l'uso aziendale per i modelli di intelligenza artificiale. Offre un'IA responsabile grazie alle sue funzionalità di intelligence dei dati basate sull'IA, che includono:

- Accesso in linguaggio naturale per utenti di tutti i livelli di competenza, per cercare e utilizzare i dati in modo efficiente.

- Individuazione e catalogazione automatizzate dei dati provenienti da fonti strutturate e non strutturate.

- Governance dei dati e controlli di qualità, inclusi tracciamento, classificazione e analisi d'impatto.

Arricchimento e standardizzazione dei dati tramite intelligenza artificiale per set di dati coerenti e utilizzabili.

Snowflake

Snowflake è una piattaforma dati basata su cloud per l'archiviazione, l'elaborazione e l'analisi dei dati, che aiuta le aziende a gestire e utilizzare i propri dati in modo efficiente. Il suo approccio responsabile all'IA pone l'accento sulla sicurezza dei dati, sulla diversità e sulla maturità organizzativa, garantendo che le applicazioni di IA siano costruite su una base dati sicura, diversificata e ben governata. Inoltre, Snowflake promuove l'alfabetizzazione dei dati e la collaborazione interfunzionale per favorire un uso responsabile dell'IA in tutte le organizzazioni.

Strumenti e librerie open-source per l'IA responsabile

* Questi strumenti sono ordinati in base al punteggio GitHub nella loro categoria. Si prega di notare che le librerie non aggiornate sono escluse da questo elenco.

privacy dell'IA

Queste librerie si concentrano sull'uso dell'IA per scopi legittimi, evitando applicazioni non etiche. Le organizzazioni che aderiscono agli standard etici per l'IA implementano linee guida rigorose, processi di revisione approfonditi e obiettivi chiari per garantire la conformità.

- TensorFlow Privacy : una libreria Python che offre implementazioni di ottimizzatori TensorFlow per l'addestramento di modelli di machine learning con privacy differenziale.

- TensorFlow Federated (TFF) : progettato per supportare la ricerca e la sperimentazione aperte nell'apprendimento federato (FL), in cui un modello globale viene addestrato su più client senza condividere i loro dati locali.

- Deon : uno strumento da riga di comando che consente di aggiungere una checklist etica ai progetti di data science, promuovendo considerazioni etiche e fornendo promemoria concreti agli sviluppatori.

Trasparenza e pregiudizi dell'IA

Le librerie di trasparenza sull'IA consentono alle parti interessate di comprendere e spiegare i modelli di IA, garantendo la trasparenza in merito alle motivazioni, ai dati e agli intenti che li sottendono.

- Model Card Toolkit (MCT) : automatizza la creazione di Model Card, documenti che offrono contesto e trasparenza sullo sviluppo e sulle prestazioni di un modello.

Equità

L'equità nell'IA implica la protezione di individui e gruppi da discriminazioni, pregiudizi e maltrattamenti. I modelli dovrebbero essere valutati in termini di equità per prevenire pregiudizi nei confronti di specifici gruppi, fattori o variabili.

- AI Fairness 360 : un toolkit open-source di IBM che offre tecniche per rilevare e mitigare i pregiudizi nei modelli di apprendimento automatico lungo tutto il ciclo di vita dell'IA.

- Fairlearn : un pacchetto Python che aiuta gli sviluppatori a valutare l'equità dei loro sistemi di intelligenza artificiale e a mitigare eventuali pregiudizi identificati, offrendo sia algoritmi di mitigazione che metriche per la valutazione dei modelli.

- Responsible AI Toolbox : una suite di strumenti di Microsoft che fornisce interfacce per esplorare e valutare modelli e dati di IA, facilitando lo sviluppo e l'implementazione di sistemi di IA in modo sicuro ed etico.

Spiegabilità dell'IA

Le librerie di interpretabilità dell'IA contribuiscono a migliorare la comprensione umana e la fiducia nei risultati degli algoritmi di apprendimento automatico.

- DALEX : Un pacchetto indipendente dal modello che aiuta a esplorare e spiegare il comportamento dei modelli, facilitando la comprensione di modelli complessi.

- TensorFlow Data Validation (TFDV) : una libreria per esplorare e validare i dati di machine learning, ottimizzata per la scalabilità e l'integrazione con TensorFlow e TensorFlow Extended (TFX).

Apprendimento automatico avversariale

L'apprendimento automatico avversariale è una tecnica che tenta di sfruttare i modelli di intelligenza artificiale utilizzando informazioni accessibili per creare attacchi dannosi.

- TextAttack : un framework Python per attacchi avversari, addestramento e aumento dei dati in PNL, che semplifica il processo di test e migliora la robustezza dei modelli PNL.

Che cos'è l'intelligenza artificiale responsabile?

4 I principi guida dell'IA , noti anche come intelligenza artificiale responsabile, si riferiscono alla creazione di fiducia nelle soluzioni di IA mediante l'applicazione di una serie di principi che sono:

- Equità

- Privacy

- Sicurezza e protezione

- Trasparenza

Questi principi contribuiscono a guidare la progettazione, lo sviluppo, l'implementazione e l'utilizzo dell'intelligenza artificiale.

Perché l'intelligenza artificiale responsabile è importante?

COME Le statistiche sull'IA e le tendenze dell'automazione IT indicano che:

- Entro il prossimo anno, il 90% delle applicazioni aziendali commerciali integrerà funzionalità di intelligenza artificiale.

- 9 aziende leader su 10 stanno investendo in tecnologie di intelligenza artificiale. Dopo il lancio di ChatGPT nel 2022, le aziende hanno segnalato un

- Aumento del 97% dell'interesse per lo sviluppo dell'intelligenza artificiale generativa.

- Si è registrato un aumento del 72% nell'adozione di pipeline di apprendimento automatico a supporto delle strategie di intelligenza artificiale generativa.

Questo aumento nell'adozione dell'IA e degli strumenti di IA generativa ha portato a preoccupazioni e precauzioni, quali:

- Il 71% dei responsabili IT è preoccupato per le vulnerabilità di sicurezza dei sistemi LLM e per i rischi legati all'intelligenza artificiale generativa .

- Il 77% delle aziende considera la conformità all'IA una priorità.

- Il 69% delle aziende ha implementato pratiche di IA responsabile per valutare la conformità e identificare i rischi. 9

- Le leggi sulla protezione dei dati, tra cui il GDPR (UE) e il CCPA (California), mirano a prevenire le violazioni della privacy.

- La legge europea sull'intelligenza artificiale impone alle organizzazioni di mantenere aggiornati e accurati i propri inventari relativi all'IA.

- Aumento dei casi di pregiudizi nell'IA , come razzismo, sessismo, abilismo e discriminazione basata sull'età.

FAQ

La governance dei dati comprende i framework e gli strumenti che le organizzazioni utilizzano per proteggere e utilizzare correttamente i propri dati. Alcuni dei metodi, processi e tecnologie della governance dei dati includono:

1- Raccolta dati

2- Archiviazione dei dati

3- Elaborazione dei dati

4- Pulizia dei dati

5- Gestione dei dati

6. Condivisione dei dati in modo controllato per:

6.a- Proteggere la privacy dei dati

6.b- Mantenere la qualità dei dati

6.c - Sostenere la conformità alle normative pertinenti .

7- Gestione delle minacce interne (ITM) .

Per IA affidabile si intendono i sistemi di IA che si comportano in modo coerente come previsto: accurato, robusto e sicuro in diverse condizioni.

L'intelligenza artificiale affidabile è un termine rilevante per l'intelligenza artificiale responsabile, poiché la fiducia, l'equità e la conformità dipendono da sistemi che si comportano in modo prevedibile. Gli strumenti di intelligenza artificiale responsabile garantiscono l'affidabilità attraverso il monitoraggio dei modelli, la verifica dei bias, la spiegabilità e l'allineamento normativo.

Per approfondire

Scopri altri strumenti e pratiche per mitigare i rischi dell'IA generativa, come ad esempio:

- Strumenti di sicurezza LLM

- Tecnologie per la tutela della privacy

- Strumenti LLMOps

- Strumenti MLOps

- Strumenti di governance dell'IA.

Sii il primo a commentare

Il tuo indirizzo email non verrà pubblicato. Tutti i campi sono obbligatori.