Le applicazioni basate su LLM stanno diventando sempre più potenti e complesse, rendendo il loro comportamento più difficile da interpretare.

Ogni output del modello deriva da prompt, interazioni con gli strumenti, fasi di recupero e ragionamenti probabilistici che non possono essere ispezionati direttamente. L'osservabilità LLM affronta questa sfida fornendo una visibilità continua sul funzionamento dei modelli in condizioni reali. Consente alle organizzazioni di monitorare la qualità, rilevare i guasti, risolvere i problemi dei flussi di lavoro a più fasi e gestire prestazioni e costi.

Attrezzo | Ideale per |

|---|---|

Esecuzione frequente di esperimenti e confronto di prompt/modelli con un solido sistema di versioning e dashboard. | |

Langfuse | Osservabilità open-source e self-hosted con tracce granulari e valutazioni personalizzabili. |

Elicone | Configurazione senza codice per il monitoraggio di base, il tracciamento dei costi e la memorizzazione nella cache delle chiamate API di LLM. |

Langsmith | Creazione di catene o agenti a più fasi (in particolare con LangChain) con visibilità dettagliata della tracciabilità. |

Braintrust | Valutazione automatizzata, avvisi e monitoraggio della qualità della produzione. |

Pesi e diagonali (tessitura W&B)

W&B Weave è la piattaforma di osservabilità LLM di Weights & Biases per il monitoraggio, la valutazione e l'ottimizzazione delle applicazioni di modelli linguistici. Weave traccia automaticamente ogni chiamata LLM utilizzando il decoratore @weave.op, acquisendo input, output, costi, latenza e metriche di valutazione senza necessità di configurazione manuale.

La piattaforma tiene traccia dell'utilizzo dei token e calcola automaticamente i costi, monitora i tempi di risposta per individuare le query lente e misura l'accuratezza confrontando le previsioni con i risultati attesi. È possibile confrontare diversi esperimenti in parallelo per vedere quale modello o prompt offre prestazioni migliori. Il tracciamento degli errori mostra quali previsioni non sono andate a buon fine e perché, mentre il versioning automatico conserva ogni modifica di configurazione per garantire la riproducibilità. Questo semplifica la sperimentazione di diversi approcci, l'identificazione delle soluzioni più efficaci e il debug dei problemi quando i modelli commettono errori.

Riepilogo dei punteggi - Dashboard

Figura 1: Grafici che mostrano la dashboard delle metriche di prestazione del modello, con tracciamento dell'accuratezza, dei costi e delle tendenze di latenza nel tempo.

Le metriche di performance vengono visualizzate per tutte le esecuzioni di valutazione. Costo totale, utilizzo dei token e tempi di risposta sono mostrati con grafici che illustrano le variazioni nel tempo. Le metriche personalizzate, come l'accuratezza e i tassi di errore, vengono visualizzate in pannelli separati. Le linee di tendenza aiutano a individuare i momenti in cui le prestazioni peggiorano o i costi aumentano inaspettatamente, e la dashboard si aggiorna automaticamente al completamento dei nuovi test.

Tracce Visualizza

Figura 2: Tabella di tracciamento della valutazione che mostra le versioni del modello e i relativi risultati di classificazione dell'intento.

Ogni esecuzione del test viene salvata con tutti i dettagli. Ogni traccia mostra quale modello è stato utilizzato, quale richiesta è stata inviata e tutte le impostazioni. Gli indicatori di successo o fallimento indicano se i test sono stati completati correttamente. La colonna "Richiesta" visualizza il testo inviato al modello per la verifica. Questa registrazione consente di confrontare diverse versioni affiancate, di vedere cosa è cambiato tra un'esecuzione e l'altra e di ripetere qualsiasi test utilizzando la configurazione salvata.

Classifica comparativa dei modelli

Figura 3: Immagine che mostra la classifica a confronto delle versioni del modello di classificazione delle intenzioni in base alle metriche di accuratezza e latenza.

È possibile confrontare diversi modelli e impostazioni sugli stessi dati di test. Le colonne mostrano accuratezza, previsioni corrette, punteggi e tempi di risposta. La codifica a colori evidenzia in verde le prestazioni migliori. Questo confronto rivela compromessi come una maggiore accuratezza a scapito di una velocità inferiore o tempi di risposta più rapidi con un'accuratezza leggermente inferiore, aiutando a scegliere la configurazione più adatta alle esigenze di produzione.

Versionamento del modello

Figura 4: Pannello di configurazione del classificatore di intenti che mostra le impostazioni del modello e i dettagli della versione.

Ogni modifica alla configurazione crea automaticamente una nuova versione, mantenendo una cronologia completa. I dettagli della versione mostrano quando sono state apportate le modifiche, chi le ha effettuate e lo spazio di archiviazione utilizzato. La scheda Valori visualizza le impostazioni esatte, inclusi il nome del modello, i parametri e le versioni delle funzioni. Questo sistema di versioning garantisce che qualsiasi test possa essere ripetuto con impostazioni identiche, consente di monitorare l'andamento delle prestazioni nel tempo e permette di ripristinare versioni precedenti, se necessario.

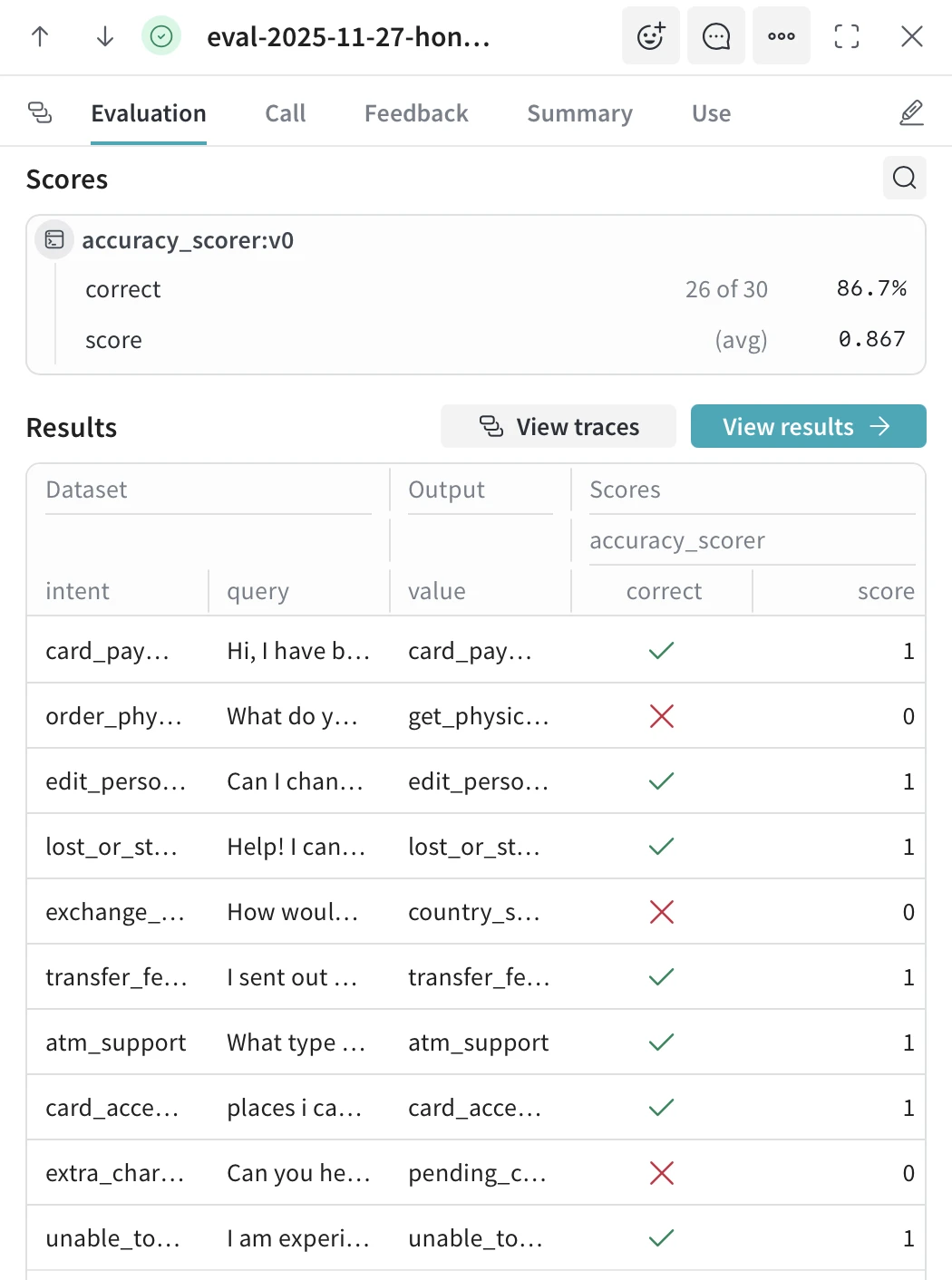

Risultati dettagliati della valutazione

Figura 5: Risultati della valutazione che mostrano i singoli casi di test con le intenzioni previste e i punteggi di accuratezza.

Per ogni campione vengono visualizzati i risultati individuali dei test. La sezione Punteggi riassume il numero totale di previsioni corrette, la percentuale di accuratezza e i punteggi personalizzati.

La tabella dei risultati mostra ogni query con la relativa risposta attesa e la previsione del modello, utilizzando un segno di spunta per le risposte corrette e una X per quelle errate. Le previsioni errate sono facili da individuare, spesso mostrando schemi ricorrenti come la confusione tra categorie simili.

Facendo clic su una qualsiasi riga si apre la traccia completa, inclusi il prompt, la risposta, il conteggio dei token e la tempistica, semplificando il debug degli errori e consentendo di migliorare i prompt o la selezione del modello.

Langsmith

LangSmith è la piattaforma di osservabilità di LangChain per il monitoraggio, il debug e la valutazione delle applicazioni LLM. Traccia automaticamente ogni chiamata LLM, acquisisce prompt e output, tiene traccia dei costi e della latenza e consente una valutazione sistematica tramite test basati su dataset. LangSmith si integra nativamente con LangChain, ma supporta qualsiasi applicazione LLM tramite il suo SDK.

Risultati della valutazione per campione

Figura 6: Immagine che mostra la valutazione del singolo caso di test in termini di previsioni e metriche di prestazione.

I risultati delle singole previsioni vengono visualizzati insieme agli output attesi, consentendo di identificare gli errori del modello. Il confronto tra previsioni attese e previsioni effettive rivela la confusione tra categorie semanticamente simili. La latenza per query e il conteggio dei token mostrano quali tipi di input sono più onerosi da elaborare, consentendo l'ottimizzazione delle query lente o dispendiose.

Monitoraggio del volume e dello stato di salute delle tracce

Figura 7: Grafico che mostra l'andamento del progetto, con visualizzazione dei tassi di successo e di errore nel tempo.

Lo stato di salute dell'applicazione viene mostrato attraverso l'andamento del volume di tracce e i rapporti successo/errore nel tempo. Sono disponibili diverse visualizzazioni per analizzare le chiamate LLM, l'andamento dei costi, le invocazioni degli strumenti o i punteggi di feedback. Problemi come picchi di errori o aumenti dei costi diventano visibili, indicando le problematiche che richiedono un'indagine.

Confronto tra modelli e configurazioni

Figura 8: Vista comparativa degli esperimenti che mostra le metriche delle prestazioni su più esecuzioni di test.

Diversi modelli possono essere confrontati fianco a fianco sullo stesso set di dati di test. I compromessi tra accuratezza, latenza (P50/P99) ed efficienza dei token vengono visualizzati graficamente. Grazie a questi confronti, è facile identificare la configurazione che meglio soddisfa i requisiti, sia che si tratti di massimizzare l'accuratezza o di minimizzare costi e tempi di risposta.

Langfuse

Langfuse è una piattaforma di osservabilità LLM open-source progettata per il monitoraggio, il debug e la valutazione delle applicazioni di modelli linguistici. Disponibile sia come soluzione self-hosted che in cloud, Langfuse offre una tracciatura completa con acquisizione automatica di prompt, output, costi e latenza.

La piattaforma supporta qualsiasi framework LLM tramite il suo SDK flessibile e offre funzionalità di valutazione integrate, tra cui LLM-as-a-judge per la valutazione automatizzata della qualità. Langfuse tiene traccia delle versioni dei prompt tra le diverse esecuzioni, consentendo il confronto delle metriche di prestazione tra formulazioni diverse.

La raccolta di feedback degli utenti tramite valutazioni positive/negative aiuta a identificare output di alta e bassa qualità, mentre i punteggi personalizzati consentono di monitorare metriche specifiche dell'applicazione. Le valutazioni automatizzate possono elaborare migliaia di tracce a frequenze di campionamento configurabili, consentendo un monitoraggio continuo della qualità su larga scala senza la necessità di una revisione manuale di ogni singolo output.

Visualizzazione dettagliata del tracciato

Figura 10: Registri di traccia che mostrano i dettagli delle chiamate API con dati su prestazioni e costi.

Le singole tracce mostrano i dettagli completi dell'esecuzione per ogni chiamata LLM. La visualizzazione della traccia mostra le misurazioni esatte della latenza, il consumo di token (token di prompt e di completamento separatamente) e i costi calcolati per richiesta.

La configurazione del modello viene mantenuta, inclusi temperatura, max_tokens e altri parametri. La sezione Anteprima mostra l'intero prompt inviato al modello insieme alla risposta completa, consentendo di comprendere con precisione cosa il modello ha ricevuto e generato.

Questa visibilità granulare consente di eseguire il debug di guasti specifici esaminando la precisa coppia input-output che ha causato l'errore.

Tabella riassuntiva delle tracce

Figura 11: Ispezione della traccia individuale che mostra i dettagli della richiesta e la risposta del modello.

Tutte le tracce vengono aggregate in una tabella filtrabile che mostra output, livelli di osservazione, latenza, utilizzo dei token e costi totali. Ogni riga rappresenta una singola chiamata LLM con livelli di osservazione codificati a colori che indicano la gerarchia o l'importanza della traccia. Il conteggio dei token mostra sia i token di prompt che quelli di completamento, insieme ai totali, mentre i calcoli dei costi vengono calcolati automaticamente in base al modello utilizzato.

Il selettore di colonne consente di personalizzare le metriche visualizzate, mentre i filtri permettono di restringere le tracce in base all'ambiente, all'intervallo di tempo o ad altri criteri. Questa visualizzazione tabellare semplifica l'identificazione di modelli, come query costantemente lente o richieste inaspettatamente costose.

Braintrust

Braintrust è una piattaforma di osservabilità LLM che combina valutazione e monitoraggio della produzione. La piattaforma consente di testare i modelli su set di dati, confrontare diversi prompt o configurazioni e tracciare le metriche di qualità tramite punteggio automatizzato. Le funzioni di valutazione integrate e personalizzate misurano l'accuratezza, la pertinenza o criteri specifici del dominio, con risultati visualizzati in tabelle comparative che mostrano le differenze di prestazioni tra le versioni.

Per il monitoraggio della produzione, Braintrust traccia metriche in tempo reale, tra cui latenza, costi e punteggi di qualità personalizzati, man mano che il traffico attraversa le applicazioni. Gli avvisi vengono attivati quando vengono superate le soglie di qualità o violate le misure di sicurezza. Brainstore, il sistema di archiviazione dei log della piattaforma, acquisisce i log delle applicazioni su larga scala con una ricerca ottimizzata delle interazioni con l'IA. La dashboard visualizza metriche aggregate relative a esperimenti e cicli di produzione, acquisendo dati sui costi, sull'utilizzo dei token e sui metadati delle risposte sia per le richieste di valutazione che per quelle di produzione.

Elicone

Helicone è una piattaforma di osservabilità basata su proxy che monitora le applicazioni LLM instradando le richieste API attraverso il suo server proxy. L'integrazione richiede solo la modifica dell'URL di base, senza installazione di SDK o modifiche al codice. La piattaforma acquisisce automaticamente richieste, risposte, costi e utilizzo dei token per monitorare il comportamento dell'applicazione.

La dashboard visualizza il volume totale delle richieste, i costi aggregati e il consumo di token per tutte le chiamate API. I log delle richieste mostrano i prompt di input completi e gli output del modello, consentendo di analizzare previsioni o errori specifici. Il monitoraggio dei costi suddivide la spesa per tipo di modello, utente o tag personalizzati per identificare le operazioni dispendiose. La cache integrata rileva le richieste duplicate e fornisce risposte memorizzate nella cache, riducendo sia i costi API che i tempi di risposta. La limitazione della frequenza imposta dei limiti di utilizzo per utente o endpoint per prevenire picchi di spesa imprevisti.

La piattaforma si concentra sul monitoraggio delle singole chiamate API: ogni richiesta appare come una voce di registro separata, senza supporto integrato per raggruppare chiamate correlate o visualizzare sequenze. Questo rende Helicone pratico per applicazioni come chiamate LLM indipendenti (ad esempio, chatbot a turno singolo), generazione di contenuti in batch o attività di classificazione, ma meno adatto al monitoraggio di flussi di lavoro a più fasi in cui è importante comprendere le relazioni tra chiamate sequenziali.

Che cos'è l'osservabilità LLM?

L'osservabilità dei modelli linguistici di grandi dimensioni (LLM) è la pratica di raccogliere e interpretare dati continui provenienti da tali modelli per comprenderne il comportamento durante l'utilizzo nel mondo reale. Si concentra sulla raccolta di metriche, tracce e log che mostrano come gli LLM rispondono a diversi prompt, strumenti e chiamate API esterne.

Poiché i modelli linguistici operano tramite ragionamento probabilistico, i loro processi interni non possono essere ispezionati direttamente. Ciò rende il monitoraggio dei modelli linguistici dipendente dall'analisi degli output e degli input dei modelli, nonché delle fasi intermedie che si verificano nei flussi di lavoro degli agenti . Studiando queste tracce, gli sviluppatori di modelli linguistici acquisiscono visibilità sulle prestazioni del sistema, sul comportamento del modello e sui modelli di utilizzo che influenzano le prestazioni dell'applicazione e la qualità dell'output.

L'osservabilità dei modelli lineari a grande scala (LLM) è fondamentale per diverse ragioni:

- Controllo qualità: i modelli linguistici complessi possono produrre risultati errati o di bassa qualità per una vasta gamma di motivi, tra cui prompt poco chiari, dati non coerenti o comportamenti inattesi degli utenti. Il monitoraggio dei prompt e delle risposte nel tempo aiuta a tenere traccia di parametri di valutazione come correttezza, coerenza, pertinenza e veridicità. Ciò consente ai team di individuare quando la qualità delle risposte dei modelli linguistici complessi inizia a diminuire o quando il modello inizia a generare risultati inaccurati . Con l'espansione dell'utilizzo dei modelli linguistici complessi nei flussi di lavoro aziendali, garantire un'accuratezza costante diventa una sfida comune.

- Risoluzione dei problemi: quando si verificano problemi all'interno delle applicazioni LLM, le cause principali possono derivare da molteplici fattori. Ad esempio, prompt configurati in modo errato, impostazioni di precisione non corrette, chiamate API esterne non riuscite o errori di logica all'interno di flussi di lavoro degli agenti a più fasi. Raccogliendo le tracce LLM che mostrano i passaggi intermedi, gli sviluppatori possono eseguire un'analisi delle cause principali in modo efficiente e individuare con precisione la fase in cui il comportamento si è discostato. Ciò riduce la necessità di intervento umano e abbrevia i tempi di individuazione degli errori.

- Ottimizzazione: il monitoraggio delle prestazioni del sistema, dell'utilizzo delle risorse e dei token aiuta le organizzazioni a identificare i colli di bottiglia e a migliorare le prestazioni dei sistemi LLM. I team possono misurare la latenza, il throughput, l'utilizzo della memoria e i tassi di errore per comprendere il comportamento dei sistemi LLM in presenza di diversi livelli di carico. Possono inoltre monitorare i token per controllare i costi e analizzare i modelli di utilizzo al fine di migliorare le prestazioni e l'efficienza dei costi . Il monitoraggio continuo di queste metriche chiave è particolarmente prezioso nei flussi di lavoro di generazione aumentata dal recupero e negli agenti, dove i colli di bottiglia delle prestazioni spesso derivano da chiamate di strumenti inefficienti o da round-trip non necessari durante il ragionamento.

categorie metriche principali

Gli strumenti di osservabilità LLM in genere raggruppano le metriche rilevanti in tre categorie che supportano sia i team di sviluppo software che i team operativi.

metriche di prestazione del sistema

- Latenza: misura il tempo che intercorre tra la ricezione di una richiesta e l'invio di una risposta.

- Throughput: indica quante richieste il modello può elaborare in un determinato periodo.

- Tassi di errore: indicano la frequenza con cui il sistema restituisce risposte non valide o errate.

Metriche di utilizzo delle risorse

- Consumo di CPU e GPU: Aiuta a capire con quale efficienza il sistema utilizza l'hardware.

- Utilizzo della memoria: influisce sulle decisioni di dimensionamento e sulla pianificazione della capacità.

- Utilizzo dei token: influisce sull'efficienza dei costi e aiuta i team a controllare le spese durante un utilizzo intensivo di LLM.

- Compromesso tra throughput e latenza: mostra come il sistema bilancia velocità e volume di elaborazione.

Metriche del comportamento del modello

- Correttezza, veridicità e qualità della risposta: per identificare i risultati di bassa qualità.

- Coinvolgimento e feedback degli utenti: forniscono informazioni su quanto bene il modello soddisfi le esigenze degli utenti.

- Indicatori di fedeltà e fondatezza: Riflettono quanto il modello aderisca al materiale di origine.

Osservabilità manuale vs. osservabilità autonoma

Affidarsi all'osservazione manuale presenta diverse difficoltà. I modelli linguistici di grandi dimensioni generano elevati volumi di dati e le catene di ragionamento a più fasi producono numerosi log e tracce. La necessità di un monitoraggio in tempo reale aumenta la complessità operativa e persino i team più esperti faticano a esaminare ogni chiamata LLM senza perdere segnali essenziali. I flussi di lavoro manuali rendono inoltre difficile stare al passo con i continui cambiamenti nel comportamento degli utenti e con le variazioni dei prompt.

I sistemi di osservabilità autonomi affrontano queste sfide utilizzando agenti software che analizzano continuamente l'attività dei dispositivi di monitoraggio a lungo termine (LLM). Questi agenti rilevano anomalie, diagnosticano problemi ed eseguono analisi delle cause profonde senza un costante intervento umano. Le valutazioni automatizzate aiutano anche a identificare comportamenti a rischio, come l'iniezione immediata.

Un sistema di questo tipo supporta il monitoraggio continuo e garantisce un tracciamento coerente delle metriche di valutazione nell'intero modello. Di conseguenza, le organizzazioni beneficiano di una risoluzione dei problemi più rapida, di prestazioni applicative migliorate e di un maggiore controllo sui rischi operativi.

Caratteristiche degli strumenti di osservabilità LLM

Valutazioni di qualità e sicurezza

- Rilevamento delle allucinazioni per identificare quando il modello si discosta da dati affidabili.

- Iniezione rapida e rilevamento del jailbreak per affrontare i problemi di sicurezza.

- Valutazione della tossicità e della sicurezza a supporto della conformità e della riduzione del rischio.

- Clustering che raggruppa output LLM simili per identificare le variazioni nel tempo.

Caratteristiche sperimentali

- Test A/B per una gestione rapida e modifiche di configurazione.

- Confronto rapido tra più modelli LLM oparametri .

- Valutazione dell'accuratezza, del consumo di token e della latenza prima dell'implementazione.

- Testare le modifiche al modello confrontandole con scenari reali utilizzando dati simili a quelli di produzione.

Correlazione con le infrastrutture

- Collegamento delle tracce LLM ai dati di monitoraggio delle prestazioni delle applicazioni back-end.

- Collegamento tra tempo di risposta e qualità della risposta a sessioni utente reali.

- Identificare in che modo le prestazioni del sistema influenzano le prestazioni di LLM e la stabilità dell'applicazione.

LLMOps e governance

- Sistemi di protezione che filtrano i messaggi non sicuri e bloccano le risposte dannose.

- Dashboard per il monitoraggio dell'esposizione a dati personali, allucinazioni e violazioni delle norme di sicurezza.

- Strumenti a supporto della conformità, della segnalazione e dell'analisi degli incidenti di sicurezza.

Osservabilità per flussi di lavoro basati su agenti

Poiché i modelli LLM alimentano flussi di lavoro multi-step basati su agenti, i requisiti di osservabilità si estendono oltre le singole coppie richiesta-risposta. Le applicazioni agentiche introducono ulteriori livelli di complessità che richiedono approcci di tracciamento dedicati.

Principali dimensioni di osservabilità per gli agenti:

- Tracce di pianificazione e ragionamento: visibilità su come l'agente scompone i compiti, seleziona le azioni e affina il suo approccio in base ai risultati intermedi

- Monitoraggio delle chiamate agli strumenti: tracciamento delle chiamate API esterne, delle query di database e delle esecuzioni di funzioni per identificare colli di bottiglia o errori dovuti alla latenza.

- Tracciamento del passaggio di consegne: per i sistemi multi-agente, monitoraggio di come i compiti vengono trasferiti tra gli agenti e se il contesto viene preservato correttamente.

- Evoluzione dello stato: comprendere come la memoria e il contesto cambiano nel corso di più turni all'interno di una sessione

Nel loro insieme, queste dimensioni costituiscono il fondamento del monitoraggio agentico . Gli strumenti di osservabilità LLM come Langsmith, Langfuse, AgentOps e Weights & Biases forniscono viste di tracciamento specifiche per ciascun agente, che mostrano grafici di esecuzione completi.

FAQ

Una buona soluzione di osservabilità consente un'osservabilità completa lungo l'intero ciclo di vita delle chiamate LLM. Ciò include il modo in cui un modello riceve una richiesta, seleziona gli strumenti, recupera i dati da una sorgente dati e genera una risposta finale. L'osservabilità è importante perché le applicazioni LLM continuano a diventare sempre più complesse e il numero di app basate su LLM che si affidano al ragionamento a più fasi aumenta vertiginosamente. Di conseguenza, le organizzazioni necessitano di strumenti di osservabilità che forniscano monitoraggio in tempo reale e valutazione automatizzata per garantire prestazioni coerenti su tutte le app LLM.

I moderni strumenti di osservabilità LLM mirano a fornire una panoramica dettagliata di ogni azione all'interno delle applicazioni basate su LLM. Ciò include il tracciamento di ogni chiamata LLM, di ogni interazione con gli strumenti e di ogni passaggio intermedio che compare in una catena di ragionamento agentico. La capacità di osservare l'intero flusso di lavoro, dalla richiesta alla risposta finale, aiuta i team a rilevare comportamenti inattesi e a comprendere come i modelli LLM prendono decisioni.

Anche l'analisi dei costi e dei token è diventata essenziale. Il monitoraggio in tempo reale dell'utilizzo dei token aiuta le organizzazioni a mantenere l'efficienza dei costi ed evitare picchi di spesa imprevisti. I team possono analizzare l'utilizzo dei token per fornitore, modello, funzionalità o percorso applicativo per comprendere come i diversi componenti contribuiscono ai costi. Alcuni strumenti di osservabilità consentono agli utenti di confrontare più fornitori di LLM affiancati, facilitando le decisioni in termini di prestazioni ed efficienza dei costi quando si instradano le richieste tra LLM open source e opzioni proprietarie.

Nell'intero ecosistema, gli strumenti di osservabilità considerano costantemente l'osservabilità dei modelli di apprendimento basati su logica (LLM) come un requisito fondamentale per il funzionamento su larga scala delle applicazioni LLM. I team che si affidano a flussi di lavoro basati su agenti necessitano di visibilità su come il modello si muove attraverso processi di ragionamento a più fasi e su come ogni decisione influisce sulle prestazioni del modello. L'osservabilità contribuisce a garantire risposte coerenti e di alta qualità, a rilevare tempestivamente i guasti e a mantenere la fiducia degli utenti.

Un altro tema importante è la necessità di gestire i costi operativi. Il monitoraggio dell'utilizzo dei token, della memoria e delle metriche di utilizzo delle risorse aiuta le organizzazioni a controllare la spesa, mantenendo al contempo prestazioni ed efficienza dei costi. L'osservabilità rivela inoltre i colli di bottiglia delle prestazioni che influenzano la soddisfazione degli utenti e le prestazioni dell'applicazione.

Infine, l'osservabilità dei modelli LLM è importante perché le organizzazioni si affidano sempre più a questi modelli per funzioni critiche. Con l'espansione di questi sistemi, gli strumenti di monitoraggio devono essere indipendenti dal framework, in grado di integrarsi con piattaforme open source e capaci di fornire informazioni su più servizi. Ciò favorisce un'implementazione sicura, riduce i problemi di sicurezza e aiuta i team a comprendere gli output del modello in un contesto operativo più ampio.

Sii il primo a commentare

Il tuo indirizzo email non verrà pubblicato. Tutti i campi sono obbligatori.