Le aziende generano grandi volumi di dati vocali da chiamate, riunioni e interfacce vocali, ma l'elaborazione manuale di questi dati è lenta e difficile da scalare.

Il riconoscimento vocale (detto anche riconoscimento vocale automatico o da parlato a testo) converte il linguaggio parlato in testo, consentendo ai sistemi di analizzare e automatizzare flussi di lavoro basati sulla voce, come la trascrizione delle chiamate, gli assistenti vocali e i riepiloghi delle riunioni.

Esplorazione del funzionamento del riconoscimento vocale, degli algoritmi coinvolti, delle sue applicazioni in vari settori ed esempi concreti.

12 casi d'uso del riconoscimento vocale

Il riconoscimento vocale viene utilizzato in molti settori per convertire il linguaggio parlato in testo e consentire interazioni vocali con i sistemi. Gli esempi seguenti mostrano casi d'uso comuni del riconoscimento vocale in settori quali il servizio clienti, le vendite, l'industria automobilistica, la sanità e la tecnologia.

Assistenza clienti

- Sistemi di risposta vocale interattiva (IVR): i sistemi IVR instradano automaticamente i chiamanti al reparto appropriato riconoscendo le richieste vocali. Riducono il volume delle chiamate e i tempi di attesa gestendo le richieste semplici tramite risposte preregistrate o sistemi di sintesi vocale . Il riconoscimento vocale automatico (ASR) consente ai sistemi IVR di comprendere e rispondere alle richieste dei clienti in tempo reale.

- Automazione dell'assistenza clienti e chatbot: il riconoscimento vocale consente ai chatbot e agli assistenti virtuali basati sulla voce di gestire le richieste di routine del servizio clienti, come rispondere alle domande frequenti, fornire indicazioni per la risoluzione dei problemi e assistere con le richieste relative all'account.

- Analisi del sentiment e monitoraggio delle chiamate: l'analisi del sentiment classifica le conversazioni come positive, negative o neutre, aiutando le organizzazioni a monitorare la qualità del servizio e a identificare le problematiche dei clienti.

- Supporto multilingue: i modelli di riconoscimento vocale possono essere addestrati a riconoscere più lingue. Integrati in chatbot o sistemi IVR, possono rilevare la lingua dell'utente e passare al modello appropriato, aiutando le organizzazioni a servire i clienti internazionali (vedi Figura 1).

- Autenticazione del cliente tramite biometria vocale: la biometria vocale utilizza tecnologie di riconoscimento vocale per analizzare la voce di chi parla ed estrarre caratteristiche come l'accento e la velocità di risposta al fine di verificarne l'identità.

Figura 1: Immagine che mostra come un chatbot multilingue riconosce le parole in un'altra lingua.

Vendite e marketing

- Assistenti virtuali alle vendite: gli assistenti virtuali basati sull'intelligenza artificiale interagiscono con i clienti tramite comandi vocali e li aiutano a prendere decisioni di acquisto. Il riconoscimento vocale consente a questi sistemi di comprendere le richieste verbali e di rispondere in base alle intenzioni del cliente.

- Servizi di trascrizione: il riconoscimento vocale converte le registrazioni di chiamate di vendita e riunioni in trascrizioni scritte, facilitando la documentazione e l'analisi.

Automobilistico

- Comandi vocali: i comandi vocali consentono agli utenti di interagire con dispositivi e applicazioni tramite comandi vocali. I conducenti possono gestire funzioni come il controllo del climatizzatore, le chiamate telefoniche o i sistemi di navigazione.

- Navigazione a comando vocale: La navigazione a comando vocale fornisce indicazioni vocali in tempo reale, utilizzando i comandi vocali del conducente per specificare la destinazione. I conducenti possono richiedere aggiornamenti sul traffico in tempo reale o cercare punti di interesse nelle vicinanze tramite comandi vocali, senza bisogno di utilizzare comandi fisici.

Assistenza sanitaria

- Trascrizione medica: La trascrizione medica, nota anche come MT (Medical Trascription), è il processo di conversione di referti medici registrati vocalmente in un documento di testo scritto. Di seguito sono riportate le fasi principali del processo di trascrizione medica:

- Trascrivere la dettatura del medico.

- Trascrizione del parlato in testo tramite sistemi di riconoscimento vocale (alcuni sistemi includono anche la diarizzazione del parlante per distinguere tra i diversi interlocutori).

- Revisionare il testo trascritto per una maggiore accuratezza e correggere gli errori, se necessario.

- Formattazione del documento in conformità ai requisiti legali e medici.

- Assistenti medici virtuali: Gli assistenti medici virtuali (VMA) utilizzano il riconoscimento vocale, l'elaborazione del linguaggio naturale e gli algoritmi di apprendimento automatico per comunicare con i pazienti tramite voce o testo. Il software di riconoscimento vocale consente ai VMA di rispondere ai comandi vocali, recuperare informazioni dalle cartelle cliniche elettroniche (EHR) e automatizzare il processo di trascrizione medica.

- Integrazione con le cartelle cliniche elettroniche (EHR): gli operatori sanitari possono utilizzare i comandi vocali per navigare nel sistema EHR, accedere ai dati dei pazienti e inserire dati in campi specifici.

Esempi concreti di riconoscimento vocale

Discorso Azure

Azure Speech è un servizio di intelligenza artificiale basato sul cloud di Microsoft (parte degli strumenti Azure AI Foundry) che consente alle applicazioni di elaborare e generare il linguaggio parlato. Offre funzionalità quali:

Riconoscimento vocale automatico (Speech-to-text) : converte l'audio parlato in testo scritto, supportando diverse modalità di trascrizione.

- Trascrizione in tempo reale per l'audio in streaming

- Trascrizione rapida di file registrati

- Trascrizione in batch per grandi volumi di audio

Gli sviluppatori possono anche creare modelli vocali personalizzati per migliorare la precisione del riconoscimento per vocabolario specifico di un dominio o in ambienti rumorosi.

Sintesi vocale (Text-to-Speech) : Trasforma il testo scritto in audio dal suono naturale utilizzando voci neurali. Gli sviluppatori possono controllare le caratteristiche della voce come tono, velocità e pronuncia utilizzando il linguaggio SSML (Speech Synthesis Markup Language).

Azure Speech supporta anche voci neurali personalizzate , consentendo alle organizzazioni di creare una voce unica per le proprie applicazioni.

Traduzione vocale : offre la traduzione vocale multilingue in tempo reale, consentendo la traduzione da parlato a parlato o da parlato a testo in diverse lingue.

Modelli vocali personalizzati : gli sviluppatori possono addestrare modelli personalizzati con i propri dati per migliorare il riconoscimento di:

- Terminologia specifica del settore

- Accenti e stili di parlato

- Condizioni audio rumorose

Avatar vocali e IA conversazionale : Azure Speech è in grado di generare avatar parlanti sintetici e di abilitare interazioni vocali in tempo reale, supportando sistemi di IA conversazionale e agenti vocali.

Figura 2: Un esempio tratto dall'agente AI di Azure Voice, Voice Live. 1

Deepgram

Deepgram fornisce API per l'integrazione di funzionalità vocali, come la trascrizione da parlato a testo, la sintesi da testo a parlato e l'intelligenza vocale. 2

- Trascrizione da parlato a testo: converte l'audio in testo sia per lo streaming in tempo reale che per l'audio preregistrato.

- Sintesi vocale: genera un parlato dal suono naturale a partire da un testo, per interfacce e assistenti vocali.

- Diarizzazione dei parlanti: identifica e separa i diversi parlanti in una registrazione audio.

- Rilevamento di parole chiave e analisi audio: individua parole o frasi specifiche ed estrae informazioni utili dai dati audio.

- Modelli vocali personalizzati: consentono alle organizzazioni di migliorare la precisione del riconoscimento utilizzando dati specifici del settore.

I casi d'uso di Deepgram includono:

- Assistenza clienti: trascrizione e analisi delle conversazioni del call center per monitorare la qualità del servizio ed estrarre informazioni utili.

- Media e trasmissioni: generazione di sottotitoli e trascrizioni per podcast, interviste e live streaming.

- Settore sanitario e legale : Conversione di dettati e conversazioni orali in documentazione scritta.

- Analisi aziendale: estrazione di parole chiave, sentiment e informazioni utili da grandi volumi di dati audio.

AssemblyAI

AssemblyAI viene utilizzato nell'analisi dei call center , dove le chiamate di assistenza clienti vengono trascritte e analizzate per il monitoraggio della qualità e per ottenere informazioni utili; nella trascrizione delle riunioni , che genera trascrizioni e riepiloghi di riunioni virtuali; e nella trascrizione multimediale , che consente di aggiungere sottotitoli, trascrizioni e contenuti audio o video ricercabili.

Viene inoltre utilizzato per la moderazione dei contenuti , al fine di rilevare discorsi inappropriati o soggetti a restrizioni nei flussi audio, e per l'analisi dei dati vocali, estraendo informazioni quali argomenti, entità e sentiment da grandi volumi di conversazioni registrate. 3

- Trascrizione da parlato a testo: converte flussi o file audio in testo con timestamp, punteggi di affidabilità e altri metadati.

- Trascrizione in streaming in tempo reale: elabora l'audio in diretta con bassa latenza per assistenti vocali e applicazioni in tempo reale.

- Intelligenza audio: estrae informazioni utili dal parlato, tra cui la diarizzazione dell'oratore, l'analisi del sentiment , il rilevamento degli argomenti e il riconoscimento delle entità.

- Riassunto e comprensione del parlato: genera riassunti e output strutturati a partire dalle trascrizioni per supportare i flussi di lavoro successivi.

- Moderazione dei contenuti e oscuramento dei dati personali: identifica o rimuove contenuti sensibili o inappropriati dai file audio.

- Funzionalità multilingue e di rilevamento della lingua: supporta la trascrizione in diverse lingue e con vari accenti.

Google Cloud Speech-to-Text

Google Cloud Speech-to-Text consente agli sviluppatori di integrare l'API per trascrivere file audio, elaborare flussi vocali in tempo reale e creare funzionalità vocali come comandi o ricerche. 4

- Trascrizione in tempo reale e in batch: trascrive sia audio in streaming che file preregistrati.

- Supporto multilingue: riconosce il parlato in oltre 100 lingue e varianti.

- Modelli avanzati di IA vocale: utilizza i modelli vocali di Google (ad esempio, Chirp 3) addestrati su grandi set di dati audio per una maggiore precisione.

- Chirp 3 è l'ultimo modello di intelligenza artificiale vocale di Google per il riconoscimento automatico del parlato (ASR). Si tratta di un modello generativo multilingue progettato per convertire l'audio parlato in testo con maggiore precisione e velocità. Il modello migliora la qualità della trascrizione e supporta funzionalità come la diarizzazione del parlante (identificazione di diversi parlanti), il rilevamento automatico della lingua e il riconoscimento vocale multilingue.

- Punteggiatura automatica e riconoscimento vocale: aggiunge la punteggiatura alle trascrizioni e distingue i diversi interlocutori nelle registrazioni.

Che cos'è il riconoscimento vocale?

Il riconoscimento vocale, noto anche come riconoscimento vocale automatico (ASR), conversione da parlato a testo (STT) e riconoscimento vocale computerizzato, è una tecnologia che consente a un computer di riconoscere e convertire il linguaggio parlato in testo.

La tecnologia di riconoscimento vocale utilizza l'intelligenza artificiale e modelli di apprendimento automatico per identificare e trascrivere con precisione diversi accenti, dialetti e modelli di parlato.

Riconoscimento vocale vs riconoscimento del parlato

Il riconoscimento vocale viene spesso confuso con il riconoscimento della voce , tuttavia si riferiscono a concetti distinti. Il riconoscimento vocale converte le parole pronunciate in testo scritto, concentrandosi sull'identificazione delle parole e delle frasi pronunciate da un utente, indipendentemente dall'identità di chi parla.

D'altro canto, il riconoscimento vocale si occupa di riconoscere o verificare la voce di chi parla, con l'obiettivo di determinare l'identità di un interlocutore sconosciuto piuttosto che concentrarsi sulla comprensione del contenuto del discorso.

Quali sono le caratteristiche dei sistemi di riconoscimento vocale?

I sistemi di riconoscimento vocale sono composti da diversi elementi che lavorano insieme per comprendere ed elaborare il linguaggio umano. Le caratteristiche principali di un efficace sistema di riconoscimento vocale sono:

Preelaborazione audio

Dopo aver acquisito il segnale audio grezzo da un dispositivo di input, è necessario preelaborarlo per migliorarne la qualità vocale. L'obiettivo principale della preelaborazione audio è quello di catturare i dati vocali rilevanti, rimuovendo eventuali artefatti indesiderati e riducendo il rumore.

estrazione di acciaio

Questa fase converte il segnale audio pre-elaborato in una rappresentazione più informativa. Ciò rende i dati audio grezzi più gestibili per i modelli di apprendimento automatico nei sistemi di riconoscimento vocale.

Ponderazione del modello linguistico

La ponderazione linguistica attribuisce maggiore importanza a determinate parole e frasi, come ad esempio i riferimenti ai prodotti, nei segnali audio e vocali. Questo aumenta la probabilità che tali parole chiave vengano riconosciute dai sistemi di riconoscimento vocale in un discorso successivo.

Modellazione acustica

Consente ai sistemi di riconoscimento vocale di catturare e distinguere le unità fonetiche all'interno di un segnale vocale. I modelli acustici vengono addestrati su grandi insiemi di dati contenenti campioni vocali provenienti da un insieme eterogeneo di parlanti con accenti, stili di parlato e background diversi.

Etichettatura degli altoparlanti

Consente alle applicazioni di riconoscimento vocale di determinare l'identità di più interlocutori in una registrazione audio. Assegna etichette univoche a ciascun interlocutore in una registrazione audio, permettendo di identificare chi stava parlando in un dato momento.

Filtro delle parolacce

Il processo di rimozione di parole o frasi offensive, inappropriate o esplicite dai dati audio.

Quali sono i diversi algoritmi di riconoscimento vocale?

Il riconoscimento vocale utilizza diversi algoritmi e tecniche computazionali per convertire il linguaggio parlato in linguaggio scritto. Di seguito sono elencati alcuni dei metodi di riconoscimento vocale più comunemente utilizzati:

Modelli di Markov nascosti (HMM)

Il modello di Markov nascosto (HMM) è un modello statistico di Markov comunemente utilizzato nei sistemi tradizionali di riconoscimento vocale. Gli HMM catturano la relazione tra le caratteristiche acustiche e modellano la dinamica temporale dei segnali vocali.

Elaborazione del linguaggio naturale (NLP)

L'elaborazione del linguaggio naturale (NLP) è un sottocampo dell'intelligenza artificiale che si concentra sull'interazione tra esseri umani e macchine attraverso il linguaggio naturale. Alcuni dei ruoli chiave dell'NLP nei sistemi di riconoscimento vocale sono:

- Stimare la probabilità delle sequenze di parole nel testo riconosciuto

- Convertire espressioni colloquiali e abbreviazioni di una lingua parlata in una forma scritta standard

- Mappare le unità fonetiche ottenute dai modelli acustici alle parole corrispondenti nella lingua di destinazione.

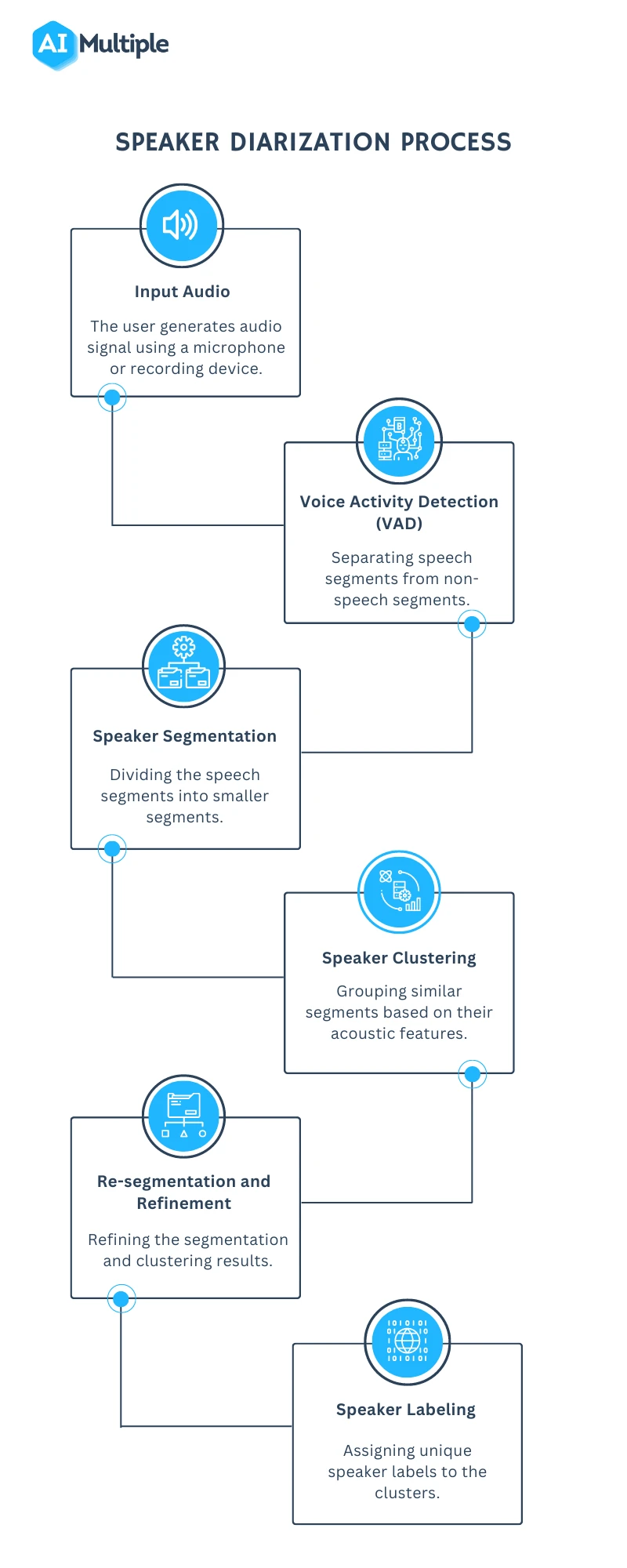

Diarizzazione del parlato (SD)

La diarizzazione del parlante, o etichettatura del parlante, è il processo di identificazione e attribuzione dei segmenti di parlato ai rispettivi parlanti (Figura 1). Consente il riconoscimento vocale specifico del parlante e l'identificazione degli individui in una conversazione.

Figura 3: Diagramma di flusso che illustra il processo di diarizzazione dei parlanti.

Dynamic Time Warping (DTW)

Gli algoritmi di riconoscimento vocale utilizzano l'algoritmo Dynamic Time Warping (DTW) per trovare un allineamento ottimale tra due sequenze (Figura 4).

Figura 4: Un sistema di riconoscimento vocale che utilizza la distorsione temporale dinamica per determinare la distanza ottimale tra gli elementi. 5

Reti neurali profonde

Le reti neurali elaborano e trasformano i dati in ingresso simulando la percezione non lineare della frequenza del sistema uditivo umano.

Classificazione temporale connessionista (CTC)

Si tratta di un obiettivo di addestramento introdotto da Alex Graves nel 2006. Il CTC è particolarmente utile per le attività di etichettatura di sequenze e per i sistemi di riconoscimento vocale end-to-end. Permette alla rete neurale di scoprire la relazione tra i frame di input e di allinearli alle etichette di output.

Quali sono le sfide del riconoscimento vocale?

Sebbene la tecnologia di riconoscimento vocale offra molti vantaggi, deve ancora affrontare diverse sfide. Alcuni dei principali limiti del riconoscimento vocale includono:

Sfide acustiche

Accenti e dialetti

Gli accenti e i dialetti differiscono nella pronuncia, nel vocabolario e nella grammatica, rendendo difficile per le applicazioni di riconoscimento vocale riconoscere il parlato con precisione.

Supponiamo che un modello di riconoscimento vocale sia stato addestrato principalmente su accenti di inglese americano. Se un oratore con un forte accento scozzese utilizza il sistema, potrebbe incontrare difficoltà a causa delle differenze di pronuncia. Ad esempio, la parola "water" (acqua) viene pronunciata in modo diverso nei due accenti. Se il sistema non ha familiarità con questa pronuncia, potrebbe avere difficoltà a riconoscere la parola "water".

Soluzione: Affrontare queste sfide è fondamentale per migliorare la precisione delle applicazioni di riconoscimento vocale. Per superare le variazioni di pronuncia, è essenziale ampliare i dati di addestramento includendo campioni di parlanti con accenti diversi. Questo approccio aiuta il sistema a riconoscere e comprendere una gamma più ampia di modelli di parlato.

rumore di fondo

Il rumore di fondo (ad esempio, traffico, conversazioni sovrapposte) rende difficile distinguere il parlato dal rumore di fondo per le applicazioni di riconoscimento vocale (vedere Figura 5).

Soluzione: Le tecniche di pre-elaborazione possono essere utilizzate per ridurre il rumore di fondo nel riconoscimento vocale, contribuendo così a migliorare le prestazioni dei modelli di riconoscimento vocale in ambienti rumorosi.

Ad esempio, è possibile utilizzare tecniche di data augmentation per ridurre l'impatto del rumore sui dati audio. La data augmentation aiuta ad addestrare modelli di riconoscimento vocale con dati rumorosi per migliorare la precisione del modello in ambienti reali.

Figura 5: Esempi di una frase target ("Il clown aveva una faccia buffa") nel rumore di fondo di chiacchiere, auto e pioggia. 6

Sfide linguistiche

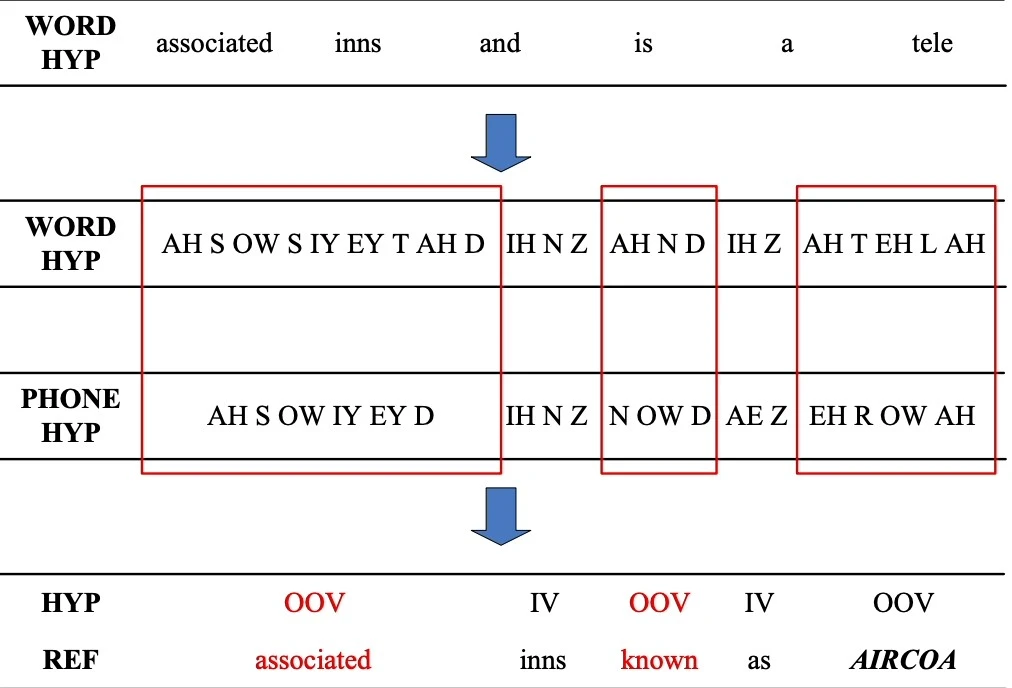

Parole fuori dal vocabolario

Poiché il modello di riconoscimento vocale non è stato addestrato su parole fuori vocabolario, potrebbe identificarle erroneamente come diverse o non riuscire a trascriverle quando le incontra.

Figura 6: Un esempio di rilevamento di una parola fuori vocabolario.

Soluzione: Il tasso di errore di parola (WER, Word Error Rate) è una metrica comune utilizzata per misurare l'accuratezza di un sistema di riconoscimento vocale o di traduzione automatica. Il tasso di errore di parola può essere calcolato come:

Figura 7: Dimostrazione di come calcolare il tasso di errore di parola (WER). 7

Omofoni

Gli omofoni sono parole che si pronunciano allo stesso modo ma hanno significati diversi, come ad esempio "to", "too" e "two".

Soluzione: L'analisi semantica consente ai programmi di riconoscimento vocale di selezionare l'omofono appropriato in base al suo significato in un dato contesto. Gestire gli omofoni migliora la capacità del processo di riconoscimento vocale di comprendere e trascrivere accuratamente le parole pronunciate.

Sfide tecniche/di sistema

Privacy e sicurezza dei dati

I sistemi di riconoscimento vocale implicano l'elaborazione e la memorizzazione di informazioni sensibili e personali, come ad esempio i dati finanziari. Una parte non autorizzata potrebbe utilizzare le informazioni acquisite, causando violazioni della privacy.

Soluzione: È possibile crittografare le informazioni audio sensibili e personali trasmesse tra il dispositivo dell'utente e il software di riconoscimento vocale. Un'altra tecnica per affrontare la privacy e la sicurezza dei dati nei sistemi di riconoscimento vocale è la mascheratura dei dati. Gli algoritmi di mascheratura dei dati mascherano e sostituiscono i dati vocali sensibili con dati strutturalmente identici ma acusticamente diversi.

Figura 8: Un esempio di come funziona la mascheratura dei dati.

Dati di addestramento limitati

La scarsità di dati di addestramento influisce direttamente sulle prestazioni del software di riconoscimento vocale. Con dati di addestramento insufficienti, il modello di riconoscimento vocale potrebbe avere difficoltà a generalizzare accenti diversi o a riconoscere parole meno comuni.

Soluzione: Per migliorare la qualità e la quantità dei dati di addestramento, è possibile espandere il set di dati esistente utilizzando tecnologie di aumento dei dati e di generazione di dati sintetici.

Sii il primo a commentare

Il tuo indirizzo email non verrà pubblicato. Tutti i campi sono obbligatori.