O ChatGPT alcançou 900 milhões de usuários ativos semanais e processou aproximadamente 2,5 bilhões de solicitações por dia. 1

Descubra o futuro dos grandes modelos de linguagem explorando abordagens promissoras, como autoaprendizagem, verificação de fatos e conhecimento especializado esparso, que podem solucionar as limitações dos LLM (Modelos de Linguagem de Grande Porte).

Tendências futuras de grandes modelos de linguagem

1- Verificação de fatos em tempo real com dados ao vivo

Agora, os modelos de aprendizagem de linguagem (LLMs) acessam fontes externas durante as conversas, em vez de dependerem apenas de dados de treinamento. O modelo consulta bancos de dados externos, recupera informações atualizadas e fornece citações.

Limitação: Ainda apresenta erros. As citações não garantem a precisão; os modelos às vezes citam fontes incorretamente ou interpretam mal o conteúdo citado.

- Microsoft Copiloto: Integra GPT-5.2 com dados da internet em tempo real. Responde a perguntas com base em eventos atuais, fornecendo links para as fontes.

- ChatGPT: Pesquisa na internet quando questionado sobre eventos recentes. Cita as fontes em suas respostas.

- Perplexity: Construído especificamente para buscas citadas. Cada resposta inclui links para as fontes.

2- Dados de treinamento sintéticos

Os modelos geram seus próprios conjuntos de dados de treinamento em vez de exigirem dados rotulados por humanos.

Modelo de autoaperfeiçoamento de Google (pesquisa de 2023):

- O modelo cria perguntas

- Seleciona respostas

- Ajusta-se automaticamente aos dados gerados.

- Melhoria no desempenho: de 74,2% para 82,1% nos problemas de matemática do GSM8K e de 78,2% para 83,0% na compreensão de leitura do DROP.

Figura: Visão geral do modelo de autoaperfeiçoamento de Google

Fonte : “Grandes modelos de linguagem podem se autoaprimorar”

Os conjuntos de dados OpenAI, Anthropic e Google utilizam dados sintéticos para complementar conjuntos de dados rotulados por humanos. Isso reduz os custos de rotulagem de dados, mas introduz novos riscos de viés; os modelos podem amplificar seus próprios erros.

3- Modelos de especialistas esparsos (Mistura de especialistas)

Em vez de ativar toda a rede neural para cada entrada, apenas um subconjunto relevante de parâmetros é ativado, dependendo da tarefa. O modelo direciona a entrada para "especialistas" especializados dentro da rede. Somente os especialistas ativados processam a consulta.

Exemplos da vida real

- Llama 4 Scout: 109 bilhões de parâmetros totais, 17 bilhões ativos por token. A arquitetura Mixture of Experts (MoE) oferece uma janela de contexto de 10 milhões de tokens em uma única GPU H100. 2

- Mistral Devstral 2: Desenvolvido especificamente para tarefas de engenharia de software. 123 bilhões de parâmetros, janela de contexto de 256 mil tokens. Alcança 72,2% no SWE-bench Verified, estabelecendo-se como o principal modelo de codificação open-weight. Uma variante menor, Devstral Small 2 (24 bilhões de parâmetros), roda localmente em hardware de consumo sob a licença Apache 2.0. 3

- DeepSeek V3.2: 671 bilhões de parâmetros totais, 37 bilhões ativados por token usando MoE. Introduz DeepSeek Atenção Esparsa (DSA) para inferência de contexto longo mais rápida e custo computacional reduzido. Suporta Pensamento no Uso de Ferramentas, permitindo que o modelo raciocine dentro de fluxos de trabalho agentes enquanto chama ferramentas externas. 4

4- Integração de fluxo de trabalho empresarial

Os LLMs são incorporados diretamente aos processos de negócios, em vez de serem usados como ferramentas independentes.

Exemplos da vida real

- Salesforce Agentforce (anteriormente Einstein Copilot): Integra LLMs às operações de CRM. Responde a consultas de clientes, gera conteúdo e executa ações no Salesforce, com base nos dados e metadados de CRM da organização por meio da camada de confiança do Einstein. 5

- Microsoft 365 Copilot: Integrado ao Word, Excel, PowerPoint e Outlook. Cria rascunhos de documentos, analisa planilhas, gera apresentações e resume conversas por e-mail, utilizando dados da empresa por meio do Microsoft Graph para contextualizar as respostas dentro da organização. 6

- Anthropic Claude para Empresas: A separação de memória baseada em projetos mantém os contextos de trabalho distintos entre as equipes. O Claude Opus 4.6 introduziu equipes de agentes, permitindo que vários agentes Claude dividam tarefas maiores em fluxos de trabalho paralelos, cada um responsável por um segmento e coordenando-se com os outros simultaneamente. A mesma versão integrou o Claude diretamente ao PowerPoint como um painel lateral nativo (prévia para pesquisa), permitindo que as apresentações sejam criadas e editadas dentro do aplicativo sem a necessidade de transferência de arquivos. 7

5- LLMs híbridos com capacidades multimodais

Os avanços futuros podem incluir grandes modelos multimodais que integram múltiplas formas de dados, como texto, imagens e áudio, permitindo-lhes compreender e gerar conteúdo em diferentes tipos de mídia, aprimorando ainda mais suas capacidades e aplicações.

- GPT-5.2: Processa texto e imagens nativamente. Gera código a partir de capturas de tela, analisa documentos e cria interfaces de usuário a partir de estímulos visuais. Áudio e vídeo não são suportados no nível da API. 8

- Gemini 3.1 Pro: Lida nativamente com texto, áudio, imagens, vídeo e repositórios de código inteiros em uma janela de contexto de 1 milhão de tokens. Disponível no AI Studio, Vertex AI e NotebookLM. 9

- Llama 4 Scout e Maverick: Os modelos open-weight de Meta utilizam tokens multimodais de texto e visão com fusão antecipada, treinados em conjunto desde o início, em vez de adicionados como módulos separados. Os modelos foram pré-treinados em 200 idiomas e forneceram suporte específico para ajuste fino em 12 idiomas, incluindo árabe, espanhol, alemão e hindi. 10

A capacidade multimodal já é padrão em modelos de ponta. O desafio restante é a consistência: os modelos têm bom desempenho em combinações comuns de imagem e texto, mas apresentam desempenho inferior em contextos visuais raros, entradas de baixa resolução e raciocínio intermodal que exige a conexão de evidências visuais e textuais.

6- Modelos de raciocínio

Modelos que "pensam" sobre os problemas passo a passo, em vez de gerar respostas imediatas.

Essa mudança da previsão para o raciocínio é fundamental para possibilitar:

- Comportamento agentivo , onde os modelos planejam, executam e adaptam tarefas de forma autônoma.

- Inteligência Artificial Interpretável , onde os resultados são passo a passo e logicamente consistentes, e não apenas plausíveis.

- Claude Opus 4.6: Utiliza pensamento adaptativo; o modelo decide dinamicamente quando e quanto pensar com base na complexidade da tarefa, sem exigir troca manual de modo. A METR mediu seu horizonte de conclusão de tarefas em aproximadamente 14,5 horas no limiar de sucesso de 50% (intervalo de confiança de 95%: 6–98 horas), a estimativa pontual mais alta registrada até fevereiro de 2026. A METR observa que o benchmark está se aproximando da saturação nesse nível de desempenho, o que significa que o valor provavelmente subestima o verdadeiro potencial do modelo. Suporta o uso de ferramentas durante o raciocínio e coordena equipes de agentes para a execução paralela de tarefas. 11 12

- Claude Sonnet 4.6: Leva o pensamento adaptativo a um preço mais acessível (US$ 3/US$ 15 por milhão de tokens). Apresenta desempenho próximo ao do Opus em benchmarks de codificação e uso de computadores (79,6% vs. 80,8% no SWE-bench Verified; 72,5% vs. 72,7% no OSWorld-Verified), tornando o raciocínio estendido viável em larga escala para implantações corporativas. Uma lacuna maior permanece em tarefas de raciocínio inovadoras, como o ARC-AGI-2. 13

7- Modelos ajustados com precisão para domínios específicos

Modelos treinados com dados especializados para setores específicos, em vez de treinamento de propósito geral.

Google, Microsoft e Meta lançaram modelos proprietários importantes, específicos para domínios e otimizados, Gemini 3.1 Pro, Microsoft 365 Copilot (GPT-5.2) e Llama 4 Scout/Maverick, respectivamente, direcionados a casos de uso específicos para empresas, além de suas ofertas de uso geral.

Esses modelos de aprendizado de máquina especializados podem resultar em menos alucinações e maior precisão, aproveitando o pré-treinamento específico do domínio, o alinhamento do modelo e o ajuste fino supervisionado.

Veja os mestrados em Direito (LLMs) especializados em áreas específicas, como programação, finanças, saúde e direito:

Programação: GitHub Copilot : Otimizado para repositórios de código. Em julho de 2025, 20 milhões de desenvolvedores usavam o GitHub Copilot, um aumento de 400% em relação ao ano anterior, e 90% das empresas da Fortune 100 o utilizavam. Ele completa automaticamente o código, gera funções e sugere correções de bugs. 14

Finanças: BloombergGPT : Modelo de linguagem latente (LLM) com 50 bilhões de parâmetros, treinado em um conjunto de dados de 363 bilhões de tokens de documentos financeiros da Bloomberg, supera modelos de tamanho comparável em benchmarks de PNL financeira, incluindo análise de sentimento, reconhecimento de entidades nomeadas e resposta a perguntas. 15

Saúde: O Med-PaLM 2 da Google , otimizado com conjuntos de dados médicos, alcançou mais de 85% de precisão em questões no estilo do Exame de Licenciamento Médico dos EUA (USMLE), sendo o primeiro LLM a atingir desempenho de nível especialista nesse benchmark. Agora, ele alimenta o MedLM, a família de modelos fundamentais de saúde da Google Cloud. 16

Direito: ChatLAW , um modelo de linguagem de código aberto treinado especificamente em conjuntos de dados do domínio jurídico chinês. 17

8- IA ética e mitigação de vieses

As empresas estão cada vez mais focadas em IA ética e mitigação de vieses no desenvolvimento e implementação de grandes modelos de linguagem (LLMs).

Exemplos da vida real:

- Em meados de 2025 , Anthropic e OpenAI realizaram uma avaliação de alinhamento mútuo, testando os modelos públicos um do outro em busca de bajulação, tendências à denúncia e comportamentos de autopreservação. O exercício identificou bajulação em todos os modelos testados, incluindo casos em que os modelos validaram decisões prejudiciais de usuários simulados que exibiam crenças delirantes. Posteriormente, Anthropic desenvolveu a estrutura de testes de Bloom especificamente para avaliar esse comportamento em novos modelos. 18

- DeepMind : “A Ética dos Assistentes Avançados de IA”, oferecendo o primeiro tratamento sistemático das questões éticas e sociais levantadas por agentes de IA, abrangendo alinhamento de valores, riscos de manipulação, antropomorfismo, privacidade e equidade. A avaliação de IA Responsável da empresa incluiu mais de 350 exercícios de simulação de ataques cibernéticos e introduziu um novo Nível de Capacidade Crítica especificamente para manipulação prejudicial, tratando-a como um risco de vanguarda, ao lado de ataques cibernéticos e ameaças QBRN (Químicas, Biológicas, Radiológicas e Nucleares). 19

- Anthropic : Opera como uma empresa de benefício público e publicou sua metodologia de IA Constitucional, um conjunto transparente e auditável de princípios éticos usados para treinar os modelos Claude. Em 2024, contratou seu primeiro pesquisador de bem-estar em IA e, em 2025, lançou um programa de pesquisa sobre bem-estar de modelos, examinando como avaliar se os sistemas de IA merecem consideração moral. 20

Limitações dos grandes modelos de linguagem (LLMs)

1- Alucinações

Os modelos geram informações que parecem plausíveis, mas são incorretas.

Figura: Parâmetro de alucinação para LLMs populares

Fonte: Quadro de Líderes de Alucinações de Vectara 21

Melhores desempenhos (2026) no benchmark de sumarização da Vectara:

- Gemini 2.5 Flash-Lite: taxa de alucinações de 3,3%, o melhor desempenho no novo conjunto de dados mais complexo.

- Mistral Large, DeepSeek V3.2, IBM Granito-4: logo atrás

- Claude Sonnet 4.6: Alucinações reduzidas por meio de modo de pensamento prolongado; as taxas variam de acordo com o tipo de referência.

- GPT-5.2: Sinalização de incerteza aprimorada

- Gemini 3.1 Pro: Precisão de citação aprimorada; no entanto, 13,6% dos modelos de raciocínio no novo conjunto de dados Vectara priorizam a abrangência em detrimento da consistência factual.

Nota: No conjunto de dados Vectara, mais complexo, a maioria dos modelos de raciocínio/pensamento (GPT-5, Claude Sonnet 4.5, Grok-4) apresenta taxas de alucinação acima de 10%. Modelos mais leves e rápidos, como as variantes do Gemini Flash, atualmente superam os modelos de ponta nesse benchmark específico.

Todos os modelos apresentam alucinações. A frequência diminuiu substancialmente de cerca de 21% em 2021 para menos de 5% nos modelos com melhor desempenho, mas não foi eliminada. Aplicações críticas ainda exigem verificação humana.

2- Viés

Os modelos absorvem e amplificam os vieses sociais presentes nos dados de treinamento.

Figura: Pontuações gerais de viés por modelos e tamanho

Fonte: Arxiv 22

Tipos de viés observados:

- Viés de gênero em sugestões de emprego

- Viés racial em simulações de triagem de currículos

- Viés de idade nas recomendações de saúde

- Viés socioeconômico no conteúdo educacional

3- Toxicidade

Apesar das medidas de segurança, os modelos podem gerar conteúdo prejudicial, ofensivo ou tóxico.

Figura: Mapa de toxicidade dos LLMs

Fonte: Pesquisadores da UCLA e da UC Berkeley 23

*GPT-4-turbo-2024-04-09*, Llama-3-70b* e Gemini-1.5-pro* são usados como moderadores, portanto os resultados podem ser tendenciosos nesses 3 modelos .

Medidas de segurança rigorosas reduzem a toxicidade, mas aumentam os falsos positivos (recusa de solicitações inofensivas). Medidas frouxas permitem a passagem de substâncias tóxicas.

4- Limitações da Janela de Contexto

Cada modelo possui uma capacidade de memória que limita a quantidade de tokens que ele pode processar.

Janelas de contexto de 2026:

- Llama 4 Scout (Meta): 10 milhões de tokens (~7,5 milhões de palavras) maior janela de contexto verificada em produção até fevereiro de 2026 24

- Gemini 3.1 Pro: 1.048.576 tokens (~780.000 palavras) nativamente multimodal 25

- Claude Sonnet 4.6: 1 milhão de tokens beta (~750.000 palavras); o limite padrão é de 200 mil 26

- GPT-5.2: 400.000 tokens (aproximadamente 300.000 palavras) 27

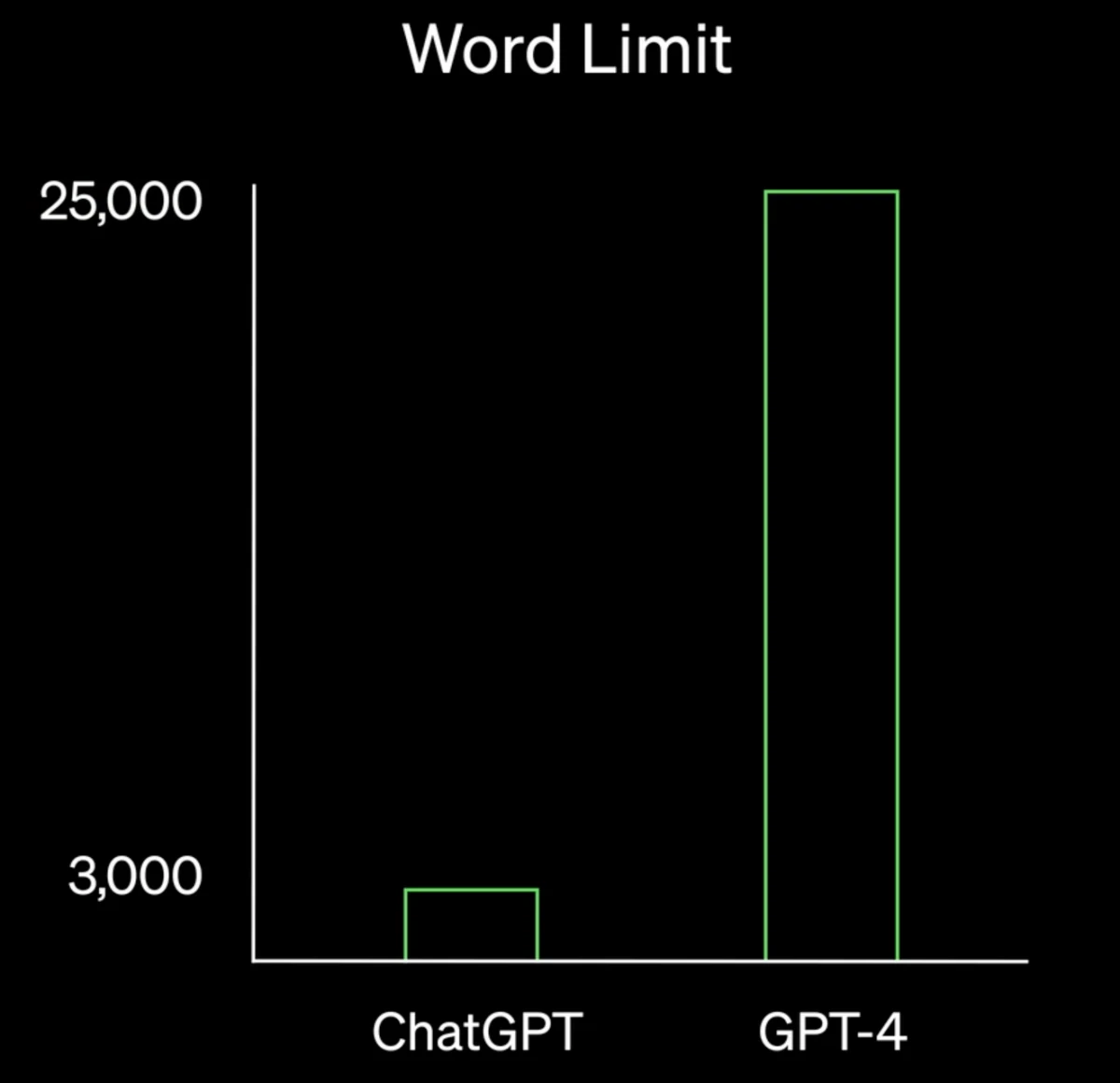

Figura: Comparação do limite de palavras entre ChatGPT e GPT-4

Fonte: OpenAI

5- Limite de conhecimento estático

Os modelos dependem de conhecimento pré-treinado com uma data limite específica. Não têm acesso a informações após o treinamento, a menos que estejam conectados a fontes externas.

Problemas:

- Informações desatualizadas sobre eventos atuais

- Incapacidade de lidar com os desenvolvimentos recentes

- Menos relevância em domínios dinâmicos (tecnologia, finanças, medicina)

Solução: Integração com busca na web. ChatGPT, Claude e Perplexity oferecem busca em tempo real. Mas a busca não elimina as alucinações; os modelos às vezes interpretam os resultados da busca de forma incorreta.

Principais plataformas de LLM

GPT-5.2

Roteamento inteligente de modelos: consultas simples → respostas rápidas, consultas complexas → análises aprofundadas.

Multimodal: Processa texto e imagens. Gera código a partir de capturas de tela, analisa documentos e cria texto alternativo para acessibilidade.

Melhorias em relação a GPT-4:

- Taxa reduzida de alucinações

- Melhor sinalização de incerteza

- Profundidade de raciocínio em nível de doutorado

Quem usa: Desenvolvedores, empresas, criadores de conteúdo. Maior base de usuários entre os LLMs.

Limitações: Ainda causa alucinações. Caro em larga escala. A limitação de conhecimento impede o acesso a informações em tempo real sem a ativação da busca na web.

Claude 4 Soneto/Opus

Raciocínio híbrido: Modo padrão rápido, modo de pensamento estendido para problemas complexos. Capaz de "pensar" por horas, se necessário.

Implementação de memória: Ativação explícita apenas. Começa com um espaço em branco, ativando a memória quando invocada por meio de chamadas de ferramentas (conversation_search, recent_chats). Os usuários veem exatamente quando a memória é ativada.

Separação baseada em projetos: Cada projeto tem um espaço de memória separado. O planejamento estratégico da startup permanece separado do trabalho com o cliente.

Modo de pensamento estendido: Uso de ferramentas durante o raciocínio. A percepção de contexto controla seu próprio orçamento de tokens ao longo das conversas.

Quem usa: Desenvolvedores que preferem transparência, empresas que precisam de controle sobre memória/contexto e equipes que gerenciam vários projetos.

Limitações: O modo de pensamento estendido é mais lento e mais caro. A disponibilidade da versão beta com 1 milhão de contextos é limitada a usuários do nível 4 ou superior.

Gemini 2.5 Pro

Processamento multimodal: Manipulação nativa de texto, áudio, imagens e vídeo. Capaz de analisar conversas completas, incluindo o contexto visual e de áudio.

Execução de código: resolução dinâmica de problemas por meio da geração e execução de código.

Gemini 3.0 previsto para o primeiro trimestre de 2026: Processamento de vídeo em tempo real a 60 fps, janelas de contexto com milhões de tokens, compreensão de objetos 3D, raciocínio integrado por padrão (sem opção de ativação manual).

Quem usa: Google Clientes de nuvem, desenvolvedores que criam aplicativos multimodais e empresas com necessidades complexas de análise de documentos.

Limitações: A latência de resposta aumenta com contextos muito longos. Computacionalmente intensivo. Ecossistema de API menos maduro que OpenAI.

Lhama 4 Escoteiro

Implantação: Uma única GPU NVIDIA H100 processa 10 milhões de contextos de tokens. Multimodalidade nativa com uma abordagem de fusão antecipada.

Quem usa: Pesquisadores, organizações que desejam modelos de código aberto, desenvolvedores que precisam de implantação em dispositivos, empresas que evitam a dependência de fornecedores.

Limitações: O desempenho varia de acordo com a configuração de hospedagem. Requer investimento significativo em infraestrutura para desempenho ideal. Menos recursos prontos para uso do que os modelos comerciais.

FLORESCER

Em grande parte substituído por modelos abertos mais recentes (Llama 4, Mistral, DeepSeek). Permanece disponível no Hugging Face para fins de pesquisa e educação.

Quem ainda o utiliza: Pesquisadores que estudam modelos multilíngues, instituições de ensino e desenvolvedores em comunidades linguísticas com poucos recursos.

Limitação: Dados de treinamento de 2022. Sem atualizações de conhecimento. Modelos abertos mais recentes superam este em grande parte dos benchmarks.

Para uma análise comparativa dos atuais modelos de linguagem, consulte nosso artigo com exemplos de grandes modelos de linguagem .

Perguntas frequentes

Um modelo de linguagem de grande escala é um modelo de IA projetado para gerar e compreender textos semelhantes aos humanos, analisando grandes quantidades de dados.

Esses modelos fundamentais são baseados em técnicas de aprendizado profundo e normalmente envolvem redes neurais com muitas camadas e um grande número de parâmetros, permitindo que elas capturem padrões complexos nos dados com os quais são treinadas.

Seja o primeiro a comentar

Seu endereço de e-mail não será publicado. Todos os campos são obrigatórios.