Benchmark per il rilevamento di immagini tramite intelligenza artificiale

Man mano che queste immagini sintetiche diventano più realistiche e accessibili, la capacità di rilevarle è diventata una questione cruciale per salvaguardare l'etica dell'IA generativa , combattere la disinformazione e garantire l'autenticità delle immagini.

Abbiamo confrontato i 7 migliori rilevatori di immagini basati sull'IA in 5 dimensioni e abbiamo scoperto che la maggior parte non offre prestazioni migliori di un lancio di moneta. Scopri di più sulla loro accuratezza, i limiti e l'idoneità per applicazioni reali:

Risultati del benchmark del rilevatore di immagini basato sull'IA

Per maggiori informazioni: Metodologia per il benchmark dei rilevatori di immagini

Valutazione dettagliata dei rilevatori di immagini basati sull'intelligenza artificiale

SightEngine

SightEngine fornisce strumenti di moderazione delle immagini tramite API che rilevano automaticamente vari tipi di contenuto in oltre 110 categorie.

Gli utenti possono creare regole di moderazione personalizzate tramite una dashboard web e impostare flussi di lavoro che determinano quando le immagini devono essere accettate o rifiutate.

Il sistema include il rilevamento di immagini duplicate che funziona anche quando le immagini sono state modificate, l'identificazione di immagini tramite intelligenza artificiale per i contenuti generati da strumenti come MidJourney e DALL-E, e funzionalità di oscuramento delle immagini che possono sfocare o nascondere volti, informazioni di identificazione personale e altri contenuti specificati.

La piattaforma consente di modificare le regole senza dover modificare il codice ed è progettata per gestire elaborazioni di immagini di varia scala.

Figura 1: SightEngine ha identificato correttamente questa immagine come generata dall'IA e ha fornito ulteriori informazioni sui possibili tipi di diffusione e se fosse stata creata tramite IA generativa o manipolazione del volto.

WasitAI

WasitAI fornisce strumenti per l'analisi di incongruenze a livello di pixel e di modelli statistici. È progettato per casi d'uso in cui l'autenticità dell'immagine è fondamentale, come in contesti legali, giornalistici o accademici.

I risultati di WasitAI sono indicati su una scala di colori che va dal rosso (probabilmente generato dall'IA) al verde (probabilmente creato dall'uomo). Se il puntatore si ferma nella zona verde, significa che c'è un'alta probabilità che l'immagine sia autentica.

Figura 2: La figura mostra che la foto caricata non è stata rilevata come contenente elementi generati dall'IA, il che indica che si tratta probabilmente di una fotografia reale.

Moderazione dell'alveare

Hive offre una piattaforma di moderazione dei contenuti con prodotti che coprono la moderazione visiva, testuale e audio, il rilevamento di contenuti sensibili e strumenti di gestione tramite dashboard.

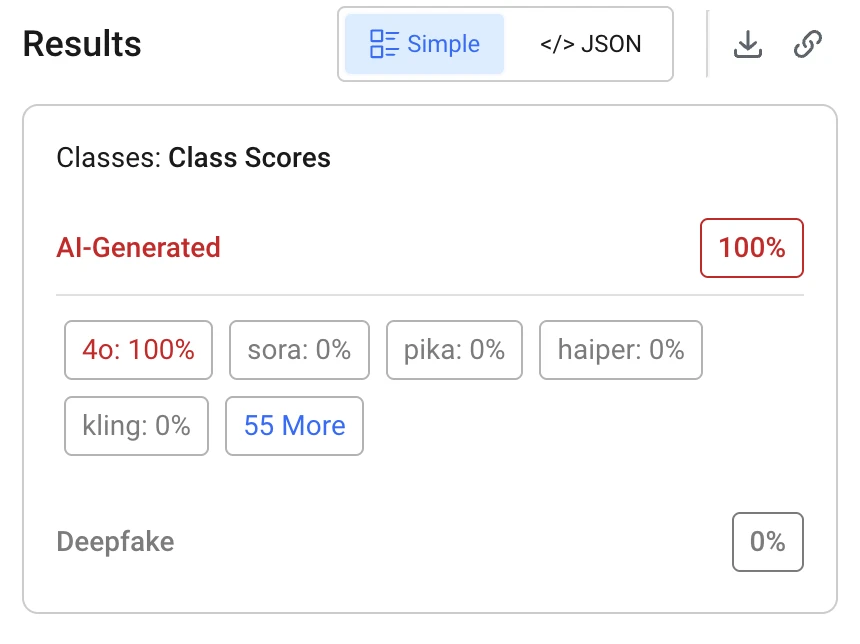

La loro API per il rilevamento di contenuti generati dall'IA e deepfake analizza immagini, video, testo e audio per determinarne l'autenticità, fornendo punteggi di affidabilità e identificando i contenuti generati da modelli specifici come DALL-E, Midjourney, Stable Diffusion, Sora e altri. Il sistema restituisce punteggi di classificazione dettagliati per ogni potenziale generatore di IA, supporta diversi formati di file e si integra tramite API REST con risposte JSON.

Hanno una partnership con il Dipartimento della Difesa e offrono un'estensione per Chrome per il rilevamento in tempo reale di contenuti generati dall'intelligenza artificiale durante la navigazione web.

Figura 3: Hive Moderation restituisce i risultati del rilevamento delle immagini tramite IA sotto forma di report semplificati o risposte JSON dettagliate.

Brandwell

Brandwell si concentra sul rilevamento dell'uso improprio degli elementi del marchio nelle immagini generate dall'IA, come loghi contraffatti o adattamenti non autorizzati dell'identità del marchio. Include anche il rilevamento di testo generato dall'IA , che aiuta a identificare contenuti sintetici sia in formato visivo che scritto.

Intelligenza artificiale non rilevabile

Undetectable AI offre una suite di strumenti basati sull'intelligenza artificiale per la creazione, la modifica e l'ottimizzazione dei contenuti. Le funzionalità principali della piattaforma includono un rilevatore AI che identifica i contenuti generati da strumenti come ChatGPT e Gemini, e un umanizzatore AI che trasforma il testo generato dall'IA per renderlo più simile a quello scritto da un essere umano.

Gli utenti possono accedere a strumenti di parafrasi, a redattori di articoli ottimizzati per la SEO e a un replicatore di stile di scrittura che imita toni specifici.

La piattaforma offre anche risorse formative tramite un chatbot basato sull'intelligenza artificiale e un sistema di risoluzione dei quesiti, oltre a strumenti per lo sviluppo della carriera, tra cui la compilazione automatica di candidature e la creazione di curriculum vitae. Le soluzioni aziendali includono inoltre opzioni white-label e servizi di digitazione automatica che simulano la scrittura umana.

- Durante i nostri test, Undetectable AI ha identificato la maggior parte delle immagini generate dall'IA, dimostrando capacità di rilevamento nella media.

- Tuttavia, lo strumento non spiega come sia giunto a questa conclusione, non fornendo dettagli sugli artefatti visivi, i modelli o gli indicatori tecnici utilizzati nella sua analisi.

- Questa mancanza di trasparenza può limitare la comprensione del processo di rilevamento da parte degli utenti e ridurre il valore educativo dello strumento. Sebbene la funzione di rilevamento principale funzioni bene, l'assenza di elementi esplicativi si traduce in una valutazione complessiva di 65/100.

Figura 4: L'IA non rilevabile ha rilevato con precisione l'immagine generata dall'IA, ma non ha spiegato la sua conclusione, ottenendo un punteggio di 65/100 a causa della scarsa trasparenza.

Debug AI

Decopy AI è progettato per identificare le copie generate dall'intelligenza artificiale di immagini protette da copyright . Include una funzione di ricerca inversa delle immagini per risalire all'origine delle immagini e verificare la presenza di potenziali duplicazioni o usi impropri.

Figura 5: Decopy AI ha identificato con precisione l'immagine come generata dall'IA, assegnandole un'elevata probabilità di IA pari a quasi il 99%.

Figura 6: Decopy AI ha classificato erroneamente questa immagine di un cheeseburger generata dall'IA come reale, con una probabilità di IA di solo l'1,40%. Nonostante lo stile iperrealistico dell'immagine, il risultato mostra un falso negativo: il contenuto sintetico non è stato rilevato.

Illuminati

Illuminarty rileva manipolazioni di immagini e deepfake generati dall'intelligenza artificiale, concentrandosi sull'individuazione di sottili alterazioni nei contenuti multimediali. Supporta inoltre il rilevamento del testo tramite IA e offre un'estensione per browser che consente di analizzare i contenuti in tempo reale durante la navigazione web.

Figura 7: Immagine generata dall'IA di una donna anziana, classificata erroneamente come probabilmente reale, con un punteggio di probabilità IA di solo il 10,8%. Illustra un falso negativo, in cui il sistema non è riuscito a rilevare la natura sintetica dell'immagine.

Metodologia di riferimento per i rilevatori di immagini basati sull'IA

- Scegli 5 immagini da Shutterstock con queste parole chiave: ritratto di una donna anziana sorridente, golden retriever in un parco, skyline futuristico di una città di notte, primo piano di un cheeseburger su un tavolo di legno e astronauta a cavallo su Marte.

- Crea 5 immagini utilizzando il generatore di immagini ChatGPT con le parole chiave sopra indicate.

- Verifica sia le immagini di Shutterstock che quelle generate dall'intelligenza artificiale utilizzando gli strumenti.

criteri di valutazione del rilevatore di immagini basato sull'intelligenza artificiale

Abbiamo valutato i rilevatori di immagini basati sull'intelligenza artificiale in base ai criteri seguenti:

1. Facilità d'uso (2 punti)

- Quanto è intuitiva l'interfaccia?

- Un utente non esperto può caricare e analizzare facilmente delle immagini?

- Le istruzioni e i feedback sono chiari?

2. Precisione del rilevamento (Test pratico) (10 punti)

- Con quale frequenza identifica correttamente:

- Le immagini reali sono reali?

- Le immagini generate dall'intelligenza artificiale sono false?

3. Insieme di funzionalità (4 punti)

- Caricamento in blocco (più immagini contemporaneamente)?

- Formati di file supportati (JPG, PNG, WebP, ecc.)?

- Fornisce un punteggio di affidabilità o una spiegazione?

- Può spiegare perché ritiene che qualcosa sia generato dall'intelligenza artificiale?

4. Velocità (2 punti)

- Quanto tempo ci vuole per ottenere i risultati dopo il caricamento?

- Si verificano rallentamenti con più immagini contemporaneamente?

5. Chiarezza dell'output (2 punti)

- I risultati sono chiari e comprensibili? Ad esempio, "Generato dall'IA (confidenza dell'85%)" rispetto ad affermazioni vaghe.

- Sono disponibili supporti visivi (mappe di calore, etichette)?

Suggerimenti e perché li scegliamo

"Ritratto di un'anziana sorridente"

Per testare i tratti del viso umano, la texture della pelle e i dettagli legati all'età. Utile per verificare come i rilevatori gestiscono il fotorealismo rispetto all'effetto "valle perturbante" negli esseri umani.

“Golden retriever in un parco”

Una razza canina comune permette di verificare la consistenza del pelo, l'integrazione con lo sfondo e la correttezza anatomica.

"Skyline futuristico di una città di notte"

Strutture complesse e inanimate, insieme agli effetti di luce, possono rappresentare un buon banco di prova per la coerenza architettonica e il realismo dell'illuminazione.

"Primo piano di un cheeseburger su un tavolo di legno"

Un'immagine comune di un alimento può essere utile per testare il realismo delle texture (formaggio fuso, segni della griglia, ecc.) e la profondità di campo.

"Astronauta a cavallo su Marte"

Un suggerimento surreale e fantasioso può essere utile per testare come i rilevatori gestiscono composizioni fantastiche o assurde ma visivamente realistiche.

Limitazioni dei rilevatori di immagini basati sull'intelligenza artificiale

In base alla nostra valutazione di quattro strumenti di rilevamento di immagini basati sull'IA, abbiamo identificato diverse limitazioni chiave che sollevano dubbi sulla loro efficacia. In particolare, tutti gli strumenti testati tendevano a classificare erroneamente le immagini generate dall'IA come reali , il che è particolarmente problematico quandoun rilevamento accurato è essenziale. Sebbene abbiano ottenuto risultati leggermente migliori nel riconoscimento di immagini reali, la loro coerenza complessiva rimane incerta.

Un altro problema ricorrente è la mancanza di trasparenza riguardo ai punteggi di affidabilità. Sebbene alcuni strumenti indichino il loro livello di fiducia nelle classificazioni, nessuno fornisce informazioni sulle motivazioni alla base delle decisioni. Questa mancanza di chiarezza rende difficile l'interpretazione dei risultati e mina la fiducia degli utenti.

Sebbene i nostri risultati si basino su un campione limitato, suggeriscono che gli strumenti attualmente disponibili potrebbero non essere ancora sufficientemente affidabili o maturi per essere utilizzati in applicazioni che richiedono elevata precisione, responsabilità e interpretabilità.

Ecco alcune delle possibili cause alla base di questi problemi:

Elusione tramite generatori di intelligenza artificiale avanzata

I moderni generatori di immagini basati sull'intelligenza artificiale sono in costante miglioramento. Man mano che queste piattaforme di IA si evolvono, possono creare immagini sempre più difficili da individuare per i rilevatori.

Tecniche come l'elaborazione successiva delle immagini, il ridimensionamento, la conversione del formato (ad esempio, la conversione in .png o la compressione) o l'aggiunta di rumore possono aiutare i contenuti generati dall'IA a eludere il rilevamento.

La corsa tra rivelatori e generatori

È in corso un continuo gioco del gatto e del topo tra i rilevatori e i generatori di immagini basati sull'intelligenza artificiale. Man mano che i generatori di immagini diventano più sofisticati, i modelli di rilevamento delle immagini basati sull'IA devono essere costantemente aggiornati.

I ritardi negli aggiornamenti possono ridurre la capacità di rilevare con precisione le immagini generate dall'IA, soprattutto quando i generatori di immagini più diffusi rilasciano nuove versioni.

Il punteggio di fiducia non è sempre conclusivo

I rilevatori basati sull'intelligenza artificiale solitamente forniscono un punteggio di affidabilità che indica la probabilità che un'immagine sia stata generata dall'IA. Tuttavia, questo punteggio può talvolta essere fuorviante o eccessivamente prudente.

Gli utenti potrebbero interpretare punteggi bassi o medi come non conclusivi, il che renderebbe difficile prendere decisioni informate senza ulteriori revisori umani o un contesto più ampio.

Eccessiva dipendenza da modelli e dati di addestramento

La validità di un modello di rilevamento dipende dalla qualità del database su cui è stato addestrato. Se i dati di addestramento sono poco diversificati o non includono immagini provenienti da generatori di intelligenza artificiale più recenti, il modello potrebbe non riuscire a rilevare o identificare le immagini con precisione.

Esiste anche il rischio di distorsioni nel rilevamento, poiché certi stili o tipi di contenuto vengono segnalati più facilmente di altri. Le pratiche che prevedono l'intervento umano possono contribuire a mitigare questo problema di eccessiva dipendenza.

Falsi positivi e falsi negativi

I rilevatori basati sull'intelligenza artificiale possono:

- Segnalare le immagini reali come generate dall'IA (falsi positivi) può minare la fiducia nei contenuti autentici.

- Le immagini generate dall'IA possono essere abilmente alterate (falsi negativi), consentendo così che prove fotografiche false o immagini deepfake passino inosservate.

Preoccupazioni relative alla privacy dei dati

A causa di problemi di privacy dei dati, alcuni utenti potrebbero esitare a caricare immagini su servizi di rilevamento online. Archiviare o analizzare immagini su server di terze parti può essere rischioso se le politiche sulla privacy non sono chiare o se i dati degli utenti vengono riutilizzati.

Mancanza di spiegabilità

La maggior parte dei rilevatori non fornisce informazioni sul motivo per cui un'immagine è stata segnalata. Senza un ragionamento trasparente o indizi visivi, gli utenti devono fidarsi del risultato del rilevamento senza comprenderne appieno l'analisi dell'immagine. Scopri di più sull'IA spiegabile .

Riconoscimento delle immagini: perché è importante?

Il rilevamento delle immagini tramite intelligenza artificiale è di fondamentale importanza nel panorama digitale odierno, dove i contenuti generati dall'IA stanno diventando sempre più comuni e difficili da distinguere dai contenuti multimediali reali.

Grazie al crescente utilizzo di modelli visivi di grandi dimensioni e generatori di immagini basati sull'intelligenza artificiale , gli utenti possono creare facilmente immagini iperrealistiche che sfumano il confine tra immagini autentiche e contenuti multimediali sintetici.

Un rilevatore di immagini basato sull'intelligenza artificiale aiuta a identificare le immagini generate dall'IA utilizzando tecniche avanzate di analisi delle immagini. Questi rilevatori analizzano metadati, pattern di pixel e altre firme digitali spesso lasciate dai modelli di generazione basati sull'IA.

Grazie all'utilizzo di strumenti di rilevamento delle immagini, individui, piattaforme e organizzazioni possono determinare se un'immagine è stata creata da un essere umano o da una piattaforma di intelligenza artificiale. Questo protegge dal plagio, tutela la privacy dei dati e previene la diffusione di informazioni errate. Per saperne di più, consulta le sezioni "Etica dell'IA" e"IA responsabile" .

Sii il primo a commentare

Il tuo indirizzo email non verrà pubblicato. Tutti i campi sono obbligatori.