Creazione di agenti di intelligenza artificiale con modelli componibili

Abbiamo trascorso 3 giorni a sperimentare flussi di lavoro e pipeline di agenti in n8n, seguendo le guide di Anthropic e OpenAI sulla creazione di agenti IA efficaci. 1 2

Esplora i componenti principali degli agenti AI , come scegliere i componenti e gli strumenti più adatti, oltre a come creare flussi di lavoro basati sui semplici modelli componibili di Anthropic, come l'incatenamento dei prompt, il routing, la parallelizzazione, i worker dell'orchestratore e un valutatore-ottimizzatore:

Comprendere le componenti degli agenti di intelligenza artificiale

La creazione di agenti implica la connessione di componenti attraverso diversi domini come modelli, strumenti, conoscenza e memoria, e meccanismi di controllo. OpenAI fornisce primitive componibili per ciascuna di esse:

Fonte: OpenAI 3

Ovviamente, OpenAI elenca prima le proprie funzionalità, ma esiste un ampio ecosistema di alternative. A seconda del caso d'uso, è possibile creare agenti utilizzando framework come LangChain, LlamaIndex, CrewAI o persino livelli di orchestrazione personalizzati.

Analizzerò più dettagliatamente ciascuno di questi componenti:

Modelli

Innanzitutto, c'è la componente dei modelli. Si tratta dei modelli di intelligenza artificiale, i modelli linguistici di grandi dimensioni che costituiscono l'intelligenza di base in grado di ragionare, prendere decisioni ed elaborare diverse modalità. Naturalmente, gli esempi che OpenAI ci fornisce sono GPT-5 , ecc.

A seconda del tipo specifico di agente che stai creando, dovrai scegliere un modello diverso all'interno dell'ecosistema OpenAI.

GPT-5 è il tuo modello di punta. È un modello di pensiero che eccelle nel ragionamento, nella risoluzione di problemi complessi e si dimostra particolarmente efficace nel rispondere alla maggior parte delle domande.

Al di fuori dell'ecosistema OpenAI, Claude 4.5 Sonnet è solitamente il modello di riferimento per chi si dedica a molte attività di programmazione, ragionamento e discipline STEM, anche se Gemini 2.5 Pro sta attualmente mettendo in discussione questa posizione.

Tuttavia, OpenAI afferma che il GPT-5.2-Codex è il modello di codifica più avanzato per gli sviluppatori per risolvere problemi complessi di ingegneria del software reali. Il GPT-5.2-Codex di OpenAI mostra prestazioni comparabili su benchmark di codifica come TerminalBench e SWE-bench. 4

Abbiamo analizzato e confrontato i migliori modelli di intelligenza artificiale per aiutarti a capire come ognuno si comporta in termini di ragionamento, velocità e costi, in modo che tu possa scegliere quello più adatto ai tuoi obiettivi.

Utensili

Successivamente, vengono presentati gli strumenti che estendono le capacità del modello, come ad esempio la possibilità di effettuare ricerche sul web o di interagire con altri sistemi.

Quasi ogni app può diventare uno strumento per la tua IA. Puoi collegarla a Gmail, Calendar, al tuo Drive o ad app come Slack, Discord, YouTube, Salesforce e Zapier. Puoi persino creare i tuoi strumenti personalizzati.

Con l'SDK Agents di OpenAI (che richiede un po' di programmazione), è possibile definire strumenti o utilizzare quelli integrati come la ricerca web, la ricerca di file e l'utilizzo del computer. 5

Il protocollo MCP (Model Context Protocol) di Anthropic semplifica anche l'integrazione degli strumenti standardizzando il modo in cui i modelli vi accedono. Nel 2026, il valore aziendale deriverà sempre più dalle "linee di assemblaggio digitali", flussi di lavoro multi-fase guidati dall'uomo in cui più agenti eseguono processi end-to-end, resi possibili dal protocollo MCP.

Se non ti appassiona la programmazione,piattaforme no-code come n8n ti permettono di trascinare e rilasciare gli strumenti per collegarli al tuo modello.

Conoscenza e memoria

Esistono due tipi principali di memoria: la memoria statica (basata sulla conoscenza) e la memoria persistente .

- La knowledge base consente all'IA di accedere a dati statici, politiche e documenti che rimangono relativamente invariati. Questo è fondamentale per gli agenti che svolgono attività basate su politiche aziendali o specifiche dell'azienda, dove i materiali di riferimento devono rimanere coerenti.

- La memoria persistente consente all'IA di ricordare le interazioni passate tra una sessione e l'altra. Questo è fondamentale per i chatbot o gli assistenti personali che hanno bisogno di richiamare alla memoria le conversazioni precedenti.

OpenAI fornisce servizi ospitati come archivi vettoriali , ricerca di file e incorporamenti per la gestione della memoria.

Se preferisci soluzioni open-source, Pinecone (cloud-native e ottimizzato per la ricerca vettoriale) e Weaviate sono opzioni popolari.

Per chi utilizza strumenti no-code , la gestione della memoria è solitamente integrata in piattaforme come n8n e Creatio .

Per maggiori informazioni, vedi: Creazione di un agente di ricerca AI con memoria

Guardrail

Le linee guida assicurano che il tuo agente si comporti come previsto, evitando risposte irrilevanti, dannose o inappropriate. Ad esempio, un bot del servizio clienti dovrebbe rimanere concentrato su argomenti relativi al servizio, senza divagare su argomenti non correlati.

Al di fuori dell'ecosistema di OpenAI, tra gli strumenti più diffusi figurano Guardrails AI e LangChain Guardrails . Molte piattaforme no-code integrano già funzionalità di guardrail, ma è comunque importante comprenderne il funzionamento per mantenere il controllo e la conformità dei propri agenti.

Orchestrazione

L'ultimo componente è l'orchestrazione. Questa fase prevede la gestione del modo in cui più sub-agenti collaborano, la loro implementazione in produzione e il monitoraggio delle loro prestazioni.

Una volta implementati, gli agenti necessitano di una supervisione continua. Modelli, dati e comportamenti cambiano, quindi aggiornamenti e miglioramenti costanti sono fondamentali.

Diverse piattaforme/framework supportano l'orchestrazione, come ad esempio:

- Piattaforme low-code/no-code :

- Stack AI

- Microsoft Copilot Studio Agent Builder

- Intelligenza artificiale per la pertinenza, ecc.

- Framework open source :

- Crew AI, progettata per sistemi multi-agente

- LangChain, ampiamente utilizzato per la gestione e l'implementazione delle interazioni tra agenti

- LlamaIndex è particolarmente efficace per agenti che gestiscono grandi quantità di documenti e per applicazioni basate sulla conoscenza.

Elementi costitutivi dell'automazione: flussi di lavoro vs agenti

Un agente di intelligenza artificiale è un sistema che percepisce il proprio ambiente, elabora le informazioni e intraprende autonomamente azioni per raggiungere obiettivi specifici, come ad esempio gli agenti di programmazione come Cursor o Windsurf, editor di codice basati sull'IA con "modalità agente" in grado di eseguire autonomamente attività di programmazione utilizzando modelli come Claude Sonnet 4.5. Un altro esempio comune sono gli agenti del servizio clienti , che molte aziende utilizzano per gestire le richieste.

Esistono molti modi diversi per progettare e implementare questi agenti, a seconda della complessità del flusso di lavoro e del grado di autonomia richiesto.

Per dare una breve anticipazione, un agente di intelligenza artificiale è spesso un insieme di sotto-agenti, ognuno dei quali svolge compiti specifici. Insieme, questi sotto-agenti si coordinano all'interno di sistemi multi-agente per fornire quello che percepiamo come un singolo agente di intelligenza artificiale.

Questi sono fondamentalmente diversi dai flussi di lavoro. I flussi di lavoro sono sequenze orchestrate di passaggi predefiniti, come una ricetta che segue sempre lo stesso ordine:

Quando utilizzare gli agenti di intelligenza artificiale

Prima di addentrarci negli esempi di implementazione di flussi di lavoro per la creazione di agenti IA, è opportuno fare una breve riflessione. Gli agenti IA non sono framework rigidi. Molti team riscontrano ancora che i flussi di lavoro tradizionali funzionano bene, anche in scenari in cui, in teoria, gli agenti potrebbero essere applicati.

Uno dei modi più chiari per riflettere su questo, descritto nel blog di Anthropic, è il seguente:

Detto questo, esistono situazioni concrete in cui gli agenti superano i flussi di lavoro tradizionali in compiti che richiedono flessibilità, ragionamento e adattabilità:

Conversazioni dinamiche che richiedono adattamenti :

Alcune interazioni, come le semplici richieste di rimborso o di reimpostazione della password, si integrano perfettamente nei flussi di lavoro. Altre, invece, richiedono valutazioni più precise o decisioni contestualizzate, come ad esempio i consigli personalizzati, che dipendono fortemente dal contesto e da un ragionamento bidirezionale.

Processo decisionale di alto valore e basso volume:

La gestione degli agenti può essere costosa, ma in alcuni casi, le decisioni che supportano risultano essere molto più onerose se prese in modo errato.

Ad esempio, BCG ha riferito che un importante fornitore di energia in Germania ha utilizzato uno strumento agentivo basato su GenAI per automatizzare le revisioni dei pagamenti. 6

Se si pianifica un'infrastruttura su larga scala, come ad esempio l'ottimizzazione di progetti ingegneristici, il costo computazionale è trascurabile. In questi casi ad alto rischio, gli agenti aggiungono valore perché il costo di un errore supera di gran lunga il costo di esecuzione del modello.

Flussi di lavoro complessi e imprevedibili, composti da più fasi:

Alcuni flussi di lavoro sono talmente complessi che scrivere infinite regole del tipo "se questo, allora quello" diventa un progetto a sé stante.

In questi casi, i cicli agentici semplificano il caos. Invece di codificare in modo rigido ogni possibile percorso, il modello decide dinamicamente il passo successivo in base al contesto e al ragionamento in tempo reale.

Questo approccio funziona bene per i sistemi o gli strumenti diagnostici che gestiscono decine di variabili variabili.

Quando i flussi di lavoro sono migliori

Scenari ad alta frequenza e bassa complessità :

Alcuni compiti dipendono più dalla velocità e dalla portata che dal ragionamento, come ad esempio:

- Recupero di informazioni da un database

- Analisi di messaggi o email strutturati

- Rispondere alle domande frequenti (FAQ).

Un flusso di lavoro potrebbe elaborare migliaia di queste richieste, con costi e latenza più prevedibili rispetto a un operatore.

Introduzione ai flussi di lavoro e alle implementazioni degli agenti di intelligenza artificiale

Ora che abbiamo discusso i flussi di lavoro degli agenti IA e i componenti che li costituiscono, passiamo alle implementazioni vere e proprie. Come accennato in precedenza, gli agenti IA non sono in genere un'entità singola. Sono invece composti da vari sotto-agenti che interagiscono tra loro. Una delle migliori risorse che ho trovato sui flussi di lavoro e sui sistemi di agenti più comuni è la guida "Building Effective Agents" di Anthropic. 7 Analizziamolo nel dettaglio.

Al centro dei sistemi agentici si trova ciò che Anthropic chiama LLM aumentato . Questa struttura è composta da tre elementi chiave:

- l'input,

- il modello linguistico ampio (LLM),

- e l'output.

Fonte: Anthropic 8

Il modello LLM potenziato è in grado di generare autonomamente query di ricerca, selezionare strumenti pertinenti e decidere quali informazioni memorizzare.

Potreste notare alcune somiglianze con i componenti di OpenAI (come descritto di seguito). Tuttavia, questa versione è più semplificata e priva di elementi come i guardrail e l'orchestrazione, ma la struttura di base rimane la stessa. Ciò è perfettamente accettabile. Per attività come il test e la distribuzione, è preferibile fare riferimento ai componenti di OpenAI.

Elenco dei componenti dell'agente AI di OpenAI 9

Questi elementi costitutivi LLM potenziati sono anche noti come sub-agenti . Ora, esploriamo come questi sub-agenti si combinano e interagiscono per formare un agente di intelligenza artificiale più grande. Inizieremo con i flussi di lavoro più semplici e ci sposteremo gradualmente verso sistemi più complessi e completamente autonomi:

1. Flussi di lavoro agentici semplici (concatenamento di prompt)

Il flusso di lavoro agentico più semplice è chiamato concatenamento di prompt. In questo processo, un'attività viene scomposta in una serie di passaggi, in cui ogni sub-agente gestisce l'output del precedente.

In sostanza, funziona come una catena di montaggio, ma è possibile introdurre punti decisionali per reindirizzare il flusso, se necessario. Lo schema generale rimane lo stesso: un input viene elaborato da un sotto-agente, che passa il risultato a un altro sotto-agente per un'ulteriore elaborazione, e così via, fino alla produzione dell'output finale. Questo metodo è particolarmente utile per attività che possono essere facilmente suddivise in sotto-attività sequenziali più piccole.

Il flusso di lavoro di concatenamento rapido 10

Esempio concreto: 11

Concatenamento rapido in n8n (schema, valutazione e pubblicazione su fogli di calcolo)

Nell'esempio precedente, l'utente inserisce un argomento nella finestra di chat n8n. Ogni nodo LLM utilizza il modello Azure OpenAI.

Il primo LLM genera una scaletta strutturata per un post del blog. La traccia per lo strumento di scrittura della scaletta è la seguente:

Screenshot della richiesta per il generatore di schemi LLM

Dove {{ $json.chatInput }} si riferisce all'argomento inserito dall'utente nella finestra di chat.

La variabile {{ $json.chatInput }} è grigia perché il flusso di lavoro non è ancora stato eseguito. Se avessimo già eseguito o testato il nodo, sarebbe verde o rossa, a seconda della validità della variabile.

Successivamente, il seguente LLM valuterà la bozza in base ai criteri chiave nella sezione dei messaggi di sistema. Il prompt è disponibile qui di seguito:

L'ultimo partecipante al corso LLM sulla scrittura di blog aggiungerà una riga in un foglio di lavoro sull'argomento, basandosi sulla scaletta creata dal partecipante del corso LLM precedente.

Screenshot della richiesta per il Master in Scrittura di Blog

Quando utilizzare l'incatenamento dei prompt:

- I compiti possono essere naturalmente scomposti in sottocompiti fissi e sequenziali.

- Ogni passaggio contribuisce in modo significativo al risultato finale.

- Il ragionamento passo passo migliora la precisione rispetto all'elaborazione diretta.

- Sono necessari punti di controllo della qualità durante tutto il processo.

2. Flusso di lavoro di instradamento

Il routing è un altro tipo di flusso di lavoro in cui si riceve un input e un sub-agente è responsabile di indirizzare tale input all'attività successiva appropriata. Ogni attività viene quindi gestita da un sub-agente specializzato in quell'area e, una volta completate le attività, viene generato l'output finale.

Un classico esempio di instradamento si riscontra nei bot di assistenza clienti. Il bot può ricevere vari tipi di richieste, come domande generali, richieste di rimborso o problemi di supporto tecnico. Il primo sub-agente identifica la natura della richiesta e la instrada al sub-agente specializzato nella gestione di quel particolare problema.

Ad esempio, se la richiesta riguarda un rimborso, verrà inoltrata al sub-agente specializzato in rimborsi, mentre una domanda di supporto tecnico verrà indirizzata al sub-agente di supporto tecnico.

Un altro esempio è l'instradamento delle domande a modelli diversi in base ai loro punti di forza. Per domande più complesse relative alle discipline STEM, si potrebbe instradare l'input a un modello come Claude Sonnet 4.5. Per query più semplici e veloci, si potrebbe optare per un modello come Gemini Flash, ottimizzato per la velocità.

Esempio concreto: 12

Nell'esempio precedente, l'agente instrada l'input dell'utente ad agenti specializzati (come un agente per i promemoria, un agente per le e-mail, ecc.) utilizzando un output strutturato proveniente da un modello linguistico.

Il router è connesso a GPT 4o mini. Il prompt e le categorie sono i seguenti:

Screenshot dei parametri del nodo dell'agente AI

Esempi di casi d'uso:

Puoi inserire una query nella finestra di chat di n8n, ad esempio:

- L'utente dice: "Ricordami di chiamare mia madre domani."

→ Instradato all'agente di promemoria - L'utente dice: "Invia un'email al team delle risorse umane."

→ Instradato all'agente di posta elettronica - L'utente dice: "Fissa un incontro con John la prossima settimana."

→ Instradato all'agente addetto alla riunione

Quando utilizzare il routing:

- Diversi tipi di input: il sistema riceve vari tipi di query che traggono vantaggio da una gestione specializzata.

- Ottimizzazione delle risorse: si desidera assegnare le query semplici ai processori più economici, instradando al contempo le richieste complesse ai sistemi più avanzati.

- Specializzazione di dominio: diverse categorie di input richiedono competenze specifiche del dominio o logiche di elaborazione specifiche.

- Ottimizzazione delle prestazioni: è necessario bilanciare il carico e garantire tempi di risposta ottimali per diversi tipi di query.

3. Flusso di lavoro di parallelizzazione

Il flusso di lavoro successivo è la parallelizzazione. Questo specifico flusso di lavoro basato su agenti presenta in genere due varianti principali. Nella parallelizzazione, più sub-agenti lavorano simultaneamente a un'attività e i loro risultati vengono poi combinati.

- La prima variante si chiama sezionamento , in cui un compito viene suddiviso in sottocompiti indipendenti che vengono eseguiti in parallelo.

- La seconda variante è il voto , in cui lo stesso compito viene eseguito più volte da diversi sub-agenti per produrre risultati diversi, che vengono poi aggregati.

Ciò contribuisce a ottenere un'automazione modulare più rapida, soprattutto nei flussi di lavoro di grandi dimensioni.

Confronto temporale tra flusso di lavoro sequenziale e flusso di lavoro parallelo 13

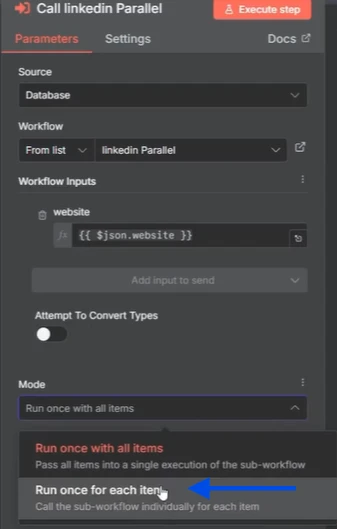

Esempio concreto: 14

Screenshot dell'esempio di flusso di lavoro di parallelizzazione in n8n

L'esecuzione parallela nell'esempio n8n dimostra un'attività in cui il flusso di lavoro interroga la ricerca Google utilizzando l'API SERP per recuperare gli URL di LinkedIn e memorizzarli in un foglio Google. Nella configurazione iniziale, il flusso di lavoro elabora ogni attività in sequenza, un sito web alla volta:

- Il flusso di lavoro viene attivato.

- Lo strumento Get recupera il sito Web dal foglio Google.

- L'agente di intelligenza artificiale utilizza l'API SERP per cercare Google e recuperare l'URL di LinkedIn.

- L'URL di LinkedIn viene quindi aggiornato nel foglio Google.

A questo punto, le attività vengono elaborate una dopo l'altra, il che può risultare lento quando si ha a che fare con grandi insiemi di dati.

n8n ha questa funzione che ti permette di selezionare i nodi, fare clic e poi dire "Voglio convertire questi nodi selezionati in un sotto-flusso di lavoro".

E quello che succede è che quando fai clic su questo pulsante, verrà assegnato un nome al mio flusso di lavoro. Quando premi conferma, tutto ciò si trasforma in un sottoflusso di lavoro che è già collegato qui e richiamato da questo strumento.

Il sottoflusso di lavoro creato

Quindi n8n ha trasformato questo in un sotto-flusso di lavoro, ma non hai ancora la parallelizzazione perché verrebbe comunque eseguito interamente fino a questo punto.

Per far sì che l'esecuzione avvenga effettivamente in parallelo, tutti gli elementi devono essere eseguiti singolarmente. Quindi, quando fai clic sul nodo, puoi scegliere di eseguirlo una sola volta per ogni elemento, il che significa che il sotto-flusso di lavoro verrà richiamato individualmente per ogni elemento.

Una volta apportata la modifica, puoi accedere al sotto-flusso di lavoro e cliccare su "Esecuzioni". Vedrai che tutti e tre gli elementi vengono eseguiti contemporaneamente.

Quando utilizzare la parallelizzazione: La parallelizzazione è più efficace quando le attività possono essere suddivise in sottoattività più piccole e indipendenti che possono essere eseguite simultaneamente, migliorando sia la velocità che l'efficienza.

È inoltre utile quando sono necessarie molteplici prospettive o tentativi ripetuti per ottenere una maggiore affidabilità dei risultati. Per problemi complessi che coinvolgono diverse dimensioni o criteri di valutazione, i modelli linguistici di grandi dimensioni mirano a ottenere prestazioni migliori quando ogni aspetto specifico viene gestito da una chiamata di modello separata, consentendo un ragionamento più mirato e accurato per ogni parte del compito.

4. Flusso di lavoro dei lavoratori dell'orchestratore

Il flusso di lavoro successivo, che diventa più complesso, è il modello orchestratore-operatore.

L'architettura orchestratore-lavoratore rende i flussi di lavoro n8n modulari, scalabili e adattabili, trasformando una singola automazione rigida in un sistema componibile di agenti cooperanti.

A prima vista, potrebbe sembrare simile alla parallelizzazione, dato che più sub-agenti possono essere attivi contemporaneamente, ma la differenza fondamentale risiede nella flessibilità. A differenza della parallelizzazione, la configurazione orchestratore-lavoratori non si basa su un elenco fisso di sotto-attività. L'orchestratore, invece, decide dinamicamente quali attività devono essere eseguite, le assegna agli agenti lavoratori e ne gestisce il coordinamento durante l'intero processo.

Esempio concreto: 15

Screenshot dell'esempio di flusso di lavoro orchestratore-operatori in n8n

Nell'esempio precedente, il brief viene raccolto una sola volta e un coordinatore smista il lavoro a più agenti specializzati.

L'agente CEO funge da orchestratore LLM. Elabora il brief di input, lo perfeziona per ogni dipartimento, seleziona quali agenti operativi attivare e determina come i loro output verranno integrati. Può decidere di chiamare uno, due o tutti gli operatori a seconda del contesto e dei vincoli.

Screenshot del nodo CEO Agent

Di seguito, tre agenti lavoratori, Marketing, Operazioni e Finanza, eseguono ciascuno il proprio modello di chat OpenAI con configurazioni di memoria e strumenti separate. Ciò consente prompt specifici per reparto e schemi JSON per un output strutturato.

Screenshot dei tre nodi dell'agente lavoratore

Una volta che l'orchestratore ha preparato le istruzioni specifiche per ciascun reparto, attiva ogni lavoratore come strumento per generare output sulla base degli input.

Ad esempio, l'agente di marketing crea campagne (nome, canale, KPI).

Nodo strumento di intelligenza artificiale (agente di marketing)

Dopo la generazione degli output dei lavoratori, l' agente CEO compila e unisce le risposte dei reparti in un unico piano coerente. Il flusso di lavoro scrive quindi il piano in un documento Google, aggiunge i metadati, lo converte in PDF e lo carica automaticamente per la condivisione o la revisione.

Screenshot dei nodi di creazione, conversione e caricamento dei documenti.

Una volta eseguito, l'orchestratore determina quali agenti attivare, coordina la loro collaborazione e combina i loro output in un unico report completo, dimostrando come i flussi di lavoro orchestratore-operatore consentano sistemi di intelligenza artificiale flessibili, modulari e componibili.

Quando utilizzare il flusso di lavoro con orchestratore: questo approccio è particolarmente utile per risolvere problemi aperti o in continua evoluzione, in cui i passaggi necessari non possono essere noti in anticipo.

Esempi in cui il flusso di lavoro orchestratore-operatore risulta utile:

- Attività di programmazione: durante lo sviluppo o il debug di prodotti software complessi che richiedono modifiche coordinate su più file, in cui i file e le modifiche esatte possono essere determinati durante l'esecuzione.

- Ricerca e raccolta di informazioni: in attività che implicano la ricerca, la raccolta e l'analisi di dati provenienti da più fonti, dove le informazioni rilevanti non possono essere identificate completamente in anticipo e devono essere scoperte dinamicamente.

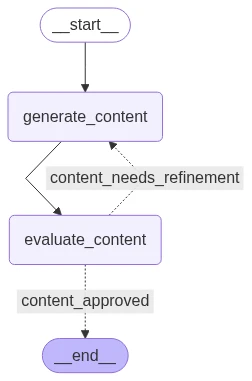

5. Flusso di lavoro dell'ottimizzatore del valutatore

Ancora più complesso è il flusso di lavoro valutatore-ottimizzatore. Questa configurazione si orienta verso un comportamento più autonomo, conferendo al sub-agente o all'agente di intelligenza artificiale maggiore libertà di decidere quali azioni intraprendere e come migliorare i propri risultati.

Si parte da un input e il primo sub-agente genera una soluzione proposta. Tale output viene quindi passato a un sub-agente valutatore, che ne esamina il risultato. Se il valutatore lo ritiene soddisfacente, l'output viene finalizzato. Se invece determina che il risultato non è sufficientemente buono, lo rimanda al primo sub-agente con un feedback specifico per il miglioramento.

Questo crea un ciclo di feedback continuo in cui l'ottimizzatore perfeziona iterativamente il suo output finché il valutatore non determina che soddisfa gli standard di qualità richiesti.

Esempio concreto: 16

In questo esempio ho utilizzato una simulazione Python, anziché uno strumento senza codice, per mostrare direttamente gli schemi di valutazione, la logica personalizzata e i cicli iterativi.

Questa non è una configurazione completa. Per eseguire il flusso di lavoro valutatore-ottimizzatore end-to-end, è necessaria una corretta configurazione dell'ambiente, l'inizializzazione del modello e la configurazione dello schema, ecc.

È inoltre possibile implementare un ciclo valutatore-ottimizzatore utilizzando strumenti di automazione del flusso di lavoro che supportano i nodi di valutazione.

Flusso di lavoro valutatore-ottimizzatore con Python:

Un esempio di ciclo Valutatore-Ottimizzatore, uno schema comune nei sistemi di IA autoriflessivi o nei flussi di lavoro agentici.

Questo flusso di lavoro rappresenta un ciclo automatizzato di generazione e valutazione dei contenuti in cui due componenti collaborano: una crea e l'altra revisiona. In questo modo si garantisce che i risultati soddisfino gli standard di qualità prima della finalizzazione.

Spiegazione passo passo:

- Inizializza l'input: crea initial_state = {"content_topic": topic}.

- Esegui il ciclo: chiama evaluator_optimizer_workflow.invoke(initial_state) che iterativamente:

- genera/perfeziona i contenuti,

- valuta la qualità,

- Si ripete fino all'approvazione o al raggiungimento del limite massimo di iterazioni.

- Risultato del registro: stampa il messaggio di completamento e il contenuto generato approvato.

- Restituisci i risultati: dizionario final_state (ad esempio, content_topic, generated_content, quality_assessment).

Visualizzazione del flusso di lavoro:

Ciclo di valutazione e ottimizzazione con risultati in Python: ogni ciclo utilizza il feedback precedente per migliorare il contenuto. Il ciclo produce infine un contenuto che soddisfa lo standard di qualità.

Quando utilizzare il flusso di lavoro di ottimizzazione del valutatore: questo flusso di lavoro è particolarmente utile quando esistono criteri di valutazione chiari e quando il perfezionamento iterativo può portare a miglioramenti significativi della qualità.

Esempi in cui il flusso di lavoro valutatore-ottimizzatore risulta utile:

- Ad esempio, in una traduzione letteraria, il primo tentativo potrebbe non cogliere alcune sfumature linguistiche o toni emotivi. Il valutatore fornirebbe un feedback e richiederebbe delle revisioni finché la traduzione non catturi appieno il significato e le sottigliezze del testo originale.

- Un altro esempio si trova nell'aggregazione di ricerche complesse , dove l'ottimizzatore raccoglie e riassume le informazioni mentre il valutatore ne verifica la profondità, la completezza e l'accuratezza. Se il valutatore ritiene che la ricerca sia insufficiente, la rimanda indietro per ulteriori modifiche fino a quando il rapporto finale non soddisfa tutti i requisiti e sintetizza efficacemente le informazioni necessarie.

6. Implementazione di un agente veramente autonomo

Infine, c'è l'implementazione di un agente veramente autonomo. Questo tipo di sistema è concettualmente semplice, ma in pratica può produrre comportamenti estremamente diversi e complessi.

L'agente inizia la sua operazione con un input umano minimo; di solito una singola istruzione o un obiettivo. Una volta definito il compito, funziona in modo indipendente, eseguendo azioni e osservandone gli effetti sull'ambiente.

Una caratteristica fondamentale di questo approccio è l'autovalutazione: l'agente deve determinare, sulla base del feedback ambientale, se le sue azioni lo stanno avvicinando all'obiettivo. Ad esempio, se esegue del codice o utilizza strumenti esterni, deve valutare se tali azioni contribuiscono al progresso o se sono necessari degli aggiustamenti. Questo ciclo guidato dal feedback continua finché l'agente non determina che l'obiettivo è stato raggiunto o che non è possibile compiere ulteriori progressi.

Esempio concreto:

Nel nostro benchmark degli strumenti di programmazione AI , abbiamo osservato che Windsurf e Cursor hanno dimostrato capacità agentive creando autonomamente strutture di file, modificando più file ed eseguendo comandi da terminale per distribuire API su Heroku.

Windsurf si è adattato anche ai recenti cambiamenti della piattaforma, quando ha scoperto che il componente aggiuntivo PostgreSQL Hobby Dev era obsoleto, ha riconfigurato correttamente la distribuzione per utilizzare PostgreSQL Essential 0.

Riepilogo

Costruire agenti di intelligenza artificiale non significa tanto raggiungere la piena autonomia, quanto piuttosto creare sistemi che siano finalizzati, trasparenti e affidabili. Dai nostri esperimenti in n8n e dalle intuizioni ricavate dalle guide di Anthropic e OpenAI, abbiamo scoperto che gli agenti efficaci derivano da scelte di progettazione.

Nell'implementazione degli agenti, ci concentriamo su tre principi guida:

- Mantieni l'architettura semplice. Inizia in piccolo, costruisci in modo modulare e introduci la complessità solo quando questa migliora chiaramente le prestazioni o la flessibilità.

- Rendere visibile il processo di ragionamento. Consentire a utenti e sviluppatori di vedere come l'agente pianifica e prende decisioni, migliorando l'interpretabilità e il controllo.

- Garantire interazioni affidabili tra gli strumenti. Progettare strumenti con ambito di applicazione chiaro, ben documentati e testati, in modo che gli agenti possano agire in modo coerente in ambienti reali.

Sii il primo a commentare

Il tuo indirizzo email non verrà pubblicato. Tutti i campi sono obbligatori.