À medida que esses recursos visuais sintéticos se tornam mais realistas e acessíveis, a capacidade de detectá-los tornou-se uma preocupação crítica para manter a ética da IA generativa , combater a desinformação e garantir a autenticidade das imagens.

Comparamos os 7 principais detectores de imagem por IA em 5 dimensões e descobrimos que a maioria não tem desempenho melhor do que jogar uma moeda para o ar. Veja informações sobre sua precisão, limitações e prontidão para aplicações no mundo real:

Resultados de teste do detector de imagens de IA

Para mais informações: Metodologia para avaliação comparativa de detectores de imagem

Avaliação detalhada de detectores de imagem por IA

SightEngine

O SightEngine fornece ferramentas de moderação de imagens por meio de APIs que detectam automaticamente vários tipos de conteúdo em mais de 110 categorias.

Os usuários podem criar regras de moderação personalizadas por meio de um painel da web e configurar fluxos de trabalho que determinam quando as imagens devem ser aceitas ou rejeitadas.

O sistema inclui detecção de imagens duplicadas que funciona mesmo quando as imagens foram modificadas, identificação de imagens gerada por IA para conteúdo produzido por ferramentas como MidJourney e DALL-E, e recursos de redação de imagens que podem desfocar ou ocultar rostos, informações de identificação pessoal e outros conteúdos especificados.

A plataforma permite modificações nas regras sem alterações no código e foi projetada para lidar com diferentes escalas de processamento de imagens.

Figura 1: O SightEngine identificou corretamente esta imagem como gerada por IA e forneceu informações adicionais sobre os possíveis tipos de difusão e se ela foi criada por IA generativa ou manipulação facial.

WasitAI

O WasitAI fornece ferramentas para analisar inconsistências de pixels em baixo nível e padrões estatísticos. Ele foi projetado para casos de uso em que a autenticidade da imagem é fundamental, como em contextos jurídicos, jornalísticos ou acadêmicos.

Os resultados do WasitAI são indicados em uma escala de cores que varia do vermelho (provavelmente gerado por IA) ao verde (provavelmente feito por humanos). Se o ponteiro parar na zona verde, isso sugere alta confiança de que a imagem é autêntica.

Figura 2: A figura mostra que a foto enviada foi detectada como não contendo nenhum elemento gerado por IA, indicando que provavelmente se trata de uma fotografia real.

Moderação da Colmeia

A Hive oferece uma plataforma de moderação de conteúdo com produtos que abrangem moderação visual, de texto e de áudio, detecção de CSAM (Alergia a Mídia Digital Comunitária) e ferramentas de gerenciamento de painéis de controle.

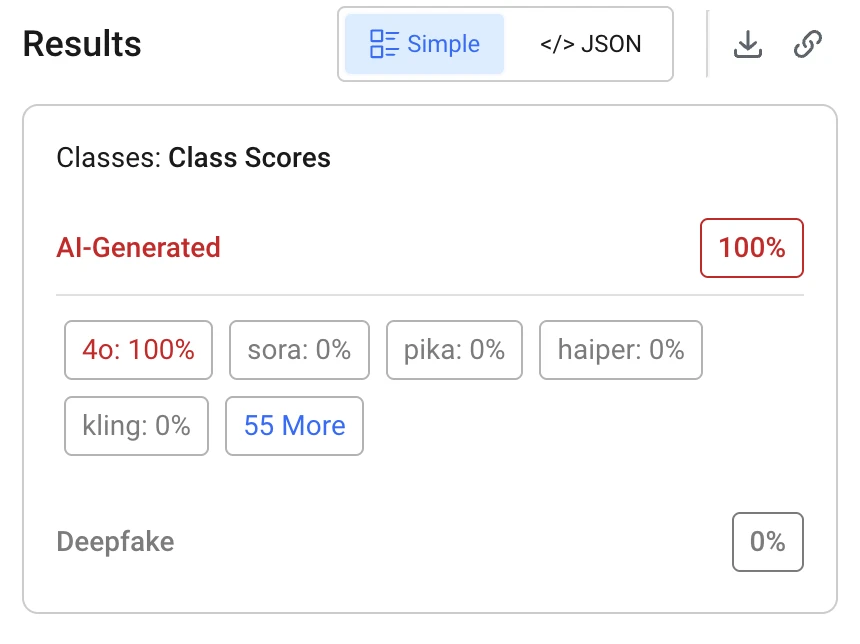

A API de Detecção de Conteúdo Gerado por IA e Deepfakes analisa imagens, vídeos, textos e áudios para determinar a autenticidade, fornecendo pontuações de confiança e identificando conteúdo gerado por modelos específicos, como DALL-E, Midjourney, Stable Diffusion, Sora e outros. O sistema retorna pontuações de classificação detalhadas para cada potencial gerador de IA, suporta múltiplos formatos de arquivo e integra-se por meio de APIs REST com respostas em JSON.

Eles têm uma parceria com o Departamento de Defesa e oferecem uma extensão para o Chrome que permite a detecção em tempo real de conteúdo gerado por IA durante a navegação na web.

Figura 3: O Hive Moderation gera resultados de detecção de imagens por IA em forma de relatórios simplificados ou respostas JSON detalhadas.

Brandwell

A Brandwell concentra-se na detecção do uso indevido de elementos da marca em imagens geradas por IA, como logotipos falsificados ou adaptações não autorizadas da identidade da marca. Também inclui detecção de texto gerado por IA , o que ajuda a identificar conteúdo sintético em formatos visuais e escritos.

IA indetectável

A Undetectable AI oferece um conjunto de ferramentas com inteligência artificial para criação, modificação e otimização de conteúdo. Os principais recursos da plataforma incluem um detector de IA que identifica conteúdo gerado por ferramentas como ChatGPT e Gemini, e um humanizador de IA que transforma o texto gerado por IA para que pareça mais natural, como se tivesse sido escrito por humanos.

Os usuários podem acessar ferramentas de paráfrase, redatores de artigos otimizados para SEO e um replicador de estilo de escrita que imita tons específicos.

A plataforma também oferece recursos educacionais por meio de um chatbot com IA e um solucionador de perguntas, além de ferramentas de desenvolvimento de carreira, incluindo candidaturas a vagas automatizadas e criadores de currículos. As soluções empresariais incluem ainda opções de marca branca e serviços automatizados de digitação de texto que simulam padrões de escrita humana.

- Durante nossos testes, a IA indetectável identificou a maioria das imagens geradas por IA, demonstrando capacidades de detecção médias.

- No entanto, a ferramenta não explica como chegou a essa conclusão, não oferecendo detalhes sobre os artefatos visuais, padrões ou indicadores técnicos utilizados em sua análise.

- Essa falta de transparência pode limitar a compreensão do processo de detecção por parte dos usuários e reduzir o valor educativo da ferramenta. Embora a função principal de detecção funcione bem, a ausência de recursos explicativos resulta em uma avaliação geral de 65/100.

Figura 4: A IA indetectável detectou com precisão a imagem gerada por IA, mas não explicou sua conclusão, obtendo uma classificação de 65/100 devido à transparência limitada.

Decopy AI

O Decopy AI foi projetado para identificar cópias de imagens protegidas por direitos autorais geradas por IA. Ele inclui uma função de busca reversa de imagens para rastrear a origem das imagens e verificar possíveis replicações ou usos indevidos.

Figura 5: O Decopy AI identificou com precisão a imagem como gerada por IA, atribuindo-lhe uma alta probabilidade de IA de quase 99%.

Figura 6: O Decopy AI classificou erroneamente esta imagem de um cheeseburger, gerada por IA, como real, com uma probabilidade de apenas 1,40%. Apesar do estilo hiper-realista da imagem, o resultado mostra um falso negativo: o conteúdo sintético não foi detectado.

Illuminati

O Illuminarty detecta manipulações de imagens geradas por IA e deepfakes, com ênfase na identificação de alterações sutis em mídias visuais. Ele também oferece detecção de texto por IA e uma extensão para navegadores que analisa conteúdo em tempo real durante a navegação na web.

Figura 7: Imagem de uma mulher idosa gerada por IA, classificada incorretamente como provavelmente real, com uma pontuação de probabilidade de IA de apenas 10,8%. Isso ilustra um falso negativo, no qual o sistema não conseguiu detectar a natureza sintética da imagem.

metodologia de avaliação comparativa de detectores de imagem por IA

- Selecione 5 imagens do Shutterstock com estas palavras-chave: retrato de uma senhora idosa sorrindo, Golden Retriever em um parque, horizonte futurista de uma cidade à noite, close-up de um cheeseburger em uma mesa de madeira e astronauta cavalgando em Marte.

- Crie 5 imagens usando o gerador de imagens do ChatGPT com as palavras-chave acima.

- Verifique as imagens do Shutterstock e as geradas por IA usando as ferramentas.

critérios de avaliação do detector de imagens por IA

Avaliamos os detectores de imagem por IA com base nos seguintes critérios:

1. Facilidade de uso (2 pontos)

- Quão intuitiva é a interface?

- Uma pessoa sem conhecimento especializado consegue fazer o upload e analisar imagens com facilidade?

- As instruções e o feedback são claros?

2. Precisão de detecção (Teste prático) (10 pontos)

- Com que frequência identifica corretamente:

- As imagens reais são realmente reais?

- As imagens geradas por IA são falsas?

3. Conjunto de funcionalidades (4 pontos)

- Envio em lote (várias imagens de uma só vez)?

- Suporte a formatos de arquivo (JPG, PNG, WebP, etc.)?

- Fornece alguma pontuação de confiança ou explicação?

- É possível destacar por que o sistema considera que algo foi gerado por IA?

4. Velocidade (2 pontos)

- Qual a rapidez com que o resultado é exibido após o upload?

- O aplicativo apresenta lentidão ao exibir várias imagens?

5. Clareza da saída (2 pontos)

- Os resultados são claros e compreensíveis? Por exemplo, "Gerado por IA (85% de confiança)" versus afirmações vagas.

- Algum recurso visual (mapas de calor, rótulos)?

Sugestões e por que as escolhemos

“Retrato de uma senhora idosa sorrindo”

Para testar características faciais humanas, textura da pele e detalhes relacionados à idade. Útil para verificar como os detectores lidam com o fotorrealismo versus o vale da estranheza em humanos.

“Golden retriever em um parque”

Uma raça canina comum permite verificar a textura da pelagem, a mesclagem com o fundo e a correção anatômica.

“Paisagem urbana futurista à noite”

Estruturas complexas e inanimadas, juntamente com efeitos de iluminação, podem ser um bom teste para avaliar a coerência arquitetônica e o realismo da iluminação.

“Imagem em close-up de um cheeseburger sobre uma mesa de madeira”

Imagens comuns de alimentos podem ser úteis para testar o realismo da textura (queijo derretido, marcas de grelha, etc.) e a profundidade de campo.

“Astronauta cavalgando em Marte”

Um estímulo surreal e imaginativo pode ser útil para testar como os detectores lidam com composições fantásticas ou absurdas, mas visualmente realistas.

Limitações dos detectores de imagem por IA

Com base na nossa avaliação de quatro ferramentas de detecção de imagens por IA, identificamos diversas limitações importantes que levantam preocupações sobre a sua eficácia. Mais notavelmente, todas as ferramentas testadas tenderam a classificar erroneamente imagens geradas por IA como reais , o que é particularmente problemático quandoa detecção precisa é essencial. Embora tenham apresentado um desempenho ligeiramente melhor no reconhecimento de imagens reais, a sua consistência geral permanece incerta.

Outro problema recorrente é a falta de transparência em relação aos índices de confiança. Embora algumas ferramentas indiquem a confiança que depositam em suas classificações, nenhuma oferece informações sobre o raciocínio por trás de suas decisões. Essa falta de clareza dificulta a interpretação dos resultados e mina a confiança do usuário.

Embora nossas conclusões sejam baseadas em uma amostra limitada, elas sugerem que as ferramentas atuais podem ainda não ser confiáveis ou maduras o suficiente para uso em aplicações que exigem alta precisão, responsabilidade e interpretabilidade.

Aqui estão algumas das possíveis causas desses problemas:

Evasão por geradores de IA avançados

Os geradores de imagens de IA modernos estão em constante aprimoramento. À medida que essas plataformas de IA evoluem, elas podem criar imagens cada vez mais difíceis de serem identificadas pelos detectores.

Técnicas como pós-processamento de imagem, redimensionamento, conversão de formato (por exemplo, conversão para .png ou compressão) ou adição de ruído podem ajudar o conteúdo gerado por IA a evitar a detecção.

A corrida entre detectores e geradores

Existe um jogo de gato e rato constante entre detectores e geradores de imagens por IA. À medida que os geradores de imagens se tornam mais sofisticados, os modelos de detecção de imagens por IA precisam ser atualizados continuamente.

Atrasos nas atualizações podem reduzir a capacidade de detectar imagens geradas por IA com precisão, especialmente quando geradores de imagens populares lançam novas versões.

A pontuação de confiança nem sempre é conclusiva.

Os detectores de IA geralmente fornecem uma pontuação de confiança que indica a probabilidade de uma imagem ter sido gerada por IA. No entanto, essa pontuação pode, por vezes, ser enganosa ou excessivamente cautelosa.

Os usuários podem interpretar pontuações baixas ou médias como inconclusivas, o que dificultaria a tomada de decisões informadas sem revisores humanos adicionais ou contexto.

Dependência excessiva de modelos e dados de treinamento

O modelo do detector é tão bom quanto o banco de dados com o qual foi treinado. Se os dados de treinamento forem pouco diversificados ou não incluírem imagens de geradores de IA mais recentes, ele poderá falhar na detecção ou identificação precisa de imagens.

Existe também o risco de viés na detecção quando certos estilos ou tipos de conteúdo são sinalizados com mais facilidade do que outros. Práticas que envolvem intervenção humana podem ajudar a mitigar esse problema de dependência excessiva.

Falsos positivos e falsos negativos

Os detectores de IA podem:

- Sinalizar imagens reais como geradas por IA (falsos positivos) pode minar a confiança em conteúdo autêntico.

- Imagens geradas por IA podem ser alteradas de forma inteligente (falsos negativos), o que pode permitir que fotos falsas ou imagens deepfake passem despercebidas.

preocupações com a privacidade dos dados

Devido a questões de privacidade de dados, alguns usuários podem hesitar em enviar imagens para serviços de detecção online. Armazenar ou analisar imagens em servidores de terceiros pode ser arriscado se as políticas de privacidade não forem claras ou se os dados do usuário forem reutilizados.

Falta de explicabilidade

A maioria dos detectores não oferece informações sobre o motivo pelo qual uma imagem foi sinalizada. Sem um raciocínio transparente ou pistas visuais, os usuários precisam confiar no resultado da detecção sem compreender totalmente a análise da imagem. Confira a IA explicável para saber mais.

Detecção de imagens: por que é importante?

A detecção de imagens por IA é de importância crucial no cenário digital atual, onde o conteúdo gerado por IA está se tornando cada vez mais comum e difícil de distinguir da mídia real.

Com o uso crescente de grandes modelos de visão computacional e geradores de imagens com IA , os usuários podem facilmente criar imagens hiper-realistas que confundem a linha divisória entre visuais autênticos e mídias sintéticas.

Um detector de imagens com IA ajuda a identificar imagens geradas por IA usando técnicas avançadas de análise de imagens. Esses detectores analisam metadados, padrões de pixels e outras assinaturas digitais frequentemente deixadas por modelos de geração de IA.

Ao utilizar detectores de imagem, indivíduos, plataformas e organizações podem determinar se uma imagem foi criada por um humano ou por uma plataforma de IA. Isso protege contra o plágio, resguarda a privacidade dos dados e impede a disseminação de informações falsas. Para saber mais, confira ética em IA eIA responsável .

Seja o primeiro a comentar

Seu endereço de e-mail não será publicado. Todos os campos são obrigatórios.