O mercado de plataformas de IA responsável inclui dois tipos de software. Siga os links para saber mais:

Plataformas de IA responsáveis voltadas para empresas, tais como:

- Credo AI e Watsonx.governance para governança de IA

- Amazon SageMaker e Dataiku para MLOps com recursos de IA responsável

- Databricks e IBM Watsonx.data inteligência para uma plataforma de dados com recursos de IA responsáveis

Bibliotecas de IA responsáveis de código aberto que oferecem funcionalidades específicas (por exemplo, aprendizado federado):

- TensorFlow Federated (TFF) para privacidade

- IA Equidade 360 para equidade

- Dalex para explicabilidade (ou seja, XAI )

- TextAttack para aprendizado de máquina adversário

Essas ferramentas são identificadas como líderes de mercado com base em métricas como número de avaliações, recursos, pontuações no GitHub e referências da Fortune 500. Veja os casos de uso e o foco das ferramentas (como MLOps, governança de IA e governança de dados) seguindo os links em cada uma delas.

Plataformas de IA responsáveis para empresas

Plataforma | Tipo | Número de funcionários | Avaliação |

|---|---|---|---|

IA Holística | governança de IA | 85 | Não há avaliações suficientes. |

Credo AI | governança de IA | 49 | Não há avaliações suficientes. |

IA justa | governança de IA | 13 | Não há avaliações suficientes. |

Aporia | MLOPS | 359 | 4.8 com base em 68 reviews |

Dataiku | MLOPS | 1,378 | 4.5 com base em 198 reviews |

Amazon SageMaker | MLOPS | 130,371 | 4.5 com base em 49 reviews |

Databricks | Governança de dados | 9,280 | 4.6 com base em 655 reviews |

IBM Watsonx | Governança de dados | 4,07 com base em 30 avaliações | |

Snowflake | Governança de dados | 8,441 | 4.6 com base em 770 reviews |

IA especializada | PNL responsável | 278 | Não há avaliações suficientes. |

* Essas ferramentas estão organizadas em ordem alfabética dentro de suas categorias, exceto os patrocinadores, que estão no topo.

plataformas de governança de IA

As ferramentas de governança de IA auxiliam as unidades de negócios na implementação de sistemas de IA que estejam em conformidade com os padrões da indústria.

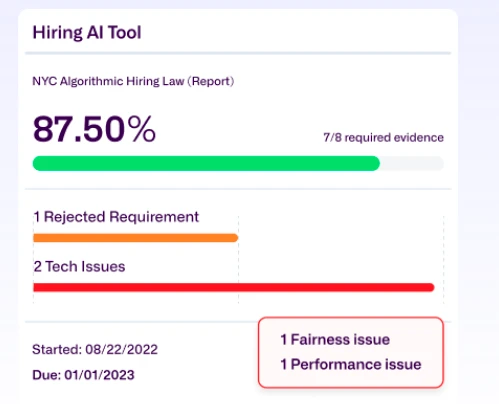

Credo AI

A Credo AI, uma plataforma de governança de IA responsável, pode ajudar as empresas:

- Colabore com ferramentas como coleta de evidências, acompanhamento de responsabilidades e simplificação de aquisições de terceiros.

- Avaliar sistemas de IA quanto a riscos operacionais, regulatórios e de reputação ao longo de todo o seu ciclo de vida.

- Crie artefatos de governança traduzindo evidências técnicas em documentos fáceis de usar, criando modelos de fichas, relatórios de auditoria, relatórios de risco e conformidade e divulgações.

- Garantir a conformidade com regulamentações globais como a Lei de IA da UE e a Lei de Dados e IA do Canadá, políticas internas e padrões do setor.

IA justa

A Fairly AI, agora adquirida pela Asenion, é uma ferramenta de governança de IA que simplifica a validação de modelos, o processo de auditoria e as avaliações de risco, garantindo a conformidade regulatória e a gestão de riscos. A estrutura de IA responsável da Fairly AI identifica lacunas em políticas e regulamentações, auxiliando na seleção de políticas apropriadas e garantindo uma cobertura abrangente para uma governança de IA e gestão de riscos eficazes.

IA Holística

A Holistic AI fornece estruturas de gestão de riscos, conformidade e governança de IA para ajudar as empresas a implementar a IA de forma responsável.

- Avaliação de vieses através da identificação e mitigação de vieses em sistemas de IA, oferecendo estratégias práticas, suporte contínuo e relatórios de auditoria abrangentes que podem ser compartilhados com as partes interessadas.

- Avaliação da conformidade através da catalogação e validação de sistemas de IA de alto risco em relação aos requisitos da Lei de IA, realização de avaliações de risco com estratégias de mitigação e garantia de que a documentação técnica esteja alinhada com os padrões legais.

- Gestão proativa de riscos através do recebimento de relatórios regulares e da realização de autoauditorias para identificar impactos adversos, utilizando insights baseados em dados para otimizar o uso da IA e fundamentar decisões estratégicas.

IBM Watsonx.governança

O Watsonx.governance pode aprimorar a confiança e a transparência da IA, fornecendo visibilidade de nível empresarial, rastreamento de ativos de IA e conformidade de dados e fluxos de trabalho de IA em vários ambientes de implantação, incluindo Cloud e AWS.

Os usuários do Watsonx.governance podem integrar-se a outras ferramentas do Watsonx Studio, como o Watsonx.ai e o Watsonx.data, para treinar, validar, ajustar e implantar IA.

MLOps

Amazon SageMaker e Amazon Bedrock

A Amazon fornece ferramentas projetadas para auxiliar as equipes de conformidade na implementação de sistemas de IA responsáveis, tais como:

- Na Amazon Bedrock: um serviço totalmente gerenciado que simplifica o desenvolvimento de aplicações de IA generativa, fornecendo acesso a modelos básicos de alto desempenho sem exigir preparação de dados, construção de modelos ou gerenciamento de infraestrutura.

- Guardrails : Implementa medidas de segurança em IA generativa, especificando tópicos a serem evitados e detectando e prevenindo automaticamente consultas e respostas restritas.

- Avaliação de Modelos : Avalia e compara Modelos Fundamentais com base em métricas personalizadas, como precisão e segurança, para ajudar a selecionar o melhor modelo para casos de uso específicos.

- Na Amazon, o SageMaker é uma plataforma de aprendizado de máquina que oferece processos de criação, treinamento e implantação de modelos, sendo ideal para tarefas de aprendizado de máquina personalizadas, como análises preditivas, sistemas de recomendação e detecção de anomalias.

- Esclarecer : Detecta possíveis vieses e fornece explicações sobre as previsões do modelo, oferecendo transparência e insights para garantir decisões de IA justas e bem fundamentadas.

- Monitor de Modelos : Monitora os modelos implantados, detectando e alertando automaticamente sobre previsões imprecisas para manter a qualidade do modelo.

- Governança de ML : Aprimora a governança oferecendo ferramentas para controlar e monitorar modelos de aprendizado de máquina, incluindo a captura e o compartilhamento de informações do modelo para garantir a implantação responsável de IA.

- Amazon Augmented AI : Facilita a revisão humana das previsões de aprendizado de máquina, permitindo a supervisão onde o julgamento humano é necessário.

Descubra como o Amazon Bedrock oferece IA responsável:

Aporia

A plataforma Aporia Responsible AI oferece governança abrangente para projetos de IA por meio de:

- Garantir a diversidade de dados, avaliar métricas de imparcialidade e monitorar sistemas em busca de vieses para manter padrões éticos de IA.

- Em conformidade com regulamentações como o GDPR e outros padrões do setor

- Promover a responsabilização e a transparência através da IA Explicável, garantindo que os processos de tomada de decisão da IA sejam compreensíveis.

Dataiku

A Dataiku é uma plataforma de aprendizado de máquina e ciência de dados que cria, implementa e gerencia projetos de dados, análises e IA. Ela pode dar suporte à IA Responsável nesses projetos por meio de diversas funcionalidades essenciais:

- Análise Estatística Avançada : Facilita a análise completa dos dados para identificar e corrigir possíveis vieses.

- Relatórios de Equidade do Modelo : Fornecem métricas como Paridade Demográfica e Odds Igualadas para medir e mitigar o viés.

- Inteligência Artificial Explicável : Oferece explicações detalhadas e análises de cenários hipotéticos para garantir transparência e responsabilidade.

- Conformidade com a privacidade de dados : Garante a adesão a regulamentações como o GDPR e o CCPA.

- Documentação do modelo : Automatiza a criação de documentação detalhada do modelo para fins regulatórios e internos.

- Ferramentas de Governança : Implementa planos de projeto padrão e fluxogramas de trabalho para alinhamento com as práticas de IA Responsável e os requisitos regulatórios.

Governança de dados

A governança de dados refere-se à estrutura abrangente que alinha as práticas de dados com os objetivos de negócios e as estruturas de responsabilidade. Uma ampla aplicação da governança de dados está em aplicações de aprendizado de máquina, denominada governança de dados de aprendizado de máquina .

Databricks

Databricks é uma plataforma unificada de dados e IA que garante a propriedade e o controle dos dados para modelos de IA por meio de monitoramento abrangente, controles de privacidade e governança. Databricks oferece IA responsável por meio de sua Estrutura de Teste de IA Responsável, que inclui:

- Testes de intrusão com IA para identificar vulnerabilidades

- Investigação automatizada e manual para detecção de viés e questões éticas.

- Testes de jailbreak para entender o comportamento do modelo sob ataques.

- Modele a segurança da cadeia de suprimentos para proteger os sistemas de IA ao longo de todo o seu ciclo de vida.

IBM Watsonx.inteligência de dados

Watsonx.data intelligence é uma plataforma de governança e inteligência de dados que garante dados de alta qualidade, em conformidade com as normas e prontos para uso comercial em modelos de IA. Ela oferece IA responsável por meio de seus recursos de inteligência de dados orientados por IA, que incluem:

- Acesso à linguagem natural para usuários de todos os níveis de habilidade, permitindo pesquisar e utilizar dados de forma eficiente.

- Descoberta e catalogação automatizadas de dados em fontes estruturadas e não estruturadas.

- Governança de dados e controles de qualidade, incluindo linhagem, classificação e análise de impacto.

Enriquecimento e padronização de dados com inteligência artificial para conjuntos de dados consistentes e utilizáveis.

Snowflake

Snowflake é uma plataforma de dados em nuvem para armazenamento, processamento e análise de dados, que ajuda as empresas a gerenciar e usar seus dados com eficiência. Sua abordagem de IA responsável enfatiza a segurança dos dados, a diversidade e a maturidade organizacional, garantindo que os aplicativos de IA sejam construídos sobre uma base de dados segura, diversificada e bem governada. Além disso, Snowflake promove a alfabetização de dados e a colaboração interfuncional para impulsionar o uso responsável da IA em todas as organizações.

Ferramentas e bibliotecas de IA responsável de código aberto

* Essas ferramentas estão classificadas com base na pontuação do GitHub em sua categoria. Observe que bibliotecas desatualizadas foram excluídas desta lista.

Privacidade da IA

Essas bibliotecas priorizam o uso da IA para fins legítimos, evitando aplicações antiéticas. Organizações que seguem padrões éticos de IA implementam diretrizes rigorosas, processos de revisão minuciosos e objetivos claros para garantir a conformidade.

- TensorFlow Privacy : Uma biblioteca Python que oferece implementações de otimizadores do TensorFlow para treinamento de modelos de aprendizado de máquina com privacidade diferencial.

- TensorFlow Federated (TFF) : Projetado para dar suporte à pesquisa e experimentação abertas em Aprendizado Federado (FL), onde um modelo global é treinado em vários clientes sem compartilhar seus dados locais.

- Deon : Uma ferramenta de linha de comando que permite adicionar uma lista de verificação ética a projetos de ciência de dados, promovendo considerações éticas e fornecendo lembretes práticos para os desenvolvedores.

Transparência e viés da IA

As bibliotecas de transparência de IA permitem que as partes interessadas compreendam e expliquem os modelos de IA, garantindo transparência nos motivos, dados e intenções por trás desses modelos.

- O Model Card Toolkit (MCT) automatiza a criação de Model Cards, que são documentos que oferecem contexto e transparência em relação ao desenvolvimento e desempenho de um modelo.

Equidade

A equidade em IA envolve a proteção de indivíduos e grupos contra discriminação, preconceito e maus-tratos. Os modelos devem ser avaliados quanto à equidade para evitar vieses contra grupos, fatores ou variáveis específicos.

- AI Fairness 360 : Um conjunto de ferramentas de código aberto de IBM que oferece técnicas para detectar e mitigar vieses em modelos de aprendizado de máquina ao longo do ciclo de vida da IA.

- Fairlearn : Um pacote Python que ajuda os desenvolvedores a avaliar a imparcialidade de seus sistemas de IA e a mitigar quaisquer vieses identificados, oferecendo algoritmos de mitigação e métricas para avaliação de modelos.

- Responsible AI Toolbox : Um conjunto de ferramentas da Microsoft que fornece interfaces para explorar e avaliar modelos e dados de IA, facilitando o desenvolvimento e a implementação de sistemas de IA de forma segura e ética.

explicabilidade da IA

Bibliotecas de explicabilidade de IA ajudam a melhorar a compreensão humana e a confiança nos resultados de algoritmos de aprendizado de máquina.

- DALEX : Um pacote agnóstico a modelos que ajuda a explorar e explicar o comportamento do modelo, auxiliando na compreensão de modelos complexos.

- TensorFlow Data Validation (TFDV) : Uma biblioteca para explorar e validar dados de aprendizado de máquina, otimizada para escalabilidade e integração com TensorFlow e TensorFlow Extended (TFX).

Aprendizado de Máquina Adversarial

O aprendizado de máquina adversarial é uma técnica que tenta explorar modelos de inteligência artificial usando informações acessíveis para criar ataques maliciosos.

- TextAttack : um framework Python para ataques adversários, treinamento e aumento de dados em PNL (Processamento de Linguagem Natural), que simplifica o processo de teste e aprimora a robustez dos modelos de PNL.

O que é IA responsável?

Os 4 princípios orientadores da IA , também conhecida como inteligência artificial responsável (IA), referem-se à construção de confiança em soluções de IA por meio da aplicação de um conjunto de princípios, que são:

- Equidade

- Privacidade

- Segurança e proteção

- Transparência

Esses princípios ajudam a orientar o projeto, o desenvolvimento, a implementação e o uso da IA.

Por que a IA responsável é importante?

Como Estatísticas de IA e tendências de automação de TI indicam:

- 90% dos aplicativos empresariais comerciais contarão com recursos de IA até o próximo ano.

- Nove em cada dez empresas líderes estão investindo em tecnologias de IA. Após o lançamento do ChatGPT em 2022, as empresas relataram um aumento significativo no uso de IA.

- Aumento de 97% no interesse pelo desenvolvimento de IA generativa.

- Observou-se um aumento de 72% na adoção de pipelines de aprendizado de máquina para dar suporte a estratégias de IA generativa.

Esse aumento na adoção de IA e ferramentas de IA generativa leva a preocupações e precauções, tais como:

- 71% dos líderes de TI estão preocupados com as vulnerabilidades de segurança do LLM e os riscos da IA generativa .

- 77% das empresas priorizam a conformidade com a IA .

- 69% das empresas implementaram práticas responsáveis de IA para avaliar a conformidade e identificar riscos. 9

- As leis de privacidade de dados, incluindo o GDPR (UE) e o CCPA (Califórnia), visam prevenir violações de privacidade.

- A Lei de IA da UE exige que as organizações mantenham seus inventários de IA atualizados e precisos.

- Aumento dos casos de preconceito em inteligência artificial , como racismo, sexismo, capacitismo e etarismo.

Perguntas frequentes

A governança de dados engloba as estruturas e ferramentas que as organizações utilizam para proteger e usar adequadamente seus dados. Alguns dos métodos, processos e tecnologias na governança de dados incluem:

1- Coleta de dados

2- Armazenamento de dados

3- Processamento de dados

4- Limpeza de dados

5- Gestão de dados

6- Partilha de dados de forma controlada para:

6.a - Proteger a privacidade dos dados

6.b - Manter a qualidade dos dados

6.c - Apoiar o cumprimento das regulamentações relevantes .

7- Gestão de ameaças internas (ITM) .

Inteligência artificial confiável refere-se a sistemas de IA que funcionam consistentemente conforme o esperado: com precisão, robustez e segurança em diferentes condições.

Inteligência Artificial Confiável é um termo relevante para Inteligência Artificial Responsável, visto que confiança, imparcialidade e conformidade dependem de sistemas que se comportam de maneira previsível. Ferramentas de IA Responsável garantem a confiabilidade por meio de monitoramento de modelos, testes de viés, explicabilidade e alinhamento regulatório.

Leitura complementar

Aprenda outras ferramentas e práticas para mitigar os riscos da IA generativa, tais como:

- Ferramentas de segurança LLM

- Tecnologias que aprimoram a privacidade

- Ferramentas LLMOps

- Ferramentas MLOps

- Ferramentas de governança de IA.

Seja o primeiro a comentar

Seu endereço de e-mail não será publicado. Todos os campos são obrigatórios.