I modelli di visione su larga scala (LVM) possono automatizzare e migliorare attività visive come il rilevamento di difetti, la diagnosi medica e il monitoraggio ambientale .

Abbiamo confrontato le prestazioni di tre modelli di rilevamento di oggetti: YOLOv8n, DETR e GPT-4o Vision, su 1.000 immagini ciascuno, misurando metriche come mAP@0.5, velocità di inferenza, FLOPs e numero di parametri. Per garantire un confronto equo, tutte le immagini sono state ridimensionate a 800×800 pixel e valutate utilizzando la stessa preelaborazione, le stesse soglie di confidenza e gli stessi criteri di corrispondenza basati su IoU.

Benchmark di rilevamento oggetti: GPT-4o (Vision), YOLOv8n, DETR

mAP@0.5: Precisione media a una soglia di Intersezione su Unione (IoU) di 0,5, che misura l'accuratezza del rilevamento degli oggetti bilanciando i veri positivi e i falsi positivi.

Latenza (ms): Il tempo medio di elaborazione per immagine, misurato in millisecondi, indica la velocità del modello.

Risultati di riferimento

Le capacità di rilevamento degli oggetti di GPT-4o rimangono limitate rispetto a modelli specializzati come YOLOv8n e DETR .

Precisione:

- DETR: mAP@0.5 = 0.55

- YOLOv8n: 0.20

- GPT-4o: 0.02

Questi risultati indicano che GPT-4o non è ancora adatto per compiti pratici di rilevamento di oggetti.

Latenza:

- YOLOv8n: 365 ms

- DETR: 3145 ms

- GPT-4o: 5150 ms

YOLOv8n offre l'inferenza più veloce ma una precisione inferiore, mentre DETR raggiunge una precisione migliore a scapito di un'elaborazione più lenta.

Per garantire la coerenza, tutti i modelli sono stati valutati utilizzando immagini di input di 800×800 pixel . I conteggi dei parametri e i FLOPS erano disponibili per YOLOv8n e DETR, ma non per GPT-4o, impedendo un confronto completo dell'efficienza computazionale.

Complessità del modello:

- DETR: 41,52 milioni di parametri , 59,56 GFLOPS

- YOLOv8n: 3,15 milioni di parametri , 6,83 GFLOPS

Questo dimostra l'efficienza di YOLOv8n per le applicazioni in tempo reale, mentre DETR sacrifica la velocità a favore di una maggiore precisione e di una maggiore richiesta computazionale. La mancanza di dettagli architetturali per GPT-4o limita un'analisi più approfondita dell'efficienza.

Consulta la nostra metodologia di benchmarking .

Possibili ragioni alla base delle differenze di rendimento

I tre modelli hanno mostrato diversi livelli di accuratezza e velocità perché sono stati creati per scopi diversi ed elaborano le informazioni visive in modi distinti. GPT-4o è un modello linguistico multimodale di grandi dimensioni che accetta sia testo che immagini, mentre YOLOv8n e DETR sono sistemi di rilevamento di oggetti che operano solo su immagini.

GPT-4o interpreta gli input visivi attraverso un processo di ragionamento basato sul linguaggio. È in grado di descrivere scene e identificare oggetti, ma non è progettato per disegnare riquadri di delimitazione o eseguire una localizzazione spaziale ad alta precisione.

I suoi risultati dipendono dal ragionamento multimodale piuttosto che da meccanismi specifici per il rilevamento. Questo lo rende più lento e meno preciso per le attività di rilevamento.

YOLOv8n e DETR utilizzano architetture create appositamente per il rilevamento di oggetti. Generano direttamente i riquadri di delimitazione anziché elaborarli.

YOLOv8n è ottimizzato per la velocità grazie a una struttura leggera, mentre DETR è un rilevatore basato su trasformatore che elabora le immagini in modo diverso da YOLO e mira a previsioni più accurate.

Entrambi i modelli si concentrano esclusivamente sugli input visivi e seguono obiettivi di addestramento che associano i pattern delle immagini alla posizione degli oggetti.

Le principali differenze includono:

- Tipo di input

- GPT-4o: immagine e testo

- YOLOv8n e DETR: solo immagine

- Funzione primaria

- GPT-4o: comprensione e ragionamento multimodale

- YOLOv8n e DETR: rilevamento degli oggetti

- meccanismo di uscita

- GPT-4o: non disegna intrinsecamente riquadri di delimitazione

- YOLOv8n e DETR: predicono direttamente i riquadri di delimitazione

Poiché YOLOv8n e DETR sono stati sviluppati esclusivamente per il rilevamento di oggetti, è naturale che offrano prestazioni migliori nei benchmark incentrati su accuratezza e latenza.

Il design multimodale ampio e non incentrato sul rilevamento di GPT-4o si traduce in un mAP inferiore e tempi di inferenza più elevati se valutato nello stesso contesto.

Valutazione dettagliata di modelli di visione di grandi dimensioni

OpenAI GPT-4o (Visione)

GPT-4o (Vision) è un'estensione multimodale di OpenAI's GPT-4, progettata per elaborare e generare risposte sia da testo che da immagini.

Questa capacità consente a GPT-4o di interpretare contenuti visivi insieme a informazioni testuali, abilitando una serie di applicazioni che richiedono la comprensione e l'analisi delle immagini.

- Interpretazione delle immagini: GPT-4o è in grado di analizzare e descrivere il contenuto delle immagini, inclusa l'identificazione di oggetti, l'interpretazione delle scene e l'estrazione di informazioni testuali da elementi visivi. Ciò lo rende utile per attività come la didascalia delle immagini e la sintesi di contenuti.

- Analisi visiva dei dati: il modello è in grado di interpretare grafici, diagrammi e tabelle, fornendo approfondimenti e spiegazioni basate sui dati visivi. Questa funzionalità è utile per l'analisi dei dati e per le applicazioni didattiche.

- Comprensione multimodale dei contenuti: GPT-4o può fornire risposte più complete combinando input di testo e immagini. Può anche migliorare le applicazioni nell'analisi dei social media e nella moderazione dei contenuti. Ad esempio, può valutare il sentiment o rilevare la disinformazione nei post che includono sia testo che immagini.

Nonostante le sue capacità avanzate, GPT-4o a volte può produrre risultati imprecisi o inaffidabili. Può interpretare erroneamente gli elementi visivi, trascurare i dettagli o generare informazioni errate, richiedendo la verifica umana per le attività critiche.

Il modello potrebbe inoltre riflettere i pregiudizi presenti nei dati di addestramento, portando a interpretazioni distorte o rafforzando gli stereotipi. Questo rappresenta un problema in applicazioni delicate in cui l'imparzialità è fondamentale, come ad esempio l'inferenza demografica o la moderazione dei contenuti.

OpenAI Sora

Sora è un modello di conversione da testo a video creato da OpenAI. Genera brevi clip video a partire da input dell'utente e può anche estendere video esistenti. La sua tecnologia di base è un adattamento del modello DALL-E 3.

Sora è un trasformatore di diffusione, un modello di diffusione latente per la riduzione del rumore che utilizza un trasformatore. I video vengono inizialmente generati in uno spazio latente tramite la riduzione del rumore di "patch" 3D, quindi convertiti in uno spazio standard utilizzando un decompressore video.

La ri-sottotitolazione viene utilizzata per migliorare il processo di addestramento, in cui un modello di conversione video-testo genera sottotitoli dettagliati per i video.

Grazie agli ultimi sviluppi, gli utenti possono ora generare video con una risoluzione fino a 1080p, una durata massima di 20 secondi e formati widescreen, verticali o quadrati. Possono inoltre integrare i propri contenuti per estendere, remixare e fondere video esistenti o creare nuovi video a partire da istruzioni testuali.

Figura 1: Esempio di generazione video di Sora utilizzando il prompt: "Un'inquadratura ampia e serena di una famiglia di mammut lanosi in un deserto aperto". 1

Landing AI LandingLens

LandingLens semplifica lo sviluppo e l'implementazione di modelli di visione artificiale. Si rivolge a diversi settori senza richiedere competenze approfondite di intelligenza artificiale o di programmazione complessa.

La piattaforma standardizza le soluzioni di deep learning, riducendo i tempi di sviluppo e consentendo una facile scalabilità globale dei progetti. Senza compromettere la velocità di produzione, gli utenti possono creare i propri modelli di deep learning e ottimizzare la precisione delle ispezioni.

Offre un'interfaccia utente guidata passo passo che semplifica il processo di sviluppo.

Figura 2: Il diagramma illustra il flusso di lavoro di LandingLens AI, in cui le immagini di input vengono elaborate in dati, utilizzate per addestrare i modelli, distribuite tramite cloud, edge o Docker e continuamente migliorate attraverso il feedback. 2

Diffusione stabile

Stable Diffusion è un modello di apprendimento profondo progettato per creare immagini di alta qualità a partire da descrizioni testuali:

- La diffusione stabile si basa sulla diffusione. Il processo inizia aggiungendo rumore casuale a un'immagine, e il modello impara quindi a ricostruire l'originale invertendo questo rumore.

- Questo processo consente al modello di generare immagini completamente nuove, affinando l'input rumoroso in più fasi fino a ottenere un'immagine chiara e coerente.

Stable Diffusion utilizza un modello di diffusione latente per migliorare l'efficienza. Invece di lavorare direttamente con immagini ad alta risoluzione, le comprime prima in uno spazio latente a dimensionalità inferiore utilizzando un autoencoder variazionale (VAE).

Questo approccio riduce significativamente i requisiti computazionali, consentendo l'esecuzione su hardware di consumo dotato di GPU.

Applicazioni:

Oltre a generare immagini dal testo, la Diffusione Stabile può essere utilizzata per diverse attività creative, come ad esempio:

- Ritocco pittorico: Restauro o riempimento delle parti mancanti di un'immagine.

- Outpainting: espansione dei bordi di un'immagine per aggiungere ulteriore contenuto.

- Traduzione da immagine a immagine: conversione di un'immagine esistente in uno stile diverso o modifica del suo aspetto in base all'input di testo.

A metà del viaggio

Midjourney è un generatore di immagini che converte descrizioni testuali in immagini di alta qualità.

Capacità

Midjourney Versione 7 presenta un'architettura completamente ricostruita con significativi miglioramenti in termini di qualità e funzionalità.

Generazione delle immagini : V7 produce immagini ingrandite a 2048 x 2048 pixel con una precisione eccezionale e una qualità quasi fotografica. I miglioramenti principali includono texture più ricche, rendering accurato di elementi complessi come mani e volti e una sofisticata comprensione dell'illuminazione e della composizione.

Generazione video : crea clip video da 5 a 21 secondi con elevata uniformità fotogramma per fotogramma. Il sistema genera circa 60 secondi di video da sei immagini in circa tre ore, ed è pensato per applicazioni professionali nel marketing, nella produzione cinematografica e nella creazione di contenuti.

Funzionalità 3D : la generazione di oggetti 3D da testo tramite modellazione NeRF crea oggetti volumetrici e scene immersive. Queste funzionalità sono utili per lo sviluppo di videogiochi, la visualizzazione di prodotti e le applicazioni architettoniche.

Figura 3: Funzione di modifica delle immagini di Midjourney. 3

DeepMind Flamingo

Flamingo di DeepMind è un modello di elaborazione del linguaggio e della visione artificiale progettato per comprendere e analizzare immagini e video utilizzando un numero minimo di esempi di addestramento (few-shot learning). Ecco alcune delle sue caratteristiche principali:

- Apprendimento multimodale con pochi esempi: Flamingo è in grado di svolgere nuovi compiti in modo efficiente con pochi esempi, a differenza dei modelli di intelligenza artificiale tradizionali che richiedono ampi set di dati etichettati.

- Meccanismo di ricampionamento del percettore: Flamingo utilizza un "ricampionatore del percettore" per elaborare in modo efficiente gli input visivi. Comprime i dati di immagini e video in un formato che può essere integrato in un ampio modello linguistico pre-addestrato.

- Allineamento visione-linguaggio con livelli di attenzione incrociata a gate: speciali livelli di attenzione incrociata a gate aiutano Flamingo ad allineare e integrare i dati visivi con il ragionamento testuale. Questa applicazione può essere importante per comprendere le conversazioni basate su immagini.

Flamingo utilizza l'elaborazione fotogramma per fotogramma, scomponendo i video in fotogrammi chiave ed estraendo informazioni per analizzare in modo efficiente gli elementi visivi.

Le sue risposte contestuali aiutano a generare sottotitoli, descrizioni e risposte basate sullo svolgimento degli eventi all'interno di un video, garantendo una comprensione coerente del contenuto.

Inoltre, Flamingo dimostra capacità di ragionamento temporale per comprendere sequenze, relazioni di causa-effetto e interazioni complesse nel tempo. Ciò lo rende estremamente efficace per l'analisi video e le attività di ragionamento multimodale.

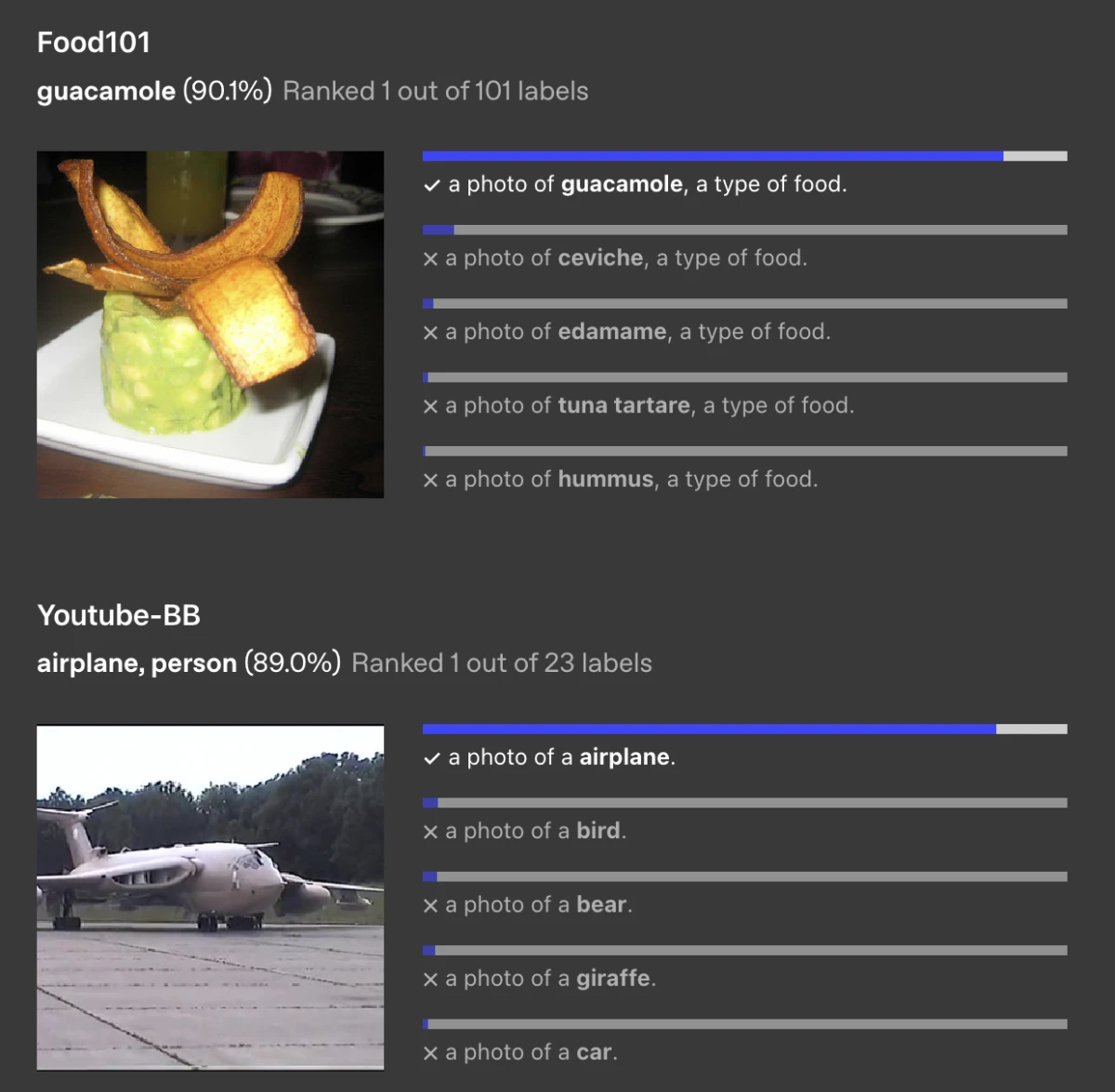

CLIP (Pre-addestramento linguistico-visivo contrastivo) di OpenAI

CLIP è una rete neurale addestrata su una varietà di immagini e didascalie di testo.

Questo modello è in grado di svolgere diverse attività di visione artificiale, tra cui la classificazione zero-shot, interpretando le immagini nel contesto del linguaggio naturale.

CLIP è addestrato su 400 milioni di coppie (immagine, testo) per colmare efficacemente il divario tra le attività di visione artificiale e l'elaborazione del linguaggio naturale. Questo permette a CLIP di prevedere didascalie o riassumere immagini senza essere stato addestrato specificamente per questi compiti.

Figura 4: Identificazione delle immagini tramite CLIP da diversi set di dati. 4

Trasformatore di Visione (ViT) di Google

Vision Transformer applica l'architettura Transformer, originariamente utilizzata nell'elaborazione del linguaggio naturale, alle attività di riconoscimento delle immagini .

Elabora le immagini in modo simile a come i transformer elaborano le sequenze di parole e si è dimostrato efficace nell'apprendere caratteristiche rilevanti dai dati delle immagini per attività di classificazione e analisi.

In Vision Transformer, le immagini vengono trattate come una sequenza di patch. Ogni patch viene appiattita in un singolo vettore, in modo simile a come vengono utilizzati gli word embedding nei transformer per il testo.

Questo approccio consente a ViT di apprendere la struttura dell'immagine e di prevedere autonomamente le etichette di classe.

modelli di base per video nativi

I modelli di base nativi video rappresentano un cambiamento fondamentale rispetto agli approcci tradizionali della visione artificiale. A differenza dei sistemi precedenti che elaboravano i video come sequenze di fotogrammi indipendenti, questi modelli trattano il tempo come una dimensione integrante dei dati visivi.

Principali innovazioni architettoniche

Sora di OpenAI esemplifica questa evoluzione attraverso la sua architettura di trasformatore a diffusione:

- Patch spaziotemporali 3D : elabora i dati video in modo olistico anziché fotogramma per fotogramma.

- Coerenza temporale : mantiene la qualità visiva e la coerenza narrativa tra le sequenze

- Dipendenze a lungo raggio : cattura le relazioni di causa-effetto e gli schemi di movimento

- Generazione consapevole della fisica : comprende il movimento realistico e le interazioni tra gli oggetti

Applicazioni attuali

Creazione di contenuti:

- Montaggio video automatizzato e sintesi di scene

- Trasferimento di stile con coerenza temporale

- Generazione di video narrativi a partire da prompt testuali

Diagnostica per immagini:

- Analisi del movimento cardiaco negli ecocardiogrammi

- Visualizzazione del flusso sanguigno in angiografia

- Valutazione del comportamento dinamico dei tessuti

Sicurezza e sorveglianza:

- Riconoscimento e tracciamento delle attività

- Anomaly rilevamento nel tempo

- analisi del comportamento sensibile al contesto

Sfide rimanenti

Nonostante i progressi compiuti, permangono diverse limitazioni:

- Costo computazionale : la generazione di video di lunga durata rimane un'attività che richiede molte risorse.

- Plausibilità fisica : scenari complessi possono produrre una fisica irrealistica

- Coerenza del personaggio : mantenere l'identità attraverso sequenze prolungate è difficile

- Requisiti di formazione : i dataset video su larga scala con annotazioni sono rari e costosi

Inferenza sul dispositivo e ottimizzazione edge

La distribuzione edge consente ai modelli di visione di funzionare localmente su smartphone, dispositivi IoT e sistemi embedded, eliminando la dipendenza dall'infrastruttura cloud.

Perché la distribuzione edge è importante

Vantaggi in termini di privacy:

- I dati visivi sensibili non lasciano mai il dispositivo.

- Fondamentale per applicazioni sanitarie, di sorveglianza e personali.

- Conformità alle normative sulla protezione dei dati

Vantaggi in termini di prestazioni:

- Latenza quasi nulla senza viaggi di andata e ritorno sulla rete.

- Elaborazione in tempo reale per la realtà aumentata e i sistemi autonomi

- Funzionamento affidabile in ambienti offline

Efficienza dei costi:

- Riduzione del consumo di larghezza di banda

- Riduzione dei costi del cloud computing.

- Costi operativi ricorrenti minimi

Tecniche di compressione del modello

Rendere i modelli di visione di grandi dimensioni utilizzabili su dispositivi edge richiede un'ottimizzazione sofisticata:

- Quantizzazione : riduce la precisione da 32 bit a numeri interi a 8 o 4 bit.

- Modello di dimensioni ridotte

- Perdita di precisione minima

- Potatura : rimuove parametri e connessioni ridondanti

- Crea reti sparse

- Mantiene le prestazioni con un minor numero di calcoli

- Distillazione della conoscenza : trasferisce la conoscenza da modelli di grandi dimensioni a modelli di piccole dimensioni.

Che cos'è un modello di visione su larga scala (LVM)?

I modelli di visione su larga scala (LVM) sono progettati per elaborare, analizzare e interpretare dati visivi, come immagini o video. Sono caratterizzati da un numero elevato di parametri, spesso nell'ordine dei milioni o miliardi. Ciò consente loro di apprendere schemi, caratteristiche e relazioni complesse nei contenuti visivi.

Analogamente ai modelli linguistici di grandi dimensioni (LLM) per il testo, gli LVM vengono addestrati su vasti set di dati, che li dotano di capacità di riconoscimento degli oggetti, generazione di immagini, comprensione delle scene e ragionamento multimodale (integrazione di informazioni visive e testuali).

Questi modelli possono supportare applicazioni in settori quali la guida autonoma, la diagnostica per immagini in ambito medico , la creazione di contenuti e la realtà aumentata .

Struttura e progettazione

I modelli di visione di grandi dimensioni vengono realizzati utilizzando architetture di reti neurali avanzate. In origine, le reti neurali convoluzionali (CNN) erano predominanti nell'elaborazione delle immagini grazie alla loro capacità di gestire in modo efficiente i dati dei pixel e di rilevare modelli gerarchici.

Di recente, i modelli transformer, inizialmente progettati per l'elaborazione del linguaggio naturale , sono stati adattati anche a diverse attività di visione artificiale, offrendo prestazioni migliori in alcuni scenari.

Formazione

L'addestramento di modelli di visione di grandi dimensioni prevede l'alimentazione con dati visivi, come immagini o video provenienti da internet, insieme a etichette o annotazioni pertinenti, secondo un innovativo approccio di modellazione sequenziale. Gli addestratori etichettano le librerie di immagini per fornire i dati ai modelli.

Ad esempio, nei compiti di classificazione delle immagini , ogni immagine viene etichettata con la classe a cui appartiene. Il modello apprende regolando i suoi parametri per minimizzare la differenza tra le sue previsioni e le etichette effettive.

Questo processo richiede una notevole potenza di calcolo e un set di dati ampio e diversificato per garantire che il modello possa generalizzarsi bene a dati nuovi e mai visti prima.

Figura 3: Diagramma di addestramento di modelli di visione di grandi dimensioni su OpenAI. 5

Consulta i servizi di raccolta dati di immagini per saperne di più sui dati di addestramento per la classificazione delle immagini.

Caratteristiche principali dei modelli con ampia escursione visiva

Il tipo di modello si riferisce all'architettura e ai principi di progettazione di un modello di visione. Definisce come il modello elabora e interpreta i dati visivi, se integra più modalità (ad esempio, testo e immagini) e quali meccanismi sottostanti (ad esempio, trasformatori, apprendimento contrastivo, diffusione) utilizza per estrarre rappresentazioni significative.

- Modello LLM multimodale basato su Transformer: un'architettura di modello che combina i Transformer con capacità multimodali. Consente di comprendere simultaneamente input visivi e testuali. Viene addestrato utilizzando dataset di grandi dimensioni per eseguire ragionamenti complessi su più tipi di dati.

- Apprendimento contrastivo: una tecnica utilizzata nell'addestramento di modelli per distinguere tra punti dati simili e dissimili. Questo processo prevede la massimizzazione della somiglianza tra input correlati e la minimizzazione della somiglianza tra input non correlati. Viene spesso utilizzato nell'apprendimento auto-supervisionato per migliorare la rappresentazione delle caratteristiche.

- Piattaforma di visione artificiale basata sull'IA: questo sistema fornisce infrastrutture, strumenti e modelli pre-addestrati per diverse attività di visione artificiale, come il riconoscimento di immagini , il rilevamento di oggetti e la segmentazione. In genere include funzionalità di addestramento, implementazione e inferenza dei modelli.

- Transformer: un'architettura di deep learning che utilizza meccanismi di autoattenzione per elaborare i dati di input. Consente ai modelli di catturare dipendenze a lungo raggio, risultando efficace per attività legate al linguaggio naturale e alla visione artificiale.

- Modello di diffusione: un modello generativo che rimuove gradualmente il rumore da un input iniziale rumoroso e lo affina passo dopo passo per produrre un output chiaro e strutturato. Viene comunemente utilizzato per la generazione e il miglioramento delle immagini .

Obiettivo di addestramento: la funzione obiettivo o di ottimizzazione che guida il modo in cui un modello apprende dai dati. Determina come il modello regola i suoi parametri interni durante l'addestramento per migliorare le prestazioni su compiti specifici. Questi compiti includono la previsione del prossimo punto dati (apprendimento autoregressivo), la distinzione tra input simili e dissimili (apprendimento contrastivo) o la classificazione delle immagini in categorie.

- Autoregressivo: un approccio di addestramento in cui un modello prevede il punto dati successivo in una sequenza basandosi sugli input osservati in precedenza. Viene spesso utilizzato nella modellazione del linguaggio e nei modelli di visione generativa.

- Apprendimento contrastivo: un obiettivo di apprendimento auto-supervisionato in cui il modello impara distinguendo tra coppie di dati simili e dissimili. Aiuta a migliorare la capacità di catturare rappresentazioni significative senza etichette esplicite.

- Apprendimento supervisionato: un paradigma di apprendimento in cui il modello viene addestrato utilizzando dati etichettati, ovvero a ciascun input è associato un output corretto corrispondente. Questo approccio è ampiamente utilizzato in attività come la classificazione e la segmentazione.

- Classificazione delle immagini: un obiettivo di addestramento specifico in cui un modello impara a categorizzare le immagini in classi predefinite in base a caratteristiche visive. Il processo di addestramento prevede l'ottimizzazione di una funzione di perdita per massimizzare l'accuratezza della classificazione.

- Diffusione di denoising: un approccio di apprendimento generativo in cui un modello viene addestrato per recuperare immagini pulite da input rumorosi. Questo processo prevede l'inversione di un processo di aggiunta progressiva di rumore per migliorare la ricostruzione e la generazione dell'immagine.

Supporto per la messa a punto: la capacità di un modello di adattarsi a compiti specifici mediante l'addestramento su set di dati più piccoli e specifici del dominio, mantenendo al contempo le conoscenze acquisite nella fase di pre-addestramento.

La messa a punto contribuisce a migliorare le prestazioni nelle applicazioni specializzate.

Apprendimento zero-shot/pochi-shot: la capacità di un modello di eseguire compiti con pochi o nessun dato di addestramento specifico per il compito.

L'apprendimento zero-shot consente di trarre inferenze su categorie non viste, mentre l'apprendimento few-shot permette l'adattamento con un numero minimo di esempi etichettati.

Supporto multimodale: la capacità di un modello di elaborare e integrare informazioni provenienti da diverse modalità (ad esempio, testo, immagini, audio).

Open source vs. proprietario: i modelli open source hanno codice e pesi disponibili pubblicamente, consentendo la modifica e l'implementazione da parte della comunità,

I modelli proprietari sono di proprietà e controllati da entità private e possono limitare l'accesso e la personalizzazione.

Implementazione Edge: la capacità di un modello di essere eseguito su dispositivi edge (ad esempio, telefoni cellulari, dispositivi IoT) anziché dipendere da server basati sul cloud.

L'implementazione edge contribuisce a ridurre la latenza, migliora la privacy e consente l'elaborazione in tempo reale in ambienti con risorse limitate.

Quali sono i casi d'uso dei modelli di visione su larga scala?

Assistenza sanitaria e diagnostica per immagini

- Diagnosi di malattie : Individuazione di malattie a partire da immagini mediche come radiografie, risonanze magnetiche o tomografie computerizzate per identificare tumori, fratture o anomalie.

- Patologia : Analisi di campioni di tessuto in patologia per individuare segni di cancro.

- Oftalmologia : Diagnosi di malattie a partire da immagini della retina.

Veicoli autonomi e robotica

- Navigazione e rilevamento degli ostacoli : aiutare veicoli autonomi e droni a navigare ed evitare gli ostacoli interpretando i dati visivi in tempo reale.

- Robotica nella produzione : supporto ai robot nelle attività di smistamento, assemblaggio e controllo qualità.

Sicurezza e sorveglianza

- Monitoraggio delle attività : analisi dei flussi video per rilevare comportamenti insoliti o sospetti.

- Riconoscimento facciale : utilizzato nei sistemi di sicurezza per la verifica e il tracciamento dell'identità. Ad esempio, Amazon Rekognition è un servizio basato su cloud offerto da AWS che fornisce funzionalità di analisi di immagini e video come il rilevamento e il riconoscimento facciale, l'identificazione di oggetti e scene e l'estrazione di testo. Può analizzare emozioni, fasce d'età e attività, il che risulterebbe utile per la personalizzazione e la sicurezza.

Guarda il video qui sotto per vedere Amazon Rekognition in azione. 6

Vendita al dettaglio e commercio elettronico

- Ricerca visiva : consente ai clienti di cercare prodotti utilizzando immagini anziché testo.

- Gestione dell'inventario : automatizzazione del monitoraggio e della gestione dell'inventario tramite riconoscimento visivo.

Agricoltura

- Monitoraggio e analisi delle colture : Monitoraggio dello stato di salute e della crescita delle colture tramite immagini aeree riprese da droni o satelliti.

- Rilevamento dei parassiti : identificazione di parassiti e malattie che colpiscono le colture.

Monitoraggio ambientale

- Monitoraggio della fauna selvatica : identificazione e tracciamento della fauna selvatica a supporto delle iniziative di conservazione.

- Analisi dell'uso e della copertura del suolo : monitoraggio dei cambiamenti nell'uso del suolo e nella copertura vegetale nel tempo.

Creazione di contenuti e intrattenimento

- Montaggio video e cinematografico : automazione dei processi di montaggio video e post-produzione.

- Sviluppo di videogiochi : miglioramento del realismo degli ambienti e della creazione dei personaggi.

- Miglioramento di foto e video : Miglioramento della qualità di immagini e video.

- Moderazione dei contenuti : rilevamento e segnalazione automatica di contenuti visivi inappropriati o dannosi.

Quali sono le sfide dei modelli di visione di grandi dimensioni?

Risorse computazionali

L'addestramento e l'implementazione di questi modelli richiedono una notevole potenza di calcolo e memoria, il che può renderli processi dispendiosi in termini di risorse.

Requisiti dei dati

Per l'addestramento sono necessari set di dati vasti e diversificati. La raccolta, l'etichettatura e l'elaborazione di set di dati così ampi possono essere complesse e costose. Tuttavia, le aziende di crowdsourcing possono fornire un valido aiuto .

Parzialità ed equità

I modelli possono ereditare i pregiudizi presenti nei dati di addestramento, portando a risultati iniqui o non etici, soprattutto in applicazioni delicate come il riconoscimento facciale.

Interpretazione e spiegabilità

Comprendere come questi modelli prendono decisioni può essere difficile, soprattutto in applicazioni in cui la trasparenza è fondamentale. Scopri l'intelligenza artificiale spiegabile per capire come funziona questo processo e come contribuisce all'etica dell'IA.

Generalizzazione

Sebbene si comportino bene con dati simili al set di addestramento, potrebbero avere difficoltà con tipi di dati completamente nuovi o diversi.

Preoccupazioni relative alla privacy

L'utilizzo di modelli visivi di grandi dimensioni, soprattutto nella sorveglianza e nel riconoscimento facciale, solleva notevoli preoccupazioni in materia di privacy .

Sfide normative ed etiche

Garantire che questi modelli siano conformi agli standard legali ed etici è sempre più importante, soprattutto man mano che si integrano maggiormente nella società.

metodologia di benchmark per il rilevamento di oggetti

In questo benchmark, le prestazioni dei modelli di rilevamento di oggetti YOLOv8n, DETR (DEtection TRansformer) e GPT-4o Vision sono state confrontate sul dataset di validazione COCO 2017. Per il confronto sono state utilizzate 1000 immagini per modello. Tutte le immagini sono state ridimensionate a 800×800 pixel per garantire dimensioni di input coerenti tra i modelli.

Il modello YOLOv8n è stato caricato con pesi pre-addestrati (yolov8n.pt) dal repository Ultralytics e l'inferenza è stata eseguita utilizzando il metodo predict() tramite l'API YOLO di Ultralytics. Il modello DETR è stato caricato con l'architettura detr_resnet50 dalla libreria di Facebook Research e i suoi output, originariamente normalizzati nel formato [center_x, center_y, width, height], sono stati riscalati e convertiti nel formato di coordinate [x1, y1, x2, y2]. Una soglia di confidenza di 0,5 è stata applicata ai risultati di entrambi i modelli.

Il modello GPT-4o Vision è stato valutato utilizzando l'API di OpenAI per le capacità di rilevamento degli oggetti. Per questo modello, sono state scaricate le immagini dal dataset di validazione COCO, sono state caricate le annotazioni e ogni immagine è stata convertita nel formato appropriato (ridimensionata a 800×800 pixel) prima di essere inviata all'API. Sono stati richiesti in formato JSON solo i rilevamenti appartenenti alle classi COCO e le previsioni restituite dall'API sono state valutate utilizzando la stessa soglia di confidenza (0,5) e lo stesso formato di coordinate.

Nella valutazione, i bounding box previsti dai modelli sono stati confrontati con i bounding box reali calcolando l'Intersection over Union (IoU), con un IoU ≥ 0,5 considerato una corrispondenza vera positiva. La precisione media (AP) è stata calcolata per ciascuna classe e la media di tutte le classi è stata riportata come metrica mAP@0,5. Oltre all'accuratezza, sono stati misurati e confrontati i tempi di inferenza. Inoltre, la complessità del modello è stata analizzata in base ai FLOP e al numero totale di parametri.

Per garantire un confronto equo, tutte le inferenze del modello sono state eseguite sullo stesso hardware (identica GPU/CPU). Gli stessi passaggi di pre-elaborazione, ovvero il ridimensionamento di tutte le immagini a 800×800 pixel e l'applicazione della normalizzazione necessaria, sono stati applicati a tutti i modelli. Per la post-elaborazione, le previsioni sono state convertite nello stesso formato di coordinate, è stata applicata in modo coerente una soglia di confidenza di 0,5 e sono stati adottati criteri di calcolo IoU uniformi durante la valutazione.

In questo contesto, YOLOv8n, DETR e il modello GPT-4o Vision sono stati confrontati in termini di prestazioni e velocità di rilevamento degli oggetti; sono stati inoltre impiegati ulteriori aggiustamenti e metodi per confrontare le capacità di GPT-4o Vision con i modelli di rilevamento degli oggetti attualmente in uso.

Conclusione

I modelli di visione su larga scala (LVM) stanno cambiando il modo in cui le macchine interpretano e agiscono sui dati visivi in diversi ambiti, tra cui la sanità, i sistemi autonomi, la sicurezza e le industrie creative.

Sfruttando architetture avanzate, come i trasformatori e i modelli di diffusione, i modelli LVM supportano un'ampia gamma di attività complesse, tra cui l'imaging medico, il rilevamento di oggetti in tempo reale, la generazione di immagini da testo e la generazione di video.

La loro capacità di apprendere da vasti set di dati multimodali consente scenari di implementazione flessibili, che vanno dall'inferenza basata sul cloud all'edge computing, permettendo applicazioni su misura che spaziano dall'ispezione industriale alla creazione di contenuti personalizzati.

Tuttavia, queste capacità comportano sfide significative. Il costo computazionale dell'addestramento e dell'implementazione dei modelli LVM rimane elevato, spesso richiedendo hardware potente e infrastrutture specializzate.

Problemi quali la distorsione dei dati, la limitata interpretabilità e le preoccupazioni etiche relative alla sorveglianza e alla privacy sottolineano la necessità di una governance attenta dei modelli. Con l'evoluzione continua dei modelli di volatilità latente (LVM), trovare un equilibrio tra innovazione e responsabilità sarà fondamentale per garantire che vengano utilizzati in modo efficace ed equo nei diversi settori.

Sii il primo a commentare

Il tuo indirizzo email non verrà pubblicato. Tutti i campi sono obbligatori.