Os aplicativos baseados em LLM estão se tornando mais capazes e cada vez mais complexos, dificultando a interpretação de seu comportamento.

Cada resultado do modelo depende de instruções, interações com ferramentas, etapas de recuperação e raciocínio probabilístico que não podem ser inspecionados diretamente. A observabilidade do LLM resolve esse desafio, proporcionando visibilidade contínua de como os modelos operam em condições reais. Ela permite que as organizações monitorem a qualidade, detectem falhas, solucionem problemas em fluxos de trabalho com várias etapas e gerenciem o desempenho e os custos.

Ferramenta | Ideal para |

|---|---|

Realizar experimentos frequentes e comparar prompts/modelos com controle de versão robusto e painéis de controle. | |

Langfuse | Observabilidade de código aberto e auto-hospedada com rastreamentos granulares e avaliações personalizáveis. |

Helicone | Configuração sem código para monitoramento básico, controle de custos e armazenamento em cache de chamadas da API LLM. |

Langsmith | Criação de cadeias ou agentes com várias etapas (especialmente com LangChain) com visibilidade detalhada do rastreamento. |

Conselho de especialistas | Avaliação automatizada, alertas e monitoramento da qualidade da produção. |

Pesos e Viéses (Tecelagem W&B)

O W&B Weave é a plataforma de observabilidade de LLM (Modelo de Linguagem Local) da Weights & Biases para monitorar, avaliar e otimizar aplicações de modelos de linguagem. O Weave rastreia automaticamente cada chamada de LLM usando o decorador @weave.op, capturando entradas, saídas, custos, latência e métricas de avaliação sem configuração manual.

A plataforma rastreia o uso de tokens e calcula os custos automaticamente, monitora os tempos de resposta para detectar consultas lentas e mede a precisão comparando as previsões com os resultados esperados. Diferentes experimentos podem ser comparados lado a lado para verificar qual modelo ou solicitação tem melhor desempenho. O rastreamento de erros mostra quais previsões falharam e por quê, enquanto o versionamento automático preserva todas as alterações de configuração para garantir a reprodutibilidade. Isso facilita o teste de diferentes abordagens, a identificação do que funciona melhor e a depuração de problemas quando os modelos cometem erros.

Painel de Resumo de Pontuação

Figura 1: Gráficos que mostram o painel de métricas de desempenho do modelo, acompanhando as tendências de precisão, custo e latência ao longo do tempo.

As métricas de desempenho são exibidas em todas as execuções de avaliação. O custo total, o uso de tokens e os tempos de resposta são apresentados em gráficos que mostram as alterações ao longo do tempo. Métricas personalizadas, como precisão e taxas de erro, aparecem em painéis separados. As linhas de tendência ajudam a identificar quando o desempenho piora ou os custos aumentam inesperadamente, com o painel sendo atualizado automaticamente à medida que novos testes são concluídos.

Visualização de Vestígios

Figura 2: Tabela de rastreamento de avaliação mostrando as versões do modelo e seus resultados de classificação de intenção.

Cada execução de teste é salva com detalhes completos. Cada rastreamento mostra qual modelo foi usado, qual comando foi enviado e todas as configurações. Indicadores de sucesso ou falha mostram se os testes foram concluídos corretamente. A coluna de comando exibe o texto enviado ao modelo para verificação. Esse registro permite comparar diferentes versões lado a lado, ver o que mudou entre as execuções e repetir qualquer teste usando sua configuração salva.

Classificação de comparação de modelos

Figura 3: Imagem mostrando a tabela de classificação comparando as versões do modelo de classificação de intenções em relação às métricas de precisão e latência.

É possível comparar diferentes modelos e configurações nos mesmos dados de teste. As colunas mostram a precisão, as previsões corretas, as pontuações e os tempos de resposta. A codificação por cores destaca os melhores desempenhos em verde. Essa comparação revela as vantagens e desvantagens, como maior precisão em detrimento da velocidade ou respostas mais rápidas com precisão ligeiramente menor, ajudando a escolher a configuração mais adequada às necessidades de produção.

Versionamento de Modelos

Figura 4: Painel de configuração do classificador de intenções mostrando as configurações do modelo e detalhes da versão.

Cada alteração de configuração cria automaticamente uma nova versão, mantendo um histórico completo. Os detalhes da versão mostram quando as alterações ocorreram, quem as fez e o armazenamento utilizado. A aba Valores exibe as configurações exatas, incluindo nome do modelo, parâmetros e versões das funções. Esse versionamento garante que qualquer teste possa ser repetido com configurações idênticas, permite acompanhar como o desempenho mudou ao longo do tempo e possibilita reverter para versões anteriores, se necessário.

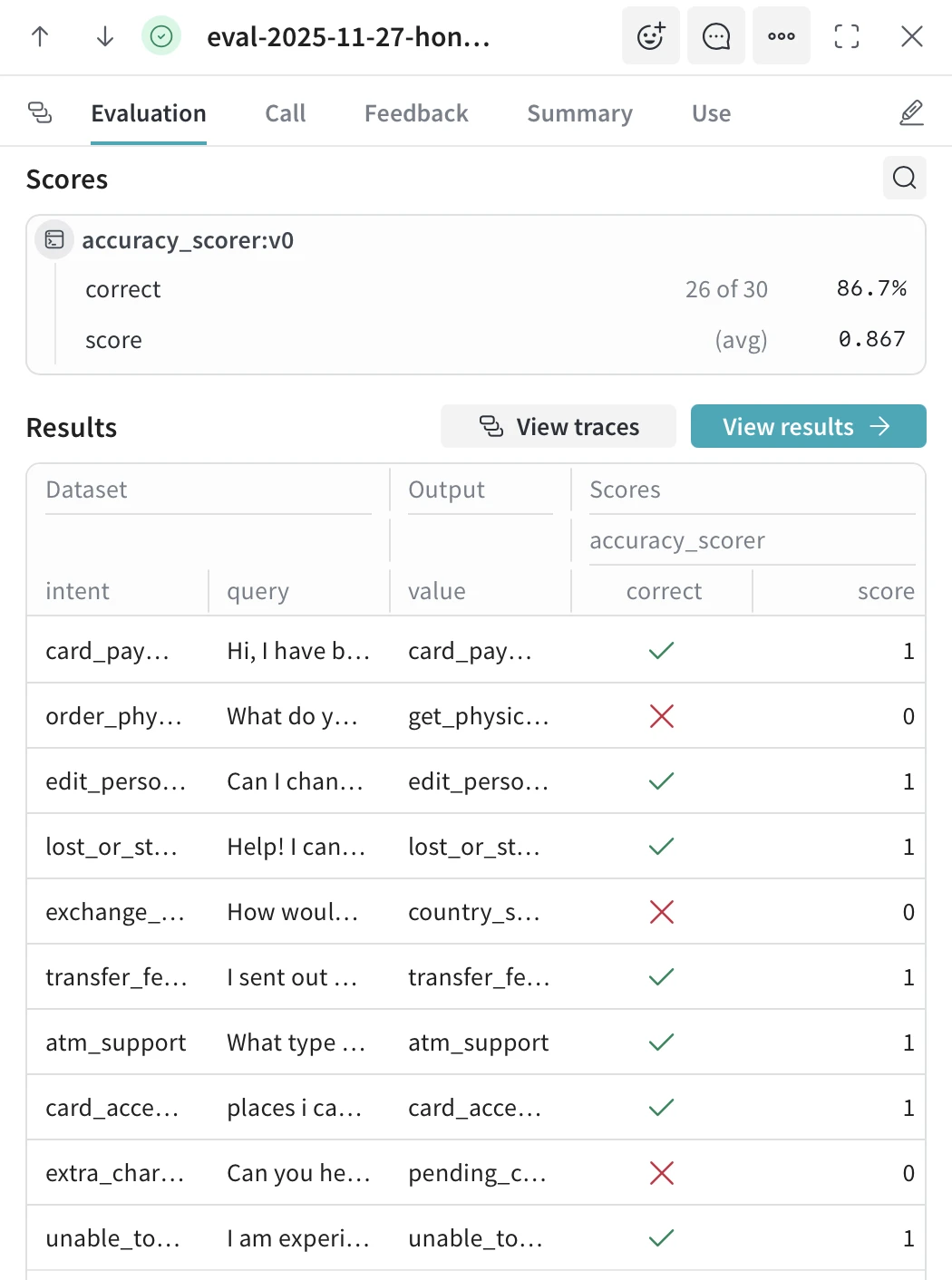

Resultados detalhados da avaliação

Figura 5: Resultados da avaliação mostrando casos de teste individuais com intenções previstas e pontuações de precisão.

Os resultados individuais dos testes são exibidos para cada amostra. A seção "Pontuações" resume o total de previsões corretas, a porcentagem de acerto e as pontuações personalizadas.

A tabela de Resultados exibe cada consulta com sua resposta esperada e a previsão do modelo, usando marcas de seleção para respostas corretas e X para respostas incorretas. Previsões incorretas são fáceis de identificar, frequentemente apresentando padrões como confusão entre categorias semelhantes.

Clicar em qualquer linha abre o rastreamento completo, incluindo o prompt, a resposta, a contagem de tokens e o tempo, facilitando a depuração de falhas e a melhoria dos prompts ou da seleção de modelos.

Langsmith

O LangSmith é a plataforma de observabilidade do LangChain para monitorar, depurar e avaliar aplicações LLM. Ele rastreia automaticamente cada chamada LLM, captura prompts e saídas, monitora custos e latência e permite a avaliação sistemática por meio de testes baseados em conjuntos de dados. O LangSmith integra-se nativamente ao LangChain, mas oferece suporte a qualquer aplicação LLM por meio de seu SDK.

Resultados da avaliação por amostra

Figura 6: Imagem mostrando a avaliação individual de cada caso de teste em relação às previsões e métricas de desempenho.

Os resultados de cada previsão são exibidos juntamente com os resultados esperados, permitindo identificar onde o modelo falha. A comparação entre as previsões esperadas e as reais revela confusões entre categorias semanticamente semelhantes. A latência por consulta e a contagem de tokens mostram quais tipos de entrada são mais custosos de processar, possibilitando a otimização de consultas lentas ou dispendiosas.

Monitoramento de volume e saúde de traços

Figura 7: Gráfico que mostra a visualização do progresso do projeto, acompanhando as taxas de sucesso e erro ao longo do tempo.

A saúde da aplicação é demonstrada por meio das tendências de volume de rastreamento e das taxas de sucesso/erro ao longo do tempo. Diferentes visualizações estão disponíveis para analisar chamadas LLM, tendências de custo, invocações de ferramentas ou pontuações de feedback. Problemas como picos de erros ou aumentos de custo tornam-se visíveis, indicando problemas que precisam ser investigados.

Comparação de modelos e configurações

Figura 8: Visão comparativa do experimento mostrando as métricas de desempenho em várias execuções de teste.

É possível comparar diferentes modelos lado a lado no mesmo conjunto de dados de teste. As relações de compromisso entre precisão, latência (P50/P99) e eficiência de tokens são exibidas visualmente. Identificar qual configuração melhor atende aos requisitos — seja maximizando a precisão ou minimizando o custo e o tempo de resposta — é simples por meio dessas comparações.

Langfuse

Langfuse é uma plataforma de observabilidade de código aberto para modelos de linguagem (LLM) projetada para monitorar, depurar e avaliar aplicações baseadas nesse modelo. Disponível tanto em versão auto-hospedada quanto em nuvem, o Langfuse oferece rastreamento abrangente com captura automática de prompts, saídas, custos e latência.

A plataforma é compatível com qualquer framework LLM através de seu SDK flexível e oferece recursos de avaliação integrados, incluindo o LLM como avaliador para avaliação automatizada da qualidade. O Langfuse rastreia versões de prompts em diferentes execuções, permitindo a comparação de métricas de desempenho entre diferentes formulações.

A coleta de feedback do usuário por meio de avaliações positivas e negativas ajuda a identificar resultados de alta e baixa qualidade, enquanto a pontuação personalizada permite o rastreamento de métricas específicas do aplicativo. As avaliações automatizadas podem processar milhares de rastreamentos em taxas de amostragem configuráveis, possibilitando o monitoramento contínuo da qualidade em escala, sem a necessidade de revisão manual de cada resultado.

Visualização detalhada do rastreamento

Figura 10: Registros de rastreamento mostrando detalhes da chamada da API com dados de desempenho e custo.

Os rastreamentos individuais exibem detalhes completos da execução de cada chamada LLM. A visualização do rastreamento mostra medições exatas de latência, consumo de tokens (tokens de prompt e de conclusão separadamente) e custos calculados por solicitação.

A configuração do modelo é preservada, incluindo temperatura, max_tokens e outros parâmetros. A seção de Pré-visualização exibe o prompt completo enviado ao modelo juntamente com a resposta completa, permitindo que você entenda precisamente o que o modelo recebeu e gerou.

Essa visibilidade granular permite a depuração de falhas específicas, examinando o par de entrada-saída exato que causou o erro.

Tabela de Visão Geral dos Traços

Figura 11: Inspeção de rastreamento individual mostrando detalhes da solicitação e resposta do modelo.

Todos os rastreamentos são agregados em uma tabela filtrável que exibe as saídas, os níveis de observação, a latência, o uso de tokens e os custos totais. Cada linha representa uma única chamada LLM, com níveis de observação codificados por cores que indicam a hierarquia ou a importância do rastreamento. A contagem de tokens exibe tanto os tokens de prompt quanto os de conclusão, juntamente com os totais, enquanto os cálculos de custo são calculados automaticamente com base no modelo utilizado.

O seletor de colunas permite a personalização das métricas exibidas, e os filtros possibilitam refinar os rastreamentos por ambiente, intervalo de tempo ou outros critérios. Essa visualização tabular facilita a identificação de padrões, como consultas consistentemente lentas ou solicitações inesperadamente dispendiosas.

Conselho de especialistas

Braintrust é uma plataforma de observabilidade para aprendizado de máquina que combina avaliação e monitoramento de produção. A plataforma permite testar modelos em conjuntos de dados, comparar diferentes prompts ou configurações e rastrear métricas de qualidade por meio de pontuação automatizada. Funções de avaliação integradas e personalizadas medem precisão, relevância ou critérios específicos do domínio, com os resultados exibidos em tabelas comparativas que mostram as diferenças de desempenho entre as versões.

Para monitoramento de produção, o Braintrust rastreia métricas em tempo real, incluindo latência, custo e pontuações de qualidade personalizadas, conforme o tráfego flui pelos aplicativos. Alertas são acionados quando os limites de qualidade são ultrapassados ou as salvaguardas de segurança são violadas. O Brainstore, sistema de armazenamento de logs da plataforma, ingere logs de aplicativos em escala com busca otimizada para interações de IA. O painel exibe métricas agregadas de experimentos e execuções em produção, capturando o rastreamento de custos, o uso de tokens e os metadados de resposta para solicitações de avaliação e produção.

Helicone

Helicone é uma plataforma de observabilidade baseada em proxy que monitora aplicações LLM roteando requisições de API através de seu servidor proxy. A integração requer apenas a alteração da URL base, sem necessidade de instalação de SDK ou modificações no código. A plataforma captura automaticamente requisições, respostas, custos e uso de tokens para monitorar o comportamento da aplicação.

O painel exibe o volume total de solicitações, os custos agregados e o consumo de tokens em todas as chamadas da API. Os registros de solicitações mostram os prompts de entrada completos e as saídas do modelo, permitindo a investigação de previsões ou erros específicos. O rastreamento de custos detalha os gastos por tipo de modelo, usuário ou tags personalizadas para identificar operações dispendiosas. O cache integrado detecta solicitações duplicadas e fornece respostas em cache, reduzindo os custos da API e os tempos de resposta. A limitação de taxa define limites de uso por usuário ou endpoint para evitar picos inesperados de gastos.

A plataforma concentra-se no monitoramento de chamadas de API individuais – cada solicitação aparece como uma entrada de log separada, sem suporte integrado para agrupar chamadas relacionadas ou visualizar sequências. Isso torna o Helicone prático para aplicações como chamadas LLM independentes (por exemplo, chatbots de interação única), geração de conteúdo em lote ou tarefas de classificação, mas menos adequado para rastrear fluxos de trabalho com várias etapas, onde a compreensão das relações entre chamadas sequenciais é importante.

O que é observabilidade LLM?

A observabilidade de modelos de linguagem de grande escala (LLM, na sigla em inglês) é a prática de coletar e interpretar dados contínuos de grandes modelos de linguagem para entender como eles se comportam durante o uso no mundo real. Ela se concentra na coleta de métricas, rastreamentos e registros que mostram como os LLMs respondem a diferentes estímulos, ferramentas e chamadas de API externas.

Como os modelos de linguagem operam por meio de raciocínio probabilístico, seus processos internos não podem ser inspecionados diretamente. Isso faz com que o monitoramento de modelos de linguagem de aprendizagem (LLM) dependa da revisão das saídas e entradas do LLM, bem como das etapas intermediárias presentes nos fluxos de trabalho de agentes . Ao estudar esses registros, os desenvolvedores de LLM obtêm visibilidade do desempenho do sistema, do comportamento do modelo e dos padrões de uso que influenciam o desempenho da aplicação e a qualidade da saída.

A observabilidade do LLM é vital por vários motivos:

- Garantia de qualidade: Grandes modelos de linguagem podem produzir resultados incorretos ou de baixa qualidade por uma ampla gama de razões, incluindo instruções pouco claras, dados inconsistentes ou comportamento inesperado do usuário. O monitoramento de instruções e respostas ao longo do tempo ajuda a acompanhar métricas de avaliação como correção, coerência, relevância e veracidade. Isso permite que as equipes detectem quando a qualidade das respostas dos modelos de linguagem começa a declinar ou quando o modelo começa a gerar informações incorretas . À medida que o uso de modelos de linguagem se expande nos fluxos de trabalho corporativos, garantir a precisão consistente torna-se um desafio comum.

- Solução de problemas: Quando ocorrem problemas em aplicativos LLM, as causas raiz podem vir de diversas áreas. Exemplos incluem prompts mal configurados, ajustes finos incorretos, falhas em chamadas de API externas ou erros de lógica em fluxos de trabalho de agentes com várias etapas. Ao coletar rastreamentos LLM que mostram as etapas intermediárias, os desenvolvedores podem realizar análises de causa raiz de forma eficiente e identificar o estágio exato em que o comportamento divergiu. Isso reduz a necessidade de intervenção humana e diminui o tempo de rastreamento de erros.

- Otimização: O monitoramento do desempenho do sistema, do uso de recursos e do uso de tokens ajuda as organizações a identificar gargalos e aprimorar o desempenho do LLM (Learning Learning Machine). As equipes podem medir latência, taxa de transferência, uso de memória e taxas de erro para entender como os LLMs se comportam sob diferentes níveis de carga. Elas também podem monitorar os tokens para controlar custos e analisar padrões de uso para melhorar o desempenho e a relação custo- benefício. O monitoramento contínuo dessas métricas-chave é especialmente valioso em fluxos de trabalho de geração e agentes com recuperação aprimorada , onde os gargalos de desempenho geralmente surgem de chamadas de ferramentas ineficientes ou viagens de ida e volta desnecessárias durante o raciocínio.

Categorias de métricas principais

As ferramentas de observabilidade do LLM normalmente agrupam as métricas relevantes em três categorias que dão suporte tanto às equipes de desenvolvimento de software quanto às equipes operacionais.

Métricas de desempenho do sistema

- Latência: mede o tempo decorrido entre o recebimento de um comando e o envio de uma resposta.

- Taxa de transferência: Indica quantas solicitações o modelo pode processar dentro de um determinado período.

- Taxas de erro: revelam com que frequência o sistema retorna respostas inválidas ou falhas.

Métricas de utilização de recursos

- Consumo de CPU e GPU: Ajuda a entender a eficiência com que o sistema utiliza o hardware.

- Utilização de memória: afeta as decisões de dimensionamento e o planejamento de capacidade.

- Utilização de tokens: influencia a eficiência de custos e ajuda as equipes a controlar os custos durante o uso intenso do LLM.

- Compromisso entre taxa de transferência e latência: Demonstre como o sistema equilibra velocidade e volume de processamento.

Métricas de comportamento do modelo

- Correção, factualidade e qualidade da resposta: para identificar resultados de baixa qualidade.

- Envolvimento e feedback do usuário: fornecem informações sobre o quão bem o modelo atende às necessidades do usuário.

- Métricas de fidelidade e fundamentação: refletem o quão fielmente o modelo adere ao material original.

Observabilidade manual versus autônoma

A dependência da observação manual apresenta diversos desafios. Grandes modelos de linguagem geram grandes volumes de dados, e cadeias de raciocínio com múltiplas etapas produzem inúmeros registros e rastreamentos. A necessidade de monitoramento em tempo real aumenta a complexidade operacional, e mesmo equipes experientes têm dificuldade em revisar cada chamada do modelo de linguagem sem perder sinais essenciais. Fluxos de trabalho manuais também dificultam o acompanhamento das mudanças contínuas no comportamento do usuário e das variações nos prompts.

Os sistemas autônomos de observabilidade abordam esses desafios utilizando agentes de software que analisam continuamente a atividade do LLM (sistema de monitoramento de longo prazo). Esses agentes detectam anomalias, diagnosticam problemas e realizam análises de causa raiz sem intervenção humana constante. As avaliações automatizadas também ajudam a identificar comportamentos de risco, como injeções imediatas.

Um sistema desse tipo oferece suporte ao monitoramento contínuo e garante o rastreamento consistente das métricas de avaliação em todo o modelo. Como resultado, as organizações se beneficiam de uma resolução de problemas mais rápida, melhor desempenho dos aplicativos e maior controle sobre os riscos operacionais.

Características das ferramentas de observabilidade LLM

Avaliações de qualidade e segurança

- Detecção de alucinações para identificar quando o modelo se desvia de dados confiáveis.

- Detecção rápida de injeção e jailbreak para solucionar problemas de segurança.

- Avaliação da toxicidade e da segurança que apoiam a conformidade e a redução de riscos.

- Agrupamento que reúne resultados semelhantes do modelo LLM para identificar desvios ao longo do tempo.

Características de experimentação

- Testes A/B para gerenciamento rápido e alterações de configuração.

- Comparação rápida entre múltiplos modelos ouparâmetros de LLM.

- Avaliação da precisão, do consumo de tokens e da latência antes da implementação.

- Testar alterações no modelo em cenários do mundo real usando dados semelhantes aos de produção.

Correlação com a infraestrutura

- Conectando rastreamentos LLM a dados de monitoramento de desempenho de aplicativos de backend.

- Vincular o tempo de resposta e a qualidade da resposta às sessões reais dos usuários.

- Identificar como o desempenho do sistema afeta o desempenho do LLM e a estabilidade do aplicativo.

LLMOps e governança

- Mecanismos de proteção que filtram avisos inseguros e bloqueiam respostas prejudiciais.

- Painéis de controle para monitorar a exposição a informações pessoais identificáveis, alucinações e violações de segurança.

- Ferramentas que auxiliam na conformidade, na elaboração de relatórios e na análise de incidentes de segurança.

Observabilidade para fluxos de trabalho agentes

À medida que os LLMs (Loading Learning Machines) impulsionam fluxos de trabalho de agentes com várias etapas, os requisitos de observabilidade se expandem para além de pares simples de solicitação-resposta. Os aplicativos com agentes introduzem camadas adicionais de complexidade que exigem abordagens de rastreamento dedicadas.

Principais dimensões de observabilidade para agentes:

- Rastreamento de planejamento e raciocínio: Visibilidade de como o agente decompõe tarefas, seleciona ações e refina sua abordagem com base em resultados intermediários.

- Monitoramento de chamadas de ferramentas: Rastreamento de chamadas de API externas, consultas de banco de dados e execuções de funções para identificar gargalos de latência ou falhas.

- Rastreamento de transferência: Para sistemas multiagentes, monitorar como as tarefas são transferidas entre os agentes e se o contexto é preservado corretamente.

- Evolução do estado: Compreendendo como a memória e o contexto mudam ao longo de múltiplas interações dentro de uma sessão.

Em conjunto, essas dimensões formam a base do monitoramento de agentes . Ferramentas de observabilidade LLM, como Langsmith, Langfuse, AgentOps e Weights & Biases, fornecem visualizações de rastreamento específicas para cada agente, exibindo gráficos de execução completos.

Perguntas frequentes

Uma boa solução de observabilidade permite a observação abrangente de todo o ciclo de vida das chamadas de LLM (Learning Learning Machine). Isso inclui como um modelo recebe uma solicitação, seleciona ferramentas, recupera dados de uma fonte de dados e gera uma resposta final. A observabilidade é importante porque os aplicativos de LLM continuam a crescer em complexidade e o número de aplicativos baseados em LLM que dependem de raciocínio em várias etapas aumenta drasticamente. Como resultado, as organizações precisam de ferramentas de observabilidade que forneçam monitoramento em tempo real e avaliação automatizada para garantir um desempenho consistente em todos os aplicativos de LLM.

As ferramentas modernas de observabilidade de LLM visam fornecer uma visão geral detalhada de cada ação em aplicativos baseados em LLM. Isso inclui o rastreamento de cada chamada de LLM, cada interação com a ferramenta e cada etapa intermediária que aparece em uma cadeia de raciocínio agentivo. A capacidade de observar todo o fluxo de trabalho, desde a solicitação até a resposta final, ajuda as equipes a detectar comportamentos inesperados e a entender como os modelos de LLM tomam decisões.

A análise de custos e tokens também se tornou essencial. O monitoramento em tempo real do uso de tokens ajuda as organizações a manter a eficiência de custos e evitar picos inesperados de gastos. As equipes podem detalhar o uso de tokens por provedor, modelo, recurso ou caminho de aplicação para entender como diferentes componentes contribuem para o custo. Algumas ferramentas de observabilidade permitem que os usuários comparem vários provedores de LLM lado a lado, auxiliando nas decisões de desempenho e custo-benefício ao rotear solicitações entre LLMs de código aberto e opções proprietárias.

Em todo o ecossistema, as ferramentas de observabilidade consistentemente definem a observabilidade de modelos de aprendizagem de linha de comando (LLM) como um requisito para a operação de aplicações LLM em escala. Equipes que dependem de fluxos de trabalho de agentes precisam de visibilidade sobre como o modelo percorre o raciocínio em várias etapas e como cada decisão afeta o desempenho do modelo. A observabilidade ajuda a garantir respostas consistentes e de alta qualidade, detectar falhas precocemente e manter a confiança do usuário.

Outro tema importante é a necessidade de gerenciar os custos operacionais. O monitoramento do uso de tokens, memória e métricas de utilização de recursos ajuda as organizações a controlar os gastos, mantendo o desempenho e a eficiência de custos. A observabilidade também revela gargalos de desempenho que influenciam a satisfação do usuário e o desempenho do aplicativo.

Por fim, a observabilidade do LLM é importante porque as organizações dependem cada vez mais de modelos LLM para funções críticas. À medida que esses sistemas se expandem, as ferramentas de monitoramento devem ser independentes de frameworks, capazes de se integrar a plataformas de código aberto e de fornecer insights em diversos serviços. Isso facilita a implantação segura, reduz as preocupações com segurança e ajuda as equipes a compreender os resultados do modelo em um contexto operacional mais amplo.

Seja o primeiro a comentar

Seu endereço de e-mail não será publicado. Todos os campos são obrigatórios.