Os grandes modelos de visão (LVMs, na sigla em inglês) podem automatizar e aprimorar tarefas visuais, como detecção de defeitos, diagnóstico médico e monitoramento ambiental .

Avaliamos três modelos de detecção de objetos: YOLOv8n, DETR e Vision, em 1.000 imagens cada, medindo métricas como mAP@0.5, velocidade de inferência, FLOPs e número de parâmetros. Para garantir uma comparação justa, todas as imagens foram redimensionadas para 800×800 pixels e avaliadas usando pré-processamento, limiares de confiança e critérios de correspondência baseados em IoU idênticos.

Benchmark de detecção de objetos: GPT-4o (Visão), YOLOv8n, DETR

mAP@0.5: Precisão média (mAR) em um limiar de Interseção sobre União (IoU) de 0,5, que mede a precisão da detecção de objetos equilibrando verdadeiros positivos e falsos positivos.

Latência (ms): O tempo médio de processamento por imagem, medido em milissegundos, indica a velocidade do modelo.

Resultados de referência

As capacidades de detecção de objetos do GPT-4o permanecem limitadas em comparação com modelos especializados como YOLOv8n e DETR .

Precisão:

- DETR: mAP@0,5 = 0,55

- YOLOv8n: 0,20

- GPT-4o: 0,02

Esses resultados indicam que GPT-4o ainda não é adequado para tarefas práticas de detecção de objetos.

Latência:

- YOLOv8n: 365 ms

- DETR: 3145 ms

- GPT-4o: 5150 ms

O YOLOv8n oferece a inferência mais rápida, porém com menor precisão, enquanto o DETR alcança melhor precisão ao custo de um processamento mais lento.

Todos os modelos foram avaliados usando imagens de entrada de 800×800 para garantir consistência. A contagem de parâmetros e o número de FLOPS estavam disponíveis para YOLOv8n e DETR, mas não para GPT-4o, o que impede uma comparação completa da eficiência computacional.

Complexidade do modelo:

- DETR: 41,52 milhões de parâmetros , 59,56 GFLOPS

- YOLOv8n: 3,15 milhões de parâmetros , 6,83 GFLOPS

Isso demonstra a eficiência do YOLOv8n para aplicações em tempo real, enquanto o DETR troca velocidade por maior precisão e maior demanda computacional. A falta de detalhes arquitetônicos para GPT-4o limita uma análise de eficiência mais aprofundada.

Consulte nossa metodologia de avaliação comparativa .

Possíveis razões para as diferenças de desempenho

Os três modelos apresentaram diferentes níveis de precisão e velocidade porque foram desenvolvidos para propósitos distintos e processam informações visuais de maneiras diferentes. O GPT-4o é um modelo de linguagem multimodal de grande porte que aceita tanto texto quanto imagens, enquanto o YOLOv8n e o DETR são sistemas de detecção de objetos que operam apenas com imagens.

O GPT-4o interpreta entradas visuais por meio de um mecanismo de raciocínio baseado em linguagem. Ele pode descrever cenas e identificar objetos, mas não foi projetado para desenhar caixas delimitadoras ou realizar localização espacial de alta precisão.

Seus resultados dependem de raciocínio multimodal em vez de mecanismos específicos de detecção. Isso o torna mais lento e menos preciso para tarefas de detecção.

YOLOv8n e DETR usam arquiteturas criadas especificamente para detecção de objetos. Elas geram caixas delimitadoras diretamente, em vez de raciocinar sobre elas.

O YOLOv8n é otimizado para velocidade com uma estrutura leve, enquanto o DETR é um detector baseado em transformadores que processa imagens de forma diferente do YOLO e visa previsões mais precisas.

Ambos os modelos se concentram exclusivamente em entradas visuais e seguem objetivos de treinamento que mapeiam padrões de imagem para localizações de objetos.

As principais diferenças incluem:

- Tipo de entrada

- GPT-4o: imagem e texto

- YOLOv8n e DETR: somente imagem

- Função principal

- GPT-4o: compreensão e raciocínio multimodal

- YOLOv8n e DETR: detecção de objetos

- Mecanismo de saída

- GPT-4o: não desenha caixas delimitadoras inerentemente

- YOLOv8n e DETR: preveem diretamente caixas delimitadoras

Como o YOLOv8n e o DETR foram desenvolvidos exclusivamente para detecção de objetos, eles naturalmente apresentam melhor desempenho em benchmarks focados em precisão e latência.

O design multimodal amplo e não centrado na detecção de GPT-4o resulta em mAP mais baixo e tempos de inferência mais altos quando avaliado no mesmo cenário.

Avaliação detalhada de modelos de visão de grande porte

OpenAI GPT-4o (Visão)

GPT-4o (Visão) é uma extensão multimodal de OpenAI de GPT-4, projetada para processar e gerar respostas a partir de texto e imagens.

Essa capacidade permite que o GPT-4o interprete conteúdo visual juntamente com informações textuais, possibilitando uma gama de aplicações que exigem a compreensão e análise de imagens.

- Interpretação de imagens: GPT-4o pode analisar e descrever o conteúdo de imagens, incluindo a identificação de objetos, a interpretação de cenas e a extração de informações textuais de elementos visuais. Isso a torna útil para tarefas como legendagem de imagens e sumarização de conteúdo.

- Análise visual de dados: O modelo consegue interpretar gráficos, tabelas e diagramas, fornecendo insights e explicações com base em dados visuais. Essa funcionalidade é benéfica para aplicações de análise de dados e educação.

- Compreensão de conteúdo multimodal: GPT-4o pode fornecer respostas mais abrangentes ao combinar entradas de texto e imagem. Também pode aprimorar aplicações em análise de mídias sociais e moderação de conteúdo. Por exemplo, pode avaliar o sentimento ou detectar desinformação em postagens que incluem texto e imagens.

Apesar de suas capacidades avançadas, o GPT-4o pode, por vezes, produzir resultados imprecisos ou não confiáveis. Ele pode interpretar elementos visuais incorretamente, ignorar detalhes ou gerar informações erradas, exigindo verificação humana para tarefas críticas.

O modelo também pode refletir vieses presentes em seus dados de treinamento, levando a interpretações distorcidas ou reforçando estereótipos. Isso é preocupante em aplicações sensíveis onde a imparcialidade é crucial, incluindo inferência demográfica ou moderação de conteúdo.

OpenAI Sora

Sora é um modelo de texto para vídeo criado por OpenAI. Ele gera pequenos videoclipes a partir de comandos do usuário e também pode estender vídeos existentes. Sua tecnologia subjacente é uma adaptação do modelo DALL-E 3.

Sora é um transformador de difusão, um modelo de difusão latente para redução de ruído que utiliza um Transformer. Os vídeos são inicialmente gerados em um espaço latente através da redução de ruído em "patches" 3D, e então convertidos para o espaço padrão utilizando um descompressor de vídeo.

A relegendagem é usada para aprimorar o processo de treinamento, no qual um modelo de vídeo para texto gera legendas detalhadas para vídeos.

Com os últimos avanços, os usuários agora podem gerar vídeos com resolução de até 1080p, duração máxima de 20 segundos e em formatos widescreen, vertical ou quadrado. Eles também podem incorporar seus próprios recursos para estender, remixar e mesclar conteúdo existente ou criar novos vídeos a partir de instruções de texto.

Figura 1: Exemplo de geração de vídeo de Sora usando a seguinte instrução: “Uma cena ampla e serena de uma família de mamutes-lanosos em um deserto aberto”. 1

Pouso com IA LandingLens

A LandingLens simplifica o desenvolvimento e a implementação de modelos de visão computacional. Ela atende a diversos setores sem exigir conhecimento profundo em IA ou programação complexa.

A plataforma padroniza soluções de aprendizado profundo, reduzindo o tempo de desenvolvimento e permitindo a fácil escalabilidade global de projetos. Sem afetar a velocidade de produção, os usuários podem criar seus próprios modelos de aprendizado profundo e otimizar a precisão das inspeções.

Oferece uma interface de usuário passo a passo que simplifica o processo de desenvolvimento.

Figura 2: O diagrama ilustra o fluxo de trabalho de IA do LandingLens, onde as imagens de entrada são processadas em dados, usados para treinar modelos, implantados via nuvem, edge ou Docker e continuamente aprimorados por meio de feedback. 2

Difusão estável

A Difusão Estável é um modelo de aprendizado profundo projetado para criar imagens de alta qualidade a partir de descrições textuais:

- A Difusão Estável baseia-se na difusão. O processo começa adicionando ruído aleatório a uma imagem, e o modelo então aprende a reconstruir a imagem original revertendo esse ruído.

- Esse processo permite que o modelo gere imagens completamente novas, refinando a entrada ruidosa em várias etapas até que uma imagem clara e coerente surja.

O Stable Diffusion utiliza um modelo de difusão latente para melhorar a eficiência. Em vez de trabalhar diretamente com imagens de alta resolução, ele primeiro as comprime em um espaço latente de menor dimensão usando um autoencoder variacional (VAE).

Essa abordagem reduz significativamente as demandas computacionais, permitindo a execução em hardware de consumo com GPUs.

Aplicações:

Além de gerar imagens a partir de texto, o Stable Diffusion pode ser usado para diversas tarefas criativas, como:

- Retoque: Restauração ou preenchimento de partes faltantes de uma imagem.

- Outpainting: Expansão das bordas de uma imagem para adicionar mais conteúdo.

- Tradução de imagem para imagem: Converter uma imagem existente para um estilo diferente ou modificar sua aparência com base em um texto inserido.

Meio da jornada

Midjourney é um gerador de arte que converte descrições de texto em imagens de alta qualidade.

Capacidades

A versão 7 do Midjourney apresenta uma arquitetura completamente reconstruída com melhorias significativas em qualidade e funcionalidade.

Geração de imagens : O V7 produz imagens ampliadas em 2048 x 2048 pixels com excepcional precisão e qualidade quase fotográfica. As principais melhorias incluem texturas mais ricas, renderização precisa de elementos complexos como mãos e rostos, e compreensão sofisticada de iluminação e composição.

Geração de vídeo : Cria videoclipes de 5 a 21 segundos com alta consistência quadro a quadro. O sistema gera aproximadamente 60 segundos de vídeo a partir de seis imagens em cerca de três horas, sendo voltado para aplicações profissionais em marketing, produção cinematográfica e criação de conteúdo.

Recursos 3D : A geração de texto para 3D usando modelagem semelhante à do NeRF cria objetos volumétricos e cenas imersivas. Esses recursos são úteis para desenvolvimento de jogos, visualização de produtos e aplicações arquitetônicas.

Figura 3: Recurso de edição de imagens do Midjourney. 3

DeepMind Flamingo

O Flamingo da DeepMind é um modelo de visão e linguagem projetado para entender e raciocinar sobre imagens e vídeos usando exemplos de treinamento mínimos (aprendizado com poucos exemplos). Aqui estão alguns dos principais recursos:

- Aprendizado multimodal com poucos exemplos: o Flamingo consegue executar novas tarefas de forma eficiente com apenas alguns exemplos, ao contrário dos modelos de IA tradicionais que exigem extensos conjuntos de dados rotulados.

- Mecanismo de Reamostragem do Perceptor: O Flamingo utiliza um "Reamostrador do Perceptor" para processar entradas visuais de forma eficiente. Ele comprime dados de imagem e vídeo em um formato que pode ser integrado a um modelo de linguagem pré-treinado de grande porte.

- Alinhamento visão-linguagem com camadas de atenção cruzada controladas: Camadas especiais de atenção cruzada controladas ajudam o Flamingo a alinhar e integrar dados visuais com raciocínio textual. Essa aplicação pode ser importante para a compreensão de conversas baseadas em imagens.

O Flamingo utiliza processamento quadro a quadro, decompondo vídeos em quadros-chave e extraindo informações para analisar elementos visuais de forma eficiente.

Suas respostas contextuais ajudam a gerar legendas, descrições e respostas com base na progressão dos eventos dentro de um vídeo, garantindo uma compreensão coerente do conteúdo.

Além disso, o Flamingo demonstra raciocínio temporal para compreender sequências, relações de causa e efeito e interações complexas ao longo do tempo. Isso o torna altamente eficaz para análise de vídeo e tarefas de raciocínio multimodal.

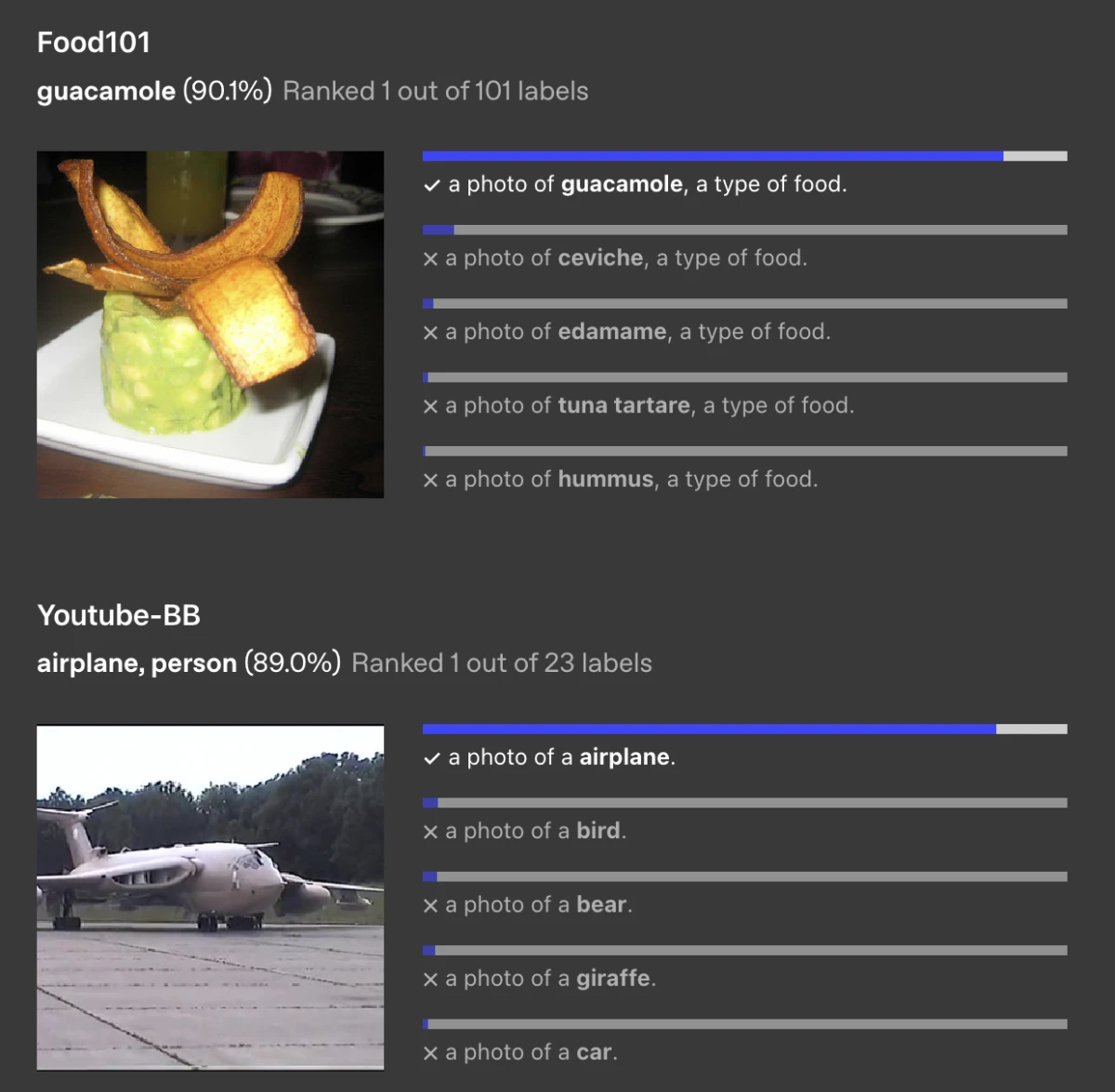

CLIP (Pré-treinamento Contrastivo de Linguagem e Imagem) de OpenAI

CLIP é uma rede neural treinada com uma variedade de imagens e legendas de texto.

Este modelo consegue executar diversas tarefas de visão computacional, incluindo classificação zero-shot, ao compreender imagens no contexto da linguagem natural.

O CLIP é treinado com 400 milhões de pares (imagem, texto) para efetivamente preencher a lacuna entre tarefas de visão computacional e processamento de linguagem natural. Isso ajuda o CLIP a fazer previsões de legendas ou resumos de imagens sem ser explicitamente treinado para essas tarefas específicas.

Figura 4: Identificação de imagens por CLIP a partir de vários conjuntos de dados. 4

Transformador de Visão (ViT) de Google

O Vision Transformer aplica a arquitetura Transformer, originalmente usada no processamento de linguagem natural, a tarefas de reconhecimento de imagem .

Ele processa imagens de maneira semelhante à forma como os Transformers processam sequências de palavras e demonstrou eficácia na aprendizagem de características relevantes a partir de dados de imagem para tarefas de classificação e análise.

No Vision Transformer, as imagens são tratadas como uma sequência de patches. Cada patch é transformado em um único vetor, de forma semelhante ao uso de word embeddings em transformers para texto.

Essa abordagem permite que o ViT aprenda a estrutura da imagem e preveja os rótulos de classe de forma independente.

modelos de base nativos de vídeo

Os modelos de base nativos de vídeo representam uma mudança fundamental em relação às abordagens tradicionais de visão computacional. Ao contrário dos sistemas anteriores que processavam vídeos como sequências de quadros independentes, esses modelos tratam o tempo como uma dimensão integral dos dados visuais.

Principais inovações arquitetônicas

O Sora de OpenAI exemplifica essa evolução por meio de sua arquitetura de transformador de difusão:

- Patches espaço-temporais 3D : Processa dados de vídeo de forma holística, em vez de quadro a quadro.

- Consistência temporal : Mantém a qualidade visual e a coerência narrativa ao longo das sequências.

- Dependências de longo alcance : Captura relações de causa e efeito e padrões de movimento.

- Geração com reconhecimento de física : Compreende movimentos realistas e interações entre objetos.

Aplicações atuais

Criação de conteúdo:

- Edição de vídeo automatizada e síntese de cenas

- Transferência de estilo com consistência temporal

- Geração de vídeos narrativos a partir de instruções de texto.

Imagens médicas:

- Análise do movimento cardíaco em ecocardiogramas

- Visualização do fluxo sanguíneo em angiografia

- Avaliação do comportamento dinâmico do tecido

Segurança e vigilância:

- Reconhecimento e rastreamento de atividades

- detecção de Anomaly ao longo do tempo

- Análise comportamental sensível ao contexto

Desafios restantes

Apesar dos progressos, várias limitações persistem:

- Custo computacional : A geração de vídeos de longa duração continua a exigir muitos recursos.

- Plausibilidade física : Cenários complexos podem produzir resultados físicos irreais.

- Consistência de personagem : Manter a identidade ao longo de sequências extensas é difícil.

- Requisitos de treinamento : Conjuntos de dados de vídeo em larga escala com anotações são escassos e caros.

Inferência no dispositivo e otimização de borda

A implantação na borda permite que os modelos de visão sejam executados localmente em smartphones, dispositivos IoT e sistemas embarcados, eliminando a dependência da infraestrutura em nuvem.

Por que a implantação na borda é importante

Benefícios para a privacidade:

- Os dados visuais sensíveis nunca saem do dispositivo.

- Essencial para aplicações em saúde, vigilância e uso pessoal.

- Conformidade com os regulamentos de proteção de dados

Vantagens de desempenho:

- Latência próxima de zero, sem necessidade de viagens de ida e volta na rede.

- Processamento em tempo real para realidade aumentada e sistemas autônomos.

- Operação confiável em ambientes offline

Relação custo-benefício:

- Consumo de largura de banda reduzido

- Redução dos custos de computação em nuvem

- Custos operacionais contínuos mínimos

Técnicas de compressão de modelos

Para que grandes modelos de visão computacional sejam viáveis em dispositivos de borda, é necessária uma otimização sofisticada:

- Quantização : Reduz a precisão de inteiros de 32 bits para 8 bits ou 4 bits.

- Tamanho do modelo menor

- Perda mínima de precisão

- Poda : Remove parâmetros e conexões redundantes.

- Cria redes esparsas

- Mantém o desempenho com menos cálculos.

- Destilação de conhecimento : Transfere conhecimento de modelos grandes para modelos pequenos.

O que é um modelo de visão de grande porte (LVM)?

Os grandes modelos de visão (LVMs, na sigla em inglês) são projetados para processar, analisar e interpretar dados visuais, como imagens ou vídeos. Eles são caracterizados por seu extenso número de parâmetros, frequentemente na casa dos milhões ou bilhões. Isso lhes permite aprender padrões, características e relações complexas no conteúdo visual.

Assim como os grandes modelos de linguagem (LLMs) para texto, os LVMs são treinados em vastos conjuntos de dados, o que os equipa com capacidades de reconhecimento de objetos, geração de imagens, compreensão de cenas e raciocínio multimodal (integrando informações visuais e textuais).

Esses modelos podem dar suporte a aplicações em áreas como direção autônoma, imagens médicas , criação de conteúdo e realidade aumentada .

Estrutura e design

Modelos de visão de grande porte são construídos usando arquiteturas avançadas de redes neurais. Originalmente, as Redes Neurais Convolucionais (CNNs) predominavam no processamento de imagens devido à sua capacidade de lidar eficientemente com dados de pixels e detectar padrões hierárquicos.

Recentemente, os modelos Transformer, inicialmente projetados para processamento de linguagem natural , também foram adaptados para diversas tarefas de visão computacional, oferecendo melhor desempenho em alguns cenários.

Treinamento

O treinamento de grandes modelos de visão computacional envolve alimentá-los com dados visuais, como imagens ou vídeos da internet, juntamente com rótulos ou anotações relevantes, em uma nova abordagem de modelagem sequencial. Os treinadores rotulam bibliotecas de imagens para alimentar os modelos.

Por exemplo, em tarefas de classificação de imagens , cada imagem é rotulada com a classe à qual pertence. O modelo aprende ajustando seus parâmetros para minimizar a diferença entre suas previsões e os rótulos reais.

Esse processo exige poder computacional significativo e um conjunto de dados amplo e diversificado para garantir que o modelo possa ser generalizado bem para dados novos e não vistos anteriormente.

Figura 3: Diagrama de treinamento de modelos de visão grandes em OpenAI. 5

Consulte os serviços de coleta de dados de imagem para saber mais sobre dados de treinamento para classificação de imagens.

Principais características de modelos de visão de grande porte

O Tipo de Modelo refere -se à arquitetura e aos princípios de design de um modelo de visão. Ele define como o modelo processa e interpreta dados visuais, se integra múltiplas modalidades (por exemplo, texto e imagens) e quais mecanismos subjacentes (por exemplo, transformadores, aprendizagem contrastiva, difusão) ele emprega para extrair representações significativas.

- Modelo de Aprendizado de Liderança Multimodal baseado em Transformers: Uma arquitetura de modelo que combina Transformers com capacidades multimodais. Permite o processo de compreensão simultânea de entradas visuais e textuais. É treinado usando conjuntos de dados em larga escala para realizar raciocínio complexo em múltiplos tipos de dados.

- Aprendizado Contrastivo: Uma técnica usada no treinamento de modelos para diferenciar entre pontos de dados semelhantes e diferentes. Esse processo envolve maximizar a similaridade de entradas relacionadas e minimizar a similaridade de entradas não relacionadas. É frequentemente usado em aprendizado autossupervisionado para melhorar a representação de características.

- Plataforma de Visão Computacional com IA: Este sistema fornece infraestrutura, ferramentas e modelos pré-treinados para diversas tarefas de visão computacional, como reconhecimento de imagem , detecção de objetos e segmentação. Normalmente, inclui recursos de treinamento, implantação e inferência de modelos.

- Transformer: Uma arquitetura de aprendizado profundo que utiliza mecanismos de autoatenção para processar dados de entrada. Ela permite que os modelos capturem dependências de longo alcance, tornando-a eficaz para tarefas relacionadas à linguagem natural e visão computacional.

- Modelo de Difusão: Um modelo generativo que remove gradualmente o ruído de uma entrada inicial ruidosa e a refina passo a passo para produzir uma saída clara e estruturada. É comumente usado para geração e aprimoramento de imagens .

Objetivo de treinamento: A função de otimização ou meta que orienta como um modelo aprende com os dados. Ela determina como o modelo ajusta seus parâmetros internos durante o treinamento para melhorar o desempenho em tarefas específicas. Essas tarefas incluem prever o próximo ponto de dados (autorregressivo), distinguir entradas semelhantes/diferentes (aprendizado contrastivo) ou classificar imagens em categorias.

- Autorregressivo: Uma abordagem de treinamento em que um modelo prevê o próximo ponto de dados em uma sequência com base em entradas observadas anteriormente. Isso é frequentemente usado em modelagem de linguagem e modelos de visão generativa.

- Aprendizado Contrastivo: Um objetivo de aprendizado autossupervisionado em que o modelo aprende distinguindo entre pares de dados semelhantes e diferentes. Isso ajuda a melhorar a capacidade de capturar representações significativas sem rótulos explícitos.

- Aprendizado Supervisionado: Um paradigma de aprendizado onde o modelo é treinado usando dados rotulados, o que significa que cada entrada está associada a uma saída correta correspondente. Essa abordagem é amplamente utilizada em tarefas como classificação e segmentação.

- Classificação de Imagens: Um objetivo de treinamento específico no qual um modelo aprende a categorizar imagens em classes predefinidas com base em características visuais. O processo de treinamento envolve a otimização de uma função de perda para maximizar a precisão da classificação.

- Difusão de Remoção de Ruído: Uma abordagem de aprendizado generativo onde um modelo é treinado para recuperar imagens limpas a partir de entradas ruidosas. Este processo envolve a reversão de um processo progressivo de adição de ruído para melhorar a reconstrução e geração de imagens.

Suporte para ajuste fino: a capacidade de um modelo ser adaptado a tarefas específicas por meio do treinamento em conjuntos de dados menores e específicos do domínio, mantendo o conhecimento da fase de pré-treinamento.

O ajuste fino ajuda a melhorar o desempenho em aplicações especializadas.

Aprendizado Zero-shot/Few-shot: A capacidade de um modelo executar tarefas com poucos ou nenhum dado de treinamento específico para a tarefa.

O aprendizado zero-shot permite inferências em categorias não vistas, enquanto o aprendizado few-shot possibilita a adaptação com um número mínimo de exemplos rotulados.

Suporte multimodal: a capacidade de um modelo processar e integrar informações de múltiplas modalidades (por exemplo, texto, imagens, áudio).

Código aberto vs. Proprietário: Os modelos de código aberto têm código e pesos disponíveis publicamente, permitindo modificação e implementação pela comunidade.

Os modelos proprietários são detidos e controlados por entidades privadas, podendo limitar o acesso e a personalização.

Implantação na borda: a capacidade de um modelo ser executado em dispositivos de borda (por exemplo, telefones celulares, dispositivos IoT) em vez de depender de servidores baseados em nuvem.

A implantação na borda da rede ajuda a reduzir a latência, aumenta a privacidade e permite o processamento em tempo real em ambientes com recursos limitados.

Quais são os casos de uso de modelos de visão de grande escala?

Assistência médica e diagnóstico por imagem

- Diagnóstico de doenças : Detecção de doenças a partir de imagens médicas, como raios-X, ressonâncias magnéticas ou tomografias computadorizadas, para identificar tumores, fraturas ou anormalidades.

- Patologia : Análise de amostras de tecido em patologia para detecção de sinais de câncer.

- Oftalmologia : Diagnóstico de doenças a partir de imagens da retina.

Veículos autônomos e robótica

- Navegação e detecção de obstáculos : Auxiliando veículos autônomos e drones a navegar e evitar obstáculos através da interpretação de dados visuais em tempo real.

- Robótica na manufatura : Auxiliando robôs em tarefas de triagem, montagem e inspeção de qualidade.

Segurança e vigilância

- Monitoramento de atividades : análise de transmissões de vídeo para detectar comportamentos incomuns ou suspeitos.

- Reconhecimento facial : Utilizado em sistemas de segurança para verificação e rastreamento de identidade. Por exemplo, o Amazon Rekognition é um serviço em nuvem oferecido pela AWS que fornece recursos de análise de imagem e vídeo, como detecção e reconhecimento facial, identificação de objetos e cenas e extração de texto. Ele pode analisar emoções, faixas etárias e atividades, o que seria útil para personalização e segurança.

Veja o vídeo abaixo para ver o Amazon Rekognition em ação. 6

Varejo e comércio eletrônico

- Busca visual : Permite que os clientes pesquisem produtos usando imagens em vez de texto.

- Gestão de inventário : Automatizando o monitoramento e a gestão de estoque por meio do reconhecimento visual.

Agricultura

- Monitoramento e análise de culturas : Monitoramento da saúde e do crescimento das culturas usando drones ou imagens de satélite.

- Detecção de pragas : Identificação de pragas e doenças que afetam as plantações.

Monitoramento ambiental

- Rastreamento da vida selvagem : Identificação e rastreamento de animais selvagens para apoiar os esforços de conservação.

- Análise de uso e cobertura da terra : Monitoramento das mudanças no uso da terra e na cobertura vegetal ao longo do tempo.

Criação de conteúdo e entretenimento

- Edição de filmes e vídeos : Automatizando os processos de edição e pós-produção de vídeo.

- Desenvolvimento de jogos : Aprimorando o realismo do ambiente e a criação de personagens.

- Aprimoramento de fotos e vídeos : Melhoria da qualidade de imagens e vídeos.

- Moderação de conteúdo : Detecção e sinalização automática de conteúdo visual inadequado ou prejudicial.

Quais são os desafios dos modelos de visão em larga escala?

Recursos computacionais

O treinamento e a implantação desses modelos exigem poder computacional e memória significativos, o que pode torná-los bastante dispendiosos em termos de recursos.

Requisitos de dados

Eles precisam de conjuntos de dados vastos e diversificados para treinamento. Coletar, rotular e processar conjuntos de dados tão grandes pode ser desafiador e caro. No entanto, empresas de crowdsourcing podem ajudar a lidar com isso .

Parcialidade e imparcialidade

Os modelos podem herdar vieses presentes em seus dados de treinamento, levando a resultados injustos ou antiéticos, particularmente em aplicações sensíveis como o reconhecimento facial.

Interpretabilidade e explicabilidade

Entender como esses modelos tomam decisões pode ser difícil, o que preocupa em aplicações onde a transparência é fundamental. Confira o conceito de IA explicável para aprender como esse processo funciona e como ele contribui para a ética da IA.

Generalização

Embora apresentem bom desempenho com dados semelhantes ao conjunto de treinamento, podem ter dificuldades com tipos de dados completamente novos ou diferentes.

preocupações com a privacidade

A utilização de modelos visuais de grande escala, especialmente em vigilância e reconhecimento facial, levanta preocupações significativas em relação à privacidade .

Desafios regulatórios e éticos

Garantir que esses modelos estejam em conformidade com os padrões legais e éticos é cada vez mais importante, principalmente à medida que se integram mais à sociedade.

Metodologia de referência para detecção de objetos

Neste teste comparativo, os desempenhos dos modelos de detecção de objetos YOLOv8n, DETR (DEtection TRansformer) e Vision foram comparados no conjunto de dados de validação COCO 2017. Foram utilizadas 1000 imagens por modelo para a comparação. Todas as imagens foram redimensionadas para 800×800 pixels para garantir dimensões de entrada consistentes entre os modelos.

O modelo YOLOv8n foi carregado com pesos pré-treinados (yolov8n.pt) do repositório Ultralytics e a inferência foi realizada usando o método predict() por meio da API YOLO da Ultralytics. O modelo DETR foi carregado com a arquitetura detr_resnet50 da biblioteca Facebook Research e suas saídas, originalmente normalizadas no formato [center_x, center_y, width, height], foram reescalonadas e convertidas para o formato de coordenadas [x1, y1, x2, y2]. Um limiar de confiança de 0,5 foi aplicado aos resultados de ambos os modelos.

O modelo de visão GPT-4o foi avaliado usando a API de OpenAI para recursos de detecção de objetos. Para este modelo, as imagens do conjunto de dados de validação COCO foram baixadas, as anotações foram carregadas e cada imagem foi convertida para o formato apropriado (redimensionada para 800×800 pixels) antes de ser enviada para a API. Somente as detecções pertencentes às classes COCO foram solicitadas em formato JSON, e as previsões retornadas pela API foram avaliadas usando o mesmo limiar de confiança (0,5) e formato de coordenadas.

Na avaliação, as caixas delimitadoras previstas pelos modelos foram comparadas com as caixas delimitadoras reais (ground truth) através do cálculo da Interseção sobre União (IoU), sendo IoU ≥ 0,5 considerado uma correspondência verdadeira positiva. A Precisão Média (AP) foi calculada para cada classe, e a média de todas as classes foi reportada como a métrica mAP@0,5. Além da acurácia, os tempos de inferência foram medidos e comparados. Adicionalmente, a complexidade do modelo foi analisada com base no número de operações de ponto flutuante (FLOPs) e na contagem total de parâmetros.

Para garantir uma comparação justa, todas as inferências do modelo foram realizadas no mesmo hardware (GPU/CPU idênticos). As mesmas etapas de pré-processamento, redimensionando todas as imagens para 800×800 pixels e aplicando a normalização necessária, foram aplicadas a todos os modelos. Para o pós-processamento, as previsões foram convertidas para o mesmo formato de coordenadas, um limiar de confiança de 0,5 foi aplicado consistentemente e critérios uniformes de cálculo do IoU foram adotados durante a avaliação.

Nesse contexto, os modelos YOLOv8n, DETR e GPT-4o Vision foram comparados em termos de desempenho e velocidade de detecção de objetos; ajustes e métodos adicionais foram empregados para avaliar as capacidades do GPT-4o Vision em relação aos modelos de detecção de objetos atuais.

Conclusão

Os grandes modelos de visão (LVMs, na sigla em inglês) estão mudando a forma como as máquinas interpretam e agem com base em dados visuais em diversos domínios, incluindo saúde, sistemas autônomos, segurança e indústrias criativas.

Ao aproveitar arquiteturas avançadas, como transformadores e modelos de difusão, os LVMs suportam uma ampla gama de tarefas complexas, incluindo imagens médicas, detecção de objetos em tempo real, geração de imagens a partir de texto e geração de vídeo.

A capacidade de aprender com vastos conjuntos de dados multimodais permite cenários de implementação flexíveis, que vão desde a inferência baseada em nuvem até a computação de borda, possibilitando aplicações personalizadas que abrangem desde a inspeção industrial até a criação de conteúdo personalizado.

No entanto, essas capacidades trazem consigo desafios significativos. O custo computacional do treinamento e da implantação de LVMs permanece elevado, muitas vezes exigindo hardware potente e infraestrutura especializada.

Questões como viés nos dados, interpretabilidade limitada e preocupações éticas relacionadas à vigilância e à privacidade ressaltam a necessidade de uma governança cuidadosa dos modelos. À medida que os Modelos de Valor Agregado (LVMs) continuam a evoluir, encontrar um equilíbrio entre inovação e responsabilidade será crucial para garantir que sejam utilizados de forma eficaz e equitativa em diversos setores.

Seja o primeiro a comentar

Seu endereço de e-mail não será publicado. Todos os campos são obrigatórios.