ChatGPT a atteint 900 millions d'utilisateurs actifs hebdomadaires et a traité environ 2,5 milliards de requêtes par jour. 1

Découvrez l'avenir des grands modèles de langage en explorant des approches prometteuses, telles que l'auto-apprentissage, la vérification des faits et l'expertise parcimonieuse, qui pourraient pallier les limitations des LLM.

Tendances futures des grands modèles de langage

1- Vérification des faits en temps réel avec des données en direct

Les étudiants en droit (LLM) accèdent désormais à des sources externes lors de leurs échanges, au lieu de se fier uniquement aux données d'entraînement. Le modèle interroge des bases de données externes, récupère des informations actualisées et fournit des citations.

Limites : Des erreurs subsistent. Les citations ne garantissent pas l’exactitude des résultats ; il arrive que les modèles citent incorrectement leurs sources ou interprètent mal le contenu cité.

- Microsoft Copilot : Intègre GPT-5.2 avec des données Internet en temps réel. Répond aux questions en fonction de l’actualité avec des liens vers les sources.

- ChatGPT : Effectue des recherches sur le Web lorsqu'on l'interroge sur des événements récents. Cite ses sources dans ses réponses.

- Perplexity : Conçu spécifiquement pour la recherche citée. Chaque réponse inclut des liens vers les sources.

2- Données d'entraînement synthétiques

Les modèles génèrent leurs propres ensembles de données d'entraînement au lieu de nécessiter des données étiquetées par des humains.

Modèle d'auto-amélioration de Google (recherche de 2023) :

- Le modèle soulève des questions

- Réponses des curés

- S'adapte automatiquement aux données générées

- Amélioration des performances : de 74,2 % à 82,1 % aux problèmes mathématiques GSM8K, de 78,2 % à 83,0 % à la compréhension de lecture DROP

Figure : Aperçu du modèle d'auto-amélioration de Google

Source : « Les grands modèles de langage peuvent s’auto-améliorer »

Les projets OpenAI, Anthropic et Google utilisent tous des données synthétiques pour compléter des ensembles de données annotés manuellement. Cela réduit les coûts d'annotation, mais introduit de nouveaux risques de biais ; les modèles peuvent amplifier leurs propres erreurs.

3- Modèles d'experts épars (mélange d'experts)

Au lieu d'activer l'intégralité du réseau neuronal pour chaque entrée, seul un sous-ensemble pertinent de paramètres est activé, en fonction de la tâche. Le modèle achemine les entrées vers des « experts » spécialisés au sein du réseau. Seuls les experts activés traitent la requête.

Exemples concrets

- Llama 4 Scout : 109 milliards de paramètres au total, dont 17 milliards actifs par jeton. L’architecture Mixture of Experts (MoE) offre une fenêtre de contexte de 10 millions de jetons sur un seul GPU H100. 2

- Mistral Devstral 2 : Conçu spécifiquement pour les tâches d'ingénierie logicielle. 123 milliards de paramètres, fenêtre de contexte de jetons de 256 000. Obtient un score de 72,2 % sur le test SWE-bench Verified, ce qui en fait le modèle de codage open-weight de référence. Une variante plus légère, Devstral Small 2 (24 milliards de paramètres), s'exécute localement sur du matériel grand public sous licence Apache 2.0. 3

- DeepSeek V3.2 : 671 milliards de paramètres au total, dont 37 milliards activés par jeton via MoE. Introduit DeepSeek l’attention parcimonieuse (DSA) pour une inférence contextuelle longue plus rapide et un coût de calcul réduit. Prend en charge la pensée in Tool-Use, permettant au modèle de raisonner au sein de flux de travail d’agents tout en appelant des outils externes. 4

4- Intégration des flux de travail d'entreprise

Les LLM sont directement intégrés aux processus métier plutôt que d'être utilisés comme des outils autonomes.

Exemples concrets

- Agentforce (anciennement Einstein Copilot) : intègre les LLM aux opérations CRM. Répond aux requêtes des clients, génère du contenu et exécute des actions dans Agentforce, en s'appuyant sur les données et métadonnées CRM de l'organisation via la couche de confiance Einstein. 5

- Microsoft 365 Copilot : Intégré à Word, Excel, PowerPoint et Outlook. Permet de rédiger des documents, d’analyser des feuilles de calcul, de générer des présentations et de synthétiser des échanges de courriels, en s’appuyant sur les données de l’entreprise grâce à Microsoft Graph pour contextualiser les réponses au sein de l’organisation. 6

- Anthropic Claude pour l'entreprise : La séparation de la mémoire par projet permet de maintenir des contextes de travail distincts entre les équipes. Claude Opus 4.6 a introduit les équipes d'agents, permettant à plusieurs agents Claude de diviser les tâches importantes en flux de travail parallèles, chacun gérant un segment et se coordonnant simultanément avec les autres. Cette même version a intégré Claude directement dans PowerPoint sous forme de panneau latéral natif (aperçu pour la recherche), permettant ainsi de créer et de modifier des présentations au sein de l'application, sans transfert de fichiers. 7

5- LLM hybrides dotés de capacités multimodales

Les progrès futurs pourraient inclure de grands modèles multimodaux intégrant de multiples formes de données, telles que du texte, des images et de l'audio, leur permettant de comprendre et de générer du contenu sur différents types de médias, améliorant ainsi leurs capacités et leurs applications.

- GPT-5.2 : Traite nativement le texte et les images. Génère du code à partir de captures d’écran, analyse des documents et crée une interface utilisateur à partir d’instructions visuelles. L’audio et la vidéo ne sont pas pris en charge au niveau de l’API. 8

- Gemini 3.1 Pro : Gère nativement le texte, l’audio, les images, la vidéo et les dépôts de code complets dans une fenêtre de contexte de 1 million de jetons. Disponible dans AI Studio, Vertex AI et NotebookLM. 9

- Les modèles à poids ouverts de Llama 4 Scout et Maverick ( Meta) utilisent une fusion précoce de jetons multimodaux de texte et d'images, entraînés conjointement dès le départ plutôt que d'être ajoutés comme modules séparés. Ces modèles ont été pré-entraînés sur 200 langues et offrent une assistance au réglage fin spécifique pour 12 langues, dont l'arabe, l'espagnol, l'allemand et l'hindi. 10

La capacité multimodale est désormais la norme pour les modèles de pointe. Le défi qui subsiste est la cohérence : les modèles fonctionnent bien avec les combinaisons image-texte courantes, mais leurs performances se dégradent dans les contextes visuels rares, avec les entrées basse résolution et lors de raisonnements intermodaux nécessitant la mise en relation d’éléments visuels et textuels.

6- Modèles de raisonnement

Des modèles qui « réfléchissent » aux problèmes étape par étape plutôt que de générer des réponses immédiates.

Ce passage de la prédiction au raisonnement est essentiel pour permettre :

- Comportement agentiel , où les modèles planifient, exécutent et adaptent les tâches de manière autonome.

- Une IA interprétable , où les résultats sont progressifs et logiquement cohérents, et non pas seulement plausibles en apparence.

- Claude Opus 4.6 : Grâce à une pensée adaptative, le modèle décide dynamiquement du moment et de l'intensité du raisonnement en fonction de la complexité de la tâche, sans nécessiter de changement de mode manuel. METR a mesuré son horizon d'exécution des tâches à environ 14,5 heures au seuil de réussite de 50 % (intervalle de confiance à 95 % : 6–98 heures), soit l'estimation la plus élevée enregistrée en février 2026. METR note que le modèle approche de la saturation à ce niveau de performance, ce qui signifie que ce chiffre sous-estime probablement son potentiel maximal. Il prend en charge l'utilisation d'outils pendant le raisonnement et coordonne les équipes d'agents pour l'exécution parallèle des tâches. 11 12

- Claude Sonnet 4.6 : Offre une pensée adaptative à un prix plus abordable (3 $/15 $ par million de jetons). Ses performances se rapprochent de celles d’Opus sur les benchmarks de codage et d’utilisation informatique (79,6 % contre 80,8 % sur SWE-bench Verified ; 72,5 % contre 72,7 % sur OSWorld-Verified), rendant le raisonnement étendu applicable à grande échelle pour les déploiements en entreprise. Un écart plus important subsiste toutefois sur les nouvelles tâches de raisonnement telles que ARC-AGI-2. 13

7- Modèles spécifiques au domaine et finement ajustés

Des modèles entraînés sur des données spécialisées pour des secteurs spécifiques plutôt que sur des données à usage général.

Google, Microsoft et Meta ont tous lancé des modèles propriétaires majeurs spécifiques au domaine et finement réglés, Gemini 3.1 Pro, Microsoft 365 Copilot (GPT-5.2) et Llama 4 Scout/Maverick, respectivement, ciblant des cas d'utilisation spécifiques aux entreprises en plus de leurs offres à usage général.

Ces LLM spécialisés peuvent entraîner moins d'hallucinations et une plus grande précision en tirant parti du pré-entraînement spécifique au domaine, de l'alignement du modèle et du réglage fin supervisé.

Consultez les LLM spécialisés dans des domaines spécifiques tels que la programmation, la finance, la santé et le droit :

Développement : GitHub Copilot : optimisé pour les dépôts de code. En juillet 2025, 20 millions de développeurs utilisaient GitHub Copilot, soit une augmentation de 400 % par rapport à l’année précédente, et 90 % des entreprises du classement Fortune 100 l’utilisaient. Il propose la saisie semi-automatique du code, la génération de fonctions et des suggestions de correction de bogues. 14

Finance : BloombergGPT : un modèle linéaire généralisé (LLM) de 50 milliards de paramètres, entraîné sur un ensemble de données de 363 milliards de jetons de documents financiers Bloomberg, surpasse les modèles de taille comparable sur les benchmarks de traitement automatique du langage naturel (NLP) financier, notamment l'analyse des sentiments, la reconnaissance d'entités nommées et la réponse aux questions. 15

Santé : Med-PaLM 2 de Google : optimisé sur des ensembles de données médicales, il a atteint une précision supérieure à 85 % sur les questions de type USMLE (US Medical Licensing Examination), devenant ainsi le premier LLM à atteindre un niveau de performance expert sur ce critère. Il alimente désormais MedLM, la suite de modèles de base pour le secteur de la santé de Google Cloud. 16

Droit : ChatLAW , un modèle de langage open source spécifiquement entraîné sur des ensembles de données du domaine juridique chinois. 17

8- IA éthique et atténuation des biais

Les entreprises se concentrent de plus en plus sur l'IA éthique et l'atténuation des biais dans le développement et le déploiement de grands modèles de langage (LLM).

Exemples concrets :

- Anthropic et OpenAI ont mené une évaluation d'alignement mutuel mi-2025, testant leurs modèles publics respectifs afin d'identifier les comportements flagorneurs, les tendances à la dénonciation et les mécanismes d'autoconservation. Cet exercice a révélé des comportements flagorneurs dans tous les modèles testés, y compris dans des cas où ces modèles ont validé des décisions préjudiciables prises par des utilisateurs simulés présentant des croyances délirantes. Anthropic a par la suite développé le cadre de test Bloom spécifiquement destiné à évaluer ce comportement dans les nouveaux modèles. 18

- Google DeepMind : « L’éthique des assistants IA avancés », une première analyse systématique des questions éthiques et sociétales soulevées par les agents d’IA, abordant l’alignement des valeurs, les risques de manipulation, l’anthropomorphisme, la protection de la vie privée et l’équité. L’évaluation de l’IA responsable menée par l’entreprise comprenait plus de 350 exercices de simulation d’attaques critiques et a introduit un nouveau niveau de capacité critique spécifiquement dédié à la manipulation malveillante, la considérant comme un risque majeur au même titre que les cyberattaques et les menaces NRBC. 19

- Anthropic : Fonctionne comme une société d'intérêt public et a publié sa méthodologie d'IA constitutionnelle, un ensemble de principes éthiques transparents et vérifiables utilisés pour entraîner les modèles Claude. En 2024, elle a recruté son premier chercheur en IA et bien-être social et, en 2025, a lancé un programme de recherche sur le bien-être social des modèles, examinant comment évaluer si les systèmes d'IA méritent une considération morale. 20

Limites des grands modèles de langage (LLM)

1- Hallucinations

Les modèles génèrent des informations qui semblent plausibles mais qui sont incorrectes.

Figure : Référence en matière d'hallucinations pour les LLM populaires

Source : Classement des hallucinations de Vectara 21

Meilleurs résultats (2026) au test de synthèse de Vectara :

- Gemini 2.5 Flash-Lite : meilleur résultat avec un taux d’hallucinations de 3,3 % sur le nouveau jeu de données plus complexe.

- Mistral Large, DeepSeek V3.2, IBM Granite-4 : juste derrière

- Claude Sonnet 4.6 : Réduction des hallucinations grâce à un mode de pensée prolongé ; les taux varient selon le type de référence

- GPT-5.2 : Amélioration du signalement des incertitudes

- Gemini 3.1 Pro : Précision des citations améliorée ; cependant, 13,6 % sur le nouveau jeu de données Vectara. Les modèles de raisonnement privilégient l’exhaustivité à la cohérence factuelle.

Remarque : Sur le jeu de données Vectara, plus complexe, la plupart des modèles de raisonnement (GPT-5, Claude Sonnet 4.5, Grok-4) présentent des taux d’hallucinations supérieurs à 10 %. Des modèles plus légers et plus rapides, comme les variantes de Gemini Flash, surpassent actuellement les modèles de pointe sur ce test de performance spécifique.

Tous les modèles présentent des hallucinations. Leur fréquence a considérablement diminué, passant d'environ 21 % en 2021 à moins de 5 % pour les plus performants, mais elles ne sont pas totalement éliminées. Les applications critiques nécessitent toujours une vérification humaine.

2- Biais

Les modèles absorbent et amplifient les biais sociaux présents dans les données d'entraînement.

Figure : Scores de biais globaux par modèles et taille

Source : Arxiv 22

Types de biais observés :

- suggestions sur les préjugés sexistes dans le domaine de l'emploi

- Biais raciaux dans les simulations de sélection de CV

- biais liés à l'âge dans les recommandations en matière de soins de santé

- Biais socio-économiques dans le contenu éducatif

3- Toxicité

Malgré les mesures de sécurité, certains modèles peuvent générer du contenu nuisible, offensant ou toxique.

Figure : Carte de toxicité des LLM

Source : Chercheurs de l'UCLA et de l'UC Berkeley 23

*GPT-4-turbo-2024-04-09*, Llama-3-70b* et Gemini-1.5-pro* sont utilisés comme modérateur, les résultats pourraient donc être biaisés sur ces 3 modèles .

Des mesures de sécurité strictes réduisent la toxicité mais augmentent le nombre de faux positifs (refus de demandes inoffensives). Des mesures laxistes laissent passer la toxicité.

4- Limitations de la fenêtre contextuelle

Chaque modèle possède une capacité de mémoire limitant les jetons qu'il peut traiter.

2026 fenêtres de contexte :

- Llama 4 Scout (Meta) : 10 millions de jetons (~7,5 millions de mots), la plus grande fenêtre de contexte vérifiée en production (février 2026). 24

- Gemini 3.1 Pro : 1 048 576 jetons (environ 780 000 mots), multimodal natif 25

- Claude Sonnet 4.6 : 1 million de jetons bêta (environ 750 000 mots) ; la limite standard est de 200 000. 26

- GPT-5.2 : 400 000 jetons (~300 000 mots) 27

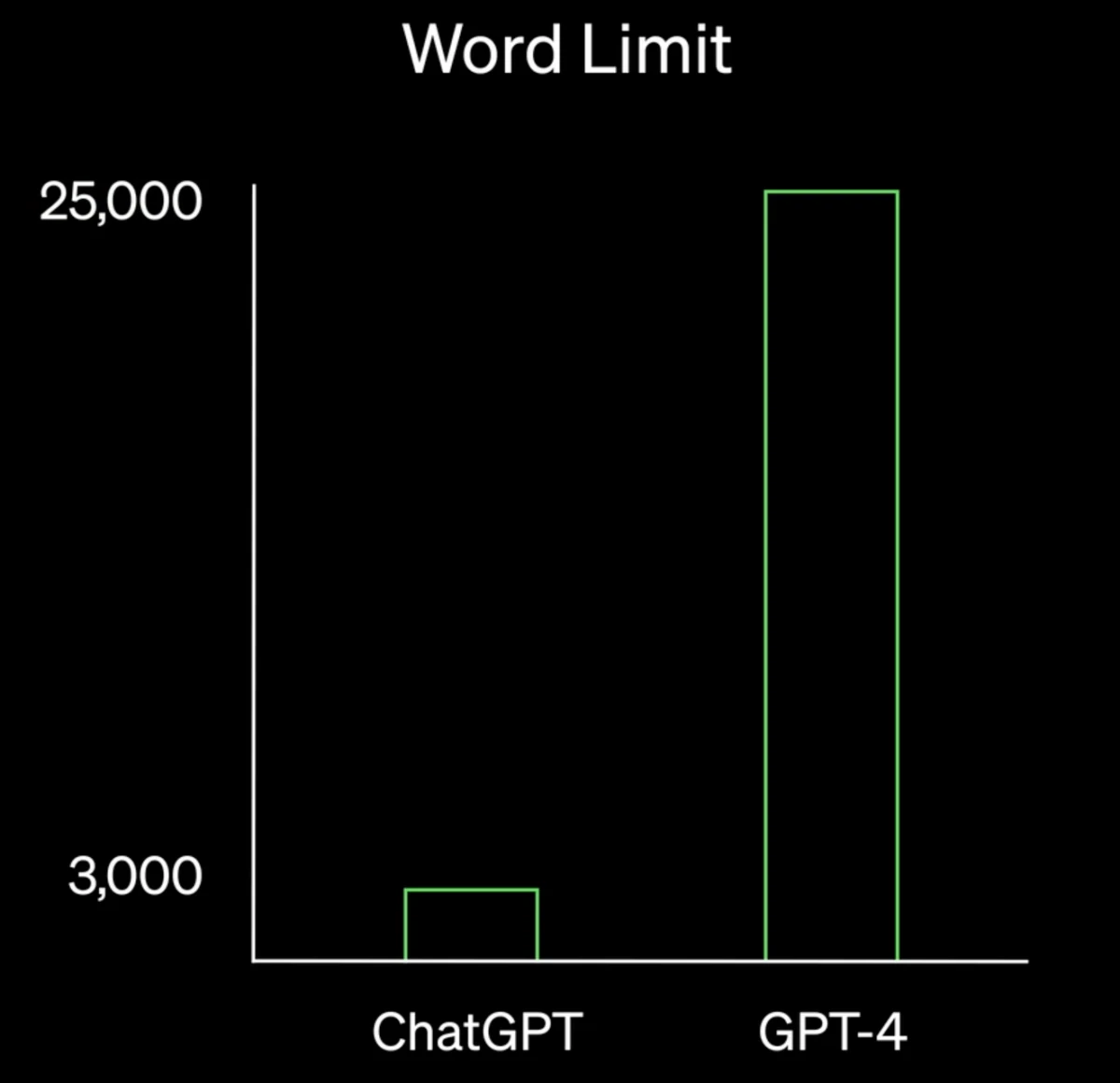

Figure : Comparaison de la limite de mots entre ChatGPT et GPT-4

Source : OpenAI

5- Seuil de connaissances statiques

Les modèles s'appuient sur des connaissances pré-entraînées avec une date limite spécifique. Ils n'ont plus accès aux informations après l'entraînement, sauf s'ils sont connectés à des sources externes.

Problèmes :

- Informations obsolètes sur l'actualité

- Incapacité à gérer les développements récents

- Moins pertinent dans les domaines dynamiques (technologie, finance, médecine)

Solution : Intégration de la recherche Web. ChatGPT, Claude et Perplexity proposent tous une recherche en temps réel. Cependant, la recherche n’élimine pas les hallucinations ; il arrive que les modèles interprètent mal les résultats de recherche.

Principales plateformes LLM

GPT-5.2

Routage intelligent des modèles : requêtes simples → réponses rapides, requêtes complexes → analyse approfondie

Multimodal : Traitement de texte et d’images. Génération de code à partir de captures d’écran, analyse de documents, création de textes alternatifs pour l’accessibilité.

Améliorations par rapport à GPT-4 :

- Réduction du taux d'hallucinations

- Meilleure signalisation de l'incertitude

- Profondeur de raisonnement de niveau doctorat

Utilisateurs : Développeurs, entreprises, créateurs de contenu. Principalement utilisée par les titulaires d’un LLM.

Limites : Persiste à provoquer des hallucinations. Coûteux à grande échelle. L’absence de données en temps réel empêche l’accès à l’information sans activer la recherche Web.

Claude 4 Sonnets/Opus

Raisonnement hybride : mode par défaut rapide, mode de réflexion approfondie pour les problèmes complexes. Capacité de « réfléchir » pendant des heures si nécessaire.

Implémentation de la mémoire : activation explicite uniquement. Initialisation à zéro, activation de la mémoire lors de son invocation par des appels d'outils (conversation_search, recent_chats). L'utilisateur est informé précisément du moment de l'activation de la mémoire.

Séparation des tâches par projet : chaque projet dispose d’un espace mémoire distinct. La feuille de route de la startup reste séparée du travail effectué pour le client.

Mode de pensée étendu : utilisation d’outils pendant le raisonnement. La prise en compte du contexte gère son propre budget de jetons tout au long des conversations.

Qui l'utilise : Les développeurs qui privilégient la transparence, les entreprises qui ont besoin de contrôler la mémoire et le contexte, et les équipes qui gèrent plusieurs projets.

Limitations : Le mode de réflexion étendue est plus lent et plus coûteux. La version bêta avec 1 million de contextes est réservée aux utilisateurs de niveau 4 et plus.

Gemini 2.5 Pro

Traitement multimodal : Gestion native du texte, de l’audio, des images et de la vidéo. Capacité d’analyser des conversations complètes, y compris le contexte visuel et audio.

Exécution de code : Résolution dynamique de problèmes par la génération et l’exécution de code.

Gemini 3.0 prévu pour le premier trimestre 2026 : traitement vidéo en temps réel à 60 images/s, fenêtres de contexte de jetons de plusieurs millions, compréhension des objets 3D, raisonnement intégré par défaut (pas de basculement manuel).

Qui l'utilise : Google Clients du cloud, développeurs créant des applications multimodales et entreprises ayant des besoins complexes en matière d'analyse de documents.

Limitations : le temps de réponse augmente avec les contextes très longs. Requiert une puissance de calcul importante. Écosystème d’API moins mature que OpenAI.

Llama 4 Scout

Déploiement : Un seul GPU H100 (NVIDIA) gère 10 millions de contextes de jetons. Multimodalité native avec une approche de fusion précoce.

Qui l'utilise : Chercheurs, organisations souhaitant utiliser des modèles open source, développeurs ayant besoin d'un déploiement sur appareil, entreprises souhaitant éviter la dépendance vis-à-vis d'un fournisseur.

Limitations : Les performances varient selon la configuration d’hébergement. Nécessite un investissement important en infrastructure pour des performances optimales. Moins abouti que les modèles commerciaux dès la mise en service.

FLORAISON

Largement remplacé par des modèles ouverts plus récents (Llama 4, Mistral, DeepSeek). Reste disponible sur Hugging Face à des fins de recherche et d'éducation.

Qui l'utilise encore : Les chercheurs qui étudient les modèles multilingues, les établissements d'enseignement et les développeurs dans les communautés linguistiques à faibles ressources.

Limites : Données d’entraînement de 2022. Aucune mise à jour des connaissances. Des modèles ouverts plus récents le surpassent sur la plupart des benchmarks.

Pour une analyse comparative des LLM actuels, consultez notre article sur les exemples de grands modèles de langage .

FAQ

Un modèle de langage à grande échelle est un modèle d'IA conçu pour générer et comprendre un texte semblable à celui des humains en analysant de vastes quantités de données.

Ces modèles fondamentaux sont basés sur des techniques d'apprentissage profond et font généralement appel à des réseaux neuronaux comportant de nombreuses couches et un grand nombre de paramètres, ce qui leur permet de capturer des modèles complexes dans les données sur lesquelles ils sont entraînés.

Soyez le premier à commenter

Votre adresse courriel ne sera pas publiée. Tous les champs sont obligatoires.