Les grands modèles de vision (LVM) peuvent automatiser et améliorer les tâches visuelles telles que la détection des défauts, le diagnostic médical et la surveillance environnementale .

Nous avons comparé les performances de trois modèles de détection d'objets : YOLOv8n, DETR et GPT-4oVision, sur 1 000 images chacun, en mesurant des métriques telles que la mAP@0,5, la vitesse d'inférence, les FLOPs et le nombre de paramètres. Afin de garantir une comparaison équitable, toutes les images ont été redimensionnées à 800 × 800 pixels et évaluées avec un prétraitement, des seuils de confiance et des critères de correspondance basés sur l'IoU identiques.

Test de détection d'objets : GPT-4o (Vision), YOLOv8n, DETR

mAP@0.5 : Précision moyenne à un seuil d’intersection sur union (IoU) de 0,5, mesurant la précision de la détection d’objets en équilibrant les vrais positifs et les faux positifs.

Latence (ms) : Le temps de traitement moyen par image, mesuré en millisecondes, indique la vitesse du modèle.

Résultats de référence

Les capacités de détection d'objets de GPT-4o restent limitées par rapport à des modèles spécialisés comme YOLOv8n et DETR .

Précision:

- DETR : mAP@0,5 = 0,55

- YOLOv8n : 0,20

- GPT-4o: 0,02

Ces résultats indiquent que GPT-4o n'est pas encore adapté aux tâches pratiques de détection d'objets.

Latence:

- YOLOv8n : 365 ms

- DETR : 3145 ms

- GPT-4o: 5150 ms

YOLOv8n offre l'inférence la plus rapide mais une précision moindre, tandis que DETR atteint une meilleure précision au prix d'un traitement plus lent.

Tous les modèles ont été évalués à l'aide d'images d'entrée de 800 × 800 pixels par souci d'homogénéité. Le nombre de paramètres et les FLOPS étaient disponibles pour YOLOv8n et DETR, mais pas pour GPT-4o, ce qui empêche une comparaison complète de leur efficacité de calcul.

Complexité du modèle :

- DETR : 41,52 millions de paramètres , 59,56 GFLOPS

- YOLOv8n : 3,15 millions de paramètres , 6,83 GFLOPS

Ceci démontre l'efficacité de YOLOv8n pour les applications en temps réel, tandis que DETR privilégie la précision à la vitesse, au prix d'une plus grande puissance de calcul. Le manque de détails architecturaux concernant GPT-4o limite une analyse d'efficacité plus approfondie.

Consultez notre méthodologie d'analyse comparative .

Raisons possibles des différences de performance

Les trois modèles ont présenté des niveaux de précision et de rapidité différents car ils sont conçus à des fins différentes et traitent l'information visuelle de manières distinctes. GPT-4o est un modèle de langage multimodal de grande taille qui accepte à la fois le texte et les images, tandis que YOLOv8n et DETR sont des systèmes de détection d'objets qui fonctionnent uniquement sur les images.

GPT-4o interprète les entrées visuelles grâce à un pipeline de raisonnement basé sur le langage. Il peut décrire des scènes et identifier des objets, mais il n'est pas conçu pour dessiner des boîtes englobantes ni pour effectuer une localisation spatiale de haute précision.

Ses résultats reposent sur un raisonnement multimodal plutôt que sur des mécanismes spécifiques à la détection. De ce fait, il est plus lent et moins précis pour les tâches de détection.

YOLOv8n et DETR utilisent des architectures spécifiquement conçues pour la détection d'objets. Ils génèrent directement les boîtes englobantes au lieu de les analyser.

YOLOv8n est optimisé pour la vitesse grâce à une structure légère, tandis que DETR est un détecteur basé sur un transformateur qui traite les images différemment de YOLO et vise des prédictions plus précises.

Les deux modèles se concentrent exclusivement sur les entrées visuelles et suivent des objectifs d'entraînement qui associent des motifs d'images à des emplacements d'objets.

Les principales différences sont les suivantes :

- Type d'entrée

- GPT-4o : image et texte

- YOLOv8n et DETR : image uniquement

- Fonction principale

- GPT-4o : compréhension et raisonnement multimodaux

- YOLOv8n et DETR : détection d'objets

- mécanisme de sortie

- GPT-4o : ne dessine pas intrinsèquement de boîtes englobantes

- YOLOv8n et DETR : prédisent directement les boîtes englobantes

Étant donné que YOLOv8n et DETR ont été développés exclusivement pour la détection d'objets, ils obtiennent naturellement de meilleurs résultats dans les tests de performance axés sur la précision et la latence.

La conception multimodale large et non centrée sur la détection de GPT-4o entraîne une mAP plus faible et des temps d'inférence plus élevés lorsqu'elle est évaluée dans le même contexte.

Évaluation détaillée des modèles de vision à grande échelle

OpenAI GPT-4o (Vision)

GPT-4o (Vision) est une extension multimodale de OpenAI, conçue pour traiter et générer des réponses à partir de texte et d'images.

Cette capacité permet à GPT-4o d'interpréter le contenu visuel en parallèle des informations textuelles, permettant ainsi une gamme d'applications qui nécessitent la compréhension et l'analyse d'images.

- Interprétation d'images : GPT-4o peut analyser et décrire le contenu d'images, notamment en identifiant des objets, en interprétant des scènes et en extrayant des informations textuelles. Cela le rend utile pour des tâches telles que la création de légendes d'images et la synthèse de contenu.

- Analyse visuelle des données : le modèle peut interpréter les graphiques et les diagrammes, et fournir des informations et des explications basées sur les données visuelles. Cette fonctionnalité est particulièrement utile pour l’analyse des données et les applications pédagogiques.

- Compréhension multimodale du contenu : GPT-4o peut fournir des réponses plus complètes en combinant texte et images. Elle peut également améliorer les applications d’analyse des médias sociaux et de modération de contenu. Par exemple, elle peut évaluer le sentiment exprimé ou détecter la désinformation dans les publications contenant à la fois du texte et des images.

Malgré ses fonctionnalités avancées, GPT-4o peut parfois produire des résultats inexacts ou peu fiables. Il peut mal interpréter des éléments visuels, négliger des détails ou générer des informations incorrectes, ce qui nécessite une vérification humaine pour les tâches critiques.

Le modèle peut également refléter des biais présents dans ses données d'entraînement, ce qui peut conduire à des interprétations biaisées ou renforcer les stéréotypes. Ceci est problématique dans les applications sensibles où l'impartialité est cruciale, notamment pour l'inférence démographique ou la modération de contenu.

OpenAI Sora

Sora est un modèle de conversion texte-vidéo créé par OpenAI. Il génère de courts clips vidéo à partir des instructions de l'utilisateur et peut également étendre des vidéos existantes. Sa technologie sous-jacente est une adaptation du modèle DALL-E 3.

Sora est un transformateur de diffusion, un modèle de diffusion latente de débruitage qui utilise un transformateur. Les vidéos sont initialement générées dans un espace latent par débruitage de « patches » 3D, puis converties dans un espace standard à l'aide d'un décompresseur vidéo.

Le re-captionnement est utilisé pour améliorer le processus de formation, dans lequel un modèle de conversion vidéo-texte génère des légendes détaillées pour les vidéos.

Grâce aux dernières mises à jour, les utilisateurs peuvent désormais créer des vidéos jusqu'à une résolution de 1080p, d'une durée maximale de 20 secondes, et aux formats écran large, vertical ou carré. Ils peuvent également intégrer leurs propres ressources pour enrichir, remixer et fusionner du contenu existant ou créer de nouvelles vidéos à partir de commandes textuelles.

Figure 1 : Exemple de génération vidéo de Sora utilisant l'invite : « Un plan large et serein d'une famille de mammouths laineux dans un désert ouvert ». 1

Atterrissage IA LandingLens

LandingLens simplifie le développement et le déploiement de modèles de vision par ordinateur. Il s'adresse à divers secteurs d'activité sans nécessiter d'expertise approfondie en IA ou en programmation complexe.

La plateforme standardise les solutions d'apprentissage profond, réduisant ainsi les délais de développement et facilitant le déploiement à l'échelle mondiale des projets. Sans impacter la vitesse de production, les utilisateurs peuvent créer leurs propres modèles d'apprentissage profond et optimiser la précision des inspections.

Elle offre une interface utilisateur étape par étape qui simplifie le processus de développement.

Figure 2 : Le diagramme illustre le flux de travail de LandingLens AI, où les images d'entrée sont traitées en données, utilisées pour entraîner des modèles, déployées via le cloud, la périphérie ou Docker, et continuellement améliorées grâce aux retours d'information. 2

Diffusion stable

Stable Diffusion est un modèle d'apprentissage profond conçu pour créer des images de haute qualité à partir de descriptions textuelles :

- La diffusion stable repose sur le principe de la diffusion. Le processus commence par l'ajout d'un bruit aléatoire à une image, puis le modèle apprend à reconstruire l'original en inversant ce bruit.

- Ce processus permet au modèle de générer des images entièrement nouvelles en affinant l'entrée bruitée en plusieurs étapes jusqu'à ce qu'une image claire et cohérente émerge.

Stable Diffusion utilise un modèle de diffusion latente pour améliorer son efficacité. Au lieu de traiter directement des images haute résolution, elle les compresse d'abord dans un espace latent de dimension inférieure à l'aide d'un auto-encodeur variationnel (VAE).

Cette approche réduit considérablement les besoins en calcul, permettant ainsi une exécution sur du matériel grand public équipé de GPU.

Applications :

Outre la génération d'images à partir de texte, la diffusion stable peut être utilisée pour diverses tâches créatives, telles que :

- Retouche : Restauration ou remplissage des parties manquantes d'une image.

- Extériorisation : Extension des bords d'une image pour y ajouter du contenu.

- Traduction d'image à image : conversion d'une image existante dans un style différent ou modification de son apparence en fonction d'une entrée textuelle.

Milieu de voyage

Midjourney est un générateur d'images qui convertit les descriptions textuelles en images de haute qualité.

Capacités

La version 7 de Midjourney présente une architecture entièrement reconstruite avec des améliorations significatives en termes de qualité et de fonctionnalités.

Génération d'images : La version 7 produit des images agrandies à 2048 x 2048 pixels avec une précision et une rapidité exceptionnelles, ainsi qu'une qualité quasi photographique. Parmi les principales améliorations, citons des textures plus riches, un rendu précis des éléments complexes comme les mains et les visages, et une gestion plus fine de la lumière et de la composition.

Génération vidéo : Crée des clips vidéo de 5 à 21 secondes avec une grande fluidité d'image à image. Le système génère environ 60 secondes de vidéo à partir de six images en trois heures environ, et cible les applications professionnelles en marketing, réalisation de films et création de contenu.

Fonctionnalités 3D : La génération 3D à partir de texte, grâce à une modélisation de type NeRF, permet de créer des objets volumétriques et des scènes immersives. Ces fonctionnalités sont utiles pour le développement de jeux, la visualisation de produits et les applications architecturales.

Figure 3 : Fonctionnalité d'édition d'images de Midjourney. 3

DeepMind Flamingo

Flamingo de DeepMind est un modèle de vision et de langage conçu pour comprendre et interpréter des images et des vidéos à partir d'un minimum d'exemples d'entraînement (apprentissage avec peu d'exemples). Voici quelques-unes de ses principales caractéristiques :

- Apprentissage multimodal avec peu d'exemples : Flamingo peut effectuer de nouvelles tâches efficacement avec seulement quelques exemples, contrairement aux modèles d'IA traditionnels qui nécessitent de vastes ensembles de données étiquetées.

- Mécanisme de rééchantillonnage du récepteur : Flamingo utilise un « rééchantillonneur de récepteur » pour traiter efficacement les entrées visuelles. Il compresse les données d’image et vidéo dans un format pouvant être intégré à un modèle de langage pré-entraîné de grande taille.

- Alignement vision-langage avec des couches d'attention croisée à seuil : des couches d'attention croisée à seuil spécifiques permettent à Flamingo d'aligner et d'intégrer les données visuelles au raisonnement textuel. Cette application peut s'avérer essentielle pour la compréhension des conversations basées sur l'image.

Flamingo utilise un traitement image par image, décomposant les vidéos en images clés et extrayant les informations pour analyser efficacement les éléments visuels.

Ses réponses contextuelles permettent de générer des légendes, des descriptions et des réponses en fonction du déroulement des événements dans une vidéo, afin de garantir une compréhension cohérente du contenu.

De plus, Flamingo fait preuve de raisonnement temporel pour comprendre les séquences, les relations de cause à effet et les interactions complexes au fil du temps. Cela le rend particulièrement performant pour l'analyse vidéo et les tâches de raisonnement multimodal.

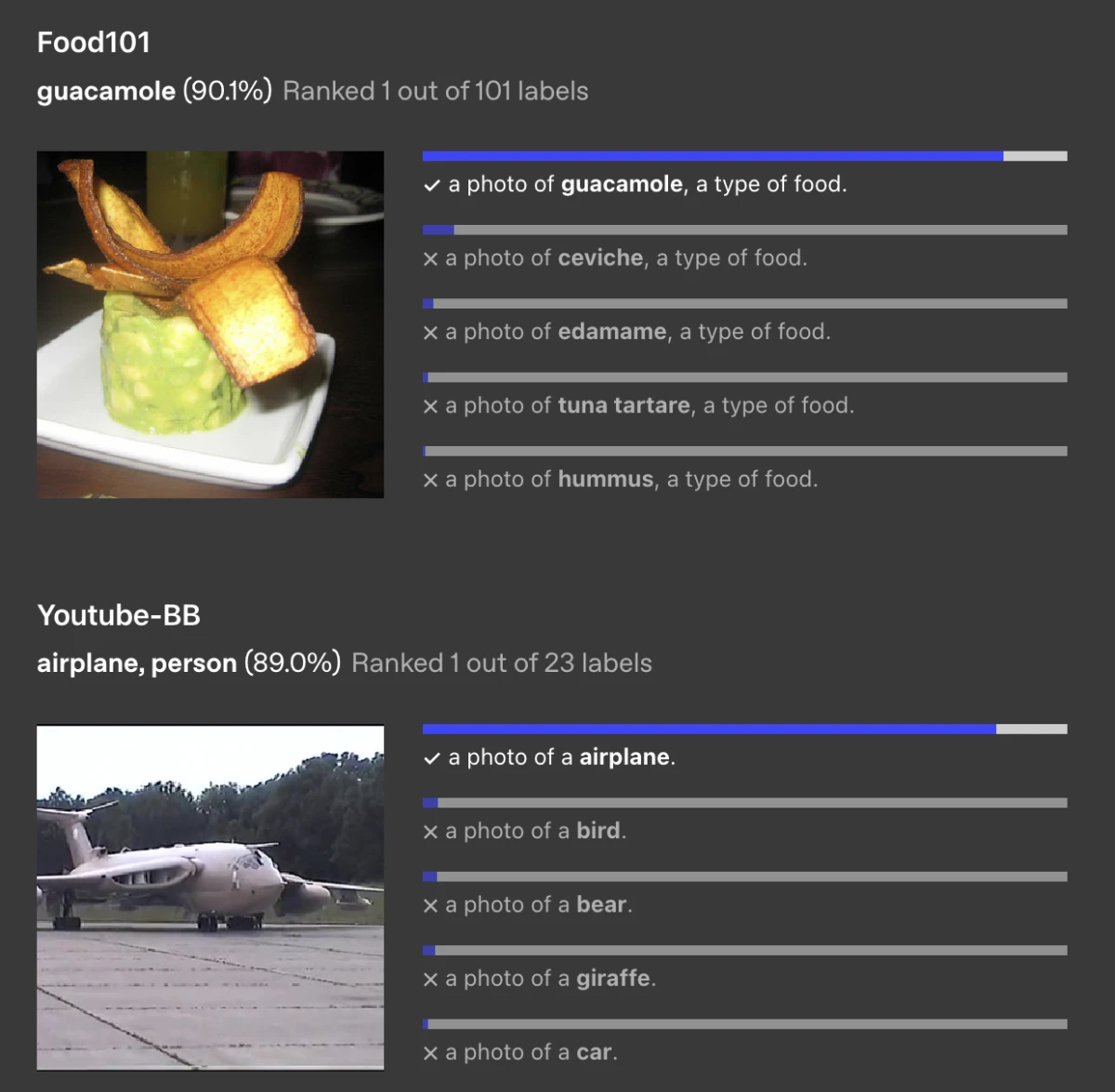

CLIP de OpenAI (Pré-entraînement contrastif langage-image)

CLIP est un réseau neuronal entraîné sur une variété d'images et de légendes textuelles.

Ce modèle peut effectuer diverses tâches de vision, notamment la classification zéro-shot, en comprenant les images dans le contexte du langage naturel.

CLIP est entraîné sur 400 millions de paires (image, texte) afin de combler efficacement le fossé entre les tâches de vision par ordinateur et le traitement automatique du langage naturel. Cela permet à CLIP de prédire les légendes ou de résumer les images sans avoir été explicitement entraîné pour ces tâches spécifiques.

Figure 4 : Identification d'images par CLIP à partir de différents ensembles de données. 4

Transformateur de vision (ViT) de Google

Vision Transformer applique l'architecture de transformateur initialement utilisée dans le traitement du langage naturel aux tâches de reconnaissance d'images .

Il traite les images d'une manière similaire à la façon dont les transformateurs traitent les séquences de mots, et il s'est avéré efficace pour apprendre les caractéristiques pertinentes des données d'images pour les tâches de classification et d'analyse.

Dans Vision Transformer, les images sont traitées comme une séquence de patchs. Chaque patch est aplati en un seul vecteur, de la même manière que les plongements lexicaux sont utilisés dans les transformateurs de texte.

Cette approche permet à ViT d'apprendre la structure de l'image et de prédire indépendamment les étiquettes de classe.

Modèles de fondation natifs de la vidéo

Les modèles de base vidéo natifs représentent un changement fondamental par rapport aux approches traditionnelles de vision par ordinateur. Contrairement aux systèmes précédents qui traitaient les vidéos comme des séquences d'images indépendantes, ces modèles considèrent le temps comme une dimension intégrante des données visuelles.

Innovations architecturales clés

Le Sora de OpenAI illustre cette évolution grâce à son architecture de transformateur de diffusion :

- Patchs spatio-temporels 3D : traite les données vidéo de manière globale plutôt qu’image par image

- Cohérence temporelle : Maintient la qualité visuelle et la cohérence narrative entre les séquences.

- Dépendances à long terme : Capture les relations de cause à effet et les schémas de mouvement

- Génération consciente de la physique : Comprend les mouvements réalistes et les interactions entre les objets

Applications actuelles

Création de contenu :

- Montage vidéo automatisé et synthèse de scènes

- Transfert de style avec cohérence temporelle

- Génération de vidéos narratives à partir de questions textuelles

Imagerie médicale :

- Analyse du mouvement cardiaque en échocardiographie

- Visualisation du flux sanguin en angiographie

- Évaluation dynamique du comportement tissulaire

Sécurité et surveillance :

- Reconnaissance et suivi des activités

- Anomaly détection au fil du temps

- Analyse comportementale contextuelle

Défis restants

Malgré les progrès réalisés, plusieurs limitations persistent :

- Coût de calcul : La production de vidéos longues reste gourmande en ressources.

- Plausibilité physique : Des scénarios complexes peuvent produire une physique irréaliste

- Cohérence des personnages : Maintenir l'identité sur de longues séquences est difficile

- Besoins en formation : Les ensembles de données vidéo à grande échelle annotés sont rares et coûteux.

Inférence embarquée et optimisation en périphérie

Le déploiement en périphérie permet aux modèles de vision de s'exécuter localement sur les smartphones, les appareils IoT et les systèmes embarqués, éliminant ainsi la dépendance à l'égard de l'infrastructure cloud.

Pourquoi le déploiement en périphérie est important

Avantages en matière de confidentialité :

- Les données visuelles sensibles ne quittent jamais l'appareil

- Essentiel pour les soins de santé, la surveillance et les applications personnelles

- Conformité aux réglementations en matière de protection des données

Avantages en matière de performance :

- Latence quasi nulle sans aller-retour réseau

- Traitement en temps réel pour la réalité augmentée et les systèmes autonomes

- Fonctionnement fiable en environnement hors ligne

Rentabilité :

- Consommation de bande passante réduite

- Réduction des dépenses liées au cloud computing

- Coûts d'exploitation courants minimes

techniques de compression de modèles

Pour rendre viables les grands modèles de vision sur les appareils périphériques, une optimisation sophistiquée est nécessaire :

- Quantification : Réduit la précision de 32 bits à 8 bits ou 4 bits (entiers)

- Modèle plus petit

- Perte de précision minimale

- Élagage : Supprime les paramètres et connexions redondants

- Crée des réseaux clairsemés

- Maintient les performances avec moins de calculs

- Distillation des connaissances : Transfert des connaissances des grands modèles vers les petits modèles

Qu'est-ce qu'un modèle de vision à grande échelle (LVM) ?

Les modèles de vision à grande échelle (LVM) sont conçus pour traiter, analyser et interpréter des données visuelles, telles que des images ou des vidéos. Ils se caractérisent par leur très grand nombre de paramètres, souvent de l'ordre de millions ou de milliards. Cela leur permet d'apprendre des motifs, des caractéristiques et des relations complexes au sein du contenu visuel.

Comme les grands modèles de langage (LLM) pour le texte, les LVM sont entraînés sur de vastes ensembles de données, ce qui leur confère des capacités de reconnaissance d'objets, de génération d'images, de compréhension de scènes et de raisonnement multimodal (intégrant des informations visuelles et textuelles).

Ces modèles peuvent prendre en charge des applications dans des domaines tels que la conduite autonome, l'imagerie médicale , la création de contenu et la réalité augmentée .

Structure et conception

Les modèles de vision de grande taille sont construits à l'aide d'architectures de réseaux neuronaux avancées. À l'origine, les réseaux neuronaux convolutifs (CNN) étaient prédominants dans le traitement d'images en raison de leur capacité à traiter efficacement les données de pixels et à détecter les motifs hiérarchiques.

Récemment, les modèles de transformateurs, initialement conçus pour le traitement automatique du langage naturel , ont également été adaptés à de nombreuses tâches de vision différentes, offrant des performances améliorées dans certains scénarios.

Entraînement

L'entraînement de grands modèles de vision consiste à leur fournir des données visuelles, telles que des images ou des vidéos trouvées sur Internet, accompagnées d'étiquettes ou d'annotations pertinentes, selon une nouvelle approche de modélisation séquentielle. Les formateurs étiquettent les bibliothèques d'images pour alimenter les modèles.

Par exemple, dans les tâches de classification d'images , chaque image est étiquetée avec la classe à laquelle elle appartient. Le modèle apprend en ajustant ses paramètres afin de minimiser l'écart entre ses prédictions et les étiquettes réelles.

Ce processus nécessite une puissance de calcul importante et un ensemble de données vaste et diversifié afin de garantir que le modèle puisse bien se généraliser à des données nouvelles et inédites.

Figure 3 : Diagramme d'entraînement des grands modèles de vision sur OpenAI. 5

Consultez les services de collecte de données d'images pour en savoir plus sur les données d'entraînement pour la classification d'images.

Caractéristiques principales des modèles de vision à grande échelle

Le type de modèle fait référence à l'architecture et aux principes de conception d'un modèle de vision. Il définit comment le modèle traite et interprète les données visuelles, s'il intègre plusieurs modalités (par exemple, texte et images) et quels mécanismes sous-jacents (par exemple, transformateurs, apprentissage contrastif, diffusion) il utilise pour extraire des représentations significatives :

- Modèle LLM multimodal basé sur les transformeurs : une architecture de modèle qui combine les transformeurs avec des capacités multimodales. Il permet de comprendre simultanément les entrées visuelles et textuelles. Il est entraîné à l’aide d’ensembles de données à grande échelle pour effectuer un raisonnement complexe sur plusieurs types de données.

- Apprentissage contrastif : technique utilisée dans l’entraînement de modèles pour différencier les points de données similaires et dissemblables. Ce processus consiste à maximiser la similarité des entrées apparentées tout en minimisant celle des entrées dissemblables. Il est souvent employé dans l’apprentissage auto-supervisé pour améliorer la représentation des caractéristiques.

- Plateforme de vision par IA : ce système fournit l’infrastructure, les outils et les modèles pré-entraînés pour diverses tâches de vision par ordinateur, telles que la reconnaissance d’images , la détection d’objets et la segmentation. Il comprend généralement des fonctionnalités d’entraînement, de déploiement et d’inférence des modèles.

- Transformer : une architecture d’apprentissage profond qui utilise des mécanismes d’auto-attention pour traiter les données d’entrée. Elle permet aux modèles de saisir les dépendances à long terme, ce qui la rend efficace pour les tâches liées au traitement automatique du langage naturel et à la vision par ordinateur.

- Modèle de diffusion : Modèle génératif qui élimine progressivement le bruit d’un signal d’entrée initial bruité et l’affine étape par étape pour produire un signal de sortie clair et structuré. Il est couramment utilisé pour la génération et l’amélioration d’images .

Objectif d'entraînement : Fonction d'optimisation qui guide l'apprentissage d'un modèle à partir des données. Elle détermine comment le modèle ajuste ses paramètres internes pendant l'entraînement afin d'améliorer ses performances sur des tâches spécifiques. Il peut s'agir de prédire le point de données suivant (modèle autorégressif), de distinguer les entrées similaires/dissimilaires (apprentissage contrastif) ou de classer des images en catégories.

- Autorégressif : méthode d’apprentissage où un modèle prédit le point de données suivant d’une séquence à partir des entrées précédemment observées. Elle est souvent utilisée en modélisation du langage et en vision générative.

- Apprentissage contrastif : Objectif d’apprentissage auto-supervisé où le modèle apprend en distinguant les paires de données similaires et dissemblables. Il contribue à améliorer la capacité à extraire des représentations significatives sans étiquettes explicites.

- Apprentissage supervisé : paradigme d’apprentissage où le modèle est entraîné à l’aide de données étiquetées, c’est-à-dire que chaque entrée est associée à une sortie correcte correspondante. Cette approche est largement utilisée dans des tâches telles que la classification et la segmentation.

- Classification d'images : Objectif d'apprentissage spécifique consistant à classer des images en catégories prédéfinies selon leurs caractéristiques visuelles. Le processus d'apprentissage implique l'optimisation d'une fonction de perte afin de maximiser la précision de la classification.

- Diffusion débruitante : une approche d’apprentissage génératif où un modèle est entraîné à reconstruire des images nettes à partir d’entrées bruitées. Ce processus consiste à inverser un processus d’ajout progressif de bruit afin d’améliorer la reconstruction et la génération d’images.

Assistance au réglage fin : capacité d’un modèle à s’adapter à des tâches spécifiques en s’entraînant sur des ensembles de données plus petits et spécifiques au domaine, tout en conservant les connaissances de sa phase de pré-entraînement.

Le réglage fin permet d'améliorer les performances sur des applications spécialisées.

Apprentissage zéro-exemple/avec peu d'exemples : capacité d'un modèle à effectuer des tâches avec peu ou pas de données d'entraînement spécifiques à la tâche.

L'apprentissage zéro-shot permet de faire des inférences sur des catégories non vues, tandis que l'apprentissage peu d'exemples permet une adaptation avec un minimum d'exemples étiquetés.

Support multimodal : Capacité d'un modèle à traiter et à intégrer des informations provenant de plusieurs modalités (par exemple, texte, images, audio).

Logiciels libres vs. logiciels propriétaires : les modèles à code source ouvert ont un code et des pondérations accessibles au public, permettant leur modification et leur déploiement par la communauté.

Les modèles propriétaires sont détenus et contrôlés par des entités privées, ce qui peut limiter l'accès et la personnalisation.

Déploiement en périphérie : la capacité d’un modèle à s’exécuter sur des périphériques (par exemple, téléphones mobiles, appareils IoT) plutôt que de dépendre de serveurs basés sur le cloud.

Le déploiement en périphérie permet de réduire la latence, d'améliorer la confidentialité et de permettre un traitement en temps réel dans des environnements aux ressources limitées.

Quels sont les cas d'utilisation des grands modèles de vision ?

soins de santé et imagerie médicale

- Diagnostic des maladies : Détection des maladies à partir d'images médicales telles que les radiographies, les IRM ou les scanners pour identifier les tumeurs, les fractures ou les anomalies.

- Pathologie : Analyse d'échantillons de tissus en pathologie pour détecter des signes de cancer.

- Ophtalmologie : Diagnostic des maladies à partir d'images rétiniennes.

Véhicules autonomes et robotique

- Navigation et détection d'obstacles : Aider les véhicules autonomes et les drones à naviguer et à éviter les obstacles en interprétant des données visuelles en temps réel.

- La robotique dans la fabrication : Aider les robots dans les tâches de tri, d'assemblage et de contrôle qualité.

Sécurité et surveillance

- Surveillance de l'activité : Analyse des flux vidéo pour détecter les comportements inhabituels ou suspects.

- Reconnaissance faciale : utilisée dans les systèmes de sécurité pour la vérification et le suivi d’identité. Par exemple, Amazon Rekognition est un service cloud proposé par AWS (991259_1677) qui offre des fonctionnalités d’analyse d’images et de vidéos telles que la détection et la reconnaissance faciale, l’identification d’objets et de scènes, ainsi que l’extraction de texte. Il peut analyser les émotions, les tranches d’âge et les activités, ce qui s’avère utile pour la personnalisation et la sécurité.

Visionnez la vidéo ci-dessous pour voir Amazon Rekognition en action. 6

Commerce de détail et commerce électronique

- Recherche visuelle : Permettre aux clients de rechercher des produits à l'aide d'images plutôt que de texte.

- Gestion des stocks : Automatisation du suivi et de la gestion des stocks par reconnaissance visuelle.

Agriculture

- Surveillance et analyse des cultures : Suivi de la santé et de la croissance des cultures à l'aide d'images de drones ou de satellites.

- Détection des ravageurs : Identification des ravageurs et des maladies affectant les cultures.

surveillance environnementale

- Suivi de la faune sauvage : Identification et suivi des animaux sauvages pour soutenir les efforts de conservation.

- Analyse de l'utilisation et de la couverture des sols : Suivi des changements d'utilisation des sols et de la couverture végétale au fil du temps.

Création de contenu et divertissement

- Montage vidéo et cinéma : Automatisation des processus de montage et de post-production vidéo.

- Développement de jeux : Amélioration du réalisme des environnements et de la création des personnages.

- Amélioration des photos et des vidéos : Amélioration de la qualité des images et des vidéos.

- Modération du contenu : Détection et signalement automatiques des contenus visuels inappropriés ou nuisibles.

Quels sont les défis posés par les modèles de vision à grande échelle ?

Ressources informatiques

L'entraînement et le déploiement de ces modèles nécessitent une puissance de calcul et une mémoire importantes, ce qui peut les rendre gourmands en ressources.

Exigences en matière de données

Ils ont besoin de vastes ensembles de données diversifiés pour l'entraînement. La collecte, l'étiquetage et le traitement de tels ensembles de données peuvent s'avérer complexes et coûteux. Cependant, les plateformes de crowdsourcing peuvent apporter leur aide .

Biais et équité

Les modèles peuvent hériter des biais présents dans leurs données d'entraînement, ce qui peut conduire à des résultats injustes ou contraires à l'éthique, notamment dans des applications sensibles comme la reconnaissance faciale.

Interprétabilité et explicabilité

Comprendre comment ces modèles prennent leurs décisions peut s'avérer complexe, notamment pour les applications où la transparence est essentielle. Consultez la section « IA explicable » pour découvrir le fonctionnement de ce processus et son rôle dans l'éthique de l'IA.

Généralisation

Bien qu'ils fonctionnent bien sur des données similaires à leur ensemble d'entraînement, ils peuvent avoir des difficultés avec des types de données complètement nouveaux ou différents.

préoccupations relatives à la confidentialité

L’utilisation de grands modèles visuels, notamment dans le domaine de la surveillance et de la reconnaissance faciale, soulève d’importantes préoccupations en matière de respect de la vie privée .

Défis réglementaires et éthiques

Il est de plus en plus important de veiller à ce que ces modèles respectent les normes juridiques et éthiques , notamment à mesure qu'ils s'intègrent davantage dans la société.

méthodologie de référence pour la détection d'objets

Dans ce test comparatif, les performances des modèles de détection d'objets YOLOv8n, DETR (DEtection TRansformer) et GPT-4o Vision ont été comparées sur le jeu de données de validation COCO 2017. Mille images par modèle ont été utilisées pour la comparaison. Toutes les images ont été redimensionnées à 800 × 800 pixels afin d'assurer des dimensions d'entrée uniformes entre les modèles.

Le modèle YOLOv8n a été chargé avec des poids pré-entraînés (yolov8n.pt) provenant du dépôt Ultralytics, et l'inférence a été réalisée à l'aide de la méthode predict() via l'API YOLO d'Ultralytics. Le modèle DETR a été chargé avec l'architecture detr_resnet50 de la bibliothèque Facebook Research, et ses sorties, initialement normalisées au format [center_x, center_y, width, height], ont été redimensionnées et converties au format de coordonnées [x1, y1, x2, y2]. Un seuil de confiance de 0,5 a été appliqué aux résultats des deux modèles.

Le modèle GPT-4o Vision a été évalué à l'aide de l'API de détection d'objets de OpenAI. Pour ce modèle, les images de l'ensemble de données de validation COCO ont été téléchargées, les annotations chargées, et chaque image a été convertie au format approprié (redimensionnée à 800 × 800 pixels) avant d'être envoyée à l'API. Seules les détections appartenant aux classes COCO ont été demandées au format JSON, et les prédictions renvoyées par l'API ont été évaluées avec le même seuil de confiance (0,5) et le même format de coordonnées.

Lors de l'évaluation, les boîtes englobantes prédites par les modèles ont été comparées aux boîtes de référence par le calcul de l'intersection sur l'union (IoU), un IoU ≥ 0,5 étant considéré comme un vrai positif. La précision moyenne (AP) a été calculée pour chaque classe, et la moyenne de toutes les classes a été rapportée sous la forme de la métrique mAP@0,5. Outre la précision, les temps d'inférence ont été mesurés et comparés. De plus, la complexité du modèle a été analysée en fonction des FLOPs et du nombre total de paramètres.

Afin de garantir une comparaison équitable, toutes les inférences de modèles ont été réalisées sur le même matériel (GPU/CPU identiques). Les mêmes étapes de prétraitement, incluant le redimensionnement de toutes les images à 800 × 800 pixels et l'application des normalisations nécessaires, ont été appliquées à tous les modèles. Pour le post-traitement, les prédictions ont été converties au même format de coordonnées, un seuil de confiance de 0,5 a été systématiquement appliqué et des critères de calcul de l'IoU uniformes ont été adoptés lors de l'évaluation.

Dans ce cadre, les modèles YOLOv8n, DETR et GPT-4o Vision ont été comparés en termes de performances et de vitesse de détection d'objets ; des ajustements et des méthodes supplémentaires ont été utilisés pour évaluer les capacités de GPT-4o Vision par rapport aux modèles de détection d'objets actuels.

Conclusion

Les grands modèles de vision (LVM) transforment la façon dont les machines interprètent et agissent sur les données visuelles dans divers domaines, notamment la santé, les systèmes autonomes, la sécurité et les industries créatives.

En tirant parti d'architectures avancées, telles que les transformateurs et les modèles de diffusion, les LVM prennent en charge un large éventail de tâches complexes, notamment l'imagerie médicale, la détection d'objets en temps réel, la génération d'images à partir de texte et la génération vidéo.

Leur capacité à tirer des enseignements de vastes ensembles de données multimodaux permet des scénarios de déploiement flexibles, allant de l'inférence basée sur le cloud à l'informatique de périphérie, permettant des applications sur mesure qui couvrent un large éventail de domaines, de l'inspection industrielle à la création de contenu personnalisé.

Cependant, ces fonctionnalités s'accompagnent de défis importants. Le coût de calcul lié à l'entraînement et au déploiement des LVM reste élevé, nécessitant souvent du matériel puissant et une infrastructure spécialisée.

Des problèmes tels que les biais dans les données, leur interprétabilité limitée et les questions éthiques liées à la surveillance et à la protection de la vie privée soulignent la nécessité d'une gouvernance rigoureuse des modèles. À mesure que les modèles de surveillance des données (LVM) évoluent, il sera essentiel de trouver un équilibre entre innovation et responsabilité afin de garantir leur utilisation efficace et équitable dans différents secteurs.

Soyez le premier à commenter

Votre adresse courriel ne sera pas publiée. Tous les champs sont obligatoires.