Les entreprises génèrent d'importants volumes de données vocales provenant des appels, des réunions et des interfaces vocales, mais le traitement manuel de ces données est lent et difficile à mettre à l'échelle.

La reconnaissance vocale (également appelée reconnaissance vocale automatique ou transcription vocale) convertit le langage parlé en texte, permettant aux systèmes d'analyser et d'automatiser les flux de travail vocaux tels que la transcription des appels, les assistants vocaux et les résumés de réunions.

Découverte du fonctionnement de la reconnaissance vocale, des algorithmes impliqués, de ses applications dans divers secteurs et d'exemples concrets.

12 cas d'utilisation de la reconnaissance vocale

La reconnaissance vocale est utilisée dans de nombreux secteurs pour convertir la parole en texte et permettre les interactions vocales avec les systèmes. Les exemples suivants illustrent des cas d'utilisation courants de la reconnaissance vocale dans des secteurs tels que le service client, la vente, l'automobile, la santé et les technologies.

Service client et assistance

- Systèmes de réponse vocale interactive (RVI) : les systèmes RVI acheminent automatiquement les appelants vers le service approprié en reconnaissant leurs requêtes vocales. Ils réduisent le volume d’appels et les temps d’attente en traitant les demandes simples grâce à des réponses préenregistrées ou à la synthèse vocale . La reconnaissance vocale automatique (RVA) permet aux systèmes RVI de comprendre et de répondre aux demandes des clients en temps réel.

- Automatisation du support client et chatbots : la reconnaissance vocale permet aux chatbots vocaux et aux assistants virtuels de traiter les demandes de service client courantes, telles que répondre aux FAQ, guider les étapes de dépannage et aider à résoudre les problèmes liés aux comptes.

- Analyse des sentiments et surveillance des appels : L’analyse des sentiments classe les conversations comme positives, négatives ou neutres, aidant ainsi les organisations à surveiller la qualité du service et à identifier les préoccupations des clients.

- Prise en charge multilingue : Les modèles de reconnaissance vocale peuvent être entraînés à reconnaître plusieurs langues. Intégrés aux chatbots ou aux systèmes SVI, ils peuvent détecter la langue de l’utilisateur et basculer vers le modèle approprié, permettant ainsi aux entreprises de servir une clientèle internationale (voir figure 1).

- Authentification client par biométrie vocale : La biométrie vocale utilise les technologies de reconnaissance vocale pour analyser la voix d’un locuteur et extraire des caractéristiques telles que l’accent et le débit afin de vérifier son identité.

Figure 1 : Image montrant comment un chatbot multilingue reconnaît des mots dans une autre langue.

Ventes et marketing

- Assistants de vente virtuels : ces assistants, dotés d’intelligence artificielle, interagissent avec les clients par la voix et les aident à prendre leurs décisions d’achat. La reconnaissance vocale leur permet de comprendre les demandes orales et d’y répondre en fonction des intentions du client.

- Services de transcription : La reconnaissance vocale convertit les enregistrements des appels et réunions commerciales en transcriptions écrites, facilitant ainsi la documentation et l’analyse.

Automobile

- Commandes vocales : Les commandes vocales permettent aux utilisateurs d’interagir avec les appareils et les applications par la voix. Les conducteurs peuvent ainsi actionner des fonctions telles que la climatisation, les appels téléphoniques ou le système de navigation.

- Navigation à commande vocale : La navigation à commande vocale fournit des instructions vocales en temps réel en utilisant la saisie vocale de la destination par le conducteur. Les conducteurs peuvent demander des informations sur le trafic en temps réel ou rechercher des points d’intérêt à proximité à l’aide de commandes vocales, sans avoir à utiliser de commandes physiques.

Soins de santé

- Transcription médicale : La transcription médicale, également appelée MT, est le processus de conversion des rapports médicaux enregistrés vocalement en un document écrit. Voici les principales étapes du processus de transcription médicale :

- Enregistrement de la dictée du médecin.

- Transcription de la parole en texte à l'aide de systèmes de reconnaissance vocale (certains systèmes incluent également la diarisation des locuteurs pour les distinguer).

- Révision du texte transcrit pour une meilleure exactitude et correction des erreurs si nécessaire.

- Mise en forme du document conformément aux exigences légales et médicales.

- Assistants médicaux virtuels : Les assistants médicaux virtuels (AMV) utilisent la reconnaissance vocale, le traitement automatique du langage naturel et des algorithmes d’apprentissage automatique pour communiquer avec les patients par la voix ou par écrit. Les logiciels de reconnaissance vocale permettent aux AMV de répondre aux commandes vocales, d’extraire des informations des dossiers médicaux électroniques (DME) et d’automatiser la transcription médicale.

- Intégration des dossiers médicaux électroniques (DME) : les professionnels de la santé peuvent utiliser des commandes vocales pour naviguer dans le système DME, accéder aux données des patients et saisir des données dans des champs spécifiques.

exemples concrets de reconnaissance vocale

Discours azur

Azure Speech est un service d'IA basé sur le cloud (provenant d'Azure AI Foundry) qui permet aux applications de traiter et de générer du langage parlé. Il offre des fonctionnalités telles que :

Reconnaissance vocale automatique : convertit l’audio parlé en texte écrit et prend en charge plusieurs modes de transcription :

- Transcription en temps réel pour l'audio en continu

- Transcription rapide des fichiers enregistrés

- Transcription par lots de grands volumes audio

Les développeurs peuvent également créer des modèles vocaux personnalisés pour améliorer la précision de la reconnaissance pour un vocabulaire spécifique à un domaine ou dans des environnements bruyants.

Synthèse vocale : transforme un texte écrit en un son naturel grâce à des voix neuronales. Les développeurs peuvent contrôler les caractéristiques vocales telles que la hauteur, le débit et la prononciation à l’aide du langage SSML (Speech Synthesis Markup Language).

Azure Speech prend également en charge les voix neuronales personnalisées , permettant aux organisations de créer une voix unique pour leurs applications.

Traduction vocale : Fournit une traduction vocale multilingue en temps réel, permettant la traduction de la parole vers la parole ou de la parole vers le texte dans différentes langues.

Modèles vocaux personnalisés : Les développeurs peuvent entraîner des modèles personnalisés avec leurs propres données afin d’améliorer la reconnaissance vocale pour :

- Terminologie propre à l'industrie

- Accents et styles de parole

- Conditions audio bruyantes

Avatars vocaux et IA conversationnelle : Azure Speech peut générer des avatars parlants synthétiques et permettre des interactions vocales en temps réel, prenant en charge les systèmes d’IA conversationnelle et les agents vocaux.

Figure 2 : Un exemple tiré de l'agent Azure Voice AI, Voice Live. 1

Deepgram

Deepgram fournit des API permettant d'intégrer des fonctionnalités vocales, telles que la transcription vocale en texte, la synthèse vocale et l'intelligence vocale. 2

- Transcription vocale en texte : convertit l’audio en texte pour les flux en temps réel et les enregistrements audio préenregistrés.

- Synthèse vocale : génère une parole naturelle à partir de texte pour les interfaces vocales et les assistants.

- Diarisation des locuteurs : identifie et sépare les différents locuteurs dans un enregistrement audio.

- Détection de mots clés et analyse audio : détecte des mots ou des expressions spécifiques et extrait des informations pertinentes des données audio.

- Modèles vocaux personnalisés : permettent aux organisations d’améliorer la précision de la reconnaissance vocale grâce à des données spécifiques au domaine.

Les cas d'utilisation de Deepgram incluent :

- Service client : Transcription et analyse des conversations du centre d'appels afin de contrôler la qualité du service et d'en extraire des informations pertinentes.

- Médias et diffusion : Génération de sous-titres et de transcriptions pour les podcasts, les interviews et les diffusions en direct.

- Santé et droit : Conversion de dictées et de conversations orales en documents écrits.

- Analyse commerciale : extraction de mots-clés, de sentiments et d’informations à partir de grands volumes de données audio.

Assemblage IA

AssemblyAI est utilisé dans l'analyse des centres d'appels , où les appels d'assistance client sont transcrits et analysés à des fins de contrôle qualité et d'obtention d'informations ; la transcription de réunions , qui génère des transcriptions et des résumés de réunions virtuelles ; et la transcription multimédia , permettant la création de sous-titres, de transcriptions et de contenus audio ou vidéo consultables.

Il est également utilisé pour la modération de contenu afin de détecter les propos inappropriés ou restreints dans les flux audio et pour l'analyse des données vocales, en extrayant des informations telles que les sujets, les entités et le sentiment à partir de grands volumes de conversations enregistrées. 3

- Transcription vocale en texte : convertit les flux ou fichiers audio en texte avec horodatage, scores de confiance et autres métadonnées.

- Transcription en flux continu en temps réel : traite l’audio en direct avec une faible latence pour les agents vocaux et les applications en temps réel.

- Intelligence audio : extrait des informations de la parole, notamment la diarisation du locuteur, l’analyse des sentiments , la détection de sujets et la reconnaissance d’entités.

- Résumé et compréhension de la parole : Génère des résumés et des résultats structurés à partir de transcriptions pour faciliter les flux de travail en aval.

- Modération du contenu et suppression des informations personnelles : identifie ou supprime le contenu sensible ou inapproprié des fichiers audio.

- Fonctionnalités multilingues et de détection de la langue : Prend en charge la transcription dans plusieurs langues et accents.

Google Synthèse vocale dans le nuage

Google Cloud Speech-to-Text permet aux développeurs d'intégrer l'API pour transcrire des fichiers audio, traiter des flux vocaux en direct et créer des fonctionnalités vocales telles que des commandes ou une recherche. 4

- Transcription en temps réel et par lots : transcrit à la fois l’audio en flux continu et les fichiers préenregistrés.

- Prise en charge multilingue : Reconnaît la parole dans plus de 100 langues et variantes.

- Modèles d'IA vocale avancés : Utilise les modèles vocaux de Google (par exemple, Chirp 3) entraînés sur de grands ensembles de données audio pour une précision améliorée.

- Chirp 3 est le dernier modèle d'IA vocale de Google pour la reconnaissance vocale automatique (ASR). Ce modèle génératif multilingue est conçu pour convertir l'audio parlé en texte avec une précision et une rapidité accrues. Il améliore la qualité de la transcription et prend en charge des fonctionnalités telles que la diarisation des locuteurs (identification des différents locuteurs), la détection automatique de la langue et la reconnaissance vocale multilingue.

- Ponctuation automatique et fonctionnalités d'identification des locuteurs : ajoute la ponctuation aux transcriptions et peut distinguer les locuteurs dans les enregistrements.

Qu'est-ce que la reconnaissance vocale ?

La reconnaissance vocale, également connue sous le nom de reconnaissance vocale automatique (ASR), de transcription vocale (STT) et de reconnaissance vocale par ordinateur, est une technologie qui permet à un ordinateur de reconnaître et de convertir le langage parlé en texte.

La technologie de reconnaissance vocale utilise l'IA et des modèles d'apprentissage automatique pour identifier et transcrire avec précision différents accents, dialectes et schémas de parole.

Reconnaissance vocale vs reconnaissance de la parole

La reconnaissance vocale est souvent confondue avec la reconnaissance de la parole , or il s'agit de concepts distincts. La reconnaissance vocale convertit les mots prononcés en texte écrit, en identifiant les mots et les phrases prononcés par un utilisateur, indépendamment de l'identité du locuteur.

En revanche, la reconnaissance vocale vise à reconnaître ou à vérifier la voix d'un locuteur, dans le but de déterminer l'identité d'un locuteur inconnu plutôt que de se concentrer sur la compréhension du contenu du discours.

Quelles sont les caractéristiques des systèmes de reconnaissance vocale ?

Les systèmes de reconnaissance vocale comportent plusieurs composants qui fonctionnent de concert pour comprendre et traiter la parole humaine. Les caractéristiques clés d'une reconnaissance vocale efficace sont les suivantes :

prétraitement audio

Une fois le signal audio brut acquis depuis un périphérique d'entrée, il est nécessaire de le prétraiter afin d'améliorer la qualité de la parole. Le prétraitement audio vise principalement à extraire les données vocales pertinentes en supprimant les artefacts indésirables et en réduisant le bruit.

Extraction de caractéristiques

Cette étape transforme le signal audio prétraité en une représentation plus informative. Les données audio brutes deviennent ainsi plus faciles à exploiter pour les modèles d'apprentissage automatique des systèmes de reconnaissance vocale.

pondération du modèle de langage

La pondération linguistique accorde plus d'importance à certains mots et expressions, comme les références à des produits, dans les signaux audio et vocaux. Cela augmente la probabilité que ces mots clés soient reconnus ultérieurement par les systèmes de reconnaissance vocale.

Modélisation acoustique

Il permet aux systèmes de reconnaissance vocale de capturer et de distinguer les unités phonétiques d'un signal vocal. Les modèles acoustiques sont entraînés sur de vastes ensembles de données contenant des échantillons vocaux provenant d'un large éventail de locuteurs aux accents, styles d'élocution et origines variés.

Étiquetage des haut-parleurs

Il permet aux applications de reconnaissance vocale d'identifier plusieurs locuteurs dans un enregistrement audio. Il attribue une étiquette unique à chaque locuteur, permettant ainsi de déterminer qui parlait à un instant donné.

Filtrage des grossièretés

Le processus de suppression des mots ou expressions offensants, inappropriés ou explicites des données audio.

Quels sont les différents algorithmes de reconnaissance vocale ?

La reconnaissance vocale utilise divers algorithmes et techniques informatiques pour convertir le langage parlé en langage écrit. Voici quelques-unes des méthodes de reconnaissance vocale les plus couramment utilisées :

Modèles de Markov cachés (MMC)

Le modèle de Markov caché est un modèle statistique de Markov couramment utilisé dans les systèmes de reconnaissance vocale traditionnels. Les modèles de Markov cachés capturent la relation entre les caractéristiques acoustiques et modélisent la dynamique temporelle des signaux vocaux.

Traitement automatique du langage naturel (TALN)

Le traitement automatique du langage naturel (TALN) est un sous-domaine de l'intelligence artificielle qui s'intéresse à l'interaction entre les humains et les machines par le biais du langage naturel. Voici quelques rôles clés du TALN dans les systèmes de reconnaissance vocale :

- Estimez la probabilité des séquences de mots dans le texte reconnu.

- Convertir les expressions familières et les abréviations d'une langue parlée en une forme écrite standardisée

- Associer les unités phonétiques obtenues à partir de modèles acoustiques à leurs mots correspondants dans la langue cible.

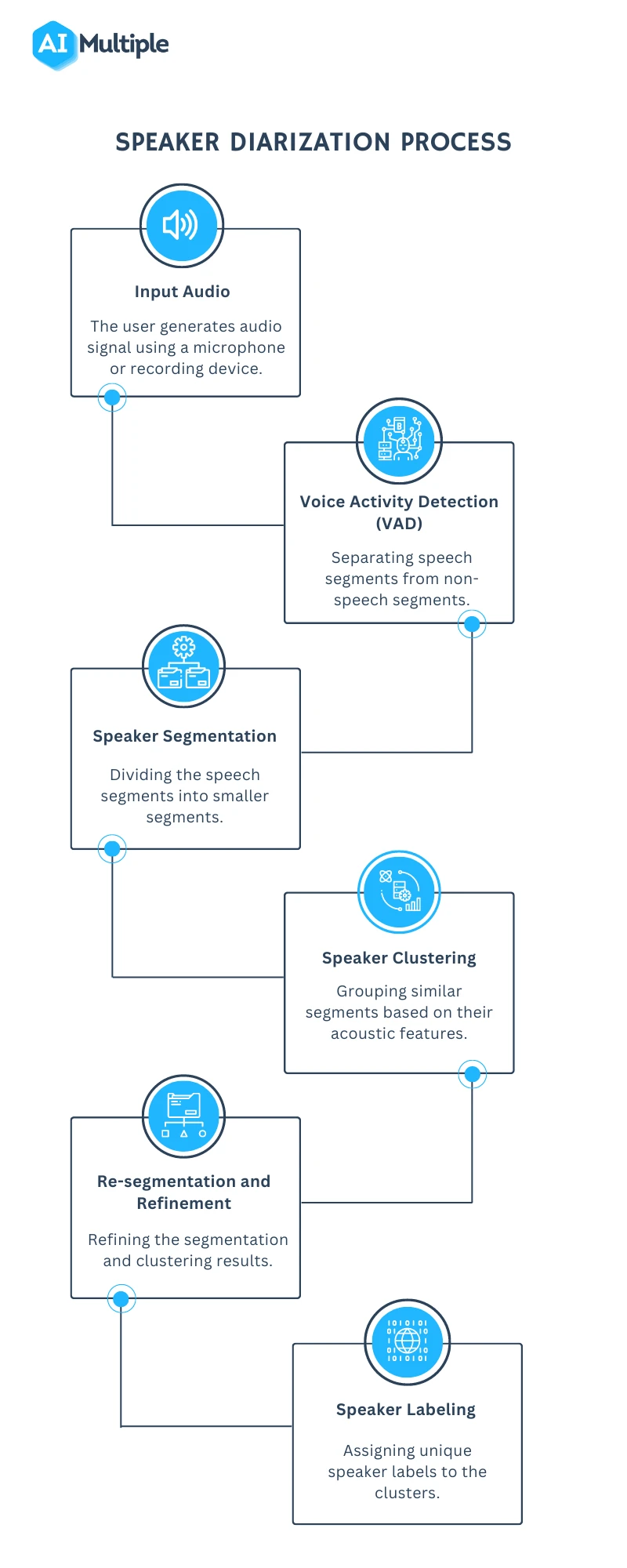

Diarisation du locuteur (SD)

L’identification des locuteurs, ou diarisation des locuteurs, est le processus qui consiste à identifier et à attribuer les segments de parole à leurs locuteurs respectifs (Figure 1). Elle permet la reconnaissance vocale spécifique au locuteur et l’identification des individus dans une conversation.

Figure 3 : Un organigramme illustrant le processus de diarisation des locuteurs

Déformation temporelle dynamique (DTW)

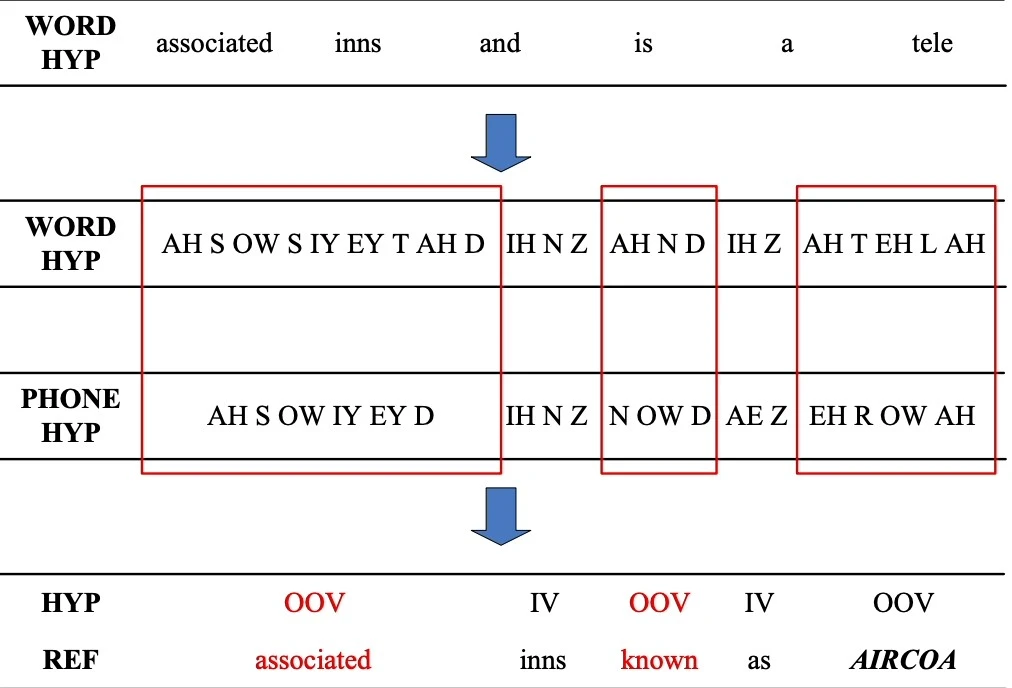

Les algorithmes de reconnaissance vocale utilisent l'algorithme Dynamic Time Warping (DTW) pour trouver un alignement optimal entre deux séquences (Figure 4).

Figure 4 : Un système de reconnaissance vocale utilisant la déformation temporelle dynamique pour déterminer la distance optimale entre les éléments. 5

Réseaux neuronaux profonds

Les réseaux neuronaux traitent et transforment les données d'entrée en simulant la perception non linéaire des fréquences du système auditif humain.

Classification temporelle connexionniste (CTC)

Il s'agit d'un objectif d'entraînement introduit par Alex Graves en 2006. Le CTC est particulièrement utile pour les tâches d'étiquetage de séquences et les systèmes de reconnaissance vocale de bout en bout. Il permet au réseau neuronal de découvrir la relation entre les trames d'entrée et d'aligner ces trames avec les étiquettes de sortie.

Quels sont les défis de la reconnaissance vocale ?

Bien que la technologie de reconnaissance vocale offre de nombreux avantages, elle se heurte encore à plusieurs défis qu'il convient de relever. Parmi les principales limitations de la reconnaissance vocale, on peut citer :

Défis acoustiques

Accents et dialectes

Les accents et les dialectes diffèrent par leur prononciation, leur vocabulaire et leur grammaire, ce qui rend difficile pour les applications de reconnaissance vocale de reconnaître la parole avec précision.

Supposons qu'un modèle de reconnaissance vocale ait été principalement entraîné sur des accents d'anglais américain. Si une personne ayant un fort accent écossais utilise le système, elle peut rencontrer des difficultés dues aux différences de prononciation. Par exemple, le mot « water » se prononce différemment selon l'accent. Si le système n'est pas familiarisé avec cette prononciation, il peut avoir du mal à reconnaître le mot « water ».

Solution : Relever ces défis est essentiel pour améliorer la précision des applications de reconnaissance vocale. Pour pallier les variations de prononciation, il est indispensable d’enrichir les données d’entraînement avec des exemples de locuteurs aux accents variés. Cette approche permet au système de reconnaître et de comprendre un plus large éventail de schémas vocaux.

bruit de fond

Le bruit de fond (par exemple, la circulation, les conversations croisées) rend difficile la distinction entre la parole et le bruit de fond pour les applications de reconnaissance vocale (voir figure 5).

Solution : Des techniques de prétraitement peuvent être utilisées pour réduire le bruit de fond dans la reconnaissance vocale, ce qui peut contribuer à améliorer les performances des modèles de reconnaissance vocale dans les environnements bruyants.

Par exemple, il est possible d'utiliser des techniques d'augmentation de données pour réduire l'impact du bruit sur les données audio. L'augmentation de données permet d'entraîner les modèles de reconnaissance vocale avec des données bruitées afin d'améliorer leur précision en situation réelle.

Figure 5 : Exemples d’une phrase cible (« Le clown avait un drôle de visage ») dans le bruit de fond de bavardages, de voitures et de pluie. 6

Défis linguistiques

Mots hors vocabulaire

Étant donné que le modèle de reconnaissance vocale n'a pas été entraîné sur les mots hors vocabulaire, il peut les reconnaître incorrectement comme différents ou ne pas parvenir à les transcrire lorsqu'il les rencontre.

Figure 6 : Un exemple de détection d'un mot hors vocabulaire.

Solution : Le taux d’erreur sur les mots (WER) est une mesure courante utilisée pour évaluer la précision d’un système de reconnaissance vocale ou de traduction automatique. Le taux d’erreur sur les mots peut être calculé comme suit :

Figure 7 : Démonstration du calcul du taux d'erreur sur les mots (WER). 7

Homophones

Les homophones sont des mots qui se prononcent de la même manière mais qui ont des significations différentes, comme « to », « too » et « two ».

Solution : L’analyse sémantique permet aux programmes de reconnaissance vocale de sélectionner l’homophone approprié en fonction de son sens dans un contexte donné. La prise en compte des homophones améliore la capacité du processus de reconnaissance vocale à comprendre et à transcrire les mots prononcés avec précision.

Défis techniques/système

confidentialité et sécurité des données

Les systèmes de reconnaissance vocale impliquent le traitement et le stockage d'informations sensibles et personnelles, notamment financières. Une personne non autorisée pourrait utiliser ces informations, ce qui entraînerait des atteintes à la vie privée.

Solution : Il est possible de chiffrer les informations audio sensibles et personnelles transmises entre l’appareil de l’utilisateur et le logiciel de reconnaissance vocale. Une autre technique permettant de garantir la confidentialité et la sécurité des données dans les systèmes de reconnaissance vocale consiste à utiliser le masquage de données. Les algorithmes de masquage de données masquent et remplacent les données vocales sensibles par des données structurellement identiques, mais acoustiquement différentes.

Figure 8 : Un exemple de fonctionnement du masquage des données.

Données d'entraînement limitées

La quantité limitée de données d'entraînement influe directement sur les performances des logiciels de reconnaissance vocale. Sans données d'entraînement suffisantes, le modèle de reconnaissance vocale peut avoir des difficultés à généraliser les différents accents ou à reconnaître les mots moins courants.

Solution : Pour améliorer la qualité et la quantité des données d'entraînement, vous pouvez étendre l'ensemble de données existant en utilisant les technologies d'augmentation de données et de génération de données synthétiques.

Soyez le premier à commenter

Votre adresse courriel ne sera pas publiée. Tous les champs sont obligatoires.