ChatGPT alcanzó los 900 millones de usuarios activos semanales y procesó aproximadamente 2.500 millones de solicitudes diarias. 1

Descubra el futuro de los modelos de lenguaje a gran escala profundizando en enfoques prometedores, como el autoaprendizaje, la verificación de datos y la experiencia limitada, que podrían abordar las limitaciones de estos modelos.

Tendencias futuras de los modelos de lenguaje a gran escala

1- Verificación de hechos en tiempo real con datos en vivo

Los modelos LLM ahora acceden a fuentes externas durante las conversaciones en lugar de depender únicamente de los datos de entrenamiento. El modelo consulta bases de datos externas, recupera información actualizada y proporciona citas.

Limitación: Aún presenta errores. Las citas no garantizan la exactitud; en ocasiones, los modelos citan fuentes incorrectamente o malinterpretan el contenido citado.

- Microsoft Copiloto: Integra GPT-5.2 con datos de internet en tiempo real. Responde preguntas basadas en eventos actuales con enlaces a las fuentes.

- ChatGPT: Realiza búsquedas en la web cuando se le pregunta sobre eventos recientes. Cita las fuentes en sus respuestas.

- Perplexity: Diseñado específicamente para búsquedas con citas. Cada respuesta incluye enlaces a las fuentes.

2- Datos de entrenamiento sintéticos

Los modelos generan sus propios conjuntos de datos de entrenamiento en lugar de requerir datos etiquetados por humanos.

Modelo de auto-mejora de Google (investigación de 2023):

- El modelo genera preguntas

- Respuestas de Curates

- Se ajusta a sí mismo en función de los datos generados.

- El rendimiento mejoró: del 74,2 % al 82,1 % en los problemas matemáticos de GSM8K, y del 78,2 % al 83,0 % en la comprensión lectora de DROP.

Figura: Descripción general del modelo de autoaprendizaje de Google

Fuente : “Los modelos de lenguaje a gran escala pueden auto-mejorarse”

Los modelos OpenAI, Anthropic y Google utilizan datos sintéticos para complementar conjuntos de datos etiquetados manualmente. Esto reduce los costos de etiquetado de datos, pero introduce nuevos riesgos de sesgo; los modelos pueden amplificar sus propios errores.

3- Modelos de expertos dispersos (mezcla de expertos)

En lugar de activar toda la red neuronal para cada entrada, solo se activa un subconjunto relevante de parámetros, según la tarea. El modelo dirige la entrada a "expertos" especializados dentro de la red. Solo los expertos activados procesan la consulta.

Ejemplos de la vida real

- Llama 4 Scout: 109 mil millones de parámetros totales, 17 mil millones activos por token. La arquitectura Mixture of Experts (MoE) ofrece una ventana de contexto de 10 millones de tokens en una sola GPU H100. 2

- Mistral Devstral 2: Diseñado específicamente para tareas de ingeniería de software. 123 mil millones de parámetros, ventana de contexto de tokens de 256 000. Alcanza un 72,2 % en SWE-bench Verified, consolidándose como el modelo de codificación de peso abierto líder. Una variante más pequeña, Devstral Small 2 (24 mil millones de parámetros), se ejecuta localmente en hardware de consumo bajo la licencia Apache 2.0. 3

- DeepSeek V3.2: 671B parámetros totales, 37B activados por token usando MoE. Introduce DeepSeek Atención Dispersa (DSA) para una inferencia de contexto largo más rápida y un costo computacional reducido. Admite Pensar en el Uso de Herramientas, lo que permite que el modelo razone dentro de flujos de trabajo de agentes mientras llama a herramientas externas. 4

4. Integración del flujo de trabajo empresarial

Los sistemas LLM están integrados directamente en los procesos empresariales, en lugar de utilizarse como herramientas independientes.

Ejemplos de la vida real

- Salesforce Agentforce (anteriormente Einstein Copilot): Integra LLM en las operaciones de CRM. Responde a las consultas de los clientes, genera contenido y ejecuta acciones en Salesforce, basándose en los datos y metadatos de CRM de la organización a través de Einstein Trust Layer. 5

- Microsoft 365 Copilot: Integrado en Word, Excel, PowerPoint y Outlook. Redacta documentos, analiza hojas de cálculo, genera presentaciones y resume hilos de correo electrónico, utilizando datos de la empresa a través de Microsoft Graph para contextualizar las respuestas dentro de la organización. 6

- Anthropic Claude para empresas: La separación de memoria basada en proyectos mantiene los contextos de trabajo diferenciados entre equipos. Claude Opus 4.6 introdujo los equipos de agentes, lo que permite que varios agentes de Claude dividan tareas grandes en flujos de trabajo paralelos, cada uno a cargo de un segmento y coordinándose con los demás simultáneamente. Esta misma versión integró Claude directamente en PowerPoint como un panel lateral nativo (vista previa de investigación), lo que permite crear y editar presentaciones dentro de la aplicación sin necesidad de transferir archivos. 7

5- Maestrías en Derecho híbridas con capacidades multimodales

Los avances futuros podrían incluir grandes modelos multimodales que integren múltiples tipos de datos, como texto, imágenes y audio, lo que les permitiría comprender y generar contenido en diferentes tipos de medios, mejorando aún más sus capacidades y aplicaciones.

- GPT-5.2: Procesa texto e imágenes de forma nativa. Genera código a partir de capturas de pantalla, analiza documentos y crea interfaces de usuario a partir de indicaciones visuales. El audio y el vídeo no son compatibles a nivel de API. 8

- Gemini 3.1 Pro: Administra de forma nativa texto, audio, imágenes, video y repositorios de código completos dentro de una ventana de contexto de 1 millón de tokens. Disponible en AI Studio, Vertex AI y NotebookLM. 9

- Los modelos de pesos abiertos de Llama 4 Scout y Maverick ( Meta) utilizan tokens multimodales de texto y visión de fusión temprana, entrenados conjuntamente desde el principio en lugar de añadirse como módulos separados. Los modelos fueron preentrenados en 200 idiomas y proporcionaron soporte específico para el ajuste fino en 12 idiomas, incluidos el árabe, el español, el alemán y el hindi. 10

La capacidad multimodal es ahora un estándar en los modelos de vanguardia. El reto restante reside en la consistencia: los modelos funcionan bien con combinaciones comunes de imagen y texto, pero su rendimiento disminuye en contextos visuales poco frecuentes, entradas de baja resolución y razonamientos multimodales que requieren la conexión de evidencia visual y textual.

6- Modelos de razonamiento

Modelos que “analizan” los problemas paso a paso en lugar de generar respuestas inmediatas.

Este cambio de la predicción al razonamiento es fundamental para posibilitar:

- Comportamiento agente , donde los modelos planifican, ejecutan y adaptan tareas de forma autónoma.

- Inteligencia artificial interpretable , donde los resultados son graduales y lógicamente sólidos, no solo plausibles.

- Claude Opus 4.6: Utiliza pensamiento adaptativo; el modelo decide dinámicamente cuándo y cuánto pensar en función de la complejidad de la tarea, sin necesidad de cambiar de modo manualmente. METR midió su horizonte de finalización de tareas en aproximadamente 14,5 horas en el umbral de éxito del 50 % (intervalo de confianza del 95 %: 6-98 horas), la estimación puntual más alta registrada hasta febrero de 2026. METR señala que el punto de referencia se está acercando a la saturación en este nivel de rendimiento, lo que significa que la cifra probablemente subestima el verdadero límite del modelo. Admite el uso de herramientas durante el razonamiento y coordina equipos de agentes para la ejecución paralela de tareas. 11 12

- Claude Sonnet 4.6: Ofrece pensamiento adaptativo a un precio más accesible (3 $/15 $ por millón de tokens). Alcanza un rendimiento similar al de Opus en pruebas comparativas de codificación y uso de computadoras (79,6 % frente a 80,8 % en SWE-bench Verified; 72,5 % frente a 72,7 % en OSWorld-Verified), lo que hace que el razonamiento extendido sea práctico a gran escala para implementaciones empresariales. Persiste una brecha mayor en tareas de razonamiento novedosas como ARC-AGI-2. 13

7- Modelos ajustados con precisión para dominios específicos

Modelos entrenados con datos especializados para industrias específicas, en lugar de un entrenamiento de propósito general.

Google, Microsoft y Meta han lanzado importantes modelos propietarios específicos de dominio y ajustados, Gemini 3.1 Pro, Microsoft 365 Copilot (GPT-5.2) y Llama 4 Scout/Maverick, respectivamente, dirigidos a casos de uso específicos de la empresa además de sus ofertas de propósito general.

Estos modelos LLM especializados pueden generar menos alucinaciones y una mayor precisión al aprovechar el preentrenamiento específico del dominio, la alineación del modelo y el ajuste fino supervisado.

Consulte los programas de máster en derecho (LLM) especializados en ámbitos específicos como la codificación, las finanzas, la sanidad y el derecho:

Programación: GitHub Copilot : Optimizado para repositorios de código. A julio de 2025, 20 millones de desarrolladores utilizan GitHub Copilot, lo que representa un aumento interanual del 400 %, y el 90 % de las empresas Fortune 100 lo utilizan. Autocompleta el código, genera funciones y sugiere correcciones de errores. 14

Finanzas: BloombergGPT : un modelo LLM de 50 mil millones de parámetros, entrenado con un conjunto de datos de 363 mil millones de tokens de documentos financieros de Bloomberg, supera a modelos de tamaño comparable en pruebas de rendimiento de PLN financiero, incluyendo análisis de sentimientos, reconocimiento de entidades nombradas y respuesta a preguntas. 15

Atención médica: Med-PaLM 2 de Google : Perfeccionado con conjuntos de datos médicos, alcanzó una precisión superior al 85 % en preguntas similares al Examen de Licencia Médica de EE. UU. (USMLE), siendo el primer LLM en alcanzar un rendimiento de nivel experto en este referente. Ahora impulsa MedLM, la familia de modelos básicos de atención médica de Google Cloud. 16

Derecho: ChatLAW , un modelo de lenguaje de código abierto entrenado específicamente con conjuntos de datos del ámbito jurídico chino. 17

8- Inteligencia artificial ética y mitigación de sesgos

Las empresas se centran cada vez más en la IA ética y la mitigación de sesgos en el desarrollo y la implementación de grandes modelos de lenguaje (LLM, por sus siglas en inglés).

Ejemplos de la vida real:

- Anthropic y OpenAI realizaron una evaluación de alineación mutua a mediados de 2025, poniendo a prueba los modelos públicos de cada uno en cuanto a adulación, tendencias a denunciar irregularidades y comportamientos de autopreservación. El ejercicio reveló adulación en todos los modelos evaluados, incluso en casos donde los modelos validaban decisiones perjudiciales de usuarios simulados con creencias delirantes. Posteriormente, Anthropic desarrolló el marco de pruebas de Bloom específicamente para evaluar este comportamiento en nuevos modelos. 18

- Google DeepMind : “La ética de los asistentes de IA avanzados”, que ofrece el primer análisis sistemático de las cuestiones éticas y sociales que plantean los agentes de IA, abarcando la alineación de valores, los riesgos de manipulación, el antropomorfismo, la privacidad y la equidad. La evaluación de IA responsable de la compañía incluyó más de 350 ejercicios de simulación de ataques (red team) y presentó un nuevo Nivel de Capacidad Crítica específicamente para la manipulación dañina, tratándola como un riesgo de vanguardia junto con los ciberataques y las amenazas CBRN. 19

- Anthropic : Opera como una corporación de beneficio público y ha publicado su metodología de IA constitucional, un conjunto transparente y auditable de principios éticos que se utilizan para entrenar los modelos Claude. En 2024, contrató a su primer investigador de bienestar en IA y, en 2025, lanzó un programa modelo de investigación de bienestar que examina cómo evaluar si los sistemas de IA merecen consideración moral. 20

Limitaciones de los modelos de lenguaje a gran escala (LLM, por sus siglas en inglés)

1- Alucinaciones

Los modelos generan información que suena plausible pero que es incorrecta.

Figura: Punto de referencia de alucinaciones para LLM populares

Fuente: Tabla de clasificación de alucinaciones de Vectara 21

Mejores resultados (2026) en la prueba comparativa de resumen de Vectara:

- Gemini 2.5 Flash-Lite: tasa de alucinaciones del 3,3%, el mejor rendimiento en el nuevo conjunto de datos más exigente.

- Mistral Large, DeepSeek V3.2, IBM Granito-4: cerca detrás

- Claude Sonnet 4.6: Alucinaciones reducidas mediante un modo de pensamiento extendido; las tasas varían según el tipo de referencia.

- GPT-5.2: Mejor señalización de incertidumbre

- Gemini 3.1 Pro: Mayor precisión en las citas; sin embargo, en el nuevo conjunto de datos Vectara, los modelos de razonamiento del 13,6 % priorizan la coherencia factual sobre la amplitud.

Nota: En el conjunto de datos Vectara, que es más exigente, la mayoría de los modelos de pensamiento/razonamiento (GPT-5, Claude Sonnet 4.5, Grok-4) muestran tasas de alucinaciones superiores al 10 %. Los modelos más ligeros y rápidos, como las variantes de Gemini Flash, superan actualmente a los modelos de vanguardia en esta prueba de rendimiento específica.

Todos los modelos presentan alucinaciones. La frecuencia se ha reducido sustancialmente, pasando de aproximadamente un 21 % en 2021 a menos del 5 % en los modelos de mejor rendimiento, pero no se ha eliminado por completo. Las aplicaciones críticas aún requieren verificación humana.

2- Sesgo

Los modelos absorben y amplifican los sesgos sociales de los datos de entrenamiento.

Figura: Puntuaciones generales de sesgo por modelos y tamaño

Fuente: Arxiv 22

Tipos de sesgo observados:

- Sesgo de género en las sugerencias de ocupación

- Sesgo racial en las simulaciones de selección de currículos

- Sesgo por edad en las recomendaciones sanitarias

- Sesgo socioeconómico en el contenido educativo

3- Toxicidad

A pesar de las medidas de seguridad, los modelos pueden generar contenido dañino, ofensivo o tóxico.

Figura: Mapa de toxicidad de los LLM

Fuente: Investigadores de UCLA y UC Berkeley 23

*GPT-4-turbo-2024-04-09*, Llama-3-70b* y Gemini-1.5-pro* se utilizan como moderadores, por lo que los resultados podrían estar sesgados en estos 3 modelos .

Las medidas de seguridad estrictas reducen la toxicidad, pero aumentan los falsos positivos (rechazo de solicitudes inofensivas). Las medidas laxas permiten el paso de la toxicidad.

4- Limitaciones de la ventana de contexto

Cada modelo tiene una capacidad de memoria que limita la cantidad de tokens que puede procesar.

Ventanas de contexto de 2026:

- Llama 4 Scout (Meta): 10 millones de tokens (~7,5 millones de palabras), la ventana de contexto verificada en producción más grande hasta febrero de 2026. 24

- Gemini 3.1 Pro: 1.048.576 tokens (~780.000 palabras) multimodal de forma nativa 25

- Claude Sonnet 4.6: 1M tokens beta (~750.000 palabras); el límite estándar es de 200K 26

- GPT-5.2: 400.000 tokens (~300.000 palabras) 27

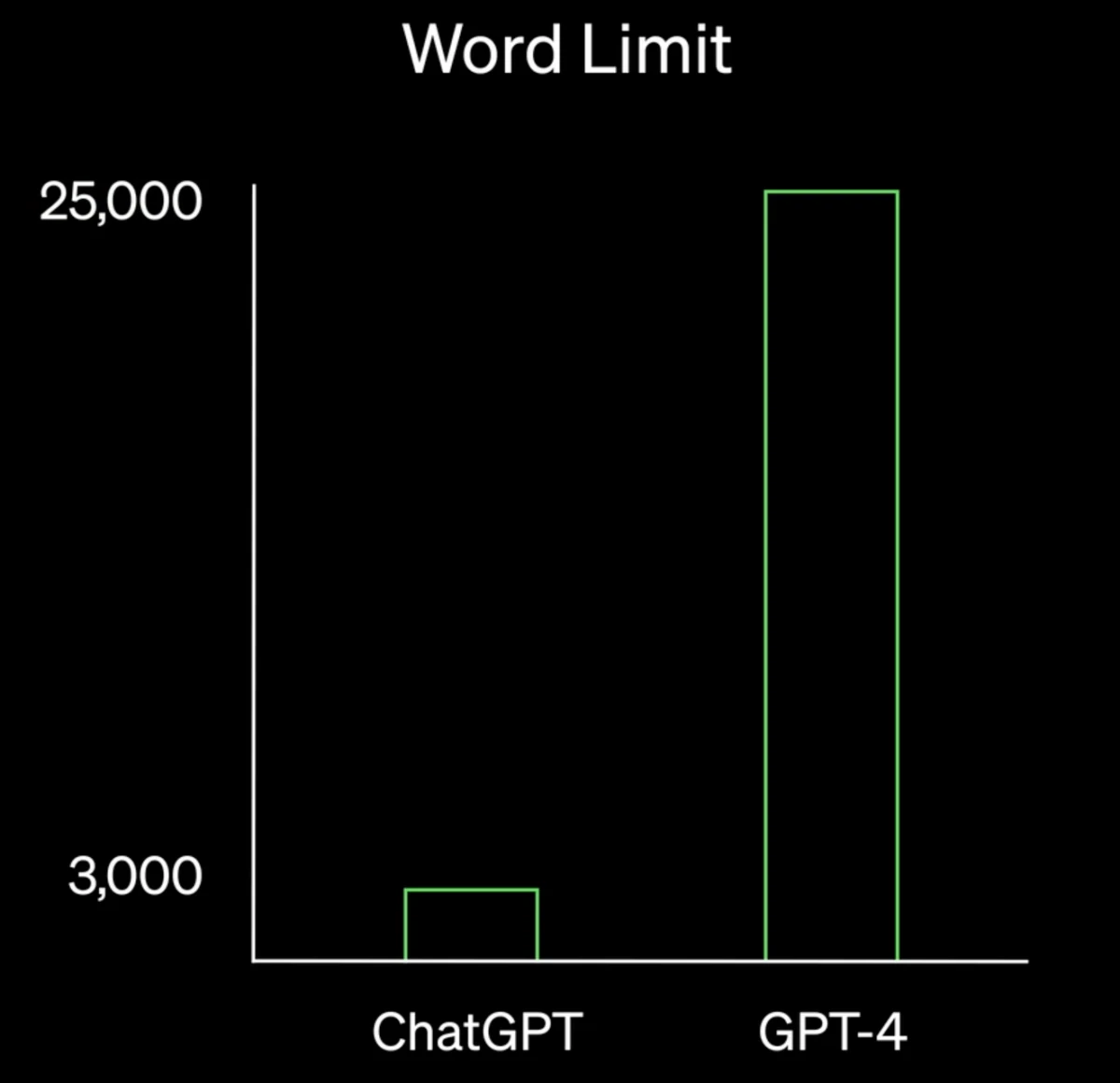

Figura: Comparación del límite de palabras entre ChatGPT y GPT-4

Fuente: OpenAI

5- Punto de corte del conocimiento estático

Los modelos se basan en conocimientos preentrenados con una fecha límite específica. No tienen acceso a la información después del entrenamiento a menos que estén conectados a fuentes externas.

Problemas:

- Información desactualizada sobre eventos actuales

- Incapacidad para afrontar los acontecimientos recientes.

- Menor relevancia en ámbitos dinámicos (tecnología, finanzas, medicina).

Solución: Integración con la búsqueda web. ChatGPT, Claude y Perplexity ofrecen búsqueda en tiempo real. Sin embargo, la búsqueda no elimina las alucinaciones; a veces, los modelos interpretan erróneamente los resultados.

Principales plataformas de LLM

GPT-5.2

Enrutamiento de modelos inteligentes: Consultas simples → respuestas rápidas, consultas complejas → análisis profundo

Multimodal: Procesar texto e imágenes. Generar código a partir de capturas de pantalla, analizar documentos, crear texto alternativo para mejorar la accesibilidad.

Mejoras respecto a GPT-4:

- Reducción de la tasa de alucinaciones

- Mejor señal de incertidumbre

- Profundidad de razonamiento a nivel de doctorado

Quiénes lo usan: Desarrolladores, empresas, creadores de contenido. La mayor base de usuarios entre los másteres jurídicos.

Limitaciones: Sigue teniendo alucinaciones. Es costoso a gran escala. La limitación del conocimiento impide obtener información en tiempo real sin tener habilitada la búsqueda web.

Claude 4 Soneto/Opus

Razonamiento híbrido: Modo rápido por defecto, modo de pensamiento extendido para problemas complejos. Puede "pensar" durante horas si es necesario.

Implementación de memoria: Activación explícita únicamente. Comienza desde cero y activa la memoria cuando se invoca mediante llamadas a herramientas (conversation_search, recent_chats). Los usuarios ven exactamente cuándo se activa la memoria.

Separación basada en proyectos: Cada proyecto tiene un espacio de memoria independiente. La hoja de ruta de la startup se mantiene separada del trabajo con los clientes.

Modo de pensamiento extendido: Uso de herramientas durante el razonamiento. La conciencia del contexto realiza un seguimiento de su propio presupuesto de tokens a lo largo de las conversaciones.

¿Quiénes lo utilizan? Desarrolladores que prefieren la transparencia, empresas que requieren control sobre la memoria/contexto y equipos que gestionan múltiples proyectos.

Limitaciones: El modo de pensamiento extendido es más lento y costoso. La disponibilidad de la versión beta con 1 millón de contextos está limitada a usuarios de nivel 4 o superior.

Gemini 2.5 Pro

Procesamiento multimodal: Manejo nativo de texto, audio, imágenes y video. Puede analizar conversaciones completas, incluyendo el contexto visual y auditivo.

Ejecución de código: Resolución dinámica de problemas mediante la generación y ejecución de código.

Gemini 3.0, previsto para el primer trimestre de 2026: procesamiento de vídeo en tiempo real a 60 fps, ventanas de contexto de millones de tokens, comprensión de objetos 3D, razonamiento integrado por defecto (sin necesidad de activación manual).

Quién lo usa: Google Clientes de la nube, desarrolladores que crean aplicaciones multimodales y empresas con necesidades complejas de análisis de documentos.

Limitaciones: La latencia de respuesta aumenta con contextos muy largos. Requiere mucha capacidad de cálculo. Ecosistema de API menos maduro que OpenAI.

Llama 4 Scout

Implementación: Una única GPU NVIDIA H100 maneja 10 millones de contextos de tokens. Multimodalidad nativa con un enfoque de fusión temprana.

¿Quiénes lo utilizan? Investigadores, organizaciones que buscan modelos de código abierto, desarrolladores que necesitan implementarlo en dispositivos y empresas que evitan depender de un único proveedor.

Limitaciones: El rendimiento varía según la configuración de alojamiento. Requiere una inversión significativa en infraestructura para un rendimiento óptimo. Ofrece un acabado menos pulido de fábrica que los modelos comerciales.

FLORACIÓN

Ha sido ampliamente reemplazado por modelos abiertos más recientes (Llama 4, Mistral, DeepSeek). Sigue disponible en Hugging Face para investigación y educación.

¿Quiénes lo siguen utilizando? Investigadores que estudian modelos multilingües, instituciones educativas y desarrolladores en comunidades lingüísticas con escasos recursos.

Limitación: Datos de entrenamiento de 2022. No hay actualizaciones de conocimiento. Los modelos abiertos más recientes lo superan en la mayoría de las pruebas comparativas.

Para un análisis comparativo de los modelos de lenguaje actuales, consulte nuestro artículo sobre ejemplos de modelos de lenguaje a gran escala .

Preguntas frecuentes

Un modelo de lenguaje a gran escala es un modelo de IA diseñado para generar y comprender texto similar al humano mediante el análisis de grandes cantidades de datos.

Estos modelos fundamentales se basan en técnicas de aprendizaje profundo y suelen implicar redes neuronales con muchas capas y un gran número de parámetros, lo que les permite capturar patrones complejos en los datos con los que se entrenan.

Sé el primero en comentar

Tu dirección de correo electrónico no será publicada. Todos los campos son obligatorios.