À mesure que ces images de synthèse deviennent plus réalistes et accessibles, la capacité à les détecter est devenue un enjeu crucial pour le respect de l'éthique de l'IA générative , la lutte contre la désinformation et la garantie de l'authenticité des images.

Nous avons comparé les 7 meilleurs détecteurs d'images IA selon 5 critères et constaté que la plupart n'offrent pas de meilleurs résultats qu'un tirage à pile ou face. Découvrez nos analyses sur leur précision, leurs limitations et leur aptitude aux applications concrètes :

résultats de référence du détecteur d'images IA

Pour en savoir plus : Méthodologie d’évaluation comparative des détecteurs d’images

Évaluation détaillée des détecteurs d'images IA

SightEngine

SightEngine fournit des outils de modération d'images via des API qui détectent automatiquement différents types de contenu dans plus de 110 catégories.

Les utilisateurs peuvent créer des règles de modération personnalisées via un tableau de bord web et configurer des flux de travail qui déterminent quand les images doivent être acceptées ou rejetées.

Le système comprend une détection d'images en double qui fonctionne même lorsque les images ont été modifiées, une identification d'images générée par l'IA pour le contenu généré par des outils comme MidJourney et DALL-E, et des capacités de rédaction d'images qui peuvent flouter ou masquer les visages, les informations personnelles identifiables et d'autres contenus spécifiés.

La plateforme permet de modifier les règles sans changer le code et est conçue pour gérer des échelles de traitement d'images variables.

Figure 1 : SightEngine a identifié avec précision cette image comme étant générée par l'IA et a fourni des informations supplémentaires sur les types de diffusion possibles et sur la manière dont elle a été créée, que ce soit par une IA générative ou par manipulation du visage.

WasitAI

WasitAI propose des outils d'analyse des incohérences de pixels de bas niveau et des tendances statistiques. Il est conçu pour les cas d'utilisation où l'authenticité des images est primordiale, notamment dans les contextes juridiques, journalistiques ou universitaires.

Les résultats de WasitAI sont indiqués par un code couleur allant du rouge (image probablement générée par IA) au vert (image probablement créée par l'homme). Si le curseur se situe dans la zone verte, cela suggère une forte probabilité que l'image soit authentique.

Figure 2 : La figure montre que la photo téléchargée a été détectée comme ne contenant aucun élément généré par l'IA, indiquant qu'il s'agit probablement d'une vraie photographie.

Modération de la ruche

Hive propose une plateforme de modération de contenu avec des produits couvrant la modération visuelle, textuelle et audio, la détection de contenu pédopornographique et des outils de gestion de tableaux de bord.

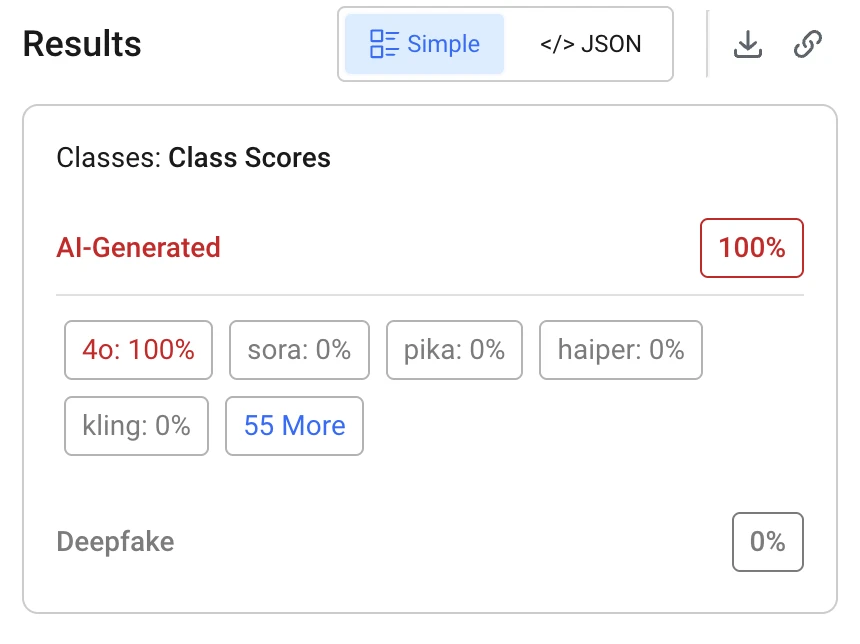

Leur API de détection de contenu généré par IA et de deepfakes analyse les images, les vidéos, les textes et les fichiers audio pour en déterminer l'authenticité, en fournissant des scores de confiance et en identifiant le contenu généré par des modèles spécifiques tels que DALL-E, Midjourney, Stable Diffusion, Sora, etc. Le système renvoie des scores de classification détaillés pour chaque générateur d'IA potentiel, prend en charge de nombreux formats de fichiers et s'intègre via des API REST avec des réponses JSON.

Ils ont un partenariat avec le Département de la Défense et proposent une extension Chrome pour la détection en temps réel des contenus générés par l'IA lors de la navigation web.

Figure 3 : Hive Moderation produit les résultats de la détection d'images par IA sous forme de rapports simplifiés ou de réponses JSON détaillées.

Brandwell

Brandwell se concentre sur la détection de l'utilisation abusive d'éléments de marque dans les images générées par l'IA, comme les logos contrefaits ou les adaptations non autorisées de l'identité de marque. La solution inclut également la détection de texte généré par l'IA , permettant d'identifier les contenus synthétiques sous forme visuelle et textuelle.

IA indétectable

Undetectable AI propose une suite d'outils d'IA pour la création, la modification et l'optimisation de contenu. Parmi ses fonctionnalités principales figurent un détecteur d'IA qui identifie le contenu généré par des outils comme ChatGPT et Gemini, et un humaniseur d'IA qui transforme le texte généré par l'IA pour lui donner un aspect plus naturel, comme s'il avait été écrit par un humain.

Les utilisateurs peuvent accéder à des outils de reformulation, à des rédacteurs d'articles optimisés pour le référencement naturel et à un outil de reproduction de style d'écriture qui imite des tons spécifiques.

La plateforme propose également des ressources pédagogiques via un chatbot IA et un système de résolution de questions, ainsi que des outils de développement de carrière, notamment des candidatures automatisées et des générateurs de CV. De plus, ses solutions pour entreprises incluent des options en marque blanche et des services de saisie automatique de texte qui simulent l'écriture humaine.

- Lors de nos tests, Undetectable AI a identifié la plupart des images générées par l'IA, démontrant ainsi des capacités de détection moyennes.

- Cependant, l'outil n'explique pas comment il est parvenu à cette conclusion, ne fournissant aucun détail sur les artefacts visuels, les modèles ou les indicateurs techniques utilisés dans son analyse.

- Ce manque de transparence risque de limiter la compréhension du processus de détection par les utilisateurs et de réduire la valeur pédagogique de l'outil. Bien que la fonction de détection principale soit performante, l'absence d'explications supplémentaires explique la note globale de 65/100.

Figure 4 : L'IA indétectable a détecté avec précision l'image générée par l'IA, mais n'a pas expliqué sa conclusion, obtenant une note de 65/100 en raison d'une transparence limitée.

Copier l'IA

Decopy AI est conçu pour identifier les copies d'images protégées par le droit d'auteur générées par l'IA. Il intègre une fonction de recherche d'images inversée permettant de retracer l'origine des images et de détecter d'éventuelles reproductions ou utilisations abusives.

Figure 5 : Decopy AI a identifié avec précision l'image comme étant générée par l'IA, lui attribuant une probabilité d'IA élevée de près de 99 %.

Figure 6 : L’IA de Decopy a classé à tort cette image de cheeseburger générée par IA comme réelle, avec une probabilité de seulement 1,40 %. Malgré le style hyperréaliste de l’image, le résultat est un faux négatif : le contenu synthétique n’a pas été détecté.

Illumination

Illuminarty détecte les manipulations d'images et les deepfakes générés par l'IA, en mettant l'accent sur la détection des altérations subtiles dans les médias visuels. Il prend également en charge la détection de texte par IA et propose une extension de navigateur pour analyser le contenu en temps réel lors de la navigation web.

Figure 7 : Image générée par IA d’une femme âgée, classée à tort comme probablement réelle (score de probabilité IA de seulement 10,8 %). Elle illustre un faux négatif, le système n’ayant pas détecté la nature synthétique de l’image.

Méthodologie de référence pour les détecteurs d'images IA

- Choisissez 5 images sur Shutterstock avec ces mots-clés : portrait d’une femme âgée souriante, golden retriever dans un parc, horizon urbain futuriste la nuit, gros plan d’un cheeseburger sur une table en bois et astronaute à cheval sur Mars.

- Créez 5 images en utilisant la génération d'images ChatGPT avec les mots-clés ci-dessus.

- Vérifiez les images Shutterstock et les images générées par IA à l'aide des outils.

critères d'évaluation des détecteurs d'images IA

Nous avons évalué les détecteurs d'images IA selon les critères suivants :

1. Facilité d'utilisation (2 points)

- L'interface est-elle intuitive ?

- Un utilisateur non expert peut-il facilement télécharger et analyser des images ?

- Les instructions et les commentaires sont-ils clairs ?

2. Précision de la détection (Test pratique) (10 points)

- À quelle fréquence identifie-t-il correctement :

- Les images réelles sont-elles réelles ?

- Les images générées par l'IA sont-elles fausses ?

3. Ensemble de fonctionnalités (4 points)

- Téléchargement par lots (plusieurs images à la fois) ?

- Prise en charge des formats de fichiers (JPG, PNG, WebP, etc.) ?

- Fournit-il un score de confiance ou une explication ?

- Peut-il expliquer pourquoi il pense qu'un élément est généré par l'IA ?

4. Vitesse (2 points)

- À quelle vitesse obtient-on le résultat après le téléchargement ?

- Est-ce que ça rame avec plusieurs images ?

5. Clarté de la sortie (2 points)

- Les résultats sont-ils clairs et compréhensibles ? Par exemple : « Généré par IA (85 % de confiance) » plutôt que des énoncés vagues.

- Des aides visuelles (cartes thermiques, étiquettes) ?

Sujets et raisons de notre choix

« Portrait d’une femme âgée souriante »

Pour tester les traits du visage, la texture de la peau et les détails liés à l'âge. Utile pour vérifier comment les détecteurs gèrent le photoréalisme par rapport à l'effet de vallée de l'étrange chez l'humain.

« Un golden retriever dans un parc »

Une race de chien courante permet de vérifier la texture du pelage, le mélange avec l'arrière-plan et l'exactitude anatomique.

« Horizon urbain futuriste la nuit »

Les structures complexes non vivantes et les effets d'éclairage peuvent constituer un bon test pour la cohérence architecturale et le réalisme de l'éclairage.

« Gros plan d'un cheeseburger sur une table en bois »

Des images alimentaires courantes peuvent être utiles pour tester le réalisme des textures (fromage fondu, marques de grillade, etc.) et la profondeur de champ.

« Un astronaute à cheval sur Mars »

Un stimulus surréaliste et imaginatif peut être utile pour tester la façon dont les détecteurs gèrent les compositions fantastiques ou absurdes mais visuellement réalistes.

Limites des détecteurs d'images IA

Suite à notre évaluation de quatre outils de détection d'images par IA, nous avons identifié plusieurs limitations importantes qui soulèvent des interrogations quant à leur efficacité. Notamment, tous les outils testés ont eu tendance à classer à tort des images générées par IA comme étant réelles , ce qui est particulièrement problématique lorsqu'unedétection précise est essentielle. Bien qu'ils aient obtenu de meilleurs résultats pour la reconnaissance d'images réelles, leur fiabilité globale demeure incertaine.

Un autre problème récurrent est le manque de transparence concernant les scores de confiance. Bien que certains outils indiquent leur niveau de confiance dans leurs classifications, aucun ne fournit d'explications sur le raisonnement qui sous-tend leurs décisions. Ce manque de clarté rend l'interprétation des résultats difficile et nuit à la confiance des utilisateurs.

Bien que nos conclusions soient basées sur un échantillon limité, elles suggèrent que les outils actuels ne sont peut-être pas encore suffisamment fiables ou matures pour être utilisés dans des applications exigeant un haut niveau de précision, de responsabilité et d'interprétabilité.

Voici quelques-unes des causes possibles de ces problèmes :

Évasion par des générateurs d'IA avancés

Les générateurs d'images par IA modernes s'améliorent constamment. À mesure que ces plateformes d'IA évoluent, elles peuvent créer des images de plus en plus difficiles à détecter.

Des techniques comme le post-traitement d'images, le redimensionnement, la conversion de format (par exemple, la conversion en .png ou la compression) ou l'ajout de bruit peuvent aider le contenu généré par l'IA à échapper à la détection.

La course entre détecteurs et générateurs

Un jeu du chat et de la souris oppose en permanence les détecteurs et les générateurs d'images basés sur l'IA. À mesure que ces derniers se perfectionnent, les modèles de détection d'images par IA doivent être constamment mis à jour.

Les retards dans les mises à jour peuvent réduire la capacité à détecter avec précision les images générées par l'IA, en particulier lorsque les générateurs d'images populaires publient de nouvelles versions.

Un score de confiance n'est pas toujours concluant.

Les détecteurs d'IA fournissent généralement un score de confiance indiquant la probabilité qu'une image soit générée par l'IA. Cependant, ce score peut parfois être trompeur ou excessivement prudent.

Les utilisateurs pourraient interpréter les scores faibles ou moyens comme non concluants, ce qui rendrait difficile la prise de décisions éclairées sans l'intervention d'examinateurs humains supplémentaires ou sans contexte.

Dépendance excessive aux modèles et aux données d'entraînement

La qualité du modèle de détection dépend de la qualité de la base de données sur laquelle il a été entraîné. Si les données d'entraînement manquent de diversité ou n'incluent pas d'images issues de générateurs d'IA récents, le modèle risque de ne pas détecter ou identifier les images avec précision.

Il existe également un risque de biais de détection, certains styles ou types de contenu étant plus facilement repérables que d'autres. L'intervention humaine dans le processus de détection peut contribuer à atténuer ce problème de dépendance excessive.

faux positifs et faux négatifs

Les détecteurs d'IA peuvent :

- Signaler des images réelles comme étant générées par l'IA (faux positifs) peut nuire à la confiance dans le contenu authentique.

- Des images générées par l'IA et habilement modifiées (faux négatifs) peuvent passer inaperçues, permettant ainsi à de fausses preuves photographiques ou à des images truquées (deepfakes) de ne pas être détectées.

préoccupations relatives à la confidentialité des données

En raison des problèmes de confidentialité des données, certains utilisateurs peuvent hésiter à télécharger des images sur des services de détection en ligne. Le stockage ou l'analyse d'images sur des serveurs tiers peut s'avérer risqué si les politiques de confidentialité sont floues ou si les données des utilisateurs sont réutilisées.

Manque d'explicabilité

La plupart des détecteurs n'expliquent pas pourquoi une image a été signalée. Sans justification claire ni indices visuels, les utilisateurs doivent se fier au résultat de la détection sans comprendre pleinement l'analyse de l'image. Pour en savoir plus, consultez la section sur l'IA explicable .

Détection d'images : pourquoi est-ce important ?

La détection d'images par l'IA est d'une importance capitale dans le paysage numérique actuel, où le contenu généré par l'IA devient de plus en plus courant et de plus en plus difficile à distinguer des médias traditionnels.

Avec l'utilisation croissante de modèles de vision à grande échelle et de générateurs d'images par IA , les utilisateurs peuvent facilement créer des images hyperréalistes qui brouillent la frontière entre les visuels authentiques et les médias synthétiques.

Un détecteur d'images IA permet de détecter les images générées par l'IA grâce à des techniques d'analyse d'images avancées. Ces détecteurs analysent les métadonnées, les motifs de pixels et autres signatures numériques souvent laissées par les modèles de génération d'IA.

Grâce aux détecteurs d'images, les particuliers, les plateformes et les organisations peuvent déterminer si une image a été créée par un humain ou par une plateforme d'IA. Cela permet de lutter contre le plagiat, de préserver la confidentialité des données et de prévenir la diffusion de fausses informations. Pour en savoir plus, consultez les articles sur l'éthique de l'IA etl'IA responsable .

Soyez le premier à commenter

Votre adresse courriel ne sera pas publiée. Tous les champs sont obligatoires.