Le marché des plateformes d'IA responsable comprend deux types de logiciels. Suivez les liens pour en savoir plus :

Plateformes d'IA responsables axées sur les entreprises, telles que :

- Credo AI et Watsonx.governance pour la gouvernance de l'IA

- Amazon SageMaker et Dataiku pour le MLOps avec des fonctionnalités d'IA responsable

- Databricks et IBM Watsonx.data intelligence pour une plateforme de données avec des fonctionnalités d'IA responsable

Bibliothèques d'IA responsables open source offrant des fonctionnalités spécifiques (par exemple, l'apprentissage fédéré) :

- TensorFlow Federated (TFF) pour la confidentialité

- L'équité en IA à 360° pour l'équité

- Dalex pour l'explicabilité (c.-à-d . XAI )

- TextAttack pour l'apprentissage automatique adverse

Ces outils sont reconnus comme leaders du marché selon des critères tels que le nombre d'avis, les fonctionnalités, les scores GitHub et les références au classement Fortune 500. Découvrez leurs cas d'utilisation et leurs domaines d'expertise (MLops, gouvernance de l'IA, gouvernance des données, etc.) en suivant les liens correspondants.

Plateformes d'IA responsables pour les entreprises

Plate-forme | Taper | nombre d'employés | Notation |

|---|---|---|---|

IA holistique | Gouvernance de l'IA | 85 | Avis insuffisants |

Credo IA | Gouvernance de l'IA | 49 | Avis insuffisants |

IA équitable | Gouvernance de l'IA | 13 | Avis insuffisants |

Aporie | MLOP | 359 | 4.8 basé sur 68 reviews |

Dataiku | MLOP | 1,378 | 4.5 basé sur 198 reviews |

Amazon SageMaker | MLOP | 130,371 | 4.5 basé sur 49 reviews |

Databricks | gouvernance des données | 9,280 | 4.6 basé sur 655 reviews |

IBM Watsonx | gouvernance des données | Note de 4,07 basée sur 30 avis | |

Snowflake | gouvernance des données | 8,441 | 4.6 basé sur 770 reviews |

IA experte | NLP responsable | 278 | Avis insuffisants |

* Ces outils sont classés par ordre alphabétique au sein de leur catégorie, à l'exception des sponsors qui figurent en haut de la liste.

plateformes de gouvernance de l'IA

Les outils de gouvernance de l'IA aident les unités commerciales à déployer des systèmes d'IA conformes aux normes de l'industrie.

Credo IA

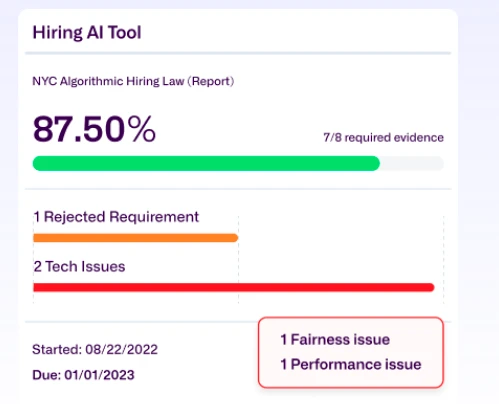

Credo AI, une plateforme de gouvernance de l'IA responsable, peut aider les entreprises :

- Collaborer grâce à des outils tels que la collecte de preuves, le suivi des responsabilités et la simplification des achats auprès de tiers.

- Évaluer les systèmes d'IA en fonction des risques opérationnels, réglementaires et de réputation tout au long de leur cycle de vie

- Élaborer des outils de gouvernance en traduisant les données techniques en documents conviviaux, en créant des fiches modèles, des rapports d'audit, des rapports sur les risques et la conformité, ainsi que des informations à divulguer.

- Assurez la conformité aux réglementations internationales telles que la loi européenne sur l'IA et la loi canadienne sur les données et l'IA, aux politiques internes et aux normes de l'industrie.

IA équitable

Fairly AI, désormais propriété d'Asenion, est un outil de gouvernance de l'IA qui simplifie la validation des modèles, les processus d'audit et les évaluations des risques, garantissant ainsi la conformité réglementaire et la gestion des risques. Le cadre d'IA responsable de Fairly AI identifie les lacunes des politiques et réglementations, facilitant le choix des politiques appropriées et assurant une couverture complète pour une gouvernance et une gestion des risques efficaces en matière d'IA.

IA holistique

Holistic AI propose des cadres de gestion des risques, de conformité et de gouvernance de l'IA pour aider les entreprises à mettre en œuvre l'IA de manière responsable.

- Évaluation des biais par l'identification et l'atténuation des biais dans les systèmes d'IA, offrant des stratégies concrètes, un soutien continu et des rapports d'audit complets pouvant être partagés avec les parties prenantes.

- Évaluation de la conformité par le catalogage et la validation des systèmes d'IA à haut risque par rapport aux exigences de la loi sur l'IA, la réalisation d'évaluations des risques avec des stratégies d'atténuation et la garantie que la documentation technique est conforme aux normes légales.

- Gestion proactive des risques grâce à la réception de rapports réguliers et à la réalisation d'auto-audits pour détecter les impacts négatifs, tout en utilisant des données pour optimiser l'utilisation de l'IA et éclairer les décisions stratégiques.

IBM Watsonx.gouvernance

IBM Watsonx.governance peut améliorer la confiance et la transparence de l'IA en fournissant une visibilité de niveau entreprise, un suivi des actifs d'IA et la conformité des flux de travail des données et de l'IA dans divers environnements de déploiement, y compris IBM Cloud et AWS.

Les utilisateurs de Watsonx.governance peuvent intégrer d'autres outils IBM watsonx studio comme watsonx.ai et watson.data pour entraîner, valider, optimiser et déployer l'IA.

MLOps

Amazon SageMaker et Amazon Bedrock

Amazon fournit des outils conçus pour aider les équipes de conformité à mettre en œuvre des systèmes d'IA responsables, tels que :

- Sur Amazon Bedrock : un service entièrement géré qui simplifie le développement d’applications d’IA générative en fournissant un accès à des modèles de base performants sans nécessiter de préparation des données, de construction de modèles ou de gestion de l’infrastructure.

- Garde-fous : Met en œuvre des mécanismes de protection dans l'IA générative en spécifiant les sujets à éviter et en détectant et empêchant automatiquement les requêtes et réponses restreintes.

- Évaluation des modèles : Évalue et compare les modèles de la Fondation en fonction de métriques personnalisées telles que la précision et la sécurité afin de sélectionner le meilleur modèle pour des cas d’utilisation spécifiques.

- Sur Amazon SageMaker : une plateforme d’apprentissage automatique qui propose des processus de création, d’entraînement et de déploiement de modèles, ce qui la rend idéale pour les tâches d’apprentissage automatique personnalisées telles que l’analyse prédictive, les systèmes de recommandation et la détection d’anomalies.

- Clarify : Détecte les biais potentiels et fournit des explications sur les prédictions du modèle, offrant transparence et éclairage pour garantir des décisions d'IA justes et éclairées.

- Moniteur de modèles : Surveille les modèles déployés en détectant et en signalant automatiquement les prédictions inexactes afin de maintenir la qualité des modèles.

- Gouvernance du ML : Améliore la gouvernance en offrant des outils de contrôle et de surveillance des modèles de ML, notamment la capture et le partage d’informations sur les modèles afin de garantir un déploiement responsable de l’IA.

- Amazon Augmented AI : facilite la vérification humaine des prédictions d’apprentissage automatique, permettant une supervision lorsque le jugement humain est requis.

Découvrez comment Amazon Bedrock propose une IA responsable :

Aporie

La plateforme Aporia Responsible AI offre une gouvernance complète pour les projets d'IA grâce à :

- Garantir la diversité des données, évaluer les indicateurs d'équité et surveiller les systèmes de détection des biais afin de maintenir des normes éthiques en matière d'IA

- Se conformer à réglementations telles que le RGPD et autres normes sectorielles

- Promouvoir la responsabilisation et la transparence grâce à une IA explicable, en veillant à ce que les processus de prise de décision de l'IA soient compréhensibles.

Dataiku

Dataiku est une plateforme d'apprentissage automatique et de science des données permettant de concevoir, déployer et gérer des projets de données, d'analyse et d'IA. Elle peut favoriser une IA responsable au sein de ces projets grâce à plusieurs fonctionnalités clés :

- Analyse statistique avancée : Permet une analyse approfondie des données afin d'identifier et de corriger les biais potentiels.

- Rapports sur l'équité des modèles : Fournit des indicateurs tels que la parité démographique et les chances égalisées pour mesurer et atténuer les biais.

- IA explicable : Offre des explications au niveau des lignes et des analyses de scénarios pour garantir la transparence et la responsabilité.

- Conformité en matière de protection des données : Garantit le respect des réglementations telles que le RGPD et le CCPA.

- Documentation du modèle : Automatise la création d’une documentation détaillée du modèle à des fins réglementaires et internes.

- Outils de gouvernance : Met en œuvre des plans de projet et des schémas de flux de travail standardisés afin de s'aligner sur les pratiques d'IA responsable et les exigences réglementaires.

gouvernance des données

La gouvernance des données désigne le cadre global qui aligne les pratiques relatives aux données sur les objectifs commerciaux et les structures de responsabilité. Elle trouve une application importante dans les applications d'apprentissage automatique, où l'on parle alors de gouvernance des données d'apprentissage automatique .

Databricks

Databricks est une plateforme unifiée de données et d'IA qui garantit la propriété et le contrôle des données pour les modèles d'IA grâce à une surveillance complète, des contrôles de confidentialité et une gouvernance. Databricks propose une IA responsable grâce à son cadre de tests d'IA responsable, qui comprend :

- Équipe rouge d'IA pour identifier les vulnérabilités

- Enquête automatisée et manuelle sur les biais et les problèmes éthiques

- Tests de jailbreak pour comprendre le comportement du modèle sous attaques

- Modéliser la sécurité de la chaîne d'approvisionnement pour protéger les systèmes d'IA tout au long de leur cycle de vie.

IBM Watsonx.data intelligence

Watsonx.data intelligence est une plateforme de gouvernance et d'analyse des données qui garantit des données de haute qualité, conformes et exploitables par les entreprises pour les modèles d'IA. Elle permet une IA responsable grâce à ses fonctionnalités d'analyse des données pilotées par l'IA, notamment :

- L'accès au langage naturel permet aux utilisateurs de tous niveaux de compétence de rechercher et d'exploiter efficacement les données.

- Découverte et catalogage automatisés des données issues de sources structurées et non structurées

- Gouvernance des données et contrôles de qualité, notamment la traçabilité, la classification et l'analyse d'impact

Enrichissement et normalisation des données par l'IA pour des ensembles de données cohérents et utilisables

Snowflake

Snowflake est une plateforme de données cloud dédiée au stockage, au traitement et à l'analyse des données, aidant les entreprises à gérer et à exploiter efficacement leurs données. Son approche responsable de l'IA met l'accent sur la sécurité des données, leur diversité et la maturité organisationnelle, garantissant ainsi que les applications d'IA reposent sur une infrastructure de données sécurisée, diversifiée et bien gouvernée. De plus, Snowflake encourage la culture des données et la collaboration interfonctionnelle afin de promouvoir une utilisation responsable de l'IA au sein des organisations.

Outils et bibliothèques d'IA responsable open source

Ces outils sont classés selon leur score GitHub dans leur catégorie. Veuillez noter que les bibliothèques obsolètes sont exclues de cette liste.

confidentialité de l'IA

Ces bibliothèques privilégient l'utilisation de l'IA à des fins légitimes, tout en évitant les applications contraires à l'éthique. Les organisations qui adhèrent aux normes éthiques de l'IA mettent en œuvre des directives strictes, des processus d'examen rigoureux et des objectifs clairs afin de garantir la conformité.

- TensorFlow Privacy : Une bibliothèque Python offrant des implémentations d'optimiseurs TensorFlow pour l'entraînement de modèles d'apprentissage automatique avec confidentialité différentielle.

- TensorFlow Federated (TFF) : Conçu pour soutenir la recherche ouverte et l'expérimentation dans l'apprentissage fédéré (FL), où un modèle global est entraîné sur plusieurs clients sans partager leurs données locales.

- Deon : Un outil en ligne de commande permettant d'ajouter une liste de contrôle éthique aux projets de science des données, promouvant les considérations éthiques et fournissant des rappels concrets aux développeurs.

Transparence et biais de l'IA

Les bibliothèques de transparence en IA permettent aux parties prenantes de comprendre et d'expliquer les modèles d'IA, garantissant ainsi la transparence des motivations, des données et des intentions qui sous-tendent ces modèles.

- Model Card Toolkit (MCT) : Automatise la création de Model Cards, qui sont des documents offrant un contexte et une transparence concernant le développement et les performances d'un modèle.

Justice

L'équité en IA implique de protéger les individus et les groupes contre la discrimination, les préjugés et les mauvais traitements. Les modèles doivent être évalués afin de prévenir les biais à l'encontre de groupes, de facteurs ou de variables spécifiques.

- AI Fairness 360 : Une boîte à outils open-source de IBM offrant des techniques pour détecter et atténuer les biais dans les modèles d'apprentissage automatique tout au long du cycle de vie de l'IA.

- Fairlearn : Un package Python qui aide les développeurs à évaluer l'équité de leurs systèmes d'IA et à atténuer les biais identifiés, en proposant à la fois des algorithmes d'atténuation et des métriques pour l'évaluation des modèles.

- Responsible AI Toolbox : Une suite d'outils de Microsoft qui fournit des interfaces pour explorer et évaluer les modèles et les données d'IA, facilitant le développement et le déploiement de systèmes d'IA de manière sûre et éthique.

Explicabilité de l'IA

Les bibliothèques d'explicabilité de l'IA contribuent à améliorer la compréhension et la confiance des humains dans les résultats des algorithmes d'apprentissage automatique.

- DALEX : Un package indépendant du modèle qui aide à explorer et à expliquer le comportement des modèles, facilitant ainsi la compréhension des modèles complexes.

- Validation de données TensorFlow (TFDV) : Une bibliothèque pour explorer et valider les données d'apprentissage automatique, optimisée pour l'évolutivité et l'intégration avec TensorFlow et TensorFlow Extended (TFX).

Apprentissage automatique adverse

L'apprentissage automatique adverse est une technique qui tente d'exploiter les modèles d'intelligence artificielle en utilisant des informations accessibles pour créer des attaques malveillantes.

- TextAttack : Un framework Python pour les attaques adverses, l'entraînement et l'augmentation des données en NLP, rationalisant le processus de test et améliorant la robustesse des modèles NLP.

Qu’est-ce que l’IA responsable ?

Les 4 principes directeurs de l'IA , également connus sous le nom d'intelligence artificielle responsable (IA), visent à instaurer la confiance dans les solutions d'IA en appliquant un ensemble de principes qui sont :

- Justice

- Confidentialité

- Sûreté et sécurité

- Transparence

Ces principes contribuent à orienter la conception, le développement, le déploiement et l'utilisation de l'IA.

Pourquoi une IA responsable est-elle importante ?

Comme Les statistiques sur l'IA et les tendances en matière d'automatisation informatique indiquent :

- D'ici l'année prochaine, 90 % des applications d'entreprise commerciales intégreront des fonctionnalités d'IA.

- Neuf entreprises de premier plan sur dix investissent dans les technologies d'IA. Suite au lancement de ChatGPT en 2022, les entreprises ont fait état d'un

- Augmentation de 97 % de l'intérêt pour le développement de l'IA générative.

- Augmentation de 72 % de l'adoption des pipelines d'apprentissage automatique pour soutenir les stratégies d'IA générative.

Cette adoption croissante de l'IA et des outils d'IA générative suscite des inquiétudes et des précautions, telles que :

- 71 % des responsables informatiques s’inquiètent des vulnérabilités de sécurité des LLM et des risques liés à l’IA générative .

- 77 % des entreprises donnent la priorité à la conformité en matière d'IA .

- 69 % des entreprises ont mis en œuvre des pratiques d'IA responsables pour évaluer la conformité et identifier les risques. 9

- Les lois sur la protection des données, notamment le RGPD (UE) et le CCPA (Californie), visent à prévenir les atteintes à la vie privée.

- La loi européenne sur l'IA exige des organisations qu'elles tiennent à jour et précises leurs inventaires d'IA.

- Augmentation des cas de biais liés à l'IA , tels que le racisme, le sexisme, le validisme et l'âgisme.

FAQ

La gouvernance des données englobe les cadres et les outils utilisés par les organisations pour protéger et exploiter correctement leurs données. Parmi les méthodes, processus et technologies de la gouvernance des données, on peut citer :

1- Collecte de données

2- Stockage des données

3- Traitement des données

4- Nettoyage des données

5- Gestion des données

6- Partage de données contrôlé pour :

6.a- Protection de la confidentialité des données

6.b- Maintenir la qualité des données

6.c- Soutenir la conformité aux réglementations pertinentes .

7- Gestion des menaces internes (GMI) .

L'IA fiable désigne les systèmes d'IA qui fonctionnent de manière constante comme prévu : avec précision, robustesse et sécurité dans différentes conditions.

L'IA fiable est un terme pertinent pour désigner l'IA responsable, car la confiance, l'équité et la conformité reposent sur des systèmes au comportement prévisible. Les outils d'IA responsable garantissent la fiabilité grâce à la surveillance des modèles, aux tests de biais, à l'explicabilité et à la conformité réglementaire.

Pour en savoir plus

Découvrez d’autres outils et pratiques pour atténuer les risques liés à l’IA générative, tels que :

- Outils de sécurité LLM

- technologies renforçant la confidentialité

- Outils LLMOps

- Outils MLOps

- Outils de gouvernance de l'IA.

Soyez le premier à commenter

Votre adresse courriel ne sera pas publiée. Tous les champs sont obligatoires.