Les applications basées sur LLM deviennent plus performantes et de plus en plus complexes, ce qui rend leur comportement plus difficile à interpréter.

Chaque résultat de modèle résulte d'instructions, d'interactions avec des outils, d'étapes de récupération et d'un raisonnement probabiliste qui ne peut être inspecté directement. L'observabilité LLM relève ce défi en offrant une visibilité continue sur le fonctionnement des modèles en conditions réelles. Elle permet aux organisations de contrôler la qualité, de détecter les défaillances, de résoudre les problèmes liés aux flux de travail complexes et de gérer les performances et les coûts.

Outil | Idéal pour |

|---|---|

Réaliser des expériences fréquentes et comparer les invites/modèles avec un système de versionnage et des tableaux de bord robustes. | |

Langfuse | Observabilité open source et auto-hébergée avec des traces granulaires et des évaluations personnalisables. |

Hélicone | Configuration sans code pour la surveillance de base, le suivi des coûts et la mise en cache des appels d'API LLM. |

Langsmith | Création de chaînes ou d'agents à plusieurs étapes (notamment avec LangChain) avec une visibilité détaillée des traces. |

Groupe de réflexion | Évaluation automatisée, alertes et surveillance de la qualité de la production. |

Poids et biais (Tissage W&B)

W&B Weave est la plateforme d'observabilité LLM de Weights & Biases, conçue pour la surveillance, l'évaluation et l'optimisation des applications de modèles de langage. Grâce au décorateur @weave.op, Weave suit automatiquement chaque appel LLM et capture les entrées, les sorties, les coûts, la latence et les métriques d'évaluation, sans configuration manuelle.

La plateforme assure le suivi de l'utilisation des jetons et calcule automatiquement les coûts, surveille les temps de réponse pour détecter les requêtes lentes et mesure la précision en comparant les prédictions aux résultats attendus. Différentes expériences peuvent être comparées afin d'identifier le modèle ou l'invite le plus performant. Le suivi des erreurs indique les prédictions ayant échoué et leurs causes, tandis que le versionnage automatique conserve chaque modification de configuration pour garantir la reproductibilité. Il est ainsi facile de tester différentes approches, d'identifier la solution optimale et de corriger les problèmes liés aux erreurs de modélisation.

Tableau de bord récapitulatif des scores

Figure 1 : Graphiques montrant le tableau de bord des indicateurs de performance du modèle, suivant l'évolution de la précision, du coût et de la latence au fil du temps.

Les indicateurs de performance sont affichés pour toutes les évaluations. Le coût total, la consommation de jetons et les temps de réponse sont présentés sous forme de graphiques illustrant leur évolution. Les indicateurs personnalisés, tels que la précision et les taux d'erreur, apparaissent dans des panneaux distincts. Les courbes de tendance permettent de repérer les baisses de performance ou les augmentations inattendues des coûts ; le tableau de bord se met à jour automatiquement à la fin de chaque test.

Vue des traces

Figure 2 : Tableau de suivi d'évaluation montrant les versions du modèle et leurs résultats de classification d'intention.

Chaque exécution de test est enregistrée avec tous les détails. Chaque trace indique le modèle utilisé, l'invite envoyée et tous les paramètres. Des indicateurs de réussite ou d'échec signalent si les tests ont été correctement exécutés. La colonne « Invite » affiche le texte envoyé au modèle pour vérification. Cet enregistrement permet de comparer différentes versions, d'identifier les modifications entre les exécutions et de reproduire n'importe quel test en utilisant sa configuration enregistrée.

Tableau comparatif des modèles

Figure 3 : Image montrant le classement comparant les versions du modèle de classification d'intention selon des métriques de précision et de latence.

Il est possible de comparer différents modèles et paramètres sur les mêmes données de test. Les colonnes affichent la précision, les prédictions correctes, les scores et les temps de réponse. Un code couleur (en vert) met en évidence les performances les plus élevées. Cette comparaison révèle les compromis possibles, comme une précision accrue au détriment de la vitesse d'exécution, ou des réponses plus rapides avec une précision légèrement inférieure, permettant ainsi de choisir la configuration la mieux adaptée aux besoins de production.

Versionnage du modèle

Figure 4 : Panneau de configuration du classificateur d'intention affichant les paramètres du modèle et les détails de la version.

Chaque modification de configuration crée automatiquement une nouvelle version, conservant ainsi un historique complet. Les détails de la version indiquent la date et l'auteur des modifications, ainsi que l'espace de stockage utilisé. L'onglet Valeurs affiche les paramètres exacts, notamment le nom du modèle, les paramètres et les versions des fonctions. Ce système de versionnage garantit la reproductibilité de tout test avec des paramètres identiques, permet de suivre l'évolution des performances et de revenir à des versions antérieures si nécessaire.

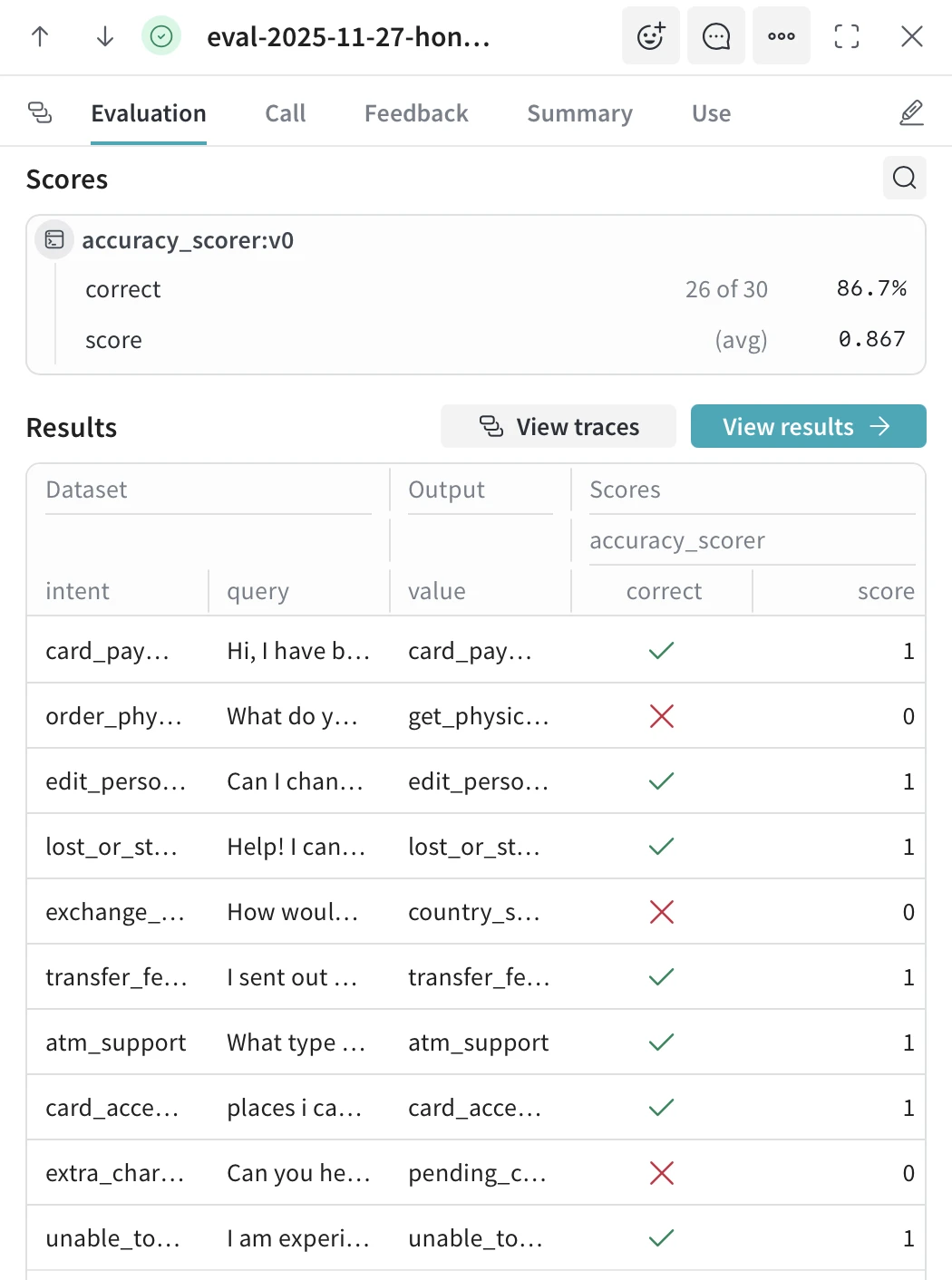

Résultats détaillés de l'évaluation

Figure 5 : Résultats de l'évaluation montrant les cas de test individuels avec les intentions prédites et les scores de précision.

Les résultats individuels des tests sont affichés pour chaque échantillon. La section « Scores » récapitule le nombre total de prédictions correctes, le pourcentage de précision et les scores personnalisés.

Le tableau des résultats affiche chaque requête avec sa réponse attendue et la prédiction du modèle, les réponses correctes étant cochées et les réponses incorrectes marquées d'une croix. Les prédictions erronées sont faciles à repérer et révèlent souvent des schémas récurrents, comme la confusion entre des catégories similaires.

Cliquer sur n'importe quelle ligne ouvre la trace complète, y compris l'invite, la réponse, le nombre de jetons et le temps, ce qui facilite le débogage des échecs et l'amélioration des invites ou de la sélection du modèle.

Langsmith

LangSmith est la plateforme d'observabilité de LangChain pour la surveillance, le débogage et l'évaluation des applications LLM. Elle trace automatiquement chaque appel LLM, capture les invites et les sorties, suit les coûts et la latence, et permet une évaluation systématique grâce à des tests basés sur des jeux de données. LangSmith s'intègre nativement à LangChain, mais prend également en charge toute application LLM via son SDK.

Résultats de l'évaluation par échantillon

Figure 6 : Image montrant l'évaluation individuelle des cas de test sur les prédictions et les indicateurs de performance.

Les résultats de chaque prédiction sont affichés à côté des résultats attendus, ce qui permet d'identifier les erreurs du modèle. La comparaison entre les prédictions attendues et les prédictions réelles révèle les confusions entre des catégories sémantiquement similaires. La latence par requête et le nombre de jetons indiquent quels types d'entrées sont les plus coûteux à traiter, ce qui permet d'optimiser les requêtes lentes ou coûteuses.

Volume de traces et surveillance de la santé

Figure 7 : Graphique montrant la visualisation des traces du projet, permettant de suivre les taux de réussite et d'erreur au fil du temps.

L'état de santé de l'application est indiqué par l'évolution du volume de traces et des taux de réussite/erreur au fil du temps. Différentes vues permettent d'analyser les appels LLM, les tendances de coûts, les invocations d'outils ou les scores de retour d'information. Les problèmes tels que les pics d'erreurs ou les augmentations de coûts sont mis en évidence, signalant les anomalies nécessitant une investigation.

Comparaison des modèles et des configurations

Figure 8 : Vue comparative des expériences montrant les indicateurs de performance sur plusieurs exécutions de tests.

Il est possible de comparer différents modèles côte à côte sur un même jeu de données de test. Les compromis entre précision, latence (P50/P99) et efficacité des jetons sont visualisés. Grâce à ces comparaisons, il est aisé d'identifier la configuration qui répond le mieux aux exigences, qu'il s'agisse de maximiser la précision ou de minimiser les coûts et le temps de réponse.

Langfuse

Langfuse est une plateforme d'observabilité open source pour les modèles de langage, conçue pour la surveillance, le débogage et l'évaluation des applications de modélisation du langage. Disponible en version auto-hébergée et cloud, Langfuse offre un traçage complet avec capture automatique des invites, des sorties, des coûts et de la latence.

La plateforme prend en charge tous les frameworks LLM grâce à son SDK flexible et offre des fonctionnalités d'évaluation intégrées, notamment LLM-as-a-judge pour une évaluation automatisée de la qualité. Langfuse conserve le suivi des versions des invites entre les exécutions, permettant ainsi la comparaison des performances entre différentes formulations.

La collecte des commentaires des utilisateurs via un système de notation par « J’aime » ou « Je n’aime pas » permet d’identifier les résultats de haute et de basse qualité, tandis qu’un système de notation personnalisé permet de suivre des indicateurs spécifiques à l’application. Les évaluations automatisées peuvent traiter des milliers de traces à des fréquences d’échantillonnage configurables, permettant ainsi une surveillance continue de la qualité à grande échelle sans examen manuel de chaque résultat.

Vue détaillée du tracé

Figure 10 : Journaux de suivi montrant les détails des appels API avec les données de performance et de coût.

Chaque trace affiche les détails d'exécution complets de chaque appel LLM. La vue de trace indique les mesures de latence exactes, la consommation de jetons (jetons d'invite et de fin séparément) et les coûts calculés par requête.

La configuration du modèle est conservée, y compris la température, le nombre maximal de jetons et les autres paramètres. La section Aperçu affiche l'intégralité de la requête envoyée au modèle ainsi que la réponse complète, vous permettant ainsi de comprendre précisément ce que le modèle a reçu et généré.

Cette visibilité granulaire permet de déboguer des pannes spécifiques en examinant la paire entrée-sortie précise qui a provoqué une erreur.

Tableau récapitulatif des traces

Figure 11 : Inspection individuelle de la trace montrant les détails de la requête et la réponse du modèle.

Toutes les traces sont regroupées dans un tableau filtrable affichant les résultats, les niveaux d'observation, la latence, l'utilisation des jetons et les coûts totaux. Chaque ligne représente un appel LLM, les niveaux d'observation étant codés par couleur pour indiquer la hiérarchie ou l'importance de la trace. Le nombre de jetons affiché comprend les jetons d'invite et de fin, ainsi que les totaux, tandis que les calculs de coûts sont effectués automatiquement en fonction du modèle utilisé.

Le sélecteur de colonnes permet de personnaliser les indicateurs affichés, et les filtres permettent d'affiner les traces par environnement, plage horaire ou autres critères. Cette vue tabulaire facilite l'identification de tendances telles que des requêtes constamment lentes ou des requêtes anormalement coûteuses.

Groupe de réflexion

Braintrust est une plateforme d'observabilité LLM qui combine évaluation et surveillance de la production. Elle permet de tester les modèles sur des jeux de données, de comparer différentes invites ou configurations et de suivre les indicateurs de qualité grâce à une notation automatisée. Des fonctions d'évaluation intégrées et personnalisées mesurent la précision, la pertinence ou des critères spécifiques au domaine, et les résultats sont affichés dans des tableaux comparatifs mettant en évidence les différences de performance entre les versions.

Pour la supervision de la production, Braintrust suit en temps réel des indicateurs tels que la latence, le coût et des scores de qualité personnalisés, à mesure que le trafic transite par les applications. Des alertes sont déclenchées lorsque les seuils de qualité sont dépassés ou que les garde-fous sont enfreints. Brainstore, le système de stockage des journaux de la plateforme, ingère les journaux d'application à grande échelle et propose une recherche optimisée pour les interactions avec l'IA. Le tableau de bord affiche des indicateurs agrégés pour les tests et les exécutions en production, incluant le suivi des coûts, l'utilisation des jetons et les métadonnées des réponses pour les requêtes d'évaluation et de production.

Hélicone

Helicone est une plateforme d'observabilité basée sur un proxy qui surveille les applications LLM en acheminant les requêtes API via son serveur proxy. Son intégration ne nécessite que la modification de l'URL de base, sans installation de SDK ni modification du code. La plateforme capture automatiquement les requêtes, les réponses, les coûts et l'utilisation des jetons pour le suivi du comportement des applications.

Le tableau de bord affiche le volume total des requêtes, les coûts agrégés et la consommation de jetons pour l'ensemble des appels API. Les journaux de requêtes présentent l'intégralité des entrées et des résultats des modèles, permettant ainsi d'analyser des prédictions ou des erreurs spécifiques. Le suivi des coûts ventile les dépenses par type de modèle, utilisateur ou balises personnalisées afin d'identifier les opérations coûteuses. La mise en cache intégrée détecte les requêtes dupliquées et sert les réponses mises en cache, réduisant ainsi les coûts et les temps de réponse de l'API. La limitation du débit fixe des plafonds d'utilisation par utilisateur ou point de terminaison afin d'éviter les pics de dépenses inattendus.

La plateforme se concentre sur la surveillance des appels API individuels : chaque requête apparaît comme une entrée de journal distincte, sans prise en charge intégrée du regroupement des appels liés ni de la visualisation des séquences. De ce fait, Helicone convient aux applications telles que les appels LLM indépendants (par exemple, les chatbots à interaction unique), la génération de contenu par lots ou les tâches de classification, mais est moins adaptée au suivi des flux de travail en plusieurs étapes où la compréhension des relations entre les appels séquentiels est essentielle.

Qu’est-ce que l’observabilité LLM ?

L'observabilité des modèles de langage (LLM) consiste à collecter et interpréter des données continues issues de ces modèles afin de comprendre leur comportement en situation réelle d'utilisation. Elle s'attache à recueillir des métriques, des traces et des journaux montrant comment les LLM réagissent aux différentes requêtes, outils et appels d'API externes.

Les modèles de langage fonctionnant par raisonnement probabiliste, leurs processus internes ne peuvent être inspectés directement. La surveillance des modèles de langage repose donc sur l'analyse de leurs entrées et sorties, ainsi que des étapes intermédiaires des flux de travail . L'étude de ces traces permet aux développeurs de modèles de langage d'obtenir une visibilité sur les performances du système, le comportement du modèle et les habitudes d'utilisation qui influent sur les performances de l'application et la qualité des résultats.

L'observabilité LLM est vitale pour plusieurs raisons :

- Assurance qualité : Les grands modèles de langage peuvent produire des résultats incorrects ou de faible qualité pour diverses raisons, notamment des consignes imprécises, des données fluctuantes ou un comportement utilisateur inattendu. Le suivi des consignes et des réponses dans le temps permet d’évaluer des indicateurs tels que l’exactitude, la cohérence, la pertinence et la véracité des données. Cela permet aux équipes de détecter une baisse de la qualité des réponses des grands modèles de langage ou des dysfonctionnements de ces derniers. Avec l’essor des grands modèles de langage dans les processus métier, garantir une précision constante devient un enjeu majeur.

- Dépannage : Lorsque des problèmes surviennent dans les applications LLM, leurs causes peuvent être multiples. Il peut s’agir, par exemple, d’invites mal configurées, d’un paramétrage incorrect, d’appels d’API externes ayant échoué ou d’erreurs de logique dans les flux de travail d’agents en plusieurs étapes. En collectant les traces LLM qui montrent les étapes intermédiaires, les développeurs peuvent effectuer une analyse des causes profondes efficace et identifier précisément l’étape à laquelle le comportement a divergé. Cela réduit le besoin d’intervention humaine et accélère le suivi des erreurs.

- Optimisation : Le suivi des performances système, de l’utilisation des ressources et des jetons permet aux organisations d’identifier les goulots d’étranglement et d’améliorer les performances des LLM. Les équipes peuvent mesurer la latence, le débit, l’utilisation de la mémoire et les taux d’erreur pour comprendre le comportement des LLM sous différentes charges. Elles peuvent également suivre les jetons pour maîtriser les coûts et analyser les habitudes d’utilisation afin d’améliorer les performances et la rentabilité . La surveillance continue de ces indicateurs clés est particulièrement précieuse dans la génération augmentée par récupération et les flux de travail des agents, où les goulots d’étranglement des performances proviennent souvent d’appels d’outils inefficaces ou d’allers-retours inutiles lors du raisonnement.

Catégories de métriques de base

Les outils d'observabilité LLM regroupent généralement les indicateurs pertinents en trois catégories qui prennent en charge à la fois les équipes de développement logiciel et les équipes opérationnelles.

Indicateurs de performance du système

- Latence : Mesure le temps écoulé entre la réception d'une requête et l'envoi d'une réponse.

- Débit : Indique le nombre de requêtes que le modèle peut traiter dans un délai donné.

- Taux d'erreur : Indiquent la fréquence à laquelle le système renvoie des réponses invalides ou erronées.

Indicateurs d'utilisation des ressources

- Consommation du processeur et du GPU : Permet de comprendre l’efficacité avec laquelle le système utilise le matériel.

- Utilisation de la mémoire : influe sur les décisions de mise à l’échelle et la planification des capacités.

- Utilisation des jetons : Influence l’efficacité des coûts et aide les équipes à contrôler les dépenses lors d’une utilisation intensive de LLM.

- Compromis entre débit et latence : Montrez comment le système équilibre la vitesse et le volume de traitement.

Métriques du comportement du modèle

- Exactitude, véracité et qualité des réponses : pour identifier les résultats de faible qualité.

- Engagement et retours des utilisateurs : Fournir des informations sur la façon dont le modèle répond aux besoins des utilisateurs.

- Indicateurs de fidélité et de pertinence : reflètent la fidélité du modèle au matériau source.

observabilité manuelle vs. autonome

Le recours à l'observation manuelle présente plusieurs défis. Les modèles de langage complexes génèrent d'importants volumes de données, et les chaînes de raisonnement à plusieurs étapes produisent de nombreux journaux et traces. La nécessité d'une surveillance en temps réel accroît la complexité opérationnelle, et même les équipes expérimentées peinent à analyser chaque appel LLM sans manquer d'informations essentielles. Les flux de travail manuels rendent également difficile le suivi des changements constants de comportement des utilisateurs et des variations des requêtes.

Les systèmes d'observabilité autonomes relèvent ces défis grâce à des agents logiciels qui analysent en continu l'activité des systèmes de gestion de la vie quotidienne (LLM). Ces agents détectent les anomalies, diagnostiquent les problèmes et effectuent une analyse des causes profondes sans intervention humaine constante. Les évaluations automatisées permettent également d'identifier les comportements à risque, tels que l'injection rapide.

Un système de ce type assure une surveillance continue et un suivi cohérent des indicateurs d'évaluation sur l'ensemble du modèle. Les organisations bénéficient ainsi d'un dépannage plus rapide, de performances applicatives améliorées et d'une meilleure maîtrise des risques opérationnels.

Caractéristiques des outils d'observabilité LLM

Évaluations de la qualité et de la sécurité

- Détection des hallucinations pour identifier les écarts du modèle par rapport aux données fiables.

- Détection rapide des injections et des jailbreaks pour répondre aux préoccupations de sécurité.

- Évaluation de la toxicité et de la sécurité favorisant la conformité et la réduction des risques.

- Le clustering regroupe les résultats LLM similaires afin d'identifier la dérive au fil du temps.

Fonctionnalités d'expérimentation

- Tests A/B pour la gestion rapide et les modifications de configuration.

- Comparaison rapide entre plusieurs modèles ouparamètres LLM.

- Évaluation de la précision, de la consommation de jetons et de la latence avant le déploiement.

- Tester les modifications du modèle par rapport à des scénarios réels en utilisant des données similaires à celles de la production.

Corrélation avec l'infrastructure

- Connexion des traces LLM aux données de surveillance des performances de l'application backend.

- Lier le temps de réponse et la qualité de la réponse aux sessions utilisateur réelles.

- Identifier comment les performances du système affectent les performances LLM et la stabilité de l'application.

LLMOps et gouvernance

- Des garde-fous qui filtrent les messages non sécurisés et bloquent les réponses nuisibles.

- Tableaux de bord pour le suivi de l'exposition aux données personnelles, des hallucinations et des violations des règles de sécurité.

- Outils facilitant la conformité, le signalement et l'analyse des incidents de sécurité.

Observabilité des flux de travail multi-agents

À mesure que les LLM prennent en charge les flux de travail multi-étapes entre agents, les exigences d'observabilité s'étendent au-delà des simples paires requête-réponse. Les applications multi-agents introduisent des couches de complexité supplémentaires qui nécessitent des approches de traçage dédiées.

Dimensions clés de l'observabilité pour les agents :

- Tracés de planification et de raisonnement : visibilité sur la manière dont l’agent décompose les tâches, sélectionne les actions et affine son approche en fonction des résultats intermédiaires.

- Surveillance des appels d'outils : suivi des appels d'API externes, des requêtes de base de données et des exécutions de fonctions afin d'identifier les goulots d'étranglement ou les défaillances liés à la latence.

- Suivi des transferts : Pour les systèmes multi-agents, surveillance de la manière dont les tâches sont transférées entre les agents et de la préservation correcte du contexte.

- Évolution de l'état : Comprendre comment la mémoire et le contexte évoluent au fil des différents tours d'une session

Ensemble, ces dimensions constituent le fondement de la surveillance des agents . Les outils d'observabilité LLM tels que Langsmith, Langfuse, AgentOps et Weights & Biases fournissent des vues de traçage spécifiques à chaque agent qui affichent des graphiques d'exécution complets.

FAQ

Une solution d'observabilité performante permet une visibilité complète sur l'ensemble du cycle de vie des appels LLM. Cela inclut la manière dont un modèle reçoit une requête, sélectionne les outils, récupère les données d'une source et génère une réponse finale. L'observabilité est essentielle car les applications LLM gagnent en complexité et le nombre d'applications LLM reposant sur un raisonnement multi-étapes augmente fortement. Par conséquent, les organisations ont besoin d'outils d'observabilité assurant une surveillance en temps réel et une évaluation automatisée afin de garantir des performances homogènes pour toutes leurs applications LLM.

Les outils modernes d'observabilité LLM visent à fournir une vue d'ensemble détaillée de chaque action au sein des applications utilisant la technologie LLM. Cela inclut le suivi de chaque appel LLM, de chaque interaction avec l'outil et de chaque étape intermédiaire d'une chaîne de raisonnement. La possibilité d'observer l'intégralité du flux de travail, de la requête à la réponse finale, aide les équipes à détecter les comportements inattendus et à comprendre comment les modèles LLM prennent leurs décisions.

L'analyse des coûts et des jetons est devenue essentielle. Le suivi en temps réel de l'utilisation des jetons permet aux organisations de maîtriser leurs coûts et d'éviter les pics de dépenses imprévus. Les équipes peuvent ventiler l'utilisation des jetons par fournisseur, modèle, fonctionnalité ou chemin d'application afin de comprendre la contribution des différents composants aux coûts. Certains outils d'observabilité permettent de comparer plusieurs fournisseurs de LLM, facilitant ainsi les décisions en matière de performance et de rentabilité lors du routage des requêtes entre les LLM open source et les solutions propriétaires.

Dans l'ensemble de l'écosystème, les outils d'observabilité présentent systématiquement l'observabilité des modèles de langage (LLM) comme une condition essentielle au bon fonctionnement des applications LLM à grande échelle. Les équipes qui utilisent des flux de travail d'agents ont besoin de visibilité sur le déroulement du raisonnement en plusieurs étapes du modèle et sur l'impact de chaque décision sur ses performances. L'observabilité contribue à garantir des réponses cohérentes et de haute qualité, à détecter rapidement les défaillances et à préserver la confiance des utilisateurs.

Un autre thème important est la nécessité de maîtriser les coûts opérationnels. Le suivi de l'utilisation des jetons, de la mémoire et des ressources permet aux organisations de contrôler leurs dépenses tout en préservant les performances et l'efficacité des coûts. L'observabilité révèle également les goulots d'étranglement qui influent sur la satisfaction des utilisateurs et les performances des applications.

Enfin, l'observabilité des modèles LLM est essentielle car les organisations s'appuient de plus en plus sur ces modèles pour des fonctions critiques. À mesure que ces systèmes se développent, les outils de surveillance doivent être indépendants de tout framework, compatibles avec les plateformes open source et capables de fournir des informations provenant de plusieurs services. Ceci favorise un déploiement sécurisé, réduit les risques de sécurité et aide les équipes à comprendre les résultats du modèle dans un contexte opérationnel plus large.

Soyez le premier à commenter

Votre adresse courriel ne sera pas publiée. Tous les champs sont obligatoires.