Las empresas generan grandes volúmenes de datos de voz procedentes de llamadas, reuniones e interfaces de voz, pero el procesamiento manual de estos datos es lento y difícil de escalar.

El reconocimiento de voz (también llamado reconocimiento automático de voz o conversión de voz a texto) convierte el lenguaje hablado en texto, lo que permite a los sistemas analizar y automatizar flujos de trabajo basados en la voz, como la transcripción de llamadas, los asistentes de voz y los resúmenes de reuniones.

Explorando cómo funciona el reconocimiento de voz, los algoritmos involucrados, sus aplicaciones en diversas industrias y ejemplos de la vida real.

12 casos de uso del reconocimiento de voz

El reconocimiento de voz se utiliza en muchos sectores para convertir el lenguaje hablado en texto y permitir la interacción por voz con los sistemas. Los siguientes ejemplos muestran casos de uso comunes del reconocimiento de voz en sectores como atención al cliente, ventas, automoción, sanidad y tecnología.

Servicio y soporte al cliente

- Sistemas de respuesta de voz interactiva (IVR): Los sistemas IVR dirigen automáticamente a las personas que llaman al departamento correspondiente mediante el reconocimiento de consultas habladas. Reducen el volumen de llamadas y los tiempos de espera al gestionar solicitudes sencillas mediante respuestas pregrabadas o sistemas de conversión de texto a voz . El reconocimiento automático de voz (ASR) permite que los sistemas IVR comprendan y respondan a las consultas de los clientes en tiempo real.

- Automatización de la atención al cliente y chatbots: El reconocimiento de voz permite que los chatbots y asistentes virtuales basados en voz gestionen las solicitudes rutinarias de atención al cliente, como responder a las preguntas frecuentes, guiar en la resolución de problemas y ayudar con las consultas sobre la cuenta.

- Análisis de sentimientos y monitorización de llamadas: El análisis de sentimientos clasifica las conversaciones como positivas, negativas o neutrales, lo que ayuda a las organizaciones a monitorizar la calidad del servicio e identificar las preocupaciones de los clientes.

- Soporte multilingüe: Los modelos de reconocimiento de voz pueden entrenarse para reconocer varios idiomas. Al integrarse en chatbots o sistemas IVR, pueden detectar el idioma del usuario y cambiar al modelo adecuado, lo que ayuda a las organizaciones a atender a clientes internacionales (véase la figura 1).

- Autenticación de clientes mediante biometría de voz: La biometría de voz utiliza tecnologías de reconocimiento de voz para analizar la voz del hablante y extraer características como el acento y la velocidad para verificar su identidad.

Figura 1: Imagen que muestra cómo un chatbot multilingüe reconoce palabras en otro idioma.

Ventas y marketing

- Asistentes de ventas virtuales: Los asistentes de ventas con inteligencia artificial interactúan con los clientes mediante la voz y les ayudan a tomar decisiones de compra. El reconocimiento de voz permite que estos sistemas comprendan las peticiones habladas y respondan según la intención del cliente.

- Servicios de transcripción: El reconocimiento de voz convierte las grabaciones de llamadas de ventas y reuniones en transcripciones escritas, lo que facilita la documentación y el análisis.

Automotor

- Controles activados por voz: Los controles activados por voz permiten a los usuarios interactuar con dispositivos y aplicaciones mediante comandos de voz. Los conductores pueden controlar funciones como el climatizador, realizar llamadas telefónicas o usar sistemas de navegación.

- Navegación asistida por voz: La navegación asistida por voz proporciona indicaciones en tiempo real mediante comandos de voz que el conductor utiliza para indicar el destino. Los conductores pueden solicitar información actualizada sobre el tráfico o buscar puntos de interés cercanos mediante comandos de voz, sin necesidad de controles físicos.

Cuidado de la salud

- Transcripción médica: La transcripción médica, también conocida como MT, es el proceso de convertir informes médicos grabados en audio en un documento de texto escrito. Los siguientes son los pasos principales del proceso de transcripción médica:

- Grabación del dictado del médico.

- Transcribir el habla a texto utilizando sistemas de reconocimiento de voz (algunos sistemas también incluyen la identificación de hablantes para distinguir entre ellos).

- Editar el texto transcrito para mejorar su precisión y corregir los errores según sea necesario.

- Formatear el documento de acuerdo con los requisitos legales y médicos.

- Asistentes médicos virtuales: Los asistentes médicos virtuales (AMV) utilizan reconocimiento de voz, procesamiento del lenguaje natural y algoritmos de aprendizaje automático para comunicarse con los pacientes mediante voz o texto. El software de reconocimiento de voz permite a los AMV responder a comandos de voz, recuperar información de los registros médicos electrónicos (RME) y automatizar el proceso de transcripción médica.

- Integración con los registros electrónicos de salud (EHR): Los profesionales sanitarios pueden utilizar comandos de voz para navegar por el sistema EHR, acceder a los datos de los pacientes e introducir datos en campos específicos.

Ejemplos reales de reconocimiento de voz

Discurso de Azure

Azure Speech es un servicio de IA basado en la nube de Microsoft (parte de las herramientas de Azure AI Foundry) que permite a las aplicaciones procesar y generar lenguaje hablado. Proporciona capacidades tales como:

Conversión de voz a texto (reconocimiento automático de voz) : Convierte el audio hablado en texto escrito y admite múltiples modos de transcripción:

- Transcripción en tiempo real para audio en streaming

- Transcripción rápida para archivos grabados

- Transcripción por lotes para grandes volúmenes de audio

Los desarrolladores también pueden crear modelos de voz personalizados para mejorar la precisión del reconocimiento de vocabulario específico de un dominio o en entornos ruidosos.

Síntesis de voz (texto a voz) : Transforma texto escrito en audio con sonido natural mediante voces neuronales. Los desarrolladores pueden controlar características de la voz como el tono, la velocidad y la pronunciación mediante el Lenguaje de Marcado de Síntesis de Voz (SSML).

Azure Speech también admite voces neuronales personalizadas , lo que permite a las organizaciones crear una voz única para sus aplicaciones.

Traducción de voz : Proporciona traducción de voz multilingüe en tiempo real, lo que permite la traducción de voz a voz o de voz a texto en diferentes idiomas.

Modelos de voz personalizados : Los desarrolladores pueden entrenar modelos personalizados con sus propios datos para mejorar el reconocimiento de:

- Terminología específica del sector

- Acentos y estilos de habla

- Condiciones de audio ruidosas

Avatares de voz e IA conversacional : Azure Speech puede generar avatares parlantes sintéticos y habilitar interacciones de voz en tiempo real, lo que permite el uso de sistemas de IA conversacional y agentes de voz.

Figura 2: Un ejemplo del agente de IA de voz de Azure, Voice Live. 1

Deepgram

Deepgram proporciona API para integrar capacidades de voz, como la transcripción de voz a texto, la síntesis de texto a voz y la inteligencia de voz. 2

- Transcripción de voz a texto: Convierte audio en texto tanto para transmisión en tiempo real como para audio pregrabado.

- Conversión de texto a voz: Genera voz con sonido natural a partir de texto para interfaces y asistentes de voz.

- Diarización de locutores: Identifica y separa a los diferentes locutores en una grabación de audio.

- Detección de palabras clave e inteligencia de audio: Detecta palabras o frases específicas y extrae información valiosa de los datos de audio.

- Modelos de voz personalizados: Permiten a las organizaciones mejorar la precisión del reconocimiento utilizando datos específicos del dominio.

Entre los casos de uso de Deepgram se incluyen:

- Atención al cliente: Transcribir y analizar las conversaciones del centro de llamadas para supervisar la calidad del servicio y extraer información relevante.

- Medios de comunicación y radiodifusión: Generación de subtítulos y transcripciones para podcasts, entrevistas y transmisiones en directo.

- Sector sanitario y jurídico : Conversión de dictados y conversaciones orales en documentación escrita.

- Análisis empresarial: Extracción de palabras clave, análisis de sentimiento e información relevante a partir de grandes volúmenes de datos de audio.

AsambleaAI

AssemblyAI se utiliza en el análisis de centros de llamadas , donde las llamadas de atención al cliente se transcriben y analizan para el control de calidad y la obtención de información; en la transcripción de reuniones , que genera transcripciones y resúmenes de reuniones virtuales; y en la transcripción de medios , que permite subtítulos, transcripciones y contenido de audio o vídeo con capacidad de búsqueda.

También se utiliza para la moderación de contenido , con el fin de detectar discursos inapropiados o restringidos en transmisiones de audio, y para el análisis de datos de voz, extrayendo información como temas, entidades y sentimientos de grandes volúmenes de conversaciones grabadas. 3

- Transcripción de voz a texto: Convierte secuencias de audio o archivos en texto con marcas de tiempo, puntuaciones de confianza y otros metadatos.

- Transcripción de transmisión en tiempo real: Procesa audio en directo con baja latencia para agentes de voz y aplicaciones en tiempo real.

- Inteligencia de audio: Extrae información valiosa del habla, incluyendo la identificación del hablante, el análisis de sentimientos , la detección de temas y el reconocimiento de entidades.

- Resumen y comprensión del habla: Genera resúmenes y resultados estructurados a partir de transcripciones para facilitar los flujos de trabajo posteriores.

- Moderación de contenido y eliminación de información personal identificable: Identifica o elimina contenido sensible o inapropiado del audio.

- Capacidades multilingües y de detección de idiomas: Admite la transcripción en varios idiomas y acentos.

Google Conversión de voz a texto en la nube

Google Cloud Speech-to-Text permite a los desarrolladores integrar la API para transcribir archivos de audio, procesar transmisiones de voz en vivo y crear funciones habilitadas para voz, como comandos o búsquedas. 4

- Transcripción en tiempo real y por lotes: Transcribe tanto audio en streaming como archivos pregrabados.

- Soporte multilingüe: Reconoce el habla en más de 100 idiomas y variantes.

- Modelos avanzados de IA de voz: Utiliza los modelos de voz de Google (por ejemplo, Chirp 3) entrenados con grandes conjuntos de datos de audio para una mayor precisión.

- Chirp 3 es el modelo de IA de voz más reciente de Google para el reconocimiento automático de voz (ASR). Se trata de un modelo generativo multilingüe diseñado para convertir audio hablado en texto con mayor precisión y velocidad. El modelo mejora la calidad de la transcripción y admite funciones como la diarización de hablantes (identificación de diferentes hablantes), la detección automática de idiomas y el reconocimiento de voz multilingüe.

- Puntuación automática y funciones de identificación de locutores: Añade signos de puntuación a las transcripciones y puede distinguir entre los diferentes locutores en las grabaciones.

¿Qué es el reconocimiento de voz?

El reconocimiento de voz, también conocido como reconocimiento automático de voz (ASR), conversión de voz a texto (STT) y reconocimiento de voz por computadora, es una tecnología que permite a una computadora reconocer y convertir el lenguaje hablado en texto.

La tecnología de reconocimiento de voz utiliza inteligencia artificial y modelos de aprendizaje automático para identificar y transcribir con precisión diferentes acentos, dialectos y patrones del habla.

Reconocimiento de voz frente a reconocimiento de voz

El reconocimiento de voz se suele confundir con el reconocimiento de habla , pero se refieren a conceptos distintos. El reconocimiento de voz convierte las palabras habladas en texto escrito, centrándose en identificar las palabras y frases pronunciadas por un usuario, independientemente de quién hable.

Por otro lado, el reconocimiento de voz se centra en reconocer o verificar la voz de un hablante, con el objetivo de determinar la identidad de un hablante desconocido en lugar de centrarse en comprender el contenido del discurso.

¿Cuáles son las características de los sistemas de reconocimiento de voz?

Los sistemas de reconocimiento de voz constan de varios componentes que trabajan conjuntamente para comprender y procesar el habla humana. Las características clave de un reconocimiento de voz eficaz son:

preprocesamiento de audio

Una vez obtenida la señal de audio sin procesar de un dispositivo de entrada, es necesario preprocesarla para mejorar la calidad de la voz. El objetivo principal del preprocesamiento de audio es capturar los datos de voz relevantes eliminando cualquier artefacto no deseado y reduciendo el ruido.

Extracción de características

Esta etapa convierte la señal de audio preprocesada en una representación más informativa. Esto facilita el manejo de los datos de audio sin procesar para los modelos de aprendizaje automático en los sistemas de reconocimiento de voz.

Ponderación del modelo de lenguaje

La ponderación lingüística otorga mayor importancia a ciertas palabras y frases, como las referencias a productos, en las señales de audio y voz. Esto aumenta la probabilidad de que los sistemas de reconocimiento de voz reconozcan esas palabras clave en un discurso posterior.

Modelado acústico

Permite a los sistemas de reconocimiento de voz capturar y distinguir unidades fonéticas dentro de una señal de voz. Los modelos acústicos se entrenan con grandes conjuntos de datos que contienen muestras de voz de diversos hablantes con diferentes acentos, estilos de habla y procedencias.

Etiquetado de altavoces

Permite que las aplicaciones de reconocimiento de voz determinen la identidad de varios hablantes en una grabación de audio. Asigna etiquetas únicas a cada hablante, lo que permite identificar quién estaba hablando en cada momento.

Filtrado de lenguaje soez

El proceso de eliminar palabras o frases ofensivas, inapropiadas o explícitas de los datos de audio.

¿Cuáles son los diferentes algoritmos de reconocimiento de voz?

El reconocimiento de voz utiliza diversos algoritmos y técnicas computacionales para convertir el lenguaje hablado en lenguaje escrito. A continuación, se presentan algunos de los métodos de reconocimiento de voz más utilizados:

Modelos ocultos de Markov (HMM)

El modelo oculto de Markov (HMM) es un modelo estadístico de Markov comúnmente utilizado en sistemas tradicionales de reconocimiento de voz. Los HMM capturan la relación entre las características acústicas y modelan la dinámica temporal de las señales de voz.

Procesamiento del lenguaje natural (PLN)

El PLN es un subcampo de la inteligencia artificial que se centra en la interacción entre humanos y máquinas a través del lenguaje natural. Algunas de las funciones clave del PLN en los sistemas de reconocimiento de voz son:

- Estimar la probabilidad de secuencias de palabras en el texto reconocido.

- Convertir expresiones coloquiales y abreviaturas de un idioma hablado a un formato escrito estándar.

- Asignar las unidades fonéticas obtenidas a partir de modelos acústicos a sus palabras correspondientes en el idioma de destino.

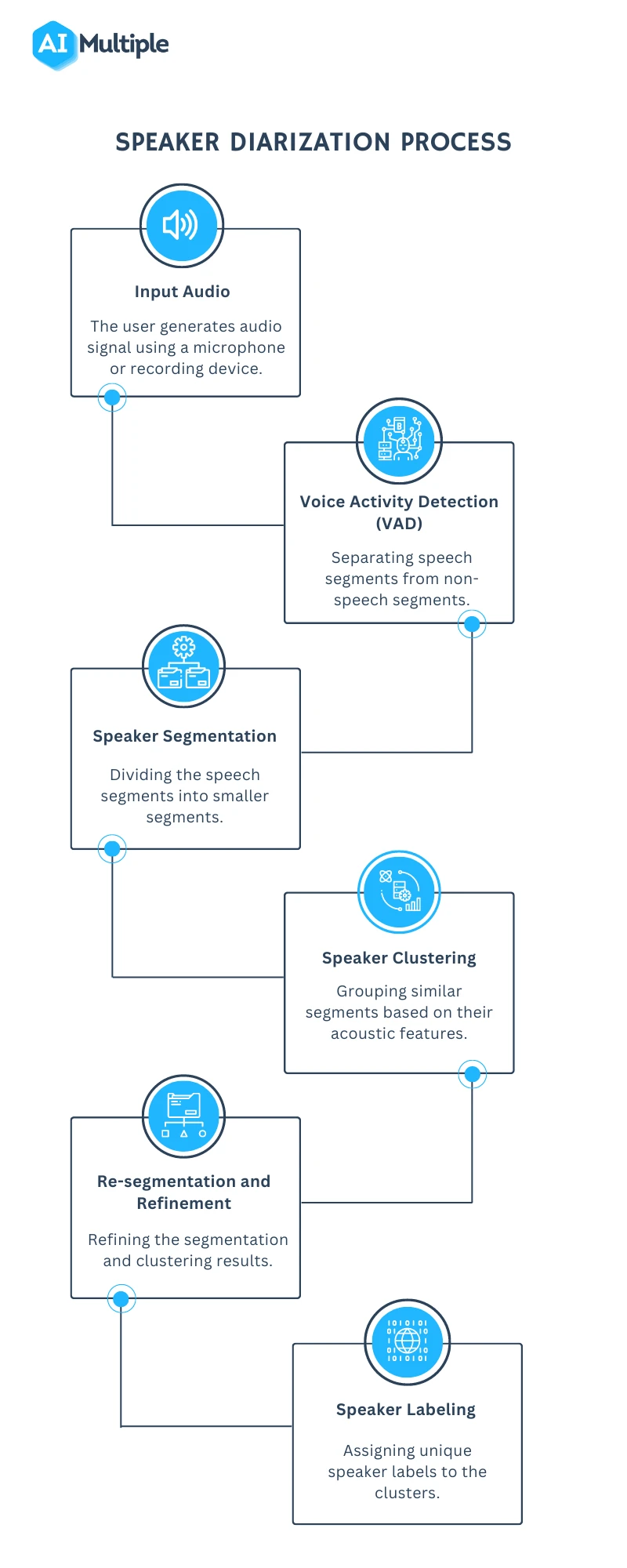

Diarización de hablantes (SD)

La identificación de hablantes, o etiquetado de hablantes, es el proceso de identificar y atribuir segmentos de habla a sus respectivos hablantes (Figura 1). Permite el reconocimiento de voz específico de cada hablante y la identificación de individuos en una conversación.

Figura 3: Diagrama de flujo que ilustra el proceso de diarización de hablantes.

Deformación temporal dinámica (DTW)

Los algoritmos de reconocimiento de voz utilizan el algoritmo de alineación temporal dinámica (DTW) para encontrar una alineación óptima entre dos secuencias (Figura 4).

Figura 4: Un reconocedor de voz que utiliza la deformación temporal dinámica para determinar la distancia óptima entre elementos. 5

Redes neuronales profundas

Las redes neuronales procesan y transforman los datos de entrada simulando la percepción de frecuencia no lineal del sistema auditivo humano.

Clasificación temporal conexionista (CTC)

Se trata de un objetivo de entrenamiento introducido por Alex Graves en 2006. El CTC es especialmente útil para tareas de etiquetado de secuencias y sistemas de reconocimiento de voz de extremo a extremo. Permite a la red neuronal descubrir la relación entre los fotogramas de entrada y alinearlos con las etiquetas de salida.

¿Cuáles son los retos del reconocimiento de voz?

Si bien la tecnología de reconocimiento de voz ofrece muchos beneficios, aún enfrenta una serie de desafíos que deben abordarse. Algunas de las principales limitaciones del reconocimiento de voz incluyen:

Desafíos acústicos

Acentos y dialectos

Los acentos y dialectos difieren en pronunciación, vocabulario y gramática, lo que dificulta que las aplicaciones de reconocimiento de voz reconozcan el habla con precisión.

Supongamos que un modelo de reconocimiento de voz se ha entrenado principalmente con acentos del inglés americano. Si una persona con un fuerte acento escocés utiliza el sistema, podría tener dificultades debido a las diferencias de pronunciación. Por ejemplo, la palabra "water" se pronuncia de forma diferente en ambos acentos. Si el sistema no está familiarizado con esta pronunciación, podría tener problemas para reconocer la palabra "water".

Solución: Abordar estos desafíos es crucial para mejorar la precisión de las aplicaciones de reconocimiento de voz. Para superar las variaciones en la pronunciación, es fundamental ampliar los datos de entrenamiento para incluir muestras de hablantes con diversos acentos. Este enfoque ayuda al sistema a reconocer y comprender una gama más amplia de patrones de habla.

ruido de fondo

El ruido de fondo (por ejemplo, el tráfico, la interferencia) dificulta la distinción entre el habla y el ruido ambiental en las aplicaciones de reconocimiento de voz (véase la figura 5).

Solución: Se pueden utilizar técnicas de preprocesamiento para reducir el ruido de fondo en el reconocimiento de voz, lo que puede ayudar a mejorar el rendimiento de los modelos de reconocimiento de voz en entornos ruidosos.

Por ejemplo, se pueden utilizar técnicas de aumento de datos para reducir el impacto del ruido en los datos de audio. El aumento de datos ayuda a entrenar modelos de reconocimiento de voz con datos ruidosos para mejorar la precisión del modelo en entornos reales.

Figura 5: Ejemplos de una oración objetivo (“El payaso tenía una cara graciosa”) con ruido de fondo de murmullos, coche y lluvia. 6

Desafíos lingüísticos

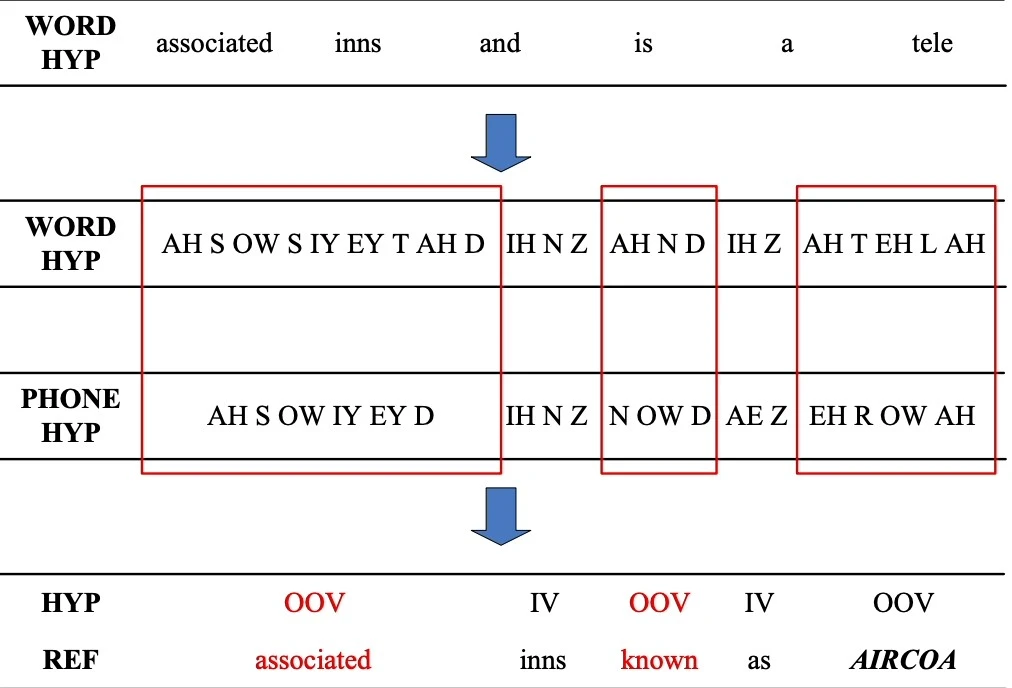

Palabras fuera del vocabulario

Dado que el modelo de reconocimiento de voz no ha sido entrenado con palabras fuera del vocabulario, puede reconocerlas incorrectamente como diferentes o no transcribirlas cuando las encuentre.

Figura 6: Un ejemplo de detección de una palabra fuera del vocabulario (OOV).

Solución: La tasa de error de palabras (WER, por sus siglas en inglés) es una métrica común que se utiliza para medir la precisión de un sistema de reconocimiento de voz o traducción automática. La tasa de error de palabras se puede calcular de la siguiente manera:

Figura 7: Demostración de cómo calcular la tasa de error de palabras (WER). 7

Homófonos

Los homófonos son palabras que se pronuncian de forma idéntica pero tienen significados diferentes, como "to", "too" y "two".

Solución: El análisis semántico permite a los programas de reconocimiento de voz seleccionar el homófono adecuado según su significado en un contexto determinado. El análisis de homófonos mejora la capacidad del proceso de reconocimiento de voz para comprender y transcribir con precisión las palabras habladas.

desafíos técnicos/del sistema

Privacidad y seguridad de los datos

Los sistemas de reconocimiento de voz implican el procesamiento y almacenamiento de información personal y confidencial, como información financiera. Una persona no autorizada podría utilizar la información capturada, lo que provocaría violaciones de la privacidad.

Solución: Puede cifrar la información de audio sensible y personal que se transmite entre el dispositivo del usuario y el software de reconocimiento de voz. Otra técnica para abordar la privacidad y la seguridad de los datos en los sistemas de reconocimiento de voz es el enmascaramiento de datos. Los algoritmos de enmascaramiento de datos ocultan y reemplazan los datos de voz sensibles con datos estructuralmente idénticos pero acústicamente diferentes.

Figura 8: Un ejemplo de cómo funciona el enmascaramiento de datos.

Datos de entrenamiento limitados

La escasez de datos de entrenamiento afecta directamente al rendimiento del software de reconocimiento de voz. Con datos de entrenamiento insuficientes, el modelo de reconocimiento de voz puede tener dificultades para generalizar diferentes acentos o reconocer palabras menos comunes.

Solución: Para mejorar la calidad y la cantidad de datos de entrenamiento, puede ampliar el conjunto de datos existente utilizando tecnologías de aumento de datos y generación de datos sintéticos.

Sé el primero en comentar

Tu dirección de correo electrónico no será publicada. Todos los campos son obligatorios.