Evaluación comparativa de rastreadores web de 2026: De la indexación a la agencia Intelligence

Realizamos pruebas comparativas de cuatro API de rastreo en tres dominios de dificultad variable (amazon.com, entrepreneur.com, theregister.com) con tres niveles de profundidad máxima (5, 10, 20) y un límite de 1000 páginas, midiendo la cobertura del rastreo, el tiempo de ejecución, el descubrimiento de enlaces, la calidad de los enlaces Markdown y la precisión de la extracción de títulos.

Si tu objetivo es:

- Convierte páginas web en datos estructurados; consulta nuestra guía sobre web scraping .

- Analiza sitios web completos, sigue leyendo.

Prueba de rendimiento de los rastreadores web

Puedes consultar nuestra metodología de evaluación comparativa.

Páginas indexadas promedio frente al costo por cada 1000 páginas.

Páginas rastreadas en todos los dominios por profundidad máxima

Firecrawl rastreó consistentemente alrededor de 100 páginas en theregister.com independientemente de la profundidad máxima, aproximadamente 90 páginas en entrepreneur.com en todos los niveles de profundidad, y solo alrededor de 30 páginas en amazon.com, probablemente debido a la agresiva protección contra bots de Amazon. Cabe destacar que aumentar la profundidad máxima prácticamente no tuvo impacto en la cantidad de páginas que Firecrawl pudo rastrear en cualquier dominio.

Apify demostró el rendimiento más consistente, alcanzando el límite máximo de rastreo de 1000 páginas en cada dominio y en cada nivel de profundidad sin ninguna dificultad aparente, incluso en sitios altamente protegidos como Amazon.

Cloudflare mostró un comportamiento inconsistente en las distintas pruebas:

- En theregister.com, con una profundidad máxima de 5, solo rastreó 100 páginas, pero con una profundidad máxima de 20 alcanzó casi 1000 páginas.

- Como observamos en pruebas anteriores, Cloudflare a veces rastrea solo una página y luego finaliza la tarea por completo. Confirmamos que no se trata de un problema de caché (la caché estaba deshabilitada) y realizamos pruebas con tiempos de espera entre ejecuciones de hasta 1 minuto, pero el comportamiento persistió. Con una profundidad máxima de 10 en theregister.com, se produjo exactamente este problema: Cloudflare rastreó solo una página antes de detenerse.

- En entrepreneur.com, Cloudflare rastreó 780 páginas a una profundidad de 5, aumentó a 885 a una profundidad de 10, pero luego cayó drásticamente a solo 172 páginas a una profundidad de 20. Esta caída puede estar relacionada con que el programador de rastreo de Cloudflare priorice menos o agote el tiempo de espera de las cadenas de enlaces más profundas, o podría reflejar un límite de concurrencia interno que hace que el trabajo termine prematuramente cuando la frontera de rastreo se vuelve demasiado grande a mayores profundidades.

- En amazon.com, Cloudflare rastreó 905 páginas a una profundidad de 5, pero el número disminuyó constantemente a medida que aumentaba la profundidad máxima, cayendo a 809 a una profundidad de 10 y a 795 a una profundidad de 20, lo que sugiere que las configuraciones de rastreo más profundas pueden hacer que Cloudflare dedique más tiempo a la sobrecarga de descubrimiento de enlaces que a la recuperación real de páginas.

Nimble alcanzó o se aproximó al límite de 1000 páginas en theregister.com en todos los niveles de profundidad (1000 / 1000 / 999). En entrepreneur.com, rastreó 1000 páginas en la profundidad 5, pero mostró ligeras caídas en profundidades mayores (896 en la profundidad 10, 983 en la profundidad 20), posiblemente debido a que se alcanzó su tiempo de espera de 7 horas antes de completar el rastreo completo en niveles más profundos, todas las ejecuciones de Nimble terminaron con un estado de tiempo de espera. Amazon resultó más desafiante:

- A una profundidad de 5 solo logró 319 páginas, pero a una profundidad de 10 saltó a 988 páginas, y luego bajó a 906 a una profundidad de 20.

- Esta inconsistencia probablemente refleja la combinación de los mecanismos de protección contra bots de Amazon y las restricciones de tiempo de espera de Nimble, donde los rastreos más profundos tardan más en procesar cada página y pueden encontrar más desafíos antibot en el camino.

Tiempo de ejecución en todos los dominios por profundidad máxima

Firecrawl fue el proveedor más rápido en todos los dominios, completando los rastreos en menos de 5 minutos, generalmente entre 75 y 265 segundos. Esta velocidad tiene un costo en cobertura, ya que Firecrawl también rastreó la menor cantidad de páginas. Básicamente, termina rápido porque se detiene pronto.

La consulta Apify tardó entre 2200 y 2400 segundos (unos 40 minutos) en theregister.com, independientemente de la profundidad de la página. En entrepreneur.com y amazon.com, los tiempos de ejecución fueron significativamente más largos, entre 8300 y 15 900 segundos (de 2 a 4 horas), debido a la mayor complejidad de la estructura de estos sitios web. A pesar de la mayor duración, Apify alcanzó sistemáticamente el límite de 1000 páginas, lo que la convierte en la más fiable en términos de relación cobertura-tiempo.

Cloudflare mostró una sincronización que refleja sus recuentos de rastreo inconsistentes:

- En theregister.com, con una profundidad de 10, se completó en tan solo 1 segundo, porque solo rastreó 1 página antes de detenerse.

- En entrepreneur.com, con una profundidad de 20, finalizó en 10 segundos tras rastrear tan solo 172 páginas.

- Cuando Cloudflare completa un recorrido completo, los tiempos oscilan entre 3.500 y 25.200 segundos.

- A medida que aumenta la profundidad máxima, Cloudflare parece priorizar el acceso a páginas más profundas sobre la amplitud, rastreando menos páginas pero completando la búsqueda más rápidamente. En amazon.com, el tiempo de ejecución se redujo de 25 200 segundos (tiempo de espera agotado) a una profundidad de 5 a tan solo 5660 segundos a una profundidad de 20, mientras que las páginas rastreadas también disminuyeron de 905 a 795. Esto sugiere que el rastreador de Cloudflare cambia su estrategia a mayores profundidades, dedicando menos tiempo a la exploración amplia y más al rastreo profundo.

Nimble alcanzó el tiempo límite de 7 horas (25 200 segundos) en cada ejecución en todos los dominios y niveles de profundidad. Esto es notable porque en nuestras pruebas rápidas anteriores con una profundidad máxima de 1, Nimble se completó sin agotar el tiempo límite. En la prueba de rendimiento completa con profundidades de 5 a 20 y un límite de 1000 páginas, se ejecutó de forma consistente hasta que se alcanzó el tiempo límite. A pesar de esto, Nimble aún logró rastrear una gran cantidad de páginas en la mayoría de los casos (entre 900 y 1000 en theregister.com y entrepreneur.com), lo que significa que estuvo rastreando activamente durante las 7 horas, pero simplemente nunca indicó que había finalizado.

Tasa de relleno de texto de enlace en todos los proveedores por profundidad máxima

Para evaluar la calidad de la salida Markdown, medimos qué porcentaje de enlaces en el Markdown de cada proveedor contiene texto de anclaje, la parte del texto del enlace en la que se puede hacer clic. La ausencia de texto de anclaje (por ejemplo, [](/about) en lugar de [About Us](/about)) significa que el rastreador no pudo extraer la etiqueta del enlace.

- Nimble : 100% en todas las profundidades

- Cloudflare : 91-94%

- Firecrawl : 90%

- Apify : 77-78%, aproximadamente 1 de cada 5 enlaces carecen de texto de anclaje

La profundidad de rastreo tuvo un impacto mínimo en las tasas de relleno para cualquier proveedor, lo que sugiere que se trata de una característica del motor de análisis de cada proveedor, en lugar de una configuración de rastreo.

Tasa de relleno de texto de enlaces en diferentes proveedores por dominio

Al analizar las tasas de relleno en diferentes dominios, se observa cómo la complejidad del sitio afecta la calidad de la extracción de enlaces de cada proveedor.

- Nimble se mantuvo al 100% en todos los dominios.

- El enlace Apify mostró la mayor variación, un 89 % en amazon.com, pero descendió al 66 % en entrepreneur.com, lo que significa que a un tercio de sus enlaces en ese sitio les faltaba texto de anclaje. Esto sugiere que Apify tiene más dificultades con sitios con mucho contenido y estructuras de navegación complejas.

- Firecrawl tuvo el mejor rendimiento en theregister.com (98%), pero bajó al 81% en entrepreneur.com, siguiendo un patrón similar al de Apify.

- Cloudflare fue el más consistente después de Nimble, manteniéndose entre el 89 y el 94% independientemente del dominio.

Entrepreneur.com resultó ser el dominio más difícil para la extracción de texto de enlaces; tanto Apify (66%) como Firecrawl (81%) obtuvieron allí sus puntuaciones más bajas, probablemente debido al uso intensivo del sitio de menús de navegación anidados y elementos de contenido dinámico que son más difíciles de convertir limpiamente a Markdown.

Enlaces totales en la salida Markdown en todos los dominios por profundidad máxima

La variabilidad en el número de enlaces entre los proveedores fue consistentemente alta (74-97%), lo que indica que extraen cantidades muy diferentes de enlaces de las mismas páginas. Para obtener una visión más detallada de esta disparidad, medimos el número total de enlaces en formato Markdown por proveedor.

- Apify devolvió la mayor cantidad de enlaces en general, particularmente en amazon.com con más de 420 000 enlaces a una profundidad de 5 (aproximadamente 423 por página). En entrepreneur.com se estabilizó en torno a los 63 000, independientemente de la profundidad. Su resultado incluye rastreadores de anuncios y píxeles de seguimiento junto con los enlaces al contenido de la página.

- Cloudflare alcanzó un pico de 303K en entrepreneur.com a una profundidad de 10, pero bajó a 53K a una profundidad de 20. En la misma página de inicio de entrepreneur.com, Cloudflare extrajo 434 enlaces en comparación con los 143 de Apify, capturando menús de navegación completos y submenús.

- Firecrawl devolvía consistentemente entre 5 y 9 mil enlaces en todas las configuraciones, limitado por su bajo número de páginas.

- Nimble devolvió entre 3 y 40 mil enlaces en total, con un promedio de entre 5 y 28 enlaces por página, en comparación con los 60 a 420 de otros proveedores. En la página de inicio de entrepreneur.com, Nimble devolvió 13 enlaces frente a los 434 de Cloudflare, limitados a los titulares de los artículos principales. Su tasa de relleno del 100 % refleja que los enlaces que incluyó tenían texto ancla, en lugar de indicar una cobertura de enlaces completa. Nimble no genera enlaces Markdown estándar. Su recuento incluye enlaces HTML escapados que se encuentran dentro de la salida Markdown.

Tasa de presentación de títulos en todos los proveedores

La similitud de títulos entre proveedores mostró una desviación inferior al 1 % en todas las pruebas y dominios, lo que confirma que, al extraer un título, los proveedores devuelven consistentemente el mismo resultado. La tasa de presencia de títulos también se mantuvo entre el 98 % y el 100 % en todos los niveles de profundidad máxima, lo que demuestra que la profundidad de rastreo no tiene un impacto significativo en la extracción de títulos.

Al analizar los datos por dominio, surgieron algunas diferencias:

En entrepreneur.com y theregister.com, la mayoría de los proveedores lograron tasas de presencia de títulos del 99-100%. Amazon.com fue el único dominio donde se observaron diferencias significativas: Firecrawl bajó al 93% y Nimble al 95,9%, mientras que Apify mantuvo el 99,6%. Esto coincide con la mayor protección contra bots de Amazon, que puede bloquear o distorsionar las respuestas de las páginas, lo que provoca que algunos proveedores devuelvan páginas sin títulos extraíbles.

¿Qué es un rastreador web?

Un rastreador web, a veces llamado "araña" o "agente", es un bot que navega por internet para indexar contenido.

Los rastreadores han trascendido el ámbito de los motores de búsqueda y ahora funcionan como la capa de datos de agentes. Actúan como los ojos de agentes de IA autónomos como Claude Code y OpenAI Operator, ayudándoles con tareas en tiempo real como la investigación de la competencia y las transacciones de varios pasos.

¿Qué hace un rastreador web?

El rastreo web se dividió en tres modos, cada uno diseñado para un objetivo diferente del rastreador.

- Modo de descubrimiento (tradicional): Los bots de los motores de búsqueda, como Googlebot, rastrean las URL para indexarlas, lo que ayuda a las personas a encontrar resultados a través de los motores de búsqueda.

- Modo de recuperación (RAG): Los bots de IA como ChatGPT-User o PerplexityBot obtienen páginas específicas en tiempo real para responder a las preguntas del usuario. Utilizan Markdown en lugar de HTML para ajustarse a los límites de tokens del modelo de IA.

- Modo Agente (Orientado a la Acción): Este nuevo tipo de rastreador, disponible en 2026, va más allá de simplemente leer contenido. Mediante el Protocolo de Contexto de Modelo (MCP), estos bots pueden interactuar con sitios web para reservar vuelos o ejecutar comandos de software.

En el pasado, los rastreadores web utilizaban selectores como XPath o CSS para extraer datos. La extracción nativa mediante IA se ha convertido en la norma.

Herramientas como Firecrawl y Crawl4AI utilizan instrucciones en lenguaje natural para encontrar datos. En lugar de escribir reglas para cada elemento, los desarrolladores pueden indicarle al rastreador que "extraiga el precio del producto", y la IA encontrará el valor correcto incluso si el código del sitio web cambia.

Desarrollar o comprar rastreadores web en la era de la IA

1. Construyendo tu propio vehículo oruga

Ideal para proteger la propiedad intelectual clave y permitir una personalización profunda. Su desarrollo ahora requiere crear una capa de agente propia, no solo escribir scripts básicos de Scrapy.

- Cuándo desarrollarlo: Elija este enfoque si su rastreador le brinda una ventaja competitiva única. Por ejemplo, desarrolle el suyo propio si está creando un motor de búsqueda especializado o si necesita un control total sobre datos confidenciales o regulados.

- El conjunto de herramientas: Ya no es necesario empezar desde cero. Los desarrolladores ahora aprovechan el Protocolo de Contexto de Modelo (MCP) para permitir que los agentes de IA internos interactúen con la web.

2. Uso de herramientas y API de rastreo web

Las herramientas gestionadas han evolucionado desde simples rastreadores web hasta agentes autónomos.

- Extracción sin mantenimiento: Las herramientas modernas como Kadoa y Firecrawl utilizan IA de autorreparación. Solo tienes que especificar los datos necesarios, como el "Precio del producto", en lugar de su ubicación en el código. Si cambia el diseño del sitio web, la herramienta se adapta automáticamente.

- Cumplimiento normativo como servicio: Muchos proveedores ofrecen cumplimiento integrado con la Ley de IA de la UE. Gestionan los registros de auditoría obligatorios y las comprobaciones de exclusión voluntaria de derechos de autor, que resultan difíciles de implementar de forma independiente.

- Rapidez en la obtención de valor: Adquirir una plataforma puede llevar su proyecto desde el concepto hasta la producción en cuestión de semanas.

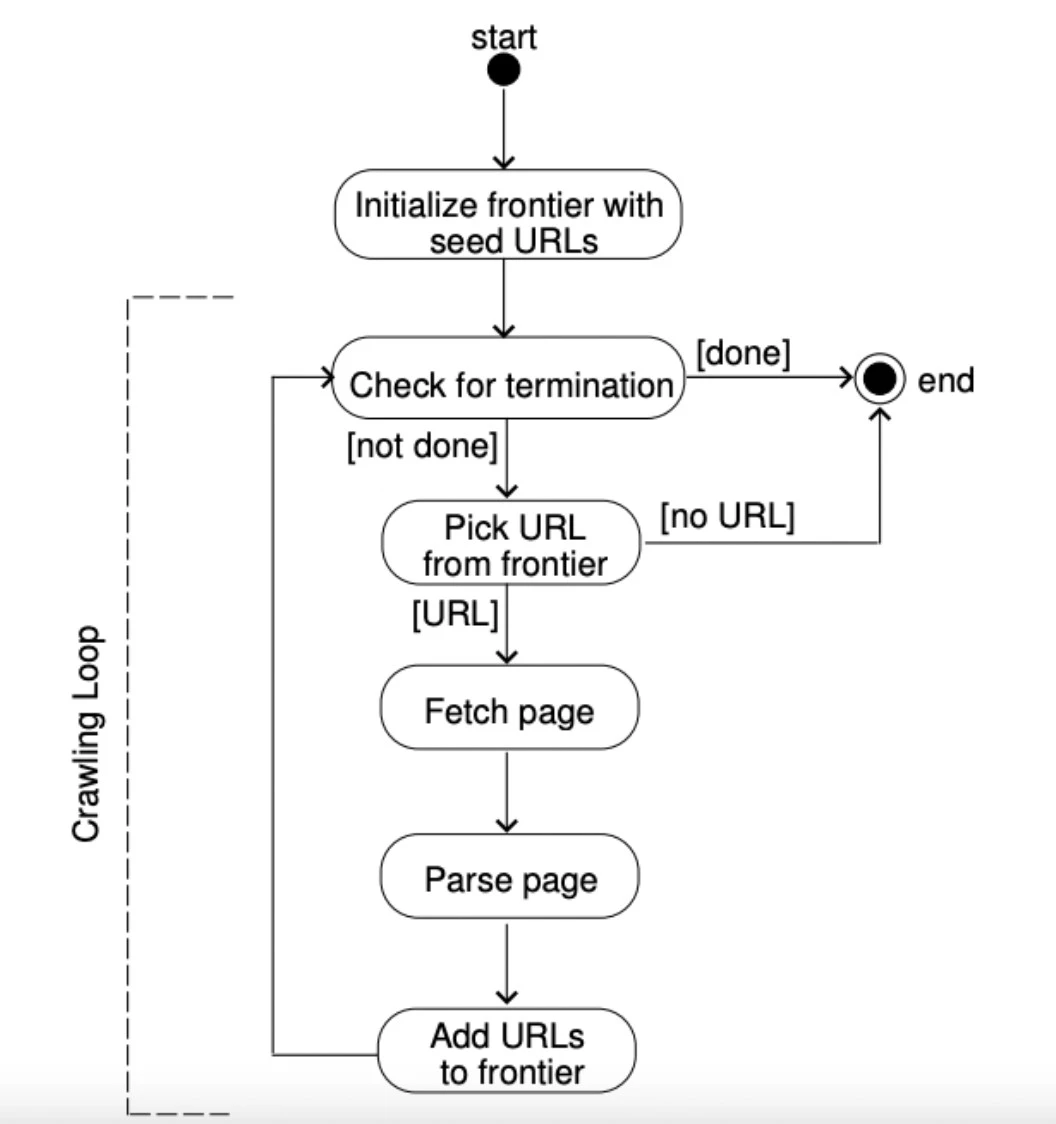

Figura 5: Explicación del funcionamiento de una frontera URL.

¿Son legales los rastreadores web?

En general, el rastreo web es legal , pero dependiendo de cómo y qué se rastree, uno podría encontrarse rápidamente en un aprieto legal. Cuatro pilares principales determinan si el rastreo (y el raspado que suele seguir) es legal:

1. Público vs. privado: Solo se deben rastrear los datos que estén disponibles públicamente sin necesidad de una cuenta.

2. Información personal: Evite proporcionar información personal identificable (nombres, correos electrónicos y direcciones) a menos que tenga una base legal para ello.

3. Estado del servidor: Utilice límites de velocidad para evitar ralentizar el servidor; evite realizar ataques DDoS a un sitio web.

4. Derechos de autor : Los artículos e imágenes están protegidos por derechos de autor, pero los datos (precios, fechas) no lo están.

¿Cuál es la diferencia entre rastreo web y extracción de datos web?

El web scraping consiste en utilizar rastreadores web para escanear y almacenar todo el contenido de una página web específica. En otras palabras, el web scraping es un caso de uso específico del rastreo web para crear un conjunto de datos específico, como extraer todas las noticias financieras para el análisis de inversiones o buscar nombres de empresas concretas.

Tradicionalmente, una vez que un rastreador web había indexado todos los elementos de una página web, un extractor de datos web extraía la información de dicha página. Sin embargo, hoy en día, los términos "scraping" y "cracking" se usan indistintamente, con la diferencia de que "crawler" suele referirse más a los rastreadores de los motores de búsqueda. A medida que otras empresas, además de los motores de búsqueda, comenzaron a utilizar datos web, el término "web scraper" empezó a reemplazar al de "web crawler".

¿Cuáles son los desafíos del rastreo web?

1. Actualización de la base de datos

El contenido de los sitios web se actualiza periódicamente. Las páginas web dinámicas, por ejemplo, modifican su contenido en función de las actividades y el comportamiento de los visitantes. Esto significa que el código fuente del sitio web no permanece inalterado tras el rastreo. Para ofrecer al usuario la información más actualizada, el rastreador web debe volver a rastrear esas páginas con mayor frecuencia.

2. Trampas para larvas

Los sitios web emplean diversas técnicas, como las trampas para rastreadores, para impedir que estos accedan a ciertas páginas web y las exploren. Una trampa para rastreadores provoca que un rastreador web realice un número infinito de solicitudes, quedando atrapado en un círculo vicioso. Los sitios web también pueden crear trampas para rastreadores de forma involuntaria. En cualquier caso, cuando un rastreador se topa con una trampa, entra en un bucle infinito que consume sus recursos.

3. Ancho de banda de la red

Descargar un gran número de páginas web irrelevantes, utilizar un rastreador web distribuido o volver a rastrear muchas páginas web dan como resultado un alto índice de consumo de capacidad de red.

4. Páginas duplicadas

Los robots de rastreo web suelen rastrear todo el contenido duplicado en la web; sin embargo, solo se indexa una versión de cada página. El contenido duplicado dificulta que los robots de los motores de búsqueda determinen qué versión indexar y posicionar. Cuando el robot Google detecta un grupo de páginas web idénticas en los resultados de búsqueda, indexa y selecciona solo una de ellas para mostrarla en respuesta a la consulta del usuario.

Las 3 mejores prácticas para el rastreo web

1. Cortesía/Tasa de rastreo

Los sitios web establecen una tasa de rastreo para limitar el número de solicitudes que realizan los robots rastreadores. Esta tasa indica cuántas solicitudes puede realizar un rastreador a su sitio web en un intervalo de tiempo determinado (por ejemplo, 100 solicitudes por hora). Esto permite a los propietarios de sitios web proteger el ancho de banda de sus servidores y reducir la sobrecarga. Un rastreador debe respetar el límite de rastreo del sitio web objetivo.

2. Cumplimiento de Robots.txt

Un archivo robots.txt es un archivo de texto ubicado en la raíz de un sitio web que indica a los rastreadores a qué páginas tienen acceso y a cuáles no. Se trata de un estándar voluntario, lo que significa que los bots compatibles lo respetan, pero técnicamente no impide el acceso. Seguir las instrucciones del archivo robots.txt de un sitio web se considera una buena práctica, y en muchas jurisdicciones, ignorarlo puede acarrear riesgos legales o de reputación.

3. Rotación de IP

Los sitios web emplean diversas técnicas anti-scraping, como los CAPTCHA, para gestionar el tráfico de los rastreadores y reducir las actividades de web scraping. Por ejemplo, la huella digital del navegador es una técnica de seguimiento que utilizan los sitios web para recopilar información sobre los visitantes, como la duración de la sesión o las páginas vistas.

Este método permite a los propietarios de sitios web detectar el tráfico no humano y bloquear la dirección IP del bot. Para evitar la detección, puede integrar proxies rotativos , como proxies residenciales , en su rastreador web.

Metodología de evaluación comparativa de rastreadores web

Probamos cuatro API de rastreo (Apify, Nimble, Cloudflare, Firecrawl) en tres dominios de dificultad variable: amazon.com (protección contra bots fuerte), entrepreneur.com (sitio de contenido complejo) y theregister.com (sitio de noticias).

Configuración compartida

Todos los proveedores recibieron la misma configuración básica para garantizar una comparación justa:

- Mapa del sitio: Deshabilitado, los proveedores deben descubrir las páginas únicamente a través de enlaces HTML.

- Enlaces externos: Deshabilitados, los rastreadores permanecen dentro del dominio de destino.

- Subdominios: Activado, se siguen las páginas de subdominios (por ejemplo, india.entrepreneur.com).

- Renderizado de JavaScript: Habilitado, todos los proveedores utilizan un navegador sin interfaz gráfica.

- Caché: Deshabilitada

- Límite de páginas: 1000 páginas por ejecución

- Tiempo de espera: 7 horas (25.200 segundos)

- Gestión del límite de velocidad: espera de 20 segundos con hasta 3 reintentos en HTTP 429.

Cada proveedor se probó en tres niveles de profundidad máxima (5, 10 y 20) en los tres dominios, lo que supuso un total de 36 ejecuciones de rastreo. Los proveedores se probaron de forma secuencial (no en paralelo), cada combinación se ejecutó una vez y el estado del rastreo se consultó cada segundo.

Apify se configuró con el actor website-content-crawler usando Playwright/Firefox como su navegador sin interfaz gráfica. El acceso a los subdominios se controló mediante patrones glob, y se utilizó el proxy integrado de Apify para todas las solicitudes.

Los dispositivos Nimble, Cloudflare y Firecrawl se configuraron utilizando sus respectivas API REST con la configuración compartida descrita anteriormente. No se aplicaron configuraciones adicionales específicas del proveedor más allá de los parámetros estandarizados.

Para Cloudflare, utilizamos el plan Workers Paid. El costo reportado refleja lo que gastamos para rastrear 1000 páginas con este plan. Cloudflare cobra en función del tiempo de renderizado del navegador, no del número de páginas.

Para Firecrawl, utilizamos el plan Hobby. El costo reportado corresponde al monto prorrateado para 1000 créditos de los créditos incluidos en este plan. El costo efectivo por página varía según el nivel del plan y si se adquieren paquetes de créditos adicionales.

Comentarios 1

Comparte tus ideas

Tu dirección de correo electrónico no será publicada. Todos los campos son obligatorios.

Hi Cem, I think there is a misunderstanding regarding the robots.txt role in the crawling context. The web bots can crawl any website when indexing is allowed without having the robots.txt somewhere on their top domain, subdomains and ports and so on. The role of a robots.txt is to keep control of the traffic from web bots so the website is not overloaded by requests.