El mercado de plataformas de IA responsable incluye dos tipos de software. Siga los enlaces para obtener más información:

Plataformas de IA responsables orientadas a la empresa, tales como:

- Credo AI y IBM Watsonx.governance para la gobernanza de la IA

- Amazon SageMaker y Dataiku para MLOps con capacidades de IA responsables

- Databricks y IBM Watsonx.data Intelligence para una plataforma de datos con funciones de IA responsables.

Bibliotecas de IA de código abierto y responsables que ofrecen funcionalidades específicas (por ejemplo, aprendizaje federado):

- TensorFlow Federated (TFF) para la privacidad

- IA Equidad 360 para la equidad

- Dalex para la explicabilidad (es decir, XAI )

- TextAttack para aprendizaje automático adversario

Estas herramientas se identifican como líderes del mercado según métricas como el número de reseñas, funcionalidades, puntuaciones en GitHub y referencias en empresas Fortune 500. Consulta los casos de uso y el enfoque de las herramientas (como MLops, gobernanza de IA y gobernanza de datos) siguiendo los enlaces correspondientes.

Plataformas de IA responsables para empresas

Plataforma | Tipo | número de empleados | Clasificación |

|---|---|---|---|

IA holística | gobernanza de la IA | 85 | No hay suficientes reseñas |

Credo AI | gobernanza de la IA | 49 | No hay suficientes reseñas |

IA justa | gobernanza de la IA | 13 | No hay suficientes reseñas |

Aporía | MLOPs | 359 | 4.8 basado en 68 reviews |

Dataiku | MLOPs | 1,378 | 4.5 basado en 198 reviews |

Amazon SageMaker | MLOPs | 130,371 | 4.5 basado en 49 reviews |

Databricks | Gobernanza de datos | 9,280 | 4.6 basado en 655 reviews |

IBM Watsonx | Gobernanza de datos | 4,07 basado en 30 reseñas | |

Snowflake | Gobernanza de datos | 8,441 | 4.6 basado en 770 reviews |

IA experta | Programación Neurolingüística Responsable | 278 | No hay suficientes reseñas |

* Estas herramientas están ordenadas alfabéticamente dentro de su categoría, excepto los patrocinadores, que se colocan en la parte superior.

Plataformas de gobernanza de IA

Las herramientas de gobernanza de IA ayudan a las unidades de negocio a implementar sistemas de IA que cumplen con los estándares de la industria.

Credo AI

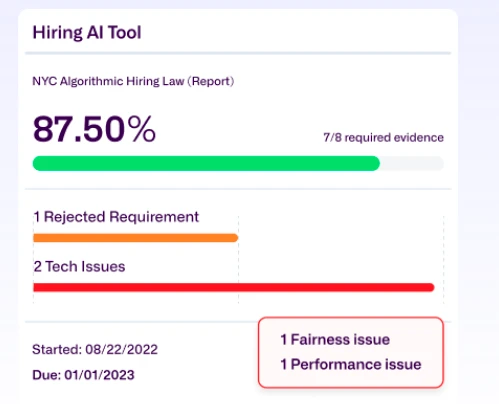

Credo AI, una plataforma de gobernanza de IA responsable, puede ayudar a las empresas a:

- Colabore con herramientas como la recopilación de pruebas, el seguimiento de la rendición de cuentas y la simplificación de las adquisiciones a terceros.

- Evaluar los sistemas de IA en cuanto a riesgos operativos, regulatorios y reputacionales a lo largo de su ciclo de vida.

- Elabore documentos de gobernanza traduciendo la evidencia técnica en documentos fáciles de usar, creando fichas modelo, informes de auditoría, informes de riesgos y cumplimiento, y divulgaciones.

- Garantizar el cumplimiento de las normativas internacionales, como la Ley de IA de la UE y la Ley de Datos e IA de Canadá, las políticas internas y los estándares del sector.

IA justa

Fairly AI, ahora adquirida por Asenion, es una herramienta de gobernanza de IA que simplifica la validación de modelos, el proceso de auditoría y las evaluaciones de riesgos, garantizando el cumplimiento normativo y la gestión de riesgos. El marco de IA responsable de Fairly AI identifica las deficiencias en las políticas y regulaciones, lo que ayuda a seleccionar las políticas adecuadas y garantiza una cobertura integral para una gobernanza y gestión de riesgos de IA eficaces.

IA holística

Holistic AI proporciona marcos de gestión de riesgos, cumplimiento y gobernanza de la IA para ayudar a las empresas a implementar la IA de forma responsable.

- Evaluación de sesgos mediante la identificación y mitigación de sesgos en los sistemas de IA, ofreciendo estrategias prácticas, apoyo continuo e informes de auditoría completos que pueden compartirse con las partes interesadas.

- Evaluación de la conformidad mediante la catalogación y validación de sistemas de IA de alto riesgo conforme a los requisitos de la Ley de IA, la realización de evaluaciones de riesgos con estrategias de mitigación y la garantía de que la documentación técnica se ajuste a las normas legales.

- Gestión proactiva de riesgos mediante la recepción de informes periódicos y la realización de autoauditorías para detectar impactos adversos, al tiempo que se utilizan análisis basados en datos para optimizar el uso de la IA y fundamentar las decisiones estratégicas.

IBM Watsonx.governance

Watsonx.governance puede mejorar la confianza y la transparencia de la IA al proporcionar visibilidad de nivel empresarial, seguimiento de activos de IA y cumplimiento de flujos de trabajo de datos e IA en varios entornos de implementación, incluidos Cloud y AWS.

Los usuarios de Watsonx.governance pueden integrarse con otras herramientas de Watsonx Studio, como Watsonx.ai y Watson.data, para entrenar, validar, ajustar e implementar IA.

MLOps

Amazon SageMaker y Amazon Bedrock

Amazon proporciona herramientas diseñadas para ayudar a los equipos de cumplimiento normativo a implementar sistemas de IA responsables, tales como:

- En Amazon Bedrock: Un servicio totalmente administrado que simplifica el desarrollo de aplicaciones de IA generativa al proporcionar acceso a modelos base de alto rendimiento sin necesidad de preparación de datos, creación de modelos ni gestión de infraestructura.

- Mecanismos de protección : Implementa medidas de seguridad en la IA generativa especificando los temas que se deben evitar y detectando y previniendo automáticamente las consultas y respuestas restringidas.

- Evaluación de modelos : Evalúa y compara los modelos de Foundation basándose en métricas personalizadas como la precisión y la seguridad para ayudar a seleccionar el mejor modelo para casos de uso específicos.

- En Amazon SageMaker: una plataforma de aprendizaje automático que ofrece los procesos de creación, entrenamiento e implementación de modelos, lo que la hace ideal para tareas de aprendizaje automático personalizadas como análisis predictivos, sistemas de recomendación y detección de anomalías.

- Aclaración : Detecta posibles sesgos y proporciona explicaciones de las predicciones del modelo, ofreciendo transparencia e información valiosa para garantizar decisiones de IA justas e informadas.

- Monitor de modelos : Supervisa los modelos implementados detectando automáticamente las predicciones inexactas y emitiendo alertas para mantener la calidad del modelo.

- Gobernanza del aprendizaje automático : Mejora la gobernanza al ofrecer herramientas para controlar y supervisar los modelos de aprendizaje automático, incluyendo la captura y el intercambio de información del modelo para garantizar una implementación responsable de la IA.

- Amazon Augmented AI : Facilita la revisión humana de las predicciones de aprendizaje automático, lo que permite la supervisión cuando se requiere el juicio humano.

Descubre cómo Amazon Bedrock ofrece una IA responsable:

Aporía

La plataforma Aporia Responsible AI ofrece una gobernanza integral para proyectos de IA mediante:

- Garantizar la diversidad de datos, evaluar las métricas de equidad y monitorear los sistemas para detectar sesgos y mantener estándares éticos de IA.

- Cumplir con regulaciones como el RGPD y otros estándares de la industria

- Promover la rendición de cuentas y la transparencia mediante la IA explicable, garantizando que los procesos de toma de decisiones de la IA sean comprensibles.

Dataiku

Dataiku es una plataforma de aprendizaje automático y ciencia de datos que crea, implementa y gestiona proyectos de datos, análisis e inteligencia artificial. Puede brindar soporte a la IA responsable en esos proyectos a través de varias capacidades clave:

- Análisis estadístico avanzado : Facilita un análisis exhaustivo de los datos para identificar y abordar posibles sesgos.

- Informes de equidad del modelo : Proporciona métricas como la paridad demográfica y la igualdad de probabilidades para medir y mitigar los sesgos.

- IA explicable : Ofrece explicaciones a nivel de fila y análisis de escenarios hipotéticos para garantizar la transparencia y la rendición de cuentas.

- Cumplimiento de la privacidad de datos : Garantiza el cumplimiento de normativas como el RGPD y la CCPA.

- Documentación del modelo : Automatiza la creación de documentación detallada del modelo para fines regulatorios e internos.

- Herramientas de gobernanza : Implementa planes de proyecto estándar y modelos de flujo de trabajo para alinearse con las prácticas de IA responsable y los requisitos reglamentarios.

Gobernanza de datos

La gobernanza de datos se refiere al marco general que alinea las prácticas de datos con los objetivos comerciales y las estructuras de rendición de cuentas. Una aplicación común de la gobernanza de datos se encuentra en las aplicaciones de aprendizaje automático, denominada gobernanza de datos de aprendizaje automático .

Databricks

Databricks es una plataforma unificada de datos e IA que garantiza la propiedad y el control de los datos para los modelos de IA a través de una monitorización integral, controles de privacidad y gobernanza. Databricks ofrece IA responsable a través de su Marco de Pruebas de IA Responsable, que incluye:

- Pruebas de penetración con IA para identificar vulnerabilidades.

- Análisis automatizado y manual de sesgos y cuestiones éticas.

- Pruebas de jailbreak para comprender el comportamiento del modelo bajo ataques.

- Modelar la seguridad de la cadena de suministro para proteger los sistemas de IA a lo largo de su ciclo de vida.

IBM Watsonx.data intelligence

Watsonx.data intelligence es una plataforma de gobernanza e inteligencia de datos que garantiza datos de alta calidad, conformes a las normativas y listos para su uso empresarial en modelos de IA. Ofrece una IA responsable a través de sus capacidades de inteligencia de datos basadas en IA, que incluyen:

- Acceso al lenguaje natural para que usuarios de todos los niveles de habilidad puedan buscar y aprovechar los datos de manera eficiente.

- Descubrimiento y catalogación automatizados de datos en fuentes estructuradas y no estructuradas.

- Gobernanza de datos y controles de calidad que incluyen linaje, clasificación y análisis de impacto.

Enriquecimiento y estandarización de datos mediante IA para obtener conjuntos de datos consistentes y utilizables.

Snowflake

Snowflake es una plataforma de datos en la nube para el almacenamiento, procesamiento y análisis de datos, que ayuda a las empresas a gestionar y utilizar sus datos de forma eficiente. Su enfoque de IA responsable hace hincapié en la seguridad de los datos, la diversidad y la madurez organizacional, garantizando que las aplicaciones de IA se desarrollen sobre una base de datos segura, diversa y bien gobernada. Además, Snowflake promueve la alfabetización de datos y la colaboración interfuncional para impulsar el uso responsable de la IA en todas las organizaciones.

Herramientas y bibliotecas de IA responsables de código abierto

* Estas herramientas están ordenadas según su puntuación en GitHub dentro de su categoría. Tenga en cuenta que las bibliotecas que no están actualizadas quedan excluidas de esta lista.

Privacidad de la IA

Estas bibliotecas se centran en el uso de la IA con fines legítimos, evitando aplicaciones poco éticas. Las organizaciones que se adhieren a los estándares éticos de la IA implementan directrices estrictas, procesos de revisión exhaustivos y objetivos claros para garantizar el cumplimiento.

- TensorFlow Privacy : una biblioteca de Python que ofrece implementaciones de optimizadores de TensorFlow para entrenar modelos de aprendizaje automático con privacidad diferencial.

- TensorFlow Federated (TFF) : Diseñado para respaldar la investigación y la experimentación abiertas en el aprendizaje federado (FL), donde un modelo global se entrena en múltiples clientes sin compartir sus datos locales.

- Deon : Una herramienta de línea de comandos que permite añadir una lista de verificación ética a los proyectos de ciencia de datos, promoviendo consideraciones éticas y proporcionando recordatorios prácticos para los desarrolladores.

Transparencia y sesgo en la IA

Las bibliotecas de transparencia de la IA permiten a las partes interesadas comprender y explicar los modelos de IA, garantizando la transparencia en los motivos, los datos y la intención que hay detrás de los modelos de IA.

- Model Card Toolkit (MCT) : Automatiza la creación de tarjetas de modelo, que son documentos que ofrecen contexto y transparencia con respecto al desarrollo y el rendimiento de un modelo.

Justicia

La equidad en la IA implica proteger a las personas y los grupos de la discriminación, los sesgos y el maltrato. Los modelos deben evaluarse en cuanto a su equidad para prevenir sesgos contra grupos, factores o variables específicos.

- AI Fairness 360 : Un conjunto de herramientas de código abierto de IBM que ofrece técnicas para detectar y mitigar el sesgo en los modelos de aprendizaje automático a lo largo del ciclo de vida de la IA.

- Fairlearn : Un paquete de Python que ayuda a los desarrolladores a evaluar la imparcialidad de sus sistemas de IA y a mitigar cualquier sesgo identificado, ofreciendo tanto algoritmos de mitigación como métricas para la evaluación del modelo.

- Caja de herramientas de IA responsable : Un conjunto de herramientas de Microsoft que proporciona interfaces para explorar y evaluar modelos y datos de IA, facilitando el desarrollo y la implementación de sistemas de IA de manera segura y ética.

Explicabilidad de la IA

Las bibliotecas de explicabilidad de la IA ayudan a mejorar la comprensión humana y la confianza en los resultados de los algoritmos de aprendizaje automático.

- DALEX : Un paquete independiente del modelo que ayuda a explorar y explicar el comportamiento de los modelos, facilitando la comprensión de modelos complejos.

- Validación de datos de TensorFlow (TFDV) : Una biblioteca para explorar y validar datos de aprendizaje automático, optimizada para la escalabilidad y la integración con TensorFlow y TensorFlow Extended (TFX).

Aprendizaje automático adversario

El aprendizaje automático adversario es una técnica que intenta explotar los modelos de inteligencia artificial utilizando información accesible para crear ataques maliciosos.

- TextAttack : Un marco de trabajo en Python para ataques adversarios, entrenamiento y aumento de datos en PLN, que simplifica el proceso de prueba y mejora la robustez de los modelos de PLN.

¿Qué es la IA responsable?

4 Principios rectores de la IA , también conocida como inteligencia artificial (IA) responsable, se refieren a generar confianza en las soluciones de IA mediante la aplicación de un conjunto de principios que son:

- Justicia

- Privacidad

- Seguridad y protección

- Transparencia

Estos principios ayudan a guiar el diseño, el desarrollo, la implementación y el uso de la IA.

¿Por qué es importante la IA responsable?

Como Las estadísticas sobre IA y las tendencias de automatización de TI indican lo siguiente:

- El 90% de las aplicaciones empresariales comerciales incorporarán capacidades de inteligencia artificial el próximo año.

- Nueve de cada diez empresas líderes están invirtiendo en tecnologías de IA. Tras el lanzamiento de ChatGPT en 2022, las empresas informaron de una

- Aumento del 97% en el interés por el desarrollo de la IA generativa.

- Se ha observado un aumento del 72% en la adopción de pipelines de aprendizaje automático para respaldar estrategias de IA generativa.

Este aumento en la adopción de la IA y las herramientas de IA generativa conlleva preocupaciones y precauciones, tales como:

- El 71% de los líderes de TI están preocupados por las vulnerabilidades de seguridad de LLM y los riesgos de la IA generativa .

- El 77% de las empresas priorizan el cumplimiento de la normativa sobre IA .

- El 69% de las empresas han implementado prácticas de IA responsables para evaluar el cumplimiento normativo e identificar riesgos. 9

- Las leyes de protección de datos, como el RGPD (UE) y la CCPA (California), tienen como objetivo prevenir las violaciones de la privacidad.

- La Ley de IA de la UE exige a las organizaciones que mantengan sus inventarios de IA actualizados y precisos.

- Aumento de los casos de sesgo en la IA , como el racismo, el sexismo, la discriminación por discapacidad y la discriminación por edad.

Preguntas frecuentes

La gobernanza de datos abarca los marcos y herramientas que las organizaciones utilizan para proteger y utilizar adecuadamente sus datos. Algunos de los métodos, procesos y tecnologías en la gobernanza de datos incluyen:

1- Recopilación de datos

2- Almacenamiento de datos

3- Procesamiento de datos

4- Limpieza de datos

5- Gestión de datos

6- Compartir datos de forma controlada para:

6.a- Proteger la privacidad de los datos

6.b- Mantener la calidad de los datos

6.c- Apoyar el cumplimiento de las normativas pertinentes .

7- Gestión de amenazas internas (ITM) .

La IA fiable se refiere a los sistemas de inteligencia artificial que funcionan de forma consistente según lo previsto: con precisión, robustez y seguridad en diferentes condiciones.

La IA confiable es un término relevante para la IA responsable, ya que la confianza, la equidad y el cumplimiento dependen de sistemas que se comporten de manera predecible. Las herramientas de IA responsable garantizan la confiabilidad mediante la monitorización de modelos, la detección de sesgos, la explicabilidad y la alineación con la normativa.

Lecturas adicionales

Aprenda otras herramientas y prácticas para mitigar los riesgos de la IA generativa, tales como:

- Herramientas de seguridad LLM

- Tecnologías que mejoran la privacidad

- Herramientas LLMOps

- Herramientas MLOps

- Herramientas de gobernanza de la IA.

Sé el primero en comentar

Tu dirección de correo electrónico no será publicada. Todos los campos son obligatorios.