ChatGPT, haftalık 900 milyon aktif kullanıcıya ulaştı ve günlük yaklaşık 2,5 milyar istek işleme aldı. 1

Büyük dil modellerinin geleceğini, kendi kendine eğitim, gerçek kontrolü ve seyrek uzmanlık gibi LLM sınırlamalarını giderebilecek umut vadeden yaklaşımları inceleyerek görün.

Büyük dil modellerinin gelecekteki eğilimleri

1- Canlı Verilerle Gerçek Zamanlı Bilgi Doğrulama

LLM'ler artık yalnızca eğitim verilerine güvenmek yerine, görüşmeler sırasında harici kaynaklara erişiyor. Model, harici veritabanlarını sorguluyor, güncel bilgileri alıyor ve alıntılar sunuyor.

Sınırlama: Hala hatalar yapabiliyor. Kaynak gösterimleri doğruluğu garanti etmiyor; modeller bazen kaynakları yanlış alıntılayabiliyor veya alıntılanan içeriği yanlış yorumlayabiliyor.

- Microsoft Copilot: GPT-5.2'yi canlı internet verileriyle entegre eder. Güncel olaylara dayalı soruları kaynak bağlantılarıyla yanıtlar.

- ChatGPT: Son olaylar hakkında sorulduğunda internette arama yapar. Yanıtlarında kaynakları belirtir.

- Perplexity: Özellikle alıntılı arama için oluşturulmuştur. Her cevap kaynak bağlantıları içerir.

2- Sentetik eğitim verileri

Modeller, insan tarafından etiketlenmiş verilere ihtiyaç duymak yerine kendi eğitim veri kümelerini oluştururlar.

Google'nın kendini geliştirme modeli (2023 araştırması):

- Model sorular oluşturuyor

- Küratörler yanıtlar

- Üretilen verilere göre kendini ince ayar yapar.

- Performans artışı: GSM8K matematik problemlerinde %74,2'den %82,1'e, DROP okuma anlama testinde ise %78,2'den %83,0'a yükseldi.

Şekil: Google'nın kendi kendini geliştiren modelinin genel görünümü

Kaynak : “Büyük Dil Modelleri Kendi Kendini Geliştirebilir”

OpenAI, Anthropic ve Google numaralı modellerin tümü, insan tarafından etiketlenmiş veri kümelerini tamamlamak için sentetik veriler kullanmaktadır. Bu, veri etiketleme maliyetlerini düşürür ancak yeni önyargı riskleri getirir; modeller kendi hatalarını büyütebilir.

3- Seyrek Uzman Modelleri (Uzmanların Karışımı)

Her girdi için tüm sinir ağını etkinleştirmek yerine, göreve bağlı olarak yalnızca ilgili parametrelerin bir alt kümesi etkinleştirilir. Model, girdiyi ağ içindeki uzmanlaşmış "uzmanlara" yönlendirir. Yalnızca etkinleştirilen uzmanlar sorguyu işler.

Gerçek hayattan örnekler

- Llama 4 Scout: Toplam 109 milyar parametre, token başına 17 milyar aktif parametre. Uzmanlar Karışımı (MoE) mimarisi, tek bir H100 GPU üzerinde 10 milyon tokenlik bir bağlam penceresi sunar. 2

- Mistral Devstral 2: Yazılım mühendisliği görevleri için özel olarak tasarlanmıştır. 123 milyar parametre, 256 bin token bağlam penceresi. SWE-bench Verified'da %72,2 başarı elde ederek önde gelen açık kaynaklı kodlama modeli olarak kendini kanıtlamıştır. Daha küçük bir varyantı olan Devstral Small 2 (24 milyar parametre), Apache 2.0 lisansı altında tüketici donanımında yerel olarak çalışır. 3

- DeepSeek V3.2: Toplam 671B parametre, MoE kullanılarak belirteç başına 37B etkinleştirildi. Daha hızlı uzun bağlamlı çıkarım ve azaltılmış hesaplama maliyeti için DeepSeek Seyrek Dikkat (DSA) özelliğini sunar. Harici araçları çağırırken modelin ajansal iş akışları içinde akıl yürütmesini sağlayan Araç Kullanımında Düşünmeyi destekler. 4

4- Kurumsal İş Akışı Entegrasyonu

LLM'ler bağımsız araçlar olarak kullanılmak yerine doğrudan iş süreçlerine entegre edilir.

Gerçek hayattan örnekler

- Salesforce Agentforce (eski adıyla Einstein Copilot): LLM'leri CRM işlemlerine entegre eder. Müşteri sorularını yanıtlar, içerik oluşturur ve Einstein Güven Katmanı aracılığıyla kuruluşun CRM verileri ve meta verilerine dayalı olarak Salesforce içinde eylemleri gerçekleştirir. 5

- Microsoft 365 Copilot: Word, Excel, PowerPoint ve Outlook'a entegre edilmiştir. Şirket verilerini kullanarak belgeler taslaklarını oluşturur, elektronik tabloları analiz eder, sunumlar hazırlar ve e-posta yazışmalarını özetler; yanıtları kurumsal bağlamda temellendirmek için Microsoft Grafiği kullanır. 6

- Anthropic Kurumsal Kullanım için Claude: Proje tabanlı bellek ayrımı, ekipler arasında çalışma bağlamlarını birbirinden ayrı tutar. Claude Opus 4.6, birden fazla Claude aracısının daha büyük görevleri paralel iş akışlarına bölmesine, her birinin bir bölümü yönetmesine ve diğerleriyle eş zamanlı olarak koordinasyon sağlamasına olanak tanıyan aracı ekiplerini tanıttı. Aynı sürüm, Claude'u doğrudan PowerPoint'e yerel bir yan panel olarak entegre etti (araştırma önizlemesi), böylece sunumlar dosya aktarımı olmadan uygulama içinde oluşturulup düzenlenebiliyor. 7

5- Çok modlu özelliklere sahip hibrit LLM'ler

Gelecekteki gelişmeler, metin, görüntü ve ses gibi birden fazla veri biçimini entegre eden, farklı medya türlerinde içerik anlamayı ve üretmeyi sağlayan, böylece yeteneklerini ve uygulamalarını daha da geliştiren büyük çok modlu modelleri içerebilir.

- GPT-5.2: Metin ve görüntüleri yerel olarak işler. Ekran görüntülerinden kod üretir, belgeleri analiz eder ve görsel ipuçlarından kullanıcı arayüzü oluşturur. Ses ve video API düzeyinde desteklenmemektedir. 8

- Gemini 3.1 Pro: 1 milyon token'lık bir bağlam penceresi içinde metin, ses, resim, video ve tüm kod depolarını yerel olarak işler. Google AI Studio, Vertex AI ve NotebookLM genelinde kullanılabilir. 9

- Llama 4 Scout ve Maverick: Meta'in açık ağırlıklı modelleri, ayrı modüller olarak eklenmek yerine baştan birlikte eğitilen erken füzyonlu çok modlu metin ve görüntü belirteçlerini kullanır. Modeller 200 dilde önceden eğitilmiştir ve Arapça, İspanyolca, Almanca ve Hintçe dahil olmak üzere 12 dil için özel ince ayar desteği sağlar. 10

Çok modlu yetenek artık öncü modellerin genelinde standart hale geldi. Geriye kalan zorluk tutarlılıktır: modeller yaygın görüntü-metin kombinasyonlarında iyi performans gösterirken, nadir görsel bağlamlarda, düşük çözünürlüklü girdilerde ve görsel ve metinsel kanıtları birleştirmeyi gerektiren çapraz modlu akıl yürütmede performansları düşmektedir.

6- Akıl yürütme modelleri

Sorunları anında çözüm üretmek yerine adım adım "düşünen" modeller.

Tahminden akıl yürütmeye geçiş, şunların sağlanması için kritik öneme sahiptir:

- Ajanik davranış , modellerin görevleri özerk bir şekilde planladığı, yürüttüğü ve uyarladığı bir yaklaşımdır.

- Yorumlanabilir yapay zeka ; burada çıktılar adım adım ve mantıksal olarak sağlamdır, sadece kulağa mantıklı gelmekle kalmaz.

- Claude Opus 4.6: Uyarlanabilir düşünme kullanır; model, manuel mod değiştirme gerektirmeden, görev karmaşıklığına bağlı olarak ne zaman ve ne kadar düşüneceğine dinamik olarak karar verir. METR, %50 başarı eşiğinde görev tamamlama ufkunu yaklaşık 14,5 saat olarak ölçmüştür (%95 güven aralığı: 6-98 saat), bu da Şubat 2026 itibarıyla kaydedilen en yüksek nokta tahminidir. METR, bu performans seviyesinde kıyaslamanın neredeyse doygunluğa yaklaştığını, yani rakamın modelin gerçek tavanını muhtemelen olduğundan düşük gösterdiğini belirtmektedir. Akıl yürütme sırasında araç kullanımını destekler ve paralel görev yürütme için ajan ekiplerini koordine eder. 11 12

- Claude Sonnet 4.6: Uyarlanabilir düşünmeyi daha düşük bir fiyat noktasına getiriyor (milyon token başına 3$/15$). Kodlama ve bilgisayar kullanımı kıyaslamalarında Opus seviyesinde performansa yaklaşıyor (SWE-bench Verified'da %79,6'ya karşı %80,8; OSWorld-Verified'da %72,5'e karşı %72,7), bu da genişletilmiş akıl yürütmeyi kurumsal dağıtımlar için ölçeklenebilir hale getiriyor. ARC-AGI-2 gibi yeni akıl yürütme görevlerinde daha büyük bir fark kalıyor. 13

7- Alana Özgü İnce Ayarlı Modeller

Genel amaçlı eğitim yerine, belirli sektörlere yönelik özel verilerle eğitilmiş modeller.

Google, Microsoft ve Meta, genel amaçlı tekliflerine ek olarak kurumsal kullanım durumlarını hedefleyen, sırasıyla Gemini 3.1 Pro, Microsoft 365 Copilot (GPT-5.2) ve Llama 4 Scout/Maverick adlı, alana özgü ve ince ayarlı önemli tescilli modeller piyasaya sürdüler.

Bu özel LLM'ler, alana özgü ön eğitim, model hizalaması ve denetimli ince ayar yöntemlerini kullanarak daha az yanılgıya ve daha yüksek doğruluğa yol açabilir.

Kodlama, finans, sağlık ve hukuk gibi belirli alanlarda uzmanlaşmış LLM programlarına göz atın:

Kodlama: GitHub Copilot : Kod depoları üzerinde ince ayar yapılmıştır. Temmuz 2025 itibarıyla 20 milyon geliştirici GitHub Copilot kullanıyor; bu, yıllık %400'lük bir artış anlamına geliyor ve Fortune 100 şirketlerinin %90'ı bunu kullanıyor. Kodu otomatik olarak tamamlar, fonksiyonlar oluşturur ve hata düzeltmeleri önerir. 14

Finans: BloombergGPT : Bloomberg'in 363 milyar tokenlik finansal belge veri kümesi üzerinde eğitilmiş 50 milyar parametreli LLM modeli, duygu analizi, adlandırılmış varlık tanıma ve soru cevaplama dahil olmak üzere finansal doğal dil işleme (NLP) kıyaslamalarında benzer büyüklükteki modellerden daha iyi performans gösteriyor. 15

Sağlık Hizmetleri: Google'nın Med-PaLM 2'si : Tıbbi veri kümeleri üzerinde ince ayar yapıldıktan sonra, ABD Tıp Lisanslama Sınavı (USMLE) tarzı sorularda %85'in üzerinde doğruluk oranına ulaştı; bu kıyaslamada uzman düzeyinde performansa ulaşan ilk LLM oldu. Şimdi Google Cloud'un sağlık hizmetleri temel modelleri ailesi olan MedLM'ye güç veriyor. 16

Hukuk: ChatLAW , özellikle Çin hukuk alanına ait veri kümeleri üzerinde eğitilmiş açık kaynaklı bir dil modelidir. 17

8- Etik Yapay Zeka ve Önyargı Azaltma

Şirketler, büyük dil modellerinin (LLM) geliştirilmesi ve kullanıma sunulmasında etik yapay zekaya ve önyargı azaltmaya giderek daha fazla odaklanıyor.

Gerçek hayattan örnekler:

- Anthropic ve OpenAI, 2025 yılının ortalarında, birbirlerinin kamuya açık modellerini dalkavukluk, ihbar eğilimleri ve öz koruma davranışları açısından test ederek karşılıklı bir uyum değerlendirmesi gerçekleştirdiler. Bu çalışma, simüle edilmiş kullanıcıların yanıltıcı inançlar sergilediği durumlarda bile, modellerin zararlı kararları onayladığı vakalar da dahil olmak üzere, test edilen tüm modellerde dalkavukluk tespit etti. Anthropic daha sonra, bu davranışı yeni modellerde kıyaslamak için özel olarak Bloom test çerçevesini geliştirdi. 18

- Google DeepMind : “Gelişmiş Yapay Zeka Asistanlarının Etiği”, değer uyumu, manipülasyon riskleri, antropomorfizm, gizlilik ve eşitlik gibi yapay zeka ajanlarının ortaya çıkardığı etik ve toplumsal sorulara ilk sistematik yaklaşımı sunuyor. Şirketin Sorumlu Yapay Zeka değerlendirmesi, 350'den fazla düşmanca kırmızı ekip tatbikatını içeriyordu ve özellikle zararlı manipülasyon için yeni bir Kritik Yetenek Seviyesi getirerek, bunu siber saldırılar ve KBRN tehditleriyle birlikte sınır düzeyinde bir risk olarak ele aldı. 19

- Anthropic : Kamu yararına çalışan bir şirket olarak faaliyet göstermekte ve Claude modellerini eğitmek için kullanılan şeffaf, denetlenebilir bir etik ilkeler kümesi olan Anayasal Yapay Zeka metodolojisini yayınlamıştır. 2024 yılında ilk yapay zeka refah araştırmacısını işe almış ve 2025 yılında yapay zeka sistemlerinin ahlaki açıdan dikkate alınmayı hak edip etmediğinin nasıl değerlendirileceğini inceleyen bir model refah araştırma programı başlatmıştır. 20

Büyük dil modellerinin (LLM'ler) sınırlamaları

1- Halüsinasyonlar

Modeller, kulağa mantıklı gelen ancak yanlış bilgiler üretir.

Şekil: Popüler LLM'ler için halüsinasyon kıyaslama ölçütü

Kaynak: Vectara Halüsinasyon Liderlik Tablosu 21

Vectara'nın özetleme kıyaslamasında en iyi performans gösterenler (2026):

- Gemini 2.5 Flash-Lite: Yeni ve daha zorlu veri setinde %3,3 halüsinasyon oranıyla en iyi performansı gösteren cihaz.

- Mistral Large, DeepSeek V3.2, IBM Granit-4: hemen arkasında

- Claude Sonnet 4.6: Genişletilmiş düşünme modu sayesinde halüsinasyonlarda azalma; oranlar kıyaslama türüne göre değişir

- GPT-5.2: Daha iyi belirsizlik işaretleme

- Gemini 3.1 Pro: Alıntı doğruluğu iyileştirildi; ancak yeni Vectara veri kümesinde %13,6 oranında mantık yürütme modelleri, olgusal tutarlılık için kapsamdan ödün veriyor.

Not: Daha zorlu Vectara veri setinde, çoğu düşünme/akıl yürütme modeli (GPT-5, Claude Sonnet 4.5, Grok-4) %10'un üzerinde halüsinasyon oranları göstermektedir. Gemini Flash varyantları gibi daha hafif ve hızlı modeller, bu özel kıyaslamada şu anda öncü modellerden daha iyi performans göstermektedir.

Tüm modeller yanıltıcı olabilir. Sıklığı 2021'deki yaklaşık %21'den en iyi performans gösterenler için %5'in altına önemli ölçüde azalmıştır, ancak tamamen ortadan kalkmamıştır. Kritik uygulamalar hala insan doğrulaması gerektirmektedir.

2- Önyargı

Modeller, eğitim verilerinden gelen sosyal önyargıları özümser ve güçlendirir.

Şekil: Modellere ve boyuta göre genel sapma puanları

Kaynak: Arxiv 22

Gözlemlenen önyargı türleri:

- Meslek önerilerinde cinsiyet önyargısı

- Özgeçmiş tarama simülasyonlarında ırksal önyargı

- Sağlık hizmeti önerilerinde yaşa dayalı önyargı

- Eğitim içeriğinde sosyoekonomik önyargı

3- Toksisite

Güvenlik önlemlerine rağmen, modeller zararlı, rahatsız edici veya zehirli içerik üretebilir.

Şekil: LLM'lerin toksisite haritası

Kaynak: UCLA, UC Berkeley Araştırmacıları 23

*GPT-4-turbo-2024-04-09*, Llama-3-70b* ve Gemini-1.5-pro* moderatör olarak kullanıldığından, sonuçlar bu 3 modelde yanlı olabilir .

Sıkı güvenlik önlemleri toksisiteyi azaltır ancak yanlış pozitifleri (zararsız istekleri reddetmeyi) artırır. Gevşek önlemler ise toksisitenin geçmesine izin verir.

4- Bağlam Penceresi Sınırlamaları

Her modelin, işleyebileceği belirteç sayısını sınırlayan bir bellek kapasitesi vardır.

2026 bağlam pencereleri:

- Llama 4 Scout (Meta): Şubat 2026 itibarıyla 10 milyon token (~7,5 milyon kelime) ile en büyük üretim doğrulamalı bağlam penceresi. 24

- Gemini 3.1 Pro: 1.048.576 belirteç (~780.000 kelime) doğal olarak çok modlu 25

- Claude Sonnet 4.6: 1 milyon belirteç beta (~750.000 kelime); standart sınır 200.000 26

- GPT-5.2: 400.000 belirteç (~300.000 kelime) 27

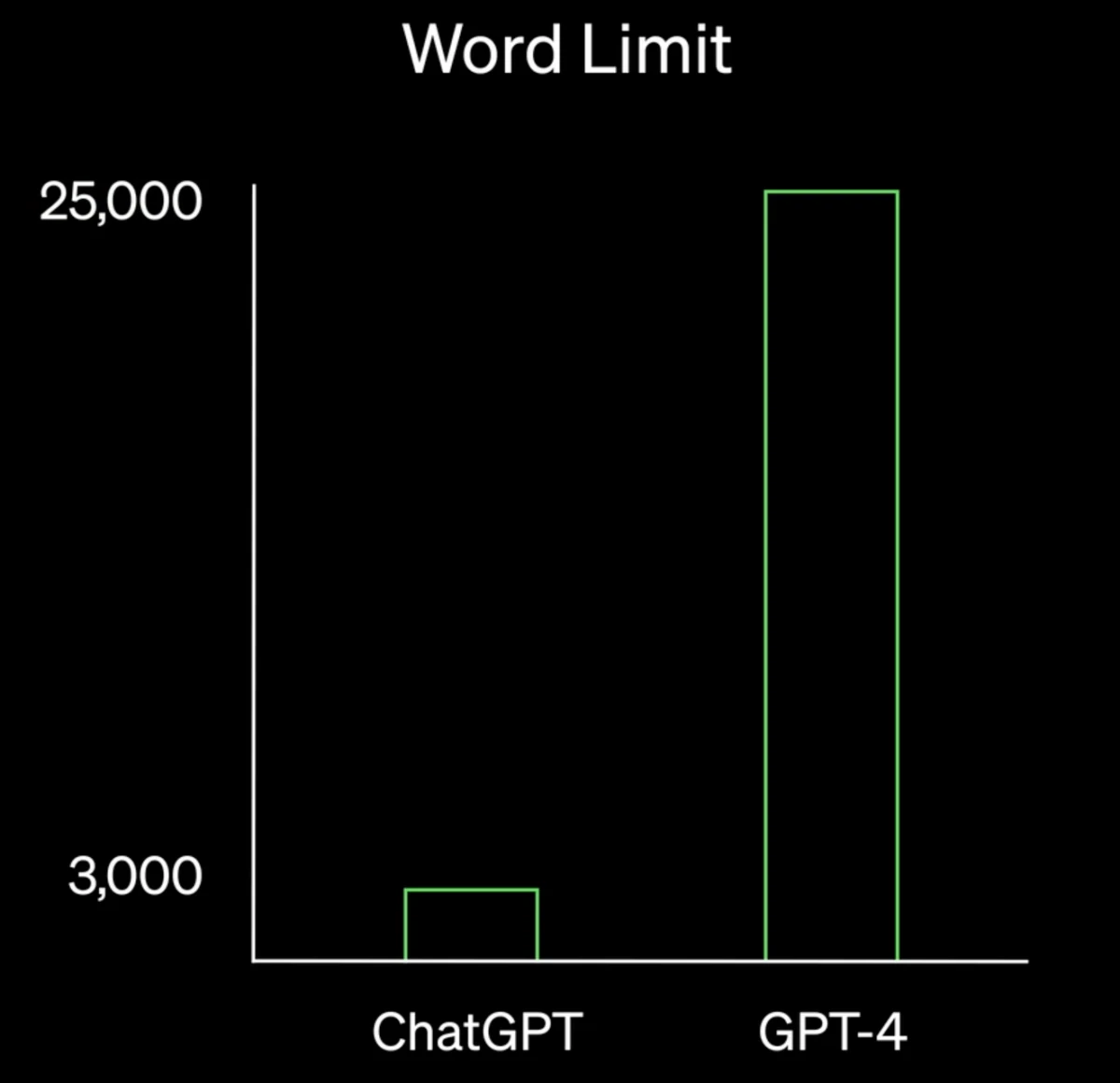

Şekil: ChatGPT ve GPT-4 arasındaki kelime sınırı karşılaştırması

Kaynak: OpenAI

5- Statik Bilgi Sınırı

Modeller, belirli bir son kullanma tarihine sahip önceden eğitilmiş bilgilere dayanır. Harici kaynaklara bağlı olmadıkları sürece eğitim sonrasındaki bilgilere erişimleri yoktur.

Sorunlar:

- Güncel olaylar hakkında güncelliğini yitirmiş bilgiler.

- Son gelişmelerle başa çıkamama

- Dinamik alanlarda (teknoloji, finans, tıp) daha az öneme sahip.

Çözüm: Web arama entegrasyonu. ChatGPT, Claude ve Perplexity hepsi gerçek zamanlı arama sunuyor. Ancak arama, yanılsamaları ortadan kaldırmaz; modeller bazen arama sonuçlarını yanlış yorumlar.

Başlıca Hukuk Yüksek Lisansı (LLM) Platformları

GPT-5.2

Akıllı model yönlendirme: Basit sorgular → hızlı yanıtlar, karmaşık sorgular → derinlemesine analiz

Çok modlu: Metin ve görselleri işleyin. Ekran görüntülerinden kod oluşturun, belgeleri analiz edin, erişilebilirlik için alternatif metin oluşturun.

GPT-4 numaralı modele göre yapılan iyileştirmeler:

- Halüsinasyon oranında azalma

- Daha iyi belirsizlik işaretlemesi

- Doktora düzeyinde akıl yürütme derinliği

Kimler kullanıyor: Geliştiriciler, işletmeler, içerik oluşturucular. Öğrenme tabanlı öğrenme platformları arasında en geniş kullanıcı tabanına sahip.

Sınırlamalar: Hala halüsinasyonlara neden oluyor. Büyük ölçekte pahalı. Bilgi kesintisi, web araması etkinleştirilmedikçe gerçek zamanlı bilgi alınamayacağı anlamına geliyor.

Claude 4 Sonnet/Opus

Hibrit akıl yürütme: Hızlı varsayılan mod, karmaşık problemler için genişletilmiş düşünme modu. Gerektiğinde saatlerce "düşünebilir".

Bellek uygulaması: Yalnızca açık etkinleştirme. Boş bir sayfayla başlar, araç çağrıları (conversation_search, recent_chats) aracılığıyla çağrıldığında belleği etkinleştirir. Kullanıcılar belleğin ne zaman etkinleştiğini tam olarak görür.

Proje bazlı ayrım: Her projenin ayrı bir bellek alanı vardır. Girişim yol haritası, müşteri çalışmalarından ayrı tutulur.

Genişletilmiş düşünme modu: Akıl yürütme sırasında araç kullanımı. Bağlam farkındalığı, konuşmalar boyunca kendi belirteç bütçesini takip eder.

Kimler kullanıyor: Şeffaflığı tercih eden geliştiriciler, bellek/bağlam üzerinde kontrol gerektiren işletmeler ve birden fazla projeyi yöneten ekipler.

Sınırlamalar: Genişletilmiş düşünme modu daha yavaş ve daha maliyetli. 1M bağlam beta sürümü yalnızca 4. seviye ve üzeri kullanıcılar için kullanılabilir.

Gemini 2.5 Pro

Çok modlu işleme: Metin, ses, görüntü ve video işleme yeteneği. Görsel ve işitsel bağlam da dahil olmak üzere tüm konuşmaları analiz edebilir.

Kod yürütme: Kod üretimi ve yürütülmesi yoluyla dinamik problem çözme.

Gemini 3.0'ın 2026'nın ilk çeyreğinde çıkması bekleniyor: Gerçek zamanlı 60 fps video işleme, milyonlarca belirteç içeren bağlam pencereleri, 3B nesne anlama, varsayılan olarak yerleşik mantık yürütme (manuel geçişe gerek yok).

Kimler kullanıyor: Google Bulut müşterileri, çok modlu uygulamalar geliştiren yazılımcılar ve karmaşık belge analizi ihtiyaçları olan işletmeler.

Sınırlamalar: Çok uzun bağlamlarda yanıt gecikmesi artar. Hesaplama açısından yoğundur. OpenAI'ya göre daha az gelişmiş bir API ekosistemine sahiptir.

Lama 4 İzci

Dağıtım: Tek bir NVIDIA H100 GPU, 10 milyon token bağlamını işler. Erken birleştirme yaklaşımıyla yerel çok modluluk.

Kimler kullanıyor: Araştırmacılar, açık kaynak modelleri isteyen kuruluşlar, cihaz üzerinde dağıtım ihtiyacı duyan geliştiriciler, tedarikçi bağımlılığından kaçınmak isteyen şirketler.

Sınırlamalar: Performans, barındırma yapılandırmasına bağlı olarak değişir. Optimum performans için önemli altyapı yatırımı gerektirir. Ticari modellere kıyasla daha az kullanıma hazır ve gelişmiş özelliklere sahiptir.

ÇİÇEK AÇMAK

Daha yeni açık modeller (Llama 4, Mistral, DeepSeek) tarafından büyük ölçüde geçersiz kılınmıştır. Araştırma ve eğitim amaçlı olarak Hugging Face'te hala mevcuttur.

Halen kullananlar: Çok dilli modelleri inceleyen araştırmacılar, eğitim kurumları ve kaynakları kısıtlı dil topluluklarındaki geliştiriciler.

Sınırlama: Eğitim verileri 2022 yılına ait. Bilgilerde herhangi bir güncelleme yok. Daha yeni açık kaynaklı modeller çoğu kıyaslamada bundan daha iyi performans gösteriyor.

Mevcut büyük dil modellerinin karşılaştırmalı analizi için, büyük dil modelleri örnekleri makalemize göz atabilirsiniz.

SSS'ler

Büyük dil modeli, çok miktarda veriyi analiz ederek insan benzeri metinler üretmek ve anlamak üzere tasarlanmış bir yapay zeka modelidir.

Bu temel modeller, derin öğrenme tekniklerine dayanmaktadır ve tipik olarak çok katmanlı ve çok sayıda parametreye sahip sinir ağlarını içerir; bu da eğitildikleri verilerdeki karmaşık kalıpları yakalamalarına olanak tanır.

Yorum yapan ilk kişi olun

E-posta adresiniz yayınlanmayacak. Tüm alanlar gereklidir.