LLM tabanlı uygulamalar giderek daha yetenekli ve karmaşık hale geliyor, bu da davranışlarını yorumlamayı zorlaştırıyor.

Her model çıktısı, doğrudan incelenemeyen istemlerden, araç etkileşimlerinden, veri alma adımlarından ve olasılıksal akıl yürütmeden kaynaklanır. LLM gözlemlenebilirliği, modellerin gerçek dünya koşullarında nasıl çalıştığına dair sürekli görünürlük sağlayarak bu zorluğun üstesinden gelir. Kuruluşların kaliteyi izlemesini, hataları tespit etmesini, çok adımlı iş akışlarında sorun gidermesini ve performansı ve maliyetleri yönetmesini sağlar.

Alet | En İyisi İçin |

|---|---|

Sık sık deneyler yürütmek ve güçlü sürümleme ve kontrol panelleriyle komutları/modelleri karşılaştırmak. | |

Langfuse | Ayrıntılı izleme ve özelleştirilebilir değerlendirmeler sunan, açık kaynaklı ve kendi sunucunuzda barındırabileceğiniz gözlemlenebilirlik çözümü. |

Helikon | LLM API çağrılarının temel izlenmesi, maliyet takibi ve önbelleğe alınması için kod gerektirmeyen kurulum. |

Langsmith | Özellikle LangChain ile, ayrıntılı izleme görünürlüğüne sahip çok adımlı zincirler veya ajanlar oluşturma. |

Beyin takımı | Otomatik değerlendirme, uyarılar ve üretim kalitesi izleme. |

Ağırlıklar ve Eğimler (W&B Dokuma)

W&B Weave, Weights & Biases'in dil modeli uygulamalarını izlemek, değerlendirmek ve optimize etmek için kullandığı LLM gözlemlenebilirlik platformudur. Weave, @weave.op dekoratörünü kullanarak her LLM çağrısını otomatik olarak izler ve manuel kurulum gerektirmeden girdileri, çıktıları, maliyetleri, gecikmeyi ve değerlendirme metriklerini yakalar.

Platform, token kullanımını izler ve maliyetleri otomatik olarak hesaplar, yavaş sorguları yakalamak için yanıt sürelerini izler ve tahminleri beklenen sonuçlarla karşılaştırarak doğruluğu ölçer. Hangi modelin veya istemin daha iyi performans gösterdiğini görmek için farklı deneyler yan yana karşılaştırılabilir. Hata izleme, hangi tahminlerin başarısız olduğunu ve nedenini gösterirken, otomatik sürümleme, tekrarlanabilirlik için her yapılandırma değişikliğini korur. Bu, farklı yaklaşımları test etmeyi, en iyi sonucu veren yöntemi belirlemeyi ve modeller hata yaptığında sorunları gidermeyi kolaylaştırır.

Puan Özeti Gösterge Paneli

Şekil 1: Model performans ölçütleri panosunu gösteren grafikler; doğruluk, maliyet ve gecikme eğilimlerinin zaman içindeki değişimini göstermektedir.

Performans ölçütleri tüm değerlendirme çalışmalarında gösterilir. Toplam maliyet, belirteç kullanımı ve yanıt süreleri, zaman içindeki değişimleri gösteren grafiklerle birlikte görüntülenir. Doğruluk ve hata oranları gibi özel ölçütler ayrı panellerde görünür. Trend çizgileri, performansın ne zaman kötüleştiğini veya maliyetlerin beklenmedik şekilde arttığını belirlemeye yardımcı olur ve yeni testler tamamlandıkça gösterge paneli otomatik olarak güncellenir.

İzler Görünümü

Şekil 2: Model sürümlerini ve bunların amaç sınıflandırma sonuçlarını gösteren değerlendirme izleme tablosu.

Her test çalıştırması tüm ayrıntılarıyla kaydedilir. Her izleme kaydı, hangi modelin kullanıldığını, hangi komutun gönderildiğini ve tüm ayarları gösterir. Başarı veya başarısızlık göstergeleri, testlerin doğru şekilde tamamlanıp tamamlanmadığını belirtir. Komut sütunu, doğrulama için modele gönderilen metni görüntüler. Bu kayıt, farklı sürümleri yan yana karşılaştırmaya, çalıştırmalar arasında nelerin değiştiğini görmeye ve kaydedilen yapılandırmayı kullanarak herhangi bir testi tekrarlamaya olanak tanır.

Model Karşılaştırma Sıralaması

Şekil 3: Niyet sınıflandırıcı model sürümlerinin doğruluk ve gecikme metrikleri açısından karşılaştırıldığı liderlik tablosunu gösteren görsel.

Farklı modeller ve ayarlar aynı test verileri üzerinde karşılaştırılabilir. Sütunlar doğruluk, doğru tahminler, puanlar ve yanıt sürelerini gösterir. Renk kodlaması, daha iyi performans gösterenleri yeşil renkle vurgular. Bu karşılaştırma, daha yüksek doğruluk karşılığında daha yavaş hız veya biraz daha düşük doğrulukla daha hızlı yanıtlar gibi ödünleşmeleri ortaya çıkararak, üretim ihtiyaçları için hangi yapılandırmanın en iyi sonucu verdiğini seçmenize yardımcı olur.

Model Sürümleme

Şekil 4: Model ayarlarını ve sürüm ayrıntılarını gösteren niyet sınıflandırıcı yapılandırma paneli.

Her yapılandırma değişikliği otomatik olarak yeni bir sürüm oluşturarak eksiksiz bir geçmiş kaydı tutar. Sürüm ayrıntıları, değişikliklerin ne zaman yapıldığını, kimin yaptığını ve kullanılan depolama alanını gösterir. Değerler sekmesi, model adı, parametreler ve fonksiyon sürümleri de dahil olmak üzere tam ayarları görüntüler. Bu sürümleme, herhangi bir testin aynı ayarlarla tekrarlanabilmesini sağlar, performansın zaman içinde nasıl değiştiğini izlemeye olanak tanır ve gerekirse eski sürümlere geri dönmeyi mümkün kılar.

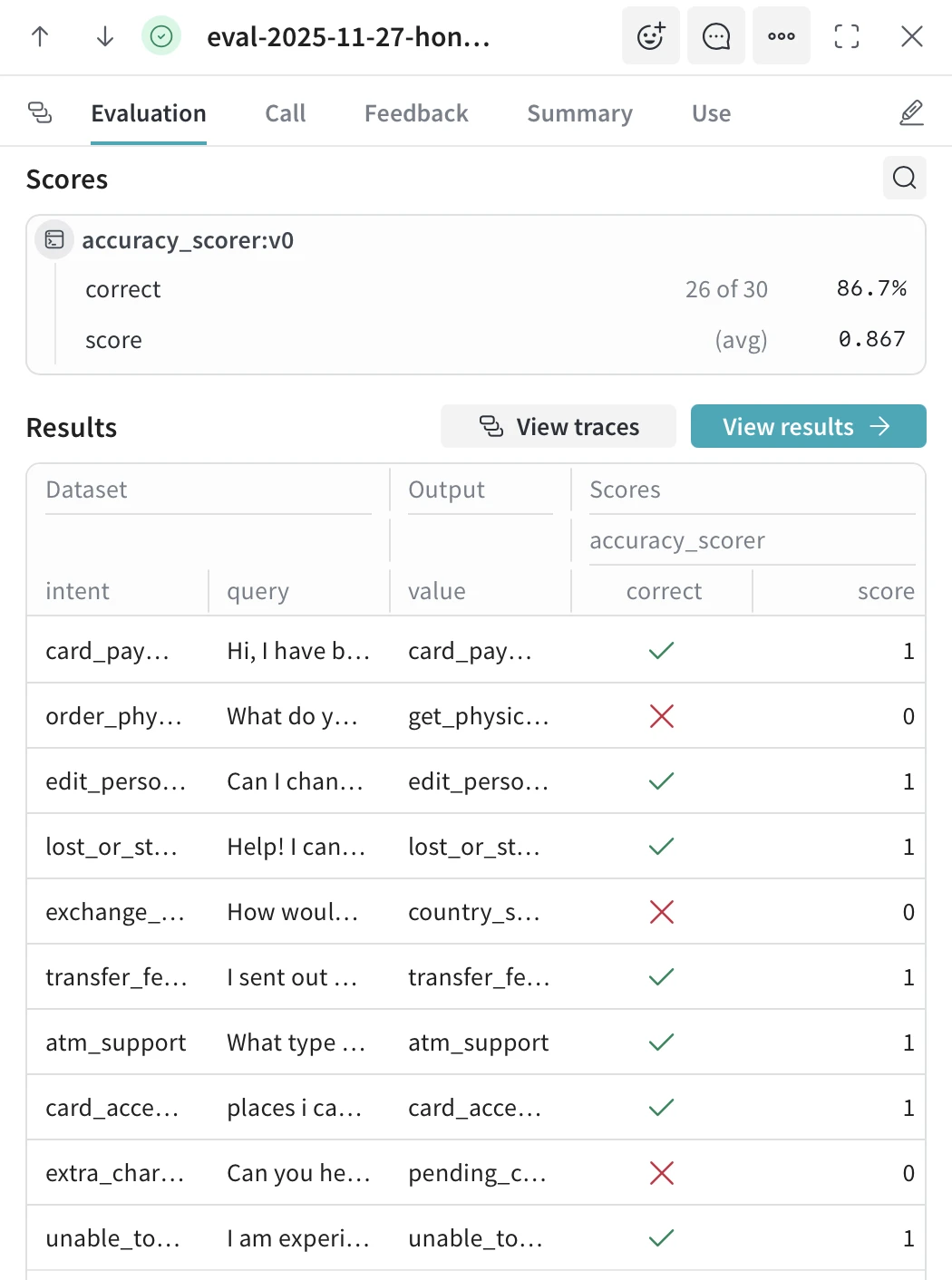

Ayrıntılı Değerlendirme Sonuçları

Şekil 5: Tahmin edilen niyetleri ve doğruluk puanlarını gösteren bireysel test durumlarının değerlendirme sonuçları.

Her örnek için ayrı ayrı test sonuçları gösterilir. Puanlar bölümü, toplam doğru tahminleri, doğruluk yüzdesini ve özel puanları özetler.

Sonuçlar tablosu, her sorguyu beklenen cevabı ve modelin tahminiyle birlikte, doğru cevaplar için onay işaretleri ve yanlış cevaplar için çarpı işaretleri kullanarak gösterir. Başarısız tahminleri tespit etmek kolaydır ve genellikle benzer kategoriler arasında karışıklık gibi kalıplar gösterir.

Herhangi bir satıra tıklamak, istemi, yanıtı, belirteç sayımlarını ve zamanlamayı içeren tam izleme kaydını açar; bu da hataları ayıklamayı ve istemleri veya model seçimini iyileştirmeyi kolaylaştırır.

Langsmith

LangSmith, LangChain'in LLM uygulamalarını izleme, hata ayıklama ve değerlendirme için kullandığı gözlemlenebilirlik platformudur. Her LLM çağrısını otomatik olarak izler, komut istemlerini ve çıktıları yakalar, maliyetleri ve gecikmeyi takip eder ve veri kümesi tabanlı testler yoluyla sistematik değerlendirme sağlar. LangSmith, LangChain ile yerel olarak entegre olur ancak SDK'sı aracılığıyla herhangi bir LLM uygulamasını destekler.

Örnek Başına Değerlendirme Sonuçları

Şekil 6: Tahminler ve performans ölçütleri üzerinden bireysel test senaryosu değerlendirmesini gösteren görüntü.

Tahmin sonuçları, beklenen çıktılarla birlikte görüntülenerek modelin nerede hata yaptığını belirlemenizi sağlar. Beklenen ve gerçek tahminlerin karşılaştırılması, anlamsal olarak benzer kategoriler arasındaki karışıklığı ortaya çıkarır. Sorgu başına gecikme ve belirteç sayıları, hangi girdi türlerinin işlenmesinin daha maliyetli olduğunu göstererek yavaş veya maliyetli sorguların optimize edilmesini sağlar.

İz Hacmi ve Sağlık İzleme

Şekil 7: Proje izleme grafikleri, zaman içindeki başarı ve hata oranlarını görselleştirerek göstermektedir.

Uygulama sağlığı, zaman içindeki izleme hacmi eğilimleri ve başarı/hata oranları aracılığıyla gösterilir. LLM çağrılarını, maliyet eğilimlerini, araç çağrılarını veya geri bildirim puanlarını analiz etmek için farklı görünümler mevcuttur. Hata artışları veya maliyet artışları gibi sorunlar görünür hale gelir ve araştırılması gereken problemleri gösterir.

Model ve Konfigürasyon Karşılaştırması

Şekil 8: Birden fazla test çalışması boyunca performans ölçümlerini gösteren deney karşılaştırma görünümü.

Farklı modeller aynı test veri kümesi üzerinde yan yana karşılaştırılabilir. Doğruluk, gecikme (P50/P99) ve belirteç verimliliği arasındaki denge görsel olarak gösterilir. Doğruluğu en üst düzeye çıkarmak veya maliyeti ve yanıt süresini en aza indirmek gibi gereksinimleri en iyi karşılayan yapılandırmayı belirlemek, bu karşılaştırmalar sayesinde kolaydır.

Langfuse

Langfuse, dil modeli uygulamalarını izlemek, hata ayıklamak ve değerlendirmek için tasarlanmış açık kaynaklı bir LLM gözlemlenebilirlik platformudur. Hem kendi sunucunuzda barındırabileceğiniz hem de bulut çözümleri olarak sunulan Langfuse, komut istemlerini, çıktıları, maliyetleri ve gecikmeyi otomatik olarak yakalayarak kapsamlı izleme olanağı sağlar.

Platform, esnek SDK'sı aracılığıyla herhangi bir LLM çerçevesini destekler ve otomatik kalite değerlendirmesi için LLM'yi hakem olarak kullanma da dahil olmak üzere yerleşik değerlendirme yetenekleri sunar. Langfuse, çalıştırmalar boyunca komut istemi sürümlerini takip ederek farklı formülasyonlar arasındaki performans metriklerinin karşılaştırılmasını sağlar.

Beğenme/beğenmeme derecelendirmeleri aracılığıyla kullanıcı geri bildirimlerinin toplanması, yüksek ve düşük kaliteli çıktıların belirlenmesine yardımcı olurken, özel puanlama uygulamaya özgü ölçütlerin izlenmesine olanak tanır. Otomatik değerlendirmeler, yapılandırılabilir örnekleme hızlarında binlerce izi işleyebilir ve her çıktının manuel olarak incelenmesine gerek kalmadan büyük ölçekte sürekli kalite izleme olanağı sağlar.

Ayrıntılı İzleme Görünümü

Şekil 10: Performans ve maliyet verileriyle birlikte API çağrı detaylarını gösteren izleme kayıtları.

Bireysel izleme kayıtları, her bir LLM çağrısı için eksiksiz yürütme ayrıntılarını gösterir. İzleme görünümü, kesin gecikme ölçümlerini, belirteç tüketimini (istem ve tamamlama belirteçleri ayrı ayrı) ve istek başına hesaplanan maliyetleri gösterir.

Model yapılandırması, sıcaklık, max_token sayısı ve diğer parametreler dahil olmak üzere korunur. Önizleme bölümü, modele gönderilen tam komutu ve eksiksiz yanıtı göstererek, modelin tam olarak ne aldığını ve ne ürettiğini anlamanıza olanak tanır.

Bu ayrıntılı görünürlük, hataya neden olan kesin giriş-çıkış çiftini inceleyerek belirli arızaların giderilmesini sağlar.

İzler Genel Bakış Tablosu

Şekil 11: İstek ayrıntılarını ve model yanıtını gösteren bireysel izleme incelemesi.

Tüm izleme verileri, çıktıları, gözlem seviyelerini, gecikmeyi, belirteç kullanımını ve toplam maliyetleri gösteren filtrelenebilir bir tabloda toplanır. Her satır, izleme hiyerarşisini veya önemini gösteren renk kodlu gözlem seviyeleriyle tek bir LLM çağrısını temsil eder. Belirteç sayıları, toplamlarla birlikte hem istem hem de tamamlama belirteçlerini gösterirken, maliyet hesaplamaları kullanılan modele göre otomatik olarak hesaplanır.

Sütun seçici, görüntülenen ölçümlerin özelleştirilmesine olanak tanır ve filtreler, ortam, zaman aralığı veya diğer kriterlere göre izlemeleri daraltmayı sağlar. Bu tablo görünümü, sürekli olarak yavaş sorgular veya beklenmedik şekilde pahalı istekler gibi kalıpları belirlemeyi kolaylaştırır.

Beyin takımı

Braintrust, değerlendirme ve üretim izlemeyi birleştiren bir LLM gözlemlenebilirlik platformudur. Platform, modelleri veri kümelerine karşı test etmeyi, farklı komutları veya yapılandırmaları karşılaştırmayı ve otomatik puanlama yoluyla kalite metriklerini izlemeyi sağlar. Yerleşik ve özel değerlendirme fonksiyonları, doğruluk, alaka düzeyi veya alana özgü kriterleri ölçer ve sonuçlar, sürümler arasındaki performans farklılıklarını gösteren karşılaştırma tablolarında görüntülenir.

Üretim izleme için Braintrust, uygulamalar üzerinden trafik akarken gecikme, maliyet ve özel kalite puanları dahil olmak üzere gerçek zamanlı ölçümleri takip eder. Kalite eşikleri aşıldığında veya güvenlik önlemleri ihlal edildiğinde uyarılar tetiklenir. Platformun günlük depolama sistemi olan Brainstore, yapay zeka etkileşimleri için optimize edilmiş arama ile uygulama günlüklerini büyük ölçekte işler. Kontrol paneli, hem değerlendirme hem de üretim istekleri için maliyet takibi, belirteç kullanımı ve yanıt meta verilerini yakalayarak deneyler ve üretim çalışmaları genelinde toplanmış ölçümleri görüntüler.

Helikon

Helicone, API isteklerini proxy sunucusu üzerinden yönlendirerek LLM uygulamalarını izleyen, proxy tabanlı bir gözlem platformudur. Entegrasyon, SDK kurulumu veya kod değişiklikleri gerektirmeden yalnızca temel URL'nin değiştirilmesini gerektirir. Platform, uygulama davranışını izlemek için istekleri, yanıtları, maliyetleri ve token kullanımını otomatik olarak yakalar.

Kontrol paneli, tüm API çağrıları genelinde toplam istek hacimlerini, toplam maliyetleri ve token tüketimini gösterir. İstek günlükleri, eksiksiz giriş istemlerini ve model çıktılarını göstererek belirli tahminlerin veya hataların incelenmesini sağlar. Maliyet takibi, pahalı işlemleri belirlemek için harcamaları model türüne, kullanıcıya veya özel etiketlere göre ayırır. Dahili önbellekleme, yinelenen istekleri algılar ve önbelleğe alınmış yanıtlar sunarak hem API maliyetlerini hem de yanıt sürelerini azaltır. Oran sınırlama, beklenmedik harcama artışlarını önlemek için kullanıcı veya uç nokta başına kullanım sınırları belirler.

Platform, bireysel API çağrılarını izlemeye odaklanmaktadır; her istek, ilgili çağrıları gruplandırma veya dizileri görselleştirme için yerleşik destek olmaksızın ayrı bir günlük girişi olarak görünür. Bu durum, Helicone'u bağımsız LLM çağrıları (örneğin, tek turlu sohbet botları), toplu içerik oluşturma veya sınıflandırma görevleri gibi uygulamalar için pratik hale getirirken, ardışık çağrılar arasındaki ilişkileri anlamanın önemli olduğu çok adımlı iş akışlarını izlemek için daha az uygun hale getirmektedir.

LLM gözlemlenebilirliği nedir?

Büyük dil modellerinin (LLM) gözlemlenebilirliği, gerçek dünya kullanımında nasıl davrandıklarını anlamak için bu modellerden sürekli veri toplama ve yorumlama uygulamasıdır. Farklı komutlara, araçlara ve harici API çağrılarına LLM'lerin nasıl yanıt verdiğini gösteren ölçümler, izler ve kayıtlar toplamaya odaklanır.

Dil modelleri olasılıksal akıl yürütme yoluyla çalıştığı için, iç süreçleri doğrudan incelenemez. Bu durum, dil modeli izlemesini, dil modeli çıktılarının, dil modeli girdilerinin ve ajan tabanlı iş akışlarında ortaya çıkan ara adımların incelenmesine bağlı kılar. Bu izleri inceleyerek, dil modeli geliştiricileri sistem performansı, model davranışı ve uygulama performansını ve çıktı kalitesini etkileyen kullanım kalıpları hakkında bilgi edinirler.

LLM'nin gözlemlenebilirliği çeşitli nedenlerden dolayı hayati önem taşımaktadır:

- Kalite güvencesi: Büyük dil modelleri, belirsiz komutlar, değişken veriler veya beklenmedik kullanıcı davranışı gibi çok çeşitli nedenlerle yanlış veya düşük kaliteli çıktılar üretebilir. Komutları ve yanıtları zaman içinde izlemek, doğruluk, tutarlılık, alaka düzeyi ve gerçeklik gibi değerlendirme ölçütlerini takip etmeye yardımcı olur. Bu, ekiplerin LLM çıktılarının yanıt kalitesinde düşüşe geçtiğini veya modelin yanılsamalar üretmeye başladığını tespit etmelerini sağlar. LLM kullanımı kurumsal iş akışlarında yaygınlaştıkça, tutarlı doğruluğu sağlamak ortak bir zorluk haline gelir.

- Sorun Giderme: LLM uygulamalarında sorunlar ortaya çıktığında, temel nedenler birçok alandan kaynaklanabilir. Örnekler arasında kötü ayarlanmış istemler, hatalı ince ayarlar , başarısız harici API çağrıları veya çok adımlı ajan iş akışlarındaki mantık hataları yer alır. Geliştiriciler, ara adımları gösteren LLM izlerini toplayarak, temel neden analizini verimli bir şekilde gerçekleştirebilir ve davranışın saptığı tam aşamayı belirleyebilirler. Bu, insan müdahalesine olan ihtiyacı azaltır ve hata izleme süresini kısaltır.

- Optimizasyon: Sistem performansını, kaynak kullanımını ve belirteç kullanımını izlemek, kuruluşların darboğazları belirlemesine ve LLM performansını iyileştirmesine yardımcı olur. Ekipler, LLM'lerin farklı yük seviyelerinde nasıl davrandığını anlamak için gecikmeyi, verimliliği, bellek kullanımını ve hata oranlarını ölçebilir. Ayrıca, maliyetleri kontrol etmek ve performans ile maliyet verimliliğini artırmak için kullanım modellerini incelemek amacıyla belirteçleri de izleyebilirler. Bu temel metriklerin sürekli izlenmesi, özellikle performans darboğazlarının genellikle verimsiz araç çağrılarından veya akıl yürütme sırasında gereksiz gidiş-dönüşlerden kaynaklandığı, veri alma ile desteklenen üretim ve ajan iş akışlarında son derece değerlidir.

Temel ölçüm kategorileri

LLM gözlemlenebilirlik araçları, genellikle ilgili ölçütleri hem yazılım geliştirme ekiplerini hem de operasyonel ekipleri destekleyecek şekilde üç kategoriye ayırır.

Sistem performans ölçütleri

- Gecikme süresi: Bir uyarıyı alma ve yanıt verme arasındaki süreyi ölçer.

- İşlem hacmi: Modelin belirli bir süre içinde kaç isteği işleyebileceğini gösterir.

- Hata oranları: Sistemin ne sıklıkla geçersiz veya başarısız yanıtlar döndürdüğünü gösterir.

Kaynak kullanım ölçütleri

- CPU ve GPU tüketimi: Sistemin donanımı ne kadar verimli kullandığını anlamaya yardımcı olur.

- Bellek kullanımı: Ölçeklendirme kararlarını ve kapasite planlamasını etkiler.

- Token kullanımı: Maliyet verimliliğini etkiler ve ekiplerin yoğun LLM kullanımı sırasında maliyetleri kontrol etmelerine yardımcı olur.

- Veri aktarım hızı ve gecikme süresi arasındaki denge: Sistemin hız ve işlem hacmini nasıl dengelediğini gösterin.

Model davranış ölçütleri

- Doğruluk, gerçeklik ve yanıt kalitesi: Düşük kaliteli çıktıları belirlemek için.

- Kullanıcı etkileşimi ve kullanıcı geri bildirimi: Modelin kullanıcı ihtiyaçlarını ne kadar iyi karşıladığına dair bilgiler sağlar.

- Sadakat ve kaynakla bütünlük ölçütleri: Modelin kaynak materyale ne kadar yakın kaldığını yansıtır.

Manuel ve otonom gözlemlenebilirlik

Manuel gözleme dayanmak çeşitli zorluklar ortaya çıkarır. Büyük dil modelleri yüksek miktarda veri üretir ve çok adımlı mantık zincirleri çok sayıda kayıt ve izleme verisi oluşturur. Gerçek zamanlı izleme ihtiyacı operasyonel karmaşıklığı artırır ve deneyimli ekipler bile önemli sinyalleri kaçırmadan her LLM çağrısını incelemekte zorlanırlar. Manuel iş akışları ayrıca kullanıcı davranışındaki sürekli değişikliklere ve komut istemi varyasyonlarına ayak uydurmayı da zorlaştırır.

Otonom gözlemlenebilirlik sistemleri, LLM aktivitesini sürekli olarak analiz eden yazılım ajanları kullanarak bu zorlukların üstesinden gelir. Bu ajanlar, sürekli insan müdahalesi olmadan anormallikleri tespit eder, sorunları teşhis eder ve temel neden analizini gerçekleştirir. Otomatik değerlendirmeler ayrıca, ani enjeksiyon gibi riskli davranışların belirlenmesine de yardımcı olur.

Bu tür bir sistem, sürekli izlemeyi destekler ve tüm model genelinde değerlendirme ölçütlerinin tutarlı bir şekilde takip edilmesini sağlar. Sonuç olarak, kuruluşlar daha hızlı sorun giderme, gelişmiş uygulama performansı ve operasyonel riskler üzerinde daha iyi kontrol gibi avantajlardan yararlanır.

LLM gözlemlenebilirlik araçlarının özellikleri

Kalite ve güvenlik değerlendirmeleri

- Modelin güvenilir verilerden sapma gösterdiği durumları belirlemek için halüsinasyon tespiti.

- Güvenlik endişelerini gidermek için hızlı enjeksiyon ve jailbreak tespiti.

- Uyumluluğu ve risk azaltmayı destekleyen toksisite puanlaması ve güvenlik değerlendirmeleri.

- Zaman içindeki sapmaları belirlemek için benzer LLM çıktılarını gruplandıran kümeleme.

Deneysel özellikler

- Hızlı yönetim ve yapılandırma değişiklikleri için A/B testi.

- Birden fazla LLM modeli veyaparametresi arasında hızlı karşılaştırma.

- Dağıtım öncesinde doğruluk, token tüketimi ve gecikme süresinin değerlendirilmesi.

- Üretim ortamına benzer veriler kullanarak model değişikliklerini gerçek dünya senaryolarına karşı test etme.

Altyapı ile ilişki

- LLM izleme verilerini arka uç uygulama performans izleme verilerine bağlama.

- Yanıt süresini ve yanıt kalitesini gerçek kullanıcı oturumlarıyla ilişkilendirme.

- Sistem performansının LLM performansı ve uygulama istikrarını nasıl etkilediğini belirlemek.

LLMOps ve yönetişim

- Tehlikeli mesajları filtreleyen ve zararlı yanıtları engelleyen güvenlik önlemleri.

- Kişisel verilerin ifşa edilmesini, halüsinasyonları ve güvenlik ihlallerini izlemek için kullanılan kontrol panelleri.

- Güvenlik olaylarının takibi, raporlanması ve analizine destek sağlayan araçlar.

Ajan tabanlı iş akışları için gözlemlenebilirlik

LLM'ler çok adımlı ajan iş akışlarını destekledikçe, gözlemlenebilirlik gereksinimleri tek istek-yanıt çiftlerinin ötesine genişler. Ajan tabanlı uygulamalar, özel izleme yaklaşımları gerektiren ek karmaşıklık katmanları getirir.

Ajanlar için temel gözlemlenebilirlik boyutları:

- Planlama ve akıl yürütme izleri: Ajanın görevleri nasıl parçalara ayırdığı, eylemleri nasıl seçtiği ve ara sonuçlara dayanarak yaklaşımını nasıl iyileştirdiği konusunda görünürlük.

- Araç çağrısı izleme: Gecikme darboğazlarını veya hataları belirlemek için harici API çağrılarını, veritabanı sorgularını ve fonksiyon yürütmelerini izleme.

- Görev aktarımı izleme: Çoklu ajan sistemlerinde, görevlerin ajanlar arasında nasıl aktarıldığını ve bağlamın doğru şekilde korunup korunmadığını izleme.

- Durum evrimi: Bir oturum içindeki birden fazla turda hafıza ve bağlamın nasıl değiştiğini anlamak.

Bu boyutlar birlikte, ajan tabanlı izlemenin temelini oluşturur. Langsmith, Langfuse, AgentOps ve Weights & Biases gibi LLM gözlemlenebilirlik araçları, tam yürütme grafiklerini gösteren ajana özgü izleme görünümleri sağlar.

SSS'ler

İyi bir gözlemlenebilirlik çözümü, LLM çağrılarının tüm yaşam döngüsü boyunca kapsamlı gözlemlenebilirlik sağlar. Bu, bir modelin bir isteği nasıl aldığını, araçları nasıl seçtiğini, bir veri kaynağından verileri nasıl aldığını ve nihai bir yanıt nasıl oluşturduğunu içerir. Gözlemlenebilirlik önemlidir çünkü LLM uygulamaları karmaşıklık açısından sürekli artmakta ve çok adımlı akıl yürütmeye dayanan LLM destekli uygulamaların sayısı hızla artmaktadır. Sonuç olarak, kuruluşların tüm LLM uygulamalarında tutarlı performans sağlamak için gerçek zamanlı izleme ve otomatik değerlendirme sağlayan gözlemlenebilirlik araçlarına ihtiyacı vardır.

Modern LLM gözlemlenebilirlik araçları, LLM destekli uygulamalar içindeki her eylemin ayrıntılı bir genel görünümünü sağlamayı amaçlamaktadır. Bu, her LLM çağrısını, her araç etkileşimini ve ajansal akıl yürütme zincirinde görünen her ara adımı izlemeyi içerir. İstemden nihai cevaba kadar tüm iş akışını gözlemleme yeteneği, ekiplerin beklenmedik davranışları tespit etmesine ve LLM modellerinin nasıl karar verdiğini anlamasına yardımcı olur.

Maliyet ve token analitiği de vazgeçilmez hale geldi. Token kullanımının gerçek zamanlı takibi, kuruluşların maliyet verimliliğini korumasına ve beklenmedik harcama artışlarından kaçınmasına yardımcı olur. Ekipler, farklı bileşenlerin maliyete nasıl katkıda bulunduğunu anlamak için token kullanımını sağlayıcıya, modele, özelliğe veya uygulama yoluna göre ayırabilir. Bazı gözlemlenebilirlik araçları, kullanıcıların birden fazla LLM sağlayıcısını yan yana karşılaştırmasına olanak tanıyarak, açık kaynaklı LLM'ler ve tescilli seçenekler arasında istekleri yönlendirirken performans ve maliyet verimliliği kararlarında yardımcı olur.

Ekosistem genelinde, gözlemlenebilirlik araçları, LLM uygulamalarını büyük ölçekte çalıştırmak için LLM gözlemlenebilirliğini sürekli olarak bir gereklilik olarak ele almaktadır. Ajan iş akışlarına dayanan ekiplerin, modelin çok adımlı akıl yürütme sürecinde nasıl ilerlediğini ve her kararın model performansını nasıl etkilediğini görmeleri gerekir. Gözlemlenebilirlik, tutarlı yüksek kaliteli yanıtlar sağlamaya, hataları erken tespit etmeye ve kullanıcı güvenini korumaya yardımcı olur.

Bir diğer tema ise operasyonel maliyetleri yönetme ihtiyacıdır. Jeton kullanımını, bellek kullanımını ve kaynak kullanım metriklerini izlemek, kuruluşların performansı ve maliyet verimliliğini korurken harcamaları kontrol etmelerine yardımcı olur. Gözlemlenebilirlik ayrıca kullanıcı memnuniyetini ve uygulama performansını etkileyen performans darboğazlarını da ortaya çıkarır.

Son olarak, LLM gözlemlenebilirliği önemlidir çünkü kuruluşlar kritik işlevler için giderek daha fazla LLM modellerine güvenmektedir. Bu sistemler genişledikçe, izleme araçlarının çerçeveden bağımsız olması, açık kaynak platformlarla entegre olabilmesi ve birden fazla hizmet genelinde içgörüler sağlayabilmesi gerekir. Bu, güvenli dağıtımı destekler, güvenlik endişelerini azaltır ve ekiplerin modelin çıktılarını daha geniş bir operasyonel bağlamda anlamalarına yardımcı olur.

Yorum yapan ilk kişi olun

E-posta adresiniz yayınlanmayacak. Tüm alanlar gereklidir.