Da diese synthetischen Bilder immer realistischer und zugänglicher werden, ist die Fähigkeit, sie zu erkennen, zu einem entscheidenden Anliegen geworden, um die Ethik der generativen KI aufrechtzuerhalten, Fehlinformationen zu bekämpfen und die Authentizität von Bildern zu gewährleisten.

Wir haben die sieben besten KI-Bilderkennungssysteme in fünf Dimensionen verglichen und festgestellt, dass die meisten nicht besser abschneiden als ein Münzwurf. Erhalten Sie Einblicke in ihre Genauigkeit, Grenzen und Eignung für reale Anwendungen:

Benchmark-Ergebnisse für KI-Bilddetektoren

Mehr dazu: Methodik für den Bilddetektor-Benchmark

Detaillierte Bewertung von KI-Bilddetektoren

SightEngine

SightEngine bietet Bildmoderationswerkzeuge über APIs, die automatisch verschiedene Arten von Inhalten in über 110 Kategorien erkennen.

Über ein Web-Dashboard können Benutzer benutzerdefinierte Moderationsregeln erstellen und Arbeitsabläufe einrichten, die festlegen, wann Bilder akzeptiert oder abgelehnt werden sollen.

Das System umfasst eine Duplikaterkennung, die auch bei veränderten Bildern funktioniert, eine KI-generierte Bildidentifizierung für Inhalte, die mit Tools wie MidJourney und DALL-E erzeugt wurden, sowie Bildbearbeitungsfunktionen, mit denen Gesichter, personenbezogene Daten und andere festgelegte Inhalte unkenntlich gemacht oder ausgeblendet werden können.

Die Plattform ermöglicht Regeländerungen ohne Codeänderungen und ist für die Verarbeitung von Bildern in unterschiedlichen Größenordnungen ausgelegt.

Abbildung 1: SightEngine hat dieses Bild korrekt als KI-generiert identifiziert und weitere Informationen über die möglichen Diffusionstypen sowie darüber, ob es durch generative KI oder Gesichtsmanipulation erzeugt wurde, bereitgestellt.

WasitAI

WasitAI bietet Werkzeuge zur Analyse von Unstimmigkeiten auf Pixelebene und statistischen Mustern. Es ist für Anwendungsfälle konzipiert, in denen die Authentizität von Bildern von entscheidender Bedeutung ist, beispielsweise in juristischen, journalistischen oder akademischen Kontexten.

Die Ergebnisse von WasitAI werden auf einer farbcodierten Skala von Rot (wahrscheinlich KI-generiert) bis Grün (wahrscheinlich von Menschenhand erstellt) angezeigt. Befindet sich der Zeiger im grünen Bereich, deutet dies auf eine hohe Wahrscheinlichkeit für die Echtheit des Bildes hin.

Abbildung 2: Die Abbildung zeigt, dass das hochgeladene Foto keine KI-generierten Elemente enthält, was darauf hindeutet, dass es sich wahrscheinlich um ein echtes Foto handelt.

Hive-Moderation

Hive bietet eine Plattform zur Inhaltsmoderation mit Produkten für die Bereiche visuelle, textuelle und Audio-Moderation, CSAM-Erkennung und Dashboard-Management-Tools.

Ihre API zur Erkennung von KI-generierten und Deepfake-Inhalten analysiert Bilder, Videos, Texte und Audiodateien, um deren Authentizität zu bestimmen. Sie liefert Konfidenzwerte und identifiziert Inhalte, die von spezifischen Modellen wie DALL-E, Midjourney, Stable Diffusion, Sora und anderen generiert wurden. Das System gibt detaillierte Klassifizierungsergebnisse für jeden potenziellen KI-Generator zurück, unterstützt verschiedene Dateiformate und lässt sich über REST-APIs mit JSON-Antworten integrieren.

Sie unterhalten eine Partnerschaft mit dem US-Verteidigungsministerium und bieten eine Chrome-Erweiterung zur Echtzeit-Erkennung von KI-generierten Inhalten beim Surfen im Internet an.

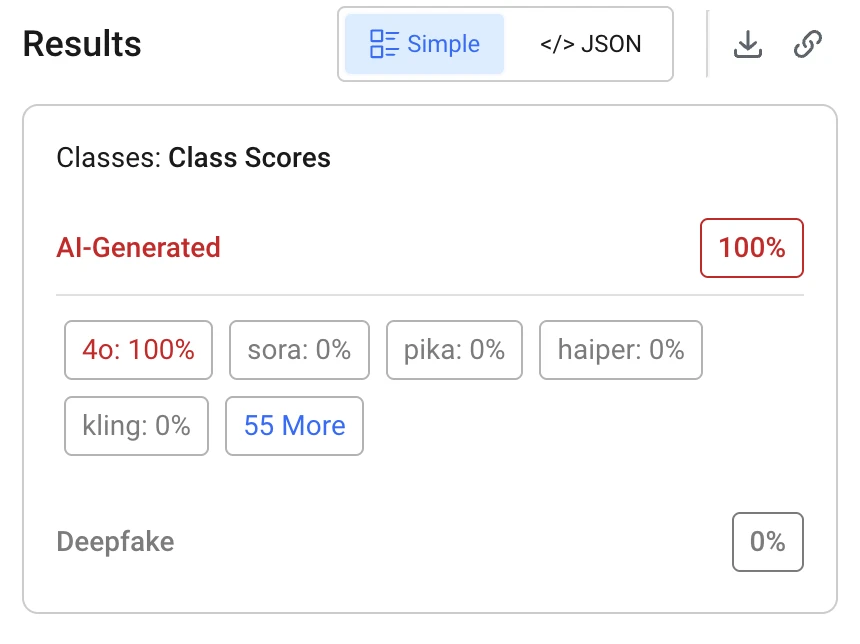

Abbildung 3: Hive Moderation gibt die Ergebnisse der KI-Bilderkennung entweder als vereinfachte Berichte oder als detaillierte JSON-Antworten aus.

Brandwell

Brandwell konzentriert sich auf die Erkennung des Missbrauchs von Markenelementen in KI-generierten Bildern, wie beispielsweise gefälschte Logos oder unautorisierte Adaptionen der Markenidentität. Es umfasst auch die KI-generierte Texterkennung, die dabei hilft, synthetische Inhalte in visueller und schriftlicher Form zu identifizieren.

Unauffindbare KI

Undetectable AI bietet eine Reihe KI-gestützter Tools zur Erstellung, Bearbeitung und Optimierung von Inhalten. Zu den Kernfunktionen der Plattform gehören ein KI-Detektor, der von Tools wie ChatGPT und Gemini generierte Inhalte erkennt, sowie ein KI-Humanizer, der KI-generierte Texte so umwandelt, dass sie natürlicher wirken.

Nutzer haben Zugriff auf Paraphrasierungswerkzeuge, SEO-optimierte Artikelautoren und einen Schreibstil-Replikator, der bestimmte Tonlagen imitiert.

Die Plattform bietet außerdem Lernressourcen über einen KI-Chatbot und einen Frage-Löser sowie Tools zur Karriereentwicklung, darunter automatisierte Bewerbungen und Lebenslaufgeneratoren. Zu den Geschäftslösungen gehören auch White-Label-Optionen und automatisierte Texteingabedienste, die menschliche Schreibmuster simulieren.

- Während unserer Tests identifizierte Undetectable AI die meisten der KI-generierten Bilder und demonstrierte damit durchschnittliche Erkennungsfähigkeiten.

- Das Tool erklärt jedoch nicht, wie es zu diesem Ergebnis gelangt ist, und liefert keine Details zu den visuellen Artefakten, Mustern oder technischen Indikatoren, die in seiner Analyse verwendet wurden.

- Diese mangelnde Transparenz kann das Verständnis des Erkennungsprozesses durch die Nutzer einschränken und den pädagogischen Wert des Tools mindern. Obwohl die Kernfunktion der Erkennung gut funktioniert, führt das Fehlen erklärender Elemente zu einer Gesamtbewertung von 65/100.

Abbildung 4: Die nicht erkennbare KI erkannte das KI-generierte Bild korrekt, erklärte jedoch ihre Schlussfolgerung nicht und erhielt aufgrund mangelnder Transparenz eine Bewertung von 65/100.

Decopy AI

Decopy AI wurde entwickelt, um KI-generierte Kopien bestehender urheberrechtlich geschützter Bilder zu identifizieren. Es beinhaltet eine umgekehrte Bildersuche, um die Ursprünge von Bildern zu ermitteln und mögliche Vervielfältigung oder Missbrauch aufzudecken.

Abbildung 5: Decopy AI hat das Bild korrekt als KI-generiert identifiziert und ihm eine hohe KI-Wahrscheinlichkeit von fast 99 % zugewiesen.

Abbildung 6: Decopy AI hat dieses KI-generierte Bild eines Cheeseburgers mit einer KI-Wahrscheinlichkeit von nur 1,40 % fälschlicherweise als echt eingestuft. Trotz des hyperrealistischen Stils des Bildes handelt es sich um ein falsch negatives Ergebnis: Synthetische Inhalte wurden nicht erkannt.

Illumination

Illuminarty erkennt KI-generierte Bildmanipulationen und Deepfakes und legt dabei besonderen Wert auf das Aufspüren subtiler Veränderungen in visuellen Medien. Es unterstützt außerdem KI-Texterkennung und bietet eine Browsererweiterung zur Echtzeit-Inhaltsanalyse beim Surfen im Web.

Abbildung 7: Ein KI-generiertes Bild einer älteren Frau, das fälschlicherweise als wahrscheinlich echt eingestuft wurde (KI-Wahrscheinlichkeitswert: nur 10,8 %). Es veranschaulicht ein falsch negatives Ergebnis, bei dem das System die synthetische Natur des Bildes nicht erkannte.

Benchmark-Methodik für KI-Bilddetektoren

- Wählen Sie 5 Bilder von Shutterstock mit diesen Stichwörtern aus: Porträt einer lächelnden älteren Frau, Golden Retriever in einem Park, futuristische Stadtkulisse bei Nacht, Nahaufnahme eines Cheeseburgers auf einem Holztisch und Astronaut reitet auf einem Pferd auf dem Mars.

- Erstelle 5 Bilder mit ChatGPT-Bildgenerierung und den oben genannten Schlüsselwörtern.

- Überprüfen Sie mithilfe der Tools sowohl Shutterstock- als auch KI-generierte Bilder.

Bewertungskriterien für KI-Bilddetektoren

Wir haben KI-Bilddetektoren anhand der folgenden Kriterien bewertet:

1. Benutzerfreundlichkeit (2 Punkte)

- Wie intuitiv ist die Benutzeroberfläche?

- Können auch Laien Bilder problemlos hochladen und analysieren?

- Sind die Anweisungen und das Feedback verständlich?

2. Erkennungsgenauigkeit (Praktischer Test) (10 Punkte)

- Wie oft erkennt es korrekt:

- Sind reale Bilder real?

- Sind KI-generierte Bilder gefälscht?

3. Funktionsumfang (4 Punkte)

- Stapel-Upload (mehrere Bilder gleichzeitig)?

- Unterstützte Dateiformate (JPG, PNG, WebP usw.)?

- Wird eine Konfidenzbewertung oder eine Erklärung angegeben?

- Kann es verdeutlichen, warum es etwas für KI-generiert hält?

4. Geschwindigkeit (2 Punkte)

- Wie schnell ist das Ergebnis nach dem Hochladen verfügbar?

- Gibt es Verzögerungen bei mehreren Bildern?

5. Verständlichkeit der Ergebnisse (2 Punkte)

- Sind die Ergebnisse klar und verständlich? Z. B. „KI-generiert (85 % Konfidenz)“ vs. vage Aussagen.

- Gibt es visuelle Hilfsmittel (Heatmaps, Beschriftungen)?

Anregungen und warum wir sie auswählen

„Porträt einer lächelnden älteren Frau“

Zum Testen von Gesichtszügen, Hautstruktur und altersbedingten Details. Nützlich, um zu überprüfen, wie Detektoren fotorealistische Darstellungen im Vergleich zum Uncanny Valley beim Menschen verarbeiten.

„Golden Retriever im Park“

Eine gängige Hunderasse ermöglicht die Überprüfung der Fellstruktur, der Hintergrundmischung und der anatomischen Korrektheit.

„Futuristische Stadtkulisse bei Nacht“

Nichtlebende, komplexe Strukturen und Lichteffekte können ein guter Test für architektonische Kohärenz und Lichtrealismus sein.

„Nahaufnahme eines Cheeseburgers auf einem Holztisch“

Gängige Lebensmittelbilder können nützlich sein, um den Realismus von Texturen (geschmolzener Käse, Grillstreifen usw.) und die Tiefenschärfe zu testen.

„Astronaut reitet auf einem Pferd auf dem Mars“

Eine surreale, fantasievolle Vorgabe eignet sich gut, um zu testen, wie Detektoren mit Fantasie- oder absurden, aber visuell realistischen Kompositionen umgehen.

Grenzen von KI-Bilddetektoren

Unsere Evaluierung von vier KI-Bilderkennungstools hat mehrere wesentliche Einschränkungen aufgezeigt, die Zweifel an ihrer Effektivität aufkommen lassen. Insbesondere neigten alle getesteten Tools dazu, KI-generierte Bilder fälschlicherweise als echt einzustufen , was besonders problematisch ist, wenneine präzise Erkennung unerlässlich ist. Zwar schnitten sie bei der Erkennung realer Bilder etwas besser ab, ihre allgemeine Zuverlässigkeit bleibt jedoch ungewiss.

Ein weiteres wiederkehrendes Problem ist die mangelnde Transparenz bei den Konfidenzwerten. Obwohl einige Tools ihre Zuverlässigkeit bei der Klassifizierung angeben, gibt keines Einblick in die Gründe für ihre Entscheidungen. Diese Intransparenz erschwert die Interpretation der Ergebnisse und untergräbt das Vertrauen der Nutzer.

Unsere Ergebnisse basieren zwar auf einer begrenzten Stichprobe, lassen aber darauf schließen, dass die derzeitigen Instrumente möglicherweise noch nicht zuverlässig oder ausgereift genug sind, um in Anwendungen eingesetzt zu werden, die hohe Genauigkeit, Nachvollziehbarkeit und Interpretierbarkeit erfordern.

Hier sind einige der möglichen Ursachen für diese Probleme:

Ausweichmanöver durch hochentwickelte KI-Generatoren

Moderne KI-Bildgeneratoren werden ständig verbessert. Mit der Weiterentwicklung dieser KI-Plattformen können sie immer schwieriger zu erkennende Bilder erzeugen.

Techniken wie Bildnachbearbeitung, Größenänderung, Formatkonvertierung (z. B. Konvertierung in .png oder Komprimierung) oder das Hinzufügen von Rauschen können dazu beitragen, dass KI-generierte Inhalte der Erkennung entgehen.

Das Wettrennen zwischen Detektoren und Generatoren

Zwischen KI-Detektoren und KI-Generatoren herrscht ein ständiges Katz-und-Maus-Spiel. Da die Bildgeneratoren immer ausgefeilter werden, müssen auch die KI-Bilderkennungsmodelle ständig aktualisiert werden.

Verzögerungen bei Aktualisierungen können die Fähigkeit, KI-generierte Bilder genau zu erkennen, beeinträchtigen, insbesondere wenn beliebte Bildgeneratoren neue Versionen veröffentlichen.

Der Konfidenzwert ist nicht immer aussagekräftig.

KI-Erkennungssysteme liefern üblicherweise einen Konfidenzwert, der angibt, wie wahrscheinlich es ist, dass ein Bild KI-generiert ist. Dieser Wert kann jedoch manchmal irreführend oder übertrieben vorsichtig sein.

Niedrige oder mittlere Punktzahlen könnten von den Nutzern als nicht eindeutig interpretiert werden, was es schwierig macht, ohne zusätzliche menschliche Gutachter oder Kontext fundierte Entscheidungen zu treffen.

Übermäßige Abhängigkeit von Modellen und Trainingsdaten

Die Leistungsfähigkeit des Detektormodells hängt maßgeblich von der Datenbank ab, mit der es trainiert wurde. Fehlt es den Trainingsdaten an Vielfalt oder enthalten sie keine Bilder von neueren KI-Generatoren, kann das Modell Bilder möglicherweise nicht präzise erkennen oder identifizieren.

Es besteht auch die Gefahr einer Verzerrung bei der Erkennung, da bestimmte Stile oder Inhaltstypen leichter erkannt werden können als andere. Die Einbindung von Menschen kann dazu beitragen, dieses Problem der übermäßigen Abhängigkeit zu verringern.

Falsch positive und falsch negative Ergebnisse

KI-Detektoren können:

- Echte Bilder werden fälschlicherweise als KI-generiert gekennzeichnet (falsche Positivwerte), was das Vertrauen in authentische Inhalte untergraben kann.

- Die KI erzeugte Bilder werden geschickt verändert (falsche Negative), wodurch gefälschte Fotobeweise oder Deepfake-Bilder unentdeckt bleiben können.

Bedenken hinsichtlich des Datenschutzes

Aufgrund von Datenschutzbedenken zögern manche Nutzer, Bilder auf Online-Erkennungsdienste hochzuladen. Das Speichern oder Analysieren von Bildern auf Servern Dritter kann riskant sein, wenn die Datenschutzrichtlinien unklar sind oder Nutzerdaten wiederverwendet werden.

Mangelnde Erklärbarkeit

Die meisten Detektoren geben keinen Aufschluss darüber, warum ein Bild markiert wurde. Ohne nachvollziehbare Begründung oder visuelle Hinweise müssen Nutzer dem Ergebnis der Erkennung vertrauen, ohne die Bildanalyse vollständig zu verstehen. Erfahren Sie mehr über erklärbare KI .

Bilderkennung: Warum ist sie wichtig?

Die KI-Bilderkennung ist in der heutigen digitalen Landschaft von entscheidender Bedeutung, da KI-generierte Inhalte immer häufiger vorkommen und immer schwieriger von realen Medien zu unterscheiden sind.

Durch den zunehmenden Einsatz von großen Bildverarbeitungsmodellen und KI-Bildgeneratoren können Benutzer auf einfache Weise hyperrealistische Bilder erstellen, die die Grenze zwischen authentischen Bildern und synthetischen Medien verwischen.

Ein KI-Bilddetektor hilft dabei, KI-generierte Bilder mithilfe fortschrittlicher Bildanalysetechniken zu erkennen. Diese Detektoren analysieren Metadaten, Pixelmuster und andere digitale Signaturen, die häufig von KI-Generierungsmodellen hinterlassen werden.

Mithilfe von Bilderkennungssystemen können Einzelpersonen, Plattformen und Organisationen feststellen, ob ein Bild von einem Menschen oder einer KI-Plattform erstellt wurde. Dies schützt vor Plagiat, wahrt die Privatsphäre und verhindert die Verbreitung von Fehlinformationen. Weitere Informationen finden Sie unter KI-Ethik undverantwortungsvolle KI .

Seien Sie der Erste, der kommentiert

Ihre E-Mail-Adresse wird nicht veröffentlicht. Alle Felder sind erforderlich.