Angesichts der steigenden Kundenzahlen und der täglich wachsenden Menge an Nutzerdaten ist eine Datenexplosion keine Überraschung. Unternehmen nutzen Datenerfassung und -analyse, um Umsatz, Kundeneinblicke und Markenreputation zu verbessern. Obwohl Sprachdaten das direkteste Feedback von Kunden darstellen, wird deren Bedeutung oft unterschätzt.

Um besser zu verstehen, wie Kunden Produkte und Dienstleistungen bewerten, erfahren Sie, wie man die Stimmung in Audiodateien analysiert und welche sieben Methoden Unternehmen am besten anwenden können:

Was ist Audio-Sentimentanalyse?

Herkömmliche Methoden der Stimmungsanalyse stützen sich hauptsächlich auf schriftliche Texte wie Rezensionen, Feedback, Umfragen usw. Da die menschliche Sprache jedoch komplex ist, sind Nuancen wie Ironie, Sarkasmus oder Absichten im schriftlichen Inhalt nicht immer leicht zu erkennen.

Der akustische Klang in Audiodateien transportiert reichhaltigere Informationen und ermöglicht einen besseren Einblick in die Stimmungen. 1 Stimmungsinformationen können aus verschiedenen Stimmmerkmalen gewonnen werden, wie zum Beispiel 2

- Tonhöhe

- Lautstärke

- eine Stimme

- andere frequenzbezogene Messgrößen

Emotionen lassen sich also besser erkennen, wenn man sowohl den Tonfall als auch den Inhalt des geschriebenen Textes analysiert, als wenn man nur schriftliches Feedback berücksichtigt.

In den letzten Jahren haben Unternehmen begonnen, Methoden der Audio- Sentimentanalyse einzusetzen, um die Stimmungen ihrer Kunden besser zu verstehen und ihnen ein besseres Erlebnis zu bieten.

Um verfrühte Investitionen in die Audio-Sentimentanalyse zu vermeiden, haben wir diesen Artikel zusammengestellt, damit sich Anwender und Entwickler mit der Technologie, ihrer Funktionsweise und den Methoden zu ihrer Anwendung vertraut machen können.

Wie funktioniert die Stimmungsanalyse in Audioaufnahmen?

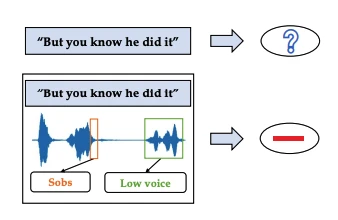

Abbildung 1. Vereinfachter Vergleich der Stimmungsanalyse von schriftlichen Inhalten und multimodaler (Text + Audio) Stimmungsanalyse

Quelle: CM-BERT: Cross-Modal BERT für Text-Audio-Sentimentanalyse. 3

Die Schritte der Audio-Sentimentanalyse sind:

1. Audioaufnahmen sammeln

Audioaufnahmen sammeln

Beginnen Sie mit dem Sammeln von Audiomaterial. Sie können Live-Aufnahmen, vorab aufgenommene Dateien oder Audio von Online-Plattformen verwenden.

Qualitätssicherung

Klare Audioqualität ist unerlässlich. Reduzieren Sie Hintergrundgeräusche und achten Sie auf einen deutlichen Klang. Verwenden Sie außerdem vielfältige Daten; unterschiedliche Stimmen, Tonlagen und Emotionen helfen Ihrem Modell, besser zu lernen.

Vorverarbeitung

Nach der Aufnahme wird das Audiomaterial bereinigt. Dazu gehören das Entfernen von Rauschen, das Anpassen der Lautstärke und das Herausschneiden von Stille. Diese Schritte bereiten das Audiomaterial für die nächsten Phasen vor.

2. Transkription in Text

Audio in Text umwandeln

Verwenden Sie Spracherkennungstools wie Whisper (OpenAI), um gesprochene Wörter in Text umzuwandeln. Dieser Schritt ist für die meisten textbasierten Stimmungsanalysemodelle notwendig. 4

Text bereinigen

Der transkribierte Text muss möglicherweise formatiert werden. Sie könnten überflüssige Satzzeichen entfernen, alle Wörter in Kleinbuchstaben umwandeln oder Sonderzeichen bereinigen.

3. Auswahl des Modells

Wählen Sie ein Modell, das gut mit Audio und Text funktioniert. Einige Modelle sind bereits auf emotionale oder gesprochene Sprache trainiert. Wählen Sie ein Modell mit hoher Genauigkeit und Flexibilität.

4. Interpretation und Nutzung der Ergebnisse

Die Ergebnisse verstehen

Nutzen Sie die Daten, um zu erfahren, wie die Menschen fühlen. Dies ist in Bereichen wie Kundenservice, Marketing und öffentlichem Feedback hilfreich.

Ergebnisse visualisieren

Stellen Sie die Stimmungsbewertungen in Diagrammen, Tabellen oder Dashboards dar. Dies hilft den Nutzern, die emotionale Grundstimmung des Audiomaterials schnell zu erfassen.

7 Methoden zur Durchführung der Audio-Sentimentanalyse

Es gibt drei Hauptmethoden zur Durchführung von Audio-Sentimentanalysen.

1. Automatische Spracherkennung (ASR)

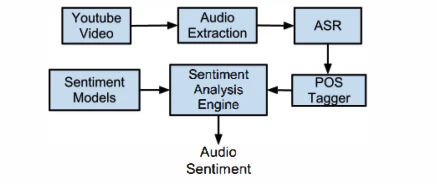

Abbildung 2. Ein Beispiel für die Funktionsweise von ASR

Quelle: Sentimentanalyse aus natürlichen Audiostreams 5

Verfahren : ASR transkribiert gesprochene Sätze mithilfe von Spracherkennung in Text. Der transkribierte Text wird anschließend mithilfe von Verfahren der natürlichen Sprachverarbeitung (NLP) auf Stimmungslage analysiert.

Beispiel : In Callcentern kann ASR Kundengespräche transkribieren, sodass Stimmungsanalysemodelle die Gesamtstimmung der Interaktion ermitteln können.

2- WaveNet (Rohaudio-Wellenformanalyse)

Verfahren : WaveNet analysiert direkt rohe Audiosignalformen, um mithilfe tiefer neuronaler Netze Audiomerkmale zu extrahieren. Diese Methode benötigt keine Audiotranskription und kann selbst feinste Details im Audiosignal erfassen. Es handelt sich um ein probabilistisches Verfahren, das mit multimodalen Datensätzen (Text + Audio) hervorragende Ergebnisse liefert.

Beispiel : WaveNet kann anhand des Tons und der Tonhöhe des Audiosignals verschiedene Emotionen erkennen und so den emotionalen Zustand des Sprechers gut wiedergeben.

3- Crossmodale bidirektionale Encoder-Repräsentationen von Transformatoren (CM-BERT)

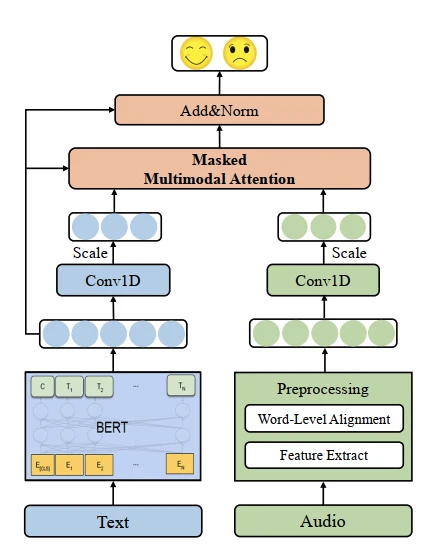

Abbildung 3. Die Architektur des CM-BERT-Netzwerks

Quelle: CM-BERT: Cross-Modal BERT für Text-Audio-Sentimentanalyse. 6

Verfahren : Der CM-BERT-Ansatz basiert auf der Interaktion zwischen Text und Audio und passt die Gewichtung von Wörtern dynamisch an, indem er die Informationen aus verschiedenen Modalitäten vergleicht. Er verwendet Modelle des maschinellen Lernens, um sowohl das Audiosignal als auch dessen Transkription zu analysieren und so die Stärken beider Modalitäten zu nutzen.

Beispiel : In einem Projekt zur Analyse von Audioaufnahmen aus Podcasts kann CM-BERT Einblicke in die in den gesprochenen Worten und den Audio-Features ausgedrückte Stimmung geben.

4- Mel-Frequenz-Cepstral-Koeffizienten (MFCCs)

Verfahren : MFCCs werden verwendet, um das Kurzzeit-Leistungsspektrum von Schall darzustellen. Sie werden aus Audioaufnahmen extrahiert und als Merkmale für Modelle zur Stimmungsanalyse verwendet.

Beispiel : Durch die Analyse von MFCCs können Modelle des maschinellen Lernens verschiedene emotionale Zustände in Audiodateien erkennen, wie zum Beispiel Freude, Traurigkeit oder Wut.

5. Analyse der prosodischen Merkmale

Vorgehensweise : Diese Methode analysiert prosodische Merkmale wie Intonation, Betonung und Rhythmus der Sprache. Diese Merkmale sind entscheidend für das Verständnis des emotionalen Tons in Audioaufnahmen.

Beispiel : Die Analyse prosodischer Merkmale kann in Interaktionen mit dem Kundenservice eingesetzt werden, um Stress oder Frustration in der Stimme eines Kunden zu erkennen und so die Benutzeroberfläche und die Reaktionsstrategien zu verbessern.

6. Tiefe neuronale Netze (DNNs)

Verfahren : DNNs können anhand großer Datensätze von Audioaufnahmen trainiert werden, um Muster zu erkennen und Stimmungen zu klassifizieren. Sie sind in der Lage, komplexe Repräsentationen von Audiodaten zu erlernen.

Beispiel : DNNs können in Sentimentanalyseprojekten eingesetzt werden, bei denen eine hohe Genauigkeit erforderlich ist, beispielsweise bei Audiobeiträgen in sozialen Medien, um die öffentliche Meinung zu erfassen.

7. Rekurrente neuronale Netze (RNNs) und Long Short-Term Memory (LSTM)-Netze

Abbildung 4. Rekurrente neuronale Netze mit zwei verborgenen Schichten

Quelle: Klassifizierung und Vorhersage von Wellenchaossystemen mit Methoden des maschinellen Lernens. 7

Vorgehensweise : RNNs und LSTMs sind für die Verarbeitung sequenzieller Daten konzipiert und eignen sich daher zur Analyse zeitlicher Abhängigkeiten in Audiosignalen. Sie können die Entwicklung von Emotionen im Zeitverlauf erfassen.

Beispiel : Bei der Analyse langer Audioaufnahmen wie Interviews oder Reden können RNNs und LSTMs die Stimmungsänderungen in der gesamten Audiodatei verfolgen.

Die 8 wichtigsten Anwendungsbereiche der Audio-Sentimentanalyse

Die Stimmungsanalyse von Audioaufnahmen findet in verschiedenen Bereichen breite Anwendung, verbessert Prozesse und liefert wertvolle Erkenntnisse branchenübergreifend.

1. Callcenter

In Callcentern wird die Audio-Sentimentanalyse eingesetzt, um Kundeninteraktionen auszuwerten. Durch die Analyse von Audioaufnahmen können Unternehmen die während der Anrufe geäußerte Stimmung – positiv, negativ oder neutral – ermitteln. Diese Informationen tragen zur Verbesserung des Kundenservice bei, indem sie:

- Problemerkennung: Durch das frühzeitige Erkennen negativer Stimmungen können Callcenter-Mitarbeiter die Anliegen der Kunden effektiver bearbeiten.

- Schulungszwecke: Das Verständnis der emotionalen Zustände von Kunden während Anrufen kann genutzt werden, um Agenten zu schulen und ihre Fähigkeit zu verbessern, mit verschiedenen Emotionen umzugehen.

- Qualitätssicherung: Die Ergebnisse der Stimmungsanalyse können genutzt werden, um die Servicequalität zu überwachen und aufrechtzuerhalten und so eine gleichbleibende Kundenzufriedenheit zu gewährleisten.

2. Emotionserkennung

Die Erkennung verschiedener Emotionen in Audioaufnahmen kann Benutzeroberflächen deutlich verbessern und empathischere KI-Systeme hervorbringen. Die Emotionserkennung mittels Audio-Sentimentanalyse umfasst Folgendes:

- Personalisierte Erlebnisse: Anpassung der Reaktionen an die erkannten Emotionen, um ein individuelleres und ansprechenderes Nutzererlebnis zu bieten.

- Anwendungen im Bereich der psychischen Gesundheit: Die Überwachung emotionaler Zustände kann bei Anwendungen im Bereich der psychischen Gesundheit hilfreich sein, indem Anzeichen von Stress, Angstzuständen oder Depressionen in Audioaufnahmen erkannt werden.

- Virtuelle Assistenten: Verbesserung der Interaktionen virtueller Assistenten durch Befähigung, angemessener auf den emotionalen Tonfall des Benutzers zu reagieren.

3. Marktforschung

In der Marktforschung kann die Audio-Sentimentanalyse von Audiodateien aus Fokusgruppen oder Kundenfeedback wertvolle Erkenntnisse liefern. Durch die Analyse der Stimmungen in gesprochenen Antworten können Unternehmen:

- Die Präferenzen der Verbraucher verstehen: Gewinnen Sie Einblicke in die Meinungen der Kunden zu Produkten oder Dienstleistungen und helfen Sie Unternehmen so, fundierte Entscheidungen zu treffen.

- Produktentwicklung: Sentimentdaten werden genutzt, um die Entwicklung und Verbesserung von Produkten auf Basis von Kundenfeedback zu steuern.

- Markenwahrnehmung: Überwachung und Analyse der öffentlichen Meinung zu einer Marke, um Unternehmen die Möglichkeit zu geben, ihre Strategien entsprechend anzupassen.

4. Überwachung sozialer Medien

Die Stimmungsanalyse von Audiodateien kann auch auf Audiodateien aus Podcasts oder Videoinhalte, die auf Social-Media-Plattformen geteilt werden, angewendet werden. Diese Anwendung hilft dabei:

- Analyse der öffentlichen Meinung: Analyse von Stimmungen in gesprochenen Inhalten, um die öffentliche Meinung zu verschiedenen Themen zu ermitteln.

- Content-Strategie: Beeinflussung von Content-Erstellungsstrategien durch das Verständnis der emotionalen Reaktionen des Publikums auf verschiedene Arten von Inhalten.

- Trendanalyse: Identifizierung neuer Trends und Stimmungen in Social-Media-Konversationen, damit Unternehmen bei ihren Marketingbemühungen immer einen Schritt voraus sind.

5. Gesundheitswesen

Im Gesundheitswesen kann die Audio-Sentimentanalyse auf die Interaktion zwischen Patient und Arzt, telemedizinische Beratungen und Patientenfeedback angewendet werden. Dies kann zu Folgendem führen:

- Verbesserte Patientenversorgung: Das Verständnis der Emotionen der Patienten kann Gesundheitsdienstleistern helfen, eine einfühlsamere und individuellere Betreuung anzubieten.

- Früherkennung von Erkrankungen: Das Erkennen von Veränderungen im emotionalen Zustand eines Patienten kann zur Früherkennung von psychischen Problemen oder anderen Erkrankungen beitragen.

- Patientenzufriedenheit: Analyse des Patientenfeedbacks zur Verbesserung der Qualität der Gesundheitsdienstleistungen und zur Sicherstellung der Patientenzufriedenheit.

6. Bildung

Im Bildungsbereich kann die Audio-Sentimentanalyse zur Analyse von Schülerinteraktionen, Lehrerfeedback und Klassendiskussionen eingesetzt werden. Dies kann Folgendes unterstützen:

- Schülerbeteiligung: Das Verständnis der emotionalen Reaktionen der Schüler kann Lehrenden helfen, ihre Lehrmethoden anzupassen, um die Schüler bei der Stange zu halten.

- Leistungsüberwachung: Die Überwachung der Stimmungslage im Feedback der Studierenden kann Aufschluss über die Effektivität von Bildungsprogrammen und Lehrstrategien geben.

- Emotionale Unterstützung: Identifizierung von Schülern, die möglicherweise zusätzliche emotionale Unterstützung benötigen, um ein rechtzeitiges Eingreifen zu ermöglichen.

7. Unterhaltungsindustrie

Die Unterhaltungsindustrie kann die Stimmungsanalyse von Audioinhalten nutzen, um die Reaktionen des Publikums auf Filme, Musik und andere Medieninhalte zu analysieren. Dies kann zu Folgendem führen:

- Inhaltsverbesserung: Nutzung der Ergebnisse der Stimmungsanalyse zur Verbesserung von Drehbüchern, Dialogen und des gesamten Inhalts auf Basis der Reaktionen des Publikums.

- Marketingstrategien: Marketingkampagnen so gestalten, dass sie die emotionalen Reaktionen des Publikums besser ansprechen.

- Publikumsbindung: Durch das Verstehen der Gefühle des Publikums ansprechendere und emotional berührendere Inhalte schaffen.

8. Personalwesen

Im Personalwesen kann die Audio-Sentimentanalyse für Mitarbeiterfeedback, Interviews und Leistungsbeurteilungen eingesetzt werden. Dies kann Folgendes verbessern:

- Mitarbeiterzufriedenheit: Analyse der Rückmeldungen der Mitarbeiter, um die Arbeitsbedingungen zu verbessern und auf Bedenken einzugehen.

- Rekrutierungsprozesse: Die emotionalen Reaktionen von Kandidaten während Vorstellungsgesprächen verstehen, um bessere Einstellungsentscheidungen zu treffen.

- Leistungsmanagement: Nutzung von Stimmungsdaten zur Unterstützung von Leistungsbeurteilungen und zur Bereitstellung von konstruktivem Feedback.

Wie erfolgreich sind Tools zur Audio-Sentimentanalyse?

In einem Benchmark-Experiment aus dem Jahr 2026 wurde untersucht, wie gut moderne Modelle Stimmungen direkt aus Sprachsignalen erkennen. 8 Die Ergebnisse zeigen, dass die audiobasierte Stimmungsanalyse emotionale Signale wie Tonfall, Tonhöhe und Sprechgeschwindigkeit erfassen kann. Diese Signale gehen häufig verloren, wenn Sprache in Text umgewandelt wird.

Die Studie testete mehrere bekannte Sprachmodelle, darunter HuBERT. 9 Wav2Vec, 10 und Whisper. 11 Bei der Analyse kurzer, mit unterschiedlichen emotionalen Tönen gesprochener Phrasen erzielten die Modelle relativ gute Ergebnisse. Die Genauigkeit lag zwischen 78 und 91 % , was darauf hindeutet, dass diese Modelle klare emotionale Signale in kontrollierter Sprache erkennen können.

Die Leistung der Modelle verschlechterte sich jedoch, als sie mit komplexeren und abwechslungsreicheren Sätzen getestet wurden. In diesen Fällen sank die Genauigkeit auf etwa 54–60 % . Die Modelle hatten Schwierigkeiten, da Satzbedeutung, Sprecherstil und Kontext stärker variierten.

Die Ergebnisse deuten insgesamt darauf hin, dass Tools zur Audio-Sentimentanalyse gut funktionieren, wenn emotionale Signale eindeutig sind. Ihre Leistungsfähigkeit nimmt jedoch in realistischen Gesprächen ab. Aus diesem Grund kombinieren viele Systeme Audiosignale mit Textanalyse, um die Zuverlässigkeit zu verbessern.

Seien Sie der Erste, der kommentiert

Ihre E-Mail-Adresse wird nicht veröffentlicht. Alle Felder sind erforderlich.