Unternehmen generieren große Mengen an Sprachdaten aus Anrufen, Besprechungen und Sprachschnittstellen, aber die manuelle Verarbeitung dieser Daten ist langsam und schwer skalierbar.

Die Spracherkennung (auch automatische Spracherkennung oder Sprach-zu-Text-Umwandlung genannt) wandelt gesprochene Sprache in Text um und ermöglicht es Systemen, sprachbasierte Arbeitsabläufe wie Anruftranskriptionen, Sprachassistenten und Besprechungszusammenfassungen zu analysieren und zu automatisieren.

Wir erforschen, wie Spracherkennung funktioniert, welche Algorithmen dabei zum Einsatz kommen, welche Anwendungsgebiete sie in verschiedenen Branchen hat und welche Beispiele aus dem realen Leben relevant sind.

12 Anwendungsfälle für Spracherkennung

Spracherkennung wird in vielen Branchen eingesetzt, um gesprochene Sprache in Text umzuwandeln und so die sprachbasierte Interaktion mit Systemen zu ermöglichen. Die folgenden Beispiele zeigen gängige Anwendungsfälle der Spracherkennung in Branchen wie Kundenservice, Vertrieb, Automobilindustrie, Gesundheitswesen und Technologie.

Kundenservice und Support

- Interaktive Sprachdialogsysteme (IVR): IVR-Systeme leiten Anrufer automatisch an die zuständige Abteilung weiter, indem sie gesprochene Anfragen erkennen. Sie reduzieren das Anrufaufkommen und die Wartezeiten, indem sie einfache Anfragen mithilfe vorab aufgezeichneter Antworten oder Text-to-Speech-Systemen bearbeiten. Die automatische Spracherkennung (ASR) ermöglicht es IVR-Systemen, Kundenanfragen in Echtzeit zu verstehen und zu beantworten.

- Automatisierung des Kundensupports und Chatbots: Spracherkennung ermöglicht es sprachbasierten Chatbots und virtuellen Assistenten, routinemäßige Kundendienstanfragen zu bearbeiten, wie z. B. die Beantwortung häufig gestellter Fragen, die Anleitung bei der Fehlerbehebung und die Unterstützung bei Kontoanfragen.

- Stimmungsanalyse und Anrufüberwachung: Die Stimmungsanalyse klassifiziert Gespräche als positiv, negativ oder neutral und hilft Unternehmen so, die Servicequalität zu überwachen und Kundenanliegen zu erkennen.

- Mehrsprachige Unterstützung: Spracherkennungsmodelle können so trainiert werden, dass sie mehrere Sprachen erkennen. Integriert in Chatbots oder IVR-Systeme, können sie die Sprache des Nutzers erkennen und zum passenden Modell wechseln, wodurch Unternehmen internationale Kunden besser bedienen können (siehe Abbildung 1).

- Kundenauthentifizierung mit Stimmbiometrie: Stimmbiometrie nutzt Spracherkennungstechnologien, um die Stimme eines Sprechers zu analysieren und Merkmale wie Akzent und Sprechgeschwindigkeit zu extrahieren, um seine Identität zu überprüfen.

Abbildung 1: Bild, das zeigt, wie ein mehrsprachiger Chatbot Wörter in einer anderen Sprache erkennt.

Vertrieb und Marketing

- Virtuelle Verkaufsassistenten: KI-gestützte Verkaufsassistenten interagieren per Sprache mit Kunden und unterstützen sie bei Kaufentscheidungen. Spracherkennung ermöglicht es diesen Systemen, gesprochene Anfragen zu verstehen und entsprechend der Kundenabsicht zu reagieren.

- Transkriptionsdienste: Spracherkennung wandelt Aufnahmen von Verkaufsgesprächen und Besprechungen in schriftliche Transkripte um und ermöglicht so eine einfachere Dokumentation und Analyse.

Automobil

- Sprachsteuerung: Die Sprachsteuerung ermöglicht es Nutzern, Geräte und Anwendungen per Sprachbefehl zu bedienen. Fahrer können Funktionen wie Klimaanlage, Telefonate oder Navigationssysteme steuern.

- Sprachgesteuerte Navigation: Die sprachgesteuerte Navigation bietet Echtzeit-Navigationsanweisungen, indem der Fahrer das Ziel per Spracheingabe angibt. Fahrer können per Sprachbefehl aktuelle Verkehrsinformationen abrufen oder nach nahegelegenen Sehenswürdigkeiten suchen – ganz ohne physische Bedienelemente.

Gesundheitspflege

- Medizinische Transkription: Die medizinische Transkription, auch MT genannt, ist der Prozess der Umwandlung von sprachaufgezeichneten medizinischen Berichten in ein schriftliches Textdokument. Die wichtigsten Schritte im Prozess der medizinischen Transkription sind:

- Aufzeichnung des Diktats des Arztes.

- Transkription von gesprochener Sprache in Text mithilfe von Spracherkennungssystemen (einige Systeme beinhalten auch eine Sprecherdiarisierung, um zwischen den Sprechern zu unterscheiden).

- Den transkribierten Text bearbeiten, um eine höhere Genauigkeit zu erzielen und Fehler gegebenenfalls zu korrigieren.

- Formatierung des Dokuments gemäß den rechtlichen und medizinischen Anforderungen.

- Virtuelle medizinische Assistenten: Virtuelle medizinische Assistenten (VMAs) nutzen Spracherkennung, natürliche Sprachverarbeitung und Algorithmen des maschinellen Lernens, um per Sprache oder Text mit Patienten zu kommunizieren. Spracherkennungssoftware ermöglicht es VMAs, auf Sprachbefehle zu reagieren, Informationen aus elektronischen Patientenakten (EHRs) abzurufen und die medizinische Transkription zu automatisieren.

- Integration von elektronischen Patientenakten (EHR): Angehörige der Gesundheitsberufe können Sprachbefehle verwenden, um im EHR-System zu navigieren, auf Patientendaten zuzugreifen und Daten in bestimmte Felder einzugeben.

Beispiele für Spracherkennung im Alltag

Azure Speech

Azure Speech ist ein cloudbasierter KI-Dienst von Microsoft (Teil der Azure AI Foundry-Tools), der es Anwendungen ermöglicht, gesprochene Sprache zu verarbeiten und zu generieren. Er bietet unter anderem folgende Funktionen:

Spracherkennung (automatische Spracherkennung) : Wandelt gesprochene Audiodaten in geschriebenen Text um und unterstützt dabei mehrere Transkriptionsmodi:

- Echtzeit-Transkription für Streaming-Audio

- Schnelle Transkription von aufgezeichneten Dateien

- Stapeltranskription großer Audiomengen

Entwickler können auch benutzerdefinierte Sprachmodelle erstellen, um die Erkennungsgenauigkeit für domänenspezifisches Vokabular oder laute Umgebungen zu verbessern.

Text-to-Speech (Sprachsynthese) : Wandelt geschriebenen Text mithilfe neuronaler Stimmen in natürlich klingenden Ton um. Entwickler können Stimmmerkmale wie Tonhöhe, Sprechgeschwindigkeit und Aussprache über die Speech Synthesis Markup Language (SSML) steuern.

Azure Speech unterstützt auch benutzerdefinierte neuronale Stimmen , sodass Unternehmen eine einzigartige Stimme für ihre Anwendungen erstellen können.

Sprachübersetzung : Bietet mehrsprachige Sprachübersetzung in Echtzeit und ermöglicht so die Übersetzung von Sprache zu Sprache oder von Sprache zu Text in verschiedenen Sprachen.

Benutzerdefinierte Sprachmodelle : Entwickler können benutzerdefinierte Modelle mit ihren eigenen Daten trainieren, um die Erkennung für Folgendes zu verbessern:

- Branchenspezifische Terminologie

- Akzente und Sprechstile

- Störende Audiobedingungen

Sprachavatare und dialogbasierte KI : Azure Speech kann synthetische sprechende Avatare generieren und Sprachinteraktionen in Echtzeit ermöglichen und unterstützt so dialogbasierte KI-Systeme und Sprachagenten.

Abbildung 2: Ein Beispiel aus dem Azure Voice AI-Agenten Voice Live. 1

Deepgram

Deepgram bietet APIs zur Integration von Sprachfunktionen wie Spracherkennung, Sprachsynthese und Sprachintelligenz. 2

- Sprach-zu-Text-Transkription: Wandelt Audio in Text um, sowohl für Echtzeit-Streaming als auch für vorab aufgezeichnetes Audio.

- Text-to-Speech: Erzeugt natürlich klingende Sprache aus Text für Sprachschnittstellen und -assistenten.

- Sprecherdiarisierung: Identifiziert und trennt verschiedene Sprecher in einer Audioaufnahme.

- Keyword-Erkennung und Audio-Intelligenz: Erkennt spezifische Wörter oder Phrasen und gewinnt Erkenntnisse aus den Audiodaten.

- Benutzerdefinierte Sprachmodelle: Ermöglicht es Organisationen, die Erkennungsgenauigkeit mithilfe domänenspezifischer Daten zu verbessern.

Zu den Anwendungsfällen von Deepgram gehören:

- Kundenservice: Transkription und Analyse von Callcenter-Gesprächen zur Überwachung der Servicequalität und Gewinnung von Erkenntnissen.

- Medien und Rundfunk: Erstellung von Untertiteln und Transkripten für Podcasts, Interviews und Live-Streams.

- Gesundheitswesen und Recht : Umwandlung von gesprochenen Diktaten und Gesprächen in schriftliche Dokumentation.

- Business Analytics: Extraktion von Schlüsselwörtern, Stimmungen und Erkenntnissen aus großen Mengen an Audiodaten.

AssemblyAI

AssemblyAI wird in der Callcenter-Analyse eingesetzt, wo Kundensupportanrufe transkribiert und zur Qualitätskontrolle und Gewinnung von Erkenntnissen analysiert werden; in der Meeting-Transkription , die Transkripte und Zusammenfassungen von virtuellen Meetings erstellt; und in der Medientranskription , die Untertitel, Transkripte und durchsuchbare Audio- oder Videoinhalte ermöglicht.

Es wird auch zur Inhaltsmoderation eingesetzt, um unangemessene oder eingeschränkte Äußerungen in Audiostreams zu erkennen, sowie zur Sprachdatenanalyse, um Informationen wie Themen, Entitäten und Stimmungen aus großen Mengen aufgezeichneter Gespräche zu extrahieren. 3

- Sprach-zu-Text-Transkription: Wandelt Audiostreams oder -dateien in Text mit Zeitstempeln, Konfidenzwerten und anderen Metadaten um.

- Echtzeit-Streaming-Transkription: Verarbeitet Live-Audio mit geringer Latenz für Sprachagenten und Echtzeitanwendungen.

- Audio Intelligence: Gewinnt Erkenntnisse aus der Sprache, einschließlich Sprecherdiarisierung, Stimmungsanalyse , Themenerkennung und Entitätserkennung.

- Zusammenfassung und Spracherkennung: Erzeugt Zusammenfassungen und strukturierte Ausgaben aus Transkripten zur Unterstützung nachgelagerter Arbeitsabläufe.

- Inhaltsmoderation und Schwärzung personenbezogener Daten: Identifiziert oder entfernt sensible oder unangemessene Inhalte aus Audiodateien.

- Mehrsprachigkeit und Spracherkennungsfunktionen: Unterstützt die Transkription über mehrere Sprachen und Akzente hinweg.

Google Cloud Speech-to-Text

Google Cloud Speech-to-Text ermöglicht es Entwicklern, die API zu integrieren, um Audiodateien zu transkribieren, Live-Sprachströme zu verarbeiten und sprachgesteuerte Funktionen wie Befehle oder die Suche zu erstellen. 4

- Echtzeit- und Stapelverarbeitung: Transkribiert sowohl Audiostreams als auch vorab aufgezeichnete Dateien.

- Mehrsprachige Unterstützung: Erkennt Sprache in mehr als 100 Sprachen und Varianten.

- Fortschrittliche KI-Sprachmodelle: Nutzt die Sprachmodelle von Google (z. B. Chirp 3), die auf großen Audiodatensätzen trainiert wurden, um eine höhere Genauigkeit zu erzielen.

- Chirp 3 ist das neueste KI-Sprachmodell für die automatische Spracherkennung (ASR) von Google. Es handelt sich um ein mehrsprachiges generatives Modell, das gesprochene Audiodateien mit höherer Genauigkeit und Geschwindigkeit in Text umwandelt. Das Modell verbessert die Transkriptionsqualität und unterstützt Funktionen wie Sprecherdiarisierung (Identifizierung verschiedener Sprecher), automatische Spracherkennung und mehrsprachige Spracherkennung.

- Automatische Interpunktion und Sprechererkennung: Fügt Transkripten Interpunktion hinzu und kann Sprecher in Aufnahmen unterscheiden.

Was ist Spracherkennung?

Spracherkennung, auch bekannt als automatische Spracherkennung (ASR), Sprach-zu-Text-Umwandlung (STT) und computergestützte Spracherkennung, ist eine Technologie, die es einem Computer ermöglicht, gesprochene Sprache zu erkennen und in Text umzuwandeln.

Die Spracherkennungstechnologie nutzt KI und Modelle des maschinellen Lernens, um verschiedene Akzente, Dialekte und Sprachmuster präzise zu identifizieren und zu transkribieren.

Spracherkennung vs. Stimmerkennung

Spracherkennung wird häufig mit Stimmerkennung verwechselt, obwohl es sich um unterschiedliche Konzepte handelt. Spracherkennung wandelt gesprochene Wörter in geschriebenen Text um und konzentriert sich dabei auf die Identifizierung der vom Benutzer gesprochenen Wörter und Sätze, unabhängig von der Identität des Sprechers.

Die Spracherkennung hingegen befasst sich mit dem Erkennen oder Überprüfen der Stimme eines Sprechers und zielt darauf ab, die Identität eines unbekannten Sprechers zu bestimmen, anstatt sich auf das Verständnis des Inhalts der Rede zu konzentrieren.

Welche Merkmale weisen Spracherkennungssysteme auf?

Spracherkennungssysteme bestehen aus mehreren Komponenten, die zusammenarbeiten, um menschliche Sprache zu verstehen und zu verarbeiten. Zu den wichtigsten Merkmalen einer effektiven Spracherkennung gehören:

Audio-Vorverarbeitung

Nachdem Sie das Rohaudiosignal von einem Eingabegerät erhalten haben, müssen Sie es vorverarbeiten, um die Qualität der Spracheingabe zu verbessern. Hauptziel der Audiovorverarbeitung ist es, relevante Sprachdaten zu extrahieren, indem unerwünschte Artefakte entfernt und Rauschen reduziert wird.

Merkmalsextraktion

In diesem Schritt wird das vorverarbeitete Audiosignal in eine aussagekräftigere Darstellung umgewandelt. Dadurch werden die Rohdaten für maschinelle Lernmodelle in Spracherkennungssystemen besser handhabbar.

Gewichtung des Sprachmodells

Die Gewichtung von Wörtern und Phrasen, wie beispielsweise Produktbezeichnungen, gewichtet Audio- und Sprachsignale stärker. Dadurch werden diese Schlüsselwörter von Spracherkennungssystemen in der nachfolgenden Rede mit höherer Wahrscheinlichkeit erkannt.

Akustische Modellierung

Es ermöglicht Spracherkennungssystemen, phonetische Einheiten innerhalb eines Sprachsignals zu erfassen und zu unterscheiden. Akustische Modelle werden anhand großer Datensätze trainiert, die Sprachproben von einer Vielzahl von Sprechern mit unterschiedlichen Akzenten, Sprechweisen und Hintergründen enthalten.

Sprecherkennzeichnung

Es ermöglicht Spracherkennungsanwendungen, die Identität mehrerer Sprecher in einer Audioaufnahme zu bestimmen. Jedem Sprecher in einer Audioaufnahme werden eindeutige Bezeichnungen zugewiesen, sodass jederzeit ermittelt werden kann, welcher Sprecher gerade spricht.

Schimpfwortfilterung

Der Prozess des Entfernens anstößiger, unangebrachter oder expliziter Wörter oder Ausdrücke aus Audiodaten.

Welche verschiedenen Spracherkennungsalgorithmen gibt es?

Die Spracherkennung nutzt verschiedene Algorithmen und Rechenverfahren, um gesprochene Sprache in geschriebene Sprache umzuwandeln. Im Folgenden werden einige der gebräuchlichsten Spracherkennungsverfahren aufgeführt:

Versteckte Markov-Modelle (HMMs)

Das Hidden-Markov-Modell (HMM) ist ein statistisches Markov-Modell, das häufig in traditionellen Spracherkennungssystemen eingesetzt wird. HMMs erfassen die Beziehungen zwischen den akustischen Merkmalen und modellieren die zeitliche Dynamik von Sprachsignalen.

Verarbeitung natürlicher Sprache (NLP)

NLP ist ein Teilgebiet der künstlichen Intelligenz, das sich mit der Interaktion zwischen Menschen und Maschinen mittels natürlicher Sprache befasst. Einige der wichtigsten Aufgaben von NLP in Spracherkennungssystemen:

- Schätzen Sie die Wahrscheinlichkeit von Wortfolgen im erkannten Text ein.

- Umgangssprachliche Ausdrücke und Abkürzungen einer gesprochenen Sprache in eine standardisierte Schriftform umwandeln

- Ordnen Sie phonetische Einheiten, die aus akustischen Modellen gewonnen wurden, den entsprechenden Wörtern in der Zielsprache zu.

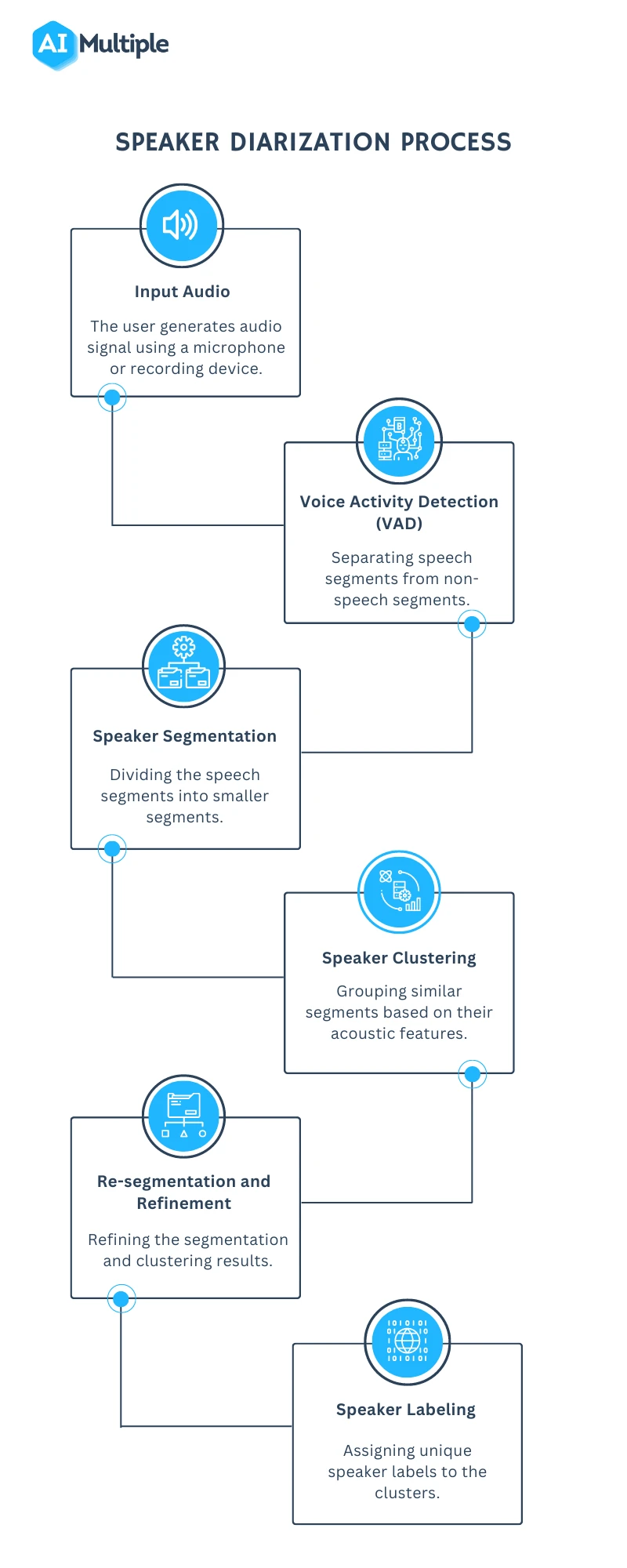

Sprecherdiarisierung (SD)

Die Sprecherdiarisierung, auch Sprecherkennzeichnung genannt, ist der Prozess, Sprachsegmente zu identifizieren und ihren jeweiligen Sprechern zuzuordnen (Abbildung 1). Sie ermöglicht die sprecherspezifische Stimmerkennung und die Identifizierung von Personen in einem Gespräch.

Abbildung 3: Ein Flussdiagramm zur Veranschaulichung des Sprecherdiarisierungsprozesses

Dynamische Zeitverzerrung (DTW)

Spracherkennungsalgorithmen verwenden den Dynamic Time Warping (DTW)-Algorithmus, um eine optimale Ausrichtung zwischen zwei Sequenzen zu finden (Abbildung 4).

Abbildung 4: Ein Spracherkenner, der dynamische Zeitverzerrung verwendet, um den optimalen Abstand zwischen Elementen zu bestimmen. 5

Tiefe neuronale Netze

Neuronale Netze verarbeiten und transformieren Eingangsdaten, indem sie die nichtlineare Frequenzwahrnehmung des menschlichen Gehörsystems simulieren.

Konnektionistische temporale Klassifikation (CTC)

CTC ist ein von Alex Graves im Jahr 2006 eingeführtes Trainingsziel . Es eignet sich besonders für Sequenzkennzeichnungsaufgaben und End-to-End-Spracherkennungssysteme. CTC ermöglicht es dem neuronalen Netzwerk, die Beziehung zwischen Eingabeframes zu erkennen und diese mit den Ausgabelabels abzugleichen.

Welche Herausforderungen birgt die Spracherkennung?

Obwohl die Spracherkennungstechnologie viele Vorteile bietet, steht sie dennoch vor einigen Herausforderungen, die bewältigt werden müssen. Zu den wichtigsten Einschränkungen der Spracherkennung gehören:

Akustische Herausforderungen

Akzente und Dialekte

Akzente und Dialekte unterscheiden sich in Aussprache, Wortschatz und Grammatik, was es Spracherkennungsanwendungen erschwert, Sprache genau zu erkennen.

Angenommen, ein Spracherkennungsmodell wurde hauptsächlich mit amerikanischen Akzenten trainiert. Nutzt ein Sprecher mit starkem schottischem Akzent das System, kann es aufgrund von Ausspracheunterschieden zu Schwierigkeiten kommen. Beispielsweise wird das Wort „water“ in den beiden Akzenten unterschiedlich ausgesprochen. Ist dem System diese Aussprache nicht vertraut, kann es Probleme haben, das Wort „water“ zu erkennen.

Lösung: Die Bewältigung dieser Herausforderungen ist entscheidend für die Verbesserung der Genauigkeit von Spracherkennungsanwendungen. Um Aussprachevariationen zu überwinden, ist es unerlässlich, die Trainingsdaten um Sprachbeispiele von Sprechern mit unterschiedlichen Akzenten zu erweitern. Dieser Ansatz hilft dem System, ein breiteres Spektrum an Sprachmustern zu erkennen und zu verstehen.

Hintergrundgeräusche

Hintergrundgeräusche (z. B. Verkehrslärm, Übersprechen) erschweren es Spracherkennungsanwendungen, Sprache von Hintergrundgeräuschen zu unterscheiden (siehe Abbildung 5).

Lösung: Durch Vorverarbeitungstechniken lässt sich das Hintergrundrauschen bei der Spracherkennung reduzieren, was die Leistungsfähigkeit von Spracherkennungsmodellen in lauten Umgebungen verbessern kann.

Beispielsweise lassen sich Datenaugmentierungstechniken einsetzen, um den Einfluss von Rauschen auf Audiodaten zu reduzieren. Datenaugmentation hilft dabei, Spracherkennungsmodelle mit verrauschten Daten zu trainieren und so die Modellgenauigkeit in realen Umgebungen zu verbessern.

Abbildung 5: Beispiele für einen Zielsatz („Der Clown hatte ein lustiges Gesicht“) im Hintergrundgeräusch von Stimmengewirr, Autolärm und Regen. 6

Sprachliche Herausforderungen

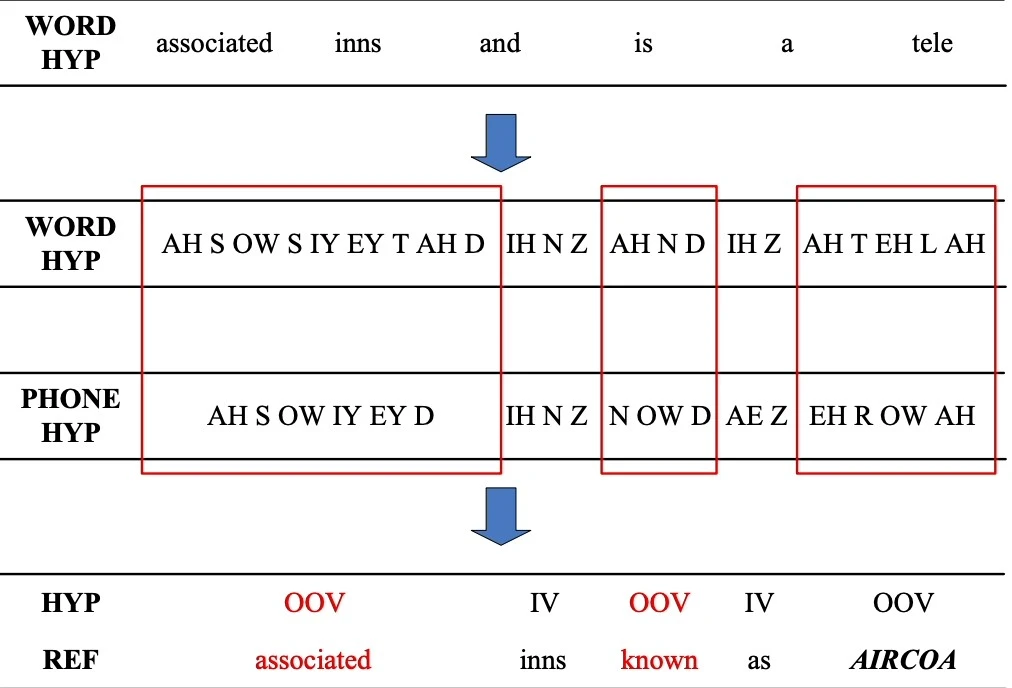

Wörter, die ich nicht kenne

Da das Spracherkennungsmodell nicht mit unbekannten Wörtern trainiert wurde, kann es diese fälschlicherweise als andersartig erkennen oder bei deren Transkription scheitern.

Abbildung 6: Ein Beispiel für die Erkennung eines unbekannten Wortes (OOV).

Lösung: Die Wortfehlerrate (WER) ist eine gängige Kennzahl zur Messung der Genauigkeit von Spracherkennungs- oder maschinellen Übersetzungssystemen. Die Wortfehlerrate kann wie folgt berechnet werden:

Abbildung 7: Veranschaulichung der Berechnung der Wortfehlerrate (WER). 7

Homophone

Homophone sind Wörter, die gleich ausgesprochen werden, aber unterschiedliche Bedeutungen haben, wie zum Beispiel „to“, „too“ und „two“.

Lösung: Die semantische Analyse ermöglicht es Spracherkennungsprogrammen, das passende Homophon anhand seiner beabsichtigten Bedeutung im jeweiligen Kontext auszuwählen. Die Berücksichtigung von Homophonen verbessert die Fähigkeit des Spracherkennungsprozesses, gesprochene Wörter zu verstehen und korrekt zu transkribieren.

Technische/systemische Herausforderungen

Datenschutz und Datensicherheit

Spracherkennungssysteme verarbeiten und speichern sensible und personenbezogene Daten, beispielsweise Finanzinformationen. Unbefugte könnten diese Informationen missbrauchen und so zu Datenschutzverletzungen führen.

Lösung: Sensible und persönliche Audiodaten, die zwischen dem Gerät des Nutzers und der Spracherkennungssoftware übertragen werden, können verschlüsselt werden. Eine weitere Technik zur Gewährleistung von Datenschutz und Datensicherheit in Spracherkennungssystemen ist die Datenmaskierung. Datenmaskierungsalgorithmen maskieren und ersetzen sensible Sprachdaten durch strukturell identische, aber akustisch unterschiedliche Daten.

Abbildung 8: Ein Beispiel für die Funktionsweise der Datenmaskierung.

Begrenzte Trainingsdaten

Begrenzte Trainingsdaten beeinträchtigen die Leistung von Spracherkennungssoftware unmittelbar. Bei unzureichenden Trainingsdaten kann das Spracherkennungsmodell Schwierigkeiten haben, verschiedene Akzente zu generalisieren oder weniger gebräuchliche Wörter zu erkennen.

Lösung: Um die Qualität und Quantität der Trainingsdaten zu verbessern, können Sie den bestehenden Datensatz mithilfe von Datenaugmentation und Technologien zur Erzeugung synthetischer Daten erweitern.

Seien Sie der Erste, der kommentiert

Ihre E-Mail-Adresse wird nicht veröffentlicht. Alle Felder sind erforderlich.