Pasamos 3 días experimentando con flujos de trabajo y pipelines de agentes en n8n, siguiendo las guías de Anthropic y OpenAI sobre la creación de agentes de IA eficaces. 1 2

Explore los componentes principales del agente de IA , cómo elegir los componentes y herramientas adecuados, además de crear flujos de trabajo de agentes basados en los patrones simples y componibles de Anthropic, como el encadenamiento de indicaciones, el enrutamiento, la paralelización, los trabajadores orquestadores y un evaluador-optimizador:

Comprensión de los componentes de los agentes de IA

La creación de agentes implica conectar componentes de varios dominios, como modelos, herramientas, conocimiento y memoria, y mecanismos de control. OpenAI proporciona primitivas componibles para cada uno:

Fuente: OpenAI 3

Obviamente, OpenAI enumera sus propios elementos primero, pero existe un amplio ecosistema de alternativas. Dependiendo de su caso de uso, puede crear agentes utilizando marcos de trabajo como LangChain, LlamaIndex, CrewAI o incluso capas de orquestación personalizadas.

Voy a entrar en más detalles sobre cada uno de estos componentes:

Modelos

Primero, tenemos el componente de modelos. Estos son los modelos de IA, los grandes modelos de lenguaje que constituyen la inteligencia central capaz de razonar, tomar decisiones y procesar diferentes modalidades. Por supuesto, los ejemplos que nos da OpenAI son GPT-5 , etc.

Dependiendo del tipo específico de agente que estés creando, querrás elegir un tipo diferente de modelo dentro del ecosistema OpenAI.

GPT-5 es su modelo insignia. Es un modelo de pensamiento que destaca por su capacidad de razonamiento, su habilidad para resolver problemas en múltiples pasos y su particular eficacia para responder a la mayoría de las preguntas.

Fuera del ecosistema OpenAI, Claude 4.5 Sonnet suele ser el modelo preferido por las personas que realizan muchas tareas de codificación, razonamiento y basadas en STEM, aunque Gemini 2.5 Pro está desafiando eso en este momento.

Sin embargo, OpenAI afirma que el GPT-5.2-Codex es el modelo de codificación más avanzado para que los desarrolladores resuelvan problemas complejos de ingeniería de software de la vida real. El GPT-5.2-Codex de OpenAI muestra un rendimiento comparable en pruebas de rendimiento de codificación como TerminalBench y SWE-bench. 4

Hemos realizado análisis comparativos de los mejores modelos de IA para ayudarte a comprender el rendimiento de cada uno en términos de razonamiento, velocidad y coste, de modo que puedas elegir el que mejor se adapte a tus objetivos.

Herramientas

A continuación, veremos las herramientas que amplían las capacidades del modelo, como la posibilidad de realizar búsquedas en la web o interactuar con otros sistemas.

Casi cualquier aplicación puede convertirse en una herramienta para tu IA. Puedes conectarla a Gmail, Calendar, tu Drive o aplicaciones como Slack, Discord, YouTube, Salesforce y Zapier. Incluso puedes crear tus propias herramientas personalizadas.

Con el SDK de agentes de OpenAI (que requiere algo de programación), puede definir herramientas o utilizar las integradas, como la búsqueda web, la búsqueda de archivos y el uso del ordenador. 5

El protocolo MCP (Model Context Protocol) de Anthropic también simplifica la integración de herramientas al estandarizar la forma en que los modelos acceden a ellas. En 2026, el valor empresarial provendrá cada vez más de las "líneas de ensamblaje digitales", flujos de trabajo multietapa guiados por humanos donde múltiples agentes ejecutan procesos de extremo a extremo, gracias al protocolo MCP.

Si no te gusta programar,las plataformas sin código como n8n te permiten arrastrar y soltar herramientas para vincularlas con tu modelo.

Conocimiento y memoria

Existen dos tipos principales de memoria: la memoria de base de conocimientos (memoria estática) y la memoria persistente .

- La base de conocimientos proporciona a la IA acceso a datos, políticas y documentos estáticos que permanecen prácticamente inalterados. Esto es fundamental para los agentes que realizan tareas basadas en políticas o específicas de la empresa, donde los materiales de referencia deben mantenerse consistentes.

- La memoria persistente permite que la IA recuerde interacciones pasadas entre sesiones. Esto es fundamental para los chatbots o asistentes personales que necesitan recordar conversaciones anteriores.

OpenAI proporciona servicios alojados como almacenes de vectores , búsqueda de archivos e incrustaciones para gestionar la memoria.

Si prefiere soluciones de código abierto, Pinecone (nativa de la nube y optimizada para la búsqueda vectorial) y Weaviate son opciones populares.

Para quienes utilizan herramientas sin código , la gestión de memoria suele estar integrada en plataformas como n8n y Creatio .

Para más información, consulte: Creación de un agente de investigación de IA con memoria.

Barandillas de seguridad

Las medidas de seguridad garantizan que el agente se comporte según lo previsto, evitando respuestas irrelevantes, perjudiciales o inapropiadas. Por ejemplo, un bot de atención al cliente debe centrarse en temas relacionados con el servicio y no desviarse hacia temas ajenos.

Fuera del ecosistema de OpenAI, algunas herramientas populares incluyen Guardrails AI y LangChain Guardrails . Muchas plataformas sin código ya incorporan funciones de control de acceso, pero sigue siendo importante comprender cómo funcionan para mantener el control y el cumplimiento normativo de sus agentes.

Orquestación

El último componente es la orquestación. Esto implica gestionar cómo trabajan juntos los distintos subagentes, implementarlos en producción y supervisar su rendimiento.

Una vez desplegados, los agentes necesitan supervisión continua. Los modelos, los datos y los comportamientos cambian, por lo que las actualizaciones y mejoras constantes son fundamentales.

Varias plataformas/frameworks admiten la orquestación, como por ejemplo:

- Plataformas de bajo código/sin código :

- Pila de IA

- Microsoft Creador de agentes de Copilot Studio

- IA relevante, etc.

- Marcos de código abierto :

- Tripulación de IA, diseñada para sistemas multiagente.

- LangChain, ampliamente utilizado para gestionar y desplegar interacciones entre agentes.

- LlamaIndex es especialmente útil para agentes con gran cantidad de documentos y aplicaciones de bases de conocimiento.

Componentes básicos de la automatización: flujos de trabajo frente a agentes.

Un agente de IA es un sistema que percibe su entorno, procesa información y toma acciones de forma autónoma para lograr objetivos específicos, como agentes de codificación como Cursor o Windsurf, editores de código impulsados por IA con "modos de agente" que pueden realizar tareas de codificación de forma autónoma utilizando modelos como Claude Sonnet 4.5. Otro ejemplo común son los agentes de servicio al cliente , que muchas empresas utilizan para gestionar consultas.

Existen muchas maneras diferentes de diseñar e implementar estos agentes, dependiendo de la complejidad del flujo de trabajo y del grado de autonomía requerido.

En resumen, un agente de IA suele ser un conjunto de subagentes, cada uno de los cuales realiza tareas específicas. Juntos, estos subagentes se coordinan dentro de sistemas multiagente para ofrecer lo que percibimos como un único agente de IA.

Estos son fundamentalmente diferentes de los flujos de trabajo. Los flujos de trabajo son secuencias orquestadas de pasos predefinidos, como una receta que siempre sigue el mismo orden:

¿Cuándo utilizar agentes de IA?

Antes de adentrarnos en ejemplos de implementación de flujos de trabajo para la creación de agentes de IA, conviene hacer una breve comprobación de la realidad. Los agentes de IA no son marcos rígidos. Muchos equipos siguen comprobando que los flujos de trabajo tradicionales funcionan bien, incluso en escenarios donde, en teoría, se podrían aplicar agentes.

Una de las formas más claras de pensar en esto, descrita en el blog de Anthropic, es la siguiente:

Dicho esto, existen situaciones reales en las que los agentes superan a los flujos de trabajo tradicionales en tareas que exigen flexibilidad, razonamiento y adaptabilidad:

Conversaciones dinámicas que requieren adaptaciones :

Algunas interacciones, como las solicitudes básicas de reembolso o restablecimiento de contraseña, se integran perfectamente en los flujos de trabajo. Pero otras requieren un juicio más matizado o decisiones que dependen del contexto, como las recomendaciones personalizadas, que dependen en gran medida del contexto y de un razonamiento bidireccional.

Toma de decisiones de alto valor y bajo volumen:

El funcionamiento de los agentes puede resultar costoso, pero en algunos casos, las decisiones que respaldan son mucho más costosas si se toman incorrectamente.

Por ejemplo, BCG informó que un importante proveedor de energía en Alemania utilizó una herramienta basada en inteligencia artificial (GenAI) para automatizar las revisiones de pagos. 6

Si se planifica una infraestructura a gran escala, como la optimización de diseños de ingeniería, el coste computacional es insignificante. En estos casos críticos, los agentes aportan valor porque el coste de equivocarse supera con creces el coste de ejecutar el modelo.

Flujos de trabajo impredecibles y de múltiples pasos:

Algunos flujos de trabajo son demasiado complejos, donde escribir un sinfín de reglas del tipo "si esto, entonces aquello" se convierte en un proyecto en sí mismo.

En estos casos, los bucles de agencia simplifican el caos. En lugar de codificar manualmente cada ruta posible, el modelo decide dinámicamente el siguiente paso basándose en el contexto y el razonamiento en tiempo real.

Este enfoque funciona bien para sistemas o herramientas de diagnóstico que manejan docenas de variables cambiantes.

Cuando los flujos de trabajo son mejores

Escenarios de alta frecuencia y baja complejidad :

Algunas tareas dependen más de la velocidad y la escala que del razonamiento, como por ejemplo:

- Recuperación de información de una base de datos

- Analizar mensajes o correos electrónicos estructurados

- Responder a consultas tipo FAQ

Un flujo de trabajo podría procesar miles de estas solicitudes con un coste y una latencia más predecibles que los que podría ofrecer un agente.

Introducción a los flujos de trabajo e implementaciones de agentes de IA

Ahora que hemos analizado los flujos de trabajo de los agentes de IA y los componentes que los conforman, pasemos a las implementaciones. Como ya se mencionó, los agentes de IA no suelen ser una sola entidad, sino que están compuestos por varios subagentes que interactúan entre sí. Uno de los mejores recursos que encontré sobre flujos de trabajo y sistemas de agentes comunes es la guía «Building Effective Agents» de Anthropic. 7 Analicemos esto.

En el núcleo de los sistemas agénticos se encuentra lo que Anthropic denomina LLM aumentado . Esta estructura consta de tres elementos clave:

- la entrada,

- el modelo de lenguaje grande (LLM),

- y el resultado.

Fuente: Anthropic 8

El LLM aumentado es capaz de generar sus propias consultas de búsqueda, seleccionar las herramientas pertinentes y decidir qué información almacenar en la memoria.

Es posible que observe algunas similitudes con los componentes de OpenAI (como se detalla a continuación). Sin embargo, esta versión es más sencilla y carece de elementos como mecanismos de control y orquestación, aunque la estructura principal se mantiene. Esto es perfectamente aceptable. Para tareas como pruebas e implementación, es recomendable consultar los componentes de OpenAI.

Lista de componentes de agentes de IA de OpenAI 9

Estos bloques de construcción LLM aumentados también se conocen como subagentes . Ahora, exploremos cómo estos subagentes se combinan e interactúan para formar un agente de IA más grande. Comenzaremos con los flujos de trabajo más simples y avanzaremos gradualmente hacia sistemas más complejos y totalmente autónomos.

1. Flujos de trabajo agenciales simples (encadenamiento de indicaciones)

El flujo de trabajo más sencillo para agentes se denomina encadenamiento de indicaciones. En este proceso, una tarea se divide en una serie de pasos, donde cada subagente gestiona la salida del anterior.

En esencia, funciona como una cadena de montaje, pero se pueden introducir puntos de decisión para redirigir el flujo si es necesario. El patrón general se mantiene: un subagente procesa una entrada, que a su vez pasa el resultado a otro subagente para su posterior procesamiento, y así sucesivamente, hasta obtener la salida final. Este método resulta especialmente útil para tareas que pueden dividirse fácilmente en subtareas más pequeñas y secuenciales.

El flujo de trabajo de encadenamiento de indicaciones 10

Ejemplo del mundo real: 11

Encadenamiento de indicaciones en n8n (esquema, evaluación y publicación en hojas de cálculo)

En el ejemplo anterior, el usuario introduce un tema en la ventana de chat n8n. Cada nodo LLM utiliza el modelo Azure OpenAI.

El primer LLM genera un esquema estructurado para una entrada de blog. La consigna para el redactor del esquema es la siguiente:

Captura de pantalla de la solicitud para el generador de esquemas LLM

Donde {{ $json.chatInput }} se refiere al tema que fue ingresado por el usuario en la ventana de chat.

La variable {{ $json.chatInput }} aparece en gris porque el flujo de trabajo aún no se ha ejecutado. Si ya hubiéramos ejecutado o probado el nodo, estaría en verde o rojo, según la validez de la variable.

A continuación, el siguiente LLM evaluará el esquema basándose en los criterios clave de la sección de mensajes del sistema. La solicitud se encuentra a continuación:

El último curso del Máster en Redacción de Blogs (LLM) consistirá en añadir una fila a una hoja sobre el tema, basándose en el esquema creado por el Máster anterior.

Captura de pantalla de la solicitud para el Máster en Redacción de Blogs (LLM)

Cuándo usar el encadenamiento de indicaciones:

- Las tareas pueden descomponerse de forma natural en subtareas fijas y secuenciales.

- Cada paso contribuye de manera significativa al resultado final.

- El razonamiento paso a paso mejora la precisión en comparación con el procesamiento directo.

- Se necesitan puntos de control de calidad a lo largo de todo el proceso.

2. Flujo de trabajo de enrutamiento

El enrutamiento es otro tipo de flujo de trabajo en el que se recibe una entrada y un subagente se encarga de dirigirla a la tarea de seguimiento correspondiente. Cada tarea es gestionada por un subagente especializado en esa área y, una vez completadas, se genera el resultado final.

Un ejemplo clásico de enrutamiento se observa en los bots de atención al cliente. El bot puede recibir diversos tipos de consultas, como preguntas generales, solicitudes de reembolso o problemas de soporte técnico. El primer subagente identifica la naturaleza de la consulta y la dirige al subagente especializado en ese problema en particular.

Por ejemplo, si la consulta es sobre un reembolso, se redirigirá al subagente especialista en reembolsos, mientras que una pregunta de soporte técnico se dirigirá al subagente de soporte técnico.

Otro ejemplo es la asignación de preguntas a diferentes modelos según sus fortalezas. Para preguntas más complejas relacionadas con ciencia, tecnología, ingeniería y matemáticas (STEM), se podría asignar la entrada a un modelo como Claude Sonnet 4.5. Para consultas más sencillas y rápidas, se podría optar por asignarla a un modelo como Gemini Flash, optimizado para la velocidad.

Ejemplo del mundo real: 12

En el ejemplo anterior, el agente dirige la entrada del usuario a agentes especializados (como un agente de recordatorios, un agente de correo electrónico, etc.) utilizando una salida estructurada de un modelo de lenguaje.

El router está conectado a GPT 4o mini. El mensaje y las categorías son los siguientes:

Captura de pantalla de los parámetros del nodo del agente de IA.

Ejemplos de casos de uso:

Puedes introducir una consulta en la ventana de chat de n8n, por ejemplo, digamos:

- El usuario dice: “Recuérdame que llame a mi madre mañana”.

→ Enviado al agente de recordatorios - El usuario dice: “Envía un correo electrónico al equipo de Recursos Humanos”.

→ Enviado al agente de correo electrónico - El usuario dice: “Programa una reunión con John la semana que viene”.

→ Enviado al agente de la reunión

Cuándo usar el enrutamiento:

- Diversos tipos de entrada: Su sistema recibe varios tipos de consultas que se benefician de un tratamiento especializado.

- Optimización de recursos: Desea asignar consultas sencillas a procesadores rentables, mientras que las solicitudes complejas se dirigen a sistemas avanzados.

- Especialización de dominio: Las diferentes categorías de entradas requieren conocimientos especializados o lógica de procesamiento específicos del dominio.

- Optimización del rendimiento: Es necesario equilibrar la carga y garantizar tiempos de respuesta óptimos en diferentes tipos de consultas.

3. Flujo de trabajo de paralelización

El siguiente flujo de trabajo es la paralelización. Este flujo de trabajo específico basado en agentes suele tener dos variantes principales. En la paralelización, varios subagentes trabajan en una tarea simultáneamente y sus resultados se combinan.

- La primera variante se denomina seccionamiento , en la que una tarea se divide en subtareas independientes que se ejecutan en paralelo.

- La segunda variante es la votación , donde diferentes subagentes realizan la misma tarea varias veces para producir resultados diversos, que luego se agregan.

Esto ayuda a lograr una automatización modular más rápida, especialmente en flujos de trabajo grandes.

Comparación de tiempos entre flujo de trabajo secuencial y flujo de trabajo paralelo 13

Ejemplo del mundo real: 14

Captura de pantalla del ejemplo de flujo de trabajo de paralelización en n8n.

La ejecución paralela en el ejemplo n8n demuestra una tarea en la que el flujo de trabajo consulta la búsqueda Google utilizando la API SERP para recuperar URL de LinkedIn y almacenarlas en una hoja Google. En la configuración inicial, el flujo de trabajo procesa cada tarea secuencialmente, un sitio web a la vez:

- Se activa el flujo de trabajo.

- La herramienta Get recupera el sitio web de la hoja Google.

- El agente de IA utiliza la API SERP para buscar Google y obtener la URL de LinkedIn.

- La URL de LinkedIn se actualiza luego en la hoja Google.

En este punto, las tareas se procesan una tras otra, lo que puede resultar lento al trabajar con grandes conjuntos de datos.

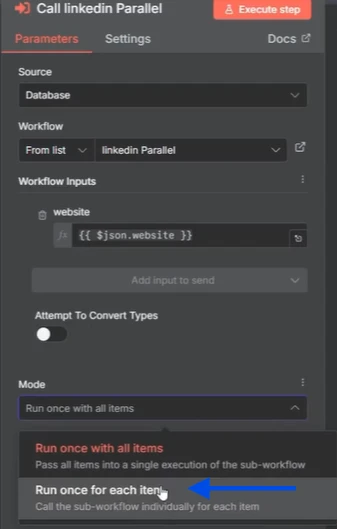

n8n tiene esta función donde puedes seleccionar nodos, hacer clic y luego decir que quiero convertir estos nodos seleccionados en un subflujo de trabajo.

Lo que sucede es que al hacer clic en este botón, se le asignará un nombre a mi flujo de trabajo. Al hacer clic en confirmar, todo se convierte en un subflujo de trabajo que ya está vinculado aquí y siendo llamado por este programa.

El subflujo de trabajo creado

Entonces n8n convirtió esto en un subflujo de trabajo, pero aún no tienes paralelización porque todavía se ejecutaría a través de todo aquí.

Para que esto se ejecute en paralelo, todos los elementos deben ejecutarse individualmente. Por lo tanto, al hacer clic en el nodo, puede seleccionar "Ejecutar una vez" para cada elemento, lo que significa que se llamará al subflujo de trabajo individualmente para cada uno.

Una vez que hayas realizado ese cambio, puedes acceder al subflujo de trabajo y hacer clic en "Ejecuciones". Verás que los tres elementos se ejecutan simultáneamente.

Cuándo utilizar la paralelización: La paralelización es más eficaz cuando las tareas se pueden dividir en subtareas más pequeñas e independientes que se pueden ejecutar simultáneamente, lo que mejora tanto la velocidad como la eficiencia.

También resulta valioso cuando se requieren múltiples perspectivas o intentos repetidos para lograr una mayor confianza en los resultados. Para problemas complejos que involucran varias dimensiones o criterios de evaluación, los modelos de lenguaje grandes buscan un mejor rendimiento cuando cada aspecto específico se maneja mediante una llamada de modelo independiente, lo que permite un razonamiento más preciso y enfocado para cada parte de la tarea.

4. Flujo de trabajo de los trabajadores de Orchestrator

El siguiente flujo de trabajo, que se vuelve más complejo, es el patrón orquestador-trabajador.

La arquitectura orquestador-trabajador hace que sus flujos de trabajo n8n sean modulares, escalables y adaptables, convirtiendo una única automatización rígida en un sistema componible de agentes que cooperan entre sí.

A primera vista, podría parecer similar a la paralelización, ya que varios subagentes pueden estar activos, pero la diferencia clave radica en la flexibilidad. A diferencia de la paralelización, la configuración orquestador-trabajador no depende de una lista fija de subtareas. En cambio, el orquestador decide dinámicamente qué tareas deben realizarse, las asigna a los agentes trabajadores y gestiona su coordinación durante todo el proceso.

Ejemplo del mundo real: 15

Captura de pantalla del ejemplo de flujo de trabajo de orquestador-trabajadores en n8n.

En el ejemplo anterior, el informe se recopila una sola vez y un coordinador distribuye el trabajo a varios agentes especializados.

El agente del director ejecutivo actúa como orquestador del LLM. Procesa el briefing de entrada, lo adapta a cada departamento, selecciona qué agentes de trabajo activar y determina cómo se integrarán sus resultados. Puede decidir llamar a uno, dos o a todos los trabajadores según el contexto y las limitaciones.

Captura de pantalla del nodo Agente del CEO

A continuación, tres agentes de trabajo (Marketing, Operaciones y Finanzas) ejecutan cada uno su propio modelo de chat OpenAI con configuraciones de memoria y herramientas independientes. Esto permite utilizar indicaciones específicas para cada departamento y esquemas JSON para una salida estructurada.

Captura de pantalla de los tres nodos de agentes de trabajo.

Una vez que el coordinador ha preparado las instrucciones específicas para cada departamento, invoca a cada trabajador como una herramienta para generar resultados en función de las entradas.

Por ejemplo, el agente de marketing crea campañas (nombre, canal, KPI).

Nodo de herramienta de IA (Agente de marketing)

Una vez generados los informes de los trabajadores, el agente del director ejecutivo recopila y fusiona las respuestas de los departamentos en un único plan coherente. A continuación, el flujo de trabajo escribe el plan en un documento Google, añade metadatos, lo convierte a PDF y lo sube automáticamente para su uso compartido o revisión.

Captura de pantalla de los nodos de creación, conversión y carga de documentos.

Al ejecutarse, el orquestador determina qué agentes activar, coordina su colaboración y combina sus resultados en un informe completo, lo que demuestra cómo los flujos de trabajo entre el orquestador y los trabajadores permiten sistemas de IA flexibles, modulares y componibles.

Cuándo utilizar el flujo de trabajo de los trabajadores del orquestador: Este enfoque es especialmente valioso para resolver problemas abiertos o en constante evolución, donde los pasos necesarios no se pueden conocer de antemano.

Ejemplos en los que el flujo de trabajo orquestador-trabajador resulta útil:

- Tareas de codificación: Al desarrollar o depurar productos de software complejos que requieren cambios coordinados en varios archivos, donde los archivos y las modificaciones exactas se pueden determinar durante la ejecución.

- Investigación y recopilación de información: En tareas que implican la búsqueda, la recopilación y el análisis de datos de múltiples fuentes, donde la información relevante no se puede identificar completamente de antemano y debe descubrirse de forma dinámica.

5. Flujo de trabajo del optimizador del evaluador

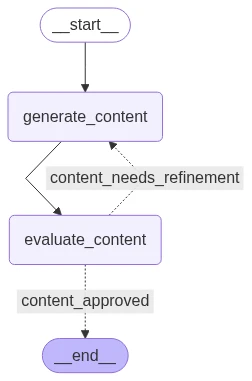

Aún más complejo es el flujo de trabajo entre evaluador y optimizador. Esta configuración tiende hacia un comportamiento más autónomo, otorgando al subagente o agente de IA mayor libertad para decidir qué acciones tomar y cómo mejorar sus propios resultados.

Se parte de una entrada y el primer subagente genera una solución propuesta. Esta solución se envía a un subagente evaluador, que la revisa. Si el evaluador la considera satisfactoria, la solución se finaliza. Pero si determina que el resultado no es lo suficientemente bueno, lo devuelve al primer subagente con comentarios específicos para su mejora.

Esto crea un ciclo de retroalimentación continuo en el que el optimizador refina iterativamente su resultado hasta que el evaluador determina que cumple con los estándares de calidad requeridos.

Ejemplo del mundo real: 16

Para este ejemplo, utilicé una simulación en Python, en lugar de una herramienta sin código, para mostrar directamente los esquemas de evaluación, la lógica personalizada y los bucles iterativos.

Esta no es una configuración completa. Para ejecutar el flujo de trabajo evaluador-optimizador de principio a fin, necesitará una configuración adecuada del entorno, la inicialización del modelo y la configuración del esquema, etc.

También puede implementar un ciclo evaluador-optimizador utilizando herramientas de automatización de flujos de trabajo que admitan nodos de evaluación.

Flujo de trabajo evaluador-optimizador con Python:

Un ejemplo de un bucle Evaluador-Optimizador, un patrón común en sistemas de IA autorreflexivos o flujos de trabajo basados en agentes.

Este flujo de trabajo representa un ciclo automatizado de generación y evaluación de contenido donde colaboran dos componentes: uno crea y el otro revisa. Garantiza que los resultados cumplan con los estándares de calidad antes de su finalización.

Explicación paso a paso:

- Inicializar la entrada: Crear initial_state = {“content_topic”: topic}.

- Ejecutar el bucle: Llamar a evaluator_optimizer_workflow.invoke(initial_state) que iterativamente:

- genera/refina contenido,

- evalúa la calidad,

- Se repite hasta que se apruebe o se alcance un límite máximo de iteraciones.

- Resultado del registro: Imprimir mensaje de finalización y contenido generado aprobado.

- Resultados devueltos: diccionario final_state (por ejemplo, content_topic, generated_content, quality_assessment).

Visualización del flujo de trabajo:

Bucle evaluador-optimizador con resultados en Python: Cada ciclo utiliza la retroalimentación previa para mejorar el contenido. El bucle finalmente produce contenido que cumple con el estándar de calidad:

Cuándo utilizar el flujo de trabajo del optimizador del evaluador: Este flujo de trabajo es especialmente útil cuando existen criterios de evaluación claros y cuando el refinamiento iterativo puede conducir a mejoras significativas en la calidad.

Ejemplos en los que resulta útil el flujo de trabajo evaluador-optimizador:

- Por ejemplo, en una traducción literaria, el primer intento podría pasar por alto ciertos matices lingüísticos o tonos emocionales. El evaluador proporcionaría retroalimentación y solicitaría revisiones hasta que la traducción capture plenamente el significado y las sutilezas del texto original.

- Otro ejemplo se encuentra en la agregación de investigaciones complejas , donde el optimizador recopila y resume la información mientras el evaluador verifica la profundidad, la exhaustividad y la precisión. Si el evaluador considera que la investigación es insuficiente, la devuelve para que se continúe trabajando en ella hasta que el informe final cumpla con todos los requisitos y sintetice eficazmente la información necesaria.

6. Implementación de un agente verdaderamente autónomo

Y, por último, está la implementación del agente verdaderamente autónomo. Este tipo de sistema es conceptualmente sencillo, pero en la práctica puede generar comportamientos muy diversos y complejos.

El agente inicia su funcionamiento con una mínima intervención humana; normalmente, una sola instrucción o un objetivo. Una vez definida la tarea, funciona de forma independiente, realizando acciones y observando sus efectos en el entorno.

Una característica clave de este enfoque es la autoevaluación: el agente debe determinar, a partir de la retroalimentación del entorno, si sus acciones lo acercan al objetivo. Por ejemplo, si ejecuta código o utiliza herramientas externas, debe evaluar si dichas acciones contribuyen al progreso o si se requieren ajustes. Este ciclo basado en la retroalimentación continúa hasta que el agente determina que se ha alcanzado el objetivo o que ya no es posible avanzar más.

Ejemplo del mundo real:

En nuestra evaluación comparativa de herramientas de codificación de IA , observamos que Windsurf y Cursor demostraron capacidades de agente al crear de forma autónoma estructuras de archivos, editar múltiples archivos y ejecutar comandos de terminal para implementar API en Heroku.

Windsurf incluso se adaptó a los cambios recientes de la plataforma, cuando descubrió que el complemento PostgreSQL Hobby Dev estaba obsoleto, reconfiguró correctamente la implementación para usar PostgreSQL Essential 0.

Resumen

La creación de agentes de IA no se trata tanto de lograr una autonomía total, sino más bien de crear sistemas con un propósito definido, transparentes y fiables. A partir de nuestros experimentos en n8n y de las enseñanzas obtenidas de las guías de Anthropic y OpenAI, descubrimos que los agentes eficaces surgen de decisiones de diseño acertadas.

Al implementar agentes, nos centramos en tres principios rectores:

- Mantén la arquitectura simple. Empieza con algo pequeño, construye de forma modular e introduce complejidad solo cuando mejore claramente el rendimiento o la flexibilidad.

- Haz visible el proceso de razonamiento. Permite que usuarios y desarrolladores vean cómo el agente planifica y toma decisiones, mejorando la interpretabilidad y el control.

- Garantizar interacciones fiables entre las herramientas. Diseñar herramientas con un alcance claro, bien documentadas y probadas para que los agentes puedan actuar de forma coherente en entornos reales.

Sé el primero en comentar

Tu dirección de correo electrónico no será publicada. Todos los campos son obligatorios.