Los modelos de visión a gran escala (LVM, por sus siglas en inglés) pueden automatizar y mejorar tareas visuales como la detección de defectos, el diagnóstico médico y la monitorización ambiental .

Comparamos el rendimiento de tres modelos de detección de objetos: YOLOv8n, DETR y GPT-4o Vision, con 1000 imágenes cada uno, midiendo métricas como mAP@0.5, velocidad de inferencia, FLOPs y número de parámetros. Para garantizar una comparación justa, todas las imágenes se redimensionaron a 800 × 800 píxeles y se evaluaron utilizando el mismo preprocesamiento, umbrales de confianza y criterios de coincidencia basados en IoU.

Punto de referencia para la detección de objetos: GPT-4o (Vision), YOLOv8n, DETR

mAP@0.5: Precisión media promedio con un umbral de intersección sobre unión (IoU) de 0,5, que mide la exactitud de la detección de objetos equilibrando los verdaderos positivos y los falsos positivos.

Latencia (ms): El tiempo medio de procesamiento por imagen, medido en milisegundos, indica la velocidad del modelo.

Resultados de referencia

Las capacidades de detección de objetos de GPT-4o siguen siendo limitadas en comparación con modelos especializados como YOLOv8n y DETR .

Exactitud:

- DETR: mAP@0.5 = 0.55

- YOLOv8n: 0.20

- GPT-4o: 0.02

Estos resultados indican que GPT-4o aún no es adecuado para tareas prácticas de detección de objetos.

Estado latente:

- YOLOv8n: 365 ms

- DETR: 3145 ms

- GPT-4o: 5150 ms

YOLOv8n ofrece la inferencia más rápida pero con menor precisión, mientras que DETR logra una mayor precisión a costa de un procesamiento más lento.

Todos los modelos se evaluaron utilizando imágenes de entrada de 800×800 para garantizar la consistencia. Se disponía de recuentos de parámetros y FLOPS para YOLOv8n y DETR, pero no para GPT-4o, lo que impidió una comparación completa de la eficiencia computacional.

Complejidad del modelo:

- DETR: 41,52 millones de parámetros , 59,56 GFLOPS

- YOLOv8n: 3,15 millones de parámetros , 6,83 GFLOPS

Esto demuestra la eficiencia de YOLOv8n para aplicaciones en tiempo real, mientras que DETR sacrifica velocidad a cambio de mayor precisión y mayor demanda computacional. La falta de detalles arquitectónicos para GPT-4o limita un análisis de eficiencia más profundo.

Consulte nuestra metodología de referencia .

Posibles razones detrás de las diferencias en el rendimiento

Los tres modelos mostraron distintos niveles de precisión y velocidad porque están diseñados para diferentes propósitos y procesan la información visual de maneras distintas. GPT-4o es un modelo de lenguaje multimodal de gran tamaño que acepta tanto texto como imágenes, mientras que YOLOv8n y DETR son sistemas de detección de objetos que operan únicamente con imágenes.

GPT-4o interpreta las entradas visuales mediante un proceso de razonamiento basado en el lenguaje. Puede describir escenas e identificar objetos, pero no está diseñado para dibujar cuadros delimitadores ni realizar una localización espacial de alta precisión.

Sus resultados dependen del razonamiento multimodal en lugar de mecanismos específicos de detección. Esto lo hace más lento y menos preciso para las tareas de detección.

YOLOv8n y DETR utilizan arquitecturas creadas específicamente para la detección de objetos. Generan cuadros delimitadores directamente en lugar de razonar sobre ellos.

YOLOv8n está optimizado para la velocidad con una estructura ligera, mientras que DETR es un detector basado en transformadores que procesa las imágenes de manera diferente a YOLO y busca predicciones más precisas.

Ambos modelos se centran exclusivamente en la información visual y siguen objetivos de entrenamiento que asocian patrones de imagen con la ubicación de los objetos.

Las principales diferencias incluyen:

- Tipo de entrada

- GPT-4o: imagen y texto

- YOLOv8n y DETR: solo imagen

- Función principal

- GPT-4o: comprensión y razonamiento multimodal

- YOLOv8n y DETR: detección de objetos

- Mecanismo de salida

- GPT-4o: no dibuja inherentemente cuadros delimitadores

- YOLOv8n y DETR: predicen directamente los cuadros delimitadores.

Dado que YOLOv8n y DETR se desarrollaron exclusivamente para la detección de objetos, es lógico que obtengan mejores resultados en las pruebas comparativas centradas en la precisión y la latencia.

El diseño multimodal amplio y no centrado en la detección de GPT-4o da como resultado un mAP más bajo y tiempos de inferencia más altos cuando se evalúa en el mismo entorno.

Evaluación detallada de modelos de visión de gran tamaño

OpenAI GPT-4o (Visión)

GPT-4o (Vision) es una extensión multimodal de OpenAI, diseñada para procesar y generar respuestas tanto de texto como de imágenes.

Esta capacidad permite a GPT-4o interpretar contenido visual junto con información textual, lo que posibilita una variedad de aplicaciones que requieren comprender y analizar imágenes.

- Interpretación de imágenes: GPT-4o puede analizar y describir el contenido de las imágenes, incluyendo la identificación de objetos, la interpretación de escenas y la extracción de información textual de las imágenes. Esto la hace útil para tareas como la creación de subtítulos para imágenes y la elaboración de resúmenes de contenido.

- Análisis visual de datos: El modelo puede interpretar gráficos, diagramas y esquemas, proporcionando información y explicaciones basadas en datos visuales. Esta función resulta útil para el análisis de datos y aplicaciones educativas.

- Comprensión de contenido multimodal: GPT-4o puede proporcionar respuestas más completas al combinar texto e imágenes. También puede mejorar las aplicaciones de análisis de redes sociales y moderación de contenido. Por ejemplo, puede evaluar el sentimiento o detectar desinformación en publicaciones que incluyen texto e imágenes.

A pesar de sus avanzadas capacidades, GPT-4o a veces puede producir resultados inexactos o poco fiables. Puede malinterpretar elementos visuales, pasar por alto detalles o generar información incorrecta, lo que requiere verificación humana para tareas críticas.

El modelo también puede reflejar sesgos presentes en sus datos de entrenamiento, lo que puede llevar a interpretaciones sesgadas o reforzar estereotipos. Esto resulta preocupante en aplicaciones delicadas donde la imparcialidad es fundamental, como la inferencia demográfica o la moderación de contenido.

OpenAI Sora

Sora es un modelo de conversión de texto a vídeo creado por OpenAI. Genera videoclips cortos a partir de las indicaciones del usuario y también puede extender vídeos ya existentes. Su tecnología subyacente es una adaptación del modelo DALL-E 3.

Sora es un transformador de difusión, un modelo de difusión latente con eliminación de ruido que utiliza un transformador. Los vídeos se generan inicialmente en un espacio latente mediante la eliminación de ruido en "parches" 3D, y luego se convierten al espacio estándar mediante un descompresor de vídeo.

La función de subtitulado se utiliza para mejorar el proceso de entrenamiento, en el que un modelo de vídeo a texto genera subtítulos detallados para los vídeos.

Gracias a las últimas novedades, los usuarios ahora pueden generar vídeos con una resolución de hasta 1080p, una duración máxima de 20 segundos y en formato panorámico, vertical o cuadrado. Además, pueden incorporar sus propios recursos para ampliar, remezclar y combinar contenido existente o crear nuevos vídeos a partir de textos.

Figura 1: Ejemplo de generación de vídeo de Sora utilizando la siguiente consigna: “Una toma amplia y serena de una familia de mamuts lanudos en un desierto abierto”. 1

Aterrizaje IA LandingLens

LandingLens simplifica el desarrollo y la implementación de modelos de visión artificial. Se adapta a diversas industrias sin requerir conocimientos avanzados de IA ni programación compleja.

La plataforma estandariza las soluciones de aprendizaje profundo, reduciendo el tiempo de desarrollo y facilitando la escalabilidad global de los proyectos. Sin afectar la velocidad de producción, los usuarios pueden crear sus propios modelos de aprendizaje profundo y optimizar la precisión de las inspecciones.

Ofrece una interfaz de usuario paso a paso que simplifica el proceso de desarrollo.

Figura 2: El diagrama ilustra el flujo de trabajo de IA de LandingLens, donde las imágenes de entrada se procesan para convertirlas en datos, se utilizan para entrenar modelos, se implementan a través de la nube, el borde o Docker, y se mejoran continuamente mediante la retroalimentación. 2

Difusión estable

Stable Diffusion es un modelo de aprendizaje profundo diseñado para crear imágenes de alta calidad a partir de descripciones textuales:

- La difusión estable se basa en la difusión. El proceso comienza añadiendo ruido aleatorio a una imagen, y el modelo aprende a reconstruir la original invirtiendo este ruido.

- Este proceso permite al modelo generar imágenes completamente nuevas, refinando la entrada ruidosa a lo largo de múltiples pasos hasta que emerge una imagen clara y coherente.

Stable Diffusion utiliza un modelo de difusión latente para mejorar la eficiencia. En lugar de trabajar directamente con imágenes de alta resolución, primero las comprime en un espacio latente de menor dimensión mediante un autoencoder variacional (VAE).

Este enfoque reduce significativamente las exigencias computacionales, lo que permite su ejecución en hardware de consumo con GPU.

Aplicaciones:

Además de generar imágenes a partir de texto, Stable Diffusion se puede utilizar para diversas tareas creativas, como por ejemplo:

- Relleno de imágenes: Restaurar o completar las partes que faltan en una imagen.

- Outpainting: Expandir los bordes de una imagen para agregar más contenido.

- Traducción de imagen a imagen: Convertir una imagen existente a un estilo diferente o modificar su apariencia en función del texto introducido.

A mitad de camino

Midjourney es un generador de arte que convierte descripciones de texto en imágenes de alta calidad.

Capacidades

La versión 7 de Midjourney presenta una arquitectura completamente reconstruida con mejoras significativas en calidad y funcionalidad.

Generación de imágenes : V7 produce imágenes ampliadas a 2048 x 2048 píxeles con una precisión excepcional y una calidad casi fotográfica. Entre las mejoras clave se incluyen texturas más ricas, una representación precisa de elementos complejos como manos y rostros, y una comprensión sofisticada de la iluminación y la composición.

Generación de vídeo : Crea videoclips de 5 a 21 segundos con gran precisión fotograma a fotograma. El sistema genera aproximadamente 60 segundos de vídeo a partir de seis imágenes en unas tres horas, y está dirigido a aplicaciones profesionales en marketing, producción cinematográfica y creación de contenido.

Capacidades 3D : La generación de texto a 3D mediante modelado tipo NeRF crea objetos volumétricos y escenas inmersivas. Estas funciones son útiles para el desarrollo de videojuegos, la visualización de productos y aplicaciones arquitectónicas.

Figura 3: Función de edición de imágenes de Midjourney. 3

DeepMind Flamingo

Flamingo de DeepMind es un modelo de lenguaje visual diseñado para comprender y razonar sobre imágenes y videos utilizando un mínimo de ejemplos de entrenamiento (aprendizaje con pocos ejemplos). Estas son algunas de sus características clave:

- Aprendizaje multimodal con pocos ejemplos: Flamingo puede realizar nuevas tareas de manera eficiente con solo unos pocos ejemplos, a diferencia de los modelos de IA tradicionales que requieren conjuntos de datos etiquetados extensos.

- Mecanismo de remuestreo del perceptor: Flamingo utiliza un "remuestreador del perceptor" para procesar las entradas visuales de manera eficiente. Comprime los datos de imagen y video en un formato que puede integrarse en un modelo de lenguaje preentrenado de gran tamaño.

- Alineación visión-lenguaje con capas de atención cruzada controlada: Las capas especiales de atención cruzada controlada ayudan a Flamingo a alinear e integrar datos visuales con razonamiento textual. Esta aplicación puede ser importante para comprender conversaciones basadas en imágenes.

Flamingo utiliza el procesamiento fotograma a fotograma, dividiendo los vídeos en fotogramas clave y extrayendo información para analizar de forma eficiente los elementos visuales.

Sus respuestas contextuales ayudan a generar subtítulos, descripciones y respuestas basadas en la progresión de los eventos dentro de un video para garantizar una comprensión coherente del contenido.

Además, Flamingo demuestra capacidad de razonamiento temporal para comprender secuencias, relaciones de causa y efecto e interacciones complejas a lo largo del tiempo. Esto lo hace altamente eficaz para el análisis de vídeo y las tareas de razonamiento multimodal.

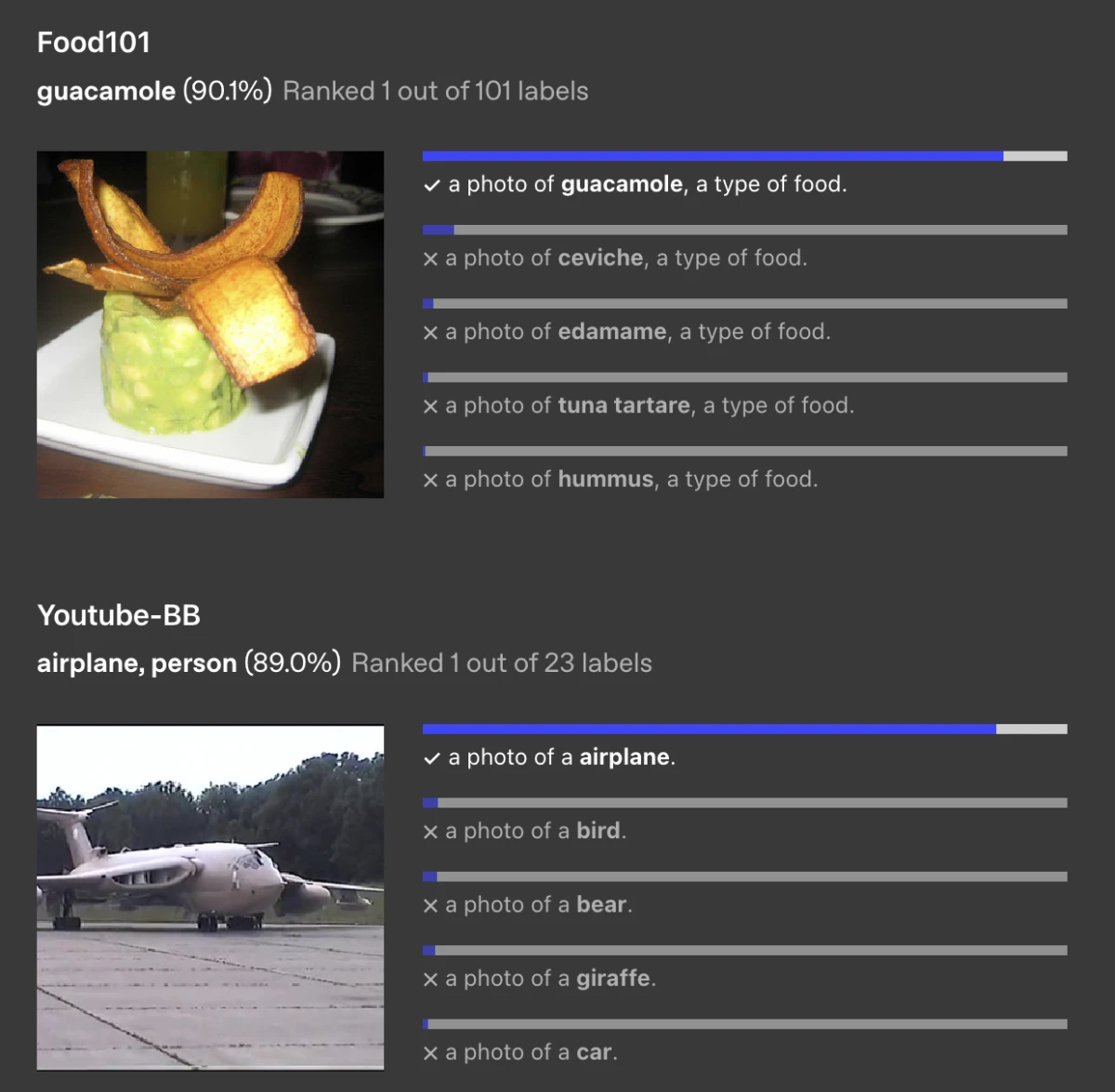

CLIP (Preentrenamiento de lenguaje contrastivo e imágenes) de OpenAI

CLIP es una red neuronal entrenada con una variedad de imágenes y subtítulos de texto.

Este modelo puede realizar diversas tareas de visión, incluida la clasificación sin ejemplos previos, al comprender las imágenes en el contexto del lenguaje natural.

CLIP se entrena con 400 millones de pares (imagen, texto) para salvar eficazmente la brecha entre las tareas de visión artificial y el procesamiento del lenguaje natural. Esto permite a CLIP realizar predicciones de subtítulos o resúmenes de imágenes sin necesidad de un entrenamiento específico para estas tareas.

Figura 4: Identificación de imágenes mediante CLIP a partir de varios conjuntos de datos. 4

Transformador de Visión (ViT) de Google

Vision Transformer aplica la arquitectura Transformer, utilizada originalmente en el procesamiento del lenguaje natural, a las tareas de reconocimiento de imágenes .

Procesa imágenes de forma similar a como los transformadores procesan secuencias de palabras, y ha demostrado su eficacia a la hora de aprender características relevantes de los datos de imagen para tareas de clasificación y análisis.

En Vision Transformer, las imágenes se tratan como una secuencia de parches. Cada parche se convierte en un único vector, de forma similar a como se utilizan las incrustaciones de palabras en los transformadores de texto.

Este enfoque permite a ViT aprender la estructura de la imagen y predecir de forma independiente las etiquetas de clase.

Modelos de base nativos de vídeo

Los modelos de base nativos de vídeo representan un cambio fundamental con respecto a los enfoques tradicionales de visión artificial. A diferencia de los sistemas anteriores, que procesaban los vídeos como secuencias de fotogramas independientes, estos modelos tratan el tiempo como una dimensión integral de los datos visuales.

Innovaciones arquitectónicas clave

El Sora de OpenAI ejemplifica esta evolución a través de su arquitectura de transformador de difusión:

- Parches espaciotemporales 3D : Procesa los datos de vídeo de forma holística en lugar de fotograma a fotograma.

- Consistencia temporal : Mantiene la calidad visual y la coherencia narrativa a lo largo de las secuencias.

- Dependencias de largo alcance : Captura relaciones de causa y efecto y patrones de movimiento.

- Generación con conciencia física : comprende el movimiento realista y las interacciones entre objetos.

Aplicaciones actuales

Creación de contenido:

- Edición de vídeo automatizada y síntesis de escenas.

- Transferencia de estilo con consistencia temporal

- Generación de vídeos narrativos a partir de indicaciones de texto.

Imágenes médicas:

- Análisis del movimiento cardíaco en ecocardiogramas

- Visualización del flujo sanguíneo en angiografía

- Evaluación dinámica del comportamiento tisular

Seguridad y vigilancia:

- Reconocimiento y seguimiento de la actividad

- Detección de Anomaly a lo largo del tiempo

- Análisis de comportamiento sensible al contexto

Desafíos restantes

A pesar de los avances, persisten varias limitaciones:

- Coste computacional : La generación de vídeos de larga duración sigue requiriendo muchos recursos.

- Plausibilidad física : Los escenarios complejos pueden producir una física poco realista.

- Consistencia de los caracteres : Mantener la identidad a lo largo de secuencias extensas es difícil.

- Requisitos de capacitación : Los conjuntos de datos de video a gran escala con anotaciones son escasos y costosos.

Inferencia en el dispositivo y optimización en el borde

La implementación en el borde de la red permite que los modelos de visión se ejecuten localmente en teléfonos inteligentes, dispositivos IoT y sistemas integrados, eliminando la dependencia de la infraestructura en la nube.

Por qué es importante la implementación en el borde.

Beneficios en materia de privacidad:

- Los datos visuales confidenciales nunca salen del dispositivo.

- Fundamental para la atención médica, la vigilancia y las aplicaciones personales.

- Cumplimiento de la normativa de protección de datos

Ventajas de rendimiento:

- Latencia casi nula sin viajes de ida y vuelta a la red.

- Procesamiento en tiempo real para sistemas de realidad aumentada y autónomos.

- Funcionamiento fiable en entornos sin conexión.

Eficiencia de costos:

- Consumo de ancho de banda reducido

- Menores gastos en computación en la nube

- Costes operativos mínimos y continuos

Técnicas de compresión de modelos

Para que los modelos de visión de gran tamaño sean viables en dispositivos periféricos se requiere una optimización sofisticada:

- Cuantización : Reduce la precisión de 32 bits a enteros de 8 o 4 bits.

- Tamaño del modelo más pequeño

- Pérdida mínima de precisión

- Poda : Elimina parámetros y conexiones redundantes.

- Crea redes dispersas

- Mantiene el rendimiento con menos cálculos.

- Destilación del conocimiento : Transfiere el conocimiento de modelos grandes a modelos pequeños.

¿Qué es un modelo de visión a gran escala (LVM)?

Los modelos de visión a gran escala (LVM, por sus siglas en inglés) están diseñados para procesar, analizar e interpretar datos visuales, como imágenes o vídeos. Se caracterizan por su gran cantidad de parámetros, a menudo millones o miles de millones. Esto les permite aprender patrones, características y relaciones complejas en el contenido visual.

Al igual que los modelos de lenguaje a gran escala (LLM, por sus siglas en inglés) para texto, los modelos de lenguaje a gran escala (LVM, por sus siglas en inglés) se entrenan con conjuntos de datos enormes, lo que les proporciona capacidades de reconocimiento de objetos, generación de imágenes, comprensión de escenas y razonamiento multimodal (que integra información visual y textual).

Estos modelos pueden dar soporte a aplicaciones en áreas como la conducción autónoma, las imágenes médicas , la creación de contenido y la realidad aumentada .

Estructura y diseño

Los modelos de visión a gran escala se construyen utilizando arquitecturas de redes neuronales avanzadas. Originalmente, las redes neuronales convolucionales (CNN) predominaban en el procesamiento de imágenes debido a su capacidad para manejar eficientemente los datos de píxeles y detectar patrones jerárquicos.

Recientemente, los modelos Transformer, que fueron diseñados inicialmente para el procesamiento del lenguaje natural , también se han adaptado a muchas tareas de visión diferentes, ofreciendo un rendimiento mejorado en algunos escenarios.

Capacitación

El entrenamiento de modelos de visión complejos implica alimentarlos con datos visuales, como imágenes o vídeos de internet, junto con etiquetas o anotaciones relevantes, mediante un novedoso enfoque de modelado secuencial. Los entrenadores etiquetan las bibliotecas de imágenes para alimentar los modelos.

Por ejemplo, en las tareas de clasificación de imágenes , cada imagen se etiqueta con la clase a la que pertenece. El modelo aprende ajustando sus parámetros para minimizar la diferencia entre sus predicciones y las etiquetas reales.

Este proceso requiere una importante capacidad de cálculo y un conjunto de datos amplio y diverso para garantizar que el modelo pueda generalizarse bien a datos nuevos y desconocidos.

Figura 3: Diagrama de entrenamiento de modelos de visión grandes en OpenAI. 5

Consulta los servicios de recopilación de datos de imágenes para obtener más información sobre los datos de entrenamiento para la clasificación de imágenes.

Características clave de los modelos de visión amplia

El tipo de modelo se refiere a la arquitectura y los principios de diseño de un modelo de visión. Define cómo el modelo procesa e interpreta los datos visuales, si integra múltiples modalidades (por ejemplo, texto e imágenes) y qué mecanismos subyacentes (por ejemplo, transformadores, aprendizaje contrastivo, difusión) emplea para extraer representaciones significativas:

- LLM multimodal basado en transformadores: una arquitectura de modelo que combina transformadores con capacidades multimodales. Permite comprender simultáneamente entradas visuales y textuales. Se entrena con conjuntos de datos a gran escala para realizar razonamientos complejos en múltiples tipos de datos.

- Aprendizaje contrastivo: Técnica utilizada en el entrenamiento de modelos para diferenciar entre datos similares y disímiles. Este proceso consiste en maximizar la similitud entre entradas relacionadas y minimizar la similitud entre entradas no relacionadas. Se utiliza frecuentemente en el aprendizaje autosupervisado para mejorar la representación de características.

- Plataforma de visión artificial: Este sistema proporciona infraestructura, herramientas y modelos preentrenados para diversas tareas de visión artificial, como el reconocimiento de imágenes , la detección de objetos y la segmentación. Generalmente incluye capacidades de entrenamiento, implementación e inferencia de modelos.

- Transformer: Una arquitectura de aprendizaje profundo que utiliza mecanismos de autoatención para procesar los datos de entrada. Permite a los modelos capturar dependencias de largo alcance, lo que la hace eficaz para tareas relacionadas con el lenguaje natural y la visión.

- Modelo de difusión: Un modelo generativo que elimina gradualmente el ruido de una entrada inicial ruidosa y la refina paso a paso para producir una salida clara y estructurada. Se utiliza comúnmente para la generación y mejora de imágenes .

Objetivo de entrenamiento: La función de optimización o meta que guía el aprendizaje de un modelo a partir de los datos. Determina cómo el modelo ajusta sus parámetros internos durante el entrenamiento para mejorar su rendimiento en tareas específicas. Estas tareas son: predecir el siguiente dato (autorregresivo), distinguir entradas similares/diferentes (aprendizaje contrastivo) o clasificar imágenes en categorías.

- Autorregresivo: Un método de entrenamiento en el que un modelo predice el siguiente dato en una secuencia basándose en entradas observadas previamente. Se utiliza con frecuencia en el modelado del lenguaje y en modelos de visión generativa.

- Aprendizaje contrastivo: Un objetivo de aprendizaje autosupervisado en el que el modelo aprende distinguiendo entre pares de datos similares y diferentes. Ayuda a mejorar la capacidad de capturar representaciones significativas sin etiquetas explícitas.

- Aprendizaje supervisado: Un paradigma de aprendizaje en el que el modelo se entrena utilizando datos etiquetados, lo que significa que cada entrada se asocia con una salida correcta correspondiente. Este enfoque se utiliza ampliamente en tareas como la clasificación y la segmentación.

- Clasificación de imágenes: Un objetivo de entrenamiento específico en el que un modelo aprende a categorizar imágenes en clases predefinidas basándose en características visuales. El proceso de entrenamiento implica optimizar una función de pérdida para maximizar la precisión de la clasificación.

- Difusión de eliminación de ruido: Un enfoque de aprendizaje generativo donde se entrena un modelo para recuperar imágenes nítidas a partir de entradas ruidosas. Este proceso implica revertir un proceso progresivo de adición de ruido para mejorar la reconstrucción y generación de imágenes.

Soporte para el ajuste fino: La capacidad de un modelo para adaptarse a tareas específicas mediante el entrenamiento con conjuntos de datos más pequeños y específicos del dominio, conservando al mismo tiempo el conocimiento de su fase de preentrenamiento.

El ajuste fino ayuda a mejorar el rendimiento en aplicaciones especializadas.

Aprendizaje con pocos o ningún ejemplo: La capacidad de un modelo para realizar tareas con pocos o ningún dato de entrenamiento específico para la tarea.

El aprendizaje de cero ejemplos permite realizar inferencias sobre categorías no vistas, mientras que el aprendizaje con pocos ejemplos permite la adaptación con un mínimo de ejemplos etiquetados.

Soporte multimodal: La capacidad de un modelo para procesar e integrar información de múltiples modalidades (por ejemplo, texto, imágenes, audio).

Código abierto frente a propietario: Los modelos de código abierto tienen código y ponderaciones disponibles públicamente, lo que permite su modificación e implementación por parte de la comunidad,

Los modelos propietarios son propiedad de entidades privadas y están controlados por ellas, lo que puede limitar el acceso y la personalización.

Implementación en el borde: La capacidad de un modelo para ejecutarse en dispositivos periféricos (por ejemplo, teléfonos móviles, dispositivos IoT) en lugar de depender de servidores basados en la nube.

El despliegue en el borde de la red ayuda a reducir la latencia, mejora la privacidad y permite el procesamiento en tiempo real en entornos con recursos limitados.

¿Cuáles son los casos de uso de los modelos de visión a gran escala?

Atención sanitaria e imagenología médica

- Diagnóstico de enfermedades : Detección de enfermedades a partir de imágenes médicas como radiografías, resonancias magnéticas o tomografías computarizadas para identificar tumores, fracturas o anomalías.

- Patología : Análisis de muestras de tejido en patología para detectar signos de cáncer.

- Oftalmología : Diagnóstico de enfermedades a partir de imágenes de la retina.

Vehículos autónomos y robótica

- Navegación y detección de obstáculos : Ayuda a los vehículos autónomos y a los drones a navegar y evitar obstáculos mediante la interpretación de datos visuales en tiempo real.

- Robótica en la fabricación : Ayudando a los robots en las tareas de clasificación, ensamblaje e inspección de calidad.

Seguridad y vigilancia

- Monitorización de la actividad : Análisis de las grabaciones de vídeo para detectar comportamientos inusuales o sospechosos.

- Reconocimiento facial : Se utiliza en sistemas de seguridad para la verificación y el seguimiento de la identidad. Por ejemplo, Amazon Rekognition es un servicio en la nube ofrecido por AWS que proporciona funciones de análisis de imágenes y vídeo, como detección y reconocimiento facial, identificación de objetos y escenas, y extracción de texto. Puede analizar emociones, rangos de edad y actividades, lo que resulta útil para la personalización y la seguridad.

Vea el siguiente vídeo para ver Amazon Rekognition en acción. 6

Comercio minorista y comercio electrónico

- Búsqueda visual : Permite a los clientes buscar productos utilizando imágenes en lugar de texto.

- Gestión de inventario : Automatización del seguimiento y la gestión del inventario mediante reconocimiento visual.

Agricultura

- Seguimiento y análisis de cultivos : Monitoreo de la salud y el crecimiento de los cultivos mediante imágenes de drones o satélites.

- Detección de plagas : Identificación de plagas y enfermedades que afectan a los cultivos.

Monitoreo ambiental

- Seguimiento de la fauna silvestre : Identificación y seguimiento de la fauna silvestre para apoyar los esfuerzos de conservación.

- Análisis del uso y la cobertura del suelo : Seguimiento de los cambios en el uso del suelo y la cobertura vegetal a lo largo del tiempo.

Creación de contenido y entretenimiento

- Edición de cine y vídeo : Automatización de los procesos de edición y postproducción de vídeo.

- Desarrollo de videojuegos : Mejora del realismo en la creación de entornos y personajes.

- Mejora de fotos y vídeos : Mejora de la calidad de imágenes y vídeos.

- Moderación de contenido : Detección y marcado automático de contenido visual inapropiado o dañino.

¿Cuáles son los desafíos de los modelos de visión a gran escala?

Recursos computacionales

El entrenamiento y la implementación de estos modelos requieren una importante capacidad de procesamiento y memoria, lo que puede convertirlos en procesos que consumen muchos recursos.

Requisitos de datos

Necesitan conjuntos de datos vastos y diversos para el entrenamiento. Recopilar, etiquetar y procesar conjuntos de datos tan grandes puede ser un desafío y resultar costoso. Sin embargo, las empresas de crowdsourcing pueden ayudar a gestionar esto .

Prejuicios y equidad

Los modelos pueden heredar sesgos presentes en sus datos de entrenamiento, lo que puede dar lugar a resultados injustos o poco éticos, especialmente en aplicaciones delicadas como el reconocimiento facial.

Interpretabilidad y explicabilidad

Comprender cómo estos modelos toman decisiones puede resultar complejo, lo cual es relevante en aplicaciones donde la transparencia es fundamental. Consulta la IA explicable para aprender cómo funciona este proceso y cómo contribuye a la ética de la IA.

Generalización

Si bien obtienen buenos resultados con datos similares a su conjunto de entrenamiento, pueden tener dificultades con tipos de datos completamente nuevos o diferentes.

preocupaciones sobre la privacidad

El uso de modelos visuales de gran tamaño, especialmente en la vigilancia y el reconocimiento facial, plantea importantes problemas de privacidad .

Desafíos regulatorios y éticos

Garantizar que estos modelos cumplan con las normas legales y éticas es cada vez más importante, sobre todo a medida que se integran más en la sociedad.

Metodología de referencia para la detección de objetos

En esta prueba comparativa, se comparó el rendimiento de los modelos de detección de objetos YOLOv8n, DETR (DEtection TRansformer) y GPT-4o Vision en el conjunto de datos de validación COCO 2017. Se utilizaron 1000 imágenes por modelo para la comparación. Todas las imágenes se redimensionaron a 800 × 800 píxeles para garantizar dimensiones de entrada consistentes entre los modelos.

El modelo YOLOv8n se cargó con pesos preentrenados (yolov8n.pt) del repositorio Ultralytics y la inferencia se realizó mediante el método predict() a través de la API YOLO de Ultralytics. El modelo DETR se cargó con la arquitectura detr_resnet50 de la biblioteca de investigación de Facebook, y sus salidas, originalmente normalizadas en formato [center_x, center_y, width, height], se reescalaron y convirtieron al formato de coordenadas [x1, y1, x2, y2]. Se aplicó un umbral de confianza de 0,5 a los resultados de ambos modelos.

El modelo GPT-4o Vision se evaluó utilizando la API de OpenAI para la detección de objetos. Para este modelo, se descargaron imágenes del conjunto de datos de validación COCO, se cargaron las anotaciones y cada imagen se convirtió al formato apropiado (redimensionada a 800 × 800 píxeles) antes de enviarla a la API. Solo se solicitaron detecciones pertenecientes a las clases COCO en formato JSON, y las predicciones devueltas por la API se evaluaron utilizando el mismo umbral de confianza (0,5) y formato de coordenadas.

En la evaluación, los cuadros delimitadores predichos por los modelos se compararon con los cuadros reales mediante el cálculo de la Intersección sobre Unión (IoU), considerando un valor de IoU ≥ 0,5 como una coincidencia positiva verdadera. Se calculó la Precisión Media (AP) para cada clase, y la media de todas las clases se reportó como la métrica mAP@0,5. Además de la precisión, se midieron y compararon los tiempos de inferencia. Adicionalmente, se analizó la complejidad del modelo en función de las operaciones de punto flotante (FLOPs) y el número total de parámetros.

Para garantizar una comparación justa, todas las inferencias de los modelos se realizaron en el mismo hardware (GPU/CPU idéntica). Se aplicaron los mismos pasos de preprocesamiento a todos los modelos: redimensionar todas las imágenes a 800 × 800 píxeles y aplicar la normalización necesaria. Para el posprocesamiento, las predicciones se convirtieron al mismo formato de coordenadas, se aplicó sistemáticamente un umbral de confianza de 0,5 y se adoptaron criterios uniformes para el cálculo de la IoU durante la evaluación.

Dentro de este marco, se compararon los modelos YOLOv8n, DETR y GPT-4o Vision en términos de rendimiento y velocidad de detección de objetos; se emplearon ajustes y métodos adicionales para comparar las capacidades de GPT-4o Vision con los modelos de detección de objetos actuales.

Conclusión

Los modelos de visión a gran escala (LVM, por sus siglas en inglés) están cambiando la forma en que las máquinas interpretan y actúan sobre los datos visuales en diversos ámbitos, como la atención médica, los sistemas autónomos, la seguridad y las industrias creativas.

Mediante el uso de arquitecturas avanzadas, como transformadores y modelos de difusión, las máquinas virtuales lógicas (LVM) admiten una amplia gama de tareas complejas, que incluyen imágenes médicas, detección de objetos en tiempo real, generación de texto a imagen y generación de vídeo.

Su capacidad para aprender de conjuntos de datos vastos y multimodales permite escenarios de implementación flexibles, que van desde la inferencia basada en la nube hasta la computación perimetral, lo que posibilita aplicaciones personalizadas que abarcan desde la inspección industrial hasta la creación de contenido personalizado.

Sin embargo, estas capacidades conllevan importantes desafíos. El coste computacional del entrenamiento y la implementación de LVM sigue siendo elevado, y a menudo requiere hardware potente e infraestructura especializada.

Problemas como el sesgo de los datos, la limitada interpretabilidad y las preocupaciones éticas en torno a la vigilancia y la privacidad subrayan la necesidad de una gobernanza rigurosa de los modelos. A medida que los modelos de valor lógico (MV) sigan evolucionando, lograr un equilibrio entre innovación y responsabilidad será crucial para garantizar su uso eficaz y equitativo en diversos sectores.

Sé el primero en comentar

Tu dirección de correo electrónico no será publicada. Todos los campos son obligatorios.