Wir haben 3 Tage lang mit Workflows und Agentenpipelines in n8n experimentiert und dabei die Anleitungen von Anthropic und OpenAI zum Erstellen effektiver KI-Agenten befolgt. 1 2

Erkunden Sie die Kernkomponenten von KI-Agenten , wie Sie die richtigen Komponenten und Werkzeuge auswählen und wie Sie Agenten-Workflows auf der Grundlage der einfachen, zusammensetzbaren Muster von Anthropic wie Prompt Chaining, Routing, Parallelisierung, Orchestrator Worker und eines Evaluator-Optimizers erstellen:

Komponenten von KI-Agenten verstehen

Die Entwicklung von Agenten erfordert die Verknüpfung von Komponenten aus verschiedenen Bereichen wie Modellen, Werkzeugen, Wissen und Speicher sowie Schutzmechanismen. OpenAI stellt für jeden dieser Bereiche zusammensetzbare Grundelemente bereit:

Quelle: OpenAI 3

Natürlich listet OpenAI dort seine eigenen Produkte zuerst auf, aber es gibt ein breites Spektrum an Alternativen. Je nach Anwendungsfall können Sie Agenten mithilfe von Frameworks wie LangChain, LlamaIndex, CrewAI oder sogar selbst entwickelten Orchestrierungsschichten erstellen .

Ich werde auf jede dieser Komponenten genauer eingehen:

Modelle

Zunächst gibt es die Modellkomponente. Dies sind Ihre KI-Modelle, Ihre großen Sprachmodelle, die den Kern der Intelligenz bilden und zum logischen Denken, Treffen von Entscheidungen und Verarbeiten verschiedener Modalitäten fähig sind. Die von OpenAI genannten Beispiele sind natürlich GPT-5 usw.

Je nachdem, welchen Agententyp Sie entwickeln, sollten Sie innerhalb des OpenAI-Ökosystems ein anderes Modell wählen.

GPT-5 ist Ihr Vorzeigemodell. Es handelt sich um ein Denkmodell, das sich durch starke Argumentationsfähigkeiten, die Fähigkeit zur mehrstufigen Problemlösung und seine besondere Effektivität bei der Beantwortung der meisten Fragen auszeichnet.

Außerhalb des OpenAI-Ökosystems ist Claude 4.5 Sonnet normalerweise das bevorzugte Modell für Menschen, die viel programmieren, logisches Denken betreiben und Aufgaben im MINT-Bereich erledigen, obwohl Gemini 2.5 Pro dies derzeit in Frage stellt.

Allerdings behauptet OpenAI, dass der GPT-5.2-Codex das fortschrittlichste Codierungsmodell für Entwickler zur Lösung komplexer, realer Softwareentwicklungsprobleme darstellt. Der OpenAI-Codex GPT-5.2 zeigt vergleichbare Ergebnisse bei Codierungs-Benchmarks wie TerminalBench und SWE-bench. 4

Wir haben die führenden KI-Modelle verglichen und ihnen Benchmarks gegeben, um Ihnen zu helfen, die Leistung der einzelnen Modelle in Bezug auf logisches Denken, Geschwindigkeit und Kosten zu verstehen, damit Sie dasjenige auswählen können, das am besten zu Ihren Zielen passt.

Werkzeuge

Als nächstes kommen die Werkzeuge, die die Fähigkeiten des Modells erweitern, wie z. B. die Möglichkeit, im Web zu suchen oder mit anderen Systemen zu interagieren.

Nahezu jede App kann zu einem Werkzeug für Ihre KI werden. Sie können sie mit Gmail, Kalender, Ihrem Google Drive oder Apps wie Slack, Discord, YouTube und Zapier verbinden. Sie können sogar Ihre eigenen, benutzerdefinierten Tools erstellen.

Mit dem Agents SDK von OpenAI (das einige Programmierkenntnisse erfordert) können Sie Tools definieren oder integrierte Tools wie Websuche, Dateisuche und Computernutzung verwenden. 5

Das Model Context Protocol (MCP) von Anthropic vereinfacht zudem die Tool-Integration durch die Standardisierung des Modellzugriffs. Im Jahr 2026 wird der Geschäftswert zunehmend aus „digitalen Fließbändern“ generiert – von Menschen gesteuerten, mehrstufigen Arbeitsabläufen, in denen mehrere Agenten durchgängige Prozesse ausführen, ermöglicht durch das Model Context Protocol (MCP).

Wenn Sie sich nicht mit Programmierung auskennen, ermöglichen IhnenNo-Code-Plattformen wie n8n, Tools per Drag & Drop mit Ihrem Modell zu verknüpfen.

Wissen und Gedächtnis

Es gibt zwei Haupttypen von Speicher: Wissensbasis (statischer Speicher) und persistenter Speicher .

- Die Wissensdatenbank ermöglicht Ihrer KI den Zugriff auf statische Fakten, Richtlinien und Dokumente, die sich kaum verändern. Dies ist unerlässlich für Agenten, die richtlinienbasierte oder unternehmensspezifische Aufgaben ausführen, bei denen die Referenzmaterialien konsistent bleiben müssen.

- Der persistente Speicher ermöglicht es der KI, sich an vergangene Interaktionen über mehrere Sitzungen hinweg zu erinnern. Dies ist entscheidend für Chatbots oder persönliche Assistenten, die sich an frühere Gespräche erinnern müssen.

OpenAI bietet gehostete Dienste wie Vektorspeicher , Dateisuche und Einbettungen zur Speicherverwaltung.

Wenn Sie Open-Source-Lösungen bevorzugen, sind Pinecone (Cloud-nativ und für die Vektorsuche optimiert) und Weaviate beliebte Optionen.

Bei Nutzern von No-Code-Tools ist die Speicherverwaltung üblicherweise in Plattformen wie n8n und Creatio integriert.

Weitere Informationen finden Sie unter: Entwicklung eines KI-Forschungsagenten mit Speicher

Leitplanken

Leitplanken stellen sicher, dass sich Ihr Agent wie vorgesehen verhält und irrelevante, schädliche oder unangemessene Antworten vermeidet. Beispielsweise sollte sich ein Kundenservice-Bot auf servicebezogene Themen konzentrieren und nicht in themenfremde Bereiche abschweifen.

Außerhalb des Ökosystems von OpenAI sind Guardrails AI und LangChain Guardrails beliebte Tools. Viele No-Code-Plattformen verfügen bereits über integrierte Schutzfunktionen, dennoch ist es wichtig zu verstehen, wie diese funktionieren, um die Kontrolle und Compliance Ihrer Agenten zu gewährleisten.

Orchestrierung

Die letzte Komponente ist die Orchestrierung. Diese umfasst die Steuerung des Zusammenspiels mehrerer Subagenten, deren Bereitstellung in der Produktionsumgebung und die Überwachung ihrer Leistung.

Nach dem Einsatz benötigen die Agenten eine kontinuierliche Überwachung. Modelle, Daten und Verhaltensweisen ändern sich, daher sind kontinuierliche Aktualisierungen und Verbesserungen von entscheidender Bedeutung.

Mehrere Plattformen/Frameworks unterstützen die Orchestrierung, wie zum Beispiel:

- Low-Code-/No-Code-Plattformen :

- Stack AI

- Microsoft Copilot Studio Agent Builder

- Relevanz-KI usw.

- Open-Source-Frameworks :

- Crew AI, entwickelt für Multiagentensysteme

- LangChain wird häufig zur Verwaltung und Bereitstellung von Agenteninteraktionen verwendet.

- LlamaIndex eignet sich besonders gut für dokumentenintensive Agenten und Wissensdatenbankanwendungen.

Bausteine der Automatisierung: Workflows vs. Agenten

Ein KI-Agent ist ein System, das seine Umgebung wahrnimmt, Informationen verarbeitet und autonom Maßnahmen ergreift, um bestimmte Ziele zu erreichen. Beispiele hierfür sind Codierungsagenten wie Cursor oder KI-gestützte Code-Editoren mit „Agentenmodi“, die Codierungsaufgaben mithilfe von Modellen wie Claude Sonnet 4.5 autonom ausführen können. Ein weiteres gängiges Beispiel sind Kundendienstagenten , die in vielen Unternehmen zur Bearbeitung von Anfragen eingesetzt werden.

Es gibt viele verschiedene Möglichkeiten, diese Agenten zu entwerfen und einzusetzen, abhängig von der Komplexität des Arbeitsablaufs und dem erforderlichen Grad an Autonomie.

Kurz gesagt, besteht ein KI-Agent oft aus einer Sammlung von Subagenten, von denen jeder spezifische Aufgaben erfüllt. Gemeinsam koordinieren sich diese Subagenten in Multiagentensystemen, um das zu erzeugen, was wir als einen einzigen KI-Agenten wahrnehmen.

Diese unterscheiden sich grundlegend von Arbeitsabläufen. Arbeitsabläufe sind orchestrierte Abfolgen vordefinierter Schritte, vergleichbar mit einem Rezept, das immer der gleichen Reihenfolge folgt:

Wann sollte man KI-Agenten einsetzen?

Bevor wir uns mit Beispielen für die Workflow-Implementierung zur Entwicklung von KI-Agenten befassen, ist ein kurzer Realitätscheck angebracht. KI-Agenten sind keine starren Frameworks. Viele Teams stellen nach wie vor fest, dass traditionelle Workflows gut funktionieren, selbst in Szenarien, in denen Agenten theoretisch eingesetzt werden könnten.

Eine der anschaulichsten Möglichkeiten, sich das vorzustellen, wird im Blog von Anthropic wie folgt beschrieben:

Allerdings gibt es durchaus Situationen, in denen Agenten bei Aufgaben, die Flexibilität, logisches Denken und Anpassungsfähigkeit erfordern, traditionelle Arbeitsabläufe übertreffen:

Dynamische Gespräche, die Anpassungen erfordern :

Manche Interaktionen, wie einfache Rückerstattungs- oder Passwortzurücksetzungsanfragen, lassen sich problemlos in Arbeitsabläufe integrieren. Andere erfordern jedoch differenzierte Beurteilungen oder kontextsensitive Entscheidungen, wie beispielsweise personalisierte Empfehlungen, die stark vom Kontext und einem iterativen Abwägen abhängen.

Hochwertige Entscheidungsfindung bei geringem Volumen:

Der Betrieb von Agenten kann teuer sein, aber in manchen Fällen sind die Entscheidungen, die sie unterstützen, weitaus kostspieliger, wenn sie falsch getroffen werden.

BCG berichtete beispielsweise, dass ein führender Energieversorger in Deutschland ein GenAI-gesteuertes Agententool zur Automatisierung von Zahlungsprüfungen einsetzte. 6

Bei der Planung groß angelegter Infrastrukturprojekte, wie beispielsweise der Optimierung von Konstruktionsentwürfen, sind die Rechenkosten vernachlässigbar. In solchen kritischen Fällen schaffen Agenten einen Mehrwert, da die Kosten eines Fehlers die Kosten für die Modellausführung bei Weitem übersteigen.

Mehrstufige, unvorhersehbare Arbeitsabläufe:

Manche Arbeitsabläufe sind zu komplex, sodass das Schreiben endloser „Wenn dies, dann das“-Regeln zu einem eigenen Projekt wird.

In solchen Fällen vereinfachen agentenbasierte Schleifen das Chaos. Anstatt jeden möglichen Pfad fest zu kodieren, entscheidet das Modell dynamisch über den nächsten Schritt auf Basis des Echtzeitkontexts und entsprechender Schlussfolgerungen.

Dieser Ansatz eignet sich gut für Diagnosesysteme oder -werkzeuge, die mit Dutzenden von sich ändernden Variablen arbeiten.

Wenn Arbeitsabläufe besser sind

Szenarien mit hoher Frequenz und geringer Komplexität :

Manche Aufgaben hängen mehr von Geschwindigkeit und Umfang als von logischem Denken ab, zum Beispiel:

- Abrufen von Informationen aus einer Datenbank

- Strukturierte Nachrichten oder E-Mails analysieren

- Beantwortung von häufig gestellten Fragen

Ein Workflow könnte Tausende dieser Anfragen verarbeiten, und zwar mit besser vorhersehbaren Kosten und Latenzzeiten als ein einzelner Agent.

Einführung in Arbeitsabläufe und Implementierungen von KI-Agenten

Nachdem wir die Arbeitsabläufe und die Komponenten von KI-Agenten besprochen haben, wenden wir uns nun der praktischen Implementierung zu. Wie bereits erwähnt, sind KI-Agenten in der Regel keine einzelnen Einheiten, sondern bestehen aus verschiedenen Subagenten, die miteinander interagieren. Eine der besten Ressourcen zu gängigen Arbeitsabläufen und Agentensystemen ist der Leitfaden „Building Effective Agents“ von Anthropic. 7 Lasst es uns aufschlüsseln.

Kernstück agentenbasierter Systeme ist das, was Anthropic als erweitertes LLM bezeichnet. Diese Struktur besteht aus drei Schlüsselelementen:

- die Eingabe,

- das große Sprachmodell (LLM),

- und die Ausgabe.

Quelle: Anthropic 8

Das erweiterte LLM ist in der Lage, eigene Suchanfragen zu generieren, relevante Werkzeuge auszuwählen und zu entscheiden, welche Informationen im Speicher abgelegt werden sollen.

Möglicherweise stellen Sie einige Ähnlichkeiten mit den Komponenten von OpenAI fest (siehe unten). Diese Version ist jedoch vereinfacht und verzichtet auf Elemente wie Schutzmechanismen und Orchestrierung, die Kernstruktur bleibt aber unverändert. Dies ist völlig ausreichend. Für Aufgaben wie Testen und Bereitstellen empfiehlt es sich, die Komponenten von OpenAI zu verwenden.

Liste der KI-Agentenkomponenten von OpenAI 9

Diese erweiterten LLM-Bausteine werden auch als Subagenten bezeichnet. Nun wollen wir untersuchen, wie diese Subagenten zusammenwirken und interagieren, um einen größeren KI-Agenten zu bilden. Wir beginnen mit den einfacheren Arbeitsabläufen und gehen schrittweise zu komplexeren, vollständig autonomen Systemen über:

1. Einfache agentenbasierte Arbeitsabläufe (Verkettung von Eingabeaufforderungen)

Der einfachste agentenbasierte Workflow wird als Prompt Chaining bezeichnet. Dabei wird eine Aufgabe in eine Reihe von Schritten unterteilt, wobei jeder Subagent die Ausgabe des vorherigen Schritts verarbeitet.

Im Kern funktioniert es wie ein Fließband, wobei bei Bedarf Entscheidungspunkte eingefügt werden können, um den Ablauf umzuleiten. Das allgemeine Muster bleibt gleich: Eine Eingabe wird von einem Subagenten verarbeitet, der das Ergebnis zur Weiterverarbeitung an einen anderen Subagenten weitergibt usw., bis die endgültige Ausgabe erzeugt ist. Diese Methode eignet sich besonders für Aufgaben, die sich leicht in kleinere, aufeinanderfolgende Teilaufgaben unterteilen lassen.

Der Prompt-Chaining-Workflow 10

Beispiel aus der Praxis: 11

Prompt Chaining in n8n (Gliederung, Bewertung & Veröffentlichung auf Tabellen)

Im obigen Beispiel gibt der Benutzer ein Thema im n8n-Chatfenster ein. Jeder LLM-Knoten verwendet das Modell Azure OpenAI.

Die erste LLM-Aufgabe erstellt eine strukturierte Gliederung für einen Blogbeitrag. Die Aufgabenstellung für den Gliederungsschreiber lautet wie folgt:

Screenshot der Eingabeaufforderung für den Gliederungsgenerator LLM

Hierbei bezieht sich {{ $json.chatInput }} auf das Thema, das der Benutzer im Chatfenster eingegeben hat.

Die Variable {{ $json.chatInput }} ist grau, da der Workflow noch nicht ausgeführt wurde. Wäre der Knoten bereits ausgeführt oder getestet worden, wäre er je nach Gültigkeit der Variable grün oder rot.

Anschließend wertet das folgende LLM den Entwurf anhand von Schlüsselkriterien im Abschnitt „Systemmeldungen“ aus. Die Eingabeaufforderung finden Sie unten:

Der letzte Blog Writer LLM-Student wird eine Zeile in ein Tabellenblatt zum Thema einfügen, basierend auf der Gliederung des vorherigen LLM-Studenten.

Screenshot der Aufgabenstellung für den Blog Writer LLM

Wann sollte man die Befehlskettenverkettung verwenden?

- Aufgaben lassen sich auf natürliche Weise in feste, aufeinanderfolgende Teilaufgaben zerlegen.

- Jeder Schritt trägt sinnvoll zum Endergebnis bei.

- Schrittweises Denken erhöht die Genauigkeit gegenüber der direkten Verarbeitung.

- Während des gesamten Prozesses sind Qualitätskontrollpunkte erforderlich.

2. Routing-Workflow

Routing ist eine weitere Workflow-Art, bei der eine Eingabe empfangen wird und ein Unteragent diese Eingabe an die entsprechende Folgeaufgabe weiterleitet. Jede Aufgabe wird dann von einem auf diesen Bereich spezialisierten Unteragenten bearbeitet, und sobald die Aufgaben abgeschlossen sind, wird die endgültige Ausgabe generiert.

Ein klassisches Beispiel für Routing findet sich bei Kundenservice-Bots. Der Bot kann verschiedene Arten von Anfragen erhalten, beispielsweise allgemeine Anfragen, Rückerstattungsanträge oder technische Supportanfragen. Der erste Subagent identifiziert die Art der Anfrage und leitet sie an den Subagenten weiter, der auf die Bearbeitung dieses speziellen Problems spezialisiert ist.

Wenn es sich beispielsweise um eine Anfrage zu einer Rückerstattung handelt, wird diese an den zuständigen Rückerstattungsspezialisten weitergeleitet, während eine Frage zum technischen Support an den zuständigen technischen Supportmitarbeiter gerichtet wird.

Ein weiteres Beispiel ist die Weiterleitung von Anfragen an verschiedene Modelle basierend auf deren Stärken. Bei komplexeren Fragen aus dem MINT-Bereich könnte man die Eingabe an ein Modell wie Claude Sonnet 4.5 weiterleiten. Für einfachere, schnellere Anfragen könnte man sich für ein auf Geschwindigkeit optimiertes Modell wie Gemini Flash entscheiden.

Beispiel aus der Praxis: 12

Im obigen Beispiel leitet ein Agent die Benutzereingaben mithilfe einer strukturierten Ausgabe aus einem Sprachmodell an spezialisierte Agenten (wie einen Erinnerungsagenten, einen E-Mail-Agenten usw.) weiter.

Der Router ist mit GPT 4o mini verbunden. Die Eingabeaufforderung und die Kategorien lauten wie folgt:

Screenshot der Parameter des KI-Agentenknotens

Anwendungsbeispiele:

Sie können eine Anfrage im n8n-Chatfenster eingeben, zum Beispiel:

- Der Nutzer sagt: „Erinnere mich daran, morgen meine Mutter anzurufen.“

→ Weitergeleitet an den Erinnerungsagenten - Der Nutzer sagt: „Schick eine E-Mail an das HR-Team.“

→ Weitergeleitet an E-Mail-Agent - Der Nutzer sagt: „Vereinbare nächste Woche einen Termin mit John.“

→ Weitergeleitet an den Besprechungsagenten

Wann sollte man Routing verwenden?

- Unterschiedliche Eingabetypen: Ihr System empfängt verschiedene Arten von Anfragen, die von einer spezialisierten Verarbeitung profitieren.

- Ressourcenoptimierung: Sie möchten einfache Anfragen kostengünstigen Prozessoren zuweisen, während komplexe Anfragen an leistungsstarke Systeme weitergeleitet werden.

- Domänenspezialisierung: Unterschiedliche Eingabekategorien erfordern domänenspezifisches Fachwissen oder Verarbeitungslogik.

- Leistungsoptimierung: Sie müssen die Last ausgleichen und optimale Antwortzeiten für verschiedene Abfragetypen sicherstellen.

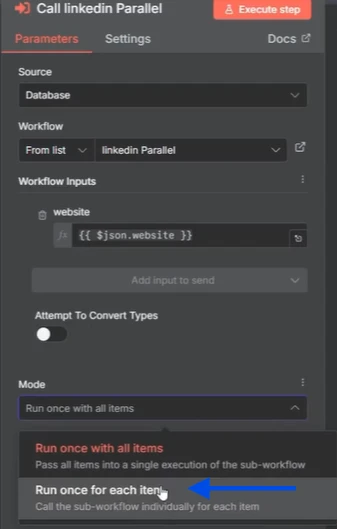

3. Parallelisierungs-Workflow

Der nächste Arbeitsablauf ist die Parallelisierung. Dieser spezielle agentenbasierte Arbeitsablauf weist typischerweise zwei Hauptvarianten auf. Bei der Parallelisierung arbeiten mehrere Subagenten gleichzeitig an einer Aufgabe, und ihre Ergebnisse werden anschließend kombiniert.

- Die erste Variante heißt Segmentierung . Dabei wird eine Aufgabe in unabhängige Teilaufgaben zerlegt, die parallel ausgeführt werden.

- Die zweite Variante ist das Voting , bei dem dieselbe Aufgabe mehrmals von verschiedenen Unteragenten ausgeführt wird, um unterschiedliche Ergebnisse zu erzielen, die dann zusammengeführt werden.

Dies trägt zu einer schnelleren modularen Automatisierung bei, insbesondere bei großen Arbeitsabläufen.

Zeitvergleich sequentieller und paralleler Arbeitsabläufe 13

Beispiel aus der Praxis: 14

Screenshot des Beispiels für den Parallelisierungs-Workflow in n8n

Die parallele Ausführung im n8n-Beispiel demonstriert eine Aufgabe, bei der der Workflow die SERP-API für die Suche Google nutzt, um LinkedIn-URLs abzurufen und in einem Google-Sheet zu speichern. In der initialen Konfiguration verarbeitet der Workflow jede Aufgabe sequenziell, eine Website nach der anderen:

- Der Workflow wird ausgelöst.

- Das Tool „Get“ ruft die Website aus dem Tabellenblatt Google ab.

- Der KI-Agent verwendet die SERP-API, um nach Google zu suchen und die LinkedIn-URL abzurufen.

- Anschließend wird die LinkedIn-URL im Tabellenblatt Google aktualisiert.

An diesem Punkt werden die Aufgaben nacheinander abgearbeitet, was bei großen Datensätzen langsam sein kann.

n8n bietet die Möglichkeit, Knoten auszuwählen, darauf zu klicken und dann zu sagen: „Ich möchte diese ausgewählten Knoten in einen Unter-Workflow umwandeln.“

Wenn Sie auf diese Schaltfläche klicken, wird mein Workflow benannt. Nach dem Bestätigen wird daraus ein Unter-Workflow, der bereits hier verknüpft und von diesem Benutzer aufgerufen wird.

Der erstellte Teilworkflow

n8n hat dies also in einen Unterworkflow umgewandelt, aber eine Parallelisierung gibt es noch nicht, da er immer noch hier komplett durchlaufen würde.

Damit dies tatsächlich parallel ausgeführt wird, müssen alle Elemente einzeln ausgeführt werden. Wenn Sie also auf den Knoten klicken, können Sie „Für jedes Element einmal ausführen“ auswählen. Das bedeutet, dass der Unterworkflow für jedes Element einzeln aufgerufen wird.

Sobald Sie das geändert haben, können Sie den Unterworkflow aufrufen und auf „Ausführungen“ klicken. Dort sehen Sie, dass alle drei Elemente exakt gleichzeitig ausgeführt werden.

Wann Parallelisierung einsetzen: Parallelisierung ist am effektivsten, wenn Aufgaben in kleinere, unabhängige Teilaufgaben unterteilt werden können, die gleichzeitig ausgeführt werden können. Dadurch werden sowohl Geschwindigkeit als auch Effizienz verbessert.

Es ist auch dann wertvoll, wenn mehrere Perspektiven oder wiederholte Versuche erforderlich sind, um ein höheres Maß an Vertrauen in die Ergebnisse zu erlangen. Bei komplexen Problemen mit mehreren Dimensionen oder Bewertungskriterien erzielen große Sprachmodelle bessere Ergebnisse, wenn jeder spezifische Aspekt durch einen separaten Modellaufruf behandelt wird. Dies ermöglicht ein fokussierteres und präziseres Schließen für jeden Teil der Aufgabe.

4. Arbeitsablauf der Orchestrator-Mitarbeiter

Der nächste, komplexere Arbeitsablauf ist das Orchestrator-Worker-Muster.

Die Orchestrator-Worker-Architektur macht Ihre n8n-Workflows modular, skalierbar und anpassungsfähig und verwandelt eine einzelne starre Automatisierung in ein zusammensetzbares System kooperierender Agenten.

Auf den ersten Blick mag es der Parallelisierung ähneln, da mehrere Subagenten aktiv sein können, der entscheidende Unterschied liegt jedoch in der Flexibilität. Anders als bei der Parallelisierung basiert das Orchestrator-Worker-System nicht auf einer festen Liste von Teilaufgaben. Stattdessen entscheidet der Orchestrator dynamisch, welche Aufgaben ausgeführt werden müssen, weist sie den Worker-Agenten zu und koordiniert deren Ausführung während des gesamten Prozesses.

Beispiel aus der Praxis: 15

Screenshot des Orchestrator-Worker-Workflow-Beispiels in n8n

Im obigen Beispiel wird das Briefing einmalig erfasst und ein Orchestrator leitet die Arbeit an mehrere spezialisierte Agenten weiter.

Der CEO-Agent fungiert als zentraler LLM-Orchestrator. Er verarbeitet das Briefing, passt es für jede Abteilung an, wählt die zu aktivierenden Worker-Agenten aus und legt fest, wie deren Ergebnisse integriert werden. Je nach Kontext und Rahmenbedingungen kann er einen, zwei oder alle Worker aufrufen.

Screenshot des CEO-Agent-Knotens

Im Folgenden nutzen drei Mitarbeiteragenten – Marketing, Operations und Finanzen – jeweils ihr eigenes Chat-Modell (OpenAI) mit separaten Speicher- und Tool-Konfigurationen. Dies ermöglicht abteilungsspezifische Eingabeaufforderungen und JSON-Schemas für strukturierte Ausgaben.

Screenshot der drei Worker-Agent-Knoten

Sobald der Orchestrator abteilungsspezifische Anweisungen vorbereitet hat, ruft er jeden Mitarbeiter als Werkzeug auf, um auf Basis der Eingaben Ausgaben zu generieren.

Der Marketing-Agent erstellt beispielsweise Kampagnen (Name, Kanal, KPI).

KI-Tool-Knoten (Marketing-Agent)

Nachdem die Ergebnisse der Mitarbeiter generiert wurden, fasst der CEO-Agent die Antworten der Abteilungen in einem einzigen, zusammenhängenden Plan zusammen. Anschließend speichert der Workflow den Plan in einem Google-Dokument, fügt Metadaten hinzu, konvertiert es in PDF und lädt es automatisch zum Teilen oder Überprüfen hoch.

Screenshot der Knoten für Dokumentenerstellung, -konvertierung und -upload

Bei der Ausführung bestimmt der Orchestrator, welche Agenten aktiviert werden sollen, koordiniert deren Zusammenarbeit und kombiniert deren Ergebnisse zu einem umfassenden Bericht. Dies verdeutlicht, wie Orchestrator-Worker-Workflows flexible, modulare und zusammensetzbare KI-Systeme ermöglichen.

Wann man den Orchestrator-Worker-Workflow einsetzt: Dieser Ansatz ist besonders wertvoll für die Lösung von Problemen mit offenem Ende oder sich entwickelnden Problemen, bei denen die erforderlichen Schritte nicht im Voraus bekannt sein können.

Beispiele, bei denen der Orchestrator-Worker-Workflow nützlich ist:

- Codierungsaufgaben: Bei der Entwicklung oder Fehlersuche komplexer Softwareprodukte, die koordinierte Änderungen in mehreren Dateien erfordern, wobei die genauen Dateien und Änderungen während der Ausführung bestimmt werden können.

- Recherche und Informationsbeschaffung: Bei Aufgaben, die das Suchen, Sammeln und Analysieren von Daten aus verschiedenen Quellen beinhalten, wobei relevante Informationen nicht im Voraus vollständig identifiziert werden können und dynamisch ermittelt werden müssen.

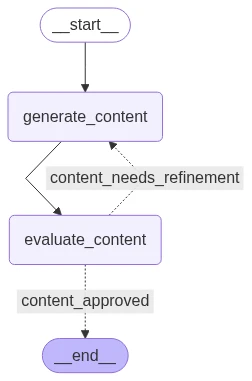

5. Workflow des Evaluators und Optimierers

Noch komplexer ist der Workflow zwischen Evaluator und Optimierer. Dieses Setup zielt auf ein autonomeres Verhalten ab und gibt dem Subagenten oder KI-Agenten mehr Freiheit, selbst zu entscheiden, welche Aktionen er durchführt und wie er seine Ergebnisse verbessert.

Man beginnt mit einer Eingabe, und der erste Subagent generiert einen Lösungsvorschlag. Dieser wird dann an einen Bewertungs-Subagenten weitergeleitet, der das Ergebnis prüft. Ist der Bewertungs-Subagent zufrieden, wird die Lösung finalisiert. Andernfalls sendet er das Ergebnis mit konkretem Feedback zur Verbesserung an den ersten Subagenten zurück.

Dadurch entsteht eine kontinuierliche Rückkopplungsschleife, in der der Optimierer seine Ausgabe iterativ verfeinert, bis der Evaluator feststellt, dass sie die erforderlichen Qualitätsstandards erfüllt.

Beispiel aus der Praxis: 16

In diesem Beispiel habe ich eine Python-Simulation verwendet, anstatt ein No-Code-Tool, um Auswertungsschemata, benutzerdefinierte Logik und iterative Schleifen direkt zu veranschaulichen.

Dies ist keine vollständige Einrichtung. Um den Evaluator-Optimierer-Workflow vollständig auszuführen, benötigen Sie eine korrekte Umgebungskonfiguration, Modellinitialisierung, Schemaeinrichtung usw.

Sie können auch eine Evaluator-Optimierer-Schleife mithilfe von Workflow-Automatisierungstools implementieren, die Evaluierungsknoten unterstützen.

Evaluator-Optimierer-Workflow mit Python:

Ein Beispiel für eine Evaluator-Optimierer-Schleife, ein häufiges Muster in selbstreflexiven KI-Systemen oder agentenbasierten Arbeitsabläufen.

Dieser Workflow stellt einen automatisierten Kreislauf zur Inhaltserstellung und -bewertung dar, in dem zwei Komponenten zusammenarbeiten: eine erstellt die Inhalte, die andere prüft sie. So wird sichergestellt, dass die Ergebnisse vor der Fertigstellung den Qualitätsstandards entsprechen.

Schritt-für-Schritt-Erklärung:

- Eingabe initialisieren: Erstellen Sie initial_state = {“content_topic”: topic}.

- Führe die Schleife aus: Rufe evaluator_optimizer_workflow.invoke(initial_state) auf, was iterativ Folgendes ausführt:

- generiert/verfeinert Inhalte,

- bewertet die Qualität

- wird wiederholt, bis die Genehmigung erteilt oder eine maximale Anzahl an Iterationen erreicht ist.

- Ergebnis des Protokolls: Abschlussmeldung und den genehmigten generierten Inhalt ausgeben.

- Rückgabeergebnis: final_state dict (z. B. content_topic, generated_content, quality_assessment).

Workflow-Visualisierung:

Evaluierungs-Optimierungs-Schleife mit Python-Ergebnissen: Jeder Durchlauf nutzt vorheriges Feedback, um den Inhalt zu verbessern. Die Schleife erzeugt schließlich Inhalte, die dem Qualitätsstandard entsprechen.

Wann sollte der Evaluator-Optimierer-Workflow verwendet werden? Dieser Workflow ist besonders dann nützlich, wenn klare Bewertungskriterien vorliegen und eine iterative Verfeinerung zu sinnvollen Qualitätsverbesserungen führen kann.

Beispiele, bei denen der Workflow aus Evaluator und Optimierer nützlich ist:

- Bei einer literarischen Übersetzungsaufgabe kann es beispielsweise vorkommen, dass der erste Versuch bestimmte sprachliche Nuancen oder emotionale Töne nicht erfasst. Der/Die Gutachter/in gibt dann Feedback und bittet um Überarbeitungen, bis die Übersetzung die beabsichtigte Bedeutung und die Feinheiten des Originaltextes vollständig wiedergibt.

- Ein weiteres Beispiel ist die komplexe Forschungsaggregation, bei der der Optimierer Informationen sammelt und zusammenfasst, während der Evaluator sie auf Tiefe, Vollständigkeit und Genauigkeit prüft. Sollte der Evaluator die Forschung als unzureichend einstufen, sendet er sie zur Überarbeitung zurück, bis der Abschlussbericht alle Anforderungen erfüllt und die notwendigen Informationen effektiv zusammenfasst.

6. Implementierung eines wirklich autonomen Agenten

Und schließlich gibt es noch die Implementierung eines wirklich autonomen Agenten. Dieses System ist konzeptionell einfach, kann aber in der Praxis äußerst vielfältige und komplexe Verhaltensweisen hervorbringen.

Der Agent nimmt seine Tätigkeit mit minimalem menschlichem Eingriff auf; üblicherweise mit einer einzigen Anweisung oder einem Ziel. Sobald die Aufgabe definiert ist, arbeitet er selbstständig, führt Aktionen aus und beobachtet deren Auswirkungen auf die Umgebung.

Ein zentrales Merkmal dieses Ansatzes ist die Selbstevaluation: Der Agent muss anhand von Rückmeldungen aus seiner Umgebung feststellen, ob seine Aktionen ihn dem Ziel näherbringen. Führt er beispielsweise Code aus oder nutzt er externe Tools, muss er beurteilen, ob diese Aktionen zum Fortschritt beitragen oder ob Anpassungen erforderlich sind. Dieser feedbackgesteuerte Zyklus setzt sich fort, bis der Agent feststellt, dass das Ziel erreicht ist oder kein weiterer Fortschritt möglich ist.

Beispiel aus der Praxis:

In unserem Benchmark von KI-Codierungswerkzeugen stellten wir fest, dass Windsurf und Cursor agentenartige Fähigkeiten demonstrierten, indem sie autonom Dateistrukturen erstellten, mehrere Dateien bearbeiteten und Terminalbefehle ausführten, um APIs auf Heroku bereitzustellen.

Windsurf passte sich sogar den jüngsten Plattformänderungen an; als es feststellte, dass das PostgreSQL Hobby Dev Add-on veraltet war, konfigurierte es die Bereitstellung korrekt neu, um PostgreSQL Essential 0 zu verwenden.

Zusammenfassung

Bei der Entwicklung von KI-Agenten geht es weniger um vollständige Autonomie, sondern vielmehr um die Schaffung zielgerichteter, transparenter und zuverlässiger Systeme. Unsere Experimente in n8n und die Erkenntnisse aus den Leitfäden von Anthropic und OpenAI haben gezeigt, dass effektive Agenten auf sorgfältigen Designentscheidungen beruhen.

Bei der Implementierung von Agenten konzentrieren wir uns auf drei Leitprinzipien:

- Halten Sie die Architektur einfach. Beginnen Sie klein, bauen Sie modular auf und führen Sie Komplexität erst dann ein, wenn dies die Leistung oder Flexibilität deutlich verbessert.

- Machen Sie den Entscheidungsprozess sichtbar. Ermöglichen Sie Benutzern und Entwicklern, nachzuvollziehen, wie der Agent plant und Entscheidungen trifft, um die Interpretierbarkeit und Kontrollierbarkeit zu verbessern.

- Gewährleisten Sie zuverlässige Werkzeuginteraktionen. Entwickeln Sie Werkzeuge, die klar definiert, gut dokumentiert und getestet sind, damit Agenten in realen Umgebungen konsistent agieren können.

Seien Sie der Erste, der kommentiert

Ihre E-Mail-Adresse wird nicht veröffentlicht. Alle Felder sind erforderlich.