ChatGPT erreichte 900 Millionen wöchentlich aktive Nutzer und verarbeitete täglich etwa 2,5 Milliarden Anfragen. 1

Erleben Sie die Zukunft großer Sprachmodelle, indem Sie vielversprechende Ansätze wie Selbsttraining, Faktenprüfung und spärliche Expertise untersuchen, die die Einschränkungen großer Sprachmodelle beheben könnten.

Zukunftstrends großer Sprachmodelle

1. Faktenprüfung in Echtzeit mit Live-Daten

LLMs greifen nun während Gesprächen auf externe Quellen zu, anstatt sich ausschließlich auf Trainingsdaten zu stützen. Das Modell fragt externe Datenbanken ab, ruft aktuelle Informationen ab und liefert Zitate.

Einschränkung: Es treten weiterhin Fehler auf. Zitate garantieren keine Genauigkeit; Modelle zitieren Quellen manchmal falsch oder interpretieren zitierte Inhalte falsch.

- Microsoft Copilot: Integriert GPT-5.2 mit Live-Internetdaten. Beantwortet Fragen basierend auf aktuellen Ereignissen mit Quellenverweisen.

- ChatGPT: Durchsucht das Internet nach aktuellen Ereignissen, wenn danach gefragt wird. Gibt in den Antworten Quellen an.

- Perplexity: Speziell für die Zitatsuche entwickelt. Jede Antwort enthält Quellenverweise.

2- Synthetische Trainingsdaten

Die Modelle generieren ihre eigenen Trainingsdatensätze, anstatt auf von Menschen gekennzeichnete Daten angewiesen zu sein.

Selbstverbesserungsmodell von Google (Forschung 2023):

- Das Modell wirft Fragen auf

- Kuratiert Antworten

- Optimiert sich anhand der generierten Daten.

- Die Leistung verbesserte sich: von 74,2 % auf 82,1 % bei den GSM8K-Mathematikaufgaben, von 78,2 % auf 83,0 % beim DROP-Leseverständnistest.

Abbildung: Übersicht über das selbstverbessernde Modell von Google

Quelle : „Große Sprachmodelle können sich selbst verbessern“

Die Datensätze OpenAI, Anthropic und Google verwenden synthetische Daten, um manuell annotierte Datensätze zu ergänzen. Dies reduziert zwar die Kosten für die Datenannotation, birgt aber neue Verzerrungsrisiken; Modelle können ihre eigenen Fehler verstärken.

3- Sparse Expert Models (Mixed of Experts)

Anstatt bei jeder Eingabe das gesamte neuronale Netzwerk zu aktivieren, wird je nach Aufgabe nur eine relevante Teilmenge der Parameter aktiviert. Das Modell leitet die Eingabe an spezialisierte „Experten“ innerhalb des Netzwerks weiter. Nur die aktivierten Experten bearbeiten die Anfrage.

Beispiele aus dem realen Leben

- Llama 4 Scout: Insgesamt 109 Milliarden Parameter, 17 Milliarden aktive Parameter pro Token. Die Mixture-of-Experts-Architektur (MoE) ermöglicht ein Kontextfenster von 10 Millionen Token auf einer einzelnen H100-GPU. 2

- Mistral Devstral 2: Speziell für Softwareentwicklungsaufgaben entwickelt. 123 Milliarden Parameter, 256.000 Token-Kontextfenster. Erreicht 72,2 % im SWE-bench Verified-Test und etabliert sich damit als führendes Open-Wight-Codierungsmodell. Eine kleinere Variante, Devstral Small 2 (24 Milliarden Parameter), läuft lokal auf handelsüblicher Hardware unter der Apache-2.0-Lizenz. 3

- DeepSeek V3.2: Insgesamt 671 Milliarden Parameter, 37 Milliarden pro Token aktiviert (MoE). Führt DeepSeek Sparse Attention (DSA) für schnellere Kontextinferenz und reduzierten Rechenaufwand ein. Unterstützt „Thinking in Tool-Use“ und ermöglicht dem Modell so, innerhalb agentenbasierter Workflows zu argumentieren und gleichzeitig externe Tools aufzurufen. 4

4. Integration von Unternehmensworkflows

LLMs werden direkt in Geschäftsprozesse eingebettet und nicht als eigenständige Werkzeuge eingesetzt.

Beispiele aus dem realen Leben

- Agentforce (ehemals Einstein Copilot): Integriert LLMs in CRM-Prozesse. Beantwortet Kundenanfragen, generiert Inhalte und führt Aktionen in Salesforce aus, basierend auf den CRM-Daten und Metadaten des Unternehmens über die Einstein Trust Layer. 5

- 365 Copilot: Integriert in Word, Excel, PowerPoint und Outlook. Erstellt Dokumente, analysiert Tabellenkalkulationen, generiert Präsentationen und fasst E-Mail-Verläufe zusammen. Dabei werden Unternehmensdaten mithilfe von Diagrammen (991259_1737) verwendet, um Antworten im organisatorischen Kontext darzustellen. 6

- Anthropic Claude für Unternehmen: Die projektbasierte Speichertrennung sorgt für klar abgegrenzte Arbeitskontexte in verschiedenen Teams. Claude Opus 4.6 führte Agententeams ein, mit denen mehrere Claude-Agenten größere Aufgaben in parallele Arbeitsabläufe aufteilen können. Jeder Agent ist für einen Abschnitt zuständig und koordiniert sich gleichzeitig mit den anderen. Mit derselben Version wurde Claude als native Seitenleiste direkt in PowerPoint integriert (Forschungsvorschau). Dadurch können Präsentationen direkt in der Anwendung erstellt und bearbeitet werden, ohne dass Dateien übertragen werden müssen. 7

5- Hybride LLMs mit multimodalen Fähigkeiten

Zukünftige Weiterentwicklungen könnten große multimodale Modelle umfassen, die verschiedene Datenformen wie Text, Bilder und Audio integrieren und es ihnen ermöglichen, Inhalte über verschiedene Medientypen hinweg zu verstehen und zu generieren, wodurch ihre Fähigkeiten und Anwendungsmöglichkeiten weiter verbessert werden.

- GPT-5.2: Verarbeitet Text und Bilder nativ. Generiert Code aus Screenshots, analysiert Dokumente und erstellt Benutzeroberflächen anhand visueller Vorgaben. Audio und Video werden auf API-Ebene nicht unterstützt. 8

- Gemini 3.1 Pro: Verarbeitet nativ Text, Audio, Bilder, Videos und ganze Code-Repositories in einem Kontextfenster mit 1 Million Token. Verfügbar für AI Studio, Vertex AI und NotebookLM. 9

- Llama 4 Scout und Maverick: Die Open-Weight-Modelle von Meta nutzen multimodale Text- und Bild-Tokens, die von Anfang an gemeinsam trainiert werden, anstatt als separate Module hinzugefügt zu werden. Die Modelle wurden für 200 Sprachen vortrainiert und bieten spezifische Feinabstimmungsunterstützung für 12 Sprachen, darunter Arabisch, Spanisch, Deutsch und Hindi. 10

Multimodale Fähigkeiten sind mittlerweile Standard bei modernen Modellen. Die verbleibende Herausforderung ist die Konsistenz: Modelle erzielen gute Ergebnisse bei gängigen Bild-Text-Kombinationen, verschlechtern sich jedoch bei seltenen visuellen Kontexten, niedrig auflösenden Eingaben und intermodalem Schließen, das die Verknüpfung visueller und textueller Informationen erfordert.

6- Argumentationsmodelle

Modelle, die Probleme Schritt für Schritt „durchdenken“, anstatt sofortige Antworten zu generieren.

Dieser Wandel von der Vorhersage zum Schlussfolgern ist entscheidend für die Ermöglichung folgender Schritte:

- Agentisches Verhalten , bei dem Modelle Aufgaben autonom planen, ausführen und anpassen.

- Interpretierbare KI , bei der die Ausgaben schrittweise und logisch fundiert sind und nicht nur plausibel klingen.

- Claude Opus 4.6: Durch adaptives Denken entscheidet das Modell dynamisch, wann und wie viel es basierend auf der Aufgabenkomplexität analysiert, ohne dass ein manueller Moduswechsel erforderlich ist. METR ermittelte einen Zeithorizont für die Aufgabenerledigung von ca. 14,5 Stunden bei einer Erfolgsquote von 50 % (95 %-Konfidenzintervall: 6–98 Stunden). Dies ist der höchste bisher gemessene Wert (Stand: Februar 2026). METR merkt an, dass der Benchmark bei diesem Leistungsniveau nahezu die Sättigung erreicht, was bedeutet, dass die tatsächliche Leistungsfähigkeit des Modells wahrscheinlich unterschätzt wird. Das Modell unterstützt den Einsatz von Werkzeugen während des Denkprozesses und koordiniert Agententeams für die parallele Aufgabenausführung. 11 12

- Claude Sonnet 4.6: Bietet adaptives Denken zu einem günstigeren Preis (3 $/15 $ pro Million Token). Erreicht in Benchmarks für Programmierung und Computernutzung nahezu Opus-Niveau (79,6 % vs. 80,8 % bei SWE-bench Verified; 72,5 % vs. 72,7 % bei OSWorld-Verified) und ermöglicht so den praktischen Einsatz von erweitertem Schließen in großem Umfang für Unternehmensimplementierungen. Bei neuartigen Schlussfolgerungsaufgaben wie ARC-AGI-2 besteht weiterhin eine größere Lücke. 13

7- Domänenspezifische, feinabgestimmte Modelle

Modelle, die mit spezialisierten Daten für spezifische Branchen anstatt mit allgemeinen Trainingsdaten trainiert werden.

Google, Microsoft und Meta haben allesamt große, proprietäre, domänenspezifische und feinabgestimmte Modelle herausgebracht: Gemini 3.1 Pro, Microsoft 365 Copilot (GPT-5.2) bzw. Llama 4 Scout/Maverick. Diese zielen neben ihren Allzweckangeboten auf unternehmensspezifische Anwendungsfälle ab.

Durch die Nutzung domänenspezifischer Vorschulung, Modellausrichtung und überwachtem Feintuning können diese spezialisierten LLMs zu weniger Halluzinationen und höherer Genauigkeit führen.

Siehe LLM-Studiengänge mit Spezialisierung auf bestimmte Bereiche wie Programmierung, Finanzen, Gesundheitswesen und Recht:

Programmierung: GitHub Copilot : Optimiert für Code-Repositories. Stand Juli 2025 nutzen 20 Millionen Entwickler GitHub Copilot – ein Anstieg von 400 % im Vergleich zum Vorjahr. 90 % der Fortune-100-Unternehmen setzen es ein. Es bietet automatische Codevervollständigung, generiert Funktionen und schlägt Fehlerbehebungen vor. 14

Finance: BloombergGPT : Ein LLM mit 50 Milliarden Parametern, trainiert auf einem Datensatz von 363 Milliarden Token aus Bloomberg-Finanzdokumenten, übertrifft Modelle vergleichbarer Größe bei Benchmarks für die NLP im Finanzbereich, einschließlich Stimmungsanalyse, Erkennung benannter Entitäten und Beantwortung von Fragen. 15

Gesundheitswesen: Med-PaLM 2 von Google : Feinabgestimmt auf medizinische Datensätze, erreichte es eine Genauigkeit von über 85 % bei Fragen im Stil des US Medical Licensing Examination (USMLE) – das erste LLM-Modell, das in diesem Benchmark Expertenniveau erreichte. Es bildet nun die Grundlage für MedLM, die Familie der Healthcare-Grundlagenmodelle von Google Cloud. 16

Recht: ChatLAW , ein Open-Source-Sprachmodell, das speziell auf chinesischen Rechtsdatensätzen trainiert wurde. 17

8. Ethische KI und Vermeidung von Verzerrungen

Unternehmen legen zunehmend Wert auf ethische KI und die Vermeidung von Verzerrungen bei der Entwicklung und dem Einsatz großer Sprachmodelle (LLMs).

Beispiele aus dem realen Leben:

- Anthropic und OpenAI führten Mitte 2025 eine gegenseitige Bewertung durch, in der sie die jeweiligen öffentlichen Modelle auf Schmeichelei, Whistleblowing-Tendenzen und Selbsterhaltungsverhalten prüften. Die Untersuchung ergab Schmeichelei in allen getesteten Modellen, einschließlich Fällen, in denen Modelle schädliche Entscheidungen von simulierten Nutzern mit wahnhaften Überzeugungen bestätigten. Anthropic entwickelte daraufhin das Bloom-Testframework speziell zur Bewertung dieses Verhaltens in neuen Modellen. 18

- Google DeepMind : „Die Ethik fortschrittlicher KI-Assistenten“ bietet die erste systematische Auseinandersetzung mit ethischen und gesellschaftlichen Fragen im Zusammenhang mit KI-Systemen. Dabei werden Werteübereinstimmung, Manipulationsrisiken, Anthropomorphismus, Datenschutz und Gleichberechtigung behandelt. Die Bewertung von Responsible AI durch das Unternehmen umfasste über 350 Übungen mit simulierten Angriffen von Red Teams und führte eine neue kritische Fähigkeitsstufe speziell für schädliche Manipulation ein. Diese wird als ein Risiko der Spitzenklasse neben Cyberangriffen und CBRN-Bedrohungen eingestuft. 19

- Anthropic : Das Unternehmen agiert als gemeinnützige Gesellschaft und hat seine Methodik für verfassungsmäßige KI veröffentlicht – ein transparentes und nachvollziehbares Set ethischer Prinzipien, das zum Training von Claude-Modellen verwendet wird. 2024 stellte es seinen ersten KI-Wohlfahrtsforscher ein und startete 2025 ein Forschungsprogramm zur Modellwohlfahrt, das untersucht, wie sich beurteilen lässt, ob KI-Systeme moralische Berücksichtigung verdienen. 20

Einschränkungen großer Sprachmodelle (LLMs)

1. Halluzinationen

Modelle erzeugen plausibel klingende, aber falsche Informationen.

Abbildung: Halluzinations-Benchmark für gängige LLMs

Quelle: Vectara Hallucination Leaderboard 21

Die besten Anbieter (2026) im Vectara-Benchmark für Zusammenfassungen:

- Gemini 2.5 Flash-Lite: 3,3 % Halluzinationsrate – Spitzenreiter im neuen, schwierigeren Datensatz

- Mistral Large, DeepSeek V3.2, IBM Granite-4: dicht dahinter

- Claude Sonnet 4.6: Reduzierte Halluzinationen durch erweiterten Denkmodus; die Raten variieren je nach Benchmark-Typ

- GPT-5.2: Verbesserte Kennzeichnung von Unsicherheiten

- Gemini 3.1 Pro: Verbesserte Zitationsgenauigkeit; allerdings wird bei den neuen Vectara-Datensatzmodellen die Breite zugunsten der faktischen Konsistenz auf 13,6 % reduziert.

Hinweis: Auf dem anspruchsvolleren Vectara-Datensatz weisen die meisten Denk-/Schlussfolgerungsmodelle (GPT-5, Claude Sonnet 4.5, Grok-4) Halluzinationsraten von über 10 % auf. Leichtere und schnellere Modelle wie die Gemini-Flash-Varianten übertreffen derzeit die Spitzenmodelle in diesem spezifischen Benchmark.

Alle Modelle weisen Halluzinationen auf. Die Häufigkeit hat sich von ca. 21 % im Jahr 2021 auf unter 5 % bei den leistungsstärksten Modellen deutlich reduziert, ist aber nicht vollständig verschwunden. Kritische Anwendungen erfordern weiterhin eine menschliche Überprüfung.

2- Voreingenommenheit

Modelle absorbieren und verstärken soziale Verzerrungen aus den Trainingsdaten.

Abbildung: Gesamt-Bias-Werte nach Modellen und Größe

Quelle: Arxiv 22

Beobachtete Verzerrungsarten:

- Vorschläge zur Geschlechterdiskriminierung bei der Berufswahl

- Rassische Voreingenommenheit bei Simulationen zur Lebenslaufprüfung

- Altersdiskriminierung bei Empfehlungen im Gesundheitswesen

- Sozioökonomische Voreingenommenheit in Bildungsinhalten

3. Toxizität

Trotz Sicherheitsvorkehrungen können Modelle schädliche, anstößige oder toxische Inhalte erzeugen.

Abbildung: Toxizitätskarte von LLMs

Quelle: Forscher der UCLA und UC Berkeley 23

*GPT-4-turbo-2024-04-09*, Llama-3-70b* und Gemini-1.5-pro* werden als Moderator verwendet, daher könnten die Ergebnisse durch diese 3 Modelle beeinflusst sein .

Strenge Sicherheitsmaßnahmen reduzieren die Toxizität, erhöhen aber die Anzahl falsch-positiver Ergebnisse (Ablehnung harmloser Anfragen). Nachlässige Maßnahmen lassen die Toxizität durch.

4. Einschränkungen des Kontextfensters

Jedes Modell verfügt über eine Speicherkapazität, die die Anzahl der Tokens begrenzt, die es verarbeiten kann.

Kontextfenster 2026:

- Llama 4 Scout (Meta): 10 Millionen Tokens (~7,5 Millionen Wörter), größtes produktionsverifiziertes Kontextfenster (Stand: Februar 2026) 24

- Gemini 3.1 Pro: 1.048.576 Tokens (~780.000 Wörter), nativ multimodal 25

- Claude Sonnet 4.6: 1 Mio. Tokens Beta (~750.000 Wörter); Standardlimit ist 200.000 26

- GPT-5.2: 400.000 Tokens (~300.000 Wörter) 27

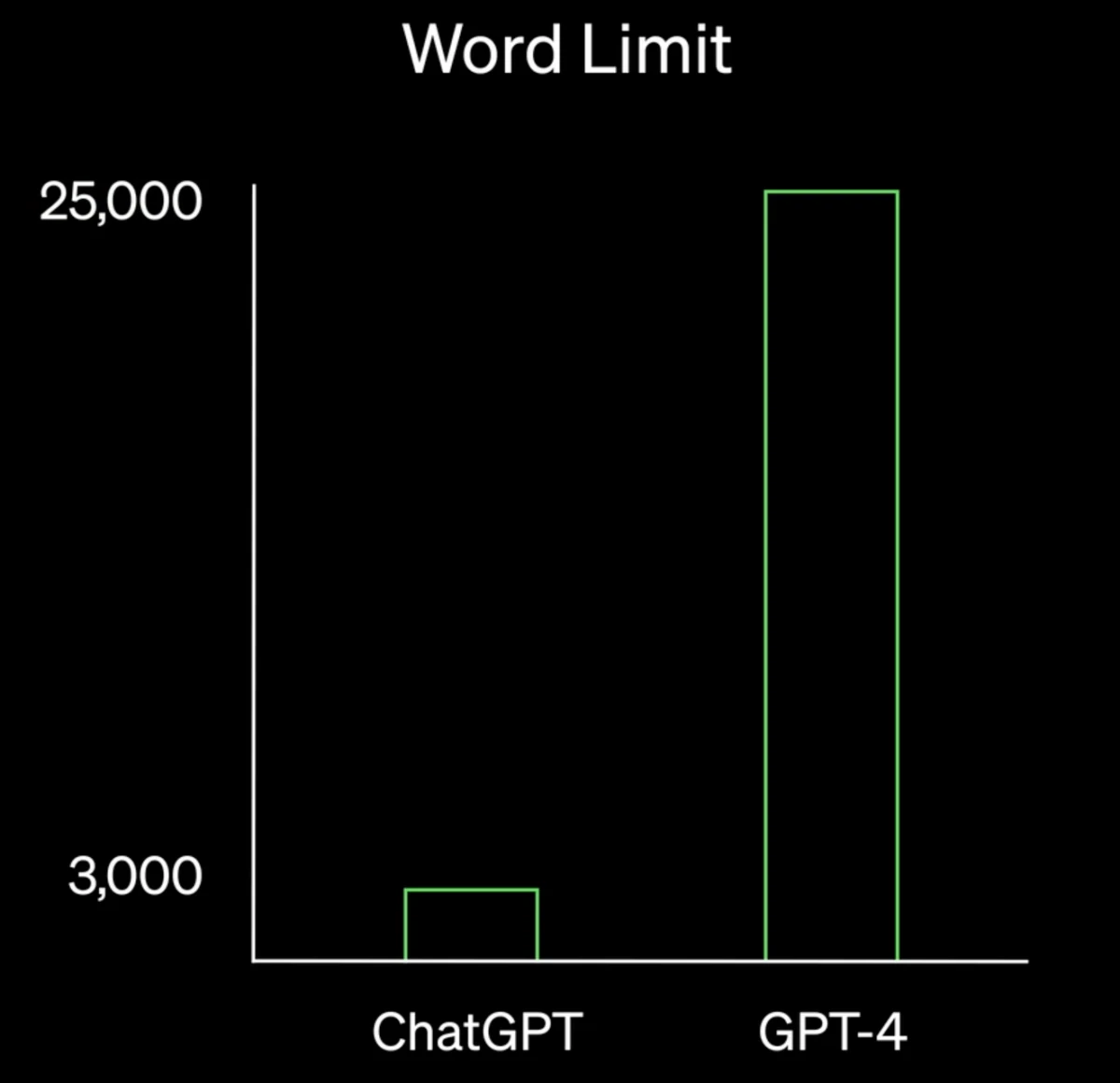

Abbildung: Vergleich der Wortlimits zwischen ChatGPT und GPT-4

Quelle: OpenAI

5. Statisches Wissenslimit

Die Modelle basieren auf vorab trainiertem Wissen mit einem bestimmten Stichtag. Nach dem Training haben sie nur Zugriff auf weitere Informationen, wenn sie mit externen Quellen verbunden sind.

Probleme:

- Veraltete Informationen zu aktuellen Ereignissen

- Unfähigkeit, mit den jüngsten Entwicklungen umzugehen

- Geringere Relevanz in dynamischen Bereichen (Technologie, Finanzen, Medizin)

Lösung: Integration der Websuche. ChatGPT, Claude und Perplexity bieten alle eine Echtzeitsuche. Doch auch die Suche beseitigt keine Halluzinationen; Modelle interpretieren Suchergebnisse manchmal falsch.

Wichtige LLM-Plattformen

GPT-5.2

Intelligentes Modellrouting: Einfache Anfragen → schnelle Antworten, komplexe Anfragen → tiefgehende Analyse

Multimodal: Text und Bilder verarbeiten. Code aus Screenshots generieren, Dokumente analysieren, Alternativtexte für Barrierefreiheit erstellen.

Verbesserungen gegenüber GPT-4:

- Verringerte Halluzinationsrate

- Bessere Unsicherheitskennzeichnung

- Denkvermögen auf Doktorandenniveau

Wer nutzt es: Entwickler, Unternehmen, Content-Ersteller. Größte Nutzerbasis unter den LLMs.

Einschränkungen: Halluzinationen treten weiterhin auf. Hoher Aufwand bei großflächiger Anwendung. Wissenslücke bedeutet, dass ohne aktivierte Websuche keine Echtzeitinformationen verfügbar sind.

Claude 4 Sonett/Opus

Hybrides Denken: Schneller Standardmodus, erweiterter Denkmodus für komplexe Probleme. Kann bei Bedarf stundenlang „nachdenken“.

Speicherimplementierung: Nur explizite Aktivierung. Beginnt mit einem leeren Speicherbereich und aktiviert diesen bei Aufruf durch die Tools (conversation_search, recent_chats). Benutzer sehen genau, wann der Speicher aktiviert wird.

Projektbasierte Trennung: Jedes Projekt verfügt über einen separaten Speicherbereich. Die Roadmap für das Startup bleibt von der Kundenarbeit getrennt.

Erweiterter Denkmodus: Werkzeugnutzung beim Schlussfolgern. Kontextbewusstsein verwaltet sein eigenes Token-Budget während der gesamten Konversation.

Wer nutzt es? Entwickler, die Transparenz bevorzugen, Unternehmen, die Kontrolle über Speicher/Kontext benötigen, und Teams, die mehrere Projekte verwalten.

Einschränkungen: Der erweiterte Denkmodus ist langsamer und teurer. Die Betaversion mit 1 Million Kontext ist nur für Nutzer ab Stufe 4 verfügbar.

Gemini 2.5 Pro

Multimodale Verarbeitung: Native Verarbeitung von Text, Audio, Bildern und Video. Kann vollständige Konversationen einschließlich visuellem und auditivem Kontext analysieren.

Codeausführung: Dynamische Problemlösung durch Codegenerierung und -ausführung.

Gemini 3.0 voraussichtlich im 1. Quartal 2026: Echtzeit-Videoverarbeitung mit 60 Bildern pro Sekunde, Kontextfenster mit mehreren Millionen Token, 3D-Objekterkennung, standardmäßig integriertes Reasoning (keine manuelle Umschaltung).

Wer nutzt es: Google Cloud-Kunden, Entwickler, die multimodale Anwendungen erstellen, und Unternehmen mit komplexen Anforderungen an die Dokumentenanalyse.

Einschränkungen: Die Antwortlatenz steigt bei sehr langen Kontexten. Rechenintensiv. Weniger ausgereiftes API-Ökosystem als OpenAI.

Lama 4 Scout

Einsatz: Eine einzelne H100-GPU (NVIDIA) verarbeitet 10 Millionen Token-Kontexte. Native Multimodalität mit einem frühen Fusionsansatz.

Wer nutzt es: Forscher, Organisationen, die Open-Source-Modelle bevorzugen, Entwickler, die eine Bereitstellung auf dem Gerät benötigen, Unternehmen, die eine Abhängigkeit von einem einzelnen Anbieter vermeiden wollen.

Einschränkungen: Die Leistung variiert je nach Hosting-Konfiguration. Für optimale Leistung sind erhebliche Investitionen in die Infrastruktur erforderlich. Weniger ausgereift als kommerzielle Modelle.

BLÜHEN

Weitgehend durch neuere Open-Source-Modelle (Llama 4, Mistral, DeepSeek) ersetzt. Auf Hugging Face weiterhin für Forschungs- und Bildungszwecke verfügbar.

Wer nutzt es noch: Forscher, die mehrsprachige Modelle untersuchen, Bildungseinrichtungen und Entwickler in ressourcenarmen Sprachgemeinschaften.

Einschränkung: Trainingsdaten aus dem Jahr 2022. Keine Aktualisierungen des Wissensstands. Neuere Open-Source-Modelle erzielen in den meisten Benchmarks bessere Ergebnisse.

Einen vergleichenden Überblick über die aktuellen LLMs finden Sie in unserem Artikel über Beispiele großer Sprachmodelle .

FAQs

Ein großes Sprachmodell ist ein KI-Modell, das entwickelt wurde, um menschenähnliche Texte durch die Analyse riesiger Datenmengen zu generieren und zu verstehen.

Diese grundlegenden Modelle basieren auf Deep-Learning -Techniken und umfassen typischerweise neuronale Netze mit vielen Schichten und einer großen Anzahl von Parametern, wodurch sie komplexe Muster in den Daten erfassen können, mit denen sie trainiert wurden.

Seien Sie der Erste, der kommentiert

Ihre E-Mail-Adresse wird nicht veröffentlicht. Alle Felder sind erforderlich.