Las aplicaciones basadas en LLM son cada vez más potentes y complejas, lo que dificulta la interpretación de su comportamiento.

Cada resultado del modelo se deriva de indicaciones, interacciones con herramientas, pasos de recuperación y razonamiento probabilístico que no pueden inspeccionarse directamente. La observabilidad de LLM aborda este desafío al proporcionar visibilidad continua sobre cómo operan los modelos en condiciones reales. Esto permite a las organizaciones supervisar la calidad, detectar fallos, solucionar problemas en flujos de trabajo de varios pasos y gestionar el rendimiento y los costes.

Herramienta | Lo mejor para |

|---|---|

Realizar experimentos frecuentes y comparar indicaciones/modelos con un control de versiones sólido y paneles de control. | |

Langfuse | Sistema de observabilidad de código abierto y autoalojado con trazas granulares y evaluaciones personalizables. |

Helicone | Configuración sin código para la monitorización básica, el seguimiento de costes y el almacenamiento en caché de las llamadas a la API de LLM. |

Langsmith | Creación de cadenas o agentes de varios pasos (especialmente con LangChain) con visibilidad detallada del rastro. |

Grupo de expertos | Evaluación automatizada, alertas y monitorización de la calidad de la producción. |

Pesos y sesgos (tejido W&B)

W&B Weave es la plataforma de observabilidad LLM de Weights & Biases para monitorizar, evaluar y optimizar aplicaciones de modelos de lenguaje. Weave realiza un seguimiento automático de cada llamada LLM mediante el decorador @weave.op, capturando entradas, salidas, costes, latencia y métricas de evaluación sin necesidad de configuración manual.

La plataforma realiza un seguimiento del uso de tokens y calcula los costos automáticamente, supervisa los tiempos de respuesta para detectar consultas lentas y mide la precisión comparando las predicciones con los resultados esperados. Se pueden comparar diferentes experimentos para ver qué modelo o solicitud funciona mejor. El seguimiento de errores muestra qué predicciones fallaron y por qué, mientras que el versionado automático conserva cada cambio de configuración para garantizar la reproducibilidad. Esto facilita la prueba de diferentes enfoques, la identificación de lo que funciona mejor y la depuración de problemas cuando los modelos cometen errores.

Panel de resumen de puntuación

Figura 1: Gráficos que muestran el panel de control de métricas de rendimiento del modelo, con un seguimiento de la precisión, el coste y las tendencias de latencia a lo largo del tiempo.

Las métricas de rendimiento se muestran en todas las ejecuciones de evaluación. El costo total, el uso de tokens y los tiempos de respuesta se visualizan con gráficos que muestran la evolución a lo largo del tiempo. Las métricas personalizadas, como la precisión y las tasas de error, aparecen en paneles separados. Las líneas de tendencia ayudan a detectar cuándo el rendimiento empeora o los costos aumentan inesperadamente, y el panel se actualiza automáticamente a medida que se completan las nuevas pruebas.

Vista de rastros

Figura 2: Tabla de seguimiento de la evaluación que muestra las versiones del modelo y los resultados de su clasificación de intenciones.

Cada ejecución de prueba se guarda con todos los detalles. Cada registro muestra qué modelo se utilizó, qué mensaje se envió y todas las configuraciones. Los indicadores de éxito o fracaso señalan si las pruebas se completaron correctamente. La columna de mensajes muestra el texto enviado al modelo para su verificación. Este registro permite comparar diferentes versiones, ver qué cambió entre ejecuciones y repetir cualquier prueba utilizando su configuración guardada.

Tabla de clasificación de comparación de modelos

Figura 3: Imagen que muestra la tabla de clasificación que compara las versiones del modelo clasificador de intenciones en función de las métricas de precisión y latencia.

Se pueden comparar diferentes modelos y configuraciones con los mismos datos de prueba. Las columnas muestran la precisión, las predicciones correctas, las puntuaciones y los tiempos de respuesta. El código de colores resalta en verde los modelos con mejor rendimiento. Esta comparación revela ventajas y desventajas, como una mayor precisión a costa de una menor velocidad o respuestas más rápidas con una precisión ligeramente inferior, lo que ayuda a elegir la configuración más adecuada para las necesidades de producción.

Control de versiones del modelo

Figura 4: Panel de configuración del clasificador de intenciones que muestra la configuración del modelo y los detalles de la versión.

Cada cambio de configuración crea automáticamente una nueva versión, manteniendo un historial completo. Los detalles de la versión muestran cuándo se realizaron los cambios, quién los hizo y el almacenamiento utilizado. La pestaña Valores muestra la configuración exacta, incluyendo el nombre del modelo, los parámetros y las versiones de las funciones. Este sistema de versiones garantiza que cualquier prueba se pueda repetir con la misma configuración, permite realizar un seguimiento de cómo ha evolucionado el rendimiento con el tiempo y posibilita la reversión a versiones anteriores si fuera necesario.

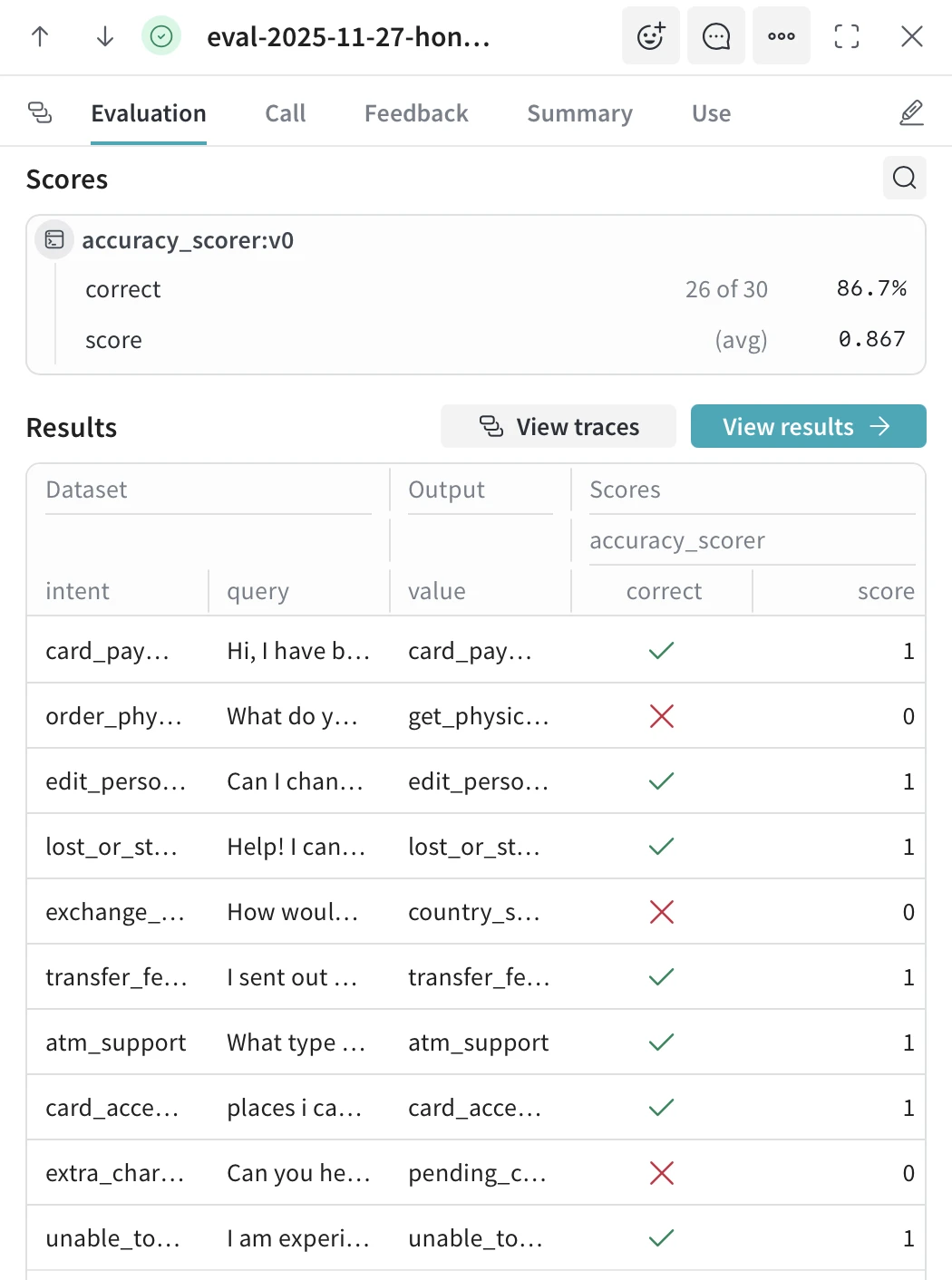

Resultados detallados de la evaluación

Figura 5: Resultados de la evaluación que muestran casos de prueba individuales con intenciones previstas y puntuaciones de precisión.

Se muestran los resultados de cada prueba individual para cada muestra. La sección de Puntuaciones resume el total de predicciones correctas, el porcentaje de precisión y las puntuaciones personalizadas.

La tabla de resultados muestra cada consulta con su respuesta esperada y la predicción del modelo, utilizando marcas de verificación para las respuestas correctas y cruces para las incorrectas. Las predicciones fallidas son fáciles de detectar, ya que suelen mostrar patrones como la confusión entre categorías similares.

Al hacer clic en cualquier fila, se abre el registro completo, que incluye la solicitud, la respuesta, el recuento de tokens y la sincronización, lo que facilita la depuración de fallos y la mejora de las solicitudes o la selección de modelos.

Langsmith

LangSmith es la plataforma de observabilidad de LangChain para monitorizar, depurar y evaluar aplicaciones LLM. Rastrea automáticamente cada llamada a LLM, captura las indicaciones y los resultados, realiza un seguimiento de los costes y la latencia, y permite una evaluación sistemática mediante pruebas basadas en conjuntos de datos. LangSmith se integra de forma nativa con LangChain, pero es compatible con cualquier aplicación LLM a través de su SDK.

Resultados de la evaluación por muestra

Figura 6: Imagen que muestra la evaluación de cada caso de prueba individual en función de las predicciones y las métricas de rendimiento.

Los resultados de las predicciones individuales se muestran junto con los resultados esperados, lo que permite identificar dónde se equivoca el modelo. La comparación entre las predicciones esperadas y las reales revela confusiones entre categorías semánticamente similares. La latencia por consulta y el recuento de tokens muestran qué tipos de entrada son más costosos de procesar, lo que permite optimizar las consultas lentas o costosas.

Monitoreo del volumen de trazas y de la salud

Figura 7: Gráfico que muestra la visualización del seguimiento del proyecto, registrando las tasas de éxito y error a lo largo del tiempo.

El estado de la aplicación se muestra mediante las tendencias del volumen de trazas y las tasas de éxito/error a lo largo del tiempo. Se ofrecen diferentes vistas para analizar las llamadas a LLM, las tendencias de costos, las invocaciones de herramientas o las puntuaciones de retroalimentación. Problemas como picos de errores o aumentos de costos se hacen visibles, lo que indica problemas que requieren investigación.

Comparación de modelos y configuraciones

Figura 8: Vista comparativa de experimentos que muestra las métricas de rendimiento en varias ejecuciones de prueba.

Se pueden comparar diferentes modelos en paralelo con el mismo conjunto de datos de prueba. Se muestran visualmente las ventajas y desventajas en cuanto a precisión, latencia (P50/P99) y eficiencia de tokens. Mediante estas comparaciones, resulta sencillo identificar la configuración que mejor se ajusta a los requisitos, ya sea maximizando la precisión o minimizando el coste y el tiempo de respuesta.

Langfuse

Langfuse es una plataforma de observabilidad LLM de código abierto diseñada para monitorizar, depurar y evaluar aplicaciones de modelos de lenguaje. Disponible como solución autoalojada y en la nube, Langfuse proporciona un seguimiento exhaustivo con captura automática de mensajes, resultados, costes y latencia.

La plataforma admite cualquier marco LLM mediante su SDK flexible y ofrece capacidades de evaluación integradas, incluyendo LLM como juez para la evaluación automatizada de la calidad. Langfuse realiza un seguimiento de las versiones de las indicaciones en todas las ejecuciones, lo que permite comparar las métricas de rendimiento entre diferentes formulaciones.

La recopilación de comentarios de los usuarios mediante valoraciones de pulgar hacia arriba o hacia abajo ayuda a identificar resultados de alta y baja calidad, mientras que la puntuación personalizada permite realizar un seguimiento de las métricas específicas de la aplicación. Las evaluaciones automatizadas pueden procesar miles de trazas a frecuencias de muestreo configurables, lo que permite una monitorización continua de la calidad a gran escala sin necesidad de revisar manualmente cada resultado.

Vista detallada del rastro

Figura 10: Registros de seguimiento que muestran los detalles de las llamadas a la API con datos de rendimiento y coste.

Los registros individuales muestran detalles completos de ejecución para cada llamada LLM. La vista de registro muestra mediciones exactas de latencia, consumo de tokens (tokens de solicitud y de finalización por separado) y costos calculados por solicitud.

Se conserva la configuración del modelo, incluyendo la temperatura, el número máximo de tokens y otros parámetros. La sección de vista previa muestra la solicitud completa enviada al modelo junto con la respuesta completa, lo que permite comprender con precisión qué recibió y generó el modelo.

Esta visibilidad granular permite depurar fallos específicos examinando el par exacto de entrada-salida que causó el error.

Tabla general de trazas

Figura 11: Inspección de traza individual que muestra los detalles de la solicitud y la respuesta del modelo.

Todos los rastros se agregan en una tabla filtrable que muestra los resultados, los niveles de observación, la latencia, el uso de tokens y los costos totales. Cada fila representa una llamada LLM individual con niveles de observación codificados por colores que indican la jerarquía o importancia del rastro. El recuento de tokens muestra tanto los tokens de solicitud como los de finalización, junto con los totales, mientras que los cálculos de costos se realizan automáticamente según el modelo utilizado.

El selector de columnas permite personalizar las métricas mostradas, y los filtros permiten refinar los registros por entorno, intervalo de tiempo u otros criterios. Esta vista tabular facilita la identificación de patrones como consultas persistentemente lentas o solicitudes inesperadamente costosas.

Grupo de expertos

Braintrust es una plataforma de observabilidad LLM que combina evaluación y monitorización de producción. La plataforma permite probar modelos con conjuntos de datos, comparar diferentes parámetros o configuraciones y realizar un seguimiento de las métricas de calidad mediante puntuación automatizada. Las funciones de evaluación integradas y personalizadas miden la precisión, la relevancia o criterios específicos del dominio, y los resultados se muestran en tablas comparativas que evidencian las diferencias de rendimiento entre versiones.

Para la monitorización de la producción, Braintrust realiza un seguimiento de métricas en tiempo real, como la latencia, el coste y las puntuaciones de calidad personalizadas, a medida que el tráfico fluye a través de las aplicaciones. Se activan alertas cuando se superan los umbrales de calidad o se infringen las medidas de seguridad. Brainstore, el sistema de almacenamiento de registros de la plataforma, ingiere los registros de las aplicaciones a gran escala con una búsqueda optimizada de interacciones de IA. El panel de control muestra métricas agregadas de experimentos y ejecuciones de producción, registrando el seguimiento de costes, el uso de tokens y los metadatos de respuesta tanto para las solicitudes de evaluación como para las de producción.

Helicone

Helicone es una plataforma de observabilidad basada en proxy que monitoriza las aplicaciones LLM enrutando las solicitudes API a través de su servidor proxy. La integración solo requiere cambiar la URL base, sin necesidad de instalar un SDK ni modificar el código. La plataforma captura automáticamente las solicitudes, las respuestas, los costes y el uso de tokens para monitorizar el comportamiento de la aplicación.

El panel de control muestra el volumen total de solicitudes, los costos agregados y el consumo de tokens en todas las llamadas a la API. Los registros de solicitudes muestran las indicaciones de entrada completas y los resultados del modelo, lo que permite investigar predicciones o errores específicos. El seguimiento de costos desglosa el gasto por tipo de modelo, usuario o etiquetas personalizadas para identificar operaciones costosas. El almacenamiento en caché integrado detecta solicitudes duplicadas y sirve respuestas almacenadas en caché, lo que reduce tanto los costos de la API como los tiempos de respuesta. La limitación de velocidad establece límites de uso por usuario o punto final para evitar picos de gasto inesperados.

La plataforma se centra en la monitorización de llamadas API individuales: cada solicitud aparece como una entrada de registro independiente, sin soporte integrado para agrupar llamadas relacionadas ni visualizar secuencias. Esto hace que Helicone sea práctica para aplicaciones como llamadas LLM independientes (por ejemplo, chatbots de una sola interacción), generación de contenido por lotes o tareas de clasificación, pero menos adecuada para el seguimiento de flujos de trabajo de varios pasos donde es importante comprender las relaciones entre llamadas secuenciales.

¿Qué es la observabilidad de LLM?

La observabilidad de los modelos de lenguaje a gran escala (LLM) consiste en recopilar e interpretar datos continuos de estos modelos para comprender su comportamiento en situaciones reales. Se centra en reunir métricas, trazas y registros que muestren cómo responden los LLM a diferentes indicaciones, herramientas y llamadas a API externas.

Dado que los modelos de lenguaje operan mediante razonamiento probabilístico, sus procesos internos no pueden inspeccionarse directamente. Esto hace que la monitorización de los modelos de lenguaje dependa del análisis de sus entradas y salidas, así como de los pasos intermedios que aparecen en los flujos de trabajo de los agentes . Al estudiar estos rastros, los desarrolladores de modelos de lenguaje obtienen visibilidad del rendimiento del sistema, el comportamiento del modelo y los patrones de uso que influyen en el rendimiento de la aplicación y la calidad de los resultados.

La observabilidad de LLM es vital por varias razones:

- Control de calidad: Los modelos de lenguaje de gran tamaño pueden generar resultados incorrectos o de baja calidad por diversas razones, como indicaciones poco claras, datos inconsistentes o comportamientos inesperados del usuario. El seguimiento de las indicaciones y respuestas a lo largo del tiempo ayuda a monitorizar métricas de evaluación como la corrección, la coherencia, la relevancia y la veracidad. Esto permite a los equipos detectar cuándo la calidad de las respuestas de los modelos de lenguaje de gran tamaño empieza a disminuir o cuándo el modelo comienza a generar errores . A medida que el uso de estos modelos se extiende a los flujos de trabajo empresariales, garantizar una precisión constante se convierte en un reto habitual.

- Solución de problemas: Cuando surgen problemas en las aplicaciones LLM, las causas raíz pueden provenir de diversas áreas. Algunos ejemplos incluyen indicaciones mal configuradas, ajustes finos defectuosos, llamadas a API externas fallidas o errores lógicos en flujos de trabajo de agentes de varios pasos. Al recopilar registros de LLM que muestran los pasos intermedios, los desarrolladores pueden realizar un análisis de la causa raíz de manera eficiente e identificar la etapa exacta en la que se produjo la divergencia. Esto reduce la necesidad de intervención humana y acorta el tiempo de seguimiento de errores.

- Optimización: El seguimiento del rendimiento del sistema, el uso de recursos y el uso de tokens ayuda a las organizaciones a identificar cuellos de botella y mejorar el rendimiento de LLM. Los equipos pueden medir la latencia, el rendimiento, el uso de memoria y las tasas de error para comprender cómo se comportan los LLM bajo diferentes niveles de carga. También pueden realizar un seguimiento de los tokens para controlar los costos y revisar los patrones de uso para mejorar el rendimiento y la eficiencia de costos . El monitoreo continuo de estas métricas clave es especialmente valioso en la generación aumentada por recuperación y los flujos de trabajo de agentes, donde los cuellos de botella de rendimiento suelen surgir de llamadas a herramientas ineficientes o viajes de ida y vuelta innecesarios durante el razonamiento.

Categorías de métricas principales

Las herramientas de observabilidad de LLM suelen agrupar las métricas relevantes en tres categorías que dan soporte tanto a los equipos de desarrollo de software como a los equipos operativos.

Métricas de rendimiento del sistema

- Latencia: Mide el tiempo que transcurre entre la recepción de una solicitud y la entrega de una respuesta.

- Rendimiento: Indica cuántas solicitudes puede procesar el modelo en un período determinado.

- Tasas de error: Revela con qué frecuencia el sistema devuelve respuestas no válidas o fallidas.

Métricas de utilización de recursos

- Consumo de CPU y GPU: Ayuda a comprender la eficiencia con la que el sistema utiliza el hardware.

- Uso de memoria: Afecta a las decisiones de escalado y a la planificación de la capacidad.

- Uso de tokens: Influye en la eficiencia de costes y ayuda a los equipos a controlar los costes durante un uso intensivo de LLM.

- Compromisos entre rendimiento y latencia: Muestra cómo el sistema equilibra la velocidad y el volumen de procesamiento.

Métricas de comportamiento del modelo

- Corrección, veracidad y calidad de la respuesta: Para identificar resultados de baja calidad.

- Participación y comentarios de los usuarios: Proporcionan información sobre la eficacia con la que el modelo satisface las necesidades de los usuarios.

- Métricas de fidelidad y fundamentación: Reflejan qué tan fielmente se ajusta el modelo al material original.

Observabilidad manual frente a observabilidad autónoma

Depender de la observación manual presenta varios desafíos. Los modelos de lenguaje complejos generan grandes volúmenes de datos, y las cadenas de razonamiento de múltiples pasos producen numerosos registros y trazas. La necesidad de monitorización en tiempo real aumenta la complejidad operativa, e incluso los equipos experimentados tienen dificultades para revisar cada llamada a LLM sin pasar por alto señales esenciales. Los flujos de trabajo manuales también dificultan mantenerse al día con los cambios continuos en el comportamiento del usuario y las variaciones en las indicaciones.

Los sistemas de observabilidad autónoma abordan estos desafíos mediante agentes de software que analizan continuamente la actividad de los LLM. Estos agentes detectan anomalías, diagnostican problemas y realizan análisis de la causa raíz sin intervención humana constante. Las evaluaciones automatizadas también ayudan a identificar comportamientos de riesgo, como la inyección prematura.

Un sistema de este tipo permite la monitorización continua y garantiza un seguimiento constante de las métricas de evaluación en todo el modelo. Como resultado, las organizaciones se benefician de una resolución de problemas más rápida, un mejor rendimiento de las aplicaciones y un mayor control de los riesgos operativos.

Características de las herramientas de observabilidad LLM

Evaluaciones de calidad y seguridad

- Detección de alucinaciones para identificar cuándo el modelo se desvía de datos fiables.

- Inyección inmediata y detección de jailbreak para abordar los problemas de seguridad.

- Sistemas de puntuación de toxicidad y evaluaciones de seguridad que respaldan el cumplimiento normativo y la reducción de riesgos.

- Agrupación que agrupa resultados LLM similares para identificar desviaciones a lo largo del tiempo.

Características de experimentación

- Pruebas A/B para una gestión y cambios de configuración rápidos.

- Comparación rápida entre múltiples modelos LLM oparámetros .

- Evaluación de la precisión, el consumo de tokens y la latencia antes del despliegue.

- Probar los cambios del modelo con escenarios del mundo real utilizando datos similares a los de producción.

Correlación con la infraestructura

- Conectar los rastros de LLM con los datos de monitorización del rendimiento de las aplicaciones de backend.

- Vincular el tiempo de respuesta y la calidad de la respuesta con las sesiones reales de los usuarios.

- Identificar cómo el rendimiento del sistema afecta al rendimiento de LLM y a la estabilidad de la aplicación.

LLMOp y gobernanza

- Mecanismos de protección que filtran las indicaciones inseguras y bloquean las respuestas perjudiciales.

- Paneles de control para el seguimiento de la exposición a información de identificación personal, alucinaciones e infracciones de seguridad.

- Herramientas que facilitan el cumplimiento normativo, la elaboración de informes y el análisis de incidentes de seguridad.

Observabilidad para flujos de trabajo basados en agentes

A medida que los LLM impulsan flujos de trabajo de agentes de varios pasos, los requisitos de observabilidad se extienden más allá de los pares únicos de solicitud-respuesta. Las aplicaciones basadas en agentes introducen capas adicionales de complejidad que requieren enfoques de rastreo específicos.

Dimensiones clave de observabilidad para los agentes:

- Rastreo de planificación y razonamiento: Visibilidad de cómo el agente desglosa las tareas, selecciona acciones y refina su enfoque en función de los resultados intermedios.

- Monitorización de llamadas a herramientas: Seguimiento de llamadas a API externas, consultas a bases de datos y ejecuciones de funciones para identificar cuellos de botella o fallos de latencia.

- Seguimiento de transferencias: Para sistemas multiagente, se monitoriza cómo se transfieren las tareas entre agentes y si el contexto se conserva correctamente.

- Evolución del estado: comprender cómo cambian la memoria y el contexto a lo largo de múltiples turnos dentro de una sesión.

En conjunto, estas dimensiones forman la base de la monitorización de agentes . Las herramientas de observabilidad LLM, como Langsmith, Langfuse, AgentOps y Weights & Biases, proporcionan vistas de seguimiento específicas para cada agente que muestran gráficos de ejecución completos.

Preguntas frecuentes

Una buena solución de observabilidad permite una observación integral a lo largo de todo el ciclo de vida de las llamadas a LLM. Esto incluye cómo un modelo recibe una solicitud, selecciona herramientas, recupera datos de una fuente de datos y genera una respuesta final. La observabilidad es fundamental porque las aplicaciones LLM siguen aumentando en complejidad, y el número de aplicaciones basadas en LLM que dependen de razonamientos de varios pasos crece exponencialmente. Por lo tanto, las organizaciones necesitan herramientas de observabilidad que proporcionen monitorización en tiempo real y evaluación automatizada para garantizar un rendimiento uniforme en todas las aplicaciones LLM.

Las herramientas modernas de observabilidad de LLM buscan proporcionar una visión general detallada de cada acción dentro de las aplicaciones basadas en LLM. Esto incluye el seguimiento de cada llamada a LLM, cada interacción con la herramienta y cada paso intermedio que aparece en una cadena de razonamiento de agentes. La capacidad de observar todo el flujo de trabajo, desde la solicitud hasta la respuesta final, ayuda a los equipos a detectar comportamientos inesperados y comprender cómo los modelos LLM toman decisiones.

El análisis de costos y tokens también se ha vuelto esencial. El seguimiento en tiempo real del uso de tokens ayuda a las organizaciones a mantener la eficiencia de costos y evitar picos de gasto inesperados. Los equipos pueden desglosar el uso de tokens por proveedor, modelo, función o ruta de aplicación para comprender cómo los diferentes componentes contribuyen al costo. Algunas herramientas de observabilidad permiten a los usuarios comparar varios proveedores de LLM simultáneamente, lo que facilita la toma de decisiones sobre rendimiento y eficiencia de costos al enrutar solicitudes entre LLM de código abierto y opciones propietarias.

En todo el ecosistema, las herramientas de observabilidad consideran la observabilidad de LLM como un requisito indispensable para operar aplicaciones LLM a gran escala. Los equipos que dependen de flujos de trabajo de agentes necesitan visibilidad sobre cómo el modelo avanza a través de razonamientos de múltiples pasos y cómo cada decisión afecta su rendimiento. La observabilidad ayuda a garantizar respuestas consistentes y de alta calidad, detectar fallos con anticipación y mantener la confianza del usuario.

Otro tema importante es la necesidad de gestionar los costos operativos. El seguimiento del uso de tokens, memoria y recursos ayuda a las organizaciones a controlar el gasto, manteniendo el rendimiento y la eficiencia de costos. La observabilidad también revela cuellos de botella que influyen en la satisfacción del usuario y el rendimiento de la aplicación.

Finalmente, la observabilidad de los modelos LLM es crucial, ya que las organizaciones dependen cada vez más de ellos para funciones críticas. A medida que estos sistemas se expanden, las herramientas de monitorización deben ser independientes del marco de trabajo, integrarse con plataformas de código abierto y proporcionar información valiosa sobre múltiples servicios. Esto facilita una implementación segura, reduce los riesgos de seguridad y ayuda a los equipos a comprender los resultados del modelo en un contexto operativo más amplio.

Sé el primero en comentar

Tu dirección de correo electrónico no será publicada. Todos los campos son obligatorios.