Nous avons passé 3 jours à expérimenter avec des flux de travail et des pipelines d'agents dans n8n, en suivant les guides de Anthropic et OpenAI sur la construction d'agents d'IA efficaces. 1 2

Explorez les composants de base des agents d'IA , comment choisir les bons composants et outils, ainsi que la création de flux de travail d'agents basés sur les modèles simples et composables de Anthropic tels que l'enchaînement d'invites, le routage, la parallélisation, les travailleurs d'orchestration et un évaluateur-optimiseur :

Comprendre les composantes des agents d'IA

La création d'agents implique la connexion de composants issus de plusieurs domaines tels que les modèles, les outils, les connaissances et la mémoire, ainsi que les garde-fous. OpenAI fournit des primitives composables pour chacun d'eux :

Source : OpenAI 3

Bien entendu, OpenAI présente ses propres éléments en premier, mais il existe un vaste écosystème d'alternatives. Selon votre cas d'utilisation, vous pouvez créer des agents à l'aide de frameworks tels que LangChain, LlamaIndex, CrewAI, ou même de couches d'orchestration personnalisées.

Je vais détailler davantage chacun de ces composants :

Modèles

Premièrement, il y a le composant « modèles ». Ce sont vos modèles d'IA, vos grands modèles de langage qui constituent l'intelligence centrale capable de raisonner, de prendre des décisions et de traiter différentes modalités. Bien sûr, les exemples que OpenAI nous donne sont GPT-5 , etc.

En fonction du type spécifique d'agent que vous construisez, vous voudrez choisir un type de modèle différent au sein de l'écosystème OpenAI.

GPT-5 est votre modèle phare. C'est un modèle de pensée performant en matière de raisonnement et de résolution de problèmes complexes, et particulièrement efficace pour répondre à la plupart des questions.

En dehors de l'écosystème OpenAI, Claude 4.5 Sonnet est généralement le modèle de référence pour les personnes qui font beaucoup de codage, de raisonnement et de tâches basées sur les STIM, bien que Gemini 2.5 Pro soit en train de le contester en ce moment.

Cependant, OpenAI affirme que le GPT-5.2-Codex est le modèle de codage le plus avancé pour permettre aux développeurs de résoudre des problèmes complexes et concrets d'ingénierie logicielle. Le OpenAI-Codex affiche des performances comparables sur des outils d'évaluation de la performance tels que TerminalBench et SWE-bench. 4

Nous avons évalué et comparé les meilleurs modèles d'IA pour vous aider à comprendre leurs performances en termes de raisonnement, de vitesse et de coût, afin que vous puissiez choisir celui qui correspond le mieux à vos objectifs.

Outils

Viennent ensuite les outils qui étendent les capacités du modèle, comme la possibilité de faire des recherches sur le Web ou d'interagir avec d'autres systèmes.

Presque n'importe quelle application peut devenir un outil pour votre IA. Vous pouvez la connecter à Gmail, Agenda, votre Drive ou à des applications comme Slack, Discord, YouTube, Salesforce et Zapier. Vous pouvez même créer vos propres outils personnalisés.

Avec le SDK Agents de OpenAI (qui nécessite un peu de codage), vous pouvez définir des outils ou utiliser des outils intégrés comme la recherche Web, la recherche de fichiers et l'utilisation de l'ordinateur. 5

Le protocole MCP (Model Context Protocol) (Anthropic) simplifie également l'intégration des outils en standardisant la manière dont les modèles y accèdent. En 2026, la valeur ajoutée pour l'entreprise proviendra de plus en plus des « chaînes de montage numériques », des flux de travail multi-étapes guidés par l'humain où plusieurs agents exécutent des processus de bout en bout, rendus possibles par le protocole MCP.

Si vous n'êtes pas adepte du codage,les plateformes no-code telles que n8n vous permettent de glisser-déposer des outils pour les lier à votre modèle.

Connaissance et mémoire

Il existe deux principaux types de mémoire : la base de connaissances (mémoire statique) et la mémoire persistante .

- La base de connaissances permet à votre IA d'accéder à des faits, des politiques et des documents statiques qui restent relativement inchangés. Ceci est essentiel pour les agents effectuant des tâches régies par des politiques ou spécifiques à l'entreprise, pour lesquelles les documents de référence doivent rester cohérents.

- La mémoire persistante permet à l'IA de se souvenir des interactions passées d'une session à l'autre. C'est essentiel pour les chatbots ou les assistants personnels qui doivent se rappeler des conversations antérieures.

OpenAI fournit des services hébergés tels que des magasins de vecteurs , la recherche de fichiers et des embeddings pour gérer la mémoire.

Si vous préférez les solutions open-source, Pinecone (native du cloud et optimisée pour la recherche vectorielle) et Weaviate sont des options populaires.

Pour ceux qui utilisent des outils sans code , la gestion de la mémoire est généralement intégrée aux plateformes comme n8n et Creatio .

Pour en savoir plus, consultez : Création d’un agent de recherche en IA doté de mémoire

garde-corps

Des garde-fous garantissent que votre agent se comporte comme prévu, en évitant les réponses hors sujet, nuisibles ou inappropriées. Par exemple, un chatbot de service client doit rester concentré sur les sujets liés au service et ne pas s'égarer sur des sujets sans rapport.

En dehors de l'écosystème de OpenAI, des outils populaires comme Guardrails AI et LangChain Guardrails sont également utilisés. De nombreuses plateformes no-code intègrent déjà des fonctionnalités de garde-fous, mais il est essentiel de comprendre leur fonctionnement pour garantir le contrôle et la conformité de vos agents.

Orchestration

La dernière étape est l'orchestration. Celle-ci consiste à gérer la manière dont plusieurs sous-agents interagissent, à les déployer en production et à surveiller leurs performances.

Une fois déployés, les agents nécessitent une supervision continue. Les modèles, les données et les comportements évoluent, c'est pourquoi les mises à jour et les améliorations continues sont essentielles.

Plusieurs plateformes/frameworks prennent en charge l'orchestration, comme :

- Plateformes low-code/no-code :

- Stack AI

- Microsoft Créateur d'agents Copilot Studio

- Pertinence IA, etc.

- Frameworks open source :

- IA d'équipage, conçue pour les systèmes multi-agents

- LangChain, largement utilisé pour la gestion et le déploiement des interactions entre agents

- LlamaIndex, particulièrement performant pour les agents manipulant de nombreux documents et les applications de bases de connaissances.

Éléments constitutifs de l'automatisation : flux de travail vs agents

Un agent d'IA est un système qui perçoit son environnement, traite les informations et prend des mesures autonomes pour atteindre des objectifs spécifiques, comme les agents de codage tels que Cursor ou Windsurf, des éditeurs de code alimentés par l'IA avec des « modes agent » qui peuvent effectuer de manière autonome des tâches de codage à l'aide de modèles tels que Claude Sonnet 4.5. Un autre exemple courant est celui des agents du service client , que de nombreuses entreprises utilisent pour traiter les demandes.

Il existe de nombreuses façons différentes de concevoir et de déployer ces agents, en fonction de la complexité du flux de travail et du degré d'autonomie requis.

Pour vous donner un aperçu rapide, un agent d'IA est souvent un ensemble de sous-agents, chacun effectuant des tâches spécifiques. Ensemble, ces sous-agents se coordonnent au sein de systèmes multi-agents pour former ce que nous percevons comme un seul agent d'IA.

Ces concepts sont fondamentalement différents des flux de travail. Les flux de travail sont des séquences orchestrées d'étapes prédéfinies, comme une recette qui suit toujours le même ordre :

Quand utiliser des agents d'IA

Avant d'aborder des exemples d'implémentation de flux de travail pour la création d'agents d'IA, il convient de rappeler que les agents d'IA ne sont pas des cadres rigides. De nombreuses équipes constatent que les flux de travail traditionnels restent performants, même dans des scénarios où l'utilisation d'agents serait théoriquement possible.

L'une des manières les plus claires d'aborder ce sujet, décrite dans le blog de Anthropic, est la suivante :

Cela dit, il existe des situations réelles où les agents surpassent les flux de travail traditionnels dans les tâches qui exigent flexibilité, raisonnement et adaptabilité :

Des conversations dynamiques qui nécessitent des adaptations :

Certaines interactions, comme les demandes de remboursement ou de réinitialisation de mot de passe, s'intègrent facilement aux flux de travail. Mais d'autres exigent un jugement nuancé ou des décisions contextuelles, telles que les recommandations personnalisées, qui dépendent fortement du contexte et d'un raisonnement itératif.

Prise de décision à forte valeur ajoutée et à faible volume :

Les agents peuvent être coûteux à gérer, mais dans certains cas, les décisions qu'ils soutiennent sont bien plus coûteuses si elles sont prises à tort.

Par exemple, BCG a rapporté qu'un important fournisseur d'énergie en Allemagne a utilisé un outil multi-agents basé sur GenAI pour automatiser les vérifications de paiement. 6

Dans le cadre de la planification d'infrastructures à grande échelle, comme l'optimisation de conceptions techniques, le coût du calcul est négligeable. Dans ces situations critiques, les agents apportent une réelle valeur ajoutée car le coût d'une erreur dépasse largement le coût d'exécution du modèle.

Flux de travail à plusieurs étapes et imprévisibles :

Certains flux de travail sont tellement complexes que l'écriture d'innombrables règles « si ceci, alors cela » devient un projet à part entière.

Dans ces cas, les boucles d'agents simplifient le chaos. Au lieu de coder en dur chaque chemin possible, le modèle décide dynamiquement de la prochaine étape en fonction du contexte et du raisonnement en temps réel.

Cette approche fonctionne bien pour les systèmes ou outils de diagnostic qui gèrent des dizaines de variables changeantes.

Quand les flux de travail sont meilleurs

Scénarios à haute fréquence et faible complexité :

Certaines tâches dépendent davantage de la vitesse et de l'échelle que du raisonnement, comme :

- Récupération d'informations à partir d'une base de données

- Analyse des messages ou courriels structurés

- Répondre aux questions de type FAQ

Un flux de travail pourrait traiter des milliers de ces requêtes, avec un coût et une latence plus prévisibles qu'un agent.

Introduction aux flux de travail et aux implémentations des agents d'IA

Maintenant que nous avons abordé les flux de travail des agents d'IA et leurs composants, passons à leur implémentation concrète. Comme mentionné précédemment, les agents d'IA ne constituent généralement pas une entité unique. Ils sont plutôt composés de divers sous-agents interagissant entre eux. L'une des meilleures ressources que j'ai trouvées sur les flux de travail et les systèmes d'agents courants est le guide « Building Effective Agents » de Anthropic. 7 Analysons cela.

Au cœur des systèmes agentiques se trouve ce que Anthropic appelle le LLM augmenté . Cette structure se compose de trois éléments clés :

- l'entrée,

- le modèle de langage étendu (LLM),

- et le résultat.

Source : Anthropic 8

Le LLM augmenté est capable de générer ses propres requêtes de recherche, de sélectionner les outils pertinents et de décider quelles informations stocker en mémoire.

Vous remarquerez peut-être des similitudes avec les composants de OpenAI (décrits ci-dessous). Cependant, cette version est plus simplifiée et ne comporte pas d'éléments tels que les garde-fous et l'orchestration, mais sa structure de base reste identique. Cela est tout à fait acceptable. Pour des tâches comme les tests et le déploiement, il est préférable de se référer aux composants de OpenAI.

Liste des composants d'agents d'IA de OpenAI 9

Ces éléments constitutifs LLM augmentés sont également appelés sous-agents . Voyons maintenant comment ces sous-agents s'assemblent et interagissent pour former un agent d'IA plus complexe. Nous commencerons par les flux de travail les plus simples et progresserons graduellement vers des systèmes plus complexes et entièrement autonomes.

1. Flux de travail d'agents simples (enchaînement d'invites)

Le flux de travail multi-agents le plus simple est appelé chaînage d'instructions. Dans ce processus, une tâche est décomposée en une série d'étapes, où chaque sous-agent traite la sortie du précédent.

En substance, ce système fonctionne comme une chaîne de montage, mais des points de décision permettent de réorienter le flux si nécessaire. Le schéma général reste le même : une entrée est traitée par un sous-agent, qui transmet le résultat à un autre sous-agent pour un traitement ultérieur, et ainsi de suite, jusqu’à l’obtention de la sortie finale. Cette méthode est particulièrement utile pour les tâches facilement décomposables en sous-tâches séquentielles plus petites.

Le flux de travail d'enchaînement d'invites 10

Exemple concret : 11

Enchaînement rapide dans n8n (planifier, évaluer et publier sur des feuilles)

Dans l'exemple ci-dessus, l'utilisateur saisit un sujet dans la fenêtre de chat n8n. Chaque nœud LLM utilise le modèle Azure OpenAI.

Le premier module LLM consiste à élaborer un plan structuré pour un article de blog. La consigne pour la rédaction du plan est la suivante :

Capture d'écran de l'invite du générateur de plan LLM

Où {{ $json.chatInput }} fait référence au sujet saisi par l'utilisateur dans la fenêtre de chat.

La variable {{ $json.chatInput }} est grisée car le flux de travail n'a pas encore été exécuté. Si le nœud avait déjà été exécuté ou testé, elle serait verte ou rouge, selon sa validité.

Ensuite, le module LLM suivant évaluera le plan en fonction des critères clés indiqués dans la section des messages système. L'invite se trouve ci-dessous :

Le dernier module de maîtrise en rédaction de blogs (LLM) ajoutera une ligne à une feuille de calcul sur le sujet, en se basant sur le plan établi par le module LLM précédent.

Capture d'écran du sujet du LLM en rédaction de blogs

Quand utiliser l'enchaînement d'invites :

- Les tâches peuvent être naturellement décomposées en sous-tâches fixes et séquentielles.

- Chaque étape contribue de manière significative au résultat final

- Le raisonnement étape par étape améliore la précision par rapport au traitement direct.

- Des points de contrôle qualité sont nécessaires tout au long du processus.

2. Flux de travail de routage

Le routage est un autre type de flux de travail où une entrée est reçue, et un sous-agent est chargé de la diriger vers la tâche de suivi appropriée. Chaque tâche est ensuite traitée par un sous-agent spécialisé dans ce domaine, et une fois les tâches terminées, le résultat final est généré.

Un exemple classique de routage se trouve dans les chatbots de service client. Le chatbot peut recevoir différents types de requêtes, comme des demandes d'informations générales, des demandes de remboursement ou des problèmes d'assistance technique. Le premier sous-agent identifie la nature de la requête et la transmet au sous-agent spécialisé dans le traitement de ce problème particulier.

Par exemple, si la demande concerne un remboursement, elle sera transmise au sous-agent spécialiste des remboursements, tandis qu'une question d'assistance technique sera adressée au sous-agent d'assistance technique.

Un autre exemple consiste à acheminer les questions vers différents modèles en fonction de leurs points forts. Pour les questions plus complexes liées aux sciences, technologies, ingénierie et mathématiques (STEM), vous pourriez acheminer les données vers un modèle comme Claude Sonnet 4.5. Pour les requêtes plus simples et plus rapides, vous pourriez opter pour un modèle comme Gemini Flash, optimisé pour la vitesse.

Exemple concret : 12

Dans l'exemple ci-dessus, l'agent achemine les entrées de l'utilisateur vers des agents spécialisés (comme un agent de rappel, un agent de messagerie, etc.) en utilisant une sortie structurée provenant d'un modèle de langage.

Le routeur est connecté à GPT 4o mini. L'invite et les catégories sont les suivantes :

Capture d'écran des paramètres du nœud de l'agent IA

Exemples de cas d'utilisation :

Vous pouvez saisir une requête dans la fenêtre de chat n8n, par exemple :

- L'utilisateur dit : « Rappelle-moi d'appeler ma mère demain. »

→ Redirection vers l'agent de rappel - L'utilisateur dit : « Envoyez un courriel à l'équipe des ressources humaines. »

→ Redirection vers l'agent de messagerie - L'utilisateur dit : « Planifiez une réunion avec John la semaine prochaine. »

→ Redirection vers l'agent de réunion

Quand utiliser le routage :

- Diversité des types d'entrées : Votre système reçoit différents types de requêtes qui nécessitent un traitement spécialisé.

- Optimisation des ressources : Vous souhaitez affecter les requêtes simples à des processeurs économiques et acheminer les requêtes complexes vers des systèmes avancés.

- Spécialisation du domaine : Différentes catégories d’entrées nécessitent une expertise ou une logique de traitement spécifiques au domaine.

- Optimisation des performances : vous devez équilibrer la charge et garantir des temps de réponse optimaux pour différents types de requêtes.

3. Flux de travail de parallélisation

L'étape suivante est la parallélisation. Ce type de flux de travail multi-agents présente généralement deux variantes principales. En parallélisation, plusieurs sous-agents travaillent simultanément sur une tâche, et leurs résultats sont ensuite combinés.

- La première variante est appelée sectionnement , où une tâche est décomposée en sous-tâches indépendantes qui s'exécutent en parallèle.

- La deuxième variante est le vote , où la même tâche est effectuée plusieurs fois par différents sous-agents pour produire des résultats divers, qui sont ensuite agrégés.

Cela permet d'obtenir une automatisation modulaire plus rapide, notamment dans les flux de travail importants.

Comparaison du temps d'exécution entre un flux de travail séquentiel et un flux de travail parallèle 13

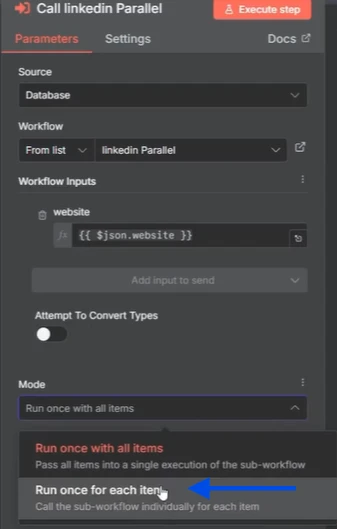

Exemple concret : 14

Capture d'écran de l'exemple de flux de travail de parallélisation dans n8n

L'exécution parallèle dans l'exemple n8n illustre une tâche où le flux de travail interroge la recherche Google à l'aide de l'API SERP pour récupérer les URL LinkedIn et les stocker dans une feuille Google. Lors de la configuration initiale, le flux de travail traite chaque tâche séquentiellement, un site web à la fois :

- Le flux de travail est déclenché.

- L'outil Get récupère le site Web à partir de la feuille Google.

- L'agent IA utilise l'API SERP pour rechercher Google et récupérer l'URL LinkedIn.

- L'URL LinkedIn est ensuite mise à jour dans la feuille Google.

À ce stade, les tâches sont traitées une à une, ce qui peut s'avérer lent lorsqu'il s'agit de grands ensembles de données.

n8n possède cette fonctionnalité qui vous permet de sélectionner des nœuds, de cliquer, puis de dire « Je veux convertir ces nœuds sélectionnés en un sous-flux de travail ».

Lorsque vous cliquez sur ce bouton, le nom de mon flux de travail est créé. En confirmant, tout cela devient un sous-flux de travail, déjà lié ici et appelé par cet élément.

Le sous-flux de travail créé

Donc n8n a transformé cela en un sous-flux de travail, mais vous n'avez pas encore de parallélisation car cela s'exécuterait toujours ici.

Pour que ce processus s'exécute réellement en parallèle, chaque élément doit être exécuté individuellement. Ainsi, lorsque vous cliquez sur le nœud, vous pouvez choisir « Exécuter une fois pour chaque élément », ce qui signifie que le sous-flux de travail sera appelé individuellement pour chaque élément.

Une fois cette modification effectuée, accédez au sous-flux de travail et cliquez sur « Exécutions ». Vous constaterez alors que les trois éléments s'exécutent simultanément.

Quand utiliser la parallélisation : La parallélisation est plus efficace lorsque les tâches peuvent être divisées en sous-tâches plus petites et indépendantes pouvant s’exécuter simultanément, améliorant ainsi la vitesse et l’efficacité.

Il est également précieux de considérer plusieurs perspectives ou d'effectuer des tentatives répétées afin d'obtenir une plus grande fiabilité des résultats. Pour les problèmes complexes impliquant plusieurs dimensions ou critères d'évaluation, les grands modèles de langage visent à être plus performants lorsque chaque aspect spécifique est traité par un appel de modèle distinct, permettant ainsi un raisonnement plus ciblé et précis pour chaque partie de la tâche.

4. Flux de travail des travailleurs de l'orchestrateur

Le flux de travail suivant, qui devient plus complexe, est le modèle orchestrateur-travailleur.

L'architecture orchestrateur-travailleur rend vos flux de travail n8n modulaires, évolutifs et adaptatifs, transformant une automatisation rigide unique en un système composable d'agents coopérants.

À première vue, cela pourrait ressembler à de la parallélisation puisque plusieurs sous-agents peuvent être actifs, mais la principale différence réside dans la flexibilité. Contrairement à la parallélisation, l'architecture orchestrateur-travailleur ne repose pas sur une liste fixe de sous-tâches. L'orchestrateur décide dynamiquement des tâches à effectuer, les assigne aux agents travailleurs et gère leur coordination tout au long du processus.

Exemple concret : 15

Capture d'écran de l'exemple de flux de travail orchestrateur-workers dans n8n

Dans l'exemple ci-dessus, le brief est recueilli une seule fois et un orchestrateur répartit le travail entre plusieurs agents spécialisés.

L'agent PDG joue le rôle de coordinateur. Il traite le brief initial, l'adapte à chaque service, sélectionne les agents à activer et détermine l'intégration de leurs résultats. Il peut mobiliser un, deux ou tous les agents selon le contexte et les contraintes.

Capture d'écran du nœud de l'agent PDG

Ci-dessous, trois agents de traitement, Marketing, Opérations et Finance, exécutent chacun leur propre modèle de conversation OpenAI avec des configurations de mémoire et d'outils distinctes. Ceci permet des invites spécifiques à chaque service et des schémas JSON pour une sortie structurée.

Capture d'écran des trois nœuds d'agents de travail

Une fois que l'orchestrateur a préparé les instructions spécifiques à chaque département, il invoque chaque travailleur comme un outil pour générer des résultats à partir des entrées.

Par exemple, l'agent marketing crée des campagnes (nom, canal, KPI).

Nœud d'outil d'IA (Agent marketing)

Une fois les résultats des employés générés, l' agent du PDG compile et fusionne les réponses des différents services en un plan unique et cohérent. Le flux de travail enregistre ensuite ce plan dans un document (Google), ajoute des métadonnées, le convertit au format PDF et le télécharge automatiquement pour partage ou révision.

Capture d'écran des nœuds de création, de conversion et de chargement de documents

Lors de son exécution, l'orchestrateur détermine quels agents activer, coordonne leur collaboration et combine leurs résultats dans un rapport complet, démontrant ainsi comment les flux de travail orchestrateur-travailleur permettent des systèmes d'IA flexibles, modulaires et composables.

Quand utiliser le workflow des orchestrateurs : cette approche est particulièrement précieuse pour résoudre des problèmes ouverts ou évolutifs dont les étapes nécessaires ne peuvent être connues à l’avance.

Exemples d'utilisation du flux de travail orchestrateur-travailleur :

- Tâches de codage : lors du développement ou du débogage de logiciels complexes nécessitant des modifications coordonnées entre plusieurs fichiers, où les fichiers et les modifications exacts peuvent être déterminés pendant l’exécution.

- Recherche et collecte d'informations : Dans les tâches qui impliquent la recherche, la collecte et l'analyse de données provenant de sources multiples, où les informations pertinentes ne peuvent pas être entièrement identifiées à l'avance et doivent être découvertes de manière dynamique.

5. Flux de travail de l'évaluateur-optimiseur

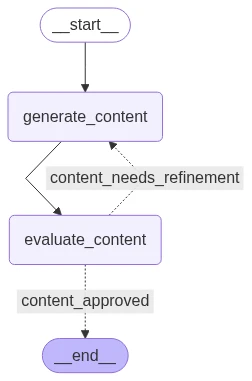

Le flux de travail évaluateur-optimiseur est encore plus complexe. Cette configuration tend vers un comportement plus autonome, conférant au sous-agent ou à l'agent IA une plus grande liberté de décision quant aux actions à entreprendre et à la manière d'améliorer ses propres résultats.

On commence par une donnée d'entrée, et le premier sous-agent génère une solution proposée. Cette solution est ensuite transmise à un sous-agent évaluateur, qui l'examine. Si l'évaluateur la juge satisfaisante, la solution est validée. Dans le cas contraire, il la renvoie au premier sous-agent avec des suggestions d'amélioration.

Cela crée une boucle de rétroaction continue dans laquelle l'optimiseur affine itérativement sa sortie jusqu'à ce que l'évaluateur détermine qu'elle répond aux normes de qualité requises.

Exemple concret : 16

Pour cet exemple, j'ai utilisé une simulation Python plutôt qu'un outil sans code afin de montrer directement les schémas d'évaluation, la logique personnalisée et les boucles itératives.

Il ne s'agit pas d'une configuration complète. Pour exécuter le flux de travail évaluateur-optimiseur de bout en bout, vous aurez besoin d'une configuration d'environnement appropriée, d'une initialisation du modèle et d'une configuration du schéma, etc.

Vous pouvez également mettre en œuvre une boucle évaluateur-optimiseur à l'aide d'outils d'automatisation des flux de travail prenant en charge les nœuds d'évaluation.

Flux de travail évaluateur-optimiseur avec Python :

Un exemple de boucle évaluateur-optimiseur, un modèle courant dans les systèmes d'IA autoréflexifs ou les flux de travail agentiels.

Ce flux de travail représente une boucle automatisée de génération et d'évaluation de contenu où deux composants collaborent : l'un crée, l'autre vérifie. Il garantit que les résultats répondent aux normes de qualité avant leur finalisation.

Explication étape par étape :

- Initialiser l'entrée : Créer initial_state = {“content_topic”: topic}.

- Exécutez la boucle : appelez evaluator_optimizer_workflow.invoke(initial_state) qui, de manière itérative :

- génère/affine le contenu,

- évalue la qualité,

- se répète jusqu'à approbation ou jusqu'à ce qu'une limite maximale d'itérations soit atteinte.

- Résultat du journal : Imprimer le message d’achèvement et le contenu généré approuvé.

- Résultats de retour : dictionnaire final_state (par exemple, content_topic, generated_content, quality_assessment).

Visualisation du flux de travail :

Boucle d'évaluation-optimisation avec résultats Python : chaque cycle utilise les retours précédents pour améliorer le contenu. La boucle produit finalement un contenu conforme aux normes de qualité.

Quand utiliser le flux de travail d'optimisation d'évaluation : Ce flux de travail est particulièrement utile lorsqu'il existe des critères d'évaluation clairs et lorsque l'amélioration itérative peut conduire à des améliorations significatives de la qualité.

Exemples d'utilisation du flux de travail évaluateur-optimiseur :

- Par exemple, dans le cadre d'une traduction littéraire, la première version peut ne pas saisir certaines nuances linguistiques ou tonalités émotionnelles. L'évaluateur fournira alors des commentaires et demandera des corrections jusqu'à ce que la traduction restitue pleinement le sens et les subtilités du texte original.

- Un autre exemple concerne l'agrégation de recherches complexes : l'optimiseur collecte et synthétise les informations tandis que l'évaluateur en vérifie la profondeur, l'exhaustivité et l'exactitude. Si l'évaluateur juge la recherche insuffisante, il la renvoie pour complément d'information jusqu'à ce que le rapport final réponde à toutes les exigences et synthétise efficacement les informations nécessaires.

6. Implémentation d'agents véritablement autonomes

Enfin, il y a l'implémentation d'agents véritablement autonomes. Ce type de système est conceptuellement simple, mais peut produire en pratique des comportements très divers et complexes.

L'agent démarre son fonctionnement avec une intervention humaine minimale ; généralement une seule instruction ou un seul objectif. Une fois la tâche définie, il fonctionne de manière autonome, en agissant et en observant les effets de ses actions sur l'environnement.

L'auto-évaluation est une caractéristique essentielle de cette approche : l'agent doit déterminer, à partir des retours de son environnement, si ses actions le rapprochent de l'objectif. Par exemple, s'il exécute du code ou utilise des outils externes, il doit évaluer si ces actions contribuent à sa progression ou si des ajustements sont nécessaires. Ce cycle d'auto-évaluation se poursuit jusqu'à ce que l'agent détermine que l'objectif a été atteint ou qu'aucune progression supplémentaire n'est possible.

Exemple concret :

Dans notre évaluation comparative des outils de codage IA , nous avons observé que Windsurf et Cursor ont démontré des capacités d'agent en créant de manière autonome des structures de fichiers, en éditant plusieurs fichiers et en exécutant des commandes de terminal pour déployer des API sur Heroku.

Windsurf s'est même adapté aux récents changements de plateforme, lorsqu'il a découvert que l'extension PostgreSQL Hobby Dev était obsolète, il a correctement reconfiguré le déploiement pour utiliser PostgreSQL Essential 0.

Résumé

La conception d'agents d'IA vise moins à atteindre une autonomie totale qu'à créer des systèmes pertinents, transparents et fiables. Nos expériences sur n8n et les enseignements tirés des guides de Anthropic et OpenAI nous ont permis de constater que l'efficacité des agents repose sur des choix de conception judicieux.

Lors de la mise en œuvre d'agents, nous nous concentrons sur trois principes directeurs :

- Privilégiez une architecture simple. Commencez petit, construisez de manière modulaire et n'introduisez la complexité que lorsqu'elle améliore clairement les performances ou la flexibilité.

- Rendez le processus de raisonnement visible. Permettez aux utilisateurs et aux développeurs de voir comment l'agent planifie et prend des décisions, améliorant ainsi l'interprétabilité et le contrôle.

- Garantissez des interactions fiables entre les outils. Concevez des outils dont le périmètre est clairement défini, bien documenté et testé afin que les agents puissent agir de manière cohérente dans des environnements réels.

Soyez le premier à commenter

Votre adresse courriel ne sera pas publiée. Tous les champs sont obligatoires.