Große Bildverarbeitungsmodelle (LVMs) können visuelle Aufgaben wie Fehlererkennung, medizinische Diagnostik und Umweltüberwachung automatisieren und verbessern.

Wir haben drei Objekterkennungsmodelle – YOLOv8n, DETR und GPT-4o Vision – anhand von jeweils 1000 Bildern verglichen und dabei Metriken wie mAP@0,5, Inferenzgeschwindigkeit, FLOPs und Parameteranzahl gemessen. Um einen fairen Vergleich zu gewährleisten, wurden alle Bilder auf 800×800 Pixel skaliert und mit identischer Vorverarbeitung, Konfidenzschwellenwerten und IoU-basierten Matching-Kriterien evaluiert.

Benchmark für Objekterkennung: GPT-4o (Vision), YOLOv8n, DETR

mAP@0.5: Mittlere durchschnittliche Präzision bei einem Intersection over Union (IoU)-Schwellenwert von 0,5, der die Genauigkeit der Objekterkennung durch Ausgleich von richtig positiven und falsch positiven Ergebnissen misst.

Latenz (ms): Die durchschnittliche Verarbeitungszeit pro Bild, gemessen in Millisekunden, gibt die Geschwindigkeit des Modells an.

Vergleichsergebnisse

Die Objekterkennungsfähigkeiten von GPT-4o sind im Vergleich zu spezialisierten Modellen wie YOLOv8n und DETR weiterhin begrenzt.

Genauigkeit:

- DETR: mAP@0.5 = 0.55

- YOLOv8n: 0,20

- GPT-4o: 0,02

Diese Ergebnisse deuten darauf hin, dass GPT-4o für praktische Objekterkennungsaufgaben noch nicht geeignet ist.

Latenz:

- YOLOv8n: 365 ms

- DETR: 3145 ms

- GPT-4o: 5150 ms

YOLOv8n bietet die schnellste Inferenz, jedoch eine geringere Genauigkeit, während DETR eine bessere Genauigkeit auf Kosten einer langsameren Verarbeitung erzielt.

Alle Modelle wurden anhand von 800×800 Pixel großen Eingangsbildern auf Konsistenz geprüft. Parameteranzahlen und FLOPS waren für YOLOv8n und DETR verfügbar, nicht jedoch für GPT-4o, was einen vollständigen Vergleich der Recheneffizienz verhinderte.

Modellkomplexität:

- DETR: 41,52 Mio. Parameter , 59,56 GFLOPS

- YOLOv8n: 3,15 Mio. Parameter , 6,83 GFLOPS

Dies verdeutlicht die Effizienz von YOLOv8n für Echtzeitanwendungen, während DETR Geschwindigkeit gegen höhere Genauigkeit und einen höheren Rechenaufwand eintauscht. Fehlende Architekturdetails zu GPT-4o schränken eine tiefergehende Effizienzanalyse ein.

Unsere Benchmark-Methodik finden Sie hier.

Mögliche Gründe für die Leistungsunterschiede

Die drei Modelle zeigten unterschiedliche Genauigkeits- und Geschwindigkeitswerte, da sie für verschiedene Zwecke entwickelt wurden und visuelle Informationen auf unterschiedliche Weise verarbeiten. GPT-4o ist ein multimodales, umfangreiches Sprachmodell, das sowohl Text als auch Bilder verarbeitet, während YOLOv8n und DETR Objekterkennungssysteme sind, die ausschließlich mit Bildern arbeiten.

GPT-4o interpretiert visuelle Eingaben mithilfe einer sprachgesteuerten Verarbeitungskette. Es kann Szenen beschreiben und Objekte identifizieren, ist aber nicht dafür ausgelegt, Begrenzungsrahmen zu zeichnen oder hochpräzise räumliche Lokalisierungen durchzuführen.

Seine Ergebnisse basieren auf multimodaler Argumentation anstatt auf spezifischen Erkennungsmechanismen. Dadurch ist es bei Erkennungsaufgaben langsamer und ungenauer.

YOLOv8n und DETR verwenden Architekturen, die speziell für die Objekterkennung entwickelt wurden. Sie generieren Begrenzungsrahmen direkt, anstatt diese zu berechnen.

YOLOv8n ist auf Geschwindigkeit optimiert und zeichnet sich durch eine leichte Struktur aus, während DETR ein transformatorbasierter Detektor ist, der Bilder anders als YOLO verarbeitet und auf genauere Vorhersagen abzielt.

Beide Modelle konzentrieren sich ausschließlich auf visuelle Eingaben und verfolgen Trainingsziele, die Bildmuster Objektpositionen zuordnen.

Zu den wichtigsten Unterschieden gehören:

- Eingabetyp

- GPT-4o: Bild und Text

- YOLOv8n und DETR: Nur Bild

- Hauptfunktion

- GPT-4o: Multimodales Verstehen und Schlussfolgern

- YOLOv8n und DETR: Objekterkennung

- Ausgabemechanismus

- GPT-4o: Zeichnet keine Begrenzungsboxen.

- YOLOv8n und DETR: direkte Vorhersage von Begrenzungsboxen

Da YOLOv8n und DETR ausschließlich für die Objekterkennung entwickelt wurden, schneiden sie naturgemäß bei Benchmarks, die auf Genauigkeit und Latenz abzielen, besser ab.

Der breite, nicht auf die Detektion ausgerichtete multimodale Ansatz von GPT-4o führt bei der Auswertung im gleichen Umfeld zu einem niedrigeren mAP und längeren Inferenzzeiten.

Detaillierte Auswertung großer Sehmodelle

OpenAI GPT-4o (Vision)

GPT-4o (Vision) ist eine multimodale Erweiterung von OpenAI's GPT-4, die entwickelt wurde, um sowohl Text als auch Bilder zu verarbeiten und Antworten daraus zu generieren.

Diese Fähigkeit erlaubt es GPT-4o, visuelle Inhalte zusammen mit textuellen Informationen zu interpretieren, wodurch eine Reihe von Anwendungen ermöglicht wird, die das Verstehen und Analysieren von Bildern erfordern.

- Bildinterpretation: GPT-4o kann den Inhalt von Bildern analysieren und beschreiben, einschließlich der Identifizierung von Objekten, der Interpretation von Szenen und der Extraktion von Textinformationen aus visuellen Darstellungen. Dies macht es nützlich für Aufgaben wie die Bildbeschreibung und die Inhaltszusammenfassung.

- Visuelle Datenanalyse: Das Modell kann Diagramme, Grafiken und Schaubilder interpretieren und auf Basis visueller Daten Erkenntnisse und Erklärungen liefern. Diese Funktion ist vorteilhaft für Datenanalyse- und Bildungsanwendungen.

- Multimodale Inhaltsanalyse: Durch die Kombination von Text- und Bildeingaben ermöglicht sie umfassendere Antworten. Sie verbessert zudem Anwendungen in der Social-Media-Analyse und Inhaltsmoderation. Beispielsweise kann sie Stimmungen analysieren oder Fehlinformationen in Beiträgen erkennen, die sowohl Text als auch Bilder enthalten.

Trotz seiner fortschrittlichen Fähigkeiten kann GPT-4o mitunter ungenaue oder unzuverlässige Ergebnisse liefern. Es kann visuelle Elemente falsch interpretieren, Details übersehen oder fehlerhafte Informationen generieren, weshalb bei kritischen Aufgaben eine menschliche Überprüfung erforderlich ist.

Das Modell kann auch Verzerrungen in seinen Trainingsdaten widerspiegeln, was zu verzerrten Interpretationen oder der Verstärkung von Stereotypen führen kann. Dies ist problematisch in sensiblen Anwendungsbereichen, in denen Unparteilichkeit von entscheidender Bedeutung ist, wie beispielsweise bei demografischen Schlussfolgerungen oder der Inhaltsmoderation.

OpenAI Sora

Sora ist ein Text-zu-Video-Modell, entwickelt von OpenAI. Es generiert kurze Videoclips anhand von Nutzereingaben und kann auch bestehende Videos erweitern. Die zugrundeliegende Technologie ist eine Anpassung des DALL-E 3-Modells.

Sora ist ein Diffusionstransformator, ein latentes Diffusionsmodell zur Rauschunterdrückung, das einen Transformer verwendet. Videos werden zunächst in einem latenten Raum durch Rauschunterdrückung von 3D-„Patches“ erzeugt und anschließend mithilfe eines Videodekompressors in den Standardraum konvertiert.

Die Neubeschreibung von Untertiteln dient der Verbesserung des Trainingsprozesses. Dabei generiert ein Video-zu-Text-Modell detaillierte Untertitel für Videos.

Dank der neuesten Entwicklungen können Nutzer nun Videos mit bis zu 1080p-Auflösung, einer maximalen Länge von 20 Sekunden und im Breitbild-, Hochformat- oder Quadratformat erstellen. Sie können außerdem eigene Inhalte einbinden, um bestehende Inhalte zu erweitern, neu zu mischen und zu kombinieren oder neue Videos anhand von Textvorgaben zu erstellen.

Abbildung 1: Soras Beispiel für die Videogenerierung anhand der Vorgabe: „Eine weite, ruhige Aufnahme einer Familie von Wollmammuts in einer offenen Wüste“. 1

Lande-KI-Landelinse

LandingLens vereinfacht die Entwicklung und den Einsatz von Computer-Vision-Modellen. Es eignet sich für verschiedene Branchen, ohne dass tiefgreifende KI-Kenntnisse oder komplexe Programmierkenntnisse erforderlich sind.

Die Plattform standardisiert Deep-Learning-Lösungen, verkürzt die Entwicklungszeit und ermöglicht die einfache globale Skalierung von Projekten. Ohne die Produktionsgeschwindigkeit zu beeinträchtigen, können Anwender ihre eigenen Deep-Learning-Modelle erstellen und die Inspektionsgenauigkeit optimieren.

Es bietet eine schrittweise Benutzeroberfläche, die den Entwicklungsprozess vereinfacht.

Abbildung 2: Das Diagramm veranschaulicht den LandingLens AI-Workflow, bei dem Eingabebilder zu Daten verarbeitet, zum Trainieren von Modellen verwendet, über Cloud, Edge oder Docker bereitgestellt und durch Feedback kontinuierlich verbessert werden. 2

Stabile Diffusion

Stable Diffusion ist ein Deep-Learning-Modell, das entwickelt wurde, um aus Textbeschreibungen qualitativ hochwertige Bilder zu erzeugen:

- Stabile Diffusion basiert auf Diffusion. Der Prozess beginnt mit dem Hinzufügen von zufälligem Rauschen zu einem Bild, und das Modell lernt dann, das Originalbild durch Umkehrung dieses Rauschens zu rekonstruieren.

- Dieser Prozess ermöglicht es dem Modell, völlig neue Bilder zu erzeugen, indem es die verrauschten Eingangsdaten in mehreren Schritten verfeinert, bis ein klares, zusammenhängendes Bild entsteht.

Stable Diffusion nutzt ein latentes Diffusionsmodell, um die Effizienz zu verbessern. Anstatt direkt mit hochauflösenden Bildern zu arbeiten, komprimiert es diese zunächst mithilfe eines Variations-Autoencoders (VAE) in einen niedrigdimensionalen latenten Raum.

Dieser Ansatz reduziert den Rechenaufwand erheblich und ermöglicht so die Ausführung auf handelsüblicher Hardware mit GPUs.

Anwendungsbereiche:

Neben der Erzeugung von Bildern aus Text kann Stable Diffusion für verschiedene kreative Aufgaben eingesetzt werden, wie zum Beispiel:

- Inpainting: Das Wiederherstellen oder Ausfüllen fehlender Teile eines Bildes.

- Outpainting: Die Ränder eines Bildes erweitern, um mehr Inhalt hinzuzufügen.

- Bild-zu-Bild-Übersetzung: Ein vorhandenes Bild wird anhand von Texteingaben in einen anderen Stil umgewandelt oder sein Erscheinungsbild verändert.

Mitte der Reise

Midjourney ist ein Kunstgenerator, der Textbeschreibungen in hochwertige Bilder umwandelt.

Fähigkeiten

Midjourney Version 7 zeichnet sich durch eine komplett neu aufgebaute Architektur mit deutlichen Verbesserungen in Qualität und Funktionalität aus.

Bildgenerierung : V7 erzeugt hochskalierte Bilder mit 2048 x 2048 Pixeln, die sich durch außergewöhnliche Schnelligkeit, Präzision und nahezu fotorealistische Qualität auszeichnen. Zu den wichtigsten Verbesserungen zählen detailreichere Texturen, die präzise Darstellung komplexer Elemente wie Hände und Gesichter sowie ein differenziertes Verständnis von Licht und Bildkomposition.

Videogenerierung : Erstellt 5- bis 21-sekündige Videoclips mit hoher Frame-zu-Frame-Konsistenz. Das System generiert aus sechs Bildern in etwa drei Stunden ca. 60 Sekunden Videomaterial und eignet sich für professionelle Anwendungen in Marketing, Filmproduktion und Content-Erstellung.

3D-Funktionen : Die Text-zu-3D-Generierung mittels NeRF-ähnlicher Modellierung erzeugt volumetrische Objekte und immersive Szenen. Diese Funktionen unterstützen die Spieleentwicklung, die Produktvisualisierung und Architekturanwendungen.

Abbildung 3: Die Bildbearbeitungsfunktion von Midjourney. 3

DeepMind Flamingo

DeepMinds Flamingo ist ein Bildverarbeitungsmodell, das entwickelt wurde, um Bilder und Videos mit minimalen Trainingsbeispielen (Few-Shot-Learning) zu verstehen und zu interpretieren. Hier einige der wichtigsten Merkmale:

- Multimodales Lernen mit wenigen Beispielen: Flamingo kann neue Aufgaben effizient mit nur wenigen Beispielen lösen, im Gegensatz zu traditionellen KI-Modellen, die umfangreiche, gelabelte Datensätze benötigen.

- Perceiver-Resampler-Mechanismus: Flamingo verwendet einen „Perceiver-Resampler“, um visuelle Eingaben effizient zu verarbeiten. Er komprimiert Bild- und Videodaten in ein Format, das in ein großes, vortrainiertes Sprachmodell integriert werden kann.

- Bild-Sprach-Angleichung mit Gated Cross-Attention-Layern: Spezielle Gated Cross-Attention-Layer helfen Flamingo, visuelle Daten mit textuellen Schlussfolgerungen abzugleichen und zu integrieren. Diese Anwendung kann für das Verständnis bildbasierter Konversationen von Bedeutung sein.

Flamingo verwendet eine framebasierte Verarbeitung, bei der Videos in Schlüsselbilder zerlegt und Informationen extrahiert werden, um visuelle Elemente effizient zu analysieren.

Die kontextbezogenen Reaktionen helfen dabei, Untertitel, Beschreibungen und Antworten auf der Grundlage des Handlungsablaufs innerhalb eines Videos zu generieren, um ein kohärentes Verständnis des Inhalts zu gewährleisten.

Flamingo verfügt zudem über zeitliches Denkvermögen, um Sequenzen, Ursache-Wirkungs-Beziehungen und komplexe Interaktionen im Zeitverlauf zu verstehen. Dies macht es äußerst effektiv für Videoanalysen und multimodale Denkaufgaben.

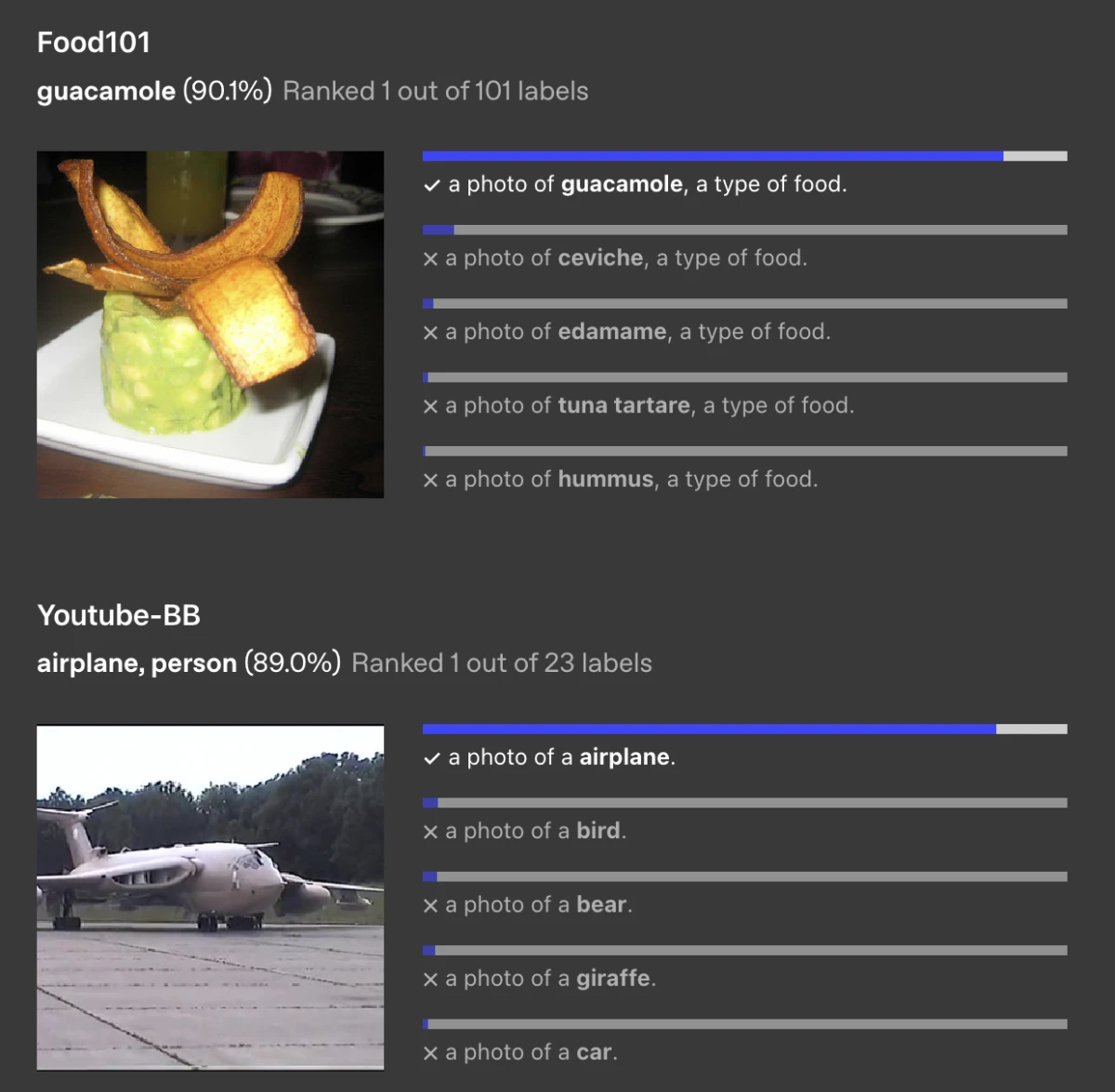

CLIP (Contrastive Language–Image Pretraining) OpenAI

CLIP ist ein neuronales Netzwerk, das mit einer Vielzahl von Bildern und Textunterschriften trainiert wurde.

Dieses Modell kann verschiedene Bildverarbeitungsaufgaben durchführen, einschließlich Zero-Shot-Klassifizierung, indem es Bilder im Kontext natürlicher Sprache versteht.

CLIP wurde anhand von 400 Millionen (Bild, Text)-Paaren trainiert, um die Lücke zwischen Computer Vision und natürlicher Sprachverarbeitung effektiv zu schließen. Dadurch kann CLIP Bildunterschriften vorhersagen oder Bildzusammenfassungen erstellen, ohne explizit für diese spezifischen Aufgaben trainiert worden zu sein.

Abbildung 4: Bildidentifizierung durch CLIP aus verschiedenen Datensätzen. 4

Googles Vision Transformer (ViT)

Vision Transformer wendet die ursprünglich in der Verarbeitung natürlicher Sprache verwendete Transformer-Architektur auf Bilderkennungsaufgaben an.

Es verarbeitet Bilder auf eine ähnliche Weise wie Transformatoren Wortfolgen verarbeiten, und hat sich als effektiv erwiesen, um relevante Merkmale aus Bilddaten für Klassifizierungs- und Analyseaufgaben zu lernen.

In Vision Transformer werden Bilder als eine Sequenz von Bildausschnitten behandelt. Jeder Bildausschnitt wird zu einem einzelnen Vektor vereinfacht, ähnlich wie Wort-Embeddings in Transformatoren für Text verwendet werden.

Dieser Ansatz ermöglicht es ViT, die Struktur des Bildes zu erlernen und selbstständig Klassenbezeichnungen vorherzusagen.

Videonative Foundation-Modelle

Videonative Grundlagenmodelle stellen einen grundlegenden Wandel gegenüber traditionellen Ansätzen der Computer Vision dar. Anders als frühere Systeme, die Videos als Sequenzen unabhängiger Einzelbilder verarbeiteten, behandeln diese Modelle die Zeit als integralen Bestandteil der visuellen Daten.

Wichtige architektonische Innovationen

OpenAIs Sora veranschaulicht diese Entwicklung durch seine Diffusionstransformator-Architektur:

- 3D-räumlich-zeitliche Patches : Verarbeitet Videodaten ganzheitlich anstatt Bild für Bild.

- Zeitliche Konsistenz : Gewährleistet visuelle Qualität und narrative Kohärenz über verschiedene Sequenzen hinweg.

- Langfristige Abhängigkeiten : Erfasst Ursache-Wirkungs-Beziehungen und Bewegungsmuster

- Physikbasierte Generierung : Versteht realistische Bewegungen und Objektinteraktionen

Aktuelle Anwendungen

Inhaltserstellung:

- Automatisierte Videobearbeitung und Szenensynthese

- Stiltransfer mit zeitlicher Konsistenz

- Erstellung von narrativen Videos anhand von Textvorgaben

Medizinische Bildgebung:

- Herzbewegungsanalyse in Echokardiogrammen

- Visualisierung des Blutflusses in der Angiographie

- Dynamische Beurteilung des Gewebeverhaltens

Sicherheit und Überwachung:

- Aktivitätserkennung und -verfolgung

- Anomaly Erkennung über die Zeit

- Kontextsensitive Verhaltensanalyse

Verbleibende Herausforderungen

Trotz der Fortschritte bestehen weiterhin einige Einschränkungen:

- Rechenaufwand : Die Erstellung von Langvideos bleibt ressourcenintensiv.

- Physikalische Plausibilität : Komplexe Szenarien können zu unrealistischen physikalischen Phänomenen führen.

- Charakterkonsistenz : Die Identität über längere Sequenzen hinweg aufrechtzuerhalten, ist schwierig

- Anforderungen an das Training : Umfangreiche Videodatensätze mit Annotationen sind selten und teuer.

On-Device-Inferenz und Edge-Optimierung

Edge-Deployment ermöglicht es, Bildverarbeitungsmodelle lokal auf Smartphones, IoT-Geräten und eingebetteten Systemen auszuführen, wodurch die Abhängigkeit von der Cloud-Infrastruktur entfällt.

Warum Edge-Bereitstellung wichtig ist

Datenschutzvorteile:

- Sensible Bilddaten verlassen das Gerät niemals.

- Unentbehrlich für Gesundheitswesen, Überwachung und persönliche Anwendungen

- Einhaltung der Datenschutzbestimmungen

Leistungsvorteile:

- Nahezu latenzfrei ohne Netzwerk-Roundtrips

- Echtzeitverarbeitung für AR- und autonome Systeme

- Zuverlässiger Betrieb in Offline-Umgebungen

Kosteneffizienz:

- Reduzierter Bandbreitenverbrauch

- Geringere Cloud-Computing-Kosten

- Minimale laufende Betriebskosten

Modellkomprimierungstechniken

Um große Bildverarbeitungsmodelle auf Edge-Geräten nutzbar zu machen, ist eine ausgefeilte Optimierung erforderlich:

- Quantisierung : Reduziert die Genauigkeit von 32-Bit auf 8-Bit- oder 4-Bit-Ganzzahlen.

- Kleinere Modellgröße

- Minimaler Genauigkeitsverlust

- Bereinigung : Entfernt redundante Parameter und Verbindungen

- Erzeugt dünn besetzte Netzwerke

- Erhält die Leistung bei weniger Berechnungen.

- Wissensdestillation : Überträgt Wissen von großen auf kleine Modelle

Was ist ein Large Vision Model (LVM)?

Große Bildverarbeitungsmodelle (LVMs) dienen der Verarbeitung, Analyse und Interpretation visueller Daten wie Bilder oder Videos. Sie zeichnen sich durch eine große Anzahl von Parametern aus, oft in den Millionen oder Milliarden. Dadurch können sie komplexe Muster, Merkmale und Zusammenhänge in visuellen Inhalten erkennen.

Ähnlich wie große Sprachmodelle (LLMs) für Text werden LVMs anhand umfangreicher Datensätze trainiert, die sie mit Fähigkeiten zur Objekterkennung, Bildgenerierung, Szenenanalyse und multimodalen Argumentation (Integration visueller und textueller Informationen) ausstatten.

Diese Modelle können Anwendungen in Bereichen wie autonomes Fahren, medizinische Bildgebung , Content-Erstellung und Augmented Reality unterstützen.

Struktur und Design

Große Bildverarbeitungsmodelle werden mithilfe fortschrittlicher neuronaler Netzwerkarchitekturen erstellt. Ursprünglich waren Convolutional Neural Networks (CNNs) in der Bildverarbeitung vorherrschend, da sie Pixeldaten effizient verarbeiten und hierarchische Muster erkennen konnten.

In jüngster Zeit wurden Transformer-Modelle, die ursprünglich für die Verarbeitung natürlicher Sprache entwickelt wurden, auch für viele verschiedene Bildverarbeitungsaufgaben angepasst und bieten in einigen Szenarien eine verbesserte Leistung.

Ausbildung

Das Training großer Bildverarbeitungsmodelle beinhaltet die Fütterung mit visuellen Daten, wie beispielsweise Bildern oder Videos aus dem Internet, zusammen mit relevanten Labels oder Annotationen im Rahmen des neuartigen sequenziellen Modellierungsansatzes. Die Trainer labeln Bildbibliotheken, um die Modelle damit zu füttern.

Bei Bildklassifizierungsaufgaben wird beispielsweise jedes Bild mit der Klasse gekennzeichnet, zu der es gehört. Das Modell lernt, indem es seine Parameter so anpasst, dass die Differenz zwischen seinen Vorhersagen und den tatsächlichen Kennzeichnungen minimiert wird.

Dieser Prozess erfordert erhebliche Rechenleistung und einen großen, vielfältigen Datensatz, um sicherzustellen, dass das Modell gut auf neue und unbekannte Daten generalisiert werden kann.

Abbildung 3: Trainingsdiagramm für große Bildverarbeitungsmodelle auf OpenAI. 5

Informieren Sie sich über Bilddatenerfassungsdienste , um mehr über Trainingsdaten für die Bildklassifizierung zu erfahren.

Hauptmerkmale von Großbild-Vision-Modellen

Der Modelltyp bezieht sich auf die Architektur und die Designprinzipien eines Bildverarbeitungsmodells. Er definiert, wie das Modell visuelle Daten verarbeitet und interpretiert, ob es mehrere Modalitäten (z. B. Text und Bilder) integriert und welche zugrunde liegenden Mechanismen (z. B. Transformatoren, kontrastives Lernen, Diffusion) es verwendet, um aussagekräftige Repräsentationen zu extrahieren:

- Transformerbasiertes multimodales LLM: Eine Modellarchitektur, die Transformatoren mit multimodalen Fähigkeiten kombiniert. Sie ermöglicht das gleichzeitige Verstehen visueller und textueller Eingaben. Das Modell wird anhand umfangreicher Datensätze trainiert, um komplexe Schlussfolgerungen über verschiedene Datentypen hinweg zu ziehen.

- Kontrastives Lernen: Eine Technik, die beim Training von Modellen eingesetzt wird, um zwischen ähnlichen und unähnlichen Datenpunkten zu unterscheiden. Dabei wird die Ähnlichkeit verwandter Eingaben maximiert und die Ähnlichkeit nicht verwandter minimiert. Diese Methode wird häufig beim selbstüberwachten Lernen verwendet, um die Merkmalsdarstellung zu verbessern.

- KI-Vision-Plattform: Dieses System bietet Infrastruktur, Werkzeuge und vortrainierte Modelle für verschiedene Aufgaben der Computer Vision, wie Bilderkennung , Objekterkennung und Segmentierung. Es umfasst typischerweise Funktionen für Modelltraining, -bereitstellung und -inferenz.

- Transformer: Eine Deep-Learning-Architektur, die Selbstaufmerksamkeitsmechanismen zur Verarbeitung von Eingabedaten nutzt. Sie ermöglicht es Modellen, Langzeitabhängigkeiten zu erfassen und eignet sich daher besonders für Aufgaben im Bereich der natürlichen Sprachverarbeitung und Bildverarbeitung.

- Diffusionsmodell: Ein generatives Modell, das Rauschen schrittweise aus einem verrauschten Eingangssignal entfernt und es so verfeinert, dass ein klares und strukturiertes Ausgangssignal entsteht. Es wird häufig zur Bildgenerierung und -verbesserung eingesetzt.

Trainingsziel: Die Ziel- oder Optimierungsfunktion, die steuert, wie ein Modell aus Daten lernt. Sie bestimmt, wie das Modell seine internen Parameter während des Trainings anpasst, um die Leistung bei spezifischen Aufgaben zu verbessern. Dazu gehören die Vorhersage des nächsten Datenpunkts (autoregressives Lernen), die Unterscheidung ähnlicher/unähnlicher Eingaben (kontrastives Lernen) oder die Klassifizierung von Bildern in Kategorien.

- Autoregressiv: Ein Trainingsansatz, bei dem ein Modell den nächsten Datenpunkt in einer Sequenz auf Grundlage zuvor beobachteter Eingaben vorhersagt. Dies wird häufig in der Sprachmodellierung und in generativen Bildverarbeitungsmodellen verwendet.

- Kontrastives Lernen: Ein selbstüberwachtes Lernverfahren, bei dem das Modell lernt, indem es zwischen ähnlichen und unähnlichen Datenpaaren unterscheidet. Es trägt dazu bei, die Fähigkeit zu verbessern, aussagekräftige Repräsentationen ohne explizite Labels zu erfassen.

- Überwachtes Lernen: Ein Lernparadigma, bei dem das Modell anhand von gelabelten Daten trainiert wird, d. h. jeder Eingabe ist eine entsprechende korrekte Ausgabe zugeordnet. Dieser Ansatz wird häufig für Aufgaben wie Klassifizierung und Segmentierung verwendet.

- Bildklassifizierung: Ein spezifisches Trainingsziel, bei dem ein Modell lernt, Bilder anhand visueller Merkmale in vordefinierte Klassen einzuordnen. Der Trainingsprozess beinhaltet die Optimierung einer Verlustfunktion, um die Klassifizierungsgenauigkeit zu maximieren.

- Denoising Diffusion: Ein generativer Lernansatz, bei dem ein Modell trainiert wird, um aus verrauschten Eingaben saubere Bilder zu rekonstruieren. Dieser Prozess beinhaltet die Umkehrung eines progressiven Rauschzusatzverfahrens, um die Bildrekonstruktion und -generierung zu verbessern.

Unterstützung für Feinabstimmung: Die Fähigkeit eines Modells, durch Training mit kleineren, domänenspezifischen Datensätzen an spezifische Aufgaben angepasst zu werden, wobei das Wissen aus der Vortrainingsphase erhalten bleibt.

Durch Feinabstimmung lässt sich die Leistung bei speziellen Anwendungen verbessern.

Zero-Shot/Few-Shot Learning: Die Fähigkeit eines Modells, Aufgaben mit wenigen oder gar keinen aufgabenspezifischen Trainingsdaten auszuführen.

Zero-Shot-Learning ermöglicht Rückschlüsse auf unbekannte Kategorien, während Few-Shot-Learning die Anpassung mit minimalen gelabelten Beispielen ermöglicht.

Multimodale Unterstützung: Die Fähigkeit eines Modells, Informationen aus verschiedenen Modalitäten (z. B. Text, Bilder, Audio) zu verarbeiten und zu integrieren.

Open-Source vs. Proprietär: Open-Source-Modelle verfügen über öffentlich verfügbaren Code und Gewichtungen, was die Modifizierung und den Einsatz durch die Community ermöglicht.

Proprietäre Modelle befinden sich im Besitz und unter der Kontrolle privater Unternehmen und können den Zugriff und die Anpassungsmöglichkeiten einschränken.

Edge-Bereitstellung: Die Fähigkeit eines Modells, auf Edge-Geräten (z. B. Mobiltelefonen, IoT-Geräten) anstatt auf Cloud-basierten Servern ausgeführt zu werden.

Edge-Bereitstellung trägt zur Reduzierung von Latenzzeiten bei, verbessert die Privatsphäre und ermöglicht die Echtzeitverarbeitung in ressourcenbeschränkten Umgebungen.

Welche Anwendungsfälle gibt es für große Bildverarbeitungsmodelle?

Gesundheitswesen und medizinische Bildgebung

- Krankheitsdiagnose : Erkennung von Krankheiten anhand medizinischer Bildgebungsverfahren wie Röntgenaufnahmen, MRT- oder CT-Scans zur Identifizierung von Tumoren, Frakturen oder Anomalien.

- Pathologie : Analyse von Gewebeproben in der Pathologie auf Anzeichen von Krebs.

- Ophthalmologie : Diagnose von Krankheiten anhand von Netzhautbildern.

Autonome Fahrzeuge und Robotik

- Navigation und Hinderniserkennung : Unterstützung autonomer Fahrzeuge und Drohnen bei der Navigation und Hindernisvermeidung durch die Interpretation visueller Echtzeitdaten.

- Robotik in der Fertigung : Unterstützung von Robotern bei Sortier-, Montage- und Qualitätsprüfungsaufgaben.

Sicherheit und Überwachung

- Aktivitätsüberwachung : Analyse von Videoaufnahmen zur Erkennung ungewöhnlichen oder verdächtigen Verhaltens.

- Gesichtserkennung : Wird in Sicherheitssystemen zur Identitätsprüfung und -verfolgung eingesetzt. Amazon Rekognition ist beispielsweise ein Cloud-basierter Dienst von AWS, der Bild- und Videoanalysefunktionen wie Gesichtserkennung, Objekt- und Szenenidentifizierung sowie Textextraktion bietet. Er kann Emotionen, Altersgruppen und Aktivitäten analysieren, was für Personalisierung und Sicherheit nützlich ist.

Im folgenden Video können Sie Amazon Rekognition in Aktion sehen. 6

Einzelhandel und E-Commerce

- Visuelle Suche : Ermöglicht Kunden die Suche nach Produkten anhand von Bildern anstatt von Text.

- Bestandsmanagement : Automatisierte Überwachung und Verwaltung des Lagerbestands durch visuelle Erkennung.

Landwirtschaft

- Pflanzenüberwachung und -analyse : Überwachung des Pflanzenzustands und -wachstums mithilfe von Drohnen- oder Satellitenbildern.

- Schädlingserkennung : Identifizierung von Schädlingen und Krankheiten, die Nutzpflanzen befallen.

Umweltüberwachung

- Wildtierbeobachtung : Identifizierung und Verfolgung von Wildtieren zur Unterstützung von Naturschutzmaßnahmen.

- Landnutzungs- und Landbedeckungsanalyse : Überwachung von Veränderungen der Landnutzung und der Vegetationsbedeckung im Laufe der Zeit.

Inhaltserstellung und Unterhaltung

- Film- und Videobearbeitung : Automatisierung von Videobearbeitungs- und Nachbearbeitungsprozessen.

- Spielentwicklung : Verbesserung der realistischen Umgebungs- und Charaktergestaltung.

- Foto- und Videooptimierung : Verbesserung der Bild- und Videoqualität.

- Inhaltsmoderation : Automatisches Erkennen und Kennzeichnen unangemessener oder schädlicher visueller Inhalte.

Welche Herausforderungen bergen große Bildverarbeitungsmodelle?

Rechenressourcen

Das Training und der Einsatz dieser Modelle erfordern erhebliche Rechenleistung und Speicherkapazität, was sie ressourcenintensiv macht.

Datenanforderungen

Sie benötigen umfangreiche und vielfältige Datensätze für das Training. Das Sammeln, Kennzeichnen und Verarbeiten solch großer Datensätze kann aufwendig und kostspielig sein. Crowdsourcing-Unternehmen können hierbei jedoch helfen .

Voreingenommenheit und Fairness

Modelle können Verzerrungen aus ihren Trainingsdaten übernehmen, was zu unfairen oder unethischen Ergebnissen führen kann, insbesondere bei sensiblen Anwendungen wie der Gesichtserkennung.

Interpretierbarkeit und Erklärbarkeit

Es kann schwierig sein zu verstehen, wie diese Modelle Entscheidungen treffen, was insbesondere für Anwendungen relevant ist, bei denen Transparenz unerlässlich ist. Informieren Sie sich über erklärbare KI , um zu erfahren, wie dieser Prozess funktioniert und welchen Beitrag er zur KI-Ethik leistet.

Verallgemeinerung

Während sie bei Daten, die ihrem Trainingsdatensatz ähneln, gute Ergebnisse erzielen, können sie bei völlig neuen oder anderen Datentypen Schwierigkeiten haben.

Datenschutzbedenken

Der Einsatz großer visueller Modelle, insbesondere bei Überwachungs- und Gesichtserkennungsanwendungen, wirft erhebliche Bedenken hinsichtlich des Datenschutzes auf.

Regulatorische und ethische Herausforderungen

Es wird zunehmend wichtiger, sicherzustellen, dass diese Modelle rechtlichen und ethischen Standards entsprechen, insbesondere da sie sich immer stärker in die Gesellschaft integrieren.

Benchmark-Methodik für Objekterkennung

In diesem Benchmark wurden die Leistungen der Objekterkennungsmodelle YOLOv8n, DETR (DEtection TRansformer) und GPT-4o Vision anhand des Validierungsdatensatzes COCO 2017 verglichen. Für den Vergleich wurden 1000 Bilder pro Modell verwendet. Alle Bilder wurden auf 800×800 Pixel skaliert, um einheitliche Eingabedimensionen für alle Modelle zu gewährleisten.

Das YOLOv8n-Modell wurde mit vortrainierten Gewichten (yolov8n.pt) aus dem Ultralytics-Repository geladen und die Inferenz mittels der predict()-Methode über die Ultralytics YOLO API durchgeführt. Das DETR-Modell wurde mit der detr_resnet50-Architektur aus der Facebook Research Library geladen. Dessen Ausgaben, ursprünglich im Format [center_x, center_y, Breite, Höhe] normalisiert, wurden reskaliert und in das Koordinatenformat [x1, y1, x2, y2] konvertiert. Für die Ergebnisse beider Modelle wurde ein Konfidenzschwellenwert von 0,5 angewendet.

Das Vision-Modell GPT-4o wurde mithilfe der API von OpenAI hinsichtlich seiner Objekterkennungsfähigkeiten evaluiert. Für dieses Modell wurden Bilder aus dem COCO-Validierungsdatensatz heruntergeladen, Annotationen geladen und jedes Bild vor dem Senden an die API in das entsprechende Format konvertiert (auf 800×800 Pixel skaliert). Es wurden ausschließlich Erkennungen von COCO-Klassen im JSON-Format angefordert, und die von der API zurückgegebenen Vorhersagen wurden mit demselben Konfidenzschwellenwert (0,5) und demselben Koordinatenformat evaluiert.

In der Evaluierung wurden die von den Modellen vorhergesagten Begrenzungsrahmen mit den tatsächlichen Begrenzungsrahmen verglichen, indem die Schnittmenge über der Vereinigung (IoU) berechnet wurde. Ein IoU-Wert ≥ 0,5 wurde als korrekte Übereinstimmung gewertet. Die durchschnittliche Präzision (AP) wurde für jede Klasse berechnet, und der Mittelwert aller Klassen wurde als mAP@0,5-Metrik angegeben. Neben der Genauigkeit wurden auch die Inferenzzeiten gemessen und verglichen. Zusätzlich wurde die Modellkomplexität anhand der FLOPs und der Gesamtzahl der Parameter analysiert.

Um einen fairen Vergleich zu gewährleisten, wurden alle Modellberechnungen auf derselben Hardware (identische GPU/CPU) durchgeführt. Die gleichen Vorverarbeitungsschritte – Skalierung aller Bilder auf 800×800 Pixel und Anwendung der erforderlichen Normalisierung – wurden für alle Modelle angewendet. Für die Nachbearbeitung wurden die Vorhersagen in dasselbe Koordinatenformat konvertiert, ein Konfidenzschwellenwert von 0,5 einheitlich angewendet und einheitliche IoU-Berechnungskriterien für die Auswertung verwendet.

In diesem Rahmen wurden YOLOv8n, DETR und das GPT-4o Vision-Modell hinsichtlich Objekterkennungsleistung und Geschwindigkeit verglichen; zusätzliche Anpassungen und Methoden wurden eingesetzt, um die Fähigkeiten von GPT-4o Vision mit aktuellen Objekterkennungsmodellen zu vergleichen.

Abschluss

Große Bildverarbeitungsmodelle (LVMs) verändern die Art und Weise, wie Maschinen visuelle Daten in verschiedenen Bereichen interpretieren und darauf reagieren, darunter Gesundheitswesen, autonome Systeme, Sicherheit und die Kreativwirtschaft.

Durch die Nutzung fortschrittlicher Architekturen wie Transformatoren und Diffusionsmodellen unterstützen LVMs eine breite Palette komplexer Aufgaben, darunter medizinische Bildgebung, Echtzeit-Objekterkennung, Text-zu-Bild-Konvertierung und Videogenerierung.

Ihre Fähigkeit, aus umfangreichen, multimodalen Datensätzen zu lernen, ermöglicht flexible Einsatzszenarien, von cloudbasierten Inferenzverfahren bis hin zu Edge-Computing, und erlaubt maßgeschneiderte Anwendungen, die von der industriellen Inspektion bis zur Erstellung personalisierter Inhalte reichen.

Diese Fähigkeiten bringen jedoch erhebliche Herausforderungen mit sich. Der Rechenaufwand für das Training und die Bereitstellung von LVMs ist nach wie vor hoch und erfordert häufig leistungsstarke Hardware und eine spezialisierte Infrastruktur.

Probleme wie Datenverzerrungen, eingeschränkte Interpretierbarkeit und ethische Bedenken hinsichtlich Überwachung und Datenschutz unterstreichen die Notwendigkeit einer sorgfältigen Modellsteuerung. Da sich LVMs stetig weiterentwickeln, ist ein ausgewogenes Verhältnis zwischen Innovation und Verantwortung entscheidend, um ihre effektive und gerechte Nutzung in verschiedenen Sektoren zu gewährleisten.

Seien Sie der Erste, der kommentiert

Ihre E-Mail-Adresse wird nicht veröffentlicht. Alle Felder sind erforderlich.