LLM-basierte Anwendungen werden immer leistungsfähiger und komplexer, wodurch ihr Verhalten schwerer zu interpretieren ist.

Die Ausgabe jedes Modells resultiert aus Eingabeaufforderungen, Werkzeuginteraktionen, Abrufschritten und probabilistischen Schlussfolgerungen, die nicht direkt einsehbar sind. Die LLM-Observability begegnet dieser Herausforderung, indem sie kontinuierliche Einblicke in die Funktionsweise von Modellen unter realen Bedingungen ermöglicht. Sie versetzt Unternehmen in die Lage, die Qualität zu überwachen, Fehler zu erkennen, mehrstufige Arbeitsabläufe zu optimieren und Leistung sowie Kosten zu steuern.

Werkzeug | Am besten geeignet für |

|---|---|

Häufige Experimente durchführen und Eingabeaufforderungen/Modelle mit starker Versionierung und Dashboards vergleichen. | |

Langfuse | Open-Source- und selbstgehostete Observability mit detaillierten Traces und anpassbaren Auswertungen. |

Helikone | Einrichtung ohne Programmierung für grundlegende Überwachung, Kostenverfolgung und Zwischenspeicherung von LLM-API-Aufrufen. |

Langsmith | Aufbau mehrstufiger Ketten oder Agenten (insbesondere mit LangChain) mit detaillierter Ablaufverfolgung. |

Braintrust | Automatisierte Auswertung, Warnmeldungen und Überwachung der Produktionsqualität. |

Gewichte & Schrägen (W&B-Webart)

W&B Weave ist die LLM-Observability-Plattform von Weights & Biases zur Überwachung, Bewertung und Optimierung von Sprachmodellanwendungen. Weave verfolgt automatisch jeden LLM-Aufruf mithilfe des @weave.op-Dekorators und erfasst Eingaben, Ausgaben, Kosten, Latenz und Bewertungsmetriken ohne manuelle Konfiguration.

Die Plattform erfasst die Token-Nutzung und berechnet die Kosten automatisch, überwacht Antwortzeiten, um langsame Anfragen zu erkennen, und misst die Genauigkeit durch den Vergleich von Vorhersagen mit erwarteten Ergebnissen. Verschiedene Experimente lassen sich direkt miteinander vergleichen, um das leistungsstärkste Modell oder die beste Abfrage zu ermitteln. Die Fehlerverfolgung zeigt an, welche Vorhersagen fehlgeschlagen sind und warum, während die automatische Versionierung jede Konfigurationsänderung für reproduzierbare Ergebnisse speichert. So lassen sich verschiedene Ansätze einfach testen, die besten Lösungen identifizieren und Fehler beheben, wenn Modelle fehlerhaft arbeiten.

Dashboard zur Ergebnisübersicht

Abbildung 1: Diagramme, die das Dashboard mit den Leistungsmetriken des Modells zeigen und die Entwicklung von Genauigkeit, Kosten und Latenz im Zeitverlauf verfolgen.

Die Leistungskennzahlen werden für alle Testläufe angezeigt. Gesamtkosten, Token-Verbrauch und Antwortzeiten werden in Diagrammen dargestellt, die Veränderungen im Zeitverlauf aufzeigen. Benutzerdefinierte Kennzahlen wie Genauigkeit und Fehlerraten werden in separaten Bereichen angezeigt. Trendlinien helfen dabei, Leistungsverschlechterungen oder unerwartete Kostenanstiege zu erkennen. Das Dashboard aktualisiert sich automatisch nach Abschluss neuer Tests.

Spurenansicht

Abbildung 2: Auswertungstabelle mit Modellversionen und deren Ergebnissen der Intentionklassifizierung.

Jeder Testlauf wird mit allen Details gespeichert. Jede Protokollierung zeigt das verwendete Modell, die gesendete Eingabeaufforderung und alle Einstellungen. Erfolgs- oder Fehlerindikatoren geben an, ob die Tests korrekt abgeschlossen wurden. Die Spalte „Eingabeaufforderung“ zeigt den zur Überprüfung an das Modell gesendeten Text an. Diese Protokollierung ermöglicht den direkten Vergleich verschiedener Versionen, die Ermittlung der Änderungen zwischen den Läufen und die Wiederholung jedes Tests mit seiner gespeicherten Konfiguration.

Modellvergleichs-Rangliste

Abbildung 3: Bild, das die Rangliste zeigt, welche die verschiedenen Versionen des Intent-Klassifikatormodells hinsichtlich Genauigkeit und Latenz vergleicht.

Anhand derselben Testdaten lassen sich verschiedene Modelle und Einstellungen vergleichen. Die Spalten zeigen Genauigkeit, korrekte Vorhersagen, Ergebnisse und Reaktionszeiten. Leistungsstärkere Modelle sind grün hervorgehoben. Dieser Vergleich verdeutlicht Kompromisse wie höhere Genauigkeit bei geringerer Geschwindigkeit oder schnellere Reaktionszeiten bei etwas geringerer Genauigkeit und hilft so bei der Auswahl der optimalen Konfiguration für den Produktiveinsatz.

Modellversionierung

Abbildung 4: Konfigurationsfeld des Intent-Klassifikators mit Modelleinstellungen und Versionsdetails.

Jede Konfigurationsänderung erzeugt automatisch eine neue Version und speichert so die vollständige Versionshistorie. Die Versionsdetails zeigen an, wann die Änderungen vorgenommen wurden, wer sie durchgeführt hat und wie viel Speicherplatz belegt wurde. Auf der Registerkarte „Werte“ werden die genauen Einstellungen angezeigt, einschließlich Modellname, Parameter und Funktionsversionen. Diese Versionierung gewährleistet, dass jeder Test mit identischen Einstellungen wiederholt werden kann, ermöglicht die Nachverfolgung von Leistungsänderungen im Zeitverlauf und erlaubt bei Bedarf die Rückkehr zu älteren Versionen.

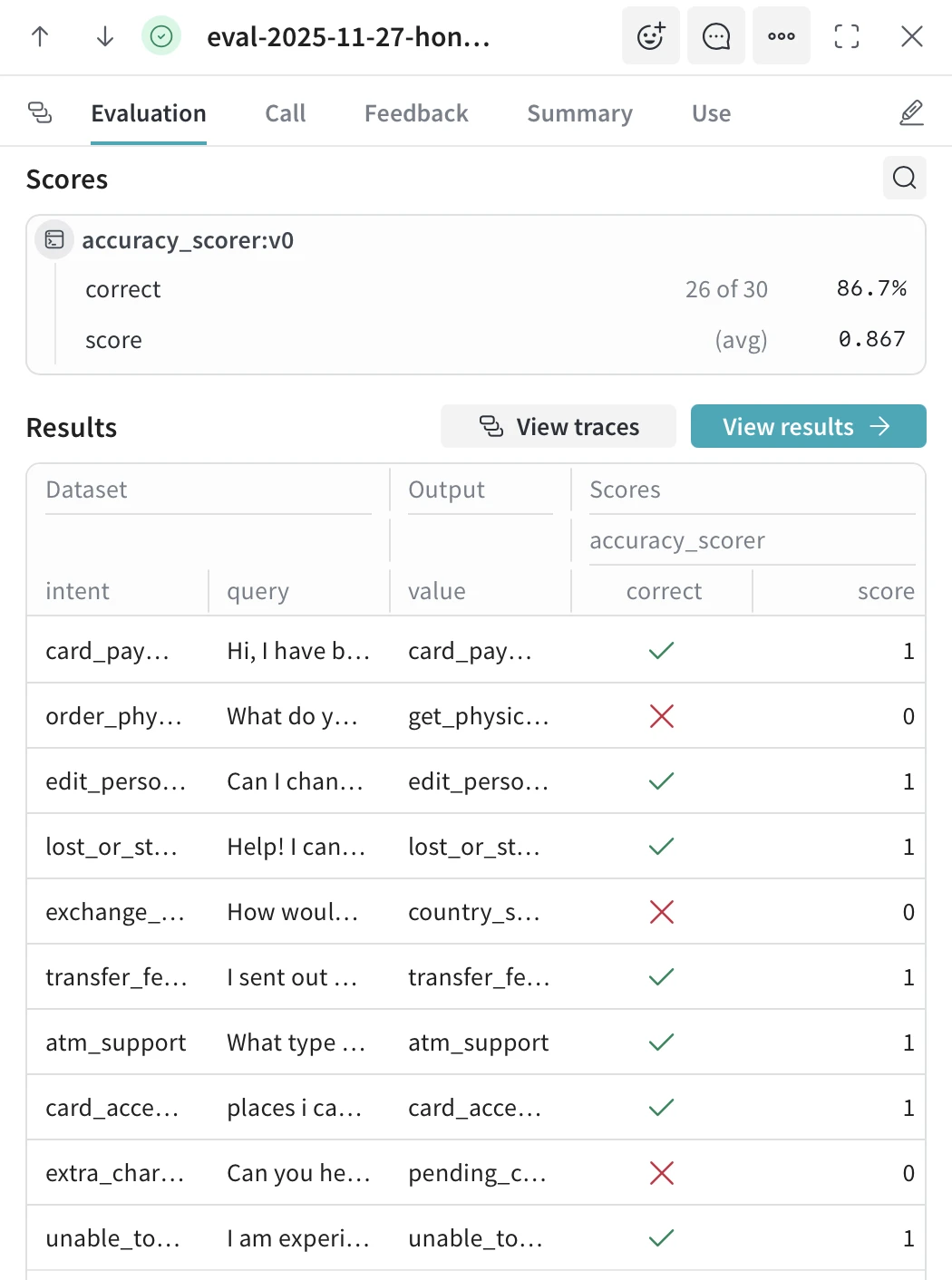

Detaillierte Auswertungsergebnisse

Abbildung 5: Auswertungsergebnisse mit Darstellung einzelner Testfälle, vorhergesagten Absichten und Genauigkeitswerten.

Für jede Probe werden die individuellen Testergebnisse angezeigt. Der Abschnitt „Ergebnisse“ fasst die Gesamtzahl der korrekten Vorhersagen, die Genauigkeit in Prozent und die benutzerdefinierten Ergebnisse zusammen.

Die Ergebnistabelle zeigt jede Anfrage mit der erwarteten Antwort und der Vorhersage des Modells an. Richtige Antworten werden mit einem Häkchen, falsche mit einem Kreuz gekennzeichnet. Fehlgeschlagene Vorhersagen sind leicht zu erkennen und weisen oft Muster auf, wie beispielsweise Verwechslungen ähnlicher Kategorien.

Durch Klicken auf eine beliebige Zeile wird die vollständige Ablaufverfolgung geöffnet, einschließlich Eingabeaufforderung, Antwort, Token-Anzahl und Zeitmessung, wodurch sich Fehler unkompliziert beheben und Eingabeaufforderungen oder Modellauswahl verbessern lassen.

Langsmith

LangSmith ist die Observability-Plattform von LangChain für die Überwachung, das Debugging und die Evaluierung von LLM-Anwendungen. Sie protokolliert automatisch jeden LLM-Aufruf, erfasst Eingabeaufforderungen und Ausgaben, verfolgt Kosten und Latenz und ermöglicht eine systematische Evaluierung durch datensatzbasierte Tests. LangSmith ist nativ in LangChain integriert, unterstützt aber über sein SDK jede beliebige LLM-Anwendung.

Auswertungsergebnisse pro Probe

Abbildung 6: Bild, das die Auswertung der einzelnen Testfälle hinsichtlich Vorhersagen und Leistungskennzahlen zeigt.

Die einzelnen Vorhersageergebnisse werden zusammen mit den erwarteten Ausgaben angezeigt, sodass Sie erkennen können, wo das Modell Fehler macht. Der Vergleich von erwarteten und tatsächlichen Vorhersagen deckt Verwechslungen zwischen semantisch ähnlichen Kategorien auf. Latenz und Tokenanzahl pro Abfrage zeigen, welche Eingabetypen aufwändiger zu verarbeiten sind, und ermöglichen so die Optimierung langsamer oder kostenintensiver Abfragen.

Spurenvolumen- und Gesundheitsüberwachung

Abbildung 7: Diagramm zur Visualisierung der Projektverläufe und der Erfolgs- und Fehlerraten im Zeitverlauf.

Der Zustand der Anwendung wird anhand von Trends im Ablauf von Trace-Volumina und Erfolgs-/Fehlerquoten im Zeitverlauf dargestellt. Verschiedene Ansichten stehen zur Analyse von LLM-Aufrufen, Kostentrends, Tool-Aufrufen oder Feedback-Bewertungen zur Verfügung. Probleme wie Fehlerspitzen oder Kostenanstiege werden sichtbar und weisen auf Fehler hin, die untersucht werden müssen.

Modell- und Konfigurationsvergleich

Abbildung 8: Vergleichsansicht der Experimente mit Darstellung der Leistungskennzahlen über mehrere Testläufe hinweg.

Verschiedene Modelle lassen sich anhand desselben Testdatensatzes direkt miteinander vergleichen. Die Kompromisse zwischen Genauigkeit, Latenz (P50/P99) und Token-Effizienz werden visuell dargestellt. Durch diese Vergleiche lässt sich unkompliziert ermitteln, welche Konfiguration die Anforderungen am besten erfüllt – sei es maximale Genauigkeit oder minimale Kosten und Reaktionszeit.

Langfuse

Langfuse ist eine Open-Source-Plattform zur Überwachung, zum Debuggen und zur Evaluierung von Sprachmodellanwendungen. Langfuse ist sowohl als selbstgehostete als auch als Cloud-Lösung verfügbar und bietet umfassendes Tracing mit automatischer Erfassung von Eingabeaufforderungen, Ausgaben, Kosten und Latenz.

Die Plattform unterstützt jedes LLM-Framework durch ihr flexibles SDK und bietet integrierte Evaluierungsfunktionen, darunter LLM-as-a-Judge für die automatisierte Qualitätsbewertung. Langfuse verfolgt die Eingabeaufforderungsversionen über verschiedene Durchläufe hinweg und ermöglicht so den Vergleich von Leistungskennzahlen zwischen unterschiedlichen Formulierungen.

Die Erfassung von Nutzerfeedback mittels Daumen-hoch/Daumen-runter-Bewertungen hilft, qualitativ hochwertige und minderwertige Ergebnisse zu identifizieren, während benutzerdefinierte Bewertungsmethoden die Verfolgung anwendungsspezifischer Kennzahlen ermöglichen. Automatisierte Auswertungen können Tausende von Protokollen mit konfigurierbaren Abtastraten verarbeiten und so eine kontinuierliche Qualitätsüberwachung in großem Umfang ohne manuelle Überprüfung jedes einzelnen Ergebnisses ermöglichen.

Detaillierte Trace-Ansicht

Abbildung 10: Trace-Protokolle mit Details zum API-Aufruf sowie Leistungs- und Kostendaten.

Einzelne Traces zeigen vollständige Ausführungsdetails für jeden LLM-Aufruf an. Die Trace-Ansicht zeigt genaue Latenzmessungen, Tokenverbrauch (Prompt- und Completion-Token separat) und berechnete Kosten pro Anfrage.

Die Modellkonfiguration, einschließlich Temperatur, max_tokens und anderer Parameter, bleibt erhalten. Im Vorschaubereich wird die vollständige Eingabeaufforderung an das Modell zusammen mit der vollständigen Antwort angezeigt, sodass Sie genau nachvollziehen können, was das Modell empfangen und generiert hat.

Diese detaillierte Transparenz ermöglicht die Fehlersuche bei spezifischen Problemen durch die Untersuchung des genauen Eingabe-Ausgabe-Paares, das den Fehler verursacht hat.

Übersichtstabelle für Spuren

Abbildung 11: Einzelne Ablaufverfolgungsanalyse mit Angabe der Anfragedetails und der Modellantwort.

Alle Traces werden in einer filterbaren Tabelle zusammengefasst, die Ausgaben, Beobachtungsebenen, Latenz, Token-Nutzung und Gesamtkosten anzeigt. Jede Zeile repräsentiert einen einzelnen LLM-Aufruf, wobei farbcodierte Beobachtungsebenen die Trace-Hierarchie bzw. -Wichtigkeit angeben. Die Token-Anzahl zeigt sowohl Prompt- als auch Completion-Tokens sowie die Summen an, während die Kostenberechnung automatisch auf Basis des verwendeten Modells erfolgt.

Die Spaltenauswahl ermöglicht die Anpassung der angezeigten Metriken, und Filter erlauben die Eingrenzung der Traces nach Umgebung, Zeitraum oder anderen Kriterien. Diese tabellarische Ansicht erleichtert das Erkennen von Mustern wie konstant langsamen Abfragen oder unerwartet teuren Anfragen.

Braintrust

Braintrust ist eine LLM-Observability-Plattform, die Evaluierung und Produktionsüberwachung vereint. Die Plattform ermöglicht das Testen von Modellen anhand von Datensätzen, den Vergleich verschiedener Eingabeaufforderungen oder Konfigurationen sowie die Verfolgung von Qualitätsmetriken durch automatisierte Bewertung. Integrierte und benutzerdefinierte Evaluierungsfunktionen messen Genauigkeit, Relevanz oder domänenspezifische Kriterien. Die Ergebnisse werden in Vergleichstabellen dargestellt, die Leistungsunterschiede zwischen verschiedenen Versionen aufzeigen.

Für die Produktionsüberwachung erfasst Braintrust Echtzeit-Metriken wie Latenz, Kosten und benutzerdefinierte Qualitätsbewertungen während des gesamten Datenverkehrs durch die Anwendungen. Warnmeldungen werden ausgelöst, sobald Qualitätsschwellenwerte überschritten oder Sicherheitsvorkehrungen verletzt werden. Brainstore, das Protokollspeichersystem der Plattform, verarbeitet Anwendungsprotokolle in großem Umfang und bietet eine optimierte Suche nach KI-Interaktionen. Das Dashboard zeigt aggregierte Metriken aus Experimenten und Produktionsläufen an und erfasst Kostenverfolgung, Token-Nutzung und Antwortmetadaten für Evaluierungs- und Produktionsanfragen.

Helikone

Helicone ist eine Proxy-basierte Observability-Plattform, die LLM-Anwendungen überwacht, indem sie API-Anfragen über ihren Proxy-Server leitet. Die Integration erfordert lediglich die Änderung der Basis-URL; eine SDK-Installation oder Codeänderungen sind nicht notwendig. Die Plattform erfasst automatisch Anfragen, Antworten, Kosten und Token-Nutzung, um das Anwendungsverhalten zu überwachen.

Das Dashboard zeigt das gesamte Anfragevolumen, die aggregierten Kosten und den Tokenverbrauch aller API-Aufrufe an. Die Anfrageprotokolle enthalten vollständige Eingabeaufforderungen und Modellausgaben und ermöglichen so die Untersuchung spezifischer Vorhersagen oder Fehler. Die Kostenverfolgung schlüsselt die Ausgaben nach Modelltyp, Benutzer oder benutzerdefinierten Tags auf, um kostenintensive Operationen zu identifizieren. Integriertes Caching erkennt doppelte Anfragen und liefert zwischengespeicherte Antworten, wodurch sowohl API-Kosten als auch Antwortzeiten reduziert werden. Die Ratenbegrenzung legt Nutzungsobergrenzen pro Benutzer oder Endpunkt fest, um unerwartete Kostenspitzen zu verhindern.

Die Plattform konzentriert sich auf die Überwachung einzelner API-Aufrufe – jede Anfrage wird als separater Logeintrag erfasst, ohne integrierte Unterstützung für die Gruppierung zusammengehöriger Aufrufe oder die Visualisierung von Sequenzen. Dadurch eignet sich Helicone für Anwendungen wie unabhängige LLM-Aufrufe (z. B. Chatbots mit einer einzigen Gesprächsrunde), die Stapelverarbeitung von Inhalten oder Klassifizierungsaufgaben, ist aber weniger geeignet für die Nachverfolgung mehrstufiger Arbeitsabläufe, bei denen das Verständnis der Beziehungen zwischen aufeinanderfolgenden Aufrufen wichtig ist.

Was ist LLM-Beobachtbarkeit?

LLM-Observability bezeichnet die Praxis, kontinuierlich Daten von großen Sprachmodellen zu sammeln und zu interpretieren, um deren Verhalten im realen Einsatz zu verstehen. Der Fokus liegt dabei auf der Erfassung von Metriken, Traces und Logs, die zeigen, wie LLMs auf verschiedene Eingabeaufforderungen, Tools und externe API-Aufrufe reagieren.

Da Sprachmodelle auf probabilistischem Denken basieren, lassen sich ihre internen Prozesse nicht direkt untersuchen. Daher ist die Überwachung von Sprachmodellen auf die Analyse ihrer Ausgaben, Eingaben und der Zwischenschritte in agentenbasierten Arbeitsabläufen angewiesen. Durch die Untersuchung dieser Daten erhalten Sprachmodellentwickler Einblick in die Systemleistung, das Modellverhalten und Nutzungsmuster, die die Anwendungsleistung und die Ausgabequalität beeinflussen.

Die Beobachtbarkeit von LLM ist aus mehreren Gründen von entscheidender Bedeutung:

- Qualitätssicherung: Große Sprachmodelle können aus vielfältigen Gründen fehlerhafte oder minderwertige Ergebnisse liefern, beispielsweise aufgrund unklarer Eingabeaufforderungen, abweichender Daten oder unerwarteten Nutzerverhaltens. Die Überwachung von Eingabeaufforderungen und Antworten im Zeitverlauf hilft, Bewertungskriterien wie Korrektheit, Kohärenz, Relevanz und Faktentreue zu erfassen. So können Teams erkennen, wann die Qualität der Antworten nachlässt oder das Modell Fehlinterpretationen generiert. Mit zunehmender Verbreitung von Sprachmodellen in unternehmensweiten Arbeitsabläufen wird die Gewährleistung einer gleichbleibenden Genauigkeit zu einer ständigen Herausforderung.

- Fehlerbehebung: Treten Probleme in LLM-Anwendungen auf, können die Ursachen vielfältig sein. Beispiele hierfür sind schlecht konfigurierte Eingabeaufforderungen, fehlerhafte Feinabstimmungen , fehlgeschlagene externe API-Aufrufe oder Logikfehler in mehrstufigen Agenten-Workflows. Durch das Erfassen von LLM-Traces, die Zwischenschritte dokumentieren, können Entwickler die Ursachenanalyse effizient durchführen und die genaue Stelle ermitteln, an der das Verhalten abweicht. Dies reduziert den Bedarf an manuellen Eingriffen und verkürzt die Fehlersuchezeit.

- Optimierung: Die Überwachung von Systemleistung, Ressourcennutzung und Tokenverbrauch hilft Unternehmen, Engpässe zu identifizieren und die Leistung von LLMs zu verbessern. Teams können Latenz, Durchsatz, Speichernutzung und Fehlerraten messen, um das Verhalten von LLMs unter verschiedenen Lastniveaus zu verstehen. Sie können außerdem Token verfolgen, um Kosten zu kontrollieren und Nutzungsmuster zu analysieren, um Leistung und Kosteneffizienz zu optimieren. Die kontinuierliche Überwachung dieser Schlüsselmetriken ist besonders wertvoll bei der Generierung von Daten mit Abrufunterstützung und bei Agenten-Workflows, wo Leistungsengpässe häufig durch ineffiziente Tool-Aufrufe oder unnötige Roundtrips während der Reasoning-Prozesse entstehen.

Kernmetrikkategorien

LLM-Observability-Tools gruppieren typischerweise relevante Metriken in drei Kategorien, die sowohl Softwareentwicklungsteams als auch operative Teams unterstützen.

Systemleistungskennzahlen

- Latenz: Misst die Zeit zwischen dem Empfang einer Aufforderung und der Übermittlung einer Antwort.

- Durchsatz: Gibt an, wie viele Anfragen das Modell innerhalb eines bestimmten Zeitraums verarbeiten kann.

- Fehlerraten: Zeigen an, wie häufig das System ungültige oder fehlgeschlagene Antworten liefert.

Kennzahlen zur Ressourcennutzung

- CPU- und GPU-Auslastung: Hilft dabei zu verstehen, wie effizient das System die Hardware nutzt.

- Speichernutzung: Beeinflusst Skalierungsentscheidungen und Kapazitätsplanung.

- Token-Nutzung: Beeinflusst die Kosteneffizienz und hilft Teams, die Kosten bei intensiver LLM-Nutzung zu kontrollieren.

- Abwägung zwischen Durchsatz und Latenz: Zeigen Sie, wie das System Geschwindigkeit und Verarbeitungsvolumen in Einklang bringt.

Verhaltensmetriken des Modells

- Korrektheit, Faktentreue und Antwortqualität: Zur Identifizierung minderwertiger Ergebnisse.

- Nutzerbeteiligung und Nutzerfeedback: Sie liefern Erkenntnisse darüber, wie gut das Modell die Bedürfnisse der Nutzer erfüllt.

- Genauigkeits- und Fundiertheitsmetriken: Sie spiegeln wider, wie genau sich das Modell an das Ausgangsmaterial anlehnt.

Manuelle vs. autonome Beobachtbarkeit

Die manuelle Beobachtung birgt mehrere Herausforderungen. Große Sprachmodelle erzeugen enorme Datenmengen, und mehrstufige Schlussfolgerungsketten führen zu zahlreichen Protokollen und Traces. Der Bedarf an Echtzeitüberwachung erhöht die operative Komplexität, und selbst erfahrene Teams haben Schwierigkeiten, jeden LLM-Aufruf zu überprüfen, ohne wichtige Signale zu übersehen. Manuelle Arbeitsabläufe erschweren es zudem, mit den ständigen Änderungen im Nutzerverhalten und den Variationen der Eingabeaufforderungen Schritt zu halten.

Autonome Überwachungssysteme begegnen diesen Herausforderungen durch den Einsatz von Softwareagenten, die die LLM-Aktivität kontinuierlich analysieren. Diese Agenten erkennen Anomalien, diagnostizieren Probleme und führen Ursachenanalysen ohne ständiges menschliches Eingreifen durch. Automatisierte Auswertungen helfen zudem, riskantes Verhalten wie beispielsweise die voreilige Injektion zu identifizieren.

Ein solches System unterstützt die kontinuierliche Überwachung und gewährleistet die konsistente Erfassung von Bewertungskennzahlen im gesamten Modell. Dadurch profitieren Unternehmen von einer schnelleren Fehlerbehebung, einer verbesserten Anwendungsleistung und einer besseren Kontrolle der Betriebsrisiken.

Merkmale der LLM-Beobachtbarkeitswerkzeuge

Qualitäts- und Sicherheitsbewertungen

- Halluzinationserkennung zur Identifizierung von Abweichungen des Modells von zuverlässigen Daten.

- Schnelle Erkennung von Jailbreaks und deren Einschleusung zur Behebung von Sicherheitsbedenken.

- Toxizitätsbewertung und Sicherheitsbewertungen zur Unterstützung der Einhaltung von Vorschriften und zur Risikominderung.

- Clustering, das ähnliche LLM-Ausgaben gruppiert, um Abweichungen im Laufe der Zeit zu identifizieren.

Experimentierfunktionen

- A/B-Tests zur schnellen Verwaltung und Anpassung von Konfigurationsänderungen.

- Schneller Vergleich mehrerer LLM-Modelle oder-Parameter .

- Bewertung von Genauigkeit, Tokenverbrauch und Latenz vor der Bereitstellung.

- Modelländerungen werden anhand realer Szenarien mit produktionsähnlichen Daten getestet.

Korrelation mit der Infrastruktur

- Verknüpfung von LLM-Traces mit Daten zur Leistungsüberwachung von Backend-Anwendungen.

- Verknüpfung von Reaktionszeit und Antwortqualität mit realen Benutzersitzungen.

- Ermittlung des Zusammenhangs zwischen Systemleistung und LLM-Performance sowie Anwendungsstabilität.

LLMOps und Governance

- Schutzmechanismen, die unsichere Eingabeaufforderungen filtern und schädliche Reaktionen blockieren.

- Dashboards zur Überwachung von PII-Offenlegung, Halluzinationen und Sicherheitsverstößen.

- Tools, die die Einhaltung von Vorschriften, die Berichterstattung und die Analyse von Sicherheitsvorfällen unterstützen.

Beobachtbarkeit für agentenbasierte Arbeitsabläufe

Da LLMs mehrstufige Agenten-Workflows unterstützen, gehen die Anforderungen an die Beobachtbarkeit über einzelne Anfrage-Antwort-Paare hinaus. Agentenbasierte Anwendungen führen zusätzliche Komplexitätsebenen ein, die spezielle Tracing-Ansätze erfordern.

Wichtige Beobachtbarkeitsdimensionen für Agenten:

- Planungs- und Denkprozesse: Einblick in die Art und Weise, wie der Agent Aufgaben aufteilt, Aktionen auswählt und seinen Ansatz auf Basis von Zwischenergebnissen verfeinert.

- Tool-Aufrufüberwachung: Verfolgung externer API-Aufrufe, Datenbankabfragen und Funktionsausführungen zur Identifizierung von Latenzengpässen oder Fehlern.

- Handoff-Tracing: Bei Multiagentensystemen wird überwacht, wie Aufgaben zwischen Agenten übertragen werden und ob der Kontext korrekt erhalten bleibt.

- Zustandsentwicklung: Verstehen, wie sich Gedächtnis und Kontext im Laufe mehrerer Gesprächsrunden innerhalb einer Sitzung verändern

Zusammen bilden diese Dimensionen die Grundlage für das agentenbasierte Monitoring . LLM-Observability-Tools wie Langsmith, Langfuse, AgentOps und Weights & Biases bieten agentenspezifische Tracing-Ansichten, die vollständige Ausführungsdiagramme anzeigen.

FAQs

Eine gute Observability-Lösung ermöglicht umfassende Transparenz über den gesamten Lebenszyklus von LLM-Aufrufen hinweg. Dies umfasst die Art und Weise, wie ein Modell eine Anfrage empfängt, Tools auswählt, Daten aus einer Datenquelle abruft und eine endgültige Antwort generiert. Observability ist wichtig, da LLM-Anwendungen immer komplexer werden und die Anzahl der LLM-basierten Anwendungen, die auf mehrstufigen Schlussfolgerungen beruhen, stark zunimmt. Daher benötigen Unternehmen Observability-Tools, die Echtzeit-Monitoring und automatisierte Auswertung ermöglichen, um eine konsistente Performance aller LLM-Anwendungen sicherzustellen.

Moderne LLM-Observability-Tools bieten einen detaillierten Überblick über alle Aktionen in LLM-basierten Anwendungen. Dazu gehört die Nachverfolgung jedes LLM-Aufrufs, jeder Tool-Interaktion und jedes Zwischenschritts in einer agentenbasierten Entscheidungskette. Die Möglichkeit, den gesamten Workflow von der Eingabeaufforderung bis zur endgültigen Antwort zu beobachten, hilft Teams, unerwartetes Verhalten zu erkennen und zu verstehen, wie LLM-Modelle Entscheidungen treffen.

Kosten- und Token-Analysen sind mittlerweile unerlässlich. Die Echtzeit-Überwachung der Token-Nutzung hilft Unternehmen, Kosteneffizienz zu gewährleisten und unerwartete Ausgabenspitzen zu vermeiden. Teams können die Token-Nutzung nach Anbieter, Modell, Funktion oder Anwendungspfad aufschlüsseln, um zu verstehen, wie die verschiedenen Komponenten zu den Kosten beitragen. Einige Observability-Tools ermöglichen es Nutzern, mehrere LLM-Anbieter direkt miteinander zu vergleichen und so Entscheidungen hinsichtlich Leistung und Kosteneffizienz beim Routing von Anfragen über Open-Source-LLMs und proprietäre Lösungen zu erleichtern.

Im gesamten Ökosystem betonen Observability-Tools durchgängig die Notwendigkeit der LLM-Observability für den Betrieb von LLM-Anwendungen im großen Maßstab. Teams, die auf Agenten-Workflows setzen, benötigen Einblick in die mehrstufigen Entscheidungsprozesse des Modells und die Auswirkungen jeder einzelnen Entscheidung auf die Modellperformance. Observability trägt dazu bei, konsistente und qualitativ hochwertige Antworten zu gewährleisten, Fehler frühzeitig zu erkennen und das Vertrauen der Nutzer zu erhalten.

Ein weiteres Thema ist die Notwendigkeit, die Betriebskosten zu kontrollieren. Die Überwachung von Token-Nutzung, Speichernutzung und Ressourcennutzungsmetriken hilft Unternehmen, die Ausgaben zu kontrollieren und gleichzeitig Leistung und Kosteneffizienz zu gewährleisten. Die Beobachtbarkeit deckt zudem Leistungsengpässe auf, die die Benutzerzufriedenheit und die Anwendungsleistung beeinträchtigen.

Schließlich ist die Beobachtbarkeit von LLM-Modellen von Bedeutung, da Unternehmen zunehmend auf diese Modelle für kritische Funktionen angewiesen sind. Mit der Erweiterung dieser Systeme müssen Überwachungstools frameworkunabhängig sein, sich in Open-Source-Plattformen integrieren lassen und Einblicke über verschiedene Dienste hinweg ermöglichen. Dies unterstützt eine sichere Implementierung, reduziert Sicherheitsbedenken und hilft Teams, die Modellausgaben in einem breiteren operativen Kontext zu verstehen.

Seien Sie der Erste, der kommentiert

Ihre E-Mail-Adresse wird nicht veröffentlicht. Alle Felder sind erforderlich.