İşletmeler, aramalar, toplantılar ve ses arayüzlerinden büyük miktarda ses verisi üretir, ancak bu verilerin manuel olarak işlenmesi yavaş ve ölçeklendirilmesi zordur.

Konuşma tanıma (otomatik konuşma tanıma veya konuşmadan metne dönüştürme olarak da adlandırılır), konuşulan dili metne dönüştürerek sistemlerin çağrı transkripsiyonu, sesli asistanlar ve toplantı özetleri gibi ses tabanlı iş akışlarını analiz etmesini ve otomatikleştirmesini sağlar.

Konuşma tanıma teknolojisinin nasıl çalıştığını, kullanılan algoritmaları, çeşitli sektörlerdeki uygulamalarını ve gerçek hayattan örneklerini inceliyoruz.

12 konuşma tanıma kullanım örneği

Konuşma tanıma, konuşulan dili metne dönüştürmek ve sistemlerle ses tabanlı etkileşimleri sağlamak için birçok sektörde kullanılmaktadır. Aşağıdaki örnekler, müşteri hizmetleri, satış, otomotiv, sağlık ve teknoloji gibi sektörlerde yaygın olarak kullanılan konuşma tanıma örneklerini göstermektedir.

Müşteri hizmetleri ve destek

- Etkileşimli Sesli Yanıt (IVR) sistemleri: IVR sistemleri, konuşulan soruları tanıyarak arayanları otomatik olarak uygun departmana yönlendirir. Önceden kaydedilmiş yanıtlar veya metinden sese dönüştürme sistemleri kullanarak basit istekleri işleyerek çağrı hacmini ve bekleme sürelerini azaltırlar. Otomatik Konuşma Tanıma (ASR), IVR sistemlerinin müşteri sorularını gerçek zamanlı olarak anlamasını ve yanıtlamasını sağlar.

- Müşteri destek otomasyonu ve sohbet botları: Ses tanıma özelliği, ses tabanlı sohbet botlarının ve sanal asistanların sık sorulan soruları yanıtlamak, sorun giderme adımlarında rehberlik etmek ve hesap sorgularına yardımcı olmak gibi rutin müşteri hizmetleri taleplerini ele almasını sağlar.

- Duygu analizi ve çağrı izleme: Duygu analizi, konuşmaları olumlu, olumsuz veya nötr olarak sınıflandırarak kuruluşların hizmet kalitesini izlemesine ve müşteri endişelerini belirlemesine yardımcı olur.

- Çok dilli destek: Konuşma tanıma modelleri birden fazla dili tanıyacak şekilde eğitilebilir. Sohbet botlarına veya IVR sistemlerine entegre edildiklerinde, kullanıcının dilini algılayabilir ve uygun modele geçiş yapabilirler; bu da kuruluşların uluslararası müşterilere hizmet vermesine yardımcı olur (Şekil 1'e bakınız).

- Ses biyometrisi ile müşteri kimlik doğrulaması: Ses biyometrisi, konuşmacının sesini analiz etmek ve aksan ve konuşma hızı gibi özellikleri çıkararak kimliğini doğrulamak için konuşma tanıma teknolojilerini kullanır.

Şekil 1: Çok dilli bir sohbet robotunun başka bir dildeki kelimeleri nasıl tanıdığını gösteren görsel.

Satış ve pazarlama

- Sanal satış asistanları: Yapay zekâ destekli satış asistanları, müşterilerle sesli iletişim kurarak satın alma kararlarında rehberlik eder. Konuşma tanıma özelliği, bu sistemlerin sözlü talepleri anlamasına ve müşteri niyetine göre yanıt vermesine olanak tanır.

- Transkripsiyon hizmetleri: Konuşma tanıma teknolojisi, satış görüşmeleri ve toplantılarının kayıtlarını yazılı metinlere dönüştürerek, dokümantasyonu ve analizi kolaylaştırır.

Otomotiv

- Sesle etkinleştirilen kontroller: Sesle etkinleştirilen kontroller, kullanıcıların sesli komutlar kullanarak cihazlar ve uygulamalarla etkileşim kurmasına olanak tanır. Sürücüler, klima kontrolü, telefon görüşmeleri veya navigasyon sistemleri gibi özellikleri çalıştırabilir.

- Sesli navigasyon: Sesli navigasyon, sürücünün sesli girişini kullanarak varış noktası için gerçek zamanlı sesli yönlendirme sağlar. Sürücüler, fiziksel kontrollere gerek kalmadan sesli komutlar kullanarak gerçek zamanlı trafik güncellemeleri isteyebilir veya yakındaki ilgi noktalarını arayabilirler.

Sağlık hizmeti

- Tıbbi transkripsiyon: Tıbbi transkripsiyon, kısaca MT olarak da bilinir, ses kaydı alınmış tıbbi raporların yazılı metin belgesine dönüştürülmesi işlemidir. Tıbbi transkripsiyon sürecindeki ana adımlar şunlardır:

- Hekimin dikte ettiği bilgilerin kaydedilmesi.

- Konuşma tanıma sistemleri kullanılarak konuşmanın metne dönüştürülmesi (bazı sistemler konuşmacıları birbirinden ayırmak için konuşmacı ayrıştırma özelliğini de içerir).

- Metnin doğruluğunu artırmak ve gerektiğinde hataları düzeltmek için transkripsiyon işlemini düzenlemek.

- Belgenin yasal ve tıbbi gerekliliklere uygun şekilde biçimlendirilmesi.

- Sanal tıbbi asistanlar: Sanal tıbbi asistanlar (VMA'lar), hastalarla sesli veya yazılı olarak iletişim kurmak için konuşma tanıma, doğal dil işleme ve makine öğrenimi algoritmalarını kullanır. Konuşma tanıma yazılımı, VMA'ların sesli komutlara yanıt vermesini, elektronik sağlık kayıtlarından (EHR'ler) bilgi almasını ve tıbbi transkripsiyon sürecini otomatikleştirmesini sağlar.

- Elektronik Sağlık Kayıtları (EHR) entegrasyonu: Sağlık profesyonelleri, sesli komutları kullanarak EHR sisteminde gezinebilir, hasta verilerine erişebilir ve belirli alanlara veri girebilir.

Konuşma tanıma gerçek hayattan örnekler

Azure Konuşma

Azure Speech, uygulamaların konuşulan dili işlemesini ve üretmesini sağlayan, Microsoft (Azure AI Foundry araçlarının bir parçası) tarafından sunulan bulut tabanlı bir yapay zeka hizmetidir. Şu gibi yetenekler sunar:

Konuşmadan metne dönüştürme (otomatik konuşma tanıma) : Konuşulan sesi, birden fazla transkripsiyon modunu destekleyerek yazılı metne dönüştürür:

- Ses akışı için gerçek zamanlı transkripsiyon

- Kaydedilmiş dosyalar için hızlı transkripsiyon

- Büyük hacimli ses dosyaları için toplu transkripsiyon

Geliştiriciler ayrıca, alana özgü kelime dağarcığı veya gürültülü ortamlar için tanıma doğruluğunu artırmak amacıyla özel konuşma modelleri oluşturabilirler.

Metinden sese dönüştürme (konuşma sentezi) : Yazılı metni, sinirsel sesler kullanarak doğal sesli bir yapıya dönüştürür. Geliştiriciler, Konuşma Sentezi İşaretleme Dili (SSML) kullanarak perde, hız ve telaffuz gibi ses özelliklerini kontrol edebilirler.

Azure Speech ayrıca özel sinirsel sesleri de destekleyerek kuruluşların uygulamaları için benzersiz bir ses oluşturmasına olanak tanır.

Konuşma çevirisi : Gerçek zamanlı çok dilli konuşma çevirisi sağlar; farklı dillerde konuşmadan konuşmaya veya konuşmadan metne çeviri imkanı sunar.

Özel konuşma modelleri : Geliştiriciler, aşağıdaki alanlarda tanımayı iyileştirmek için kendi verilerini kullanarak özel modeller eğitebilirler:

- Sektöre özgü terminoloji

- Aksanlar ve konuşma stilleri

- Gürültülü ses koşulları

Ses avatarları ve konuşma yapay zekası : Azure Speech, sentetik konuşan avatarlar oluşturabilir ve gerçek zamanlı ses etkileşimlerini mümkün kılarak konuşma yapay zekası sistemlerini ve sesli aracıları destekleyebilir.

Şekil 2: Azure Voice AI aracısı Voice Live'dan bir örnek. 1

Deepgram

Deepgram, konuşmadan metne dönüştürme, metinden konuşmaya sentezleme ve ses zekası gibi konuşma özelliklerini entegre etmek için API'ler sağlar. 2

- Konuşmadan metne dönüştürme: Hem gerçek zamanlı yayınlar hem de önceden kaydedilmiş ses dosyaları için sesi metne dönüştürür.

- Metinden sese dönüştürme: Sesli arayüzler ve asistanlar için metinden doğal sesli konuşma üretir.

- Konuşmacı ayrıştırma: Bir ses kaydındaki farklı konuşmacıları belirler ve birbirinden ayırır.

- Anahtar kelime tespiti ve ses zekası: Belirli kelimeleri veya ifadeleri tespit eder ve ses verilerinden bilgiler çıkarır.

- Özel konuşma modelleri: Kuruluşların alana özgü verileri kullanarak tanıma doğruluğunu artırmasına olanak tanır.

Deepgram'ın kullanım alanları şunlardır:

- Müşteri hizmetleri: Çağrı merkezi görüşmelerini yazıya dökmek ve analiz etmek, hizmet kalitesini izlemek ve içgörüler elde etmek.

- Medya ve yayıncılık: Podcast'ler, röportajlar ve canlı yayınlar için altyazı ve transkript oluşturma.

- Sağlık ve hukuk alanında : Sözlü dikte ve konuşmaları yazılı belgelere dönüştürme.

- İş analitiği: Büyük miktarda ses verisinden anahtar kelimeler, duygu analizi ve içgörüler çıkarma.

AssemblyAI

AssemblyAI, müşteri destek görüşmelerinin yazıya dökülüp kalite izleme ve analiz için kullanıldığı çağrı merkezi analitiğinde ; sanal toplantıların transkriptlerini ve özetlerini oluşturan toplantı transkripsiyonunda ; ve altyazı, transkript ve aranabilir ses veya video içeriği sağlayan medya transkripsiyonunda kullanılır.

Ayrıca, ses akışlarındaki uygunsuz veya kısıtlanmış konuşmaları tespit etmek için içerik denetimi ve kaydedilmiş büyük miktardaki konuşmalardan konu, varlık ve duygu gibi bilgileri çıkarmak için ses verisi analizi amacıyla da kullanılır. 3

- Konuşmadan metne dönüştürme: Ses akışlarını veya dosyalarını zaman damgaları, güvenilirlik puanları ve diğer meta verilerle birlikte metne dönüştürür.

- Gerçek zamanlı akışlı transkripsiyon: Sesli asistanlar ve gerçek zamanlı uygulamalar için düşük gecikmeyle canlı ses işleme yapar.

- Ses zekası: Konuşmadan içgörüler çıkarır; konuşmacı ayrıştırma, duygu analizi , konu tespiti ve varlık tanıma gibi özellikler içerir.

- Özetleme ve konuşma anlama: Sonraki iş akışlarını desteklemek için transkriptlerden özetler ve yapılandırılmış çıktılar oluşturur.

- İçerik denetimi ve kişisel bilgilerin gizlenmesi: Ses kayıtlarından hassas veya uygunsuz içerikleri belirler veya kaldırır.

- Çok dilli ve dil algılama özellikleri: Birden fazla dil ve aksan üzerinden transkripsiyonu destekler.

Google Bulut Konuşmadan Metne

Bulut Tabanlı Konuşmadan Metne Dönüştürme, geliştiricilerin ses dosyalarını yazıya dökmek, canlı konuşma akışlarını işlemek ve komutlar veya arama gibi sesle etkinleştirilen özellikler oluşturmak için API'yi entegre etmelerine olanak tanır. 4

- Gerçek zamanlı ve toplu transkripsiyon: Hem akış halindeki ses dosyalarını hem de önceden kaydedilmiş dosyaları transkribe eder.

- Çok dilli destek: 100'den fazla dil ve varyantta konuşmayı tanır.

- Gelişmiş konuşma yapay zeka modelleri: Daha yüksek doğruluk için büyük ses veri kümeleri üzerinde eğitilmiş Google'in konuşma modellerini (örneğin, Chirp 3) kullanır.

- Chirp 3, Google'in otomatik konuşma tanıma (ASR) için geliştirdiği en yeni konuşma yapay zekâ modelidir. Konuşulan sesi daha yüksek doğruluk ve hızla metne dönüştürmek için tasarlanmış çok dilli bir üretken modeldir. Model, transkripsiyon kalitesini artırır ve konuşmacı ayrıştırma (farklı konuşmacıları belirleme), otomatik dil algılama ve çok dilli konuşma tanıma gibi özellikleri destekler.

- Otomatik noktalama ve konuşmacı özellikleri: Transkriptlere noktalama işaretleri ekler ve kayıtlardaki konuşmacıları birbirinden ayırt edebilir.

Konuşma tanıma nedir?

Konuşma tanıma, otomatik konuşma tanıma (ASR), konuşmadan metne dönüştürme (STT) ve bilgisayar konuşma tanıma olarak da bilinen, bir bilgisayarın konuşulan dili tanımasını ve metne dönüştürmesini sağlayan bir teknolojidir.

Konuşma tanıma teknolojisi, farklı aksanları, lehçeleri ve konuşma kalıplarını doğru bir şekilde tanımlamak ve yazıya dökmek için yapay zeka ve makine öğrenimi modellerini kullanır.

Konuşma tanıma ile ses tanıma arasındaki fark

Konuşma tanıma, sıklıkla ses tanıma ile karıştırılır, ancak bunlar farklı kavramlardır. Konuşma tanıma, konuşulan kelimeleri yazılı metne dönüştürür ve konuşmacının kimliğinden bağımsız olarak, kullanıcı tarafından söylenen kelimeleri ve cümleleri belirlemeye odaklanır.

Öte yandan, ses tanıma, konuşmanın içeriğini anlamaya odaklanmaktan ziyade, bilinmeyen bir konuşmacının kimliğini belirlemeyi amaçlayarak, konuşmacının sesini tanımak veya doğrulamakla ilgilenir.

Konuşma tanıma sistemlerinin özellikleri nelerdir?

Konuşma tanıma sistemleri, insan konuşmasını anlamak ve işlemek için birlikte çalışan çeşitli bileşenlere sahiptir. Etkili konuşma tanıma sistemlerinin temel özellikleri şunlardır:

Ses ön işleme

Giriş cihazından ham ses sinyalini aldıktan sonra, konuşma girişinin kalitesini iyileştirmek için ön işlemden geçirmeniz gerekir. Ses ön işlemenin temel amacı, istenmeyen bozulmaları ortadan kaldırarak ve gürültüyü azaltarak ilgili konuşma verilerini yakalamaktır.

Özellik çıkarımı

Bu aşama, önceden işlenmiş ses sinyalini daha bilgilendirici bir gösterime dönüştürür. Bu, ham ses verilerini konuşma tanıma sistemlerindeki makine öğrenimi modelleri için daha yönetilebilir hale getirir.

Dil modeli ağırlıklandırması

Dil ağırlıklandırması, ses ve konuşma sinyallerinde ürün referansları gibi belirli kelime ve ifadelere daha fazla ağırlık verir. Bu, söz konusu anahtar kelimelerin konuşma tanıma sistemleri tarafından daha sonraki konuşmalarda tanınma olasılığını artırır.

Akustik modelleme

Bu, konuşma tanıma sistemlerinin bir konuşma sinyali içindeki fonetik birimleri yakalamasını ve ayırt etmesini sağlar. Akustik modeller, farklı aksanlara, konuşma stillerine ve geçmişlere sahip çeşitli konuşmacılardan alınan konuşma örneklerini içeren büyük veri kümeleri üzerinde eğitilir.

Hoparlör etiketleme

Bu özellik, konuşma tanıma uygulamalarının bir ses kaydındaki birden fazla konuşmacının kimliğini belirlemesini sağlar. Ses kaydındaki her konuşmacıya benzersiz etiketler atayarak, herhangi bir anda hangi konuşmacının konuştuğunun belirlenmesine olanak tanır.

Küfür filtreleme

Ses kayıtlarından rahatsız edici, uygunsuz veya açık sözlü kelime veya ifadelerin kaldırılması işlemi.

Farklı konuşma tanıma algoritmaları nelerdir?

Konuşma tanıma, konuşulan dili yazılı dile dönüştürmek için çeşitli algoritmalar ve hesaplama teknikleri kullanır. Aşağıda en yaygın kullanılan konuşma tanıma yöntemlerinden bazıları yer almaktadır:

Gizli Markov Modelleri (HMM'ler)

Gizli Markov modeli, geleneksel konuşma tanıma sistemlerinde yaygın olarak kullanılan istatistiksel bir Markov modelidir. HMM'ler, akustik özellikler arasındaki ilişkiyi yakalar ve konuşma sinyallerinin zamansal dinamiklerini modeller.

Doğal dil işleme (NLP)

Doğal dil işleme (NLP), insan ve makine arasındaki etkileşimi doğal dil aracılığıyla inceleyen yapay zekanın bir alt alanıdır. Konuşma tanıma sistemlerinde NLP'nin başlıca rollerinden bazıları şunlardır:

- Tanımlanan metindeki kelime dizilerinin olasılığını tahmin edin.

- Konuşma dilindeki argo ifadeleri ve kısaltmaları standart yazılı forma dönüştürün.

- Akustik modellerden elde edilen fonetik birimleri hedef dildeki karşılık gelen kelimelerle eşleştirin.

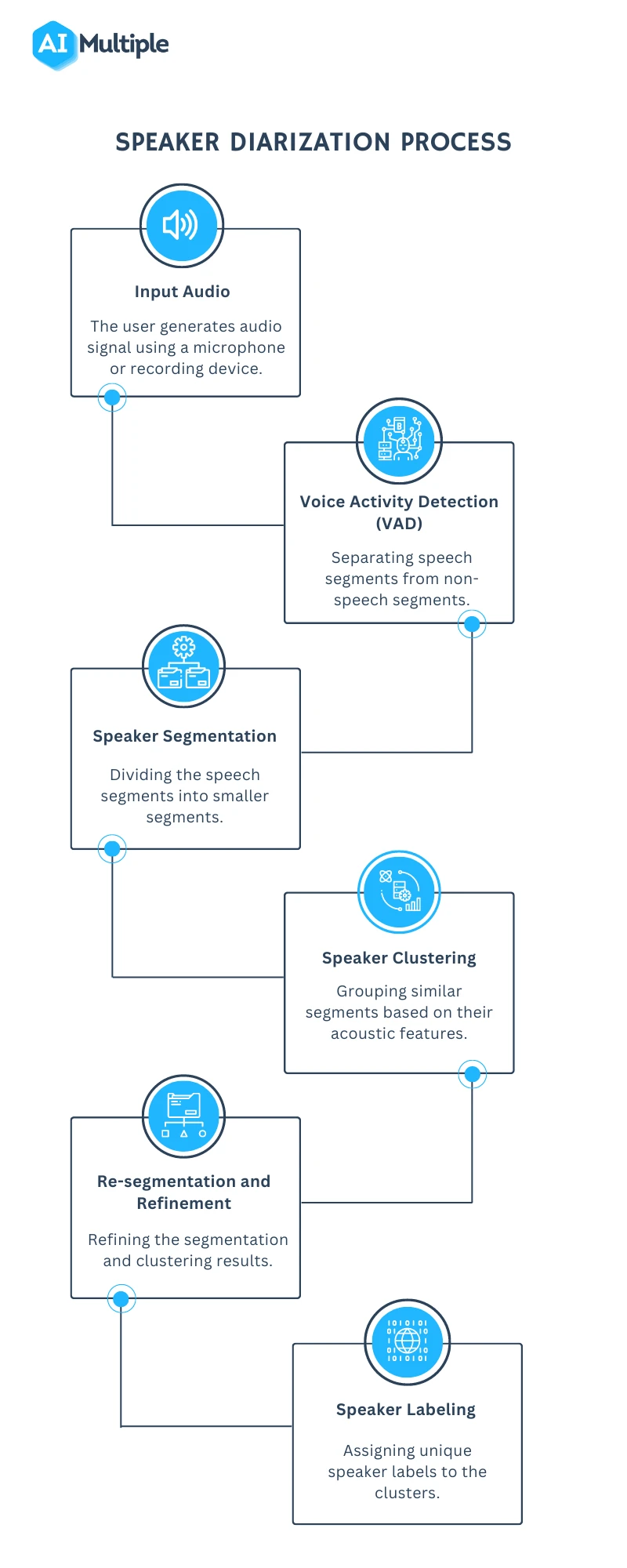

Konuşmacı Diyagramlaştırma (SD)

Konuşmacı ayrıştırma veya konuşmacı etiketleme, konuşma bölümlerini ilgili konuşmacılara tanımlama ve atfetme işlemidir (Şekil 1). Bu işlem, konuşmacıya özgü ses tanıma ve bir konuşmadaki bireylerin tanımlanmasına olanak tanır.

Şekil 3: Konuşmacı ayrıştırma sürecini gösteren bir akış şeması.

Dinamik Zaman Bükme (DTW)

Konuşma tanıma algoritmaları, iki dizi arasında en uygun hizalamayı bulmak için Dinamik Zaman Bükme (DTW) algoritmasını kullanır (Şekil 4).

Şekil 4: Elemanlar arasındaki en uygun mesafeyi belirlemek için dinamik zaman bükme yöntemini kullanan bir konuşma tanıyıcı. 5

Derin sinir ağları

Sinir ağları, insan işitme sisteminin doğrusal olmayan frekans algısını simüle ederek giriş verilerini işler ve dönüştürür.

Bağlantıcı Zamansal Sınıflandırma (CTC)

Bu, Alex Graves tarafından 2006 yılında tanıtılan bir eğitim hedefidir. CTC, özellikle sıralı etiketleme görevleri ve uçtan uca konuşma tanıma sistemleri için kullanışlıdır. Sinir ağının giriş kareleri arasındaki ilişkiyi keşfetmesini ve giriş karelerini çıkış etiketleriyle hizalamasını sağlar.

Konuşma tanıma teknolojisinin zorlukları nelerdir?

Konuşma tanıma teknolojisi birçok avantaj sunsa da, ele alınması gereken bir dizi zorlukla da karşı karşıyadır. Konuşma tanıma teknolojisinin başlıca sınırlamalarından bazıları şunlardır:

Akustik zorluklar

Aksanlar ve lehçeler

Aksanlar ve lehçeler telaffuz, kelime dağarcığı ve dilbilgisi açısından farklılık gösterdiğinden, konuşma tanıma uygulamalarının konuşmayı doğru bir şekilde tanıması zorlaşmaktadır.

Varsayalım ki bir konuşma tanıma modeli öncelikle Amerikan İngilizcesi aksanları üzerinde eğitilmiştir. Güçlü bir İskoç aksanına sahip bir konuşmacı sistemi kullanırsa, telaffuz farklılıkları nedeniyle zorluklarla karşılaşabilir. Örneğin, "su" kelimesi her iki aksanda da farklı telaffuz edilir. Sistem bu telaffuza aşina değilse, "su" kelimesini tanımakta zorlanabilir.

Çözüm: Bu zorlukların üstesinden gelmek, konuşma tanıma uygulamalarının doğruluğunu artırmak için çok önemlidir. Telaffuz farklılıklarının üstesinden gelmek için, eğitim verilerini çeşitli aksanlara sahip konuşmacılardan alınan örnekleri içerecek şekilde genişletmek şarttır. Bu yaklaşım, sistemin daha geniş bir konuşma kalıbı yelpazesini tanımasına ve anlamasına yardımcı olur.

Arka plan gürültüsü

Arka plan gürültüsü (örneğin, trafik, karşılıklı konuşma) konuşma tanıma uygulamaları için konuşmayı arka plan gürültüsünden ayırt etmeyi zorlaştırır (Şekil 5'e bakınız).

Çözüm: Konuşma tanımada arka plan gürültüsünü azaltmak için ön işleme teknikleri kullanılabilir; bu da gürültülü ortamlarda konuşma tanıma modellerinin performansını artırmaya yardımcı olabilir.

Örneğin, ses verilerindeki gürültünün etkisini azaltmak için veri artırma tekniklerini kullanabilirsiniz. Veri artırma, konuşma tanıma modellerini gürültülü verilerle eğitmeye yardımcı olarak gerçek dünya ortamlarında model doğruluğunu artırır.

Şekil 5: Arka planda konuşma, araba ve yağmur gürültüsü eşliğinde hedef cümlenin (“Palyaçonun komik bir yüzü vardı”) örnekleri. 6

Dilsel zorluklar

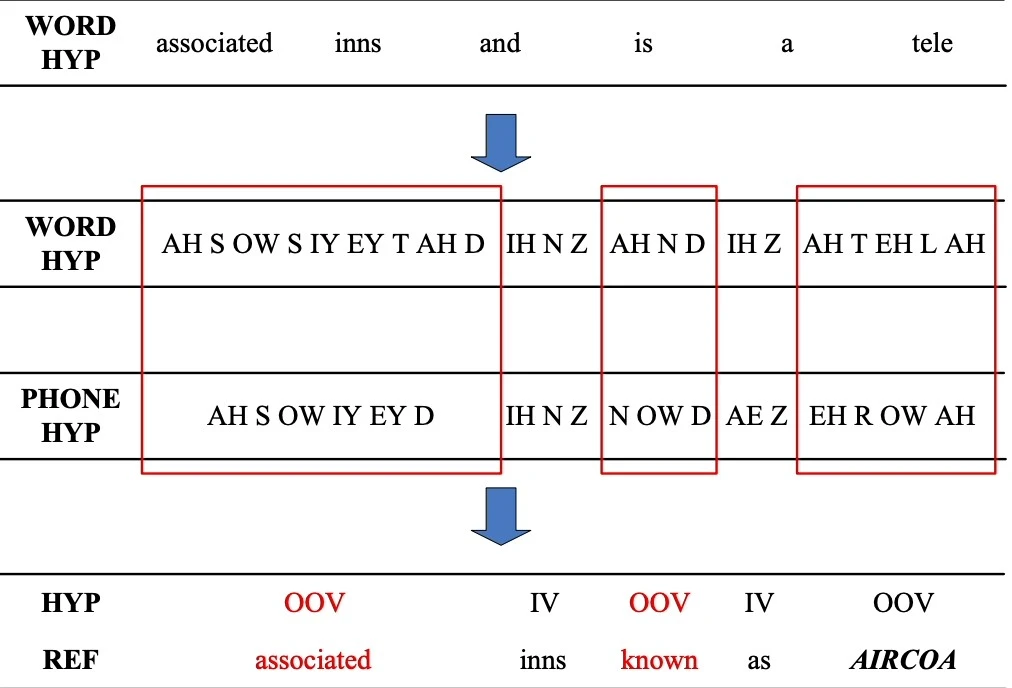

Sözlük dışı kelimeler

Konuşma tanıma modeli, sözlük dışı kelimeler üzerinde eğitilmediği için, bu kelimelerle karşılaştığında onları yanlış tanıyabilir veya yazıya dökemeyebilir.

Şekil 6: Sözlük dışı bir kelimenin tespitine bir örnek.

Çözüm: Kelime Hata Oranı (WER), konuşma tanıma veya makine çevirisi sisteminin doğruluğunu ölçmek için kullanılan yaygın bir ölçüttür. Kelime hata oranı şu şekilde hesaplanabilir:

Şekil 7: Kelime hata oranının (WER) nasıl hesaplanacağını göstermektedir. 7

Eşsesli kelimeler

Eşsesli kelimeler, aynı şekilde telaffuz edilen ancak farklı anlamlara gelen kelimelerdir; örneğin "to", "too" ve "two".

Çözüm: Semantik analiz, konuşma tanıma programlarının belirli bir bağlamda amaçlanan anlamına göre uygun eşsesli kelimeyi seçmesine olanak tanır. Eşsesli kelimelerin ele alınması, konuşma tanıma sürecinin konuşulan kelimeleri doğru bir şekilde anlama ve yazıya dökme yeteneğini geliştirir.

Teknik/sistem zorlukları

Veri gizliliği ve güvenliği

Konuşma tanıma sistemleri, finansal bilgiler gibi hassas ve kişisel bilgilerin işlenmesini ve saklanmasını içerir. Yetkisiz bir taraf, ele geçirilen bilgileri kullanarak gizlilik ihlallerine yol açabilir.

Çözüm: Kullanıcının cihazı ile konuşma tanıma yazılımı arasında iletilen hassas ve kişisel ses bilgilerini şifreleyebilirsiniz. Konuşma tanıma sistemlerinde veri gizliliği ve güvenliğini ele almanın bir diğer tekniği ise veri maskelemedir. Veri maskeleme algoritmaları, hassas konuşma verilerini yapısal olarak aynı ancak akustik olarak farklı verilerle maskeler ve değiştirir.

Şekil 8: Veri maskeleme işleminin nasıl çalıştığına dair bir örnek.

Sınırlı eğitim verileri

Sınırlı eğitim verisi, konuşma tanıma yazılımının performansını doğrudan etkiler. Yetersiz eğitim verisiyle, konuşma tanıma modeli farklı aksanları genelleştirmekte veya daha az kullanılan kelimeleri tanımakta zorlanabilir.

Çözüm: Eğitim verilerinin kalitesini ve miktarını artırmak için, veri artırma ve sentetik veri üretme teknolojilerini kullanarak mevcut veri setini genişletebilirsiniz.

Yorum yapan ilk kişi olun

E-posta adresiniz yayınlanmayacak. Tüm alanlar gereklidir.