Wir haben 15 führende multimodale KI-Modelle hinsichtlich ihres visuellen Denkvermögens anhand von 200 visuellen Aufgaben getestet. Die Evaluierung umfasste zwei Teile: 100 Aufgaben zum Verständnis von Diagrammen, die die Interpretation von Datenvisualisierungen prüften, und 100 Aufgaben zur visuellen Logik, die Mustererkennung und räumliches Denken bewerteten. Jede Aufgabe wurde fünfmal gestellt, um konsistente und zuverlässige Ergebnisse zu gewährleisten.

Benchmark für visuelles Denkvermögen

In unserer Benchmark-Methodik erfahren Sie mehr über unsere Testverfahren.

Die Modelle gemini-3.1-pro-preview und gemini-3-pro-preview führen die Rangliste an. Ihnen folgen gpt-5.2 , kimi-k2.5 und gpt-5.2-pro, die die nächste Gruppe von Modellen bilden. Während die meisten Modelle bei datengetriebenen Aufgaben gut abschneiden, besteht bei llama-4-maverick weiterhin eine Lücke in der Verknüpfung visueller Eingaben mit logischen Schritten.

Visuelle Logik

Visuelle Logik erfordert Mustererkennung und räumliches Denken. gemini-3.1-pro-preview führt den Test zur visuellen Logik an und zeigt die höchste Leistung bei Aufgaben zum abstrakten Denken. Viele Modelle weisen im Vergleich zu den Ergebnissen der Diagrammanalyse eine geringere Leistung auf. llama-4-maverick zeigt eine Einschränkung bei diesen Aufgaben.

Diagrammverständnis

Die Modelle zeigen eine höhere Kompetenz in der Diagramminterpretation als in der visuellen Logik. gemini-3.1-pro-preview erzielt die höchste Punktzahl in Tests zum Diagrammverständnis, dicht gefolgt von gemini-3-pro-preview und gemini-2.5-pro , was eine starke Fähigkeit zur Dekodierung strukturierter Daten und Visualisierungen belegt. claude-opus-4.6 und claude-sonnet-4.6 erzielen höhere Ergebnisse bei der Diagramminterpretation als in ihren Logiktests. Datengetriebene visuelle Aufgaben sind für aktuelle multimodale Modelle leichter zugänglich als Mustererkennung.

Statistische Zuverlässigkeit der visuellen Denkleistung (95%-KI)

Wir berechneten die 95%-Konfidenzintervalle (KI) mittels 10.000 Bootstrap-Resamples, um die Fehlermarge für jedes Modell zu bestimmen und den Bereich aufzuzeigen, in dem die tatsächliche Leistung wahrscheinlich liegt.

Benchmark-Fragen zu den Stärken und Schwächen von LLM-Absolventen

Diagrammfrage mit der niedrigsten LLM-Erfolgsquote

Abbildung 1: Balkendiagramm mit den Verkaufszahlen von Star über 12 Monate mit vier gruppierten Balken pro Monat (Daten von 1998–2000). Jeder Monat zeigt durchgezogene, weiße und gestreifte Balken in enger Gruppierung.

Hinweis: Alle Charts stammen von Hitbullseye. 1

Frage: Wenn die Umsätze über drei aufeinanderfolgende Jahre stetig steigen oder fallen, spricht man von einem stetigen Trend. In welchen Monaten ist über drei aufeinanderfolgende Jahre ein stetig steigender Trend zu beobachten?

Beispielsweise war der Istwert im Juni 1999 niedriger als 1998, was einen Rückgang anzeigte, aber das Modell interpretierte ihn fälschlicherweise als stetigen Anstieg. Die meisten Modelle machen bei dieser Frage denselben Fehler.

Wenn vier Balken pro Monat zusammengefasst wurden, hatten die Modelle Schwierigkeiten mit der Zuordnung der Balken zu den Jahren und der relativen Höhenwahrnehmung. Sie konnten nicht genau unterscheiden, welcher gestreifte/durchgezogene/weiße Balken zu welchem Jahr gehörte, was dazu führte, dass die Balken in der falschen Reihenfolge gelesen oder ihre Höhen verwechselt wurden.

Dies offenbarte eine grundlegende Einschränkung des visuell-räumlichen Denkens: Den aktuellen Modellen fehlte die pixelgenaue Wahrnehmung, die für die korrekte Messung und Sequenzierung dicht gedrängter Balken erforderlich ist, was zu einer systematischen Fehlidentifizierung von Trends führte.

Diagrammfrage mit der höchsten Erfolgsquote im LLM-Studium

Abbildung 2: Balkendiagramm mit den prozentualen Wahlbeteiligungen bei den indischen Parlamentswahlen von 1952 bis 1998. Ein Balken pro Wahljahr mit deutlichem Abstand zwischen den Balken.

Frage: In welchen Jahren wurde die höchste bzw. niedrigste Wahlbeteiligung (in Prozent) verzeichnet?

Alle Modelle haben diese Frage korrekt beantwortet. Dieser Erfolg zeigt, dass die Modelle bei der einfachen Min-Max-Identifizierung, also dem Auffinden der höchsten und niedrigsten Balken, hervorragend geeignet sind.

Im Gegensatz zu den unübersichtlichen, gruppierten 4-Balken-Diagrammen zeigt dieses Diagramm einen einzelnen Balken pro Jahr mit klaren Abständen, was einen direkten visuellen Vergleich ermöglicht. Die Modelle eignen sich gut für rein beobachtende Aufgaben, die keine komplexe Zuordnung von Balken zu Kategorien erfordern.

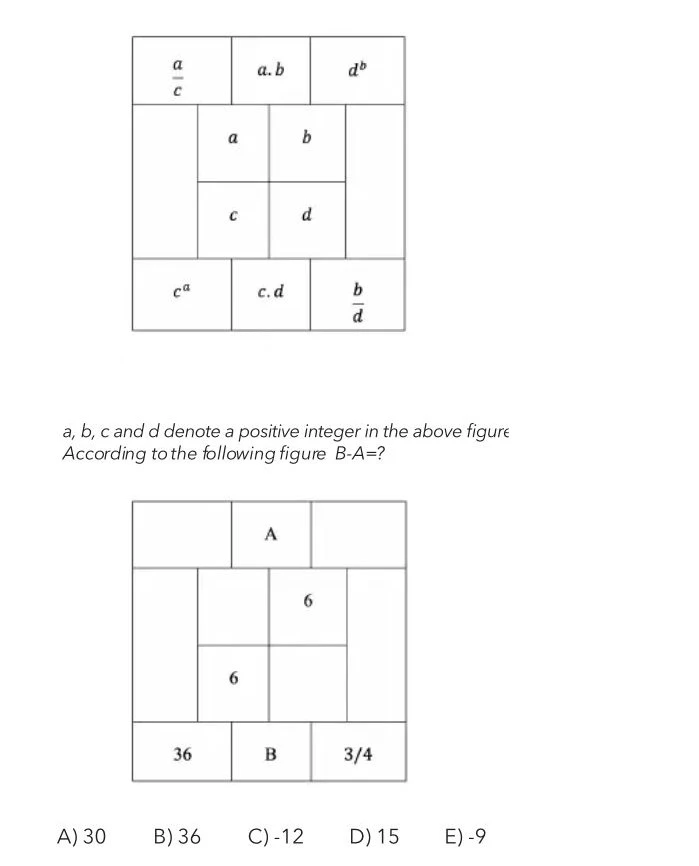

Frage zur visuellen Logik mit der höchsten Erfolgsquote im LLM-Studium

Abbildung 3: Zwei übereinander angeordnete 3×3-Gitter zur Veranschaulichung algebraischer Mustererkennung. Das obere Gitter enthält Variablen und ihre Rechenoperationen (Multiplikation, Division, Potenzierung). Das untere Gitter zeigt numerische Werte, wobei einige Zellen ausgefüllt sind (6, 36, 3/4) und zwei Unbekannte (A, B) enthalten sind. Gesucht ist BA.

Der Erfolg beruhte auf dem klaren mathematischen Muster, das in der Tabellenstruktur erkennbar war (algebraische Beziehungen wie a×b, c×d). Das einfache Rasterlayout ohne visuelle Komplexität ermöglichte es den Modellen, sich ausschließlich auf numerische Schlussfolgerungen und logische Deduktion zu konzentrieren.

Modelle sind dann besonders effektiv, wenn Probleme explizite mathematische Muster beinhalten, die durch schrittweises Denken gelöst werden können. Sie beweisen ihre Stärke in symbolischer Logik und Mustererkennung, wenn visuelle Ablenkungen minimal sind.

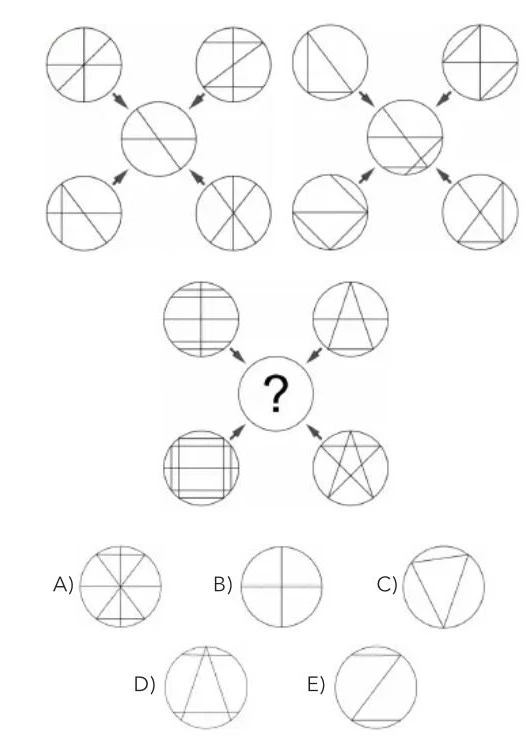

Frage zur visuellen Logik mit der niedrigsten Erfolgsquote im LLM-Studium

Abbildung 4: Mustererkennungsrätsel mit Kreisen, die verschiedene Linienmuster und geometrische Formen enthalten. Oben sind zwei Beispielsequenzen mit Pfeilen dargestellt, gefolgt von einer Frage, in der die dritte Sequenz aus fünf Antwortmöglichkeiten vervollständigt werden soll.

Die Schwierigkeit liegt darin, dass eine abstrakte visuelle Mustererkennung erforderlich ist, um geometrische Transformationsregeln anhand mehrerer Beispiele zu identifizieren.

Dies erfordert rein räumliches Denken, um zu verstehen, wie sich Formen drehen, verändern und zueinander in Beziehung stehen. Modelle haben Schwierigkeiten, Regeln aus visuellen Sequenzen abzuleiten, wenn keine expliziten numerischen oder textuellen Vorgaben, sondern nur räumliche Muster vorliegen.

Was ist visuelles Denken?

Visuelles Denken ist die Fähigkeit eines Modells, Bilder zu interpretieren, visuelle Elemente zu verknüpfen und Fragen zu beantworten, die sowohl visuelle als auch textuelle Informationen erfordern. Diese Fähigkeit geht über die einfache Objekterkennung hinaus und umfasst Aufgaben wie die Analyse von Datenvisualisierungen, die Identifizierung räumlicher Muster und das Verständnis von Beziehungen zwischen visuellen Elementen.

Unser Benchmark bewertete dies anhand zweier unterschiedlicher Testreihen, um verschiedene kognitive Aspekte zu prüfen: Diagrammverständnis, bei dem die Modelle Balken-, Linien- und Streudiagramme interpretierten, um ihre Fähigkeit zur Extraktion strukturierter Informationen aus Datenvisualisierungen zu beurteilen; und visuelle Logik, bei der sie Mustererkennungsaufgaben und räumliche Denkprobleme lösten, um abstraktes Denken ohne explizite numerische Vorgaben zu messen. Diese Unterteilung spiegelt den grundlegenden Unterschied in der Verarbeitung expliziter Daten im Vergleich zu impliziten Mustern durch die Modelle wider.

Modelle erzielen visuelles Schließen durch unterschiedliche architektonische Ansätze. Beispielsweise koordiniert das Cola-Framework mehrere Bild-Sprach-Modelle, von denen jedes Bildunterschriften und plausible Antworten liefert. Ein zentrales LLM wertet diese Optionen dann aus und wählt die zutreffendste Antwort aus.

Abbildung 5: Graph, der zeigt, wie Cola ein koordinatives Sprachmodell für visuelles Denken nutzt. 2

Ein weiteres Beispiel ist das CVR-LLM-Framework, das die Schlussfolgerung verbessert, indem es Bilder mithilfe der CaID-Methode in kontextbezogene Beschreibungen umwandelt und mit dem CVR-ICL-Verfahren relevante Beispiele auswählt. Dieses Framework behandelt Bildinformationen als textbasierte Repräsentationen und ermöglicht es dem LLM so, Assoziationen in verschiedenen multimodalen Aufgaben effektiver zu analysieren. 3

Wie visuelles Denken in LLMs funktioniert

Sprachmodellsysteme (LLMs) nehmen Bilder nicht direkt wahr. Sie nutzen Bildkodierer, die Bilder in strukturierte, auf Sprachmodelle zugeschnittene Repräsentationen umwandeln. Der Kodierer identifiziert Objekte, Texturen, räumliche Beziehungen und visuelle Muster. Das LLM kombiniert diese Repräsentation dann mit der Textanfrage, um eine Schlussfolgerungskette zu erstellen.

Koordination oder Verfeinerung

Für komplexe visuelle Szenarien existieren zwei Hauptmechanismen: Koordination, bei der ein LLM die Ausgaben mehrerer Bildverarbeitungsmodelle integriert, um Interpretationen abzugleichen; und Verfeinerung, bei der das LLM die Bildbeschreibungen iterativ durch Feedbackschleifen verbessert, die fehlende Informationen identifizieren. Beide Mechanismen beheben die Einschränkungen, bei denen einzelne Modelle komplexe Szenarien nicht analysieren können.

Kontextbezogenes Lernen für multimodales Denken

Einige Frameworks extrahieren ähnliche Beispiele aus den Trainingsdaten und liefern dem Modell so Vorlagen zur Interpretation visueller Eingaben. Diese Beispiele helfen dem Modell, erlernte Denkmuster auf neue Probleme anzuwenden.

Erstellung der endgültigen Erklärung

Das LLM liefert eine Antwort, die durch einen Begründungsprozess untermauert wird und erklärt, wie es das Bild interpretiert hat, auf welche visuellen Elemente es sich gestützt hat und welche logischen Verbindungen es hergestellt hat.

Gedankenkettenschluss bei visuellen Aufgaben

Die Gedankenketten-Theorie (Chain-of-Thought, CoT) hat sich als wichtiger Ansatz im visuellen Denken etabliert. Anstatt ein Bild als Ganzes zu analysieren, zerlegen Modelle visuelle Probleme nun in kleinere, aufeinanderfolgende Schritte, ähnlich wie Menschen komplexe Probleme lösen, indem sie diese Schritt für Schritt durchdenken.

Visual CoT ermöglicht es Modellen, den Fokus dynamisch auf verschiedene räumliche Bereiche eines Bildes anzupassen und behebt damit eine zentrale Einschränkung bisheriger Modelle, die auf Bildverarbeitung mit fester Granularität beruhten. Beispielsweise könnte das Modell bei der Analyse eines komplexen Diagramms zunächst die Achsen identifizieren, dann einzelne Datenpunkte untersuchen und schließlich Trends vergleichen, anstatt zu versuchen, alles gleichzeitig zu erfassen.

Dieser Ansatz integriert bestärkendes Lernen und Imitationslernen, um Modelle stärker an menschliche Denkmuster anzugleichen. Dies stellt einen grundlegenden Wandel von passiver Mustererkennung hin zu aktiver visueller Problemlösung dar, bei der Modelle aktiv erkunden und interpretieren, was sie sehen. 4

Geschäftsanwendungen des visuellen Denkens in LLMs

LLMs mit visuellen Fähigkeiten können vielfältige Geschäftsszenarien unterstützen. Diese Anwendungen basieren auf der Fähigkeit des Modells, Bilder zu analysieren, sie mit Textdaten zu verknüpfen und verlässliche Erkenntnisse zu gewinnen.

Dokumenten- und Inhaltsanalyse

Unternehmen verarbeiten Diagramme, technische Zeichnungen, Abbildungen aus wissenschaftlichen Zeitschriften und verschiedene Formen visueller Daten. Ein visuelles Denkmodell kann:

- Fehlende oder fehlerhafte Elemente erkennen.

- Identifizieren Sie Objekte oder Zeichen im unteren Bereich oder in den Ecken der Diagramme.

- Verbinden Sie Text- und Bildsegmente für Qualitätskontrollen.

- Strukturierte Informationen für die weitere Verwendung oder Berichterstellung extrahieren.

Intuit integrierte beispielsweise die Doc AI- und Doc AI-Modelle der Cloud, um Steuererklärungen in gängigen US-Steuerformularen automatisch auszufüllen und so sowohl die Geschwindigkeit als auch die Genauigkeit der Dokumentenverarbeitung zu verbessern. 5

Qualitätsprüfung und Betriebsabläufe

In der Fertigung und Logistik können Modelle Produkte oder Verpackungen prüfen. Visuelles Denken hilft, Fehler, Fehlausrichtungen oder ungewöhnliche Muster zu erkennen. Das Modell kann Bilder mit einer Referenz vergleichen und eine Erklärung dafür generieren, was sich geändert hat oder was fehlt.

Beispielsweise nutzt Intel KI-gestützte Bildverarbeitungssysteme, die jährlich 2 Millionen Dollar einsparen. Die Hersteller erreichen den ROI in der Regel innerhalb von 6 bis 12 Monaten durch weniger Ausschuss und weniger Kundenretouren. 6

Einzelhandel und E-Commerce

Modelle analysieren Produktbilder, identifizieren wichtige Merkmale und gleichen diese mit Katalogdaten ab. Visuelle Suchfunktionen ermöglichen es Kunden, Bilder hochzuladen und mithilfe von Computer Vision ähnliche Produkte zu finden. KI-gestützte Größenempfehlungen haben die Retourenquote um 20–30 % gesenkt. Diese Systeme erkennen zudem Unstimmigkeiten zwischen Produktbeschreibungen und Bildern. 7

Sicherheit und Überwachung

Visuelles Denken unterstützt die Video- und Bildprüfung durch die Analyse von Bildsequenzen und die Erkennung ungewöhnlicher Muster. Cambridge Industries implementierte ein KI-gestütztes Sicherheitssystem für Baustellen, das die Kosten für Notfallreparaturen um fast 50 % senkte. 8

Marketing und Nutzererfahrung

Visuelles Denken hilft Teams zu verstehen, wie Nutzer mit digitalen Inhalten interagieren. Ein Modell kann Screenshots oder Werbemittel auswerten und Erkenntnisse über Layout, Objektplatzierung und potenzielle Probleme liefern. Dies ist besonders relevant bei der Bewertung verschiedener Kategorien visueller Assets.

Comeen verwendet beispielsweise Gemini KI, um mit einem Klick mehrsprachige Untertitel für Videos am Arbeitsplatz in 40 Sprachen zu generieren. Dadurch entfällt der mehrtägige Prozess mit mehreren Anbietern, der Inhalte zuvor schon vor der Veröffentlichung veraltet machte. 9

Vergleichendes Marktumfeld: Die wichtigsten Akteure und ihre Herangehensweisen

Chance AI

Chance AI gehört zu den ersten kommerziellen Tools, die auf visuellem Verständnis basieren. Ihr visuelles Analysesystem untersucht Bilder unter kulturellen, historischen, funktionalen und ästhetischen Gesichtspunkten. Anstatt einfache Kategorien zu vergeben, liefert es strukturierte Erkenntnisse, die erklären, warum ein Objekt, eine Figur oder eine Szene relevant ist – beispielsweise der Stil des Kunstwerks, seine Symbolik und sein historischer Kontext, neben dem dargestellten Motiv.

Das Design legt den Fokus auf die Benutzerfreundlichkeit, indem es eine sinngeleitete Erkundung von Bildern ohne Texteingabe ermöglicht. Dies geht über die traditionelleComputer Vision hinaus und fördert Interpretation, Storytelling und menschenähnliche Erklärungen. Dadurch ist es besonders relevant für die Kreativwirtschaft, den Bildungsbereich und den Tourismus, wo der Kontext einen Mehrwert jenseits der reinen Erkenntnis bietet. 10

Meta AI

Das UniBench-Framework von Meta führte einen einheitlichen Ansatz zur Bewertung visuellen Denkens ein, indem es über fünfzig Benchmarks für räumliches Verständnis, Kompositionsdenken und Zählen kombinierte. Tests mit fast sechzig Bild-Sprach-Modellen ergaben, dass die Skalierung von Daten und Modellgröße die Wahrnehmung, nicht aber das logische Denken verbessert. Selbst fortgeschrittene Modelle versagen bei einfachen Aufgaben wie der Ziffernerkennung und dem Zählen von Objekten.

Diese Erkenntnisse haben die Messung von Fortschritten im visuellen Denken verändert und unterstreichen den Bedarf an qualitativ hochwertigeren Daten, zielgerichteten Lernzielen und strukturiertem Lernen, anstatt sich ausschließlich auf größere Modelle zu verlassen. Unternehmen bietet UniBench eine transparente Möglichkeit, die Denkleistung bei multimodalen Aufgaben vor der Implementierung zu vergleichen. 11

Abbildung 6: Die Grafik zeigt die mittlere Leistung von 59 VLMs auf 53 Benchmarks. Daraus geht hervor, dass trotz Fortschritten viele Modelle immer noch auf einem Niveau nahe dem Zufallsniveau abschneiden, insbesondere bei Aufgaben wie Winoground, iNaturalist, DSPR und anderen (blau: Median ohne vorheriges Training; grau: Zufallsniveau). 12

OpenAI

OpenAI Die Modelle o3 und o4-mini ermöglichen fortgeschrittenes visuelles Denken, indem sie Bildmanipulation in ihre Schlussfolgerungen integrieren. Während der Analyse zoomen, beschneiden oder drehen sie Bilder, um sich auf relevante Details zu konzentrieren – analog zur menschlichen Art, die visuelle Aufmerksamkeit beim Interpretieren von Diagrammen oder Zeichnungen anzupassen.

Die Modelle wurden anhand multimodaler Benchmarks wie Diagramminterpretation, visueller Problemlösung und mathematischem Denken getestet und zeigten deutliche Verbesserungen in Genauigkeit und Kontextverständnis. Die Ergebnisse offenbarten jedoch auch Einschränkungen, darunter inkonsistente Schlussfolgerungen und gelegentliche Wahrnehmungsfehler, was die anhaltende Herausforderung der Zuverlässigkeit visueller Denksysteme unterstreicht.

Abbildung 7: Die Grafik zeigt die Ergebnisse aller Modelle, die unter hohen Anforderungen an den Denkaufwand ausgewertet wurden. 13

Akademische und offene Forschungsbemühungen

VisuLogic: Ein Benchmark zur Bewertung visuellen Schließens in multimodalen großen Sprachmodellen

Dieser Artikel stellt VisuLogic vor, einen Benchmark zur Bewertung der Leistungsfähigkeit multimodaler Modelle bei visuellen Schlussfolgerungsaufgaben. Er kombiniert über fünfzig Datensätze, die verschiedene Arten des Denkens abdecken, darunter räumliche Beziehungen, Kompositionslogik und Objektzählung.

Die Autoren analysieren Dutzende bestehender Modelle und stellen fest, dass eine Vergrößerung der Datenmenge zwar die Bilderkennung verbessert, nicht aber das logische Denken. Modelle erkennen häufig Muster, ohne die Beziehungen zwischen Objekten zu verstehen. Die Arbeit betont, dass ein spezifisches Training für das logische Denken, eine höhere Datenqualität und eine detaillierte Evaluierung unerlässlich für einen sinnvollen Fortschritt sind.

VisuLogic bietet ein einheitliches Framework, das Forschern und Unternehmen hilft, Denkfähigkeiten zu analysieren, anstatt sich ausschließlich auf Wahrnehmungsmetriken zu verlassen. Dadurch wird es zu einer wertvollen Ressource für die Bewertung multimodaler Denksysteme. 14

Erklären Sie, bevor Sie antworten: Eine Umfrage zum visuellen Kompositionsdenken

Diese Studie untersucht aktuelle Ansätze des kompositionellen visuellen Denkens und konzentriert sich darauf, wie Modelle visuelle und textuelle Hinweise kombinieren, um zu einer korrekten Antwort zu gelangen. Sie identifiziert Schwächen bestehender Methoden, die auf Wiedererkennung anstatt auf strukturiertem Denken beruhen.

Die Autoren schlagen vor, Modelle so zu trainieren, dass sie vor der Beantwortung erklären, um sicherzustellen, dass jeder Denkprozess transparent und nachvollziehbar ist. Sie erörtern Techniken zur Angleichung visueller und sprachlicher Repräsentationen, damit die Modelle Diagramme, Abbildungen und Objektassoziationen besser verstehen können.

Die Studie kommt zu dem Schluss, dass abgestimmtes und erklärbares Denken die Zuverlässigkeit und Interpretierbarkeit multimodaler Aufgaben verbessert. Sie hebt hervor, dass die Zukunft der Forschung zum visuellen Denken von der Integration erklärungsbasierten Lernens in die Modellentwicklung abhängt. 15

Herausforderungen bei den visuellen Denkfähigkeiten des LLM

Fortschritte im Bereich des visuellen Denkens bringen auch technische und ethische Herausforderungen mit sich, die berücksichtigt werden müssen.

Die Zuverlässigkeit bleibt ein zentrales Anliegen. Wie unsere Benchmark zeigt, haben die Modelle Schwierigkeiten mit dicht gepackten Visualisierungen. Insbesondere die Zuordnung von Balken zu Jahren und die Wahrnehmung relativer Höhen in komplexen Diagrammen verlaufen mangelhaft, was zu systematischen Fehlern bei der Trendidentifizierung führt. Selbst fortgeschrittene Modelle scheitern an einfachen Aufgaben wie der Ziffernerkennung und der Objektzählung. Die Skalierung der Daten verbessert zwar die Wahrnehmung, nicht aber die Schlussfolgerungen.

Verzerrungen und Interpretationsprobleme sind weit verbreitet. Visuelle Denkmodelle lernen und spiegeln bei der Bildinterpretation Verzerrungen aus ihren Trainingsdaten wider. Diese Verzerrungen beinhalten kulturelle Annahmen und Stereotypen, darunter Geschlechter-, Rassen-, Alters- und Behindertenvorurteile. Beispielsweise können sie bei der Vorhersage des Berufs von Personen auf einem Bild oder der Interpretation von Szenarien die Ergebnisse verfälschen.

Erklärbarkeit ist entscheidend für Vertrauen. Modelle sollten ihren Denkprozess transparent darlegen, insbesondere in sensiblen Anwendungsbereichen wie dem Gesundheitswesen, der Personalbeschaffung und der Strafjustiz, wo verzerrte Ergebnisse Schaden anrichten.

Benchmark-Methodik

Alle Modelle wurden mithilfe der API OpenRouter mit standardisierten Parametern evaluiert: Die Temperatur wurde auf 0,8 gesetzt und der Parameter für die maximale Tokenanzahl nicht festgelegt, um die Argumentationsfähigkeit nicht einzuschränken. Die Modelle wurden angewiesen, ohne weitere Erläuterung nur mit einem einzigen Buchstaben (AE) zu antworten. Einige Modelle lieferten jedoch detaillierte Begründungen, die wir analysierten, um die endgültigen Antworten zu extrahieren. Die Evaluierung erfolgte parallel für alle Modelle gleichzeitig. Jede Frage wurde fünfmal gestellt, um konsistente und zuverlässige Ergebnisse zu gewährleisten.

Der Benchmark-Test umfasste 200 Fragen, die in zwei Kategorien unterteilt waren: Diagrammverständnis (100 Fragen) zu Balkendiagrammen, Liniendiagrammen, Streudiagrammen und komplexen Datenvisualisierungen sowie visuelle Logik (10 Fragen) zur Prüfung von Mustererkennung, räumlichem Vorstellungsvermögen und mathematischer visueller Logik. Alle Fragen wurden im Multiple-Choice-Format mit fünf Antwortmöglichkeiten gestellt und erforderten von den Modellen die Analyse von Bildern und die Auswahl der richtigen Antwort.

Questions:

1. Diagrammverständnis Wir bewerteten die Modelle hinsichtlich ihrer Fähigkeit, Informationen aus verschiedenen Datenvisualisierungen zu extrahieren, zu interpretieren und zu analysieren:

- Balkendiagramme : Horizontale und vertikale Konfigurationen, gestapelte und gruppierte Formate

- Liniendiagramme : Trends einzelner und mehrerer Datenreihen, Zeitreihendaten

- Streudiagramme : Korrelationsanalyse, Mustererkennung mit beschrifteten Achsen

- Kreisdiagramme : Prozentuale Verteilungen und proportionales Denken

- Komplexe Visualisierungen : Kombinationsdiagramme, Zweiachsendiagramme und Mehrfeldanzeigen

2. Visuelle Logik Wir beurteilten abstraktes Denken und räumliches Vorstellungsvermögen durch:

- Mustererkennung : Sequenzen identifizieren und visuelle Muster vervollständigen

- Räumliches Denken : 3D-Visualisierung, Würfelnetze und geometrische Transformationen

- Mathematische Logik : Numerische Muster, algebraisches Denken und Kombinatorik

- Abstraktes Denken : Symbolmanipulation, logisches Schließen und Regelschlussfolgern

Frageformat

- Antwortformat : Mehrfachauswahl (A, B, C, D, E)

Seien Sie der Erste, der kommentiert

Ihre E-Mail-Adresse wird nicht veröffentlicht. Alle Felder sind erforderlich.