Büyük görüntü işleme modelleri (LVM'ler), kusur tespiti, tıbbi teşhis ve çevresel izleme gibi görsel görevleri otomatikleştirebilir ve iyileştirebilir.

Üç nesne algılama modelini (YOLOv8n, DETR ve GPT-4o Vision) her biri 1.000 görüntü üzerinde karşılaştırdık ve mAP@0.5, çıkarım hızı, FLOP'lar ve parametre sayısı gibi ölçütleri değerlendirdik. Adil bir karşılaştırma sağlamak için tüm görüntüler 800×800 piksele yeniden boyutlandırıldı ve aynı ön işleme, güven eşikleri ve IoU tabanlı eşleştirme kriterleri kullanılarak değerlendirildi.

Nesne algılama kıyaslaması: GPT-4o (Vision), YOLOv8n, DETR

mAP@0.5: Doğru pozitifler ve yanlış pozitifler arasındaki dengeyi sağlayarak nesne tespitinin doğruluğunu ölçen, 0,5'lik bir kesişim/birleşim (IoU) eşiğindeki Ortalama Hassasiyet.

Gecikme süresi (ms): Görüntü başına ortalama işlem süresi, milisaniye cinsinden ölçülür ve modelin hızını gösterir.

Karşılaştırma Sonuçları

GPT-4o'nun nesne algılama yetenekleri, YOLOv8n ve DETR gibi özel modellere kıyasla sınırlı kalmaktadır.

Kesinlik:

- DETR: mAP@0.5 = 0.55

- YOLOv8n: 0.20

- GPT-4o: 0.02

Bu sonuçlar, GPT-4o'nun henüz pratik nesne algılama görevleri için uygun olmadığını göstermektedir.

Gecikme süresi:

- YOLOv8n: 365 ms

- DETR: 3145 ms

- GPT-4o: 5150 ms

YOLOv8n en hızlı çıkarımı sunar ancak daha düşük doğruluk oranına sahiptir, DETR ise daha yavaş işlem pahasına daha yüksek doğruluk oranı elde eder.

Tutarlılık sağlamak amacıyla tüm modeller 800×800 çözünürlükte giriş görüntüleri kullanılarak değerlendirilmiştir. Parametre sayıları ve FLOPS değerleri YOLOv8n ve DETR için mevcuttu, ancak GPT-4o için mevcut değildi; bu da hesaplama verimliliğinin tam olarak karşılaştırılmasını engelledi.

Model Karmaşıklığı:

- DETR: 41,52 milyon parametre , 59,56 GFLOPS

- YOLOv8n: 3,15 milyon parametre , 6,83 GFLOPS

Bu, YOLOv8n'nin gerçek zamanlı uygulamalar için verimliliğini gösterirken, DETR daha yüksek doğruluk ve daha fazla hesaplama gereksinimi karşılığında hızdan ödün veriyor. GPT-4o için mimari detayların eksikliği, daha derin verimlilik analizini sınırlıyor.

Karşılaştırma yöntemimizi inceleyin.

Performans farklılıklarının olası nedenleri

Üç model, farklı amaçlar için tasarlandıkları ve görsel bilgileri farklı şekillerde işledikleri için farklı doğruluk ve hız seviyeleri gösterdi. GPT-4o , hem metin hem de görüntüleri kabul eden çok modlu büyük bir dil modelidir; YOLOv8n ve DETR ise yalnızca görüntüler üzerinde çalışan nesne algılama sistemleridir.

GPT-4o, dil tabanlı bir akıl yürütme hattı aracılığıyla görsel girdileri yorumlar. Sahneleri tanımlayabilir ve nesneleri belirleyebilir, ancak sınırlayıcı kutular çizmek veya yüksek hassasiyetli mekansal konumlandırma yapmak için tasarlanmamıştır.

Çıktıları, tespit odaklı mekanizmalardan ziyade çok modlu akıl yürütmeye bağlıdır. Bu da onu tespit görevleri için daha yavaş ve daha az doğru hale getirir.

YOLOv8n ve DETR, nesne tespiti için özel olarak oluşturulmuş mimariler kullanır. Sınır kutularını doğrudan oluştururlar, bunlar hakkında mantıksal çıkarım yapmazlar.

YOLOv8n, hafif yapısıyla hız için optimize edilmiştir; DETR ise YOLO'dan farklı şekilde görüntüleri işleyen ve daha doğru tahminler yapmayı hedefleyen, transformatör tabanlı bir dedektördür.

Her iki model de yalnızca görsel girdilere odaklanır ve görüntü desenlerini nesne konumlarına eşleyen eğitim hedeflerini takip eder.

Başlıca farklılıklar şunlardır:

- Giriş türü

- GPT-4o: resim ve metin

- YOLOv8n ve DETR: yalnızca görüntü

- Birincil işlev

- GPT-4o: çok modlu anlama ve akıl yürütme

- YOLOv8n ve DETR: nesne tespiti

- Çıkış mekanizması

- GPT-4o: doğal olarak sınırlayıcı kutular çizmez

- YOLOv8n ve DETR: sınırlayıcı kutuları doğrudan tahmin eder.

YOLOv8n ve DETR yalnızca nesne tespiti için geliştirildiğinden, doğruluk ve gecikme süresine odaklanan kıyaslama testlerinde doğal olarak daha iyi performans gösterirler.

GPT-4o'nun geniş, algılama merkezli olmayan çok modlu tasarımı, aynı ortamda değerlendirildiğinde daha düşük mAP ve daha yüksek çıkarım süreleriyle sonuçlanmaktadır.

Büyük görüntü işleme modellerinin detaylı değerlendirmesi

OpenAI GPT-4o (Vizyon)

GPT-4o (Vizyon), hem metin hem de görüntülerden yanıtlar işlemek ve üretmek üzere tasarlanmış, OpenAI'in GPT-4'sinin çok modlu bir uzantısıdır.

Bu özellik, GPT-4o'nun metinsel bilgilerin yanı sıra görsel içeriği de yorumlamasına olanak tanıyarak, görüntüleri anlama ve analiz etme gerektiren bir dizi uygulamayı mümkün kılar.

- Görüntü yorumlama: GPT-4o, nesneleri tanımlama, sahneleri yorumlama ve görsellerden metinsel bilgi çıkarma dahil olmak üzere görüntülerin içeriğini analiz edebilir ve tanımlayabilir. Bu da onu görüntü alt yazıları oluşturma ve içerik özetleme gibi görevler için kullanışlı hale getirir.

- Görsel veri analizi: Model, grafikleri, çizelgeleri ve diyagramları yorumlayarak görsel verilere dayalı içgörüler ve açıklamalar sunabilir. Bu özellik, veri analizi ve eğitim uygulamaları için faydalıdır.

- Çok modlu içerik anlama: GPT-4o metin ve görüntü girdilerini birleştirerek daha kapsamlı yanıtlar sağlayabilir. Ayrıca sosyal medya analizi ve içerik denetimi uygulamalarını da geliştirebilir. Örneğin, hem metin hem de görüntü içeren gönderilerde duygu değerlendirmesi yapabilir veya yanlış bilgileri tespit edebilir.

Gelişmiş yeteneklerine rağmen, GPT-4o bazen hatalı veya güvenilmez çıktılar üretebilir. Görsel öğeleri yanlış yorumlayabilir, ayrıntıları gözden kaçırabilir veya yanlış bilgiler üretebilir; bu da kritik görevler için insan doğrulaması gerektirir.

Model, eğitim verilerinde mevcut olan önyargıları da yansıtabilir; bu da çarpık yorumlara veya kalıplaşmış yargıların pekişmesine yol açabilir. Bu durum, demografik çıkarım veya içerik denetimi gibi tarafsızlığın çok önemli olduğu hassas uygulamalarda endişe kaynağıdır.

OpenAI Sora

Sora, OpenAI tarafından oluşturulmuş bir metinden videoya dönüştürme modelidir. Kullanıcı komutlarından kısa video klipler üretir ve mevcut videoları da uzatabilir. Temel teknolojisi, DALL-E 3 modelinin bir uyarlamasıdır.

Sora, bir difüzyon dönüştürücüsü, yani bir Transformer kullanan, gürültü giderme özelliğine sahip gizli difüzyon modelidir. Videolar başlangıçta 3 boyutlu "yama"ların gürültüden arındırılmasıyla gizli bir alanda oluşturulur, ardından bir video sıkıştırma çözücüsü kullanılarak standart alana dönüştürülür.

Yeniden altyazı ekleme, video-metin modelinin videolar için ayrıntılı altyazılar oluşturduğu eğitim sürecini geliştirmek için kullanılır.

En son gelişmelerle birlikte, kullanıcılar artık 1080p çözünürlüğe kadar, maksimum 20 saniye süreli ve geniş ekran, dikey veya kare en boy oranlarında videolar oluşturabiliyorlar. Ayrıca, mevcut içeriği genişletmek, yeniden düzenlemek ve harmanlamak için kendi varlıklarını entegre edebiliyor veya metin komutlarından yeni videolar oluşturabiliyorlar.

Şekil 1: Sora'nın "Açık bir çölde yünlü mamut ailesinin geniş, sakin bir görüntüsü" komutunu kullanarak oluşturduğu video örneği. 1

Landing AI LandingLens

LandingLens, bilgisayar görüşü modellerinin geliştirilmesini ve dağıtımını basitleştirir. Derin yapay zeka veya karmaşık programlama uzmanlığı gerektirmeden çeşitli sektörlere hizmet vermektedir.

Platform, derin öğrenme çözümlerini standartlaştırarak geliştirme süresini kısaltıyor ve projelerin küresel ölçekte kolayca yaygınlaştırılmasını sağlıyor. Kullanıcılar, üretim hızını etkilemeden kendi derin öğrenme modellerini oluşturabilir ve denetim doğruluğunu optimize edebilirler.

Geliştirme sürecini basitleştiren adım adım bir kullanıcı arayüzü sunar.

Şekil 2: Diyagram, LandingLens yapay zeka iş akışını göstermektedir; burada girdi görüntüleri veriye dönüştürülür, modelleri eğitmek için kullanılır, bulut, uç cihaz veya Docker aracılığıyla dağıtılır ve geri bildirim yoluyla sürekli olarak iyileştirilir. 2

Kararlı Difüzyon

Stable Diffusion, metinsel açıklamalardan yüksek kaliteli görüntüler oluşturmak için tasarlanmış bir derin öğrenme modelidir:

- Kararlı Difüzyon, difüzyon prensibine dayanmaktadır. Süreç, bir görüntüye rastgele gürültü eklenmesiyle başlar ve model daha sonra bu gürültüyü tersine çevirerek orijinal görüntüyü yeniden oluşturmayı öğrenir.

- Bu süreç, modelin gürültülü girdiyi birden fazla adımda iyileştirerek, net ve tutarlı bir görüntü ortaya çıkana kadar tamamen yeni görüntüler üretmesini sağlar.

Stable Diffusion, verimliliği artırmak için gizli bir difüzyon modeli kullanır. Yüksek çözünürlüklü görüntülerle doğrudan çalışmak yerine, öncelikle varyasyonel otoenkoder (VAE) kullanarak bunları daha düşük boyutlu bir gizli alana sıkıştırır.

Bu yaklaşım, hesaplama gereksinimlerini önemli ölçüde azaltarak, GPU'lu tüketici donanımlarında çalışmayı mümkün kılıyor.

Uygulamalar:

Stable Diffusion, metinden görseller oluşturmanın yanı sıra, aşağıdakiler gibi çeşitli yaratıcı görevler için de kullanılabilir:

- Resim içi onarım: Bir resmin eksik kısımlarını onarmak veya doldurmak.

- Dış boyama: Daha fazla içerik eklemek için bir görüntünün kenarlarını genişletme.

- Görüntüden Görüntüye Çeviri: Mevcut bir görüntüyü farklı bir stile dönüştürme veya metin girişine bağlı olarak görünümünü değiştirme.

Yolculuğun ortası

Midjourney, metin açıklamalarını yüksek kaliteli görüntülere dönüştüren bir sanat oluşturma aracıdır.

Yetenekler

Midjourney Version 7, kalite ve işlevsellik açısından önemli iyileştirmelerle tamamen yeniden inşa edilmiş bir mimariye sahiptir.

Görüntü oluşturma : V7, olağanüstü hızlı hassasiyet ve neredeyse fotoğraf kalitesinde, 2048 x 2048 piksel çözünürlüğünde büyütülmüş görüntüler üretir. Başlıca iyileştirmeler arasında daha zengin dokular, eller ve yüzler gibi karmaşık unsurların doğru işlenmesi ve aydınlatma ve kompozisyonun gelişmiş bir şekilde anlaşılması yer almaktadır.

Video oluşturma : Kare kare tutarlılığı yüksek, 5-21 saniyelik video klipler oluşturur. Sistem, yaklaşık üç saatte altı görüntüden yaklaşık 60 saniyelik video üretir ve pazarlama, film yapımı ve içerik oluşturma alanlarındaki profesyonel uygulamaları hedefler.

3B yetenekleri : NeRF benzeri modelleme kullanan metinden 3B'ye dönüştürme özelliği, hacimsel nesneler ve sürükleyici sahneler oluşturur. Bu özellikler oyun geliştirme, ürün görselleştirme ve mimari uygulamaları destekler.

Şekil 3: Midjourney'nin görüntü düzenleme özelliği. 3

DeepMind Flamingo

DeepMind'ın Flamingo modeli, minimum eğitim örneği kullanarak (az örnekle öğrenme) görüntüleri ve videoları anlamak ve bunlar hakkında akıl yürütmek için tasarlanmış bir görsel-dil modelidir. İşte bazı temel özellikleri:

- Çok modlu az örnekle öğrenme: Flamingo, kapsamlı etiketli veri kümelerine ihtiyaç duyan geleneksel yapay zeka modellerinin aksine, yalnızca birkaç örnekle yeni görevleri verimli bir şekilde gerçekleştirebilir.

- Algılayıcı Yeniden Örnekleyici Mekanizması: Flamingo, görsel girdileri verimli bir şekilde işlemek için bir "Algılayıcı Yeniden Örnekleyici" kullanır. Görüntü ve video verilerini, önceden eğitilmiş büyük bir dil modeline entegre edilebilecek bir biçime sıkıştırır.

- Kapılı Çapraz Dikkat Katmanları ile Görsel-Dil Uyumu: Özel Kapılı Çapraz Dikkat katmanları, Flamingo'nun görsel verileri metinsel akıl yürütmeyle hizalamasına ve bütünleştirmesine yardımcı olur. Bu uygulama, görüntü tabanlı konuşmaları anlamak için önemli olabilir.

Flamingo, kare bazlı işlemeyi kullanarak videoları ana karelere ayırır ve görsel öğeleri verimli bir şekilde analiz etmek için bilgi çıkarır.

Bağlam duyarlı yanıtları, videodaki olayların ilerleyişine bağlı olarak altyazılar, açıklamalar ve yanıtlar oluşturmaya yardımcı olarak içeriğin tutarlı bir şekilde anlaşılmasını sağlar.

Ayrıca Flamingo, zaman içindeki sıralamaları, neden-sonuç ilişkilerini ve karmaşık etkileşimleri anlamak için zamansal akıl yürütme yeteneği sergiler. Bu da onu video analizi ve çok modlu akıl yürütme görevleri için son derece etkili kılar.

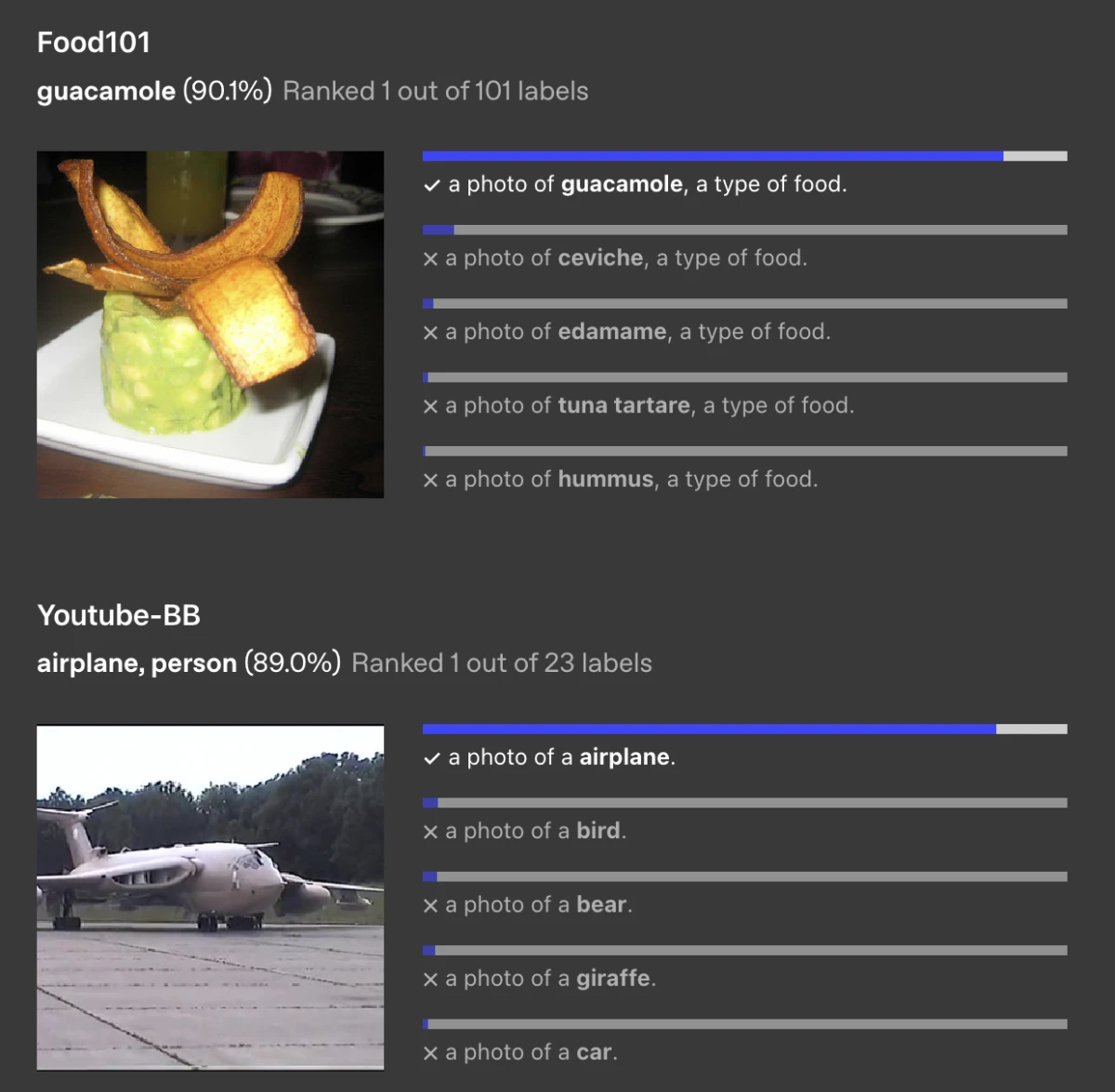

OpenAI'in CLIP'i (Kontrastif Dil-Görüntü Ön Eğitimi)

CLIP, çeşitli görüntüler ve metin alt yazıları üzerinde eğitilmiş bir sinir ağıdır.

Bu model, görüntüleri doğal dil bağlamında anlayarak sıfır atışlı sınıflandırma da dahil olmak üzere çeşitli görme görevlerini yerine getirebilir.

CLIP, bilgisayar görüşü görevleri ile doğal dil işleme arasındaki boşluğu etkili bir şekilde kapatmak için 400 milyon (görüntü, metin) çifti üzerinde eğitilmiştir. Bu, CLIP'in bu özel görevler için açıkça eğitilmesine gerek kalmadan altyazı tahminleri veya görüntü özetleri yapmasına yardımcı olur.

Şekil 4: Çeşitli veri kümelerinden CLIP ile görüntü tanımlama. 4

Google'un Vizyon Dönüştürücüsü (ViT)

Vision Transformer, doğal dil işlemede kullanılan transformatör mimarisini görüntü tanıma görevlerine uyguluyor.

Görüntüleri, transformatörlerin kelime dizilerini işleme biçimine benzer bir şekilde işler ve sınıflandırma ve analiz görevleri için görüntü verilerinden ilgili özellikleri öğrenmede etkili olduğu gösterilmiştir.

Vision Transformer'da görüntüler bir dizi yama olarak ele alınır. Her yama, metin için kullanılan dönüştürücülerde kelime gömülerinin kullanımına benzer şekilde, tek bir vektöre dönüştürülür.

Bu yaklaşım, ViT'nin görüntünün yapısını öğrenmesine ve sınıf etiketlerini bağımsız olarak tahmin etmesine olanak tanır.

Video tabanlı temel modeller

Video tabanlı temel modeller, geleneksel bilgisayar görüşü yaklaşımlarından köklü bir değişimi temsil eder. Videoları bağımsız kare dizileri olarak işleyen önceki sistemlerin aksine, bu modeller zamanı görsel verilerin ayrılmaz bir boyutu olarak ele alır.

Önemli mimari yenilikler

OpenAI'in Sora'sı, difüzyon transformatör mimarisi aracılığıyla bu evrimi örneklemektedir:

- 3D uzamsal-zamansal yamalar : Video verilerini kare kare değil, bütünsel olarak işler.

- Zamansal tutarlılık : Sahneler boyunca görsel kaliteyi ve anlatısal tutarlılığı korur.

- Uzun menzilli bağımlılıklar : Sebep-sonuç ilişkilerini ve hareket modellerini yakalar.

- Fizik kurallarına duyarlı üretim : Gerçekçi hareketleri ve nesne etkileşimlerini anlar.

Mevcut başvurular

İçerik oluşturma:

- Otomatik video düzenleme ve sahne sentezi

- Zamansal tutarlılıkla stil aktarımı

- Metin komutlarından anlatısal video oluşturma

Tıbbi görüntüleme:

- Ekokardiyogramlarda kalp hareketi analizi

- Anjiyografide kan akışının görüntülenmesi

- Dinamik doku davranışı değerlendirmesi

Güvenlik ve gözetim:

- Aktivite tanıma ve izleme

- Anomaly zaman içinde tespit

- Bağlam duyarlı davranış analizi

Kalan zorluklar

İlerleme kaydedilmesine rağmen, bazı sınırlamalar devam etmektedir:

- Hesaplama maliyeti : Uzun metrajlı video üretimi hala kaynak yoğun bir süreçtir.

- Fiziksel olasılık : Karmaşık senaryolar gerçekçi olmayan fiziksel sonuçlar doğurabilir.

- Karakter tutarlılığı : Uzun sekanslar boyunca kimliği korumak zordur.

- Eğitim gereksinimleri : Ek açıklamalar içeren büyük ölçekli video veri kümeleri az bulunur ve pahalıdır.

Cihaz içi çıkarım ve uç nokta optimizasyonu

Uç nokta dağıtımı, görüntü işleme modellerinin akıllı telefonlarda, IoT cihazlarında ve gömülü sistemlerde yerel olarak çalışmasını sağlayarak bulut altyapısına olan bağımlılığı ortadan kaldırır.

Uç nokta dağıtımının önemi

Gizlilik avantajları:

- Hassas görsel veriler asla cihazdan dışarı çıkmaz.

- Sağlık hizmetleri, gözetim ve kişisel uygulamalar için kritik öneme sahip.

- Veri koruma yönetmeliklerine uyum

Performans avantajları:

- Ağ gidiş gelişleri olmadan neredeyse sıfır gecikme süresi

- Artırılmış Gerçeklik ve Otonom Sistemler için Gerçek Zamanlı İşleme

- Çevrimdışı ortamlarda güvenilir çalışma

Maliyet verimliliği:

- Bant genişliği tüketiminde azalma

- Bulut bilişim giderlerini düşürün

- Minimum devam eden işletme maliyetleri

Model sıkıştırma teknikleri

Büyük ölçekli görüntü işleme modellerini uç cihazlarda kullanılabilir hale getirmek, gelişmiş optimizasyon gerektirir:

- Nicelleştirme : Hassasiyeti 32 bitten 8 bit veya 4 bit tamsayıya düşürür.

- Daha küçük model boyutu

- Minimum doğruluk kaybı

- Budama : Gereksiz parametreleri ve bağlantıları kaldırır.

- Seyrek ağlar oluşturur.

- Daha az hesaplama ile performansı korur.

- Bilgi damıtma : Bilgiyi büyük modellerden küçük modellere aktarır.

Büyük ölçekli görsel model (LVM) nedir?

Büyük görme modelleri (ÖVM'ler), görüntüler veya videolar gibi görsel verileri işlemek, analiz etmek ve yorumlamak için tasarlanmıştır. Genellikle milyonlarca veya milyarlarca parametreye sahip olmalarıyla karakterize edilirler. Bu, görsel içerikteki karmaşık desenleri, özellikleri ve ilişkileri öğrenmelerini sağlar.

Metin için kullanılan büyük dil modelleri (LLM'ler) gibi, LVM'ler de geniş veri kümeleri üzerinde eğitilir ve bu da onlara nesne tanıma, görüntü oluşturma, sahne anlama ve çok modlu akıl yürütme (görsel ve metinsel bilgileri entegre etme) yetenekleri kazandırır.

Bu modeller, otonom sürüş, tıbbi görüntüleme , içerik oluşturma ve artırılmış gerçeklik gibi alanlardaki uygulamaları destekleyebilir.

Yapı ve tasarım

Gelişmiş sinir ağı mimarileri kullanılarak büyük görüntü işleme modelleri oluşturulmaktadır. Başlangıçta, piksel verilerini verimli bir şekilde işleme ve hiyerarşik desenleri tespit etme yetenekleri nedeniyle görüntü işlemede Evrişimsel Sinir Ağları (CNN'ler) baskın konumdaydı.

Son zamanlarda, başlangıçta doğal dil işleme için tasarlanan transformatör modelleri, birçok farklı görüntü işleme görevi için de uyarlanarak bazı senaryolarda daha iyi performans sunmaktadır.

Eğitim

Yeni sıralı modelleme yaklaşımında, büyük görüntü işleme modellerinin eğitilmesi, internetten alınan görüntüler veya videolar gibi görsel verilerin, ilgili etiketler veya açıklamalarla birlikte modellere beslenmesini içerir. Eğiticiler, modellere beslemek için görüntü kütüphanelerini etiketler.

Örneğin, görüntü sınıflandırma görevlerinde, her görüntü ait olduğu sınıf ile etiketlenir. Model, tahminleri ile gerçek etiketler arasındaki farkı en aza indirgemek için parametrelerini ayarlayarak öğrenir.

Bu süreç, modelin yeni ve daha önce görülmemiş verilere iyi bir şekilde genelleme yapabilmesini sağlamak için önemli miktarda hesaplama gücü ve geniş, çeşitli bir veri kümesi gerektirir.

Şekil 3: OpenAI üzerinde büyük görüntü işleme modelleri eğitim diyagramı. 5

Görüntü sınıflandırması için eğitim verileri hakkında daha fazla bilgi edinmek için görüntü veri toplama hizmetlerine göz atın.

Büyük boyutlu görüntüleme modellerinin temel özellikleri

Model Tipi, bir görme modelinin mimarisine ve tasarım prensiplerine atıfta bulunur. Modelin görsel verileri nasıl işlediğini ve yorumladığını, birden fazla yöntemi (örneğin, metin ve görüntüler) entegre edip etmediğini ve anlamlı temsiller çıkarmak için hangi temel mekanizmaları (örneğin, dönüştürücüler, karşılaştırmalı öğrenme, difüzyon) kullandığını tanımlar:

- Transformer tabanlı Çok Modlu LLM: Transformer'ları çok modlu yeteneklerle birleştiren bir model mimarisi. Hem görsel hem de metinsel girdileri aynı anda anlama sürecini mümkün kılar. Çoklu veri türlerinde karmaşık akıl yürütme gerçekleştirmek için büyük ölçekli veri kümeleri kullanılarak eğitilir.

- Karşılaştırmalı Öğrenme: Modellerin benzer ve benzer olmayan veri noktaları arasında ayrım yapabilmesi için kullanılan bir tekniktir. Bu süreç, ilgili girdilerin benzerliğini en üst düzeye çıkarırken, ilgisiz girdilerin benzerliğini en aza indirmeyi içerir. Bu teknik, özellik temsilini iyileştirmek için genellikle kendi kendine denetimli öğrenmede kullanılır.

- Yapay Zeka Görüntüleme Platformu: Bu sistem , görüntü tanıma , nesne tespiti ve segmentasyon gibi çeşitli bilgisayar görüşü görevleri için altyapı, araçlar ve önceden eğitilmiş modeller sağlar. Tipik olarak model eğitimi, dağıtımı ve çıkarım yeteneklerini içerir.

- Transformer: Giriş verilerini işlemek için öz dikkat mekanizmalarını kullanan bir derin öğrenme mimarisi. Modellerin uzun menzilli bağımlılıkları yakalamasına olanak tanıyarak doğal dil ve görme ile ilgili görevler için etkili hale gelir.

- Difüzyon Modeli: Başlangıçtaki gürültülü girdiden gürültüyü kademeli olarak gideren ve net ve yapılandırılmış bir çıktı üretmek için adım adım iyileştiren üretken bir modeldir. Genellikle görüntü oluşturma ve iyileştirme için kullanılır.

Eğitim hedefi: Bir modelin verilerden nasıl öğrendiğini yönlendiren amaç veya optimizasyon fonksiyonu. Modelin, belirli görevlerde performansını artırmak için eğitim sırasında iç parametrelerini nasıl ayarlayacağını belirler. Bunlar, bir sonraki veri noktasını tahmin etme (otoregresif), benzer/benzer olmayan girdileri ayırt etme (kontrastlı öğrenme) veya görüntüleri kategorilere ayırma olabilir:

- Otoregresif: Bir modelin, daha önce gözlemlenen girdilere dayanarak bir dizideki bir sonraki veri noktasını tahmin ettiği bir eğitim yaklaşımıdır. Bu, genellikle dil modellemesinde ve üretken görme modellerinde kullanılır.

- Karşılaştırmalı Öğrenme: Modelin benzer ve benzer olmayan veri çiftleri arasında ayrım yaparak öğrendiği, kendi kendine denetlenen bir öğrenme hedefidir. Açık etiketler olmadan anlamlı temsiller yakalama yeteneğini geliştirmeye yardımcı olur.

- Denetimli Öğrenme: Modelin etiketlenmiş veriler kullanılarak eğitildiği bir öğrenme paradigmasıdır; yani her girdi, karşılık gelen doğru bir çıktı ile ilişkilendirilir. Bu yaklaşım, sınıflandırma ve segmentasyon gibi görevlerde yaygın olarak kullanılır.

- Görüntü Sınıflandırma: Bir modelin, görsel özelliklere dayanarak görüntüleri önceden tanımlanmış sınıflara ayırmayı öğrendiği özel bir eğitim hedefidir. Eğitim süreci, sınıflandırma doğruluğunu en üst düzeye çıkarmak için bir kayıp fonksiyonunun optimize edilmesini içerir.

- Gürültü Giderme Yayılımı: Gürültülü girdilerden temiz görüntüler elde etmek için bir modelin eğitildiği üretken bir öğrenme yaklaşımıdır. Bu süreç, görüntü yeniden yapılandırmasını ve üretimini iyileştirmek için aşamalı bir gürültü ekleme sürecini tersine çevirmeyi içerir.

İnce ayar desteği: Bir modelin, ön eğitim aşamasından elde ettiği bilgileri korurken, daha küçük, alana özgü veri kümeleri üzerinde eğitilerek belirli görevlere uyarlanabilme yeteneği.

İnce ayar, özel uygulamalarda performansı artırmaya yardımcı olur.

Sıfır atışlı/Az atışlı öğrenme: Bir modelin, göreve özgü eğitim verisi olmadan veya çok az veriyle görevleri yerine getirme yeteneği.

Sıfır örnekle öğrenme, daha önce görülmemiş kategoriler üzerinde çıkarım yapılmasına olanak tanırken, az örnekle öğrenme ise minimum etiketli örnekle uyum sağlamayı mümkün kılar.

Çok Modlu Destek: Bir modelin birden fazla yöntemden (örneğin metin, görüntü, ses) gelen bilgileri işleme ve bütünleştirme yeteneği.

Açık kaynaklı mı, tescilli mi?: Açık kaynaklı modellerin kodları ve ağırlıkları herkese açık olup, topluluk tarafından değiştirilmesine ve kullanılmasına olanak tanır.

Tescilli modeller özel kuruluşlara aittir ve onlar tarafından kontrol edilir; bu durum erişimi ve özelleştirmeyi sınırlayabilir.

Uç Nokta Dağıtımı: Bir modelin bulut tabanlı sunuculara bağımlı kalmak yerine uç cihazlarda (örneğin, cep telefonları, IoT cihazları) çalışabilme yeteneği.

Uç nokta dağıtımı, gecikmeyi azaltmaya, gizliliği artırmaya ve kaynak kısıtlı ortamlarda gerçek zamanlı işlemeyi mümkün kılmaya yardımcı olur.

Büyük ölçekli görüntü işleme modellerinin kullanım alanları nelerdir?

Sağlık hizmetleri ve tıbbi görüntüleme

- Hastalık teşhisi : Tümörleri, kırıkları veya anormallikleri belirlemek için röntgen, MR veya BT taramaları gibi tıbbi görüntüleme yöntemlerinden hastalıkların saptanması.

- Patoloji : Patoloji laboratuvarlarında doku örneklerinin kanser belirtileri açısından incelenmesi.

- Oftalmoloji : Retina görüntülerinden hastalıkların teşhis edilmesi.

Otonom araçlar ve robotik

- Navigasyon ve engel tespiti : Otonom araçların ve dronların gerçek zamanlı görsel verileri yorumlayarak navigasyon yapmalarına ve engellerden kaçınmalarına yardımcı olur.

- Üretimde robotik : Robotlara sıralama, montaj ve kalite kontrol görevlerinde yardımcı olmak.

Güvenlik ve gözetim

- Aktivite izleme : Olağandışı veya şüpheli davranışları tespit etmek için video kayıtlarının analiz edilmesi.

- Yüz tanıma : Kimlik doğrulama ve izleme için güvenlik sistemlerinde kullanılır. Örneğin, Amazon Rekognition, Amazon Web Services (AWS) tarafından sunulan, yüz algılama ve tanıma, nesne ve sahne tanımlama ve metin çıkarma gibi görüntü ve video analiz özellikleri sağlayan bulut tabanlı bir hizmettir. Duyguları, yaş aralıklarını ve aktiviteleri analiz edebilir; bu da kişiselleştirme ve güvenlik için faydalı olacaktır.

Aşağıdaki videoda Amazon Rekognition'ın nasıl çalıştığını görebilirsiniz. 6

Perakende ve E-ticaret

- Görsel arama : Müşterilerin metin yerine görseller kullanarak ürün aramasına olanak tanır.

- Envanter yönetimi : Görsel tanıma yoluyla envanterin izlenmesi ve yönetilmesinin otomasyonu.

Tarım

- Mahsul izleme ve analizi : Drone veya uydu görüntüleri kullanarak mahsul sağlığını ve büyümesini izleme.

- Zararlı tespiti : Mahsulleri etkileyen zararlıları ve hastalıkları belirleme.

Çevresel izleme

- Yaban hayatı takibi : Koruma çalışmalarını desteklemek amacıyla yaban hayvanlarını tespit etme ve izleme.

- Arazi kullanımı ve arazi örtüsü analizi : Zaman içinde arazi kullanımındaki ve bitki örtüsündeki değişikliklerin izlenmesi.

İçerik oluşturma ve eğlence

- Film ve video düzenleme : Video düzenleme ve post-prodüksiyon süreçlerinin otomasyonu.

- Oyun geliştirme : Gerçekçi ortam ve karakter yaratımının geliştirilmesi.

- Fotoğraf ve video iyileştirme : Görüntü ve videoların kalitesini artırma.

- İçerik denetimi : Uygunsuz veya zararlı görsel içerikleri otomatik olarak tespit edip işaretleme.

Büyük ölçekli görüntüleme modellerinin zorlukları nelerdir?

Hesaplama kaynakları

Bu modellerin eğitilmesi ve devreye alınması önemli miktarda işlem gücü ve bellek gerektirir, bu da onları kaynak yoğun hale getirebilir.

Veri gereksinimleri

Eğitim için geniş ve çeşitli veri kümelerine ihtiyaç duyuyorlar. Bu kadar büyük veri kümelerini toplamak, etiketlemek ve işlemek zorlu ve pahalı olabilir. Ancak, kitlesel kaynak kullanan şirketler bu konuda yardımcı olabilir .

Önyargı ve adalet

Modeller, eğitim verilerinde mevcut olan önyargıları devralabilir ve bu da özellikle yüz tanıma gibi hassas uygulamalarda adaletsiz veya etik dışı sonuçlara yol açabilir.

Yorumlanabilirlik ve açıklanabilirlik

Bu modellerin nasıl karar verdiğini anlamak zor olabilir; bu durum, şeffaflığın kritik önem taşıdığı uygulamalar için önemlidir. Bu sürecin nasıl işlediğini ve yapay zeka etiğine nasıl hizmet ettiğini öğrenmek için Açıklanabilir Yapay Zeka'ya göz atın .

Genelleme

Eğitim setlerine benzer verilerde iyi performans gösterirken, tamamen yeni veya farklı veri türlerinde zorlanabilirler.

Gizlilik endişeleri

Özellikle gözetim ve yüz tanıma alanlarında büyük görsel modellerin kullanılması, önemli gizlilik endişelerini beraberinde getiriyor.

Düzenleyici ve etik zorluklar

Bu modellerin yasal ve etik standartlara uygun olmasını sağlamak, özellikle toplumla daha fazla bütünleştikçe, giderek daha önemli hale geliyor.

Nesne algılama kıyaslama metodolojisi

Bu karşılaştırmada, YOLOv8n, DETR (DEtection TRansformer) ve GPT-4o Vision nesne algılama modellerinin performansları COCO 2017 doğrulama veri kümesi üzerinde karşılaştırılmıştır. Karşılaştırma için model başına 1000 görüntü kullanılmıştır. Modeller arasında tutarlı giriş boyutları sağlamak için tüm görüntüler 800×800 piksele yeniden boyutlandırılmıştır.

YOLOv8n modeli, Ultralytics deposundan önceden eğitilmiş ağırlıklarla (yolov8n.pt) yüklendi ve çıkarım, Ultralytics YOLO API'si aracılığıyla predict() yöntemi kullanılarak gerçekleştirildi. DETR modeli, Facebook Araştırma kütüphanesinden detr_resnet50 mimarisiyle yüklendi ve orijinal olarak [center_x, center_y, width, height] formatında normalize edilmiş çıktıları yeniden ölçeklendirilerek [x1, y1, x2, y2] koordinat formatına dönüştürüldü. Her iki modelin sonuçlarına da 0,5'lik bir güven eşiği uygulandı.

GPT-4o Vision modeli, nesne algılama yetenekleri için OpenAI'in API'si kullanılarak değerlendirildi. Bu model için, COCO doğrulama veri setinden görüntüler indirildi, açıklamalar yüklendi ve her görüntü API'ye gönderilmeden önce uygun formata dönüştürüldü (800×800 piksele yeniden boyutlandırıldı). Yalnızca COCO sınıflarına ait algılamalar JSON formatında talep edildi ve API tarafından döndürülen tahminler aynı güven eşiği (0,5) ve koordinat formatı kullanılarak değerlendirildi.

Değerlendirmede, modellerin tahmin ettiği sınırlayıcı kutular, kesişim oranı (IoU) hesaplanarak gerçek kutularla karşılaştırıldı; IoU ≥ 0,5 gerçek pozitif eşleşme olarak kabul edildi. Her sınıf için Ortalama Hassasiyet (AP) hesaplandı ve tüm sınıfların ortalaması mAP@0,5 metriği olarak rapor edildi. Doğruluğun yanı sıra, çıkarım süreleri de ölçüldü ve karşılaştırıldı. Ek olarak, model karmaşıklığı FLOP'lar ve toplam parametre sayılarına göre analiz edildi.

Adil bir karşılaştırma sağlamak için, tüm model çıkarımları aynı donanım üzerinde (aynı GPU/CPU) gerçekleştirildi. Tüm modellerde aynı ön işleme adımları uygulandı; tüm görüntüler 800×800 piksele yeniden boyutlandırıldı ve gerekli normalizasyon uygulandı. Son işlem için, tahminler aynı koordinat formatına dönüştürüldü, tutarlı bir şekilde 0,5 güven eşiği uygulandı ve değerlendirme sırasında tek tip IoU hesaplama kriterleri benimsendi.

Bu çerçevede, YOLOv8n, DETR ve GPT-4o Vision modeli, nesne algılama performansı ve hızı açısından karşılaştırıldı; GPT-4o Vision'ın yeteneklerini mevcut nesne algılama modelleriyle karşılaştırmak için ek ayarlamalar ve yöntemler kullanıldı.

Çözüm

Büyük ölçekli görüntü işleme modelleri (LVM'ler), sağlık hizmetleri, otonom sistemler, güvenlik ve yaratıcı endüstriler de dahil olmak üzere çeşitli alanlarda makinelerin görsel verileri yorumlama ve bunlara göre hareket etme biçimini değiştiriyor.

LVM'ler, transformatörler ve difüzyon modelleri gibi gelişmiş mimarilerden yararlanarak, tıbbi görüntüleme, gerçek zamanlı nesne tespiti, metinden görüntü oluşturma ve video oluşturma dahil olmak üzere çok çeşitli karmaşık görevleri destekler.

Geniş ve çok modlu veri kümelerinden öğrenme yetenekleri, bulut tabanlı çıkarımdan uç bilişime kadar uzanan esnek dağıtım senaryolarına olanak tanıyarak, endüstriyel denetimden kişiselleştirilmiş içerik oluşturmaya kadar uzanan özel uygulamalar geliştirmeyi mümkün kılıyor.

Ancak bu yetenekler önemli zorlukları da beraberinde getiriyor. LVM'lerin eğitilmesi ve dağıtılmasının hesaplama maliyeti yüksek olup, genellikle güçlü donanım ve özel altyapı gerektiriyor.

Veri yanlılığı, sınırlı yorumlanabilirlik ve gözetim ile gizlilikle ilgili etik kaygılar gibi sorunlar, dikkatli model yönetiminin gerekliliğinin altını çizmektedir. LVM'ler gelişmeye devam ettikçe, çeşitli sektörlerde etkili ve adil bir şekilde kullanılmalarını sağlamak için yenilik ve sorumluluk arasında bir denge kurmak çok önemli olacaktır.

Yorum yapan ilk kişi olun

E-posta adresiniz yayınlanmayacak. Tüm alanlar gereklidir.